Ultralytics YOLO26重新定义尖端视觉人工智能

2026年1月14日

Ultralytics 在速度、简易性和实际部署能力方面树立视觉AI新标杆——从边缘设备到大规模服务器皆可胜任。

2026年1月14日

Ultralytics 在速度、简易性和实际部署能力方面树立视觉AI新标杆——从边缘设备到大规模服务器皆可胜任。

今日,我们正式Ultralytics 该模型树立了尖端性能的新基准。该模型由我们的创始人兼首席执行官Glenn Jocher在伦敦YOLO 2025(YV25)大会上首次发布,是迄今为止我们最先进且可部署的模型。

YOLO26专为轻量化、紧凑型和高速运行而设计,旨在满足现实世界中实时视觉AI应用的实际运行需求。该模型内置原生端到端推理功能,可简化部署流程、降低系统复杂度,并在边缘设备及大规模生产环境中提供稳定可靠的性能表现。

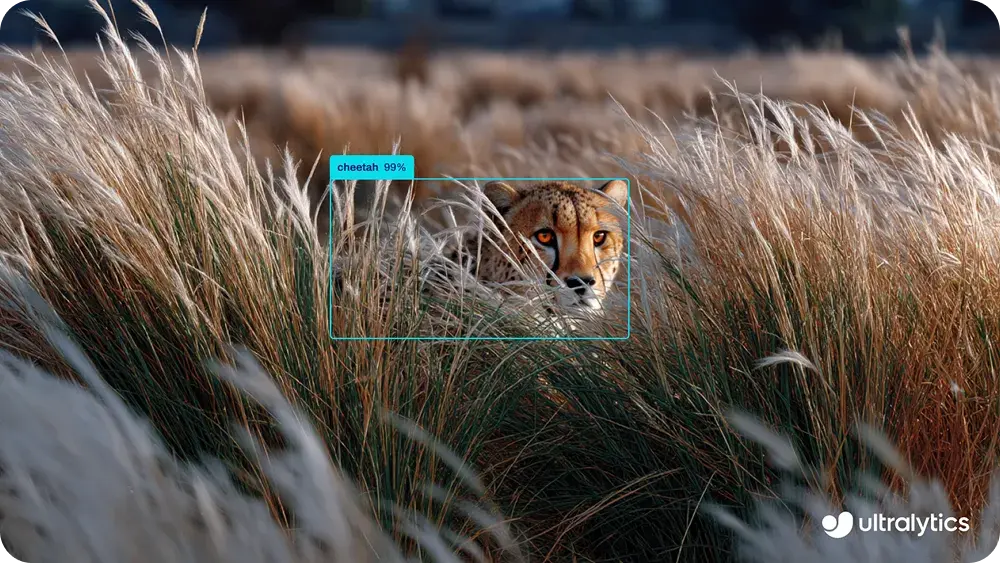

事实上,YOLO26的最小版本——nano模型——在标准CPU上的运行速度提升高达43%,为移动应用、智能摄像头及其他边缘设备提供了高效的实时视觉AI解决方案。Ultralytics"让强大的视觉AI能力触手可及"的愿景,YOLO26将顶尖性能与简易性完美融合,使其易于使用和部署。

计算机视觉正迅速突破云端限制。现实世界中的应用日益要求在无人机、摄像头、移动系统和嵌入式平台等设备上实现实时推理、低延迟、硬件灵活性及可预测的性能表现。

YOLO26正是为实现这一转变而专门构建的。通过从根本上重新设计目标检测管道Ultralytics 一种模型架构,在消除不必要复杂性的同时,实现了顶尖的准确率与运行速度。

例如,Ultralytics 模型依赖于一个名为非最大抑制(NMS)的额外后处理步骤,用于在推理后过滤重叠预测结果。YOLO26通过实现原生端到端推理消除了这一额外步骤,使模型能够直接输出最终检测结果。这使得模型能够更快、更可预测且更可靠地部署于实际应用场景。

YOLO26并非渐进式更新,它标志着生产级视觉人工智能在训练、部署和扩展方式上的结构性飞跃。

.webp)

YOLO26 的关键优势之一在于它如何继承了早期模型的优点,例如 Ultralytics YOLO11 ,同时拓展了计算机视觉的边界。开箱即用时,YOLO26支持YOLO11相同的核心计算机视觉任务,包括目标检测、实例分割和图像分类。

该模型还持续支持姿势估计 、面向边界框的航空与卫星影像目标检测,以及跨视频流的目标追踪。YOLO11,YOLO26提供五种模型变体:Nano(n)、Small(s)、Medium(m)、Large(l)和Extra large(x),为用户提供兼顾速度、体积与精度的选择方案。

Ultralytics 旨在提升性能、可靠性和实际应用性的改进。以下是YOLO26的主要功能一览:

YOLO26的开发凝聚了团队研究成果,并融合了来自社区、合作伙伴及客户的宝贵反馈。我们致力于简化架构、提升效率,使模型更适应实际应用场景。

回顾这一历程时,格伦·乔克解释道:"最大的挑战之一在于确保用户能充分利用YOLO26,同时保持顶尖性能。"他的观点凸显了YOLO26的核心设计原则:让视觉人工智能保持易用性。

对此观点,我们的高级机器学习工程师景秋补充道:"YOLO 关键在于稳扎稳打,不急不躁。我持续优化模型,专注于速度与精度的平衡。当最终成果呈现时,那种静谧的满足感油然而生——这正是专注细节终有回报的明证。"

Ultralytics 即日起通过Ultralytics 向公众开放,全面支持训练、推理及导出工作流。在商业或封闭环境中部署 YOLO26 的机构可获取企业级许可方案,该方案涵盖生产环境部署支持、长期维护服务及可扩展的边缘部署能力。

与我们之前的模型一样,该模型Ultralytics Python 获得全面支持,使用户能够立即上手使用。用户可以使用熟悉的简化工作流来训练、验证和部署YOLO26,同时还能利用多种导出选项,ONNX、TensorRT、CoreML、TFLite、OpenVINO。

Ultralytics 标志着我们在推动视觉人工智能更快、更轻量、更易用方面迈出的新一步。但这仅仅是个开始。

真正的影响力源于视觉人工智能社区以此创造的成果。我们期待见证您的创新,并继续携手共塑计算机视觉的未来。

加入我们的社区,探索GitHub代码库,深入了解人工智能。发现行业解决方案,如机器人技术中的AI应用和物流领域的计算机视觉技术,了解我们的许可选项,立即开始构建计算机视觉项目。

开启您的机器学习未来之旅