Entdecken Sie die besten Objekterkennungsmodelle des Jahres 2025 und werfen Sie einen Blick auf beliebte Architekturen, Kompromisse bei der Leistung und praktische Faktoren für den Einsatz.

Entdecken Sie die besten Objekterkennungsmodelle des Jahres 2025 und werfen Sie einen Blick auf beliebte Architekturen, Kompromisse bei der Leistung und praktische Faktoren für den Einsatz.

Anfang dieses Jahres stellte Andrew Ng, ein Pionier im Bereich KI und maschinelles Lernen, das Konzept der agentenbasierten Objekterkennung vor. Bei diesem Ansatz detect mithilfe eines schlussfolgernden Agenten auf Grundlage einer Textanweisung detect , ohne dass dafür große Mengen an Trainingsdaten erforderlich sind.

Die Fähigkeit, Objekte in Bildern und Videos zu identifizieren, ohne dass dafür riesige beschriftete Datensätze erforderlich sind, ist ein Schritt in Richtung intelligenterer und flexiblerer Computer-Vision-Systeme. Allerdings befindet sich die agentenbasierte Vision-KI noch in einem frühen Stadium.

Es kann zwar allgemeine Aufgaben wie die Erkennung von Personen oder Straßenschildern in einem Bild bewältigen, doch präzisere Computer-Vision-Anwendungen basieren nach wie vor auf traditionellen Objekterkennungsmodellen. Diese Modelle werden anhand großer, sorgfältig gekennzeichneter Datensätze trainiert, um genau zu lernen, wonach sie suchen müssen und wo sich Objekte befinden.

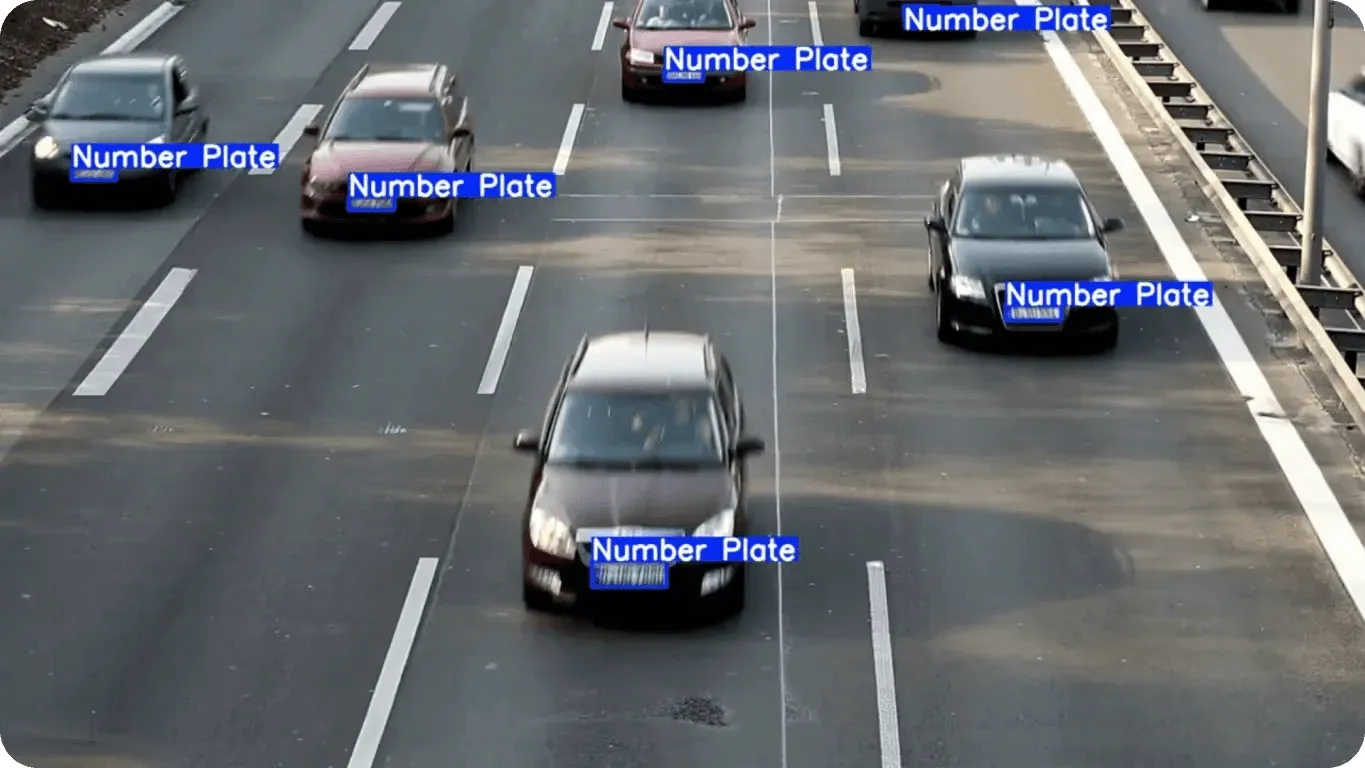

Die traditionelle Objekterkennung ist unverzichtbar, da sie sowohl die Erkennung, also die Identifizierung des Objekts, als auch die Lokalisierung, also die genaue Bestimmung seiner Position im Bild, ermöglicht. Diese Kombination ermöglicht es Maschinen, komplexe Aufgaben in der realen Welt zuverlässig auszuführen, von autonomen Fahrzeugen über industrielle Automatisierung bis hin zur Diagnostik im Gesundheitswesen.

Dank technologischer Fortschritte werden Modelle zur Objekterkennung immer besser, schneller, genauer und besser für reale Umgebungen geeignet. In diesem Artikel stellen wir Ihnen einige der besten derzeit verfügbaren Modelle zur Objekterkennung vor. Los geht's!

Computer-Vision-Aufgaben wie die Bildklassifizierung können verwendet werden, um festzustellen, ob ein Bild ein Auto, eine Person oder ein anderes Objekt enthält. Sie können jedoch nicht bestimmen, wo sich das Objekt innerhalb des Bildes befindet.

Hier kann die Objekterkennung aufschlussreich sein. Objekterkennungsmodelle können identifizieren, welche Objekte vorhanden sind, und auch ihre genauen Positionen bestimmen. Dieser als Lokalisierung bezeichnete Prozess ermöglicht es Maschinen, Szenen genauer zu verstehen und angemessen zu reagieren, sei es beim Anhalten eines selbstfahrenden Autos, beim Steuern eines Roboterarms oder beim Hervorheben eines Bereichs in der medizinischen Bildgebung.

Der Aufstieg des Deep Learning hat die Objekterkennung revolutioniert. Anstatt sich auf manuell programmierte Regeln zu stützen, lernen moderne Modelle Muster direkt aus Anmerkungen und visuellen Daten. Diese Datensätze vermitteln den Modellen, wie Objekte aussehen, wo sie normalerweise vorkommen und wie sie mit Herausforderungen wie kleinen Objekten, unübersichtlichen Szenen oder wechselnden Lichtverhältnissen umgehen können.

Tatsächlich können modernste Objekterkennungssysteme detect Objekte gleichzeitig präzise detect . Damit ist die Objekterkennung eine wichtige Technologie für Anwendungen wie autonomes Fahren, Robotik, Gesundheitswesen und industrielle Automatisierung.

Die Eingabe für ein Objekterkennungsmodell ist ein Bild, das von einer Kamera, einem Videobild oder sogar einem medizinischen Scan stammen kann. Das Eingabebild wird durch ein neuronales Netzwerk verarbeitet, in der Regel ein Convolutional Neural Network (CNN), das darauf trainiert ist, Muster in visuellen Daten zu erkennen.

Innerhalb des Netzwerks wird das Bild schrittweise analysiert. Auf Grundlage der erkannten Merkmale sagt das Modell voraus, welche Objekte vorhanden sind und wo sie erscheinen.

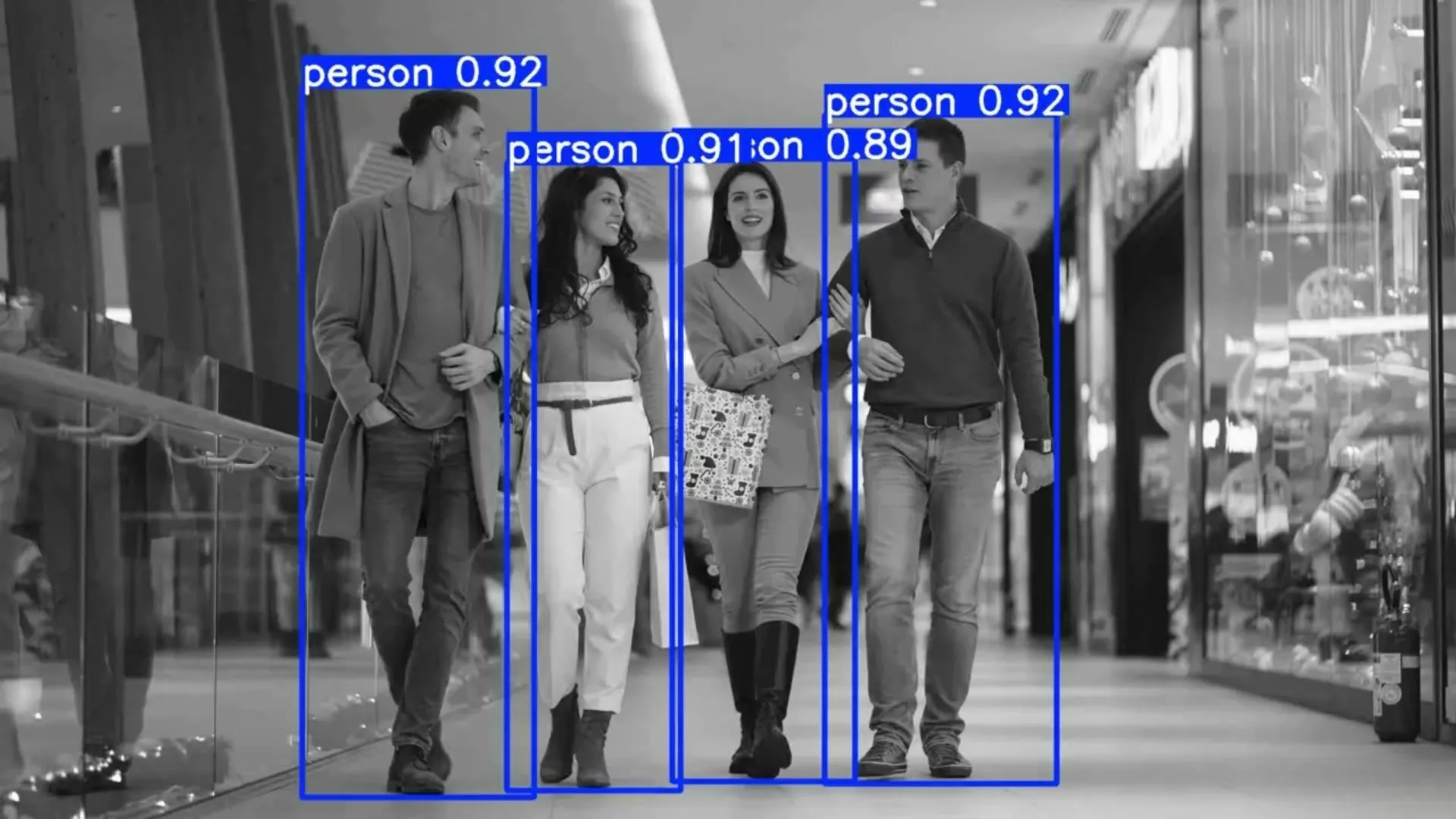

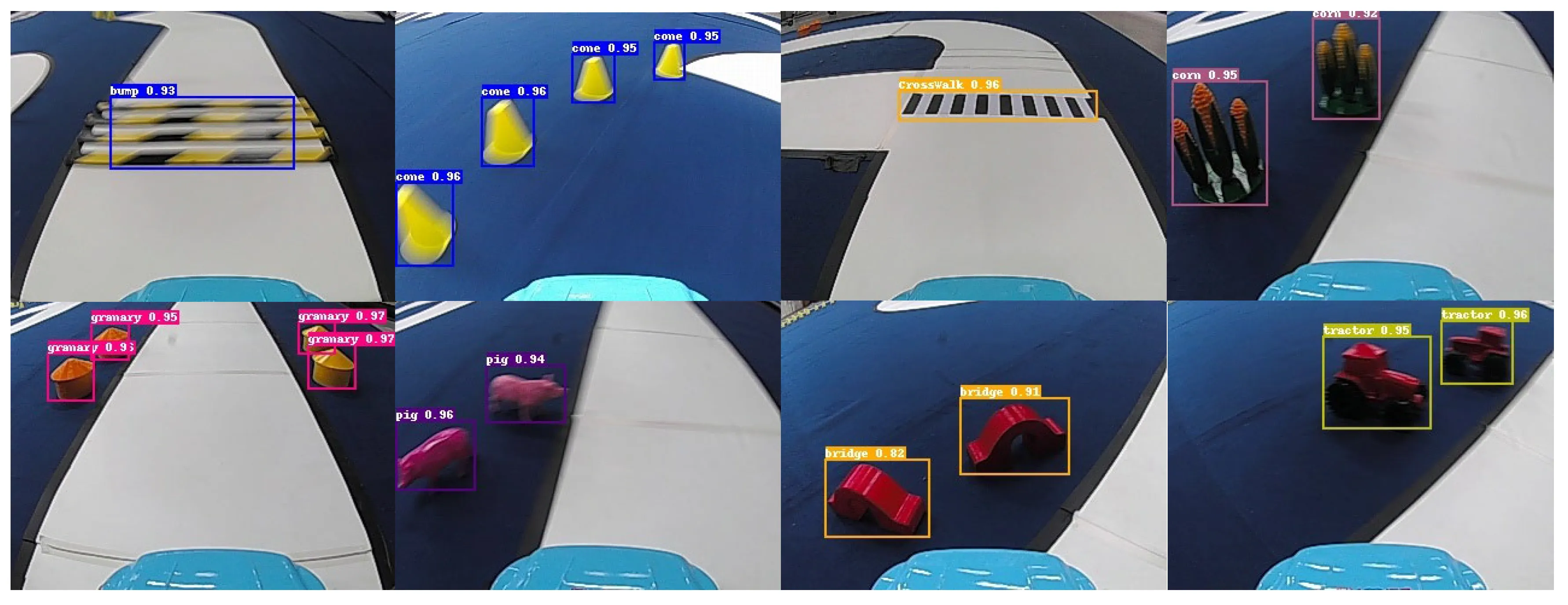

Diese Vorhersagen werden mithilfe von Begrenzungsrahmen dargestellt, bei denen es sich um Rechtecke handelt, die um jedes erkannte Objekt herum gezeichnet werden. Jedem Begrenzungsrahmen weist das Modell eine Klassenbezeichnung (z. B. Auto, Person oder Hund) und einen Konfidenzwert zu, der angibt, wie sicher die Vorhersage ist (dies kann auch als Wahrscheinlichkeit betrachtet werden).

Der gesamte Prozess stützt sich in hohem Maße auf die Merkmalsextraktion. Das Modell lernt, nützliche visuelle Muster wie Kanten, Formen, Texturen und andere Unterscheidungsmerkmale zu identifizieren. Diese Muster werden in Merkmalskarten kodiert, die dem Netzwerk helfen, das Bild auf mehreren Detailebenen zu verstehen.

Je nach Modellarchitektur verwenden Objektdetektoren unterschiedliche Strategien zur Lokalisierung von Objekten, wobei sie ein Gleichgewicht zwischen Geschwindigkeit, Genauigkeit und Komplexität herstellen.

Viele Objekterkennungsmodelle, insbesondere zweistufige Detektoren wie Faster R-CNN, konzentrieren sich auf bestimmte Teile des Bildes, die als Regionen von Interesse (ROIs) bezeichnet werden. Durch die Konzentration auf diese Bereiche priorisiert das Modell Regionen, die mit größerer Wahrscheinlichkeit Objekte enthalten, anstatt jedes Pixel gleichermaßen zu analysieren.

Andererseits wählen einstufige Modelle wie frühe YOLO keine bestimmten ROIs aus, wie dies bei zweistufigen Modellen der Fall ist. Stattdessen unterteilen sie das Bild in ein Raster und verwenden vordefinierte Boxen, sogenannte Ankerboxen, zusammen mit Merkmalskarten, um Objekte im gesamten Bild in einem Durchgang vorherzusagen.

Heutzutage werden in modernsten Objekterkennungsmodellen ankerfreie Ansätze erforscht. Im Gegensatz zu herkömmlichen einstufigen Modellen, die auf vordefinierten Ankerboxen basieren, sagen ankerfreie Modelle die Position und Größe von Objekten direkt anhand von Merkmalskarten voraus. Dies kann die Architektur vereinfachen, den Rechenaufwand reduzieren und die Leistung verbessern, insbesondere bei der Erkennung von Objekten unterschiedlicher Formen und Größen.

Heute gibt es viele Modelle zur Objekterkennung, die jeweils für bestimmte Ziele entwickelt wurden. Einige sind für Echtzeitleistung optimiert, während andere auf höchste Genauigkeit ausgelegt sind. Die Wahl des richtigen Modells für eine Computer-Vision-Lösung hängt oft von Ihrem speziellen Anwendungsfall und Ihren Leistungsanforderungen ab.

Als Nächstes wollen wir uns einige der besten Objekterkennungsmodelle des Jahres 2025 ansehen.

Eine der heute am häufigsten verwendeten Familien von Objekterkennungsmodellen ist die Ultralytics YOLO . YOLO, kurz für „You Only Look Once“ (Du schaust nur einmal hin), ist branchenübergreifend beliebt, da es eine starke Erkennungsleistung bietet und gleichzeitig schnell, zuverlässig und einfach zu handhaben ist.

DieYOLO umfasst Ultralytics YOLOv5, Ultralytics YOLOv8, Ultralytics YOLO11und das in Kürze erscheinende Ultralytics bieten eine Reihe von Optionen für unterschiedliche Leistungs- und Anwendungsanforderungen. Dank ihres schlanken Designs und ihrer Geschwindigkeitsoptimierung eignen sichYOLO Ultralytics YOLO ideal für die Echtzeit-Erkennung und können auf Edge-Geräten mit begrenzter Rechenleistung und begrenztem Speicher eingesetzt werden.

Über die grundlegende Objekterkennung hinaus sind diese Modelle äußerst vielseitig. Sie unterstützen auch Aufgaben wie die Instanzsegmentierung, bei der Objekte auf Pixelebene umrissen werden, und die Posenschätzung, bei der wichtige Punkte an Personen oder Objekten identifiziert werden. Diese Flexibilität machtYOLO Ultralytics zu einer ersten Wahl für eine Vielzahl von Anwendungen, von der Landwirtschaft und Logistik bis hin zum Einzelhandel und zur Fertigung.

Ein weiterer wichtiger Grund für die BeliebtheitYOLO Ultralytics ist das Ultralytics Python , das eine einfache und benutzerfreundliche Oberfläche für das Training, die Feinabstimmung und die Bereitstellung von Modellen bietet. Entwickler können mit vortrainierten Gewichten beginnen, die Modelle an ihre eigenen Datensätze anpassen und sie mit nur wenigen Zeilen Code bereitstellen.

RT‑DETR (Real-Time Detection Transformer) und das neuere RT‑DETRv2 sind Objekterkennungsmodelle, die für den Echtzeitgebrauch entwickelt wurden. Im Gegensatz zu vielen herkömmlichen Modellen können sie ein Bild aufnehmen und die endgültigen Erkennungsergebnisse direkt ausgeben, ohne Non-Maximum Suppression (NMS) zu verwenden.

NMS ein Schritt, der überflüssige überlappende Boxen entfernt, wenn ein Modell dasselbe Objekt mehrmals vorhersagt. Durch das Überspringen von NMS der Erkennungsprozess einfacher und schneller.

Diese Modelle kombinieren CNNs mit Transformatoren. Das CNN findet visuelle Details wie Kanten und Formen, während der Transformator eine Art neuronales Netzwerk ist, das das gesamte Bild auf einmal betrachten und verstehen kann, wie verschiedene Teile miteinander in Beziehung stehen. Dieses umfassende Verständnis ermöglicht es dem Modell, detect , die nahe beieinander liegen oder sich überlappen.

RT‑DETRv2 verbessert das ursprüngliche Modell durch Funktionen wie die mehrstufige Erkennung, mit der sowohl kleine als auch große Objekte gefunden werden können, und eine bessere Verarbeitung komplexer Szenen. Durch diese Änderungen bleibt das Modell schnell und verbessert gleichzeitig die Genauigkeit.

RF‑DETR ist ein Echtzeitmodell auf Transformer-Basis, das die Genauigkeit von Transformer-Architekturen mit der für reale Anwendungen erforderlichen Geschwindigkeit kombiniert. Wie RT‑DETR und RT‑DETRv2 verwendet es einen Transformer zur Analyse des gesamten Bildes und ein CNN zur Extraktion feiner visueller Merkmale wie Kanten, Formen und Texturen.

Das Modell prognostiziert Objekte direkt aus dem Eingabebild und überspringt dabei Ankerboxen und Nicht-Maximalunterdrückung, was den Erkennungsprozess vereinfacht und die Inferenz schnell hält. RF‑DETR unterstützt auch Instanzsegmentierung, wodurch es zusätzlich zur Prognose von Begrenzungsrahmen Objekte auf Pixelebene umreißen kann.

EfficientDet wurde Ende 2019 veröffentlicht und ist ein Objekterkennungsmodell, das für effiziente Skalierung und hohe Leistung entwickelt wurde. Was EfficientDet auszeichnet, ist die zusammengesetzte Skalierung, eine Methode, bei der die Eingabeauflösung, die Netzwerktiefe und die Netzwerkbreite gleichzeitig skaliert werden, anstatt nur einen Faktor anzupassen. Dieser Ansatz hilft dem Modell, eine stabile Genauigkeit aufrechtzuerhalten, unabhängig davon, ob es für Hochleistungsaufgaben hochskaliert oder für leichtgewichtige Bereitstellungen herunterskaliert wird.

Eine weitere Schlüsselkomponente von EfficientDet ist sein effizientes Feature Pyramid Network (FPN), das es dem Modell ermöglicht, Bilder in mehreren Maßstäben zu analysieren. Diese mehrstufige Analyse ist entscheidend für die Erkennung von Objekten unterschiedlicher Größe und ermöglicht es EfficientDet, sowohl kleine als auch große Objekte innerhalb desselben Bildes zuverlässig zu identifizieren.

PP-YOLOE+ wurde 2022 veröffentlicht und ist ein Objektdetektionsmodell YOLO, d. h. es erkennt und klassifiziert Objekte in einem einzigen Durchgang über das Bild. Dieser Ansatz macht es schnell und für Echtzeitanwendungen geeignet, während gleichzeitig eine hohe Genauigkeit gewährleistet bleibt.

Eine der wichtigsten Verbesserungen in PP-YOLOE+ ist das aufgabenorientierte Lernen, wodurch die Konfidenzwerte des Modells besser widerspiegeln, wie genau Objekte lokalisiert werden. Dies ist besonders nützlich für die Erkennung kleiner oder überlappender Objekte.

Das Modell verwendet außerdem eine entkoppelte Kopfarchitektur, die die Aufgaben der Vorhersage von Objektpositionen und Klassenbezeichnungen voneinander trennt. Dadurch kann es Begrenzungsrahmen präziser zeichnen und Objekte gleichzeitig korrekt klassifizieren.

GroundingDINO ist ein transformatorbasiertes Objekterkennungsmodell, das Bildverarbeitung und Sprache kombiniert. Anstatt sich auf einen festen Satz von Kategorien zu stützen, ermöglicht es Benutzern, detect mithilfe von Textbefehlen in natürlicher Sprache detect .

Durch die Zuordnung visueller Merkmale aus einem Bild zu Textbeschreibungen kann das Modell Objekte lokalisieren, selbst wenn diese genauen Bezeichnungen nicht in seinen Trainingsdaten enthalten waren. Das bedeutet, dass Sie dem Modell Beschreibungen wie „eine Person, die einen Helm trägt“ oder „ein rotes Auto in der Nähe eines Gebäudes“ vorgeben können, woraufhin es präzise Begrenzungsrahmen um passende Objekte generiert.

Durch die Unterstützung der Zero-Shot-Erkennung reduziert GroundingDINO außerdem die Notwendigkeit, das Modell für jeden neuen Anwendungsfall neu zu trainieren oder fein abzustimmen, wodurch es für eine Vielzahl von Anwendungen äußerst flexibel einsetzbar ist. Diese Kombination aus Sprachverständnis und visueller Erkennung eröffnet neue Möglichkeiten für interaktive und adaptive KI-Systeme.

Wenn Sie verschiedene Objekterkennungsmodelle vergleichen, fragen Sie sich vielleicht, wie Sie feststellen können, welches Modell tatsächlich die beste Leistung erbringt. Das ist eine gute Frage, denn neben der Modellarchitektur und der Qualität Ihrer Daten können viele Faktoren die Leistung beeinflussen.

Forscher stützen sich häufig auf gemeinsame Benchmarks und Standard-Leistungskennzahlen, um Modelle konsistent zu bewerten, Ergebnisse zu vergleichen und Kompromisse zwischen Geschwindigkeit und Genauigkeit zu verstehen. Standard-Benchmarks sind besonders wichtig, da viele Objekterkennungsmodelle anhand derselben Datensätze bewertet werden, beispielsweise dem COCO .

Hier finden Sie eine genauere Betrachtung einiger gängiger Metriken, die zur Bewertung von Objekterkennungsmodellen verwendet werden:

Hier sind einige der wichtigsten Vorteile der Verwendung von Objekterkennungsmodellen in realen Anwendungen:

Trotz dieser Vorteile gibt es praktische Einschränkungen, die sich auf die Leistung von Objekterkennungsmodellen auswirken können. Hier sind einige wichtige Faktoren, die es zu berücksichtigen gilt:

Das beste Objekterkennungsmodell für Ihr Computer-Vision-Projekt hängt von Ihrem Anwendungsfall, Ihrer Datenkonfiguration, Ihren Leistungsanforderungen und Ihren Hardwarebeschränkungen ab. Einige Modelle sind auf Geschwindigkeit optimiert, während andere den Schwerpunkt auf Genauigkeit legen. Die meisten realen Anwendungen benötigen jedoch ein ausgewogenes Verhältnis zwischen beiden Faktoren. Dank Open-Source-Frameworks und aktiven Communities auf GitHub lassen sich diese Modelle immer einfacher bewerten, anpassen und für den praktischen Einsatz bereitstellen.

Weitere Informationen finden Sie in unserem GitHub-Repository. Werden Sie Teil unserer Community und besuchen Sie unsere Lösungsseiten, um mehr über Anwendungen wie KI im Gesundheitswesen und Computer Vision in der Automobilindustrie zu erfahren. Entdecken Sie unsere Lizenzoptionen und starten Sie noch heute mit Vision AI.

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens