Explore os melhores modelos de deteção de objetos em 2025, com uma análise das arquiteturas populares, compromissos de desempenho e fatores práticos de implementação.

Explore os melhores modelos de deteção de objetos em 2025, com uma análise das arquiteturas populares, compromissos de desempenho e fatores práticos de implementação.

No início deste ano, Andrew Ng, pioneiro em IA e aprendizagem automática, apresentou o conceito de deteção de objetos por agentes. Essa abordagem utiliza um agente de raciocínio para detect com base em um prompt de texto, sem a necessidade de grandes quantidades de dados de treino.

Ser capaz de identificar objetos em imagens e vídeos sem precisar de enormes conjuntos de dados rotulados é um passo em direção a sistemas de visão computacional mais inteligentes e flexíveis. No entanto, a IA de visão agênica ainda está em seus estágios iniciais.

Embora seja capaz de lidar com tarefas gerais, como detetar pessoas ou sinais de trânsito numa imagem, aplicações de visão computacional mais precisas ainda dependem de modelos tradicionais de deteção de objetos. Esses modelos são treinados em grandes conjuntos de dados cuidadosamente rotulados para aprender exatamente o que procurar e onde os objetos estão localizados.

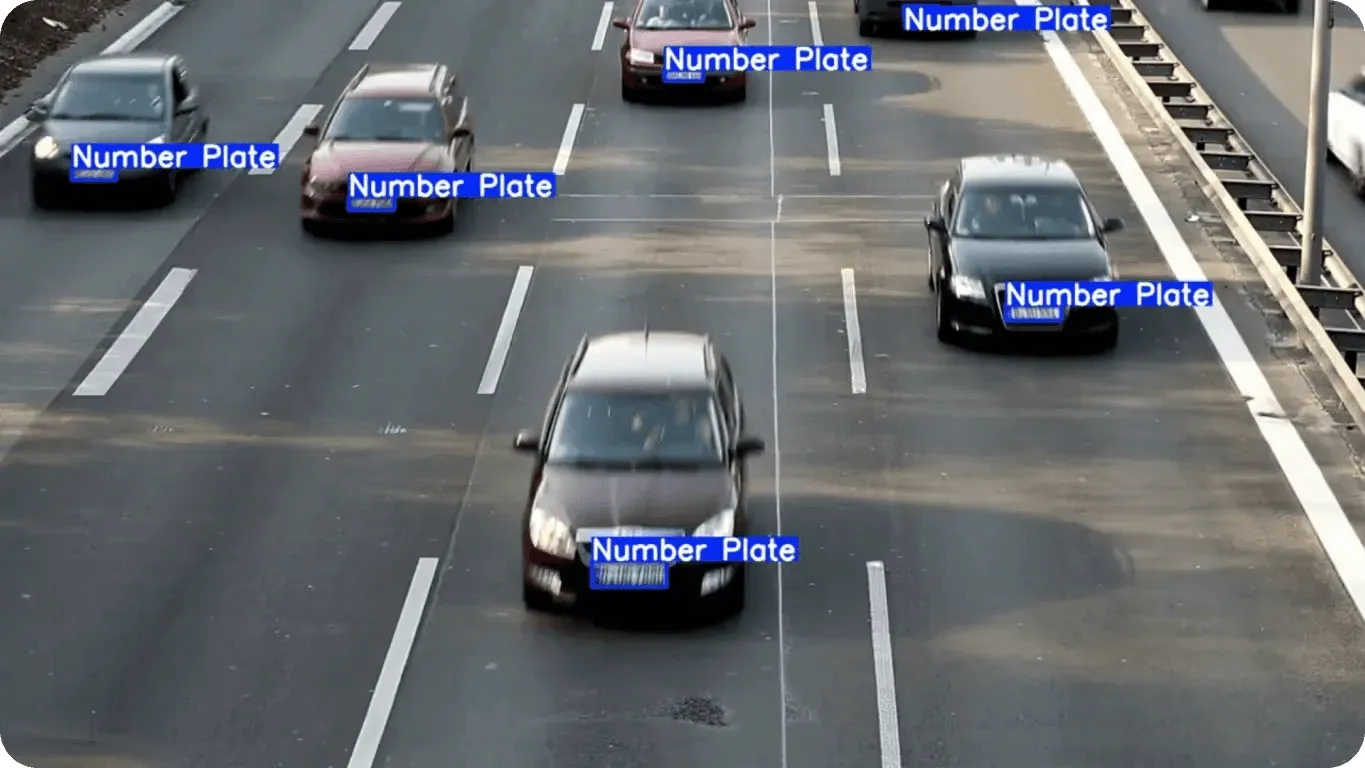

A deteção tradicional de objetos é essencial porque fornece tanto o reconhecimento, identificando o que é o objeto, quanto a localização, determinando exatamente onde ele está na imagem. Essa combinação permite que as máquinas realizem tarefas complexas do mundo real de forma confiável, desde veículos autónomos até automação industrial e diagnósticos de saúde.

Graças aos avanços tecnológicos, os modelos de deteção de objetos continuam a melhorar, tornando-se mais rápidos, precisos e adequados para ambientes do mundo real. Neste artigo, vamos apresentar alguns dos melhores modelos de deteção de objetos disponíveis atualmente. Vamos começar!

Tarefas de visão computacional, como classificação de imagens, podem ser usadas para determinar se uma imagem contém um carro, uma pessoa ou outro objeto. No entanto, elas não conseguem determinar onde o objeto está localizado dentro da imagem.

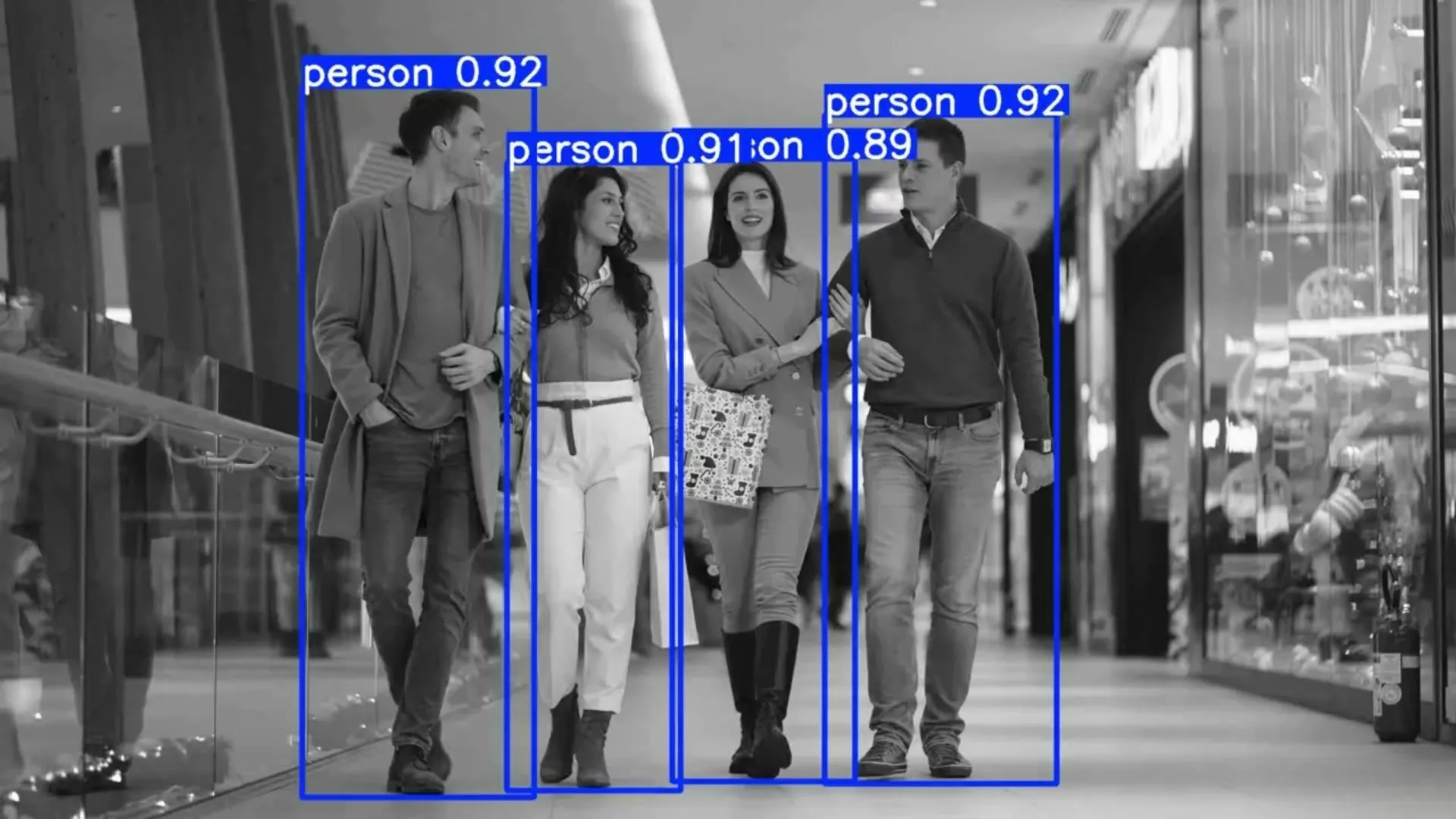

É aqui que a deteção de objetos pode ser útil. Os modelos de deteção de objetos podem identificar quais objetos estão presentes e também localizar suas posições exatas. Esse processo, conhecido como localização, permite que as máquinas compreendam as cenas com mais precisão e respondam adequadamente, seja para parar um carro autônomo, guiar um braço robótico ou destacar uma área em imagens médicas.

O surgimento do deep learning transformou a deteção de objetos. Em vez de depender de regras codificadas manualmente, os modelos modernos aprendem padrões diretamente a partir de anotações e dados visuais. Esses conjuntos de dados ensinam aos modelos como são os objetos, onde costumam aparecer e como lidar com desafios como objetos pequenos, cenas confusas ou condições de iluminação variáveis.

Na verdade, os sistemas de deteção de objetos de última geração podem detect com precisão detect objetos ao mesmo tempo. Isso torna a deteção de objetos uma tecnologia essencial em aplicações como condução autónoma, robótica, cuidados de saúde e automação industrial.

A entrada para um modelo de deteção de objetos é uma imagem, que pode vir de uma câmara, um fotograma de vídeo ou até mesmo um exame médico. A imagem de entrada é processada por uma rede neural, normalmente uma rede neural convolucional (CNN), que é treinada para reconhecer padrões em dados visuais.

Dentro da rede, a imagem é analisada em etapas. Com base nas características que detecta, o modelo prevê quais objetos estão presentes e onde eles aparecem.

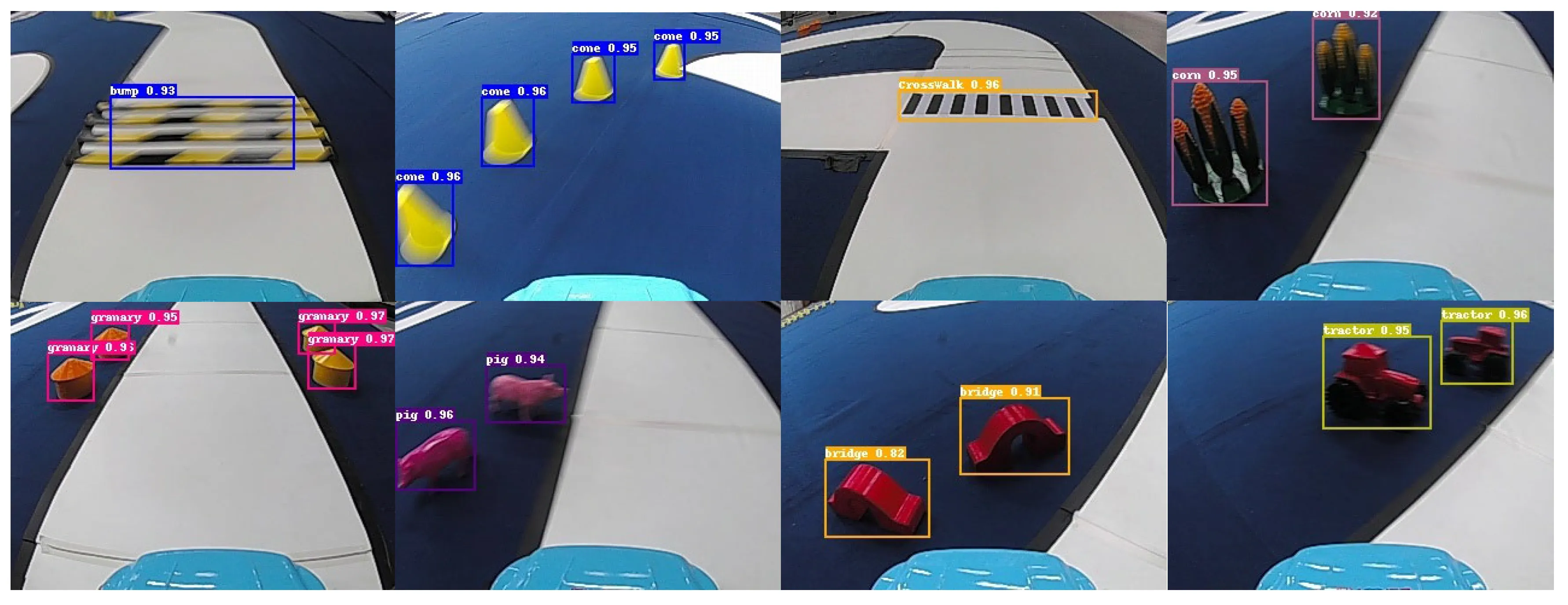

Essas previsões são representadas por caixas delimitadoras, que são retângulos desenhados em torno de cada objeto detetado. Para cada caixa delimitadora, o modelo atribui um rótulo de classe (por exemplo, carro, pessoa ou cão) e uma pontuação de confiança indicando o grau de certeza da previsão (isso também pode ser considerado uma probabilidade).

O processo geral depende fortemente da extração de características. O modelo aprende a identificar padrões visuais úteis, como bordas, formas, texturas e outras características distintivas. Esses padrões são codificados em mapas de características, que ajudam a rede a compreender a imagem em vários níveis de detalhe.

Dependendo da arquitetura do modelo, os detectores de objetos utilizam diferentes estratégias para localizar objetos, equilibrando velocidade, precisão e complexidade.

Muitos modelos de deteção de objetos, particularmente detetores de duas etapas como o Faster R-CNN, concentram-se em partes específicas da imagem chamadas regiões de interesse (ROIs). Ao concentrar-se nessas áreas, o modelo prioriza regiões mais propensas a conter objetos, em vez de analisar todos os pixels igualmente.

Por outro lado, modelos de estágio único, como YOLO primeiros YOLO , não selecionam ROIs específicos como os modelos de dois estágios. Em vez disso, eles dividem a imagem em uma grade e usam caixas predefinidas, chamadas caixas âncora, juntamente com mapas de recursos para prever objetos em toda a imagem em uma única passagem.

Atualmente, os modelos de deteção de objetos de ponta estão a explorar abordagens sem âncoras. Ao contrário dos modelos tradicionais de fase única, que dependem de caixas de âncora predefinidas, os modelos sem âncoras prevêem as localizações e os tamanhos dos objetos diretamente a partir de mapas de características. Isso pode simplificar a arquitetura, reduzir a sobrecarga computacional e melhorar o desempenho, especialmente para a deteção de objetos de formas e tamanhos variados.

Hoje, existem muitos modelos de deteção de objetos, cada um projetado com objetivos específicos em mente. Alguns são otimizados para desempenho em tempo real, enquanto outros se concentram em alcançar a maior precisão possível. A escolha do modelo certo para uma solução de visão computacional geralmente depende do seu caso de uso específico e dos requisitos de desempenho.

A seguir, vamos explorar alguns dos melhores modelos de deteção de objetos de 2025.

Uma das famílias de modelos de deteção de objetos mais utilizadas atualmente é a famíliaYOLO Ultralytics YOLO . YOLO, que significa You Only Look Once (Você só precisa olhar uma vez), é popular em todos os setores porque oferece um forte desempenho de deteção, além de ser rápido, confiável e fácil de trabalhar.

YOLO Ultralytics YOLO inclui Ultralytics YOLOv5, Ultralytics YOLOv8, Ultralytics YOLO11e o próximo Ultralytics , oferecendo uma variedade de opções para diferentes requisitos de desempenho e casos de uso. Graças ao seu design leve e otimização de velocidade,YOLO Ultralytics YOLO são ideais para detecção em tempo real e podem ser implementados em dispositivos de ponta com poder de computação e memória limitados.

Além da deteção básica de objetos, esses modelos são altamente versáteis. Eles também suportam tarefas como segmentação de instâncias, que delineia objetos no nível de pixel, e estimativa de pose, que identifica pontos-chave em pessoas ou objetos. Essa flexibilidade tornaYOLO Ultralytics YOLO uma opção ideal para uma ampla gama de aplicações, desde agricultura e logística até retalho e manufatura.

Outra razão importante para a popularidade dosYOLO Ultralytics é o Python Ultralytics , que oferece uma interface simples e intuitiva para treinar, ajustar e implementar modelos. Os programadores podem começar com pesos pré-treinados, personalizar os modelos para os seus próprios conjuntos de dados e implementá-los com apenas algumas linhas de código.

RT‑DETR (Real-Time Detection Transformer) e o mais recente RT‑DETRv2 são modelos de detecção de objetos criados para uso em tempo real. Ao contrário de muitos modelos tradicionais, eles podem capturar uma imagem e fornecer as detecções finais diretamente, sem usar supressão não máxima (NMS).

NMS uma etapa que remove caixas sobrepostas adicionais quando um modelo prevê o mesmo objeto mais de uma vez. Ignorar NMS o processo de deteção mais simples e rápido.

Esses modelos combinam CNNs com transformadores. A CNN encontra detalhes visuais, como bordas e formas, enquanto o transformador é um tipo de rede neural que pode analisar a imagem inteira de uma só vez e compreender como as diferentes partes se relacionam entre si. Essa compreensão abrangente permite que o modelo detect que estão próximos ou sobrepostos.

O RT‑DETRv2 melhora o modelo original com funcionalidades como deteção multiescala, que ajuda a encontrar objetos pequenos e grandes, e melhor tratamento de cenas complexas. Estas alterações mantêm o modelo rápido, melhorando simultaneamente a precisão.

O RF‑DETR é um modelo baseado em transformador em tempo real, projetado para combinar a precisão das arquiteturas de transformador com a velocidade necessária para aplicações do mundo real. Assim como o RT‑DETR e o RT‑DETRv2, ele usa um transformador para analisar a imagem inteira e uma CNN para extrair características visuais precisas, como bordas, formas e texturas.

O modelo prevê objetos diretamente a partir da imagem de entrada, ignorando caixas de ancoragem e supressão não máxima, o que simplifica o processo de deteção e mantém a inferência rápida. O RF‑DETR também suporta segmentação de instâncias, permitindo delinear objetos ao nível do pixel, além de prever caixas delimitadoras.

Lançado no final de 2019, o EfficientDet é um modelo de detecção de objetos projetado para escalabilidade eficiente e alto desempenho. O que diferencia o EfficientDet é a escalabilidade composta, um método que dimensiona a resolução de entrada, a profundidade da rede e a largura da rede simultaneamente, em vez de ajustar apenas um fator. Essa abordagem ajuda o modelo a manter uma precisão estável, seja ele dimensionado para tarefas de alto desempenho ou reduzido para implementações leves.

Outro componente essencial do EfficientDet é a sua eficiente rede piramidal de características (FPN), que permite ao modelo analisar imagens em várias escalas. Essa análise multiescala é crucial para detectar objetos de diferentes tamanhos, permitindo que o EfficientDet identifique com confiabilidade objetos pequenos e grandes na mesma imagem.

Lançado em 2022, o PP-YOLOE+ é um modelo de detecção de objetos YOLO, o que significa que ele detecta e classifica objetos em uma única passagem pela imagem. Essa abordagem o torna rápido e adequado para aplicações em tempo real, mantendo alta precisão.

Uma das principais melhorias no PP-YOLOE+ é a aprendizagem alinhada à tarefa, que ajuda as pontuações de confiança do modelo a refletir a precisão com que os objetos são localizados. Isso é especialmente útil para detectar objetos pequenos ou sobrepostos.

O modelo também utiliza uma arquitetura de cabeça desacoplada, que separa as tarefas de prever localizações de objetos e rótulos de classe. Isso permite desenhar caixas delimitadoras com mais precisão, ao mesmo tempo que classifica os objetos corretamente.

O GroundingDINO é um modelo de detecção de objetos baseado em transformadores que combina visão e linguagem. Em vez de depender de um conjunto fixo de categorias, ele permite que os utilizadores detect usando comandos de texto em linguagem natural.

Ao alinhar as características visuais de uma imagem com descrições de texto, o modelo consegue localizar objetos mesmo que esses rótulos exatos não estejam nos seus dados de treino. Isso significa que pode solicitar ao modelo descrições como «uma pessoa usando um capacete» ou «um carro vermelho perto de um edifício», e ele irá gerar caixas delimitadoras precisas em torno dos objetos correspondentes.

Além disso, ao suportar a deteção zero-shot, o GroundingDINO reduz a necessidade de retreinar ou ajustar o modelo para cada novo caso de uso, tornando-o altamente flexível em uma ampla gama de aplicações. Essa combinação de compreensão de linguagem e reconhecimento visual abre novas possibilidades para sistemas de IA interativos e adaptáveis.

Ao comparar vários modelos de deteção de objetos, pode estar a perguntar-se como saber qual deles realmente tem o melhor desempenho. É uma boa pergunta, porque, além da arquitetura do modelo e da qualidade dos seus dados, muitos fatores podem afetar o desempenho.

Os investigadores costumam basear-se em benchmarks partilhados e métricas de desempenho padrão para avaliar modelos de forma consistente, comparar resultados e compreender as compensações entre velocidade e precisão. Os benchmarks padrão são especialmente importantes porque muitos modelos de deteção de objetos são avaliados com base nos mesmos conjuntos de dados, como o COCO .

Veja abaixo algumas métricas comuns utilizadas para avaliar modelos de deteção de objetos:

Aqui estão algumas das principais vantagens de usar modelos de deteção de objetos em aplicações do mundo real:

Apesar destas vantagens, existem limitações práticas que podem afetar o desempenho dos modelos de deteção de objetos. Aqui estão alguns fatores importantes a considerar:

O melhor modelo de deteção de objetos para o seu projeto de visão computacional depende do seu caso de uso, configuração de dados, requisitos de desempenho e restrições de hardware. Alguns modelos são otimizados para velocidade, enquanto outros se concentram na precisão, e a maioria das aplicações do mundo real precisa de um equilíbrio entre os dois. Graças às estruturas de código aberto e às comunidades ativas no GitHub, esses modelos estão a se tornar mais fáceis de avaliar, adaptar e implementar para uso prático.

Para saber mais, explore o nosso repositório GitHub. Junte-se à nossa comunidade e consulte as nossas páginas de soluções para ler sobre aplicações como IA na área da saúde e visão computacional na indústria automóvel. Descubra as nossas opções de licenciamento para começar a usar o Vision AI hoje mesmo.

Comece sua jornada com o futuro do aprendizado de máquina