Исследование обнаружения мелких объектов с помощью Ultralytics YOLO11

Узнайте, как Ultralytics YOLO11 быстрое и точное обнаружение небольших объектов в реальных приложениях, таких как видеонаблюдение и робототехника.

Узнайте, как Ultralytics YOLO11 быстрое и точное обнаружение небольших объектов в реальных приложениях, таких как видеонаблюдение и робототехника.

Дроны, оснащенные искусственным интеллектом Vision AI, могут летать на высоте сотен метров над землей и при этом detect , который на видеоизображении выглядит как несколько пикселей. На самом деле это обычная задача в таких областях, как робототехника, видеонаблюдение и дистанционное зондирование, где системы должны идентифицировать очень маленькие объекты на изображении.

Однако традиционные модели обнаружения объектов могут испытывать с этим трудности. Небольшие объекты на изображениях и в видео представляют собой очень ограниченную визуальную информацию. Проще говоря, когда модель рассматривает их, ей нечего изучать или распознавать.

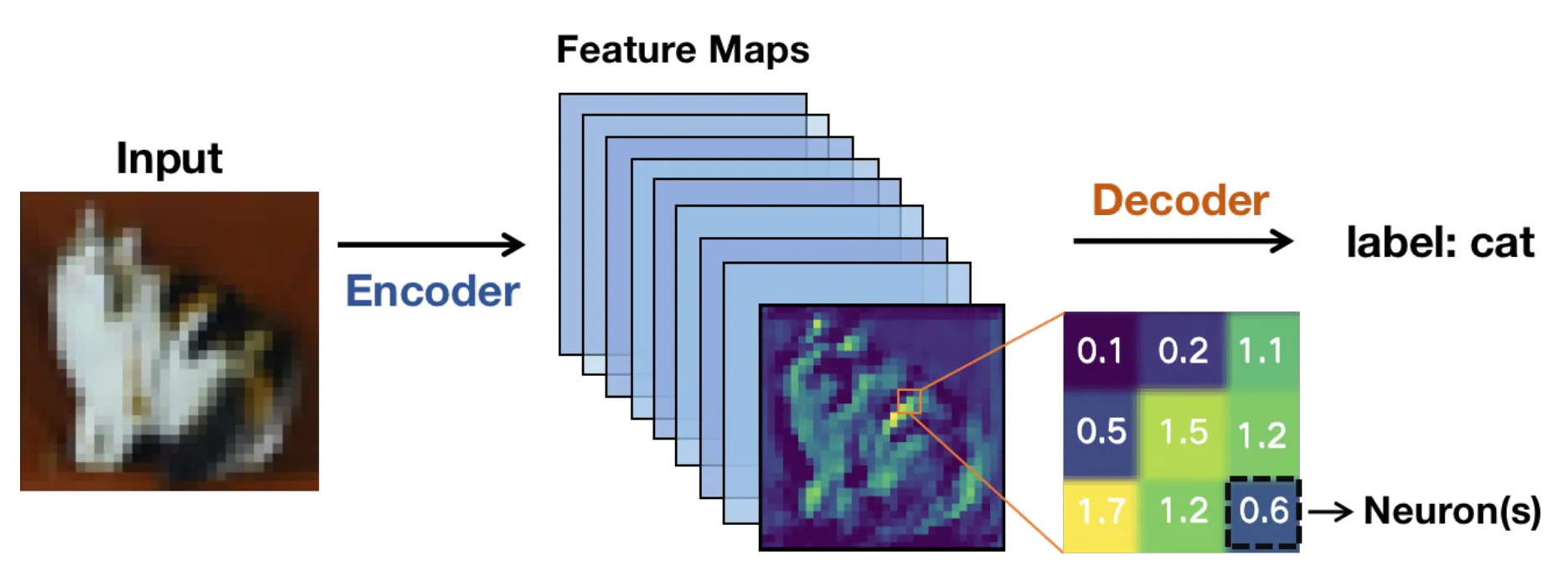

Внутри эти модели обычно используют архитектуру, основанную на сверточной нейронной сети (CNN). Изображения проходят через слои сети и преобразуются в карты признаков или упрощенные представления, которые выделяют значимые паттерны вместо необработанных пикселей.

По мере продвижения изображения по сети эти карты характеристик становятся меньше. Это ускоряет вычисления, но также означает, что мелкие детали могут исчезнуть.

Для крошечных объектов эти детали имеют решающее значение. Как только эти детали исчезают, модель компьютерного зрения может испытывать трудности с обнаружением объекта, что может привести к менее точным или несогласованным ограничительным рамкам.

Системы компьютерного зрения, работающие в режиме реального времени, еще больше усложняют эту задачу. Изображения с высоким разрешением помогают сохранить детали, но они замедляют вычисления и требуют большей GPU . Изображения с более низким разрешением работают быстрее, но мелкие объекты становится еще труднее detect.

Это становится постоянным балансированием между скоростью, точностью и ограничениями аппаратного обеспечения. Благодаря недавним технологическим достижениям, модели компьютерного зрения, такие как Ultralytics YOLO11 и готовящаяся к выпуску Ultralytics , разработаны для более эффективного управления этим компромиссом.

В этой статье мы рассмотрим, почему обнаружение мелких объектов является сложной задачей и как YOLO11 ее упростить. Приступим!

Обнаружение мелких объектов — это задача в области компьютерного зрения, одной из отраслей искусственного интеллекта, которая сосредоточена на идентификации и локализации объектов, занимающих очень небольшую часть изображения. Эти объекты часто представлены в изображении ограниченным количеством пикселей, которые являются наименьшими единицами цифрового изображения. Это делает их более сложными для detect более крупные и четкие объекты (которые часто содержат больше пикселей).

Например, транспортные средства на аэрофотоснимках, инструменты на заводском цехе или люди, запечатленные широкоугольными камерами наблюдения, могут отображаться на изображении в виде небольших объектов. Их обнаружение важно, поскольку они часто содержат важную информацию, а многие реальные приложения, такие как системы наблюдения, зависят от правильного функционирования этих средств обнаружения.

Когда мелкие объекты остаются незамеченными, это может повлиять на производительность системы и принятие решений. Хорошим примером является мониторинг с помощью беспилотных летательных аппаратов (БПЛА), где пропуск мелкого движущегося объекта на земле может повлиять на точность навигации или отслеживания.

В более ранних системах использовались ручные функции и традиционные методы компьютерного зрения, которые не справлялись с загруженными или разнообразными сценами. Даже сегодня, когда модели глубокого обучения работают гораздо лучше, обнаружение небольших целей по-прежнему затруднительно, если они занимают лишь небольшую часть изображения.

Далее рассмотрим некоторые типичные проблемы, возникающие в различных реальных сценариях при обнаружении мелких объектов.

Небольшие объекты содержат очень мало пикселей, что ограничивает количество визуальных деталей, которые модель может запомнить на таких этапах, как извлечение признаков. В результате такие элементы, как края, формы и текстуры, сложнее detect, из-за чего небольшие объекты чаще смешиваются с фоном.

По мере прохождения изображений через слои свертки нейронной сети визуальная информация в пикселях постепенно сжимается в карты признаков. Это помогает модели оставаться эффективной, но также означает, что мелкие детали теряются.

В случае небольших целей важные сигналы могут исчезнуть до того, как сеть обнаружения успеет сработать. Когда это происходит, локализация становится менее надежной, а ограничительные рамки могут смещаться, перекрываться или полностью пропускать целевые объекты.

Проблемы, связанные с размером, также часто возникают из-за окклюзии. Окклюзия возникает, когда объекты, особенно небольшие, частично скрываются другими объектами в сцене.

Это уменьшает видимую площадь цели, что ограничивает информацию, доступную для детектора объектов. Даже небольшая окклюзия может сбить с толку сети обнаружения, особенно в сочетании с входными данными низкого разрешения. Интересный пример этого можно увидеть в наборах данных БПЛА, таких как VisDrone, где пешеходы, велосипедисты или транспортные средства могут быть частично заблокированы зданиями, деревьями или другими движущимися объектами.

Аналогичным образом, различия в масштабе создают дополнительную сложность, когда один и тот же объект выглядит очень маленьким или относительно большим в зависимости от расстояния и положения камеры. Несмотря на эти препятствия, алгоритмы обнаружения должны распознавать эти небольшие объекты в разных масштабах без потери точности.

Контекст также играет важную роль в обнаружении. Например, крупные объекты обычно появляются на фоне четкого окружения, которое дает полезные визуальные подсказки. С другой стороны, мелкие цели часто лишены этой контекстной информации, что затрудняет распознавание образов.

Общие метрики оценки, такие как Intersection over Union (IoU), измеряют степень перекрытия прогнозируемой ограничительной рамки с реальной рамкой. Хотя IoU хорошо IoU для крупных объектов, его поведение совершенно иное для мелких объектов.

Небольшие объекты занимают всего несколько пикселей, поэтому даже незначительное смещение в прогнозируемом поле может привести к большой пропорциональной погрешности и резкому снижению IoU . Это означает, что небольшие объекты часто не соответствуют стандартному IoU , используемому для определения правильности прогноза, даже если объект виден на изображении.

В результате ошибки локализации чаще классифицируются как ложные срабатывания или ложные отказы. Эти ограничения побудили исследователей переосмыслить подход систем обнаружения объектов к оценке и обработке небольших,detect .

По мере того как исследователи работали над улучшением обнаружения мелких объектов, стало ясно, что сохранение и представление визуальной информации в нескольких масштабах имеет решающее значение. Эта идея нашла отражение в недавних исследованиях arXiv и в статьях, представленных на таких мероприятиях, как международные конференции IEEE и Европейская ассоциация компьютерного зрения (ECCV).

По мере продвижения изображений вглубь нейронной сети мелкие объекты могут терять детали или полностью исчезать, поэтому современные модели компьютерного зрения, такие как YOLO11 большое внимание улучшению извлечения признаков. Далее давайте рассмотрим основные концепции, лежащие в основе карт признаков и сетей пирамиды признаков, чтобы лучше их понять.

Когда входной образ, например, изображение дистанционного зондирования, поступает в нейронную сеть, он постепенно преобразуется в карты признаков. Это упрощенные представления образа, которые выделяют визуальные паттерны, такие как края, формы и текстуры.

По мере углубления сети эти карты признаков становятся меньше по пространственному размеру. Это уменьшение помогает модели работать эффективно и сосредоточиться на информации высокого уровня. Однако сокращение и углубление карт признаков также приводит к уменьшению пространственных деталей.

В то время как крупные объекты сохраняют достаточно визуальной информации для точного обнаружения, мелкие объекты могут терять важные детали уже после нескольких сетевых слоев. В этом случае модель может с трудом распознать даже само существование мелкого объекта. Это одна из основных причин, по которой мелкие объекты пропускаются в моделях глубокого обнаружения объектов.

Сети пирамиды признаков, часто называемые FPN, были введены для решения проблемы потери пространственных деталей и работают как вспомогательный модуль, который объединяет информацию из нескольких слоев, чтобы модели могли более эффективно detect объекты. Этот процесс также известен как агрегация признаков и слияние признаков.

Неглубокие слои обеспечивают точные пространственные детали, а более глубокие слои добавляют семантический контекст, что позволяет эффективно обучать многомасштабные особенности. В отличие от простого повышения разрешения, которое просто увеличивает карты особенностей, FPN сохраняет значимую информацию и улучшает обнаружение мелких объектов.

Современные подходы основываются на этой идее, используя адаптивное объединение характеристик и контекстно-зависимые конструкции для дальнейшего улучшения обнаружения небольших целей. Другими словами, FPN помогает моделям одновременно видеть как общую картину, так и мельчайшие детали. Эта оптимизация необходима, когда объекты имеют небольшой размер.

Вот краткий обзор того, как модели обнаружения объектов развивались и совершенствовались с течением времени, чтобы лучше detect разных размеров, в том числе очень маленькие:

Теперь, когда мы лучше понимаем, как работает обнаружение мелких объектов, давайте рассмотрим несколько реальных примеров YOLO11 .

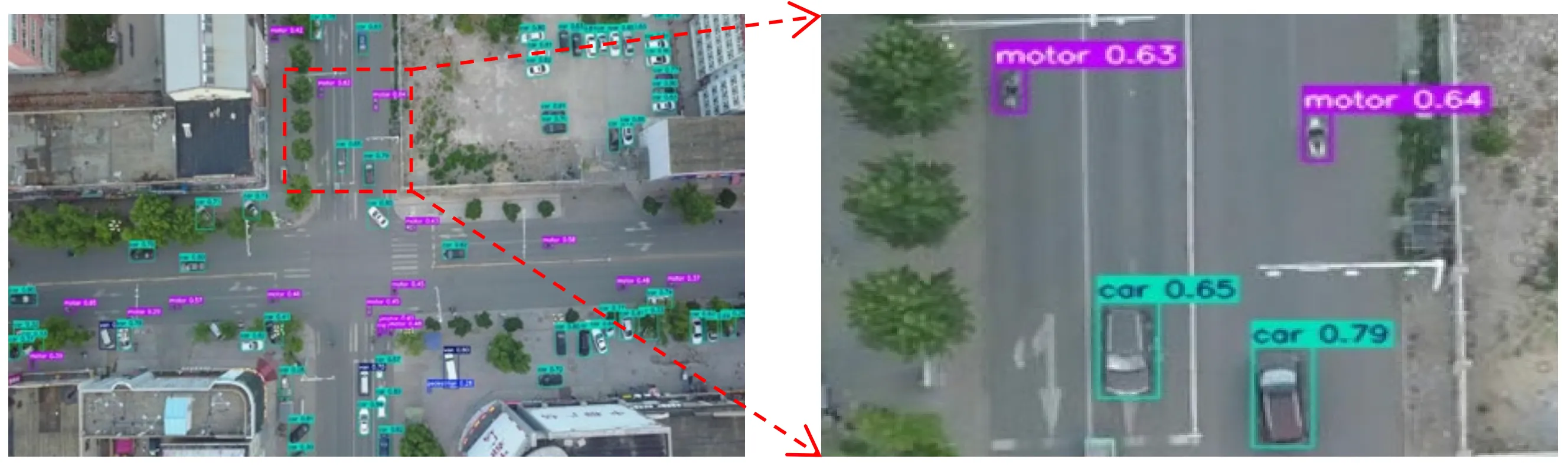

Представьте себе дрон, летящий высоко над оживленной городской улицей. С такой высоты автомобили, велосипеды и даже люди превращаются в несколько пикселей на экране.

БПЛА и модули аэрофотосъемки часто фиксируют подобные сцены, где объекты, представляющие интерес, являются крошечными и окружены загроможденным фоном, что затрудняет их detect моделями компьютерного зрения.

В таких сценариях YOLO11 быть идеальным выбором модели. Например, дрон, оснащенный моделью типа YOLO11 отслеживать дорожное движение в режиме реального времени, обнаруживая автомобили, велосипедистов и пешеходов, которые перемещаются по сцене, даже если каждый объект занимает лишь небольшую часть изображения. Это позволяет быстрее принимать решения и получать более точные данные в таких областях, как управление дорожным движением, общественная безопасность или городское планирование.

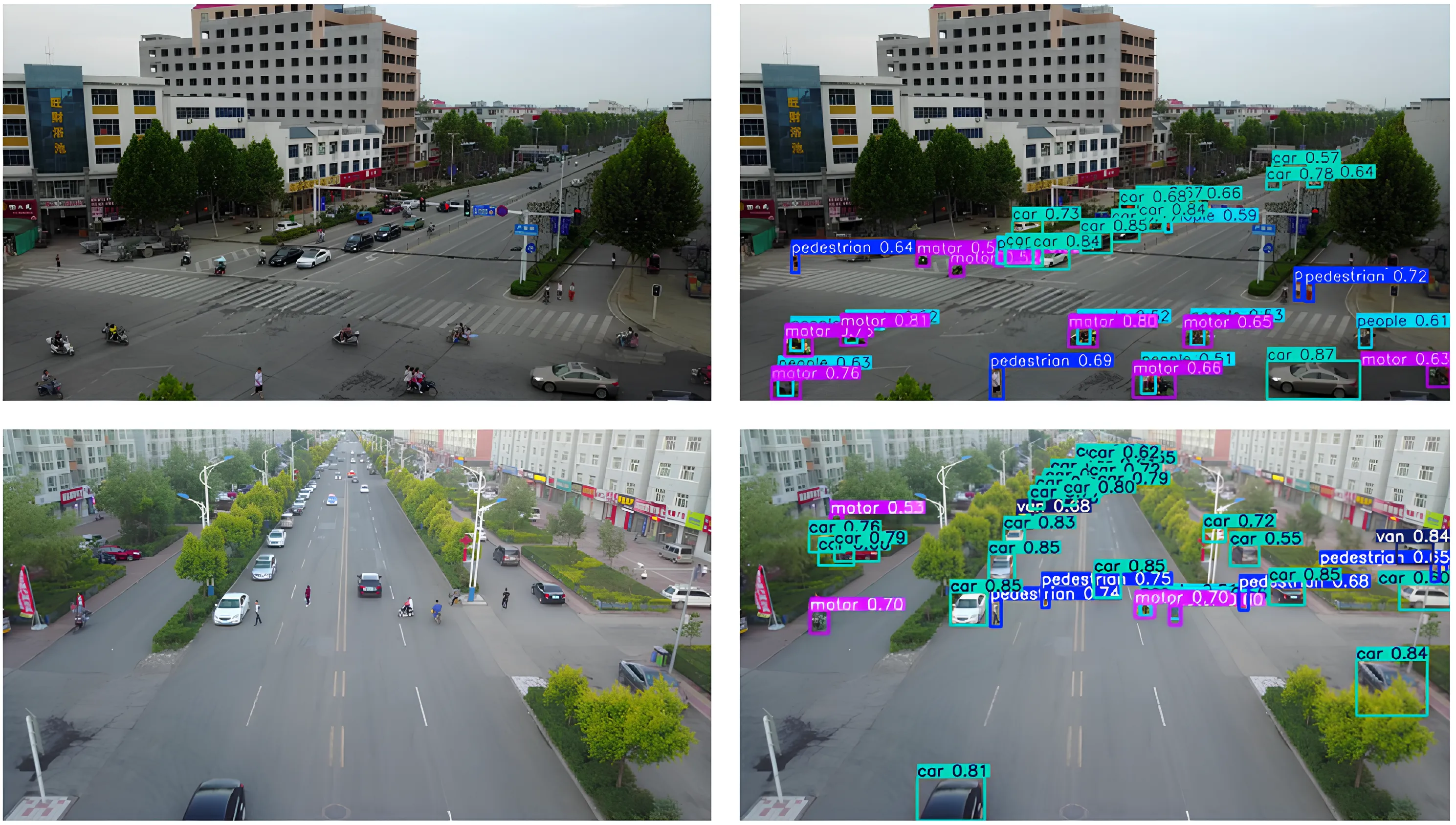

Роботы часто используются в условиях, где точность и синхронизация имеют решающее значение. В таких местах, как склады, фабрики и фермы, робот может нуждаться в распознавании очень мелких объектов, таких как деталь на конвейере, этикетка на упаковке или маленький бутон растения на поле, и быстрой реакции.

Обнаружение объектов такого размера может быть сложной задачей, особенно когда они занимают всего несколько пикселей в изображении с камеры или частично закрыты другими объектами. Пропуск таких мелких деталей может замедлить работу автоматизированной системы или повлиять на способность робота выполнить задачу.

YOLO11 изменить ситуацию в таких случаях. Улучшенная функция извлечения признаков и быстрое выведение позволяют роботам detect объекты в режиме реального времени и немедленно принимать меры.

YOLO11 поддерживает сегментацию экземпляров, что помогает роботам более точно определять границы объектов и точки захвата, а не только находить общие ограничительные рамки. Например, роботизированная рука, интегрированная с YOLO11 обнаруживать мелкие детали на конвейерной ленте, segment точную форму и подбирать их, прежде чем они выйдут из зоны досягаемости, что помогает системе оставаться эффективной и надежной.

С учетом того, что сегодня доступно так много моделей компьютерного зрения, вы, возможно, задаетесь вопросом, чем жеYOLO11 Ultralytics YOLO11 .

Вот несколько причин, по которым Ultralytics YOLO11 отличным выбором для приложений, в которых необходимо обнаруживать небольшие объекты:

Помимо использования такой модели, как YOLO11, способ подготовки аннотаций, общий набор данных и процедура обучения модели могут существенно повлиять на эффективность обнаружения.

Вот краткий обзор того, на чем следует сосредоточить внимание:

Обнаружение мелких объектов затруднено, поскольку мелкие цели теряют детали при прохождении изображений через модель компьютерного зрения. YOLO11 сохранение этих деталей, делая обнаружение мелких объектов более надежным без ущерба для производительности в реальном времени. Этот баланс позволяет YOLO11 точное и эффективное обнаружение в реальных приложениях.

Присоединяйтесь к нашему растущему сообществу! Изучите наш репозиторий GitHub, чтобы узнать больше об ИИ. Откройте для себя такие инновации, как компьютерное зрение в розничной торговле и ИИ в автомобильной промышленности, посетив страницы с нашими решениями. Чтобы начать создавать решения на основе компьютерного зрения уже сегодня, ознакомьтесь с нашими вариантами лицензирования.

Начните свой путь в будущее машинного обучения