FastVLM: Apple yeni hızlı görme dil modelini tanıtıyor

Apple, CVPR 2025'te FastVLM'yi tanıtıyor. Bu açık kaynaklı görüntü‑dil modeli, 85 ×'e kadar daha hızlı ilk belirteç süresi sağlayan FastViTHD kodlayıcıya sahiptir.

Apple, CVPR 2025'te FastVLM'yi tanıtıyor. Bu açık kaynaklı görüntü‑dil modeli, 85 ×'e kadar daha hızlı ilk belirteç süresi sağlayan FastViTHD kodlayıcıya sahiptir.

CVPR 2025 konferansında Apple, FastVLM adlı yeni bir açık kaynaklı yapay zeka modeli tanıttı. Hem görüntüleri hem de dili anlamak için oluşturulmuştur ve iPhone'lar, iPad'ler ve Mac'ler gibi Apple cihazlarında çalışır. Bu, verilerinizi buluta göndermeden akıllı sonuçları hızla sunabileceği anlamına gelir.

FastVLM'yi özellikle ilginç kılan şey, ne kadar hızlı ve verimli olduğudur. Apple, modelin daha az bellek ve güç kullanırken yüksek kaliteli görüntüleri yorumlamasına yardımcı olan FastViTHD adlı yeni bir görüntü kodlayıcı geliştirdi. Tüm işlemler cihaz üzerinde yerel olarak gerçekleşir, bu da kullanıcı gizliliğini korurken daha hızlı yanıt süreleri sağlar.

Bu makalede, FastVLM'nin nasıl çalıştığını, onu diğerlerinden ayıran özellikleri ve bu Apple sürümünün cihazlarınızdaki günlük yapay zeka uygulamaları için neden önemli bir adım olabileceğini inceleyeceğiz.

FastVLM'yi özel yapan şeylere dalmadan önce, adındaki "VLM"nin ne anlama geldiğini açıklayalım. Görsel içeriği dil ile anlamak ve bağlamak için tasarlanmış bir görüntü-dil modelini ifade eder.

VLM'ler, görsel anlayışı ve dili bir araya getirerek bir fotoğrafı tanımlama, bir ekran görüntüsü hakkında soruları yanıtlama veya bir belgeden metin çıkarma gibi görevleri gerçekleştirmelerini sağlar. Görsel-dil modelleri genellikle iki bölümden oluşur: biri görüntüyü işler ve veriye dönüştürür, diğeri ise bu veriyi yorumlayarak okuyabileceğiniz veya duyabileceğiniz bir yanıt oluşturur.

Bu tür bir yapay zeka yeniliğini farkında bile olmadan kullanmış olabilirsiniz. Makbuzları tarayan, kimlik kartlarını okuyan, görüntü başlıkları oluşturan veya görme bozukluğu olan kişilerin ekranlarıyla etkileşim kurmasına yardımcı olan uygulamalar genellikle arka planda sessizce çalışan görme-dil modellerine güvenir.

Apple, FastVLM'yi diğer görüntü-dil modelleriyle aynı görevleri gerçekleştirmek için geliştirdi, ancak daha yüksek hız, daha güçlü gizlilik ve kendi cihazlarında optimize edilmiş performansla. Bir görüntünün içeriğini anlayabilir ve metinle yanıt verebilir, ancak bulut sunucularına dayanan birçok modelin aksine, FastVLM tamamen iPhone, iPad veya Mac'inizde çalışabilir.

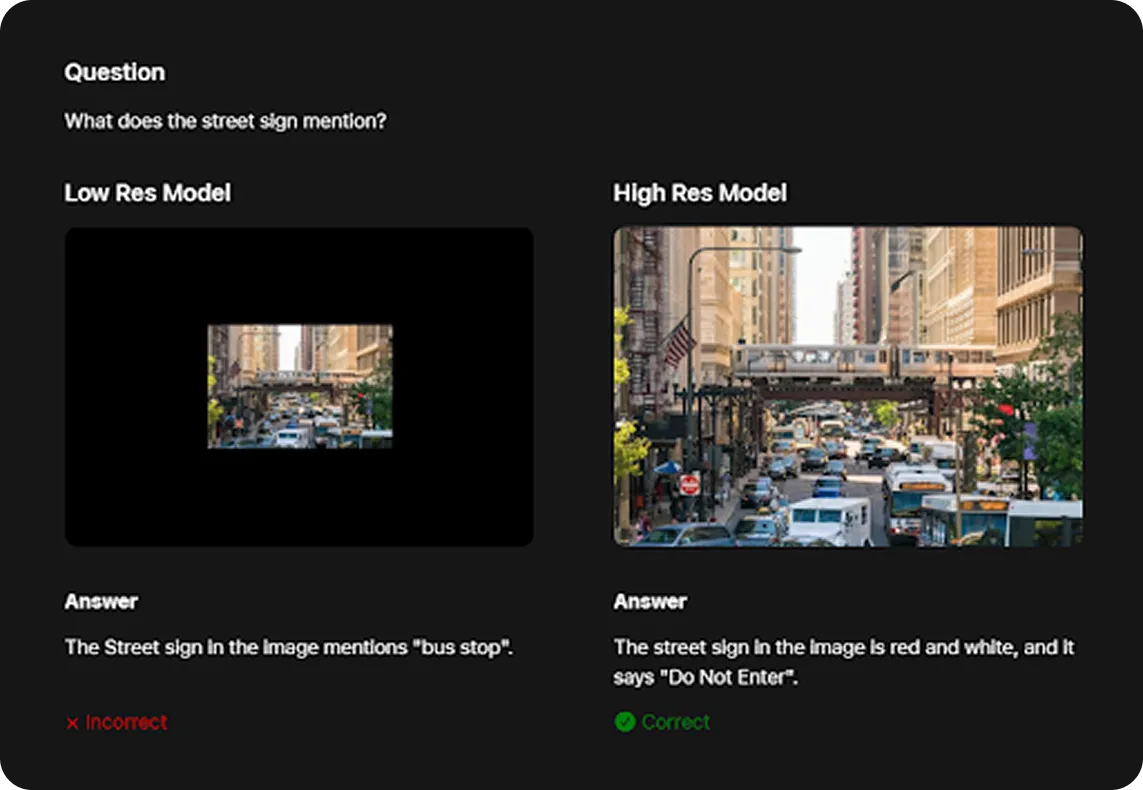

VLM'ler genellikle yüksek çözünürlüklü görüntülerle daha iyi performans gösterir. Örneğin, aşağıda gösterildiği gibi, FastVLM bir trafik işaretini yalnızca görüntünün yüksek çözünürlüklü bir versiyonu verildiğinde doğru bir şekilde "Girilmez" olarak tanımlayabilmiştir. Ancak, yüksek çözünürlüklü girdiler genellikle modelleri yavaşlatır. FastViTHD işte burada fark yaratır.

Apple'ın yeni görüntü kodlayıcısı FastViTHD, FastVLM'nin yüksek kaliteli görüntüleri daha verimli bir şekilde işlemesine, daha az bellek ve güç kullanmasına yardımcı olur. Özellikle, FastViTHD daha küçük cihazlarda bile sorunsuz çalışacak kadar hafiftir.

Ayrıca, FastVLM, geliştiricilerin kaynak koduna erişebileceği, değişiklik yapabileceği ve Apple'ın lisans koşullarına uygun olarak kendi uygulamalarında kullanabileceği FastVLM GitHub deposunda herkese açıktır.

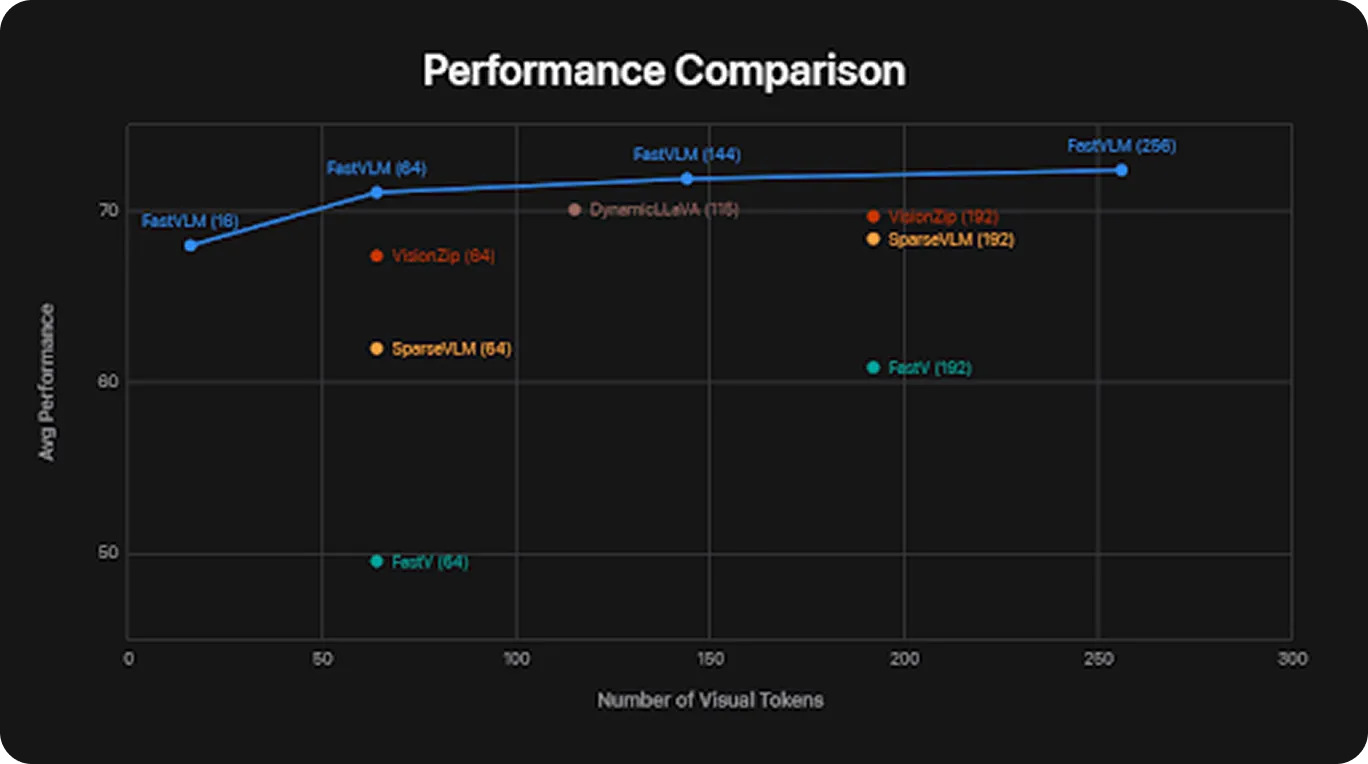

Diğer görme-dil modelleriyle karşılaştırıldığında, FastVLM akıllı telefonlar ve dizüstü bilgisayarlar gibi günlük cihazlarda çalışacak şekilde optimize edilmiştir. Performans testlerinde, FastVLM ilk kelimesini veya çıktısını LLaVA-OneVision-0.5B gibi modellere göre 85 kata kadar daha hızlı oluşturdu.

İşte FastVLM'nin üzerinde değerlendirildiği bazı standart kıyaslama testlerine kısa bir bakış:

FastVLM, bu kıyaslamalarda daha az kaynak kullanırken rekabetçi sonuçlar elde etti. Telefonlar, tabletler ve dizüstü bilgisayarlar gibi günlük cihazlara pratik görsel yapay zeka getiriyor.

Şimdi de FastVLM'nin görüntü işleme performansında çok önemli bir rol oynayan vizyon kodlayıcı FastViTHD'ye daha yakından bakalım.

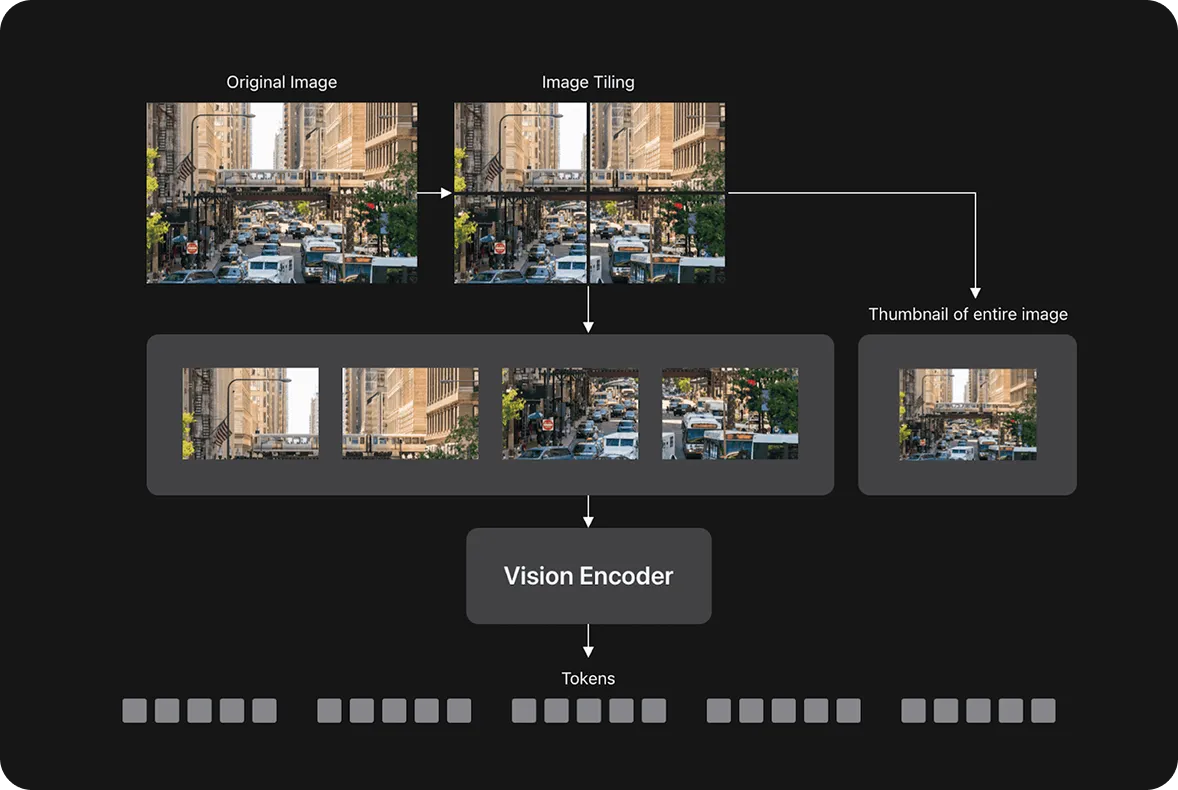

Çoğu görsel dil modeli, bir görüntüyü belirteç adı verilen binlerce küçük parçaya böler. Ne kadar çok belirteç olursa, modelin görüntüyü anlaması için o kadar çok zaman ve güce ihtiyacı olur. Bu durum, özellikle telefonlarda veya dizüstü bilgisayarlarda işleri yavaşlatabilir.

FastViTHD, çok fazla belirteç işlemeyle gelen yavaşlamayı, tam görüntüyü anlamaya devam ederken bunlardan daha azını kullanarak önler. İki yaklaşımı birleştirir: kalıpları ve ilişkileri modellemede iyi olan transformatörler ve görsel verileri işlemede verimli olan evrişimsel katmanlar. Sonuç, daha hızlı çalışan ve daha az bellek kullanan bir sistemdir.

Apple'a göre, FastViTHD, yüksek doğruluğu korurken bazı geleneksel görüntü işleme kodlayıcılarından 3,4 kata kadar daha küçüktür. İşlemi hızlandırmak için belirteç budama (token pruning) (daha az önemli görüntü yamalarını kaldırma) gibi model optimizasyon tekniklerine güvenmek yerine, daha basit, daha akıcı bir mimari aracılığıyla verimlilik elde eder.

Apple, FastVLM'yi üç farklı boyutta yayınladı: 0,5B, 1,5B ve 7B parametre (burada "B", modeldeki eğitilebilir ağırlıkların sayısını ifade eden milyar anlamına gelir). Her sürüm, farklı cihaz türlerine uyacak şekilde tasarlanmıştır. Daha küçük modeller telefonlarda ve tabletlerde çalışabilirken, daha büyük 7B modeli masaüstleri veya daha zorlu görevler için daha uygundur.

Bu, geliştiricilere uygulamaları için en iyi olanı seçme esnekliği sağlar. Aynı temel model mimarisini kullanırken, mobil için hızlı ve hafif bir şey veya daha büyük sistemler için daha karmaşık bir şey oluşturabilirler.

Apple, FastVLM model varyantlarını, görüntü ve dil modellerini hizalamak için bir çerçeve olan LLaVA‑1.5 hattını kullanarak eğitti. Dil bileşeni için, doğal ve tutarlı metin üretimiyle bilinen Qwen ve Vicuna gibi mevcut açık kaynaklı modelleri kullanarak FastVLM'yi değerlendirdiler. Bu kurulum, FastVLM'nin hem basit hem de karmaşık görüntüleri işlemesine ve okunabilir, alakalı yanıtlar üretmesine olanak tanır.

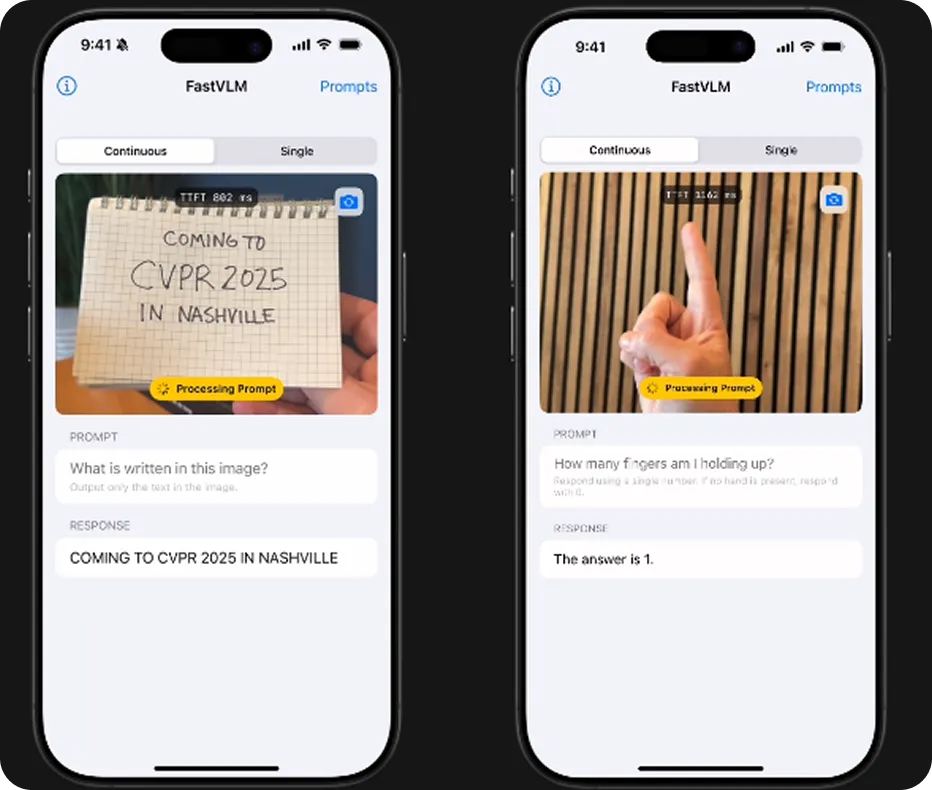

FastVLM'nin verimli görüntü işlemesinin neden önemli olduğunu merak ediyor olabilirsiniz? Bunun nedeni, uygulamaların buluta güvenmeden gerçek zamanlı olarak ne kadar sorunsuz çalışabileceğidir. FastVLM, doğrudan cihazınızda çalışacak kadar hızlı ve hafif kalırken, 1152'ye 1152 piksele kadar yüksek çözünürlüklü görüntüleri işleyebilir.

Bu, uygulamaların kameranın gördüklerini tanımlayabileceği, çekildikleri anda makbuzları tarayabileceği veya ekrandaki değişikliklere yanıt verebileceği ve tüm bunları yerel olarak tutabileceği anlamına gelir. Özellikle eğitim, erişilebilirlik, üretkenlik ve fotoğrafçılık gibi alanlar için faydalıdır.

FastViTHD, büyük resimler söz konusu olduğunda bile verimli olduğundan, cihazların hızlı yanıt vermesine ve serin kalmasına yardımcı olur. Giriş seviyesi iPhone'larda çalışan en küçük olanı da dahil olmak üzere tüm model boyutlarıyla çalışır. Bu, aynı yapay zeka özelliklerinin telefonlarda, tabletlerde ve Mac'lerde çalışabileceği anlamına gelir.

FastVLM, hız, verimlilik ve cihaz üzerinde gizlilik gibi temel faydaları sayesinde çok çeşitli uygulamalara güç sağlayabilir. İşte nasıl kullanılabileceğine dair birkaç örnek:

Cihaz üzerinde yapay zeka asistanları: FastVLM, ekranda ne olduğunu hızla anlaması gereken yapay zeka asistanlarıyla iyi çalışabilir. Doğrudan cihaz üzerinde çalıştığı ve verileri gizli tuttuğu için, metin okuma, düğmeleri veya simgeleri tanımlama ve buluta bilgi göndermeye gerek kalmadan kullanıcılara gerçek zamanlı olarak rehberlik etme gibi görevlere yardımcı olabilir.

FastVLM, cihaz üzerinde görüntü-dil yapay zekasını Apple cihazlarına getirerek hızı, gizliliği ve verimliliği bir araya getiriyor. Hafif tasarımı ve açık kaynaklı sürümü ile mobil ve masaüstü uygulamalarında gerçek zamanlı görüntü anlamayı mümkün kılar.

Bu, yapay zekanın günlük kullanım için daha pratik ve erişilebilir hale gelmesine yardımcı olur ve geliştiricilere kullanışlı, gizliliğe odaklı uygulamalar oluşturmak için sağlam bir temel sağlar. İleriye baktığımızda, görme-dil modellerinin teknolojiyle etkileşimimizde önemli bir rol oynaması ve yapay zekayı günlük durumlarda daha duyarlı, bağlam farkındalığı olan ve yardımcı hale getirmesi muhtemeldir.

Yapay zeka hakkında daha fazla bilgi edinmek için GitHub depomuzu keşfedin. Aktif topluluğumuza katılın ve otomotivdeki yapay zeka endüstrisi ve üretimde Görüntü İşleme gibi sektörlerdeki yenilikleri keşfedin. Bilgisayarlı görüye bugün başlamak için lisanslama seçeneklerimize göz atın.

Makine öğreniminin geleceği ile yolculuğunuza başlayın