探索视觉AI如何利用尖端模型、数据集和端到端工作流,将图像和视频转化为实时洞察,并应用于各行各业。

探索视觉AI如何利用尖端模型、数据集和端到端工作流,将图像和视频转化为实时洞察,并应用于各行各业。

每天,工厂、医院、城市、车辆和消费设备中的摄像头都会捕获海量图像和视频。这种持续的视觉数据流创造了新的可能性,但也使得快速理解正在发生的事情并采取行动变得困难。

例如,繁忙的十字路口或拥挤的公共场所可能瞬息万变。手动监控这些环境速度慢且通常不准确,尤其是在需要快速可靠决策时。

为了应对此类情况,系统需要一种方式来实时理解视觉信息并做出响应。计算机视觉通过让机器分析图像和视频、识别模式并提取有用信息,使这成为可能。

早期的计算机视觉系统依赖于固定规则,在受控环境中有效,但当光照或摄像机角度等条件发生变化时,往往会失效。现代视觉AI通过使用人工智能和机器学习改进了这种方法。

这些系统不再仅仅捕获或存储视觉信息,而是实时分析视觉数据,从示例中学习,并适应不断变化的环境。这使得视觉AI在实际场景中更有效,并随着在更多应用中的使用而不断改进。

在本文中,我们将深入探讨什么是视觉AI,以及如何利用它构建端到端的智能工作流。让我们开始吧!

视觉AI是人工智能的一个分支,它使机器能够理解和解释图像和视频。换句话说,视觉AI系统分析它们所看到的内容,并利用这些信息来支持行动、优化预测或作为更大工作流程的一部分做出决策。与生成新内容的生成式AI不同,视觉AI专注于理解和从现有视觉数据中提取信息。

例如,长时间监控工厂车间或公共场所的活动,需要手动难以保持的速度和一致性。视觉AI系统可以通过应用机器学习和深度学习技术来应对这一挑战,以识别模式、识别相关细节,并在新的视觉信息出现时做出响应。

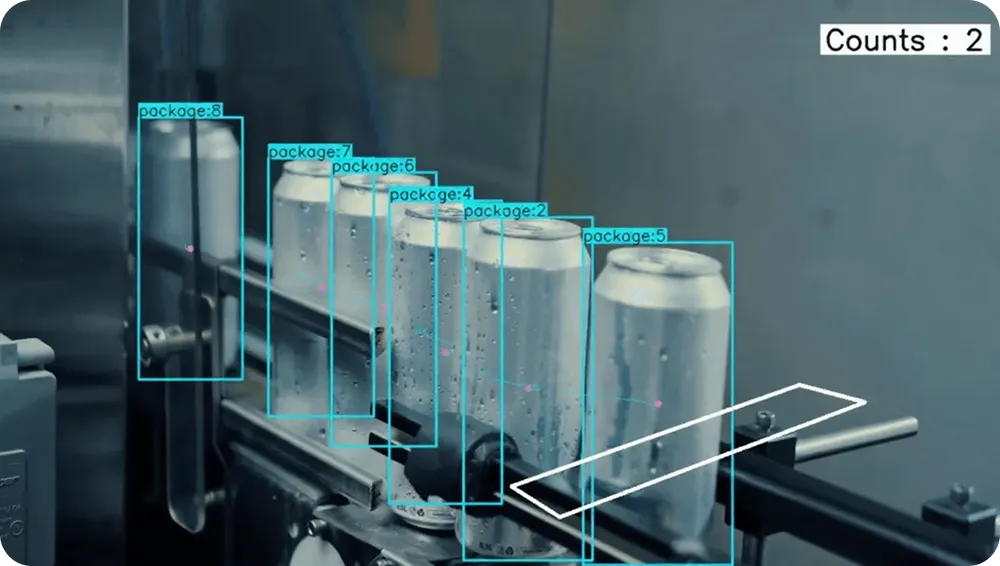

由于图像和视频通常以大容量和高速生成,视觉AI系统可以持续处理视觉数据,并对每一帧应用相同的规则。这使得结果更加一致,并帮助团队在条件变化时保持准确性,从而改进运营。

在实际应用中,视觉AI通常是端到端AI系统的一部分。它将视觉AI模型与决策逻辑以及根据结果采取行动的其他工具连接起来。通过将视觉输入转化为有用的洞察,视觉AI可以自动化日常任务,并在众多计算机视觉应用中支持更快、更自信的决策。

那么,一个系统或机器如何从看到图像或视频,到理解正在发生的事情并决定下一步该怎么做呢?

这个过程始于来自真实世界的视觉输入,例如照片、视频片段、实时摄像头馈送或传感器流。由于这些数据在质量、光照和摄像机角度方面可能差异很大,通常需要在分析前进行准备。

这种准备工作可能包括调整图像大小、调整光照,并将视频帧组织成一致的格式。通常还会包含额外上下文,例如时间戳或摄像机位置,以支持更准确的分析。

然后,准备好的数据在一个学习框架内使用,该框架允许系统识别视觉模式。通过对标注图像和视频进行训练,视觉AI模型学习对象、模式和事件在不同条件下的表现形式。

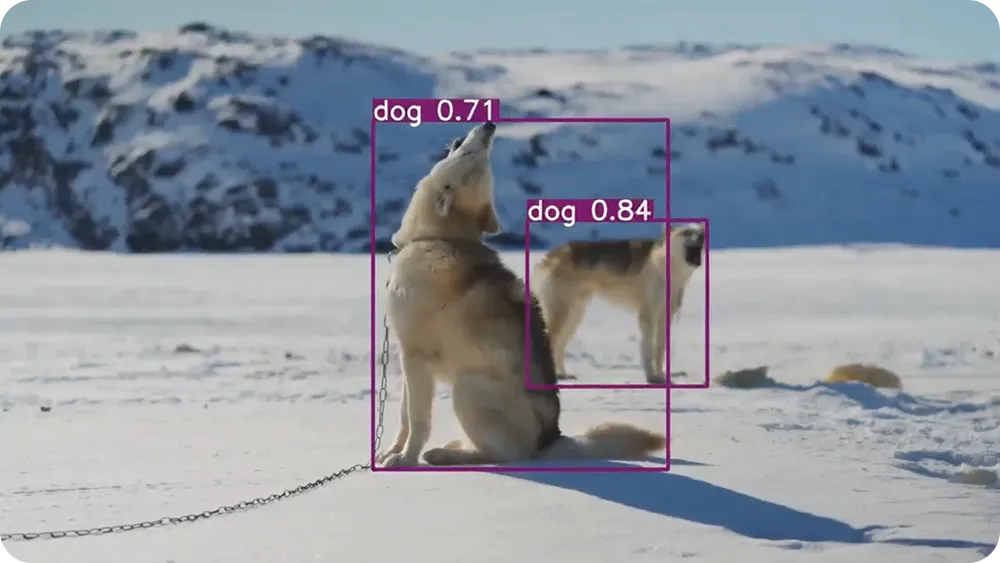

这种习得的理解构成了许多常见计算机视觉任务的基础,例如对象检测(在图像中识别和定位对象)和实例分割(在像素级别分离和标注单个对象)。最先进的视觉AI模型,例如Ultralytics YOLO26,旨在支持这些任务,同时在实际环境中保持快速和准确。

系统部署后,视觉输入将作为端到端工作流程的一部分持续进行处理。模型分析图像和视频,并将其输出发送到仪表盘、自动化工具或其他AI系统。在某些情况下,视觉AI代理利用这些结果触发操作或支持决策,将视觉理解转化为实用、可操作的洞察。

随着您深入了解视觉AI,您可能会思考模型和架构为何重要,以及它们如何影响系统性能。视觉AI模型对于当今的计算机视觉创新至关重要。

大多数视觉AI系统都围绕一个模型构建,该模型决定了图像和视频的分析方式。该模型定义了系统在场景中能够识别的内容,以及其在不同条件下的表现。

随着视觉AI应用变得日益多样和复杂,视觉AI模型及其底层架构也在不断演进,以适应需求并提升用户友好性。早期的计算机视觉系统需要工程师手动定义系统应识别的内容,例如特定的边缘、颜色或形状。

这些基于规则的方法在受控环境中表现良好,但当光照变化、摄像头质量不一或场景变得更复杂时,它们往往会失效。现代视觉AI模型则采取了不同的方法。

许多开源模型直接从数据中学习视觉模式,这使得它们更具灵活性,更适合条件不可预测的真实世界环境。模型架构的进步也简化了图像和视频的处理方式,使这些系统更易于部署并集成到实用的视觉AI平台中。

Ultralytics YOLO 模型是这一转变的良好例证。诸如 YOLO26 等模型广泛应用于需要速度和一致性的目标检测任务,尤其是在实时视频应用中。

以下是AI驱动的视觉系统赖以理解视觉信息并优化现实世界环境的一些核心计算机视觉任务:

每个高效的视觉AI系统背后都有一个精心策划的数据集。这些视觉AI数据集提供了视觉AI模型学习所需的图像和视频,帮助它们识别真实世界环境中的物体、模式和场景。

数据的质量直接影响系统的准确性和可靠性。为了使视觉数据发挥作用,数据集需要进行标注。这意味着在每张图像或视频中添加重要细节,例如标记物体、突出特定区域或分配类别。

除了标签,还可以包含时间、位置或场景类型等额外元数据,以帮助组织数据并增进理解。数据集通常也分为训练集、验证集和测试集,以便系统能够对从未见过的视觉内容进行评估。

ImageNet、COCO 和 Open Images 等流行数据集通过提供大量多样化的标注图像集合,在推动视觉 AI 方面发挥了重要作用。尽管如此,收集真实世界数据仍然很困难。

偏见、覆盖范围的不足以及不断变化的环境使得创建真正反映真实条件的数据集变得困难。大规模获取适当平衡的数据是构建可靠视觉AI系统的关键。

既然我们对视觉AI的工作原理有了更好的理解,接下来让我们探讨它在实际应用中的使用方式。在众多行业中,视觉AI帮助团队大规模处理视觉任务,从而实现更快的响应和更高效的运营。

以下是视觉AI在不同领域的一些常见应用方式:

以下是在实际应用中使用视觉AI的一些主要优势:

尽管有这些优势,但仍存在可能影响视觉AI系统性能的局限性。以下是一些需要考虑的因素:

视觉AI将图像和视频转化为系统可以理解和使用的有意义信息。这有助于自动化视觉任务,并支持更快、更可靠的决策。它的有效性取决于有能力的模型、高质量数据集和精心设计的工作流程的协同组合。

对视觉AI感兴趣?加入我们的社区,了解农业中的计算机视觉以及汽车行业的视觉AI。查看我们的许可选项以开始使用计算机视觉。访问我们的GitHub仓库以继续探索AI。

开启您的机器学习未来之旅