探索如何使用 RKNN 工具包在 Rockchip 上部署Ultralytics YOLO11 ,以实现高效的边缘人工智能、人工智能加速和实时对象检测。

探索如何使用 RKNN 工具包在 Rockchip 上部署Ultralytics YOLO11 ,以实现高效的边缘人工智能、人工智能加速和实时对象检测。

人工智能社区最近的一个热门词汇是边缘 AI,尤其是在计算机视觉方面。随着 AI 驱动的应用程序的增长,越来越需要在功率和计算资源有限的嵌入式设备上高效运行模型。

例如,无人机使用视觉人工智能(Vision AI)进行实时导航,智能摄像头即时detect 物体,工业自动化系统无需依赖云计算即可执行质量控制。这些应用需要直接在边缘设备上进行快速、高效的人工智能处理,以确保实时性能和低延迟。然而,在边缘设备上运行人工智能模型并非易事。人工智能模型所需的功率和内存往往超出许多边缘设备的承受能力。

Rockchip的RKNN工具包通过为Rockchip驱动的设备优化深度学习模型来帮助解决这一问题。与CPU 或GPU 处理相比,它使用专用神经处理单元 (NPU) 加快推理速度,减少延迟和功耗。

视觉人工智能社区一直渴望运行 Ultralytics YOLO11在基于 Rockchip 的设备上运行,我们听到了你们的呼声。我们添加了将YOLO11 导出为 RKNN模型格式的支持。在本文中,我们将探讨导出为 RKNN 的工作原理,以及为什么在搭载 Rockchip 的设备上部署YOLO11 会改变游戏规则。

Rockchip 是一家设计片上系统(SoC)的公司,片上系统是一种微小但功能强大的处理器,可运行许多嵌入式设备。这些芯片结合了CPU、GPU 和神经处理单元 (NPU),可处理从一般计算任务到依赖于物体检测和图像处理的视觉 AI 应用等各种任务。

瑞芯微(Rockchip)SoC 广泛应用于各种设备,包括单板计算机(SBC)、开发板、工业 AI 系统和智能摄像头。许多知名的硬件制造商,如 Radxa、华硕(ASUS)、Pine64、Orange Pi、Odroid、Khadas 和 Banana Pi,都生产由瑞芯微 SoC 驱动的设备。这些开发板因其在性能、能效和成本效益之间的平衡,而广泛应用于边缘 AI 和计算机视觉应用。

为了帮助 AI 模型在这些设备上高效运行,瑞芯微提供了 RKNN(Rockchip Neural Network)工具包。它使开发人员能够转换和优化深度学习模型,以使用瑞芯微的神经处理单元 (NPU)。

RKNN 模型经过优化,可实现低延迟推理和高效的功耗。通过将模型转换为 RKNN,开发人员可以在 Rockchip 驱动的设备上实现更快的处理速度、更低的功耗和更高的效率。

让我们仔细看看 RKNN 模型如何提高 Rockchip 设备上的 AI 性能。

与处理各种计算任务的 CPU 和 GPU 不同,Rockchip 的 NPU 专为深度学习而设计。 通过将 AI 模型转换为 RKNN 格式,开发人员可以直接在 NPU 上运行推理。 这使得 RKNN 模型对于实时计算机视觉任务特别有用,在这些任务中,快速高效的处理至关重要。

NPU 比 CPU 和 GPU 更快、更高效,因为它们专为并行处理神经网络计算而构建。虽然 CPU 一次处理一个任务,GPU 将工作负载分配到多个内核,但 NPU 经过优化,可以更有效地执行 AI 专用计算。

因此,RKNN 模型运行速度更快,功耗更低,非常适合电池供电设备、智能相机、工业自动化和其他需要实时决策的边缘 AI 应用。

Ultralytics YOLO (只看一次)模型专为实时计算机视觉任务而设计,如物体检测、实例分割和图像分类。它们以速度、准确性和效率著称,广泛应用于农业、制造业、医疗保健和自主系统等行业。

随着时间的推移,这些模型有了很大改进。例如,Ultralytics YOLOv5使对象检测更容易与PyTorch 配合使用。然后,Ultralytics YOLOv8增加了一些新功能,如姿势估计 和图像分类。现在,YOLO11 更进一步,在提高准确性的同时使用更少的资源。事实上,与YOLOv8m 相比,YOLOv8m 在COCO 数据集上的表现更好,而使用的参数却减少了 22%,这使它变得更精确、更高效。

Ultralytics YOLO 模型还支持导出为多种格式,允许在不同平台上灵活部署。这些格式包括ONNX、TensorRT、CoreML 和OpenVINO,让开发人员可以根据目标硬件自由优化性能。

由于新增了将YOLO11 输出为 RKNN 模型格式的支持,YOLO11 现在可以利用 Rockchip 的 NPU。采用 RKNN 格式的最小模型 YOLO11n 每幅图像的推理时间仅为 99.5 毫秒,即使在嵌入式设备上也能实现实时处理。

目前,YOLO11 物体检测模型可以导出为 RKNN 格式。此外,请继续关注--我们正在努力在未来的更新中添加对其他计算机视觉任务和 INT8 量化的支持。

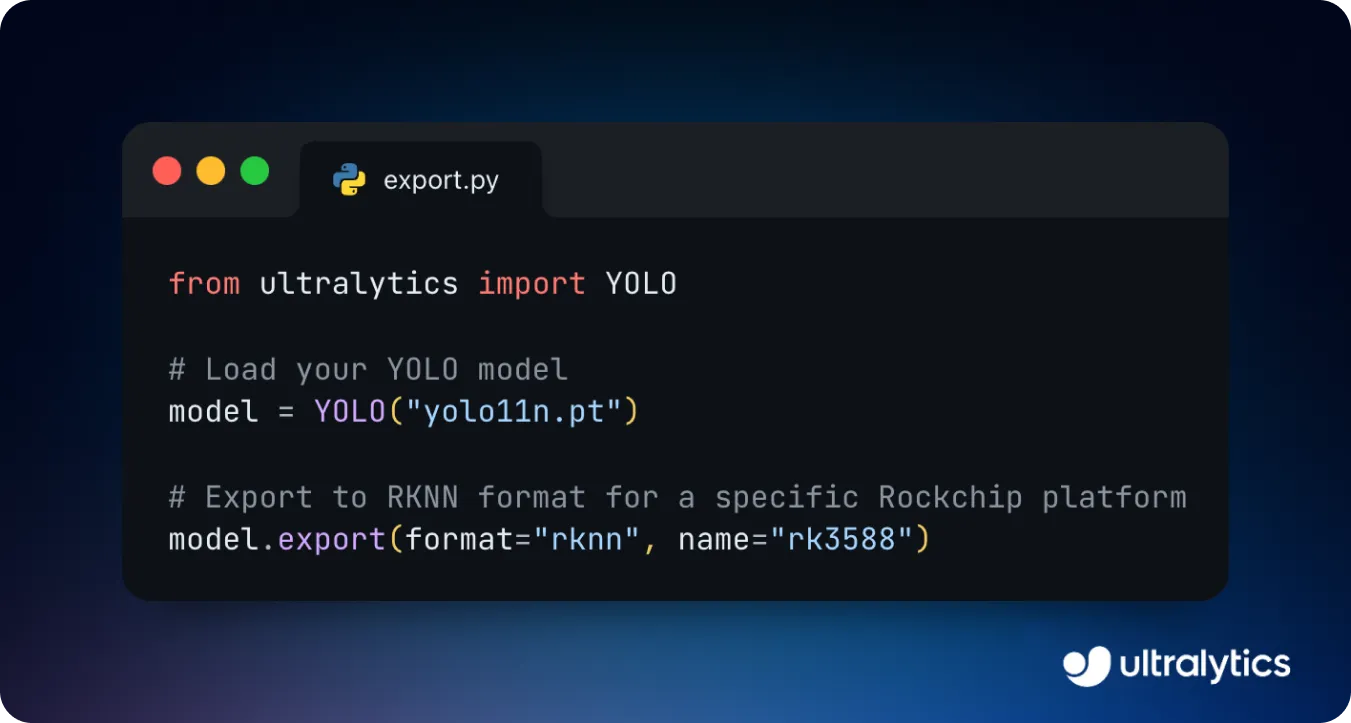

将YOLO11 输出为 RKNN 格式是一个简单直接的过程。您可以加载自定义训练的 YOLO11 模型,指定目标 Rockchip 平台,然后用几行代码将其转换为 RKNN 格式。RKNN 格式兼容各种 Rockchip SoC,包括 RK3588、RK3566 和 RK3576,确保了广泛的硬件支持。

一旦导出,RKNN 模型就可以部署到基于 Rockchip 的设备上。要部署模型,只需将导出的 RKNN 文件加载到 Rockchip 设备上,然后运行推理--使用训练有素的人工智能模型分析新图像或视频并实时detect 物体的过程。只需几行代码,您就可以开始从图像或视频流中识别物体。

为了更好地了解YOLO11 在现实世界中可以部署在支持 Rockchip 的设备上,让我们来看看一些关键的边缘人工智能应用。

Rockchip 处理器广泛应用于Android平板电脑、开发板和工业人工智能系统。凭借对Android、Linux 和Python 的支持,您可以为各行各业轻松构建和部署 Vision AI 驱动型解决方案。

在搭载 Rockchip 的设备上运行YOLO11 的常见应用是坚固耐用的平板电脑。它们是专为仓库、建筑工地和工业环境等恶劣环境设计的耐用、高性能平板电脑。这些平板电脑可以利用物体检测功能来提高效率和安全性。

例如,在仓储物流中,工人可以使用配备YOLO11 的 Rockchip 平板电脑自动扫描和detect 库存,从而减少人为错误,加快处理速度。同样,在建筑工地,这些平板电脑可用于detect 工人是否佩戴了必要的安全装备,如头盔和背心,从而帮助公司执行法规,防止事故发生。

在制造和自动化方面,基于瑞芯微(Rockchip)的工业主板可以在质量控制和过程监控中发挥重要作用。工业主板是一种紧凑、高性能的计算模块,专为工业环境中的嵌入式系统而设计。这些主板通常包括处理器、内存、I/O 接口和连接选项,可以与传感器、相机和自动化机械集成。

在这些电路板上运行YOLO11 模型,可以对生产线进行实时分析,即时发现问题并提高效率。例如,在汽车制造中,使用 Rockchip 硬件和YOLO11 人工智能系统可以在汽车下线时detect 划痕、错位零件或油漆缺陷。通过实时识别这些缺陷,制造商可以减少浪费、降低生产成本,并在汽车到达客户手中之前确保更高的质量标准。

基于 Rockchip 的设备在性能、成本和效率方面实现了良好的平衡,是在边缘人工智能应用中部署YOLO11 的最佳选择。

以下是在基于 Rockchip 的设备上运行YOLO11 的一些优势:

通过利用硬件加速和 RKNN 格式,Ultralytics YOLO11 可以在基于 Rockchip 的设备上高效运行。这缩短了推理时间并提高了性能,使其成为实时计算机视觉任务和边缘人工智能应用的理想选择。

RKNN 工具包提供了量化和微调等关键优化工具,确保YOLO11 模型在 Rockchip 平台上运行良好。随着边缘人工智能应用的增长,优化模型以实现高效的设备上处理将变得至关重要。有了合适的工具和硬件,开发人员就能为各行各业的计算机视觉解决方案带来新的可能性。

加入我们的社区,探索我们的GitHub 存储库,以了解更多关于 AI 的信息。 通过访问我们的解决方案页面,了解农业中的计算机视觉和医疗保健中的 AI如何推动创新。 此外,请查看我们的许可选项,立即开始构建您的视觉 AI 解决方案!

开启您的机器学习未来之旅