了解去噪的自监督学习如何运作,探究图像产生噪声的原因,并掌握恢复清晰视觉细节的核心方法与步骤。

了解去噪的自监督学习如何运作,探究图像产生噪声的原因,并掌握恢复清晰视觉细节的核心方法与步骤。

相机拍摄的世界并不总是与我们所见一致。在低光环境下拍摄的人像或疾驰的汽车照片,往往会显得颗粒感明显、模糊不清或变形扭曲。

迟缓的传感器、昏暗的环境以及物体运动都可能引入细微的噪点,这些噪点会模糊边缘并掩盖重要细节。一旦清晰度丧失,即便是先进的AI和机器学习系统也难以理解图像内容,因为许多智能系统正是依赖这些精细细节才能高效运作。

例如,计算机视觉作为人工智能的一个分支,能够使机器解读图像和视频。但要实现精准识别,视觉人工智能模型需要基于干净、高质量的视觉数据进行学习。

具体而言,诸如 Ultralytics YOLO11 以及即将Ultralytics 支持物体检测、实例分割和姿势估计 等任务,并可针对不同应用场景进行定制化训练。这些任务依赖于边缘、纹理、颜色和精细结构细节等清晰的视觉线索。

当噪声掩盖这些特征时,模型接收到的训练信号会变弱,导致其更难学习准确的模式。因此,即使少量噪声也会降低实际应用中的性能表现。

此前,我们探讨了自监督学习如何对图像进行降噪。本文将深入剖析自监督降噪技术的工作原理,以及它们如何帮助恢复有意义的视觉信息。让我们开始吧!

在探讨自监督学习如何应用于图像去噪之前,让我们先回顾图像产生噪声的根本原因。

现实世界中的物体和场景图像很少是完美的。低光照条件、传感器质量有限以及快速运动都可能在图像中引入随机扰动,影响各个像素。这些像素级别的干扰被称为噪声,会降低整体清晰度,使重要细节更难辨识。

当噪声掩盖了边缘、纹理和微妙的图案时,计算机视觉系统就难以准确识别物体或解读场景。不同条件会产生不同类型的噪声,每种噪声都会以独特的方式影响图像。

.webp)

以下是图像中常见的几种噪声类型:

那么,自监督去噪的独特之处何在?它在以下场景中尤为出色:当干净的真实图像根本不存在,或难以获取时。

这种情况常出现在低光摄影、高ISO成像、医学与科学成像等场景中,或任何无法避免噪声且难以获取完美参考数据的环境里。模型无需干净的样本,而是直接从现有噪声图像中学习,从而能够适应相机或传感器的特定噪声模式。

当您希望提升下游计算机视觉任务的性能,但数据集充斥着不一致或噪声图像时,自监督去噪也是绝佳选择。通过恢复更清晰的边缘、纹理和结构,这些方法能YOLO 模型更可靠地detect、segment理解场景。简而言之,若您处理的是噪声数据且缺乏干净的训练图像,自监督去噪往往是最实用有效的解决方案。

正如我们之前所见,自监督去噪是一种基于深度学习的人工智能方法,它使模型能够直接从噪声图像中学习,而无需依赖干净的标签。该方法基于自监督学习原理,即模型从数据本身生成自身的训练信号。

换言之,模型能够通过将噪声图像同时作为输入和学习信号源来实现自我训练。通过比较同一图像的不同损坏版本或预测被遮蔽的像素,模型学会了区分哪些模式代表真实结构,哪些只是噪声。借助迭代优化与模式识别,神经网络逐渐提升了从随机变异中辨别有意义图像内容的能力。

.webp)

这得益于特定的学习策略,这些策略引导模型将稳定的图像结构与随机噪声分离。接下来,让我们深入探讨优化这一流程的核心技术与算法,以及每种方法如何帮助模型重建更清晰、更可靠的图像。

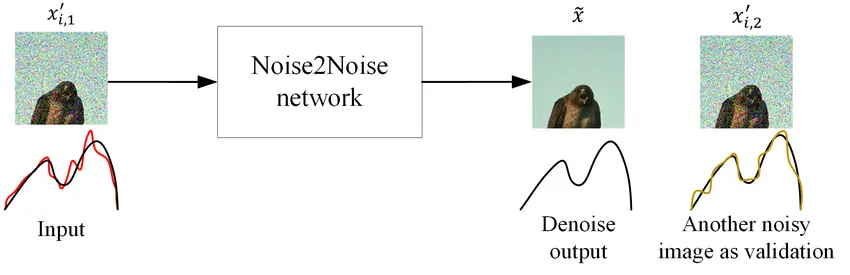

许多早期的去噪自监督学习方法通过比较同一图像的两个噪声版本来工作。由于噪声在每次图像捕获或损坏时都会随机变化,但真实结构保持不变,这些差异可作为模型的学习信号。

这些方法通常被称为成对图像去噪方法,因为它们在训练过程中依赖于使用或生成成对的噪声图像。例如,由Jaakko Lehtinen及其团队提出的Noise2Noise方法,通过使用同一场景的两张独立噪声图像来训练模型。由于两张图像的噪声模式存在差异,模型学会识别代表实际底层图像的一致细节。

随着时间推移,这种方法能教会神经网络抑制随机噪声并保留真实结构,即使它从未见过干净的参考图像。设想一个简单的场景:你拍摄了两张夜间低光街道的照片。

每张图像包含相同的建筑、光线和阴影,但颗粒状噪点出现在不同位置。通过在训练过程中对比这两张噪点照片,自监督模型能够学习哪些视觉模式是稳定的,哪些是由噪点引起的,从而最终提升其重建更清晰图像的能力。

成对方法依赖于比较同一图像的两个不同损坏版本,而盲点方法则采取了不同的策略。它们通过隐藏选定像素使网络无法看到其损坏值,从而让模型仅从单张噪声图像中学习。

模型必须仅利用周围上下文来预测隐藏像素。其核心思想在于:噪声是随机的,但图像的底层结构并非如此。

通过阻止模型复制像素的噪声值,盲点方法促使模型基于稳定的图像模式(如邻近边缘、纹理或颜色渐变)推断该像素应有的值。 诸如Noise2Void(由Alexander Krull团队提出)和Noise2Self(由Joshua Batson与Loïc Royer开发)等技术,通过遮蔽单个像素或局部邻域区域,训练模型进行重建,从而实现这一原理。

更先进的方法(如Noise2Same和PN2V)通过在多个遮罩版本中强制保持预测一致性,或通过显式建模噪声分布来估计不确定性,从而提升了鲁棒性。由于这些方法仅需单张噪声图像,在难以获取无噪声或配对图像的领域(如显微成像、天文观测、生物医学成像或低光摄影)尤为实用。

大多数成对和盲点自监督去噪方法依赖卷积神经网络(CNN)或去噪网络。CNN是这些方法的理想选择,因为它们专注于局部模式,即边缘、纹理和微小细节。

诸如U-Net之类的架构因能结合精细特征与多尺度信息而被广泛应用。然而,卷积神经网络主要在有限邻域内运作,这意味着它们可能忽略跨越图像更大区域的重要关联关系。

为解决这一局限性,引入了Transformer先进降噪方法。该方法不再仅关注邻近像素,而是通过注意力机制理解图像不同部分之间的关联关系。

某些模型采用全局注意力机制,而另一些则使用基于窗口或分层的注意力机制来降低计算成本。但总体而言,这些机制旨在捕捉卷积神经网络(CNN)自身无法捕捉的长距离结构。这种更广阔的视角有助于模型还原重复纹理、平滑表面或大型物体——这些都需要调用图像中跨区域的信息。

除了自监督技术外,还有其他几种方法可以清理噪声图像。传统方法,如双边滤波、小波去噪和非局部均值,都采用简单的数学规则来平滑噪声,同时努力保留重要细节。

与此同时,深度学习方法也已出现,包括从干净与噪声图像对中学习的监督模型,以及能生成更清晰、更逼真结果的生成对抗网络(GAN)。然而,这些方法通常需要更高质量的图像进行训练。

既然我们刚刚介绍了多种不同的技术,您可能会好奇:既然它们各自采用不同的架构,是否每种技术的工作原理都截然不同?然而它们都遵循相似的流程:从数据准备开始,到模型评估结束。

接下来,让我们逐步深入探讨整个自监督去噪图像处理过程的工作原理。

在模型开始从噪声图像中学习之前,首要步骤是确保所有图像看起来一致。真实照片可能存在很大差异。

某些图像可能过亮,某些可能过暗,还有些可能存在轻微的色彩偏差。若将这些差异直接输入模型,它就更难专注于学习噪声的特征。

为解决此问题,每张图像都需经过标准化处理和基础预处理。这可能包括将像素值缩放至标准范围、校正亮度差异,或进行裁剪与尺寸调整。关键在于确保模型接收到的数据经过清理,能够作为稳定且可比的输入使用。

图像归一化完成后,下一步是创建训练信号,使模型无需接触无噪声图像即可进行学习。自监督去噪方法通过确保模型无法简单复制接收到的噪声像素值来实现这一目标。

相反,它们创造了模型必须依赖图像周围上下文的情境——这些上下文包含稳定结构,而非不可预测的噪声。不同方法实现这一目标的方式略有差异,但核心理念是相同的。

某些方法会暂时隐藏或遮蔽特定像素,迫使模型根据邻近像素推断其值;而另一些方法则生成同一噪声图像的独立损坏版本,使输入与目标包含独立的噪声。这两种情况下,目标图像都承载着有意义的结构信息,同时阻止网络获取其应预测像素的原始噪声值。

由于噪声随机变化而底层图像保持不变,这种设置自然促使模型学习真实结构的特征,同时忽略不同版本间变化的噪声。

在训练信号就位后,模型便可通过训练开始学习如何从噪声中分离出有意义的图像结构。每次预测被遮罩或重新损坏的像素时,它必须依赖周围上下文,而非原本占据该位置的噪声值。

经过多次迭代或训练周期,这使网络学会识别图像中保持稳定的模式类型,例如边缘、纹理和光滑表面。同时,它也学会忽略构成噪声特征的随机波动。

例如,考虑一张低光照片中表面看起来极其颗粒感强烈的图像。尽管噪声在像素间存在差异,但底层表面依然平滑。通过反复推断此类区域中的隐藏像素,模型逐渐能够更准确地识别噪声下的稳定模式,并更清晰地进行重建。

通过模型训练过程,网络学习到图像结构的内部表征。这使得模型即使在输入严重损坏的情况下,也能恢复连贯的细节。

在模型学会预测隐藏或再次损坏的像素后,最后一步是评估其在完整图像上的表现。测试过程中,模型接收整张噪声图像,并基于其学习到的图像结构知识生成完整的去噪版本。为衡量该过程的有效性,将输出结果与干净的参考图像或标准基准数据集进行对比。

两种常用指标分别是峰值信噪比(PSNR),用于衡量重建结果与原始真实数据的接近程度;以及结构相似性指数(SSIM),用于评估边缘和纹理等重要特征的保留程度。通常而言,更高分数意味着更准确且视觉上更可靠的去噪效果。

自监督去噪研究不仅发表于IEEE期刊及CVF系列会议,更广泛见于CVPR、ICCV、ECCV等顶级会议,并在arXiv平台大量传播。这类研究常结合合成数据集与真实世界数据集,在可控环境与实际场景中评估深度学习模型的性能表现。一方面,合成数据集以无损图像为基础添加人工噪声,便于通过PSNR和SSIM等指标进行方法对比;

以下是一些常用于基准测试的流行数据集,其中添加了合成噪声:

另一方面,真实世界的噪声数据集包含直接从相机传感器捕获的图像,这些图像是在低光照、高ISO或其他严苛条件下拍摄的。这类数据集旨在检验模型能否处理复杂的非高斯噪声——这类噪声难以通过模拟手段复现。

以下是一些常见的真实世界噪声数据集:

.webp)

若要训练基于深度学习的自监督去噪模型,需考虑以下因素与限制:

自监督去噪为人工智能爱好者提供了一种实用方法,仅凭现有噪声数据即可实现图像净化。通过学习识别噪声下的真实结构,这些方法能够恢复重要的视觉细节。随着去噪技术的持续进步,它有望在日常场景中提升各类计算机视觉任务的可靠性。

加入我们不断壮大的社区!深入探索我们的GitHub代码库,了解更多人工智能知识。若您正致力于开发计算机视觉解决方案,欢迎查看我们的授权方案。探索计算机视觉在零售领域的应用优势,见证人工智能如何改变制造业格局!

开启您的机器学习未来之旅