Entdecken Sie, wie Vision AI Bilder und Videos mithilfe modernster Modelle, Datensätze und durchgängiger Workflows branchenübergreifend in Echtzeit-Erkenntnisse umwandelt.

Entdecken Sie, wie Vision AI Bilder und Videos mithilfe modernster Modelle, Datensätze und durchgängiger Workflows branchenübergreifend in Echtzeit-Erkenntnisse umwandelt.

Jeden Tag nehmen Kameras in Fabriken, Krankenhäusern, Städten, Fahrzeugen und Verbrauchergeräten riesige Mengen an Bildern und Videos auf. Dieser ständige Strom visueller Daten schafft neue Möglichkeiten, erschwert es jedoch auch, zu verstehen, was gerade passiert, und schnell zu handeln.

Beispielsweise können sich belebte Kreuzungen oder überfüllte öffentliche Plätze von einem Moment auf den anderen verändern. Die manuelle Überwachung dieser Umgebungen ist langsam und oft ungenau, insbesondere wenn schnelle und zuverlässige Entscheidungen erforderlich sind.

Um mit solchen Situationen umgehen zu können, müssen Systeme in der Lage sein, visuelle Informationen zu verstehen und in Echtzeit darauf zu reagieren. Computer Vision macht dies möglich, indem es Maschinen ermöglicht, Bilder und Videos zu analysieren, Muster zu erkennen und nützliche Informationen zu extrahieren.

Frühere Computer-Vision-Systeme basierten auf festen Regeln, die in kontrollierten Umgebungen funktionierten, aber oft versagten, wenn sich Bedingungen wie Beleuchtung oder Kamerawinkel änderten. Moderne Vision-KI verbessert diesen Ansatz durch den Einsatz von künstlicher Intelligenz und maschinellem Lernen.

Anstatt nur Bilder zu erfassen oder zu speichern, analysieren diese Systeme visuelle Daten in Echtzeit, lernen aus Beispielen und passen sich an veränderte Umgebungen an. Dadurch ist die visuelle KI in realen Situationen effektiver und kann sich im Laufe der Zeit verbessern, da sie in immer mehr Anwendungen zum Einsatz kommt.

In diesem Artikel werden wir uns genauer ansehen, was Vision-KI ist und wie sie zum Aufbau durchgängiger intelligenter Workflows genutzt werden kann. Los geht's!

Vision AI ist ein Zweig der künstlichen Intelligenz, der es Maschinen ermöglicht, Bilder und Videos zu verstehen und zu interpretieren. Mit anderen Worten: Vision-AI-Systeme analysieren das, was sie sehen, und nutzen diese Informationen, um Aktionen zu unterstützen, Vorhersagen zu optimieren oder Entscheidungen als Teil eines größeren Arbeitsablaufs zu treffen. Im Gegensatz zur generativen KI, die neue Inhalte erstellt, konzentriert sich Vision AI darauf, Informationen aus vorhandenen visuellen Daten zu verstehen und zu extrahieren.

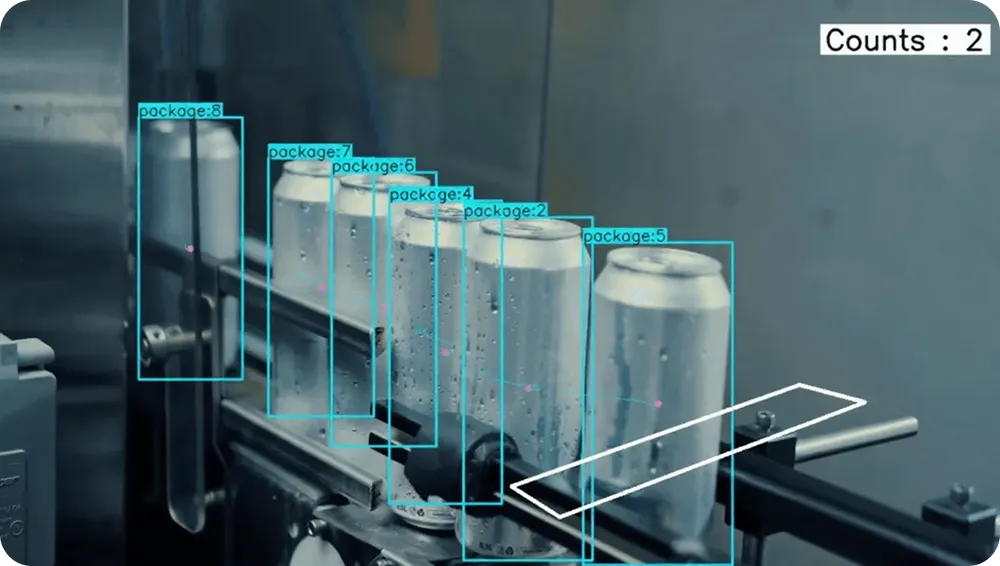

Beispielsweise erfordert die Überwachung von Aktivitäten in einer Fabrikhalle oder im öffentlichen Raum über längere Zeiträume hinweg Geschwindigkeit und Konsistenz, was manuell nur schwer aufrechtzuerhalten ist. Vision-KI-Systeme können diese Herausforderung bewältigen, indem sie Techniken des maschinellen Lernens und Deep Learning einsetzen, um Muster zu erkennen, relevante Details zu identifizieren und auf neue visuelle Informationen zu reagieren.

Da Bilder und Videos oft in großen Mengen und mit hoher Geschwindigkeit erzeugt werden, können visuelle KI-Systeme visuelle Daten kontinuierlich verarbeiten und dieselben Regeln auf jedes Einzelbild anwenden. Dadurch werden die Ergebnisse konsistenter und Teams können ihre Abläufe verbessern, während sie auch bei sich ändernden Bedingungen präzise bleiben.

In der Praxis ist Vision-KI in der Regel Teil eines End-to-End-KI-Systems. Es verbindet Vision-KI-Modelle mit Entscheidungslogik und anderen Tools, die auf die Ergebnisse reagieren. Durch die Umwandlung visueller Eingaben in nützliche Erkenntnisse kann Vision-KI Routineaufgaben automatisieren und eine schnellere, sicherere Entscheidungsfindung in vielen Computer-Vision-Anwendungen unterstützen.

Wie gelangt ein System oder eine Maschine also vom Betrachten eines Bildes oder Videos zum Verstehen dessen, was geschieht, und zum Entscheiden, was als Nächstes zu tun ist?

Der Prozess beginnt mit visuellen Eingaben aus der realen Welt, wie Fotos, Videoclips, Live-Kameraaufnahmen oder Sensorströmen. Da diese Daten hinsichtlich Qualität, Beleuchtung und Kamerawinkel sehr unterschiedlich sein können, müssen sie in der Regel vor der Analyse aufbereitet werden.

Diese Vorbereitung kann das Ändern der Bildgröße, das Anpassen der Beleuchtung und das Organisieren von Videobildern in einem einheitlichen Format umfassen. Oft werden zusätzliche Kontextinformationen wie Zeitstempel oder Kamerastandort hinzugefügt, um eine genauere Analyse zu ermöglichen.

Die aufbereiteten Daten werden dann in einem Lernrahmen verwendet, der es dem System ermöglicht, visuelle Muster zu erkennen. Durch das Training mit gekennzeichneten Bildern und Videos lernt ein Vision-KI-Modell, wie Objekte, Muster und Ereignisse unter verschiedenen Bedingungen erscheinen.

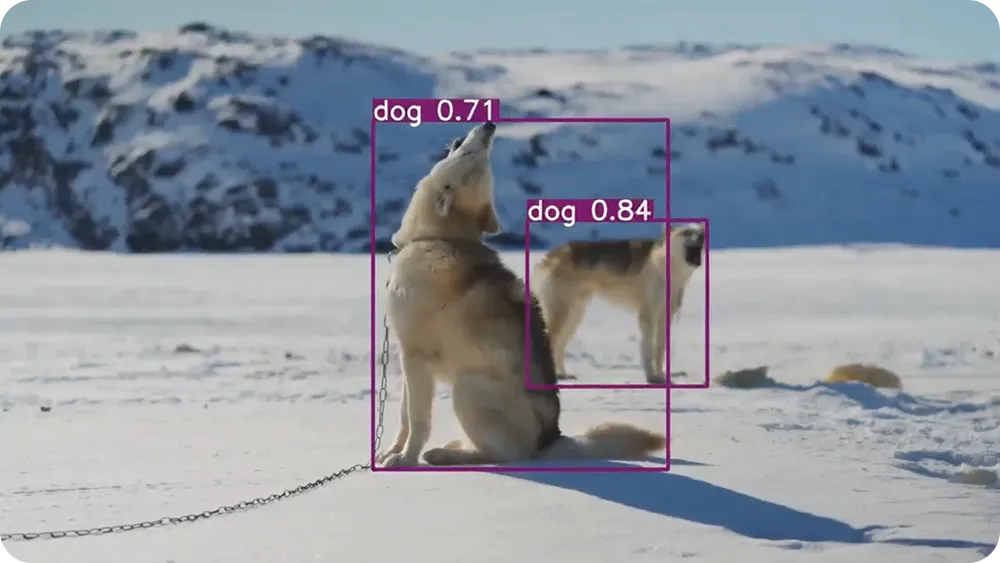

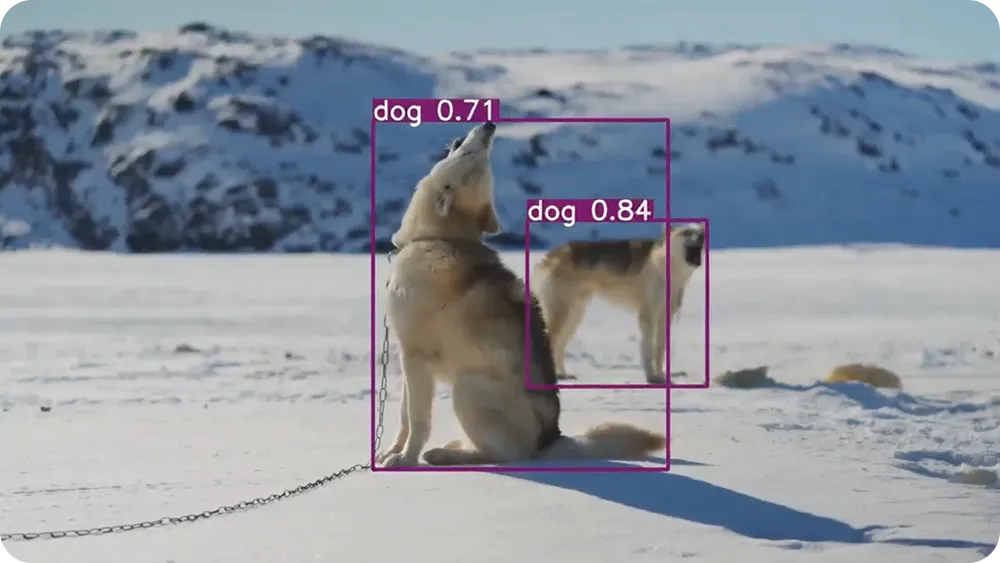

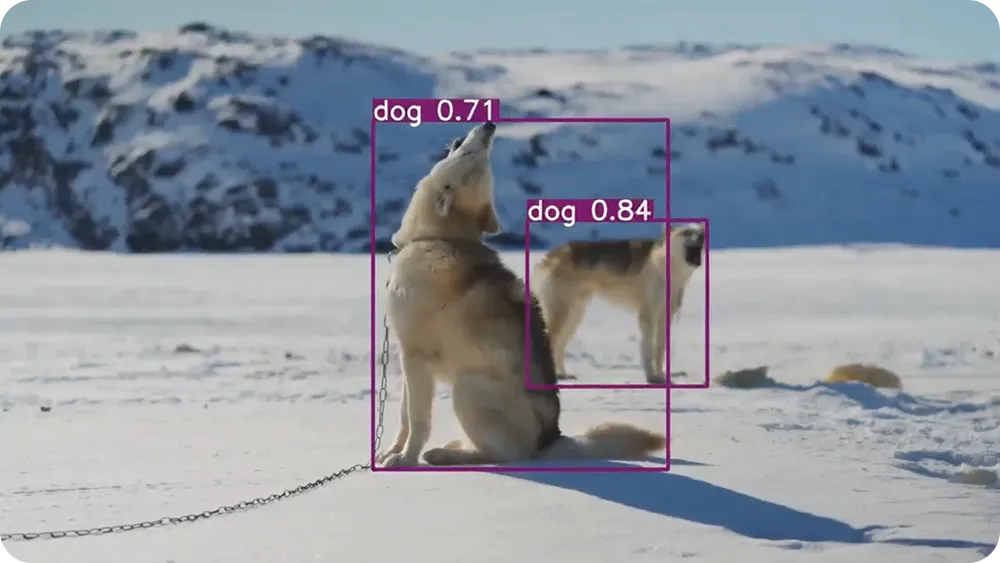

Dieses erworbene Verständnis bildet die Grundlage für viele gängige Computer-Vision-Aufgaben wie die Objekterkennung (Identifizieren und Lokalisieren von Objekten innerhalb eines Bildes) und die Instanzsegmentierung (Trennen und Beschriften einzelner Objekte auf Pixelebene). Modernste Vision-KI-Modelle wie Ultralytics wurden entwickelt, um diese Aufgaben zu unterstützen und gleichzeitig in realen Umgebungen schnell und genau zu arbeiten.

Sobald das System implementiert ist, werden visuelle Eingaben kontinuierlich als Teil eines End-to-End-Workflows verarbeitet. Das Modell analysiert Bilder und Videos und sendet seine Ergebnisse an Dashboards, Automatisierungstools oder andere KI-Systeme. In einigen Fällen nutzen Vision-KI-Agenten diese Ergebnisse, um Aktionen auszulösen oder die Entscheidungsfindung zu unterstützen, wodurch visuelles Verständnis in praktische, umsetzbare Erkenntnisse umgewandelt wird.

Wenn Sie sich näher mit Vision-KI befassen, fragen Sie sich vielleicht, warum Modelle und Architekturen so wichtig sind und wie sie sich auf die Systemleistung auswirken. Vision-KI-Modelle sind für die heutigen Innovationen im Bereich Computer Vision von entscheidender Bedeutung.

Die meisten visuellen KI-Systeme basieren auf einem Modell, das festlegt, wie Bilder und Videos analysiert werden. Das Modell definiert, was das System in einer Szene erkennen kann und wie gut es unter verschiedenen Bedingungen funktioniert.

Da Vision-KI-Anwendungen immer vielfältiger und komplexer geworden sind, haben sich auch Vision-KI-Modelle und ihre zugrunde liegenden Architekturen weiterentwickelt, um mit dieser Entwicklung Schritt zu halten und benutzerfreundlich zu bleiben. Bei frühen Computer-Vision-Systemen mussten Ingenieure manuell definieren, wonach das System suchen sollte, beispielsweise bestimmte Kanten, Farben oder Formen.

Diese regelbasierten Ansätze funktionierten gut in kontrollierten Umgebungen, versagten jedoch häufig, wenn sich die Beleuchtung änderte, die Kameraqualität variierte oder die Szenen komplexer wurden. Moderne Vision-KI-Modelle verfolgen einen anderen Ansatz.

Viele Open-Source-Modelle lernen visuelle Muster direkt aus Daten, wodurch sie flexibler und besser für reale Umgebungen geeignet sind, in denen die Bedingungen unvorhersehbar sind. Fortschritte in der Modellarchitektur haben auch die Verarbeitung von Bildern und Videos vereinfacht, sodass diese Systeme leichter zu implementieren und in praktische Vision-KI-Plattformen zu integrieren sind.

YOLO Ultralytics sind ein gutes Beispiel für diesen Wandel. Modelle wie YOLO26 werden häufig für Objekterkennungsaufgaben eingesetzt, die Geschwindigkeit und Konsistenz erfordern, insbesondere in Live-Videoanwendungen.

Hier sind einige der wichtigsten Aufgaben der Bildverarbeitung, auf die sich KI-gesteuerte Bildverarbeitungssysteme stützen, um visuelle Informationen zu verstehen und reale Umgebungen zu optimieren:

Hinter jedem effektiven Vision-KI-System steht ein sorgfältig zusammengestellter Datensatz. Diese Vision-KI-Datensätze liefern die Bilder und Videos, anhand derer Vision-KI-Modelle lernen, Objekte, Muster und Szenen in realen Umgebungen zu erkennen.

Die Qualität der Daten wirkt sich direkt auf die Genauigkeit und Zuverlässigkeit des Systems aus. Um visuelle Daten aussagekräftig zu gestalten, werden Datensätze mit Anmerkungen versehen. Das bedeutet, dass jedem Bild oder Video wichtige Details hinzugefügt werden, beispielsweise durch die Beschriftung von Objekten, die Hervorhebung bestimmter Bereiche oder die Zuordnung zu Kategorien.

Neben Labels können zusätzliche Metadaten wie Zeit, Ort oder Szenentyp hinzugefügt werden, um die Daten zu organisieren und das Verständnis zu verbessern. Datensätze werden häufig auch in Trainings-, Validierungs- und Testsätze unterteilt, damit Systeme anhand von Bildmaterial bewertet werden können, das sie zuvor noch nicht gesehen haben.

Beliebte Datensätze wie ImageNet, COCO und Open Images haben durch die Bereitstellung großer, vielfältiger Sammlungen von beschrifteten Bildern eine wichtige Rolle bei der Weiterentwicklung der Bildverarbeitungs-KI gespielt. Dennoch ist das Sammeln von Daten aus der realen Welt nach wie vor schwierig.

Voreingenommenheit, Lücken in der Abdeckung und sich ständig verändernde Umgebungen erschweren die Erstellung von Datensätzen, die die realen Bedingungen wirklich widerspiegeln. Die richtige Balance zwischen Daten und Umfang ist der Schlüssel zum Aufbau zuverlässiger Vision-KI-Systeme.

Nachdem wir nun ein besseres Verständnis davon haben, wie Vision-KI funktioniert, wollen wir uns ansehen, wie sie in realen Anwendungen eingesetzt wird. In vielen Branchen hilft Vision-KI Teams dabei, visuelle Aufgaben in großem Umfang zu bewältigen, was zu schnelleren Reaktionen und effizienteren Abläufen führt.

Hier sind einige gängige Anwendungsbereiche für Vision-KI in verschiedenen Branchen:

Hier sind einige der wichtigsten Vorteile des Einsatzes von Vision-KI in realen Anwendungen:

Trotz dieser Vorteile gibt es Einschränkungen, die sich auf die Leistung von Vision-KI-Systemen auswirken können. Hier sind einige Faktoren, die zu beachten sind:

Vision AI wandelt Bilder und Videos in aussagekräftige Informationen um, die Systeme verstehen und nutzen können. Dies hilft bei der Automatisierung visueller Aufgaben und unterstützt eine schnellere und zuverlässigere Entscheidungsfindung. Seine Wirksamkeit hängt von der Kombination leistungsfähiger Modelle, hochwertiger Datensätze und gut konzipierter Workflows ab, die zusammenwirken.

Interessieren Sie sich für Vision AI? Treten Sie unserer Community bei und erfahren Sie mehr über Computer Vision in der Landwirtschaft und Vision AI in der Automobilindustrie. Informieren Sie sich über unsere Lizenzoptionen, um mit Computer Vision zu beginnen. Besuchen Sie unser GitHub-Repository, um mehr über KI zu erfahren.

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens