了解 Ultralytics YOLO26 如何通过渐进式损失平衡 (Progressive Loss Balancing)、小目标感知标签分配 (Small-Target-Aware Label Assignment) 和 MuSGD 优化器实现更可靠的训练。

.webp)

了解 Ultralytics YOLO26 如何通过渐进式损失平衡 (Progressive Loss Balancing)、小目标感知标签分配 (Small-Target-Aware Label Assignment) 和 MuSGD 优化器实现更可靠的训练。

.webp)

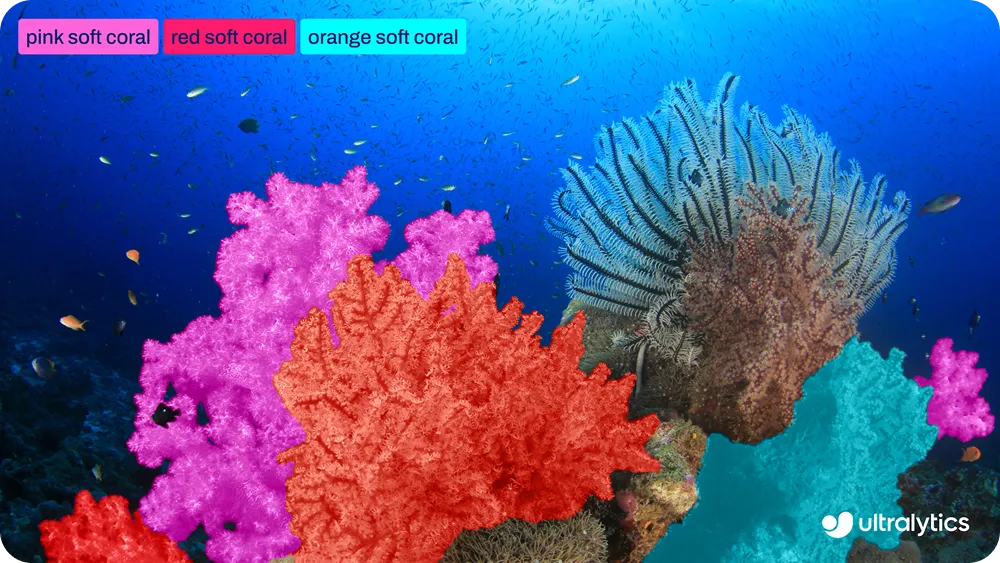

上周,我们发布了Ultralytics YOLO26,为边缘优先的实时计算机视觉模型设定了新标准。与之前的Ultralytics YOLO 模型(例如Ultralytics YOLO11)类似,YOLO26 支持用户熟悉的计算机视觉核心任务,包括目标 detect、实例 segment 和姿势估计。

然而,YOLO26不仅仅是一个增量更新。尽管其支持的任务可能看起来很熟悉,但这个新模型代表了计算机视觉模型训练方式的创新性飞跃。YOLO26的重点不仅在于推理效率,更在于提升训练的稳定性。

YOLO26在设计时充分考虑了整个训练生命周期。这意味着更快的收敛、更可靠的训练运行以及一致的模型行为。这些改进在实际工作流程中尤为重要,因为训练的可靠性直接影响模型迭代和部署的速度。

为实现这一目标,YOLO26引入了几项有针对性的训练创新,例如渐进式损失平衡(ProgLoss)、小目标感知标签分配(STAL)和MuSGD优化器。这些改进共同提升了学习损失的平衡方式、标签的分配方式以及优化过程随时间演变的行为。

在本文中,我们将探讨这些机制的工作原理,以及它们如何使Ultralytics YOLO26更易于训练并在规模化应用中更具可靠性。让我们开始吧!

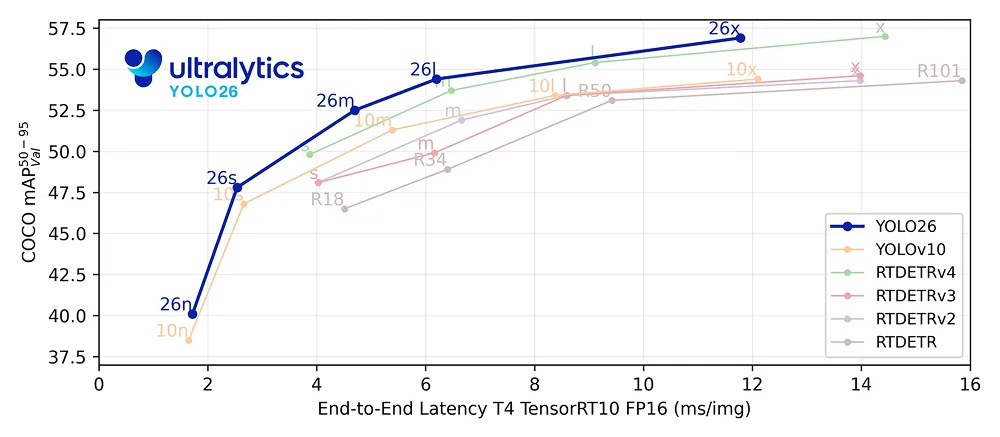

Ultralytics YOLO26通过消除对NMS等后处理步骤的依赖,原生简化了整个推理流程。YOLO26不再生成大量重叠预测并随后进行过滤,而是直接从网络中生成最终的detect结果。

这使得YOLO26成为一个端到端模型,其中预测、重复项消除和最终输出都在网络内部学习。这简化了部署并提高了推理效率,同时也影响了模型在训练过程中的学习方式。

在这样的端到端系统中,训练和推理紧密相连。由于没有外部后处理阶段来后续修正预测,模型必须在训练过程中学会做出清晰且自信的决策。

这使得训练目标与推理行为之间的一致性尤为重要。模型训练方式与推理时使用方式之间的任何不匹配都可能导致不稳定的学习或更慢的收敛。

YOLO26通过从一开始就围绕实际应用场景设计其训练过程来解决这个问题。训练系统不再仅仅关注推理速度,而是旨在支持长时间运行中的稳定学习、从Nano到Extra Large各种模型尺寸的一致收敛,以及在多样化数据集上的鲁棒性能。

Ultralytics YOLO26的一项关键训练创新是基于先前YOLO模型中使用的双头训练方法。在目标detect模型中,头指的是网络中负责进行预测的部分。

换句话说,detect头学习预测图像中物体的位置以及这些物体是什么。它们通过回归边界框坐标来实现这一点,这意味着它们学习估计输入图像中每个物体的位置和大小。

在训练过程中,模型通过最小化损失来学习,损失是衡量其预测与正确答案或真实值之间差距的数值度量。更低的损失意味着模型的预测更接近真实值,而更高的损失则表示更大的误差。损失计算指导模型在训练过程中如何更新其参数。

YOLO26在训练期间使用两个detect头,它们共享相同的底层模型但服务于不同的目的。一对一头是在推理时使用的头。它学习将每个物体与一个单一、自信的预测相关联,这对于YOLO26的端到端、NMS-free设计至关重要。

同时,一对多头仅在训练期间使用。它允许将多个预测与同一物体相关联,提供更密集的监督。这种更丰富的学习信号有助于稳定训练并提高准确性,尤其是在早期阶段。

在YOLO26中,两个头都使用相同的边界框回归和分类损失计算。早期的实现方法在整个训练过程中对这两种损失信号应用了固定的平衡。

然而,在实践中,每个头的重要性会随时间变化。密集监督在早期最有用,而与推理行为的一致性在训练后期变得更重要。YOLO26围绕这一洞察进行设计,这直接影响了它如何随着训练的进行重新平衡学习信号。

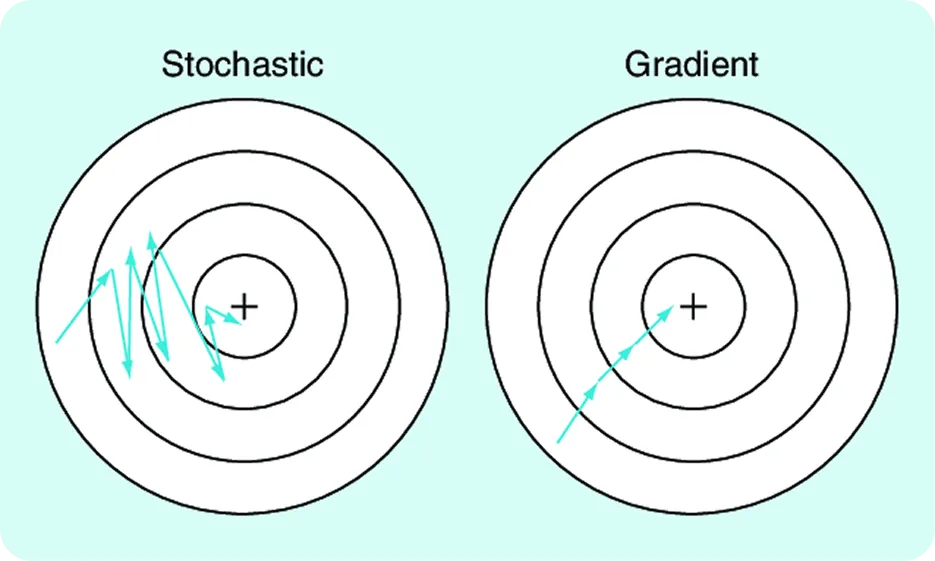

那么,Ultralytics YOLO26如何在训练过程中处理这些不断变化的学习需求呢?它使用渐进式损失平衡来调整学习信号随时间变化的权重。

ProgLoss的工作原理是,随着训练的进行,动态调整每个头对总损失的贡献权重。在早期,更多权重放在一对多头,以稳定学习并提高召回率。随着训练的继续,平衡逐渐转向一对一头,使训练更紧密地与推理行为对齐。

这种渐进式转变使YOLO26能够以正确的顺序学习。渐进式损失平衡不再强制模型一次性优化相互竞争的目标,而是在训练的每个阶段优先处理最有用的学习信号。结果是更平滑的收敛、更少的训练不稳定情况以及更一致的最终性能。

Ultralytics YOLO26的另一个有趣的训练改进来自于模型如何将训练目标分配给预测,这一过程被称为标签分配。它负责将真实值物体与候选预测进行匹配,这些候选预测通常称为锚点。

这些匹配决定了哪些预测会获得监督并计入损失。YOLO26 基于现有的标签分配方法——任务对齐学习(TAL),该方法旨在训练期间更好地对齐分类与定位。

尽管TAL对大多数物体表现良好,但训练揭示了一个重要局限性。在匹配过程中,极小的物体可能会被完全忽略。实际上,在640像素输入图像中,小于约8像素的物体通常无法获得任何锚框分配。当这种情况发生时,模型对这些物体几乎没有或根本没有监督,从而难以可靠地学习 detect 它们。

为解决此问题,YOLO26 引入了小目标感知标签分配(STAL)。STAL 修改了分配过程,以确保在训练期间不会忽略小物体。具体来说,它对小于8像素的物体强制执行至少四个锚框分配。这保证了即使是微小的物体也能持续地对训练损失做出贡献。

通过加强对小目标的监督,STAL 提高了在小物体或远距离物体常见的场景中的学习稳定性和 detect 性能。这种改进对于边缘优先的YOLO26应用尤为重要,例如航空影像、机器人技术和物联网(IoT)系统,在这些系统中,物体通常很小、很远或部分可见,而可靠的 detect 至关重要。

为了支持更稳定和可预测的训练,Ultralytics YOLO26 还引入了一种名为 MuSGD 的新型优化器。该优化器旨在提高端到端 detect 模型中的收敛性和训练可靠性,尤其是在模型规模和训练复杂性增加时。

为了让神经网络在训练期间进行学习并相应地调整权重,我们会计算一个误差(也称为“损失”)。因此,模型使用损失值来衡量其预测的错误程度,计算指示其参数应如何变化的梯度,然后更新这些参数以减少误差。随机梯度下降(SGD)是一种广泛使用的优化器,它执行这些更新,使训练高效且可扩展。

MuSGD 在这一熟悉的基础上,融入了受 Muon 启发而来的优化思想,Muon 是一种用于大型语言模型训练的方法。这些思想受到了近期进展的影响,例如月之暗面(Moonshot AI)的 Kimi K2,它通过更结构化的参数更新展示了改进的训练行为。

YOLO26 采用混合更新策略。一些参数使用 Muon 启发式更新和 SGD 的组合进行更新,而另一些则单独使用 SGD。这使得 YOLO26 能够在优化过程中引入额外的结构,同时保持使 SGD 有效的鲁棒性和泛化特性。

结果是更平滑的优化、更快的收敛以及在不同模型尺寸下更可预测的训练行为,这使得 MuSGD 成为 YOLO26 更易于训练并在规模上更可靠的关键原因。

Ultralytics YOLO26 的训练创新,结合其端到端、NMS-free 和边缘优先等关键特性,使得模型更易于训练并在规模上更可靠。您可能想知道这对于计算机视觉应用究竟意味着什么。

实际上,它使得将计算机视觉部署到实际运行环境中变得更加容易。模型训练更具可预测性,在不同尺寸下扩展更一致,并且更易于适应新数据集。这减少了实验与部署之间的摩擦,尤其是在可靠性和效率与原始性能同等重要的环境中。

例如,在机器人技术和工业视觉应用中,随着环境、传感器或任务的变化,模型通常需要频繁地重新训练。借助 YOLO26,团队可以更快地迭代,而无需担心不稳定的训练运行或不同模型尺寸下的不一致行为。

可靠的计算机视觉系统不仅取决于模型在推理时的表现,也取决于它们的训练方式。通过改进学习信号的平衡方式、小目标的处理方式以及优化过程,YOLO26 使训练更加稳定且易于扩展。这种对可靠训练的关注有助于团队更顺畅地从实验阶段过渡到实际部署,尤其是在边缘优先的应用中。

想了解AI?访问我们的GitHub仓库以发现更多。加入我们活跃的社区,了解物流AI和汽车视觉AI等领域的创新。立即开始计算机视觉之旅,请查看我们的许可选项。

开启您的机器学习未来之旅