从低能见度到眩光,了解是什么让夜间交通视频检测的准确性面临挑战,以及计算机视觉如何提高安全性和流畅性。

从低能见度到眩光,了解是什么让夜间交通视频检测的准确性面临挑战,以及计算机视觉如何提高安全性和流畅性。

道路在黑暗中看起来不同,不仅对驾驶员而言,对负责保障他们安全的系统也是如此。低能见度、前灯眩光和快速移动的反射光会使夜间车辆检测更具挑战性。

传统方法,如人工观察或基于运动的摄像头,主要依赖于人的判断和简单的运动线索。这在弱光或复杂的交通状况下可能不太可靠。这些方法可能会错误识别车辆或行人,导致虚假检测或遗漏观察结果。

人工智能 (AI)、深度学习和计算机视觉可以通过自动化车辆检测和识别来弥合差距。特别是,计算机视觉是人工智能的一个分支,它使机器能够看到和解释视觉数据。在夜间交通视频检测方面,视觉 AI 模型可以超越亮度或运动,学习识别复杂的模式,从而提高准确性。

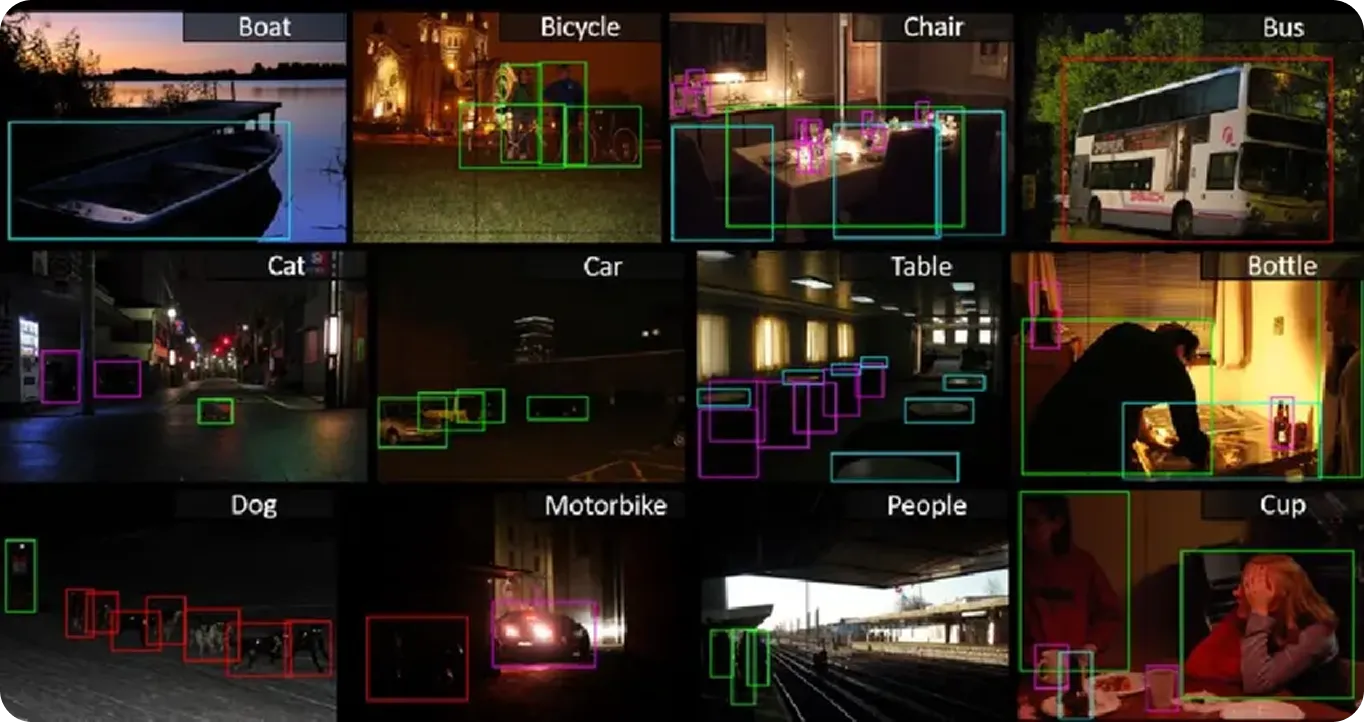

例如,Ultralytics YOLO26和 Ultralytics YOLO11等计算机视觉模型以速度和精度著称。它们可以实时处理视频和图像数据,在一个帧内检测多个物体并对其进行分类,还可以跨序列跟踪这些物体。

这些功能是通过各种视觉任务实现的,如物体检测和实例分割,即使前灯、阴影或重叠的车辆使检测变得困难。这些功能使模型能够识别、classify和区分物体。

在本文中,我们将探讨夜间交通监控的挑战,了解计算机视觉如何应对这些挑战,以及视觉 AI 在现实世界交通监控系统中的应用。让我们开始吧!

在探讨计算机视觉如何解决夜间交通检测的挑战之前,让我们看看为什么在天黑后发现车辆如此困难。以下是一些需要考虑的因素:

计算机视觉模型是通过被称为数据集的大型图像集合进行训练的。这些数据集仔细标注了其中包含的物体,如汽车、卡车、行人和自行车,作为训练的基础。通过研究这些标注的示例,模型学会了识别模式,从而能够在新的视频片段中识别和detect 物体。

在训练过程中,模型从数据中提取特征,并利用这些特征来提高检测精度。这个过程有助于减少模型在实际交通场景中出现漏检和误报的情况。

然而,构建用于夜间环境的数据集或数据集合则更具挑战性。较差的视频质量使得标注工作耗时且容易出错。此外,在夜间环境中,事故或异常驾驶行为等罕见但重要的事件难以捕捉。这导致模型可供学习的训练样本数量有限。

为了解决这个问题,研究人员开发了专门的基准数据集。基准数据集不仅仅是一组图像。它包括标准化标签、评估协议以及精确度、召回率和平均精确度mAP)等性能指标。有了这些指标,就可以在相同的条件下测试和比较不同的算法,从而确保评估的公平性和一致性。

例如,ExDark 基准数据集包含 7,363 张低光照图像,涵盖 12 个物体类别(自行车、船、瓶子、公共汽车、汽车、猫、椅子、杯子、狗、摩托车、人、桌子)。每张图像都用边界框进行标注,该数据集广泛应用于研究中,以评估在弱光照条件下的物体检测和分类性能。

类似地,NightOwls 基准数据集提供约 115,000 张夜间图像,其中包含约 279,000 个人行道标注。它已成为评估行人检测系统的关键资源,这些系统在道路安全和高级驾驶辅助系统(ADAS)中发挥着至关重要的作用。

现在我们对所涉及的挑战以及对数据集的需求有了更好的理解,接下来让我们仔细看看基于视觉的系统如何解释夜间交通视频。

YOLO11 和 YOLO26 等模型支持对象检测、跟踪和实例分割等计算机视觉任务,即使在弱光条件下也能分析交通状况。以下是这些模型在分析夜间交通时支持的视觉人工智能任务概览:

我们讨论了模型训练、对数据集的需求以及YOLO11 和 YOLO26 等模型支持的任务。但要将所有内容归纳起来,还需要一个概念:如何将这些模型实际应用于夜间监测。

开箱即用的Ultralytics YOLO 模型是预训练版本,这意味着它们已经在大型通用数据集上经过训练,例如COCO 数据集,其中涵盖了许多日常物体。这为模型提供了detect 和classify 物体的强大基础能力。

但是,由于这些数据集包含的低光照或夜间示例非常少,因此预训练模型在处理眩光、阴影或对比度差方面效果不佳。为了使它们对夜间交通视频检测产生影响,需要在反映真实夜间条件的专门数据集上对它们进行微调。

微调或自定义训练涉及在低光照条件下捕获的额外标记图像上训练模型,例如在车头灯眩光下的车辆、人行横道上的行人或夜间拥挤的十字路口,因此它可以学习夜间场景的独特特征。

经过自定义训练后,该模型可以支持检测、跟踪、分割或分类等任务,并在低光照条件下具有更高的准确性。这使得交通管理部门可以将此类模型应用于实际用例,例如夜间的车辆计数、速度估计、自适应信号控制和事故预防。

接下来,让我们看看如何在实际的夜间交通系统中采用计算机视觉。

城市十字路口是交通管理中最困难的区域之一,尤其是在夜间,能见度降低且交通流量变得难以预测。传统的交通信号灯依赖于固定的计时器,无法对实时变化做出反应。研究表明,这不仅浪费了驾驶员的时间,还会导致不必要的燃料消耗和延误。

这正是计算机视觉系统可以帮助克服这一挑战的地方。这些系统可以实时监控车辆行驶并detect 车辆数量。然后将数据输入自适应交通控制系统。这样,信号灯就能根据实际路况迅速调整。因此,如果一条车道拥挤不堪,而另一条车道却空无一人,信号配时就可以立即调整,以消除瓶颈。

夜间驾驶比白天更危险,因为能见度降低、光线不均和眩光使驾驶员更难判断距离。事实上,研究表明,夜间每公里的致命事故率可比白天高出三倍。

传统的监控方法,如固定监控摄像头、道路巡逻、车辆存在传感器和固定时间信号系统等,都是被动运行的,可能无法及早detect 危险情况以防止其发生。

计算机视觉解决方案可以通过分析实时视频流并检测道路或高速公路上的异常模式来解决这个问题。通过使用目标跟踪,这些系统可以实时监控车辆行为,并在出现异常情况时发出警报。

例如,如果一辆行驶中的车辆正在变换车道、在拥堵区域行驶过快或突然减速,系统可以实时标记它。这意味着有关部门可以迅速做出反应,并在事故发生前加以预防。

对于自动驾驶车辆和ADAS,夜间驾驶带来了其自身的挑战。低能见度和不可预测的交通模式使得传统传感器难以可靠地执行任务,从而引发了安全问题。

计算机视觉通过处理诸如目标检测、车道跟踪和分割等任务来增强这些系统,使车辆即使在光线不足的条件下也能识别行人、其他车辆和障碍物。当与雷达或LiDAR(光探测和测距)结合使用时,后者以3D方式绘制周围环境,增加的视觉层有助于ADAS提供早期预警,并使自动驾驶车辆具备在夜间更安全地导航所需的感知能力。

超速是造成全球三分之一的交通事故死亡的原因,而且这种风险在夜间只会变得更糟。黑暗使得交警更难抓到违规行为,因为在白天清晰可见的细节在天黑后往往会变得模糊。

这就是为什么在空旷的道路上超速、闯红灯或漂移到错误的车道等违规行为通常不会受到惩罚。计算机视觉通过使用红外摄像机来发现违规行为,即使在弱光条件下也是如此,从而解决了这个问题。这些系统创建检测区域,在这些区域中记录事件,从而减少误报并提供清晰、可验证的证据。对于交通管理部门来说,这意味着更少的盲点和更少的对手动检查的依赖。

以下是使用视觉AI进行夜间交通视频检测的一些优点。

尽管有其优点,但使用视觉AI进行夜间交通检测也存在一定的局限性。以下是一些需要牢记的因素:

随着城市的发展和道路的繁忙,夜间交通检测正朝着更智能、反应更灵敏的系统方向发展。例如,热像仪和红外传感器可以detect 人和车辆的热信号,即使在漆黑环境中也能看清。这就减少了标准摄像机在强光或弱光环境下拍摄时出现的错误。

另一种日益普及的方法是摄像头与激光雷达融合。摄像头提供道路的详细图像,而激光雷达生成精确的 3D 地图。结合使用时,它们可以提高检测车道、车辆和障碍物的准确性,尤其是在弱光或中度雾天条件下。

与此同时,低光图像增强、行人识别和车牌识别技术的进步正在扩展计算机视觉的能力。 随着这些改进,即使是光线不足的道路和十字路口也可以得到更可靠、更少错误的监控。

夜间车辆检测一直是交通监控的挑战,但计算机视觉正使其变得更容易管理。 通过减少眩光的影响和处理复杂的交通场景,它可以更准确地了解道路在天黑后的状况。 随着这些系统的不断进步,它们正在为夜间更安全、更智能、更高效的交通运输铺平道路。

准备好将视觉 AI 集成到您的项目中了吗? 加入我们活跃的社区,探索诸如汽车行业中的 AI和机器人技术中的视觉 AI等创新。 访问我们的 GitHub 存储库以了解更多信息。 要立即开始使用计算机视觉,请查看我们的许可选项。

开启您的机器学习未来之旅