كيف يتدرب Ultralytics بشكل أكثر ذكاءً باستخدام ProgLoss و STAL و MuSGD

تعرف على كيفية قيام Ultralytics بالتدريب بشكل أكثر موثوقية باستخدام موازنة الخسارة التقدمية، وتعيين التسميات المدركة للأهداف الصغيرة، ومحسن MuSGD.

.webp)

تعرف على كيفية قيام Ultralytics بالتدريب بشكل أكثر موثوقية باستخدام موازنة الخسارة التقدمية، وتعيين التسميات المدركة للأهداف الصغيرة، ومحسن MuSGD.

.webp)

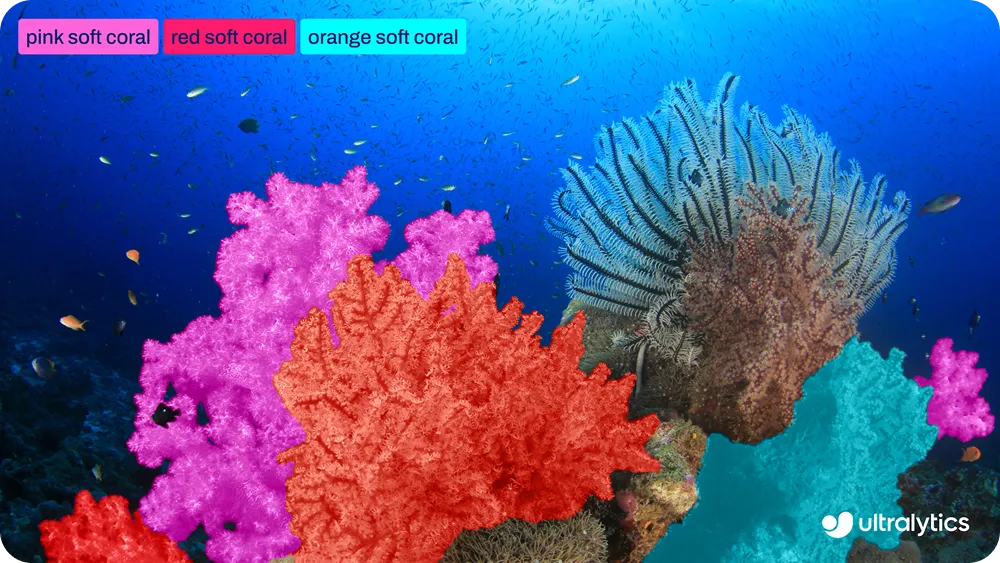

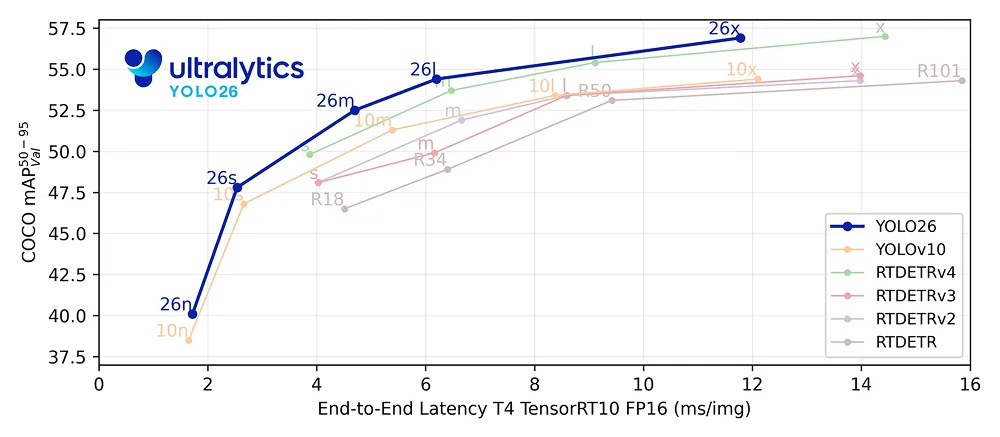

في الأسبوع الماضي، أطلقنا Ultralytics الذي وضع معيارًا جديدًا لنماذج الرؤية الحاسوبية في الوقت الفعلي التي تعتمد على الحافة أولاً. على غرار YOLO Ultralytics YOLO السابقة، مثل Ultralytics YOLO11، يدعم YOLO26 مهام الرؤية الحاسوبية الأساسية المألوفة للمستخدمين، بما في ذلك اكتشاف الكائنات وتجزئة الحالات وتقدير الوضع.

ومع ذلك، فإن YOLO26 ليس مجرد تحديث تدريجي. على الرغم من أن المهام المدعومة قد تبدو مألوفة، إلا أن هذا النموذج الجديد يمثل خطوة مبتكرة إلى الأمام في طريقة تدريب نماذج الرؤية الحاسوبية. مع YOLO26، يتجاوز التركيز كفاءة الاستدلال إلى جعل التدريب أكثر استقرارًا.

تم تصميم YOLO26 مع مراعاة دورة التدريب الكاملة. وهذا يعني تقاربًا أسرع، وتدريبات أكثر موثوقية، وسلوكًا متسقًا للنموذج. هذه التحسينات مهمة بشكل خاص في سير العمل في العالم الواقعي، حيث تؤثر موثوقية التدريب بشكل مباشر على سرعة تكرار النماذج ونشرها.

لتمكين ذلك، يقدم YOLO26 العديد من الابتكارات التدريبية المستهدفة مثل موازنة الخسارة التقدمية (ProgLoss) وتعيين التسميات المدركة للأهداف الصغيرة (STAL) ومحسن MuSGD. تعمل هذه التغييرات معًا على تحسين كيفية موازنة خسارة التعلم وكيفية تعيين التسميات وكيفية عمل التحسين بمرور الوقت.

في هذه المقالة، سوف نستكشف كيفية عمل كل من هذه الآليات ولماذا تجعل Ultralytics أسهل في التدريب وأكثر موثوقية على نطاق واسع. هيا بنا نبدأ!

يعمل Ultralytics على تبسيط خط أنابيب الاستدلال بالكامل عن طريق إزالة الاعتماد على خطوات المعالجة اللاحقة مثل Non-Maximum Suppression. بدلاً من إنشاء العديد من التنبؤات المتداخلة وتصفيتها لاحقًا، ينتج YOLO26 عمليات الكشف النهائية مباشرة من الشبكة.

وهذا يجعل YOLO26 نموذجًا شاملاً، حيث يتم تعلم التنبؤ وحل التكرار والنتائج النهائية داخل الشبكة نفسها. وهذا يبسط عملية النشر ويحسن كفاءة الاستدلال، بينما يشكل أيضًا كيفية تعلم النموذج أثناء التدريب.

في نظام شامل مثل هذا، يرتبط التدريب والاستدلال ارتباطًا وثيقًا. نظرًا لعدم وجود مرحلة معالجة لاحقة خارجية لتصحيح التنبؤات لاحقًا، يجب أن يتعلم النموذج اتخاذ قرارات واضحة وواثقة أثناء التدريب نفسه.

وهذا يجعل التوافق بين أهداف التدريب وسلوك الاستدلال أمرًا بالغ الأهمية. أي تباين بين كيفية تدريب النموذج وكيفية استخدامه في وقت الاستدلال يمكن أن يؤدي إلى تعلم غير مستقر أو تقارب أبطأ.

تتعامل YOLO26 مع هذا الأمر من خلال تصميم عملية التدريب الخاصة بها حول الاستخدام في العالم الحقيقي منذ البداية. بدلاً من التركيز فقط على سرعة الاستدلال، تم تصميم نظام التدريب لدعم التعلم المستقر على المدى الطويل، والتقارب المتسق عبر أحجام النماذج من Nano إلى Extra Large، والأداء القوي على مجموعات بيانات متنوعة.

أحد الابتكارات الرئيسية في التدريب Ultralytics يعتمد على نهج التدريب ثنائي الرأس المستخدم في YOLO السابقة. في نماذج الكشف عن الكائنات، يشير الرأس إلى الجزء من الشبكة المسؤول عن إجراء التنبؤات.

بعبارة أخرى، تتعلم رؤوس الكشف توقع مكان وجود الكائنات في الصورة وماهية تلك الكائنات. وتقوم بذلك عن طريق إرجاع إحداثيات المربع المحيط، مما يعني أنها تتعلم تقدير موضع وحجم كل كائن في الصورة المدخلة.

أثناء التدريب، يتعلم النموذج عن طريق تقليل الخسارة، وهي مقياس رقمي لمدى ابتعاد تنبؤاته عن الإجابات الصحيحة أو الحقيقة الأساسية. تعني الخسارة الأقل أن تنبؤات النموذج أقرب إلى الحقيقة الأساسية، بينما تشير الخسارة الأعلى إلى أخطاء أكبر. يوجه حساب الخسارة كيفية تحديث النموذج لمعلماته أثناء التدريب.

يستخدم YOLO26 رأسين للكشف أثناء التدريب يشتركان في نفس النموذج الأساسي ولكنهما يخدمان أغراضًا مختلفة. الرأس الفردي هو الرأس المستخدم في وقت الاستدلال. يتعلم هذا الرأس ربط كل كائن بتنبؤ واحد مؤكد، وهو أمر ضروري لتصميم YOLO26 الشامل NMS.

في الوقت نفسه، يتم استخدام الرأس "واحد إلى كثير" فقط أثناء التدريب. وهو يسمح بربط تنبؤات متعددة بنفس الكائن، مما يوفر إشرافًا أكثر كثافة. تساعد إشارة التعلم الأكثر ثراءً هذه على استقرار التدريب وتحسين الدقة، خاصة في المراحل المبكرة.

في YOLO26، يستخدم كلا الرأسين نفس حساب الخسارة لانحدار الصندوق والتصنيف. طبقت التطبيقات السابقة توازنًا ثابتًا بين هاتين الإشارتين للخسارة طوال فترة التدريب.

لكن في الواقع، تتغير أهمية كل عنصر مع مرور الوقت. فالإشراف المكثف يكون أكثر فائدة في المراحل المبكرة، بينما يصبح التوافق مع سلوك الاستدلال أكثر أهمية في المراحل المتأخرة من التدريب. تم تصميم YOLO26 بناءً على هذه الفكرة، مما يؤدي مباشرة إلى كيفية إعادة توازن إشارات التعلم مع تقدم التدريب.

إذن، كيف يتعامل Ultralytics مع هذه الاحتياجات التعليمية المتغيرة أثناء التدريب؟ إنه يستخدم توازن الخسارة التدريجي لتعديل كيفية تقييم إشارات التعلم بمرور الوقت.

يعمل ProgLoss عن طريق التغيير الديناميكي لمقدار مساهمة كل رأس في الخسارة الإجمالية مع تقدم التدريب. في البداية، يتم وضع وزن أكبر على الرأس "واحد إلى كثير" لتثبيت التعلم وتحسين الاسترجاع. مع استمرار التدريب، يتحول التوازن تدريجياً نحو الرأس "واحد إلى واحد"، مما يجعل التدريب أكثر توافقاً مع سلوك الاستدلال.

يتيح هذا الانتقال التدريجي لـ YOLO26 التعلم بالترتيب الصحيح. بدلاً من إجبار النموذج على تحسين الأهداف المتنافسة دفعة واحدة، يعطي Progressive Loss Balancing الأولوية لأكثر إشارات التعلم فائدة في كل مرحلة من مراحل التدريب. والنتيجة هي تقارب أكثر سلاسة، وتقليل عدد عمليات التدريب غير المستقرة، وأداء نهائي أكثر اتساقًا.

هناك تحسين آخر مثير للاهتمام في Ultralytics يتعلق بكيفية قيام النموذج بتعيين أهداف التدريب للتنبؤات، وهي عملية تُعرف باسم تعيين التسميات. وهي مسؤولة عن مطابقة الكائنات الحقيقية مع التنبؤات المرشحة، والتي غالبًا ما تسمى المراسي.

تحدد هذه المطابقات التوقعات التي تخضع للإشراف وتساهم في الخسارة. يعتمد YOLO26 على طريقة تخصيص التسميات الحالية المسماة Task Alignment Learning (TAL)، والتي تم تصميمها لتحسين مواءمة التصنيف والتوطين أثناء التدريب.

على الرغم من أن TAL يعمل بشكل جيد مع معظم الكائنات، إلا أن التدريب كشف عن قيد مهم. أثناء عملية المطابقة، يمكن أن يتم إسقاط الكائنات الصغيرة جدًا بالكامل. في الممارسة العملية، غالبًا ما تفشل الكائنات الأصغر من حوالي 8 بكسل في صورة إدخال 640 بكسل في الحصول على أي تعيينات مرساة. عندما يحدث هذا، يتلقى النموذج القليل من الإشراف أو لا يتلقى أي إشراف على الإطلاق لتلك الكائنات، مما يجعل من الصعب تعلم كيفية detect بشكل موثوق.

لمعالجة هذه المشكلة، يقدم YOLO26 نظام تخصيص العلامات الصغيرة (STAL). يقوم STAL بتعديل عملية التخصيص لضمان عدم تجاهل الكائنات الصغيرة أثناء التدريب. على وجه التحديد، يفرض نظام STAL تخصيص أربعة علامات ربط على الأقل للكائنات الأصغر من 8 بكسل. وهذا يضمن أن الكائنات الصغيرة تساهم بشكل ثابت في خسارة التدريب.

من خلال تعزيز الإشراف على الأهداف الصغيرة، يعمل STAL على تحسين استقرار التعلم وأداء الكشف في السيناريوهات التي تكثر فيها الأجسام الصغيرة أو البعيدة. هذا التحسين مهم بشكل خاص لتطبيقات YOLO26 التي تعتمد على الحافة أولاً، مثل الصور الجوية والروبوتات وأنظمة إنترنت الأشياء (IoT)، حيث غالباً ما تكون الأجسام صغيرة أو بعيدة أو مرئية جزئياً، ويكون الكشف الموثوق به أمراً بالغ الأهمية.

لدعم تدريب أكثر استقرارًا ويمكن التنبؤ به، يقدم Ultralytics أيضًا مُحسِّنًا جديدًا يسمى MuSGD. تم تصميم هذا المُحسِّن لتحسين التقارب وموثوقية التدريب في نماذج الكشف الشاملة، خاصة مع زيادة حجم النموذج وتعقيد التدريب.

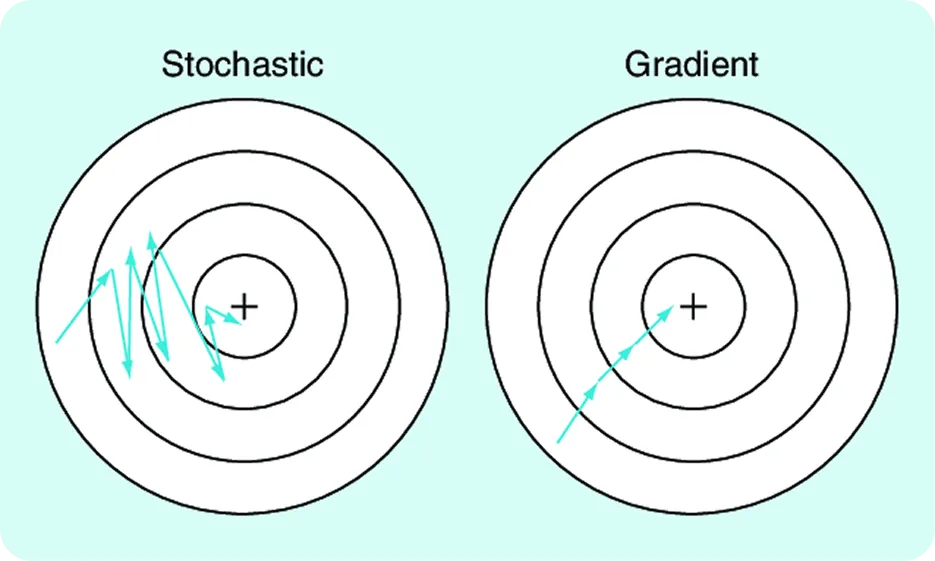

لكي تتعلم الشبكة العصبية، وبالتالي تغير الأوزان وفقًا لذلك، أثناء التدريب، نحسب الخطأ (المسمى أيضًا "الخسارة"). وبالتالي، يقيس النموذج مدى خطأ تنبؤاته باستخدام قيمة الخسارة، ويحسب التدرجات التي تشير إلى كيفية تغيير معلماته، ثم يقوم بتحديث تلك المعلمات لتقليل الخطأ. يعد Stochastic Gradient Descent (SGD) مُحسِّنًا مستخدمًا على نطاق واسع يقوم بهذه التحديثات، مما يجعل التدريب فعالًا وقابلًا للتطوير.

يعتمد MuSGD على هذا الأساس المألوف من خلال دمج أفكار التحسين المستوحاة من Muon، وهي طريقة مستخدمة في تدريب نماذج اللغة الكبيرة. وقد تأثرت هذه الأفكار بالتطورات الحديثة مثل Kimi K2 من Moonshot AI، الذي أظهر تحسناً في سلوك التدريب من خلال تحديثات أكثر تنظيماً للمعلمات.

يستخدم YOLO26 استراتيجية تحديث مختلطة. يتم تحديث بعض المعلمات باستخدام مزيج من التحديثات المستوحاة من SGD بينما تستخدم معلمات أخرى SGD . وهذا يجعل من الممكن لـ YOLO26 إدخال بنية إضافية في عملية التحسين مع الحفاظ على خصائص المتانة والتعميم التي جعلت SGD .

والنتيجة هي تحسين أكثر سلاسة، وتقارب أسرع، وسلوك تدريب أكثر قابلية للتنبؤ عبر أحجام النماذج، مما يجعل MuSGD جزءًا أساسيًا من سبب سهولة تدريب YOLO26 وموثوقيته على نطاق واسع.

إن ابتكارات Ultralytics في مجال التدريب، إلى جانب ميزات رئيسية مثل تصميمها الشامل NMS والمتميز بأولوية الحافة، تجعل النموذج أسهل في التدريب وأكثر موثوقية على نطاق واسع. قد تتساءل عما يعنيه ذلك بالفعل بالنسبة لتطبيقات الرؤية الحاسوبية.

في الواقع، فإنه يجعل نقل الرؤية الحاسوبية إلى المكان الذي تعمل فيه بالفعل أسهل بكثير. يتم تدريب النماذج بشكل أكثر قابلية للتنبؤ، وتوسيع نطاقها بشكل أكثر اتساقًا عبر الأحجام المختلفة، كما أنها أسهل في التكيف مع مجموعات البيانات الجديدة. وهذا يقلل من التوتر بين التجربة والنشر، خاصة في البيئات التي تهم فيها الموثوقية والكفاءة بقدر ما يهم الأداء الخام.

على سبيل المثال، في تطبيقات الروبوتات والرؤية الصناعية، غالبًا ما تحتاج النماذج إلى إعادة التدريب بشكل متكرر مع تغير البيئات أو أجهزة الاستشعار أو المهام. باستخدام YOLO26، يمكن للفرق تكرار العملية بشكل أسرع دون القلق بشأن عمليات التدريب غير المستقرة أو السلوك غير المتسق عبر أحجام النماذج.

تعتمد أنظمة الرؤية الحاسوبية الموثوقة على كيفية تدريب النماذج بقدر ما تعتمد على أدائها في وقت الاستدلال. من خلال تحسين توازن إشارات التعلم، وكيفية التعامل مع الأجسام الصغيرة، وكيفية تقدم عملية التحسين، يجعل YOLO26 التدريب أكثر استقرارًا وأسهل في التوسع. يساعد هذا التركيز على التدريب الموثوق الفرق على الانتقال بسلاسة أكبر من مرحلة التجريب إلى مرحلة النشر في العالم الحقيقي، خاصة في التطبيقات التي تعتمد على الحافة أولاً.

هل تريد التعرف على الذكاء الاصطناعي؟ تفضل بزيارة مستودع GitHub الخاص بنا لمعرفة المزيد. انضم إلى مجتمعنا النشط واكتشف الابتكارات في قطاعات مثل الذكاء الاصطناعي في مجال الخدمات اللوجستية والرؤية الاصطناعية في صناعة السيارات. لبدء استخدام الرؤية الحاسوبية اليوم، تحقق من خيارات الترخيص المتاحة لدينا.

ابدأ رحلتك مع مستقبل تعلم الآلة