Verbesserung der Re-Identifizierung von Fahrzeugen mit Ultralytics YOLO

Erfahren Sie, wie dieYOLO Ultralytics bei Lösungen zur Wiedererkennung von Fahrzeugen eine Rolle spielen können, indem sie präzise und genaue Erkennungen liefern.

Erfahren Sie, wie dieYOLO Ultralytics bei Lösungen zur Wiedererkennung von Fahrzeugen eine Rolle spielen können, indem sie präzise und genaue Erkennungen liefern.

Wenn Sie sich ein Formel-1-Rennen ansehen, ist es leicht, das Auto Ihres Lieblingsteams zu erkennen. Das leuchtende Rot von Ferrari oder das Silber von Mercedes stechen Runde für Runde hervor.

Von einer Maschine zu verlangen, dass sie dasselbe tut, und zwar nicht auf einer sauberen Rennstrecke, sondern auf überfüllten, verkehrsreichen Straßen, ist eine weitaus größere Herausforderung. Deshalb hat die Re-Identifizierung von Fahrzeugen (Vehicle Re-ID) in letzter Zeit im Bereich der KI an Aufmerksamkeit gewonnen.

Die Wiedererkennung von Fahrzeugen gibt Maschinen die Möglichkeit, dasselbe Fahrzeug über mehrere oder sich nicht überschneidende Kameras hinweg zu erkennen. Außerdem sollen Fahrzeuge nach vorübergehender Verdeckung (wenn ein Fahrzeug teilweise verdeckt ist) oder Veränderungen der Beleuchtung und des Blickwinkels erkannt werden.

Eine Kerntechnologie für die Fahrzeugerkennung ist die Computer Vision. Computer Vision ist ein Teilgebiet der künstlichen Intelligenz, bei dem es darum geht, Maschinen zu lehren, visuelle Informationen wie Bilder und Videos zu verstehen und zu interpretieren. Mithilfe dieser Technologie können KI-Systeme Fahrzeugmerkmale analysieren und sie über große Kameranetzwerke für Anwendungen wie Stadtüberwachung und Verkehrsüberwachung zuverlässig track .

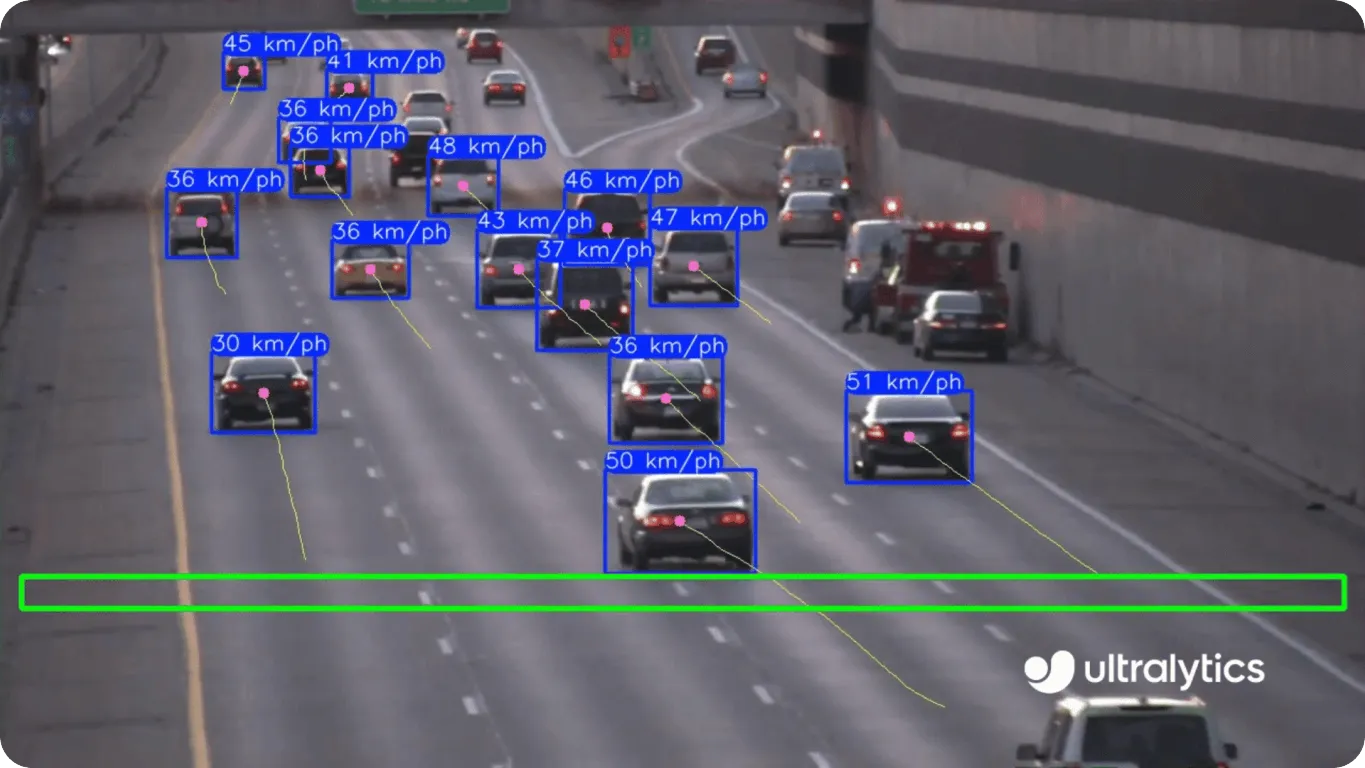

Insbesondere die Vision AI-Modelle wie Ultralytics YOLO11 und das kommende Ultralytics YOLO26 unterstützen Aufgaben wie Objekterkennung und -verfolgung. Sie können Fahrzeuge in jedem Bild schnell lokalisieren und ihre Bewegung durch eine Szene verfolgen. Wenn diese Modelle mit Netzwerken zur Wiedererkennung von Fahrzeugen kombiniert werden, kann das kombinierte System dasselbe Fahrzeug über verschiedene Kameraeinspeisungen hinweg erkennen, selbst wenn sich die Ansichten oder Lichtverhältnisse ändern.

In diesem Artikel gehen wir darauf ein, wie die Re-Identifizierung von Fahrzeugen funktioniert, welche Technologie sie ermöglicht und wo sie in intelligenten Verkehrssystemen eingesetzt wird. Legen wir los!

Die Wiedererkennung von Fahrzeugen ist eine wichtige Anwendung in der Computer Vision. Dabei geht es darum, ein und dasselbe Fahrzeug auf verschiedenen, sich nicht überschneidenden Kameras zu erkennen und seine Identität während der Fahrt durch eine Stadt beizubehalten. Dies ist eine Herausforderung, da jede Kamera das Fahrzeug aus einem anderen Winkel, bei anderer Beleuchtung oder mit teilweiser Verdeckung aufnehmen kann.

Stellen Sie sich ein Szenario vor, in dem eine blaue Limousine eine Kreuzung überquert und später auf einer anderen Straße auftaucht, beobachtet von einer anderen Kamera. Der Winkel, die Beleuchtung und der Hintergrund haben sich geändert, und andere Fahrzeuge können kurzzeitig die Sicht versperren. Trotzdem muss das Fahrzeugidentifizierungssystem feststellen, dass es sich um dasselbe Fahrzeug handelt.

Jüngste Fortschritte im Bereich des Deep Learning, insbesondere bei den Faltungsneuronalen Netzen (CNN) und transformatorbasierten Modellen, haben diesen Prozess wesentlich präziser gemacht. Diese Modelle können aussagekräftige visuelle Muster extrahieren und zwischen ähnlich aussehenden Fahrzeugen unterscheiden und dennoch das richtige Fahrzeug identifizieren.

In intelligenten Verkehrssystemen unterstützt diese Fähigkeit die kontinuierliche Überwachung, die Rekonstruktion von Routen und die stadtweite Verkehrsanalyse, so dass Smart-City-Systeme ein klareres Bild davon erhalten, wie sich Fahrzeuge bewegen. Sie tragen zur Verbesserung von Sicherheit und Effizienz bei.

In der Regel wird Videomaterial von Kreuzungen, Parkplätzen und Autobahnen mit Techniken zur Wiedererkennung von Fahrzeugen analysiert, um festzustellen, ob dasselbe Fahrzeug auf verschiedenen Kameras zu sehen ist. Dieses Konzept ähnelt der Re-Identifizierung von Personen, bei der Systeme Personen über mehrere Ansichten hinweg track , aber hier liegt der Schwerpunkt auf der Analyse von fahrzeugspezifischen Merkmalen anstelle des menschlichen Aussehens.

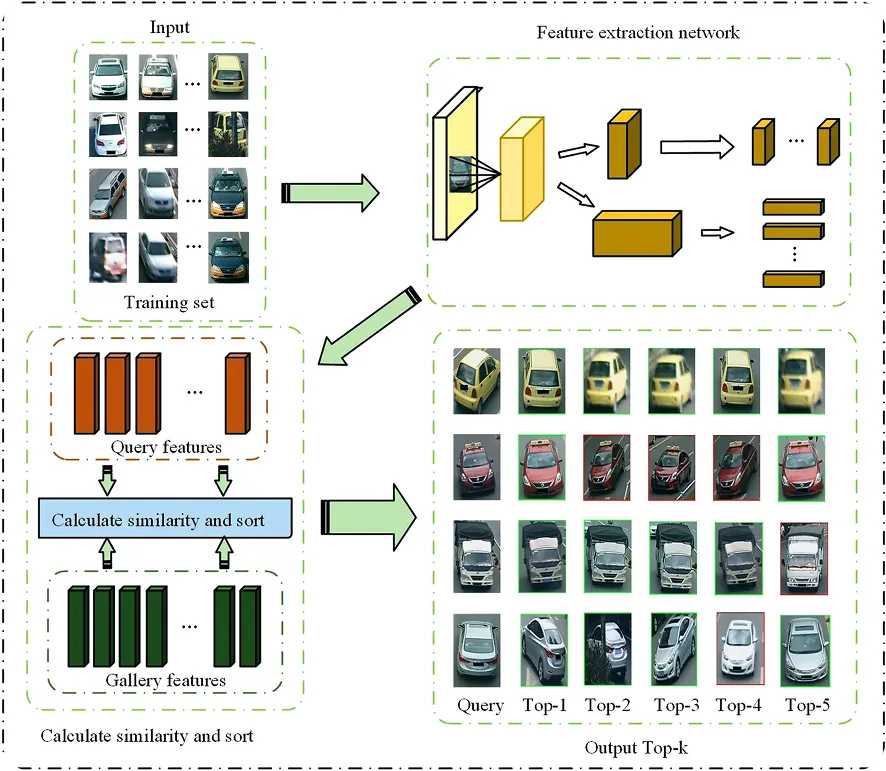

Der Prozess umfasst mehrere wichtige Schritte, die dem System helfen sollen, Fahrzeuge detect , ihre visuellen Merkmale zu extrahieren und sie aus verschiedenen Blickwinkeln zuverlässig zuzuordnen.

Auf einer hohen Ebene erkennt das System zunächst Fahrzeuge in jedem Bild und extrahiert dann Merkmale wie Farbe, Form und Textur, um eine eindeutige digitale Darstellung oder Einbettung für jedes Fahrzeug zu erstellen. Diese Einbettungen werden zeit- und kameraübergreifend verglichen, oft unterstützt durch Objektverfolgung und räumlich-zeitliche Prüfungen, um zu entscheiden, ob zwei Sichtungen zum selben Fahrzeug gehören.

Im Folgenden wird dieser Prozess näher beleuchtet:

DieYOLO Ultralytics spielen eine wichtige unterstützende Rolle in den Pipelines zur Re-Identifizierung von Fahrzeugen. Während sie selbst keine Re-ID durchführen, bieten sie andere wesentliche Fähigkeiten, wie schnelle Erkennung und stabile Verfolgung, auf die Re-ID-Netzwerke für einen genauen kameraübergreifenden Abgleich angewiesen sind.

Als Nächstes wollen wir einen genaueren Blick darauf werfen, wie Ultralytics YOLO wie YOLO11 die Systeme zur Wiedererkennung von Fahrzeugen verbessern können.

Die Grundlage eines jeden Systems zur Wiedererkennung von Fahrzeugen ist eine genaue Objekterkennung. DieYOLO Ultralytics , wie YOLO11 , sind hierfür eine hervorragende Option, da sie Fahrzeuge in jedem Bild schnell detect können, selbst in belebten Szenen mit teilweiser Verdeckung, starkem Verkehr oder wechselnden Lichtverhältnissen.

Sie können auch benutzerdefiniert trainiert werden, d. h. Sie können das Modell anhand Ihres eigenen Datensatzes feinabstimmen, damit es lernt, bestimmte Fahrzeugtypen zu erkennen, z. B. Taxis, Lieferwagen oder Flottenfahrzeuge. Dies ist besonders nützlich, wenn eine Lösung eine speziellere Erkennung erfordert. Durch die Bereitstellung sauberer, präziser Bounding Boxes geben dieYOLO Ultralytics den Re-ID-Netzwerken qualitativ hochwertige Eingaben, mit denen sie arbeiten können, was zu einem zuverlässigeren Abgleich zwischen den Kameras führt.

Sobald Fahrzeuge erkannt sind, können Modelle wie YOLO11 auch eine stabile Objektverfolgung innerhalb einer einzelnen Kameraansicht unterstützen. Bei der Objektverfolgung wird ein erkanntes Fahrzeug über mehrere aufeinanderfolgende Frames hinweg verfolgt und ihm eine konsistente ID zugewiesen, während es sich bewegt.

Mit der integrierten Unterstützung für Tracking-Algorithmen wie ByteTrack und BoT-SORT im Ultralytics Python kann YOLO11 konsistente IDs beibehalten, während sich Fahrzeuge durch eine Szene bewegen. Dieses stabile Tracking reduziert Identitätswechsel, bevor das Re-ID-System übernimmt, was letztendlich die Genauigkeit des kameraübergreifenden Abgleichs verbessert.

Zusätzlich zum standardmäßigen bewegungsbasierten Tracking enthält das Ultralytics Python in seinem BoT-SORT-Tracker optionale Re-ID-Fähigkeiten, die auf dem Erscheinungsbild basieren. Dies bedeutet, dass der Tracker visuelle Erscheinungsmerkmale und nicht nur Bewegungsmuster oder Bounding-Box-Überlappung verwenden kann, um zu bestimmen, ob zwei Erkennungen zum selben Fahrzeug gehören.

Wenn diese Funktion aktiviert ist, extrahiert BoT-SORT leichtgewichtige Einbettungen des Aussehens aus dem Detektor oder aus einem YOLO11 und verwendet diese, um die Identität zwischen Frames zu überprüfen. Dieses zusätzliche Erscheinungsbild hilft dem Tracker, stabilere IDs in schwierigen Situationen beizubehalten, z. B. bei kurzen Verdeckungen, dicht aneinander vorbeifahrenden Fahrzeugen oder kleinen Verschiebungen durch Kamerabewegungen.

Diese eingebaute Re-ID ist zwar nicht als Ersatz für eine vollständige kameraübergreifende Re-Identifizierung von Fahrzeugen gedacht, sie verbessert jedoch die Konsistenz der Identität innerhalb einer einzigen Kameraansicht und erzeugt sauberere Tracklets, auf die sich nachgelagerte Re-ID-Module verlassen können. Um diese auf dem Erscheinungsbild basierenden Tracking-Funktionen zu nutzen, aktivieren Sie einfach Re-ID in einer BoT-SORT-Tracker-Konfigurationsdatei, indem Sie "with_reid" auf "True" setzen und auswählen, welches Modell die Erscheinungsbild-Funktionen bereitstellen soll.

Weitere Einzelheiten finden Sie auf derUltralytics-Dokumentationsseite zur Objektverfolgung, auf der die verfügbaren Re-ID-Optionen und deren Konfiguration erläutert werden.

Neben der Verbesserung der Identitätsstabilität während der Verfolgung spielen YOLO auch eine wichtige Rolle bei der Vorbereitung sauberer visueller Eingaben für das Re-ID-Netzwerk selbst.

Nach der Erkennung eines Fahrzeugs wird dessen Bounding Box in der Regel beschnitten und an ein Re-Identifizierungsnetzwerk gesendet, das die für den Abgleich erforderlichen visuellen Merkmale extrahiert. Da Re-ID-Modelle in hohem Maße auf diese zugeschnittenen Bilder angewiesen sind, können schlechte Eingaben, wie unscharfe, falsch ausgerichtete oder unvollständige Ausschnitte, zu schwächeren Einbettungen und einem weniger zuverlässigen kameraweiten Abgleich führen.

DieYOLO Ultralytics tragen dazu bei, diese Probleme zu verringern, indem sie durchgängig saubere, gut ausgerichtete Bounding Boxes erzeugen, die das Fahrzeug von Interesse vollständig erfassen. Mit klareren und genaueren Ausschnitten kann sich das Re-ID-Netzwerk auf aussagekräftige Details wie Farbe, Form, Textur und andere Unterscheidungsmerkmale konzentrieren. Qualitativ hochwertige Eingaben führen zu einer zuverlässigeren und genaueren Re-ID-Leistung über alle Kameraansichten hinweg.

Obwohl dieYOLO Ultralytics selbst keine Re-Identifizierung durchführen, liefern sie die entscheidenden Informationen, die ein Re-ID-Netzwerk benötigt, um Fahrzeuge über verschiedene Kameraansichten hinweg zu vergleichen. Modelle wie YOLO11 können sich um die Lokalisierung und Verfolgung von Fahrzeugen innerhalb jeder Kamera kümmern, während das Re-ID-Modell feststellt, ob zwei Fahrzeugaufnahmen von verschiedenen Standorten zur selben Identität gehören.

Wenn diese Komponenten zusammenarbeiten - YOLO für die Erkennung und Verfolgung und ein spezielles Einbettungsmodell für die Merkmalsextraktion -, bilden sie eine vollständige Pipeline für den Fahrzeugabgleich mit mehreren Kameras. Dadurch ist es möglich, ein und dasselbe Fahrzeug zuzuordnen, während es sich durch ein größeres Kameranetzwerk bewegt.

In einer kürzlich durchgeführten Studie haben Forscher beispielsweise ein leichtgewichtiges YOLO11 als Fahrzeugdetektor in einem Online-Multikamera-Tracking-System verwendet. Die Studie ergab, dass die Verwendung von YOLO11 dazu beitrug, die Erkennungszeit zu verkürzen, ohne die Genauigkeit zu beeinträchtigen, was die Gesamtleistung der nachgelagerten Verfolgung und des kameraübergreifenden Abgleichs verbesserte.

Nachdem wir nun besser verstanden haben, wie dieYOLO Ultralytics die Re-Identifizierung von Fahrzeugen unterstützen können, wollen wir uns die Deep-Learning-Modelle, die die Schritte der Merkmalsextraktion und des Abgleichs übernehmen, genauer ansehen. Diese Modelle sind dafür verantwortlich, zu lernen, wie Fahrzeuge aussehen, robuste Einbettungen zu erstellen und zwischen visuell ähnlichen Fahrzeugen in verschiedenen Kameraansichten zu unterscheiden.

Hier sind einige Beispiele für die wichtigsten Deep-Learning-Komponenten, die in Systemen zur Wiedererkennung von Objekten verwendet werden:

Zusätzlich zu diesen architektonischen Komponenten spielt metrisches Lernen eine Schlüsselrolle beim Training von Fahrzeug-Re-ID-Modellen. Verlustfunktionen wie Triplet Loss, Contrastive Loss und Cross-Entropy Loss helfen dem System, starke, diskriminierende Einbettungen zu erlernen, indem sie Bilder desselben Fahrzeugs zusammenführen, während sie unterschiedliche Bilder auseinanderschieben.

In der Computer-Vision-Forschung hat die Qualität eines Datensatzes einen großen Einfluss darauf, wie gut ein Modell funktioniert, sobald es eingesetzt wird. Ein Datensatz liefert die beschrifteten Bilder oder Videos, aus denen ein Modell lernt.

Für die Re-Identifizierung von Fahrzeugen müssen diese hochmodernen Datensätze verschiedene Bedingungen wie Beleuchtung, Änderungen des Blickwinkels und Wetterschwankungen erfassen. Diese Vielfalt hilft den Modellen, die Komplexität der realen Verkehrsumgebung zu bewältigen.

Hier finden Sie einen Überblick über gängige Datensätze, die das Training, die Optimierung und die Bewertung von Modellen zur Wiedererkennung von Fahrzeugen unterstützen:

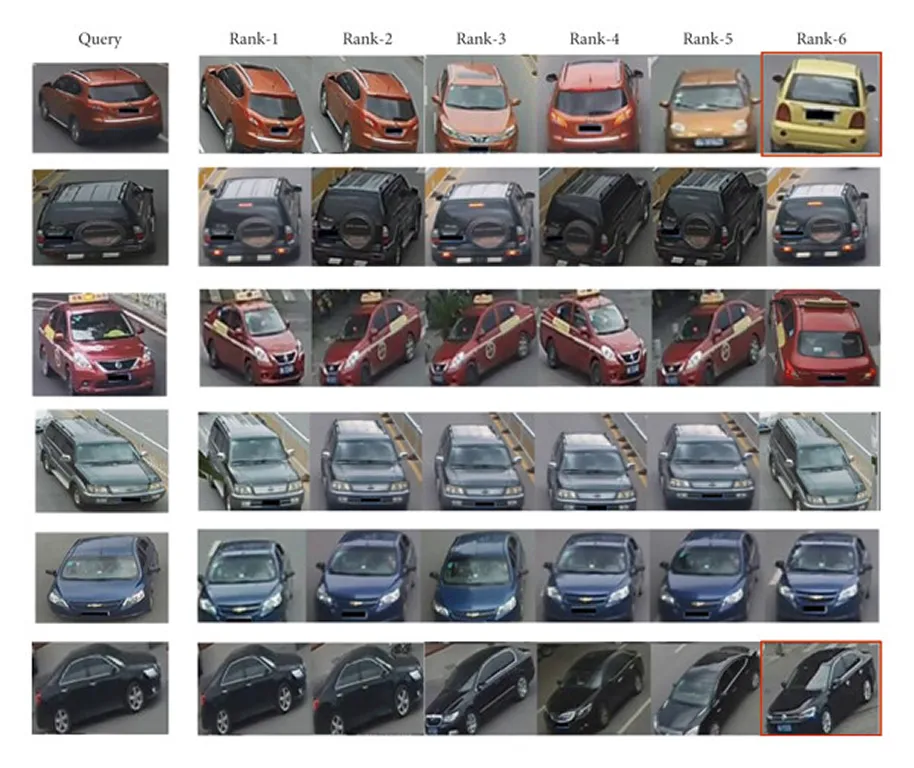

Die Leistung des Modells in diesen Datensätzen wird in der Regel anhand von Metriken wie der mittleren durchschnittlichen PräzisionmAP) und der Genauigkeit von Rang 1 oder Rang 5 bewertet. mAP misst, wie genau das Modell alle relevanten Übereinstimmungen für ein bestimmtes Fahrzeug findet, während die Ergebnisse von Rang 1 und Rang 5 angeben, ob die richtige Übereinstimmung am Anfang der Ergebnisliste oder innerhalb der ersten paar Vorhersagen erscheint.

Zusammengenommen bieten diese Benchmarks den Forschern eine einheitliche Möglichkeit, verschiedene Ansätze zu vergleichen, und spielen eine wichtige Rolle bei der Entwicklung genauerer und zuverlässigerer Systeme zur Fahrzeugidentifizierung für den praktischen Einsatz.

Nachdem wir uns nun mit den Grundlagen befasst haben, wollen wir nun einige reale Anwendungsfälle durchgehen, bei denen die Re-Identifizierung von Fahrzeugen praktische Transport-, Mobilitäts- und Überwachungsabläufe unterstützt.

Auf verkehrsreichen Straßen ist ständig etwas los, und Verkehrskameras haben oft Schwierigkeiten, ein und dasselbe Fahrzeug track , wenn es sich zwischen verschiedenen Bereichen bewegt. Veränderungen in der Beleuchtung, überfüllte Szenen und Fahrzeuge, die fast identisch aussehen, können dazu führen, dass die Identitäten auf verschiedenen Kameras verloren gehen.

Die Re-Identifizierung von Fahrzeugen schafft hier Abhilfe, indem sie Fahrzeuge eindeutig erkennt, charakteristische Merkmale extrahiert und selbst bei niedrig aufgelöstem oder verkehrsreichem Filmmaterial konsistente IDs beibehält. Das Ergebnis ist eine reibungslosere, kontinuierliche Verfolgung im gesamten Netz, die den Verkehrsteams ein klareres Bild davon vermittelt, wie sich Fahrzeuge durch die Stadt bewegen, und schnellere, fundiertere Reaktionen auf Staus und Zwischenfälle ermöglicht.

Intelligente Parkhäuser sind auf eine konsistente Fahrzeugidentifizierung angewiesen, um die Ein- und Ausfahrt, die Zugangskontrolle und die Platzzuweisung zu verwalten. Die Kameras in diesen Umgebungen erfassen die Fahrzeuge jedoch oft aus ungewöhnlichen Winkeln und unter schwierigen Lichtverhältnissen, z. B. in Tiefgaragen, schattigen Bereichen oder auf Außenplätzen in der Dämmerung.

Unter diesen Bedingungen ist es schwieriger zu bestätigen, ob dasselbe Fahrzeug in verschiedenen Zonen gesehen wird. Wenn die Identitäten nicht übereinstimmen, können Parkaufzeichnungen fehlerhaft sein, die Zugangskontrolle wird unzuverlässiger und die Fahrer müssen mit Verzögerungen rechnen. Aus diesem Grund enthalten viele intelligente Parksysteme Modelle zur Wiedererkennung von Fahrzeugen, um eine stabile Identität für jedes Fahrzeug aufrechtzuerhalten, während es sich durch die Anlage bewegt.

Neben der Verkehrsüberwachung spielt die Re-Identifizierung von Fahrzeugen auch eine wichtige Rolle bei der Strafverfolgung und bei forensischen Untersuchungen. In vielen Fällen müssen Beamte ein Fahrzeug über mehrere Kameras verfolgen, aber die Nummernschilder können unlesbar sein, fehlen oder absichtlich unkenntlich gemacht werden.

Überfüllte Szenen, schlechte Sicht und teilweise Verdeckung können dazu führen, dass sich verschiedene Fahrzeuge täuschend ähnlich sehen, was die manuelle Identifizierung langsam und unzuverlässig macht. Die Re-Identifizierung von Fahrzeugen kann verwendet werden, um die Bewegung eines Fahrzeugs über nicht überlappende Kameranetzwerke hinweg zu verfolgen, indem die visuellen Merkmale des Fahrzeugs analysiert werden, anstatt nur von den Nummernschildern abzuhängen.

Dies bedeutet, dass Ermittler die Bewegungen eines Fahrzeugs leichter verfolgen, verstehen können, wann es an verschiedenen Orten auftauchte, und seinen Weg vor und nach einem Vorfall bestätigen können. Die KI-gestützte Fahrzeugerkennung unterstützt auch Aufgaben wie die Verfolgung verdächtiger Fahrzeuge, die Überprüfung von Bildmaterial von Vorfällen oder die Bestimmung der Richtung, in die ein Fahrzeug vor oder nach einem Ereignis gefahren ist.

Flotten- und Logistikunternehmen verlassen sich häufig auf GPS, RFID-Etiketten und manuelle Protokolle, um Fahrzeugbewegungen track , aber diese Instrumente lassen Lücken in Bereichen, die von Sicherheits- oder Hofkameras abgedeckt werden, wie z. B. Ladebuchten, Lagerhöfe und interne Straßennetze.

Fahrzeuge bewegen sich häufig zwischen Kameras, die sich nicht überschneiden, verschwinden hinter Strukturen oder sehen fast identisch aus wie andere Fahrzeuge der Flotte, so dass es schwierig ist, festzustellen, ob das gleiche Fahrzeug an verschiedenen Orten gesehen wurde. Systeme zur Wiedererkennung von Fahrzeugen können dazu beitragen, diese Lücken zu schließen, indem sie visuelle Details und Zeitinformationen analysieren, um eine konsistente Identität für jedes Fahrzeug zu erhalten, während es sich durch die Anlage bewegt.

Dadurch erhalten Flottenmanager einen umfassenderen Überblick über die Aktivitäten innerhalb ihrer Knotenpunkte und können Aufgaben wie die Überprüfung von Lieferwegen, die Identifizierung ungewöhnlicher Bewegungen und die Sicherstellung, dass die Fahrzeuge den erwarteten Routen folgen, unterstützen.

Hier sind einige der wichtigsten Vorteile der KI-gestützten Fahrzeugidentifizierung:

Die Re-Identifizierung von Fahrzeugen bietet zwar viele Vorteile, aber es gibt auch einige Einschränkungen zu beachten. Hier sind einige Faktoren, die ihre Zuverlässigkeit in der Praxis beeinträchtigen:

Die Re-Identifizierung von Fahrzeugen schreitet mit der Weiterentwicklung der Technologie weiter voran. Jüngste Veröffentlichungen von IEEE, CVPR und arXiv sowie Präsentationen auf internationalen Konferenzen zeigen eine deutliche Verschiebung hin zu umfassenderen Modellen, die mehrere Datenquellen und fortschrittlichere Erkenntnisse über Merkmale kombinieren. Zukünftige Arbeiten in diesem Bereich werden sich wahrscheinlich auf die Entwicklung von Systemen konzentrieren, die robuster und effizienter sind und mit der Variabilität der realen Welt in großem Umfang umgehen können.

Eine vielversprechende Richtung ist zum Beispiel die Verwendung von transformatorbasierten Modellen und Graphenaggregationsnetzen. Transformatoren können ein ganzes Bild analysieren und verstehen, wie alle visuellen Details zusammenpassen, was dem System hilft, dasselbe Fahrzeug zu erkennen, selbst wenn sich der Winkel oder die Beleuchtung ändert.

Graphenbasierte Modelle gehen noch einen Schritt weiter, indem sie verschiedene Fahrzeugteile oder Kameraansichten als verbundene Punkte in einem Netzwerk behandeln. Dadurch kann das System die Korrelation zwischen diesen Schlüsselpunkten verstehen und bessere Entscheidungen über Fahrzeugidentitäten und Unterscheidungsmerkmale treffen.

Ein weiterer wichtiger Fortschritt ist die multimodale Datenfusion und die Fusion von Merkmalen. Anstatt sich nur auf Bilder zu verlassen, kombinieren neuere Systeme visuelle Informationen mit anderen Multimediasignalen, wie GPS-Daten oder Bewegungsmustern von Sensoren. Dieser zusätzliche Kontext erleichtert es dem System, genau zu bleiben, wenn Fahrzeuge teilweise blockiert sind, wenn die Beleuchtung schlecht ist oder wenn sich der Kamerawinkel plötzlich ändert.

Die Re-Identifizierung von Fahrzeugen wird zu einer wichtigen Methode in intelligenten Verkehrssystemen, die den Städten hilft, Fahrzeuge über verschiedene Kameras hinweg zuverlässiger track . Dank Fortschritten beim Deep Learning und einer besseren Validierung mit umfangreicheren, vielfältigeren Datensätzen werden diese Systeme immer genauer und praktischer unter realen Bedingungen.

Bei der Weiterentwicklung der Technologie ist es wichtig, Innovationen mit verantwortungsvollen Praktiken in Bezug auf Datenschutz, Sicherheit und Ethik in Einklang zu bringen. Insgesamt ebnen diese Fortschritte den Weg für intelligentere, sicherere und effizientere Verkehrsnetze.

Erfahren Sie mehr über KI, indem Sie unser GitHub-Repository besuchen und unserer Community beitreten. Besuchen Sie unsere Lösungsseiten, um mehr über KI in der Robotik und Computer Vision in der Fertigung zu erfahren. Entdecken Sie unsere Lizenzierungsoptionen, um noch heute mit Vision A zu beginnen!

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens