Erfahren Sie, wie Tools zur Posenschätzung verwendet werden können, um detect -Keypoints in Bildern und Videos detect , 2D- und 3D-Posen zu schätzen und verschiedene Vision-KI-Anwendungen zu unterstützen.

Erfahren Sie, wie Tools zur Posenschätzung verwendet werden können, um detect -Keypoints in Bildern und Videos detect , 2D- und 3D-Posen zu schätzen und verschiedene Vision-KI-Anwendungen zu unterstützen.

Als Menschen interpretieren wir Bewegungen instinktiv. Wenn sich jemand nach vorne beugt, den Kopf dreht oder einen Arm hebt, können wir sofort erkennen, was er tut. Es handelt sich um eine stille, fast unbewusste Fähigkeit, die unsere Interaktion mit anderen Menschen und unsere Erkundung der Welt prägt.

Da Technologie einen immer größeren Teil unseres Alltags einnimmt, ist es nur natürlich, dass wir uns wünschen, dass unsere Geräte Bewegungen genauso reibungslos verstehen wie wir. Die jüngsten Fortschritte in der künstlichen Intelligenz, insbesondere im Bereich des Deep Learning, machen dies möglich. Vor allem die Bildverarbeitung hilft Maschinen dabei, Bedeutungen aus Bildern und Videos zu extrahieren, und treibt diesen Fortschritt voran.

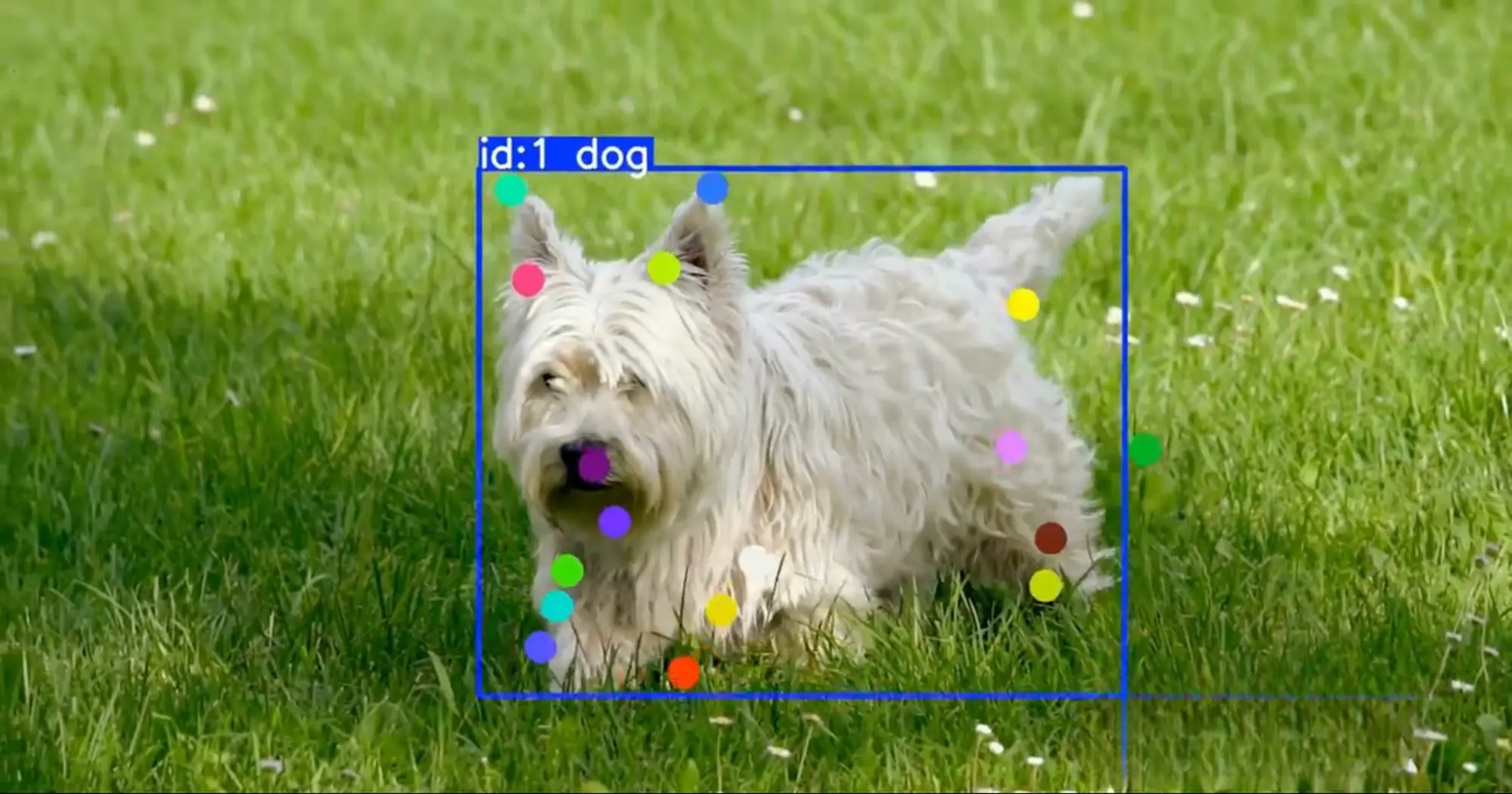

Beispielsweise ist die Posenschätzung eine gängige Aufgabe der Bildverarbeitung, bei der die Positionen vordefinierter Körper-Schlüsselpunkte (wie Schultern, Ellbogen, Hüften und Knie) in einem Bild oder Videobild vorhergesagt werden. Diese Schlüsselpunkte können mithilfe einer festen Skelettdefinition miteinander verbunden werden, um eine vereinfachte Darstellung der Pose zu bilden.

Computervisionsmodelle wie Ultralytics YOLO11 und das in Kürze erscheinende Ultralytics unterstützen Aufgaben wie die Posenschätzung und können für Echtzeitanwendungen genutzt werden, darunter Form-Feedback im Fitness- und Sportbereich, Sicherheitsüberwachung und interaktive Augmented-Reality-Erlebnisse.

.webp)

In diesem Artikel werden wir uns eingehend mit Tools zur Posenschätzung befassen und uns ansehen, wie Posenschätzung funktioniert, wo sie eingesetzt wird und welche der derzeit besten Modelle und Bibliotheken verfügbar sind. Los geht's!

Die Posenschätzung ist eine Technik der Bildverarbeitung, die einem System dabei hilft, die Position einer Person oder eines Objekts in einem Bild oder Video zu verstehen. Anstatt jedes Pixel gleichermaßen zu analysieren, werden dabei eine Reihe konsistenter Orientierungspunkte wie Kopf, Schultern, Ellbogen, Hüften, Knie und Knöchel vorhergesagt.

Die meisten Modelle geben die Koordinaten dieser Schlüsselpunkte und eine Punktzahl aus, die angibt, wie wahrscheinlich es ist, dass jede Vorhersage richtig ist. Diese Schlüsselpunkte können dann mithilfe eines vordefinierten Skelettlayouts miteinander verbunden werden, um eine einfache Posendarstellung zu bilden.

Wenn sie Frame für Frame in Videos angewendet werden, können die resultierenden Schlüsselpunkte über die Zeit hinweg miteinander verknüpft werden, um Bewegungen zu schätzen. Dies ermöglicht Anwendungen wie Formprüfungen, Bewegungsanalysen und gestenbasierte Interaktionen.

.webp)

Menschliche Bewegungen enthalten eine Vielzahl von Informationen. Die Art und Weise, wie sich jemand beugt, nach etwas greift oder sein Gewicht verlagert, kann Aufschluss über Absichten, Anstrengung, Ermüdung oder sogar Verletzungsrisiken geben. Bis vor kurzem waren für die Erfassung dieser Details in der Regel spezielle Sensoren, Motion-Capture-Anzüge oder kontrollierte Laborumgebungen erforderlich.

Die Posenschätzung ändert dies. Durch die Extraktion wichtiger Körpermerkmale aus normalen Bildern und Videos können Computer Bewegungen mit Standardkameras analysieren. Dadurch wird die Bewegungsanalyse zugänglicher, skalierbarer und praktischer für den Einsatz in realen Umgebungen.

Hier sind einige Beispiele dafür, wie die Posenschätzung Wirkung zeigen kann:

Die Idee der Posenschätzung gibt es schon seit vielen Jahren. Frühe Ansätze verwendeten einfache geometrische Modelle und handgefertigte Regeln und funktionierten in der Regel nur unter kontrollierten Bedingungen.

Beispielsweise kann ein System gut funktionieren, wenn eine Person still in einer festen Position steht, aber versagen, wenn sie zu gehen beginnt, sich dreht oder mit Objekten in realen Szenen interagiert. Diese Methoden hatten oft Schwierigkeiten mit natürlichen Bewegungen, wechselnden Kamerawinkeln, unübersichtlichen Hintergründen und teilweiser Verdeckung.

Die moderne Posenschätzung stützt sich auf Deep Learning, um diese Herausforderungen zu bewältigen. Durch das Training von Convolutional Neural Networks auf großen, beschrifteten Datensätzen lernen die Modelle visuelle Muster, die ihnen helfen, detect über verschiedene Posen, Personen und Umgebungen hinweg zuverlässiger detect .

Mit mehr Beispielen verbessert das Modell seine Vorhersagen und kann neue Szenen besser verallgemeinern. Dank dieser Fortschritte unterstützt die Posenschätzung nun eine Vielzahl praktischer Anwendungsfälle, darunter die Überwachung und Ergonomie am Arbeitsplatz sowie die Sportanalyse, bei der Trainer und Analysten die Bewegungen von Sportlern untersuchen.

Die Posenschätzung gibt es in verschiedenen Formen, je nach Umgebung und dem, was Sie messen möchten. Hier sind die wichtigsten Arten, denen Sie begegnen werden:

.webp)

Die Posenschätzung kann auf viele Arten von Objekten angewendet werden, aber um die Dinge einfach zu halten, konzentrieren wir uns auf die Posenschätzung beim Menschen.

Die meisten Systeme zur Schätzung der Körperhaltung von Menschen werden anhand von annotierten Datensätzen trainiert, in denen wichtige Körperteile in großen Sammlungen von Bildern und Videobildern gekennzeichnet sind. Anhand dieser Beispiele lernt das Modell visuelle Muster, die mit Körpermerkmalen wie Schultern, Ellbogen, Hüften, Knien und Knöcheln verbunden sind, sodass es Schlüsselpunkte in neuen Szenen genau vorhersagen kann.

Ein weiterer wichtiger Aspekt ist die Inferenzarchitektur des Modells, die bestimmt, wie es Schlüsselpunkte erkennt und zu vollständigen Posen zusammenfügt. Einige Systeme detect zunächst detect Person und schätzen dann die Schlüsselpunkte innerhalb des Bereichs jeder Person, während andere detect im gesamten Bild detect und diese dann zu einzelnen Personen gruppieren. Neuere einstufige Designs können Posen in einem Durchgang vorhersagen und bieten so ein ausgewogenes Verhältnis zwischen Geschwindigkeit und Genauigkeit für den Echtzeitgebrauch.

Als Nächstes wollen wir uns verschiedene Ansätze zur Posenschätzung im Detail ansehen.

Bei einem Bottom-up-Ansatz betrachtet das Modell zunächst das gesamte Bild und ermittelt zunächst wichtige Körperpunkte wie Kopf, Schultern, Ellbogen, Hüften, Knie und Knöchel. In dieser Phase versucht es noch nicht, Personen voneinander zu trennen. Es erkennt lediglich alle wichtigen Punkte oder Körpergelenke, die durch das Positionsskelett in der Szene definiert sind.

Anschließend führt das System einen zweiten Schritt durch, um die Punkte miteinander zu verbinden. Es verknüpft zusammengehörige Schlüsselpunkte und gruppiert sie zu vollständigen Skeletten, eines pro Person. Da es nicht erforderlich ist, detect Person zuerst zu detect , eignen sich Bottom-up-Methoden häufig gut für überfüllte Szenen, in denen sich Personen überlappen, unterschiedlich groß erscheinen oder teilweise verdeckt sind.

Im Gegensatz dazu erkennen Top-Down-Systeme zunächst jede Person im Bild. Sie platzieren einen Begrenzungsrahmen um jede Person und behandeln jeden Rahmen als eigenen Bereich, der analysiert werden muss.

Sobald eine Person isoliert ist, prognostiziert das Modell die Körper-Schlüsselpunkte innerhalb dieses Bereichs. Diese schrittweise Vorgehensweise liefert oft sehr genaue Ergebnisse, insbesondere wenn sich nur wenige Personen in der Szene befinden und jede Person deutlich sichtbar ist.

Einstufige Modelle, manchmal auch als Hybridmodelle bezeichnet, sagen Posen in einem Durchgang voraus. Anstatt zuerst die Personenerkennung und dann die Schlüsselfallschätzung durchzuführen, geben sie gleichzeitig den Standort der Person und die Körper-Schlüsselfälle aus.

Da alles in einem einzigen Modul geschieht, sind diese Modelle oft schneller und effizienter, wodurch sie sich besonders gut für Echtzeitanwendungen wie Live-Bewegungsverfolgung und Motion Capture eignen. Modelle wie Ultralytics YOLO11 auf diesem Konzept und zielen darauf ab, Geschwindigkeit mit zuverlässigen Keypoint-Vorhersagen in Einklang zu bringen.

Unabhängig vom verwendeten Ansatz muss ein Posenschätzungsmodell sorgfältig trainiert und getestet werden, bevor es in der Praxis zuverlässig eingesetzt werden kann. Es lernt in der Regel aus großen Bildersammlungen (und manchmal auch Videos), in denen wichtige Körperpunkte markiert sind, wodurch es verschiedene Posen, Kamerawinkel und Umgebungen besser verarbeiten kann.

Zu den bekannten Datensätzen zur Posenschätzung gehören COCO , MPII Human Pose, CrowdPose und OCHuman. Wenn diese Datensätze nicht die Bedingungen widerspiegeln, denen das Modell im Einsatz ausgesetzt sein wird, sammeln und kennzeichnen Ingenieure häufig zusätzliche Bilder aus der Zielumgebung, z. B. aus einer Fabrikhalle, einem Fitnessstudio oder einer Klinik.

.webp)

Nach dem Training wird die Leistung des Modells anhand von Standard-Benchmarks bewertet, um die Genauigkeit und Robustheit zu messen und weitere Anpassungen für den Einsatz in der Praxis vorzunehmen. Die Ergebnisse werden häufig anhand der mittleren durchschnittlichen Präzision(Mean mAP) angegeben, die die Leistung über verschiedene Konfidenzschwellen hinweg zusammenfasst, indem die vorhergesagten Posen mit den gekennzeichneten Referenzdaten verglichen werden.

In vielen Pose-Benchmarks wird eine vorhergesagte Pose mithilfe der Objekt-Keypoint-Ähnlichkeit (OKS) mit einer Ground-Truth-Pose abgeglichen. OKS misst, wie nah die vorhergesagten Keypoints an den annotierten Keypoints liegen, und berücksichtigt dabei Faktoren wie die Größe der Person und die typische Lokalisierungsschwierigkeit jedes Keypoints.

Pose-Modelle geben auch Konfidenzwerte für erkannte Personen und für einzelne Schlüsselpunkte aus. Diese Werte spiegeln die Konfidenz des Modells wider und werden zum Rangieren und Filtern von Vorhersagen verwendet, was besonders unter schwierigen Bedingungen wie Verdeckung, Bewegungsunschärfe oder ungewöhnlichen Kamerawinkeln wichtig ist.

Heutzutage gibt es viele Tools zur Posenschätzung, die jeweils ein Gleichgewicht zwischen Geschwindigkeit, Genauigkeit und Benutzerfreundlichkeit bieten. Hier sind einige der am häufigsten verwendeten Tools und Bibliotheken:

Die Posenschätzung wird zunehmend eingesetzt, um gewöhnliche Videos in nützliche Bewegungsinformationen umzuwandeln. Durch die Verfolgung von Körper-Schlüsselpunkten Frame für Frame können diese Systeme aus Kameraaufnahmen Haltung, Bewegung und körperliches Verhalten ableiten, wodurch diese Technologie in vielen realen Situationen praktisch einsetzbar ist.

Im Gesundheitswesen und in der Rehabilitation kann die Posenerfassung Ärzten beispielsweise dabei helfen, die Bewegungen eines Patienten während der Therapie und Genesung zu beobachten und zu messen. Durch die Extraktion von Körpermerkmalen aus gewöhnlichen Videoaufnahmen kann sie zur Beurteilung der Körperhaltung, des Bewegungsumfangs und der allgemeinen Bewegungsmuster im Zeitverlauf verwendet werden. Diese Messungen können traditionelle klinische Bewertungen unterstützen und optimieren und in einigen Fällen track erleichtern, ohne dass tragbare Sensoren oder spezielle Geräte erforderlich sind.

In ähnlicher Weise kann die Posenschätzung im Sport und im Rundfunk die Bewegungen von Athleten direkt aus Videoaufnahmen analysieren. Ein interessantes Beispiel ist Hawk-Eye, ein kamerabasiertes Tracking-System, das im Profisport für Schiedsrichterentscheidungen und Rundfunkgrafiken eingesetzt wird. Es bietet auch Skelett-Tracking, indem es die Körper-Keypoints eines Athleten aus Kameraaufnahmen schätzt.

Die Auswahl des richtigen Tools zur Posenschätzung beginnt mit dem Verständnis der Anforderungen Ihres Computer-Vision-Projekts. Einige Anwendungen legen Wert auf Echtzeitgeschwindigkeit, während andere eine höhere Genauigkeit und Detailtreue erfordern.

Das Ziel-Bereitstellungsgerät spielt ebenfalls eine Rolle. Mobile Apps und Edge-Geräte erfordern in der Regel leichtgewichtige, effiziente Modelle, während größere Modelle oft besser für Server oder Cloud-Umgebungen geeignet sind.

Darüber hinaus kann auch die Benutzerfreundlichkeit eine Rolle spielen. Eine gute Dokumentation, eine reibungslose Bereitstellung und die Unterstützung für benutzerdefinierte Schulungen können Ihr Projekt optimieren.

Einfach ausgedrückt: Verschiedene Tools zeichnen sich in unterschiedlichen Bereichen aus. So bieten beispielsweise YOLO Ultralytics eine praktische Balance zwischen Geschwindigkeit, Genauigkeit und einfacher Implementierung für viele reale Anwendungen zur Posenschätzung.

Die Posenschätzung hilft Computern dabei, menschliche Bewegungen zu verstehen, indem sie wichtige Körperpunkte in Bildern und Videos erkennt. Modelle wie YOLO11 YOLO26 erleichtern die Entwicklung von Echtzeitanwendungen für Bereiche wie Sport, Gesundheitswesen, Arbeitssicherheit und interaktive Erlebnisse. Da die Modelle immer schneller und genauer werden, wird die Posenschätzung wahrscheinlich zu einer gängigen Funktion in vielen Vision-KI-Systemen werden.

Möchten Sie mehr über KI erfahren? Besuchen Sie unsere Community und unser GitHub-Repository. Auf unseren Lösungsseiten erfahren Sie mehr über KI in der Robotik und Computer Vision in der Fertigung. Entdecken Sie unsere Lizenzoptionen und beginnen Sie noch heute mit dem Aufbau von Computer Vision!

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens