Confronto tra Ultralytics YOLO11 e i modelli YOLO precedenti

Confrontate Ultralytics YOLOv8, YOLOv9, YOLOv10 e Ultralytics YOLO11 per capire come si sono evoluti e migliorati questi modelli dal 2023 al 2025.

Confrontate Ultralytics YOLOv8, YOLOv9, YOLOv10 e Ultralytics YOLO11 per capire come si sono evoluti e migliorati questi modelli dal 2023 al 2025.

Dall'automazione delle attività quotidiane all'aiuto nel prendere decisioni informate in tempo reale, l'intelligenza artificiale (IA) sta rimodellando il futuro di vari settori. Un'area particolarmente affascinante dell'IA è la computer vision, altrimenti nota come Vision AI. Si concentra sul consentire alle macchine di analizzare e interpretare i dati visivi come fanno gli umani.

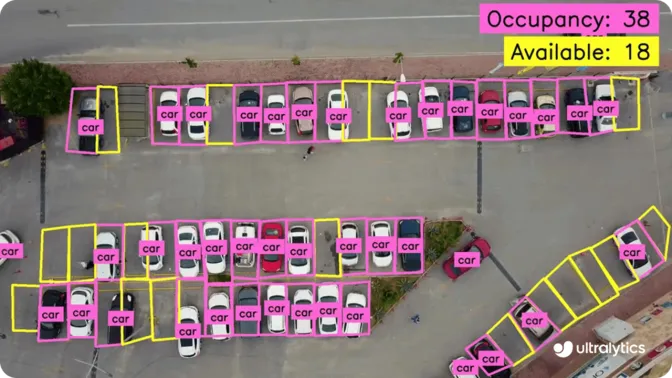

In particolare, i modelli di computer vision sono alla base di innovazioni che migliorano la sicurezza e l'efficienza. Per esempio, questi modelli sono utilizzati nelle auto a guida autonoma per detect pedoni e nelle telecamere di sicurezza per monitorare i locali 24 ore su 24.

Alcuni dei modelli di computer vision più noti sono i modelli YOLO (You Only Look Once), noti per le loro capacità di rilevamento degli oggetti in tempo reale. Nel tempo, i modelli YOLO sono migliorati e ogni nuova versione offre prestazioni migliori e maggiore flessibilità.

Le versioni più recenti come Ultralytics YOLO11 sono in grado di gestire una varietà di compiti, come la segmentazione delle istanze, la classificazione delle immagini, la stima della posa e il tracciamento di più oggetti, con un'accuratezza, una velocità e una precisione mai viste prima.

In questo articolo confronteremo Ultralytics YOLOv8YOLOv9, YOLOv10 e Ultralytics YOLO11 per avere un'idea più precisa dell'evoluzione di questi modelli. Analizzeremo le loro caratteristiche principali, i risultati dei benchmark e le differenze di prestazioni. Iniziamo!

YOLOv8, rilasciato da Ultralytics il 10 gennaio 2023, rappresenta un importante passo avanti rispetto ai precedenti modelli YOLO . È ottimizzato per un rilevamento accurato in tempo reale, combinando approcci ben collaudati con aggiornamenti innovativi per ottenere risultati migliori.

Oltre al rilevamento degli oggetti, supporta anche le seguenti attività di computer vision: segmentazione dell'istanza, stima della posa, rilevamento degli oggetti oriented bounding box (OBB) e classificazione delle immagini. Un'altra caratteristica importante di YOLOv8 è che è disponibile in cinque diverse varianti di modello - Nano, Small, Medium, Large e X - in modo da poter scegliere il giusto equilibrio tra velocità e precisione in base alle proprie esigenze.

Grazie alla sua versatilità e alle sue ottime prestazioni, YOLOv8 può essere utilizzato in molte applicazioni reali, come i sistemi di sicurezza, le smart city, la sanità e l'automazione industriale.

Ecco un approfondimento su alcune delle altre caratteristiche principali di YOLOv8:

YOLOv9 è stato rilasciato il 21 febbraio 2024 da Chien-Yao Wang e Hong-Yuan Mark Liao dell'Institute of Information Science, Academia Sinica, Taiwan. Supporta compiti come il rilevamento di oggetti e la segmentazione di istanze.

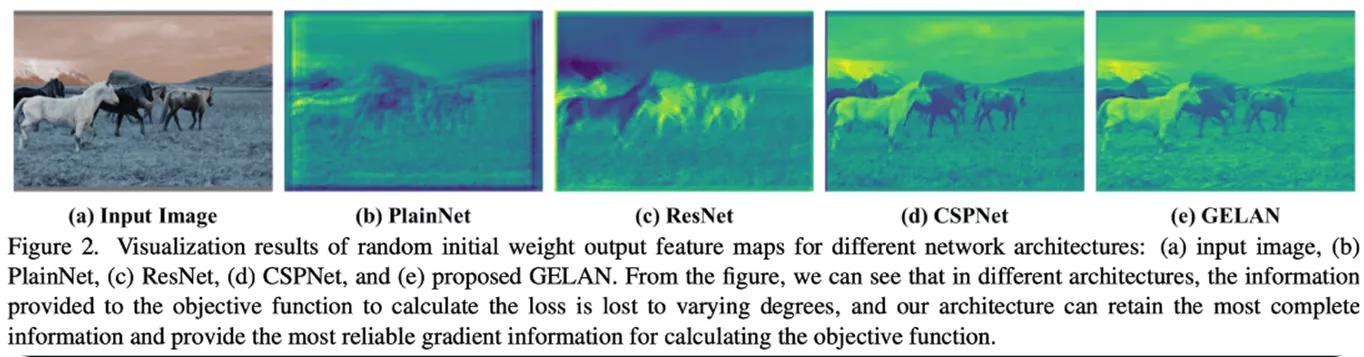

Questo modello si basa su Ultralytics YOLOv5 e introduce due importanti innovazioni: Programmable Gradient Information (PGI) e Generalized Efficient Layer Aggregation Network (GELAN).

L'IGP aiuta YOLOv9 a conservare le informazioni importanti mentre elabora i dati attraverso i suoi livelli, il che porta a risultati più accurati. Nel frattempo, GELAN migliora il modo in cui il modello utilizza i suoi livelli, aumentando le prestazioni e l'efficienza di calcolo. Grazie a questi aggiornamenti, YOLOv9 è in grado di gestire attività in tempo reale su dispositivi edge e applicazioni mobili, dove le risorse di calcolo sono spesso limitate.

Ecco un assaggio di alcune delle altre caratteristiche principali di YOLOv8:

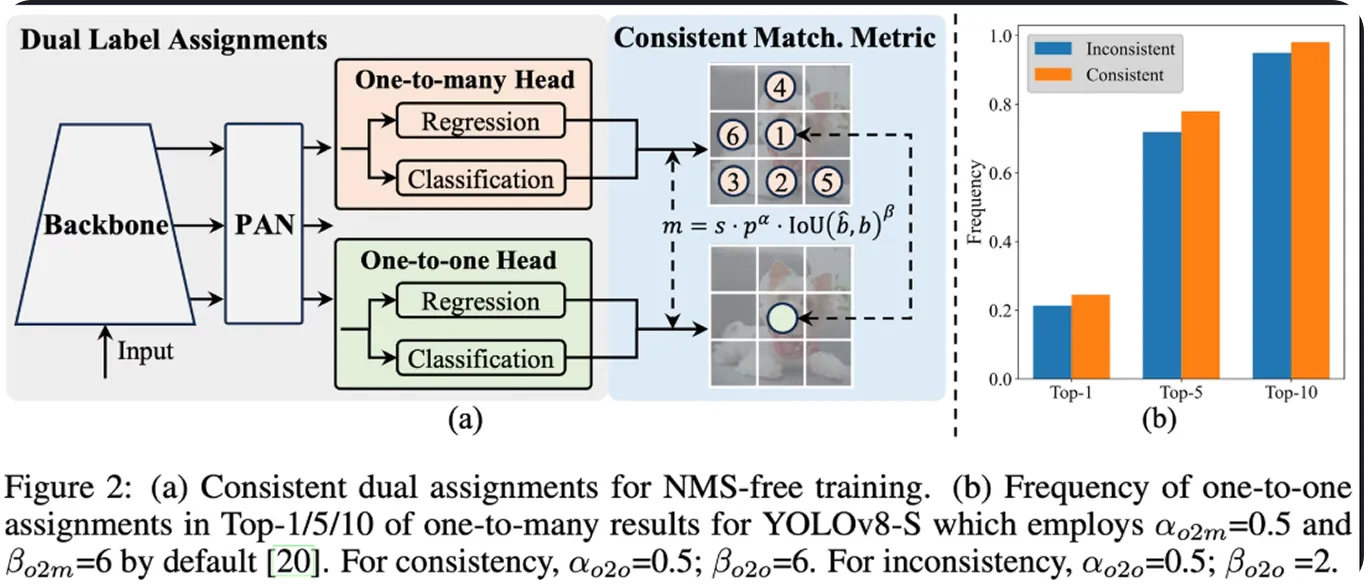

YOLOv10 è stato presentato il 23 maggio 2024 dai ricercatori della Tsinghua University ed è incentrato sul rilevamento degli oggetti in tempo reale. Affronta le limitazioni delle versioni precedenti di YOLO eliminando la necessità della soppressione non massimaNMS), una fase di post-elaborazione utilizzata per eliminare i rilevamenti doppi, e perfezionando il design complessivo del modello. Il risultato è un rilevamento più rapido ed efficiente degli oggetti, pur mantenendo un'accuratezza all'avanguardia.

Una parte fondamentale di ciò che rende possibile tutto questo è un approccio all'addestramento noto come assegnazione coerente di due etichette. Esso combina due strategie: una che consente di apprendere più previsioni dallo stesso oggetto (one-to-many) e un'altra che si concentra sulla scelta della migliore previsione singola (one-to-one). Poiché entrambe le strategie seguono le stesse regole di corrispondenza, il modello impara da solo a evitare i duplicati, quindi non è necessario l'NMS .

L'architettura di YOLOv10si avvale inoltre di una spina dorsale CSPNet migliorata per apprendere le caratteristiche in modo più efficace e di un collo PAN (Path Aggregation Network) che combina le informazioni provenienti da diversi livelli, migliorando il rilevamento di oggetti sia piccoli che grandi. Questi miglioramenti consentono di utilizzare YOLOv10 per applicazioni reali nei settori della produzione, della vendita al dettaglio e della guida autonoma.

Ecco alcune delle altre caratteristiche di YOLOv10:

Quest'anno, il 30 settembre, Ultralytics ha lanciato ufficialmente YOLO11 - uno degli ultimi modelli della serie YOLO - in occasione dell'evento ibrido annuale YOLO Vision 2024 (YV24).

Questa versione ha introdotto miglioramenti significativi rispetto alle versioni precedenti. YOLO11 è più veloce, più preciso e altamente efficiente. Supporta l'intera gamma di attività di computer vision che gli utenti di YOLOv8 conoscono bene, tra cui il rilevamento di oggetti, la segmentazione di istanze e la classificazione di immagini. Inoltre, mantiene la compatibilità con i flussi di lavoro di YOLOv8 , facilitando la transizione degli utenti alla nuova versione.

Inoltre, YOLO11 è progettato per soddisfare un'ampia gamma di esigenze informatiche, dai dispositivi edge leggeri ai potenti sistemi cloud. Il modello è disponibile sia in versione open-source sia in versione enterprise, il che lo rende adattabile a diversi casi d'uso.

È un'ottima opzione per attività di precisione come l'imaging medico e il rilevamento satellitare, nonché per applicazioni più ampie in veicoli autonomi, agricoltura e assistenza sanitaria.

Ecco alcune delle altre caratteristiche uniche di YOLO11:

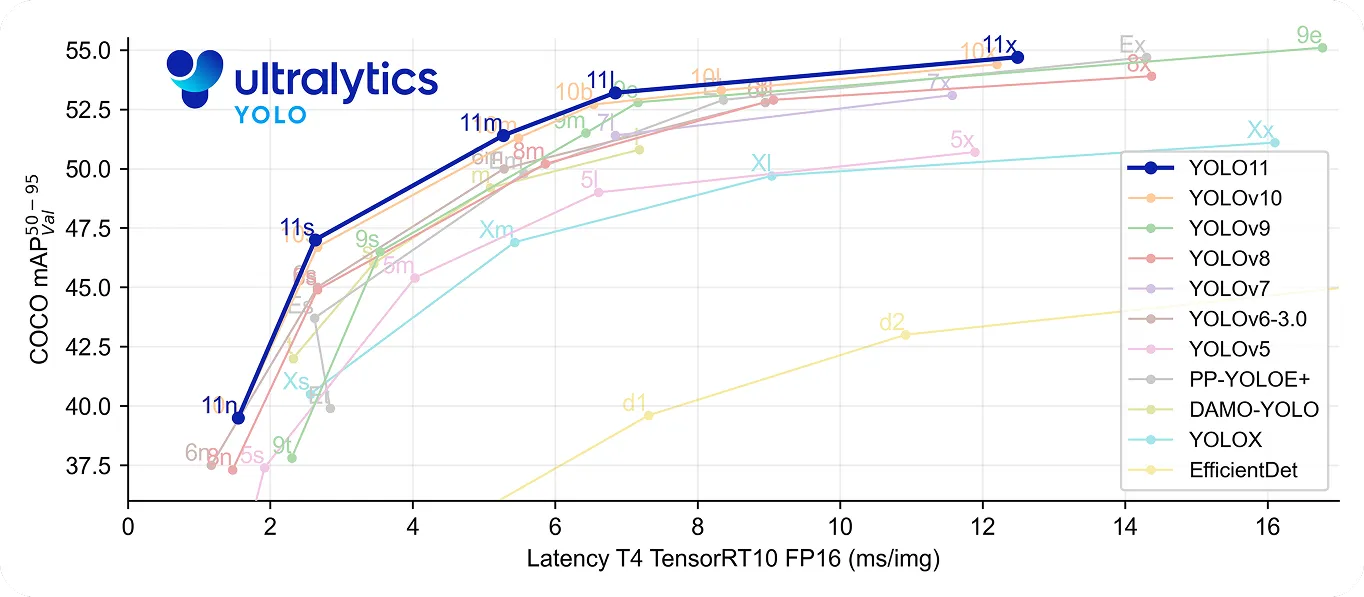

Quando si esplorano diversi modelli, non è sempre facile confrontarli solo guardando le loro caratteristiche. È qui che entra in gioco il benchmarking. Eseguendo tutti i modelli sullo stesso set di dati, possiamo misurare e confrontare oggettivamente le loro prestazioni. Vediamo come si comporta ogni modello sul set di datiCOCO .

Se si confrontano i modelli YOLO , ogni nuova versione apporta notevoli miglioramenti in termini di precisione, velocità e flessibilità. In particolare, YOLO11m fa un balzo in avanti in quanto utilizza il 22% di parametri in meno rispetto a YOLOv8m, il che significa che è più leggero e veloce da eseguire. Inoltre, nonostante le dimensioni ridotte, ottiene una precisione media superioremAP) sul set di dati COCO . Questa metrica misura la capacità del modello di rilevare e localizzare gli oggetti, per cui una mAP più alta significa previsioni più accurate.

Analizziamo le prestazioni di questi modelli in situazioni reali.

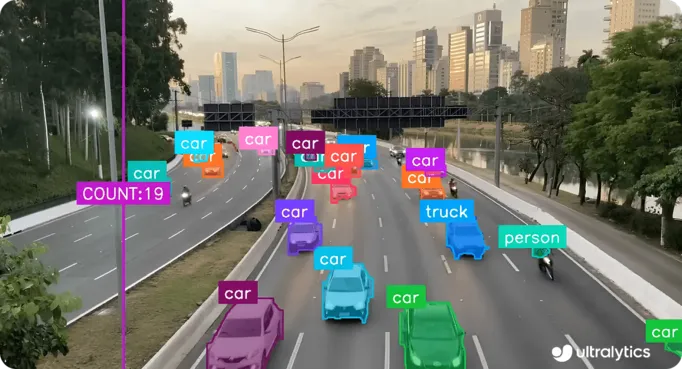

Per confrontare YOLOv8, YOLOv9, YOLOv10 e YOLO11, tutti e quattro sono stati eseguiti sullo stesso video del traffico utilizzando un punteggio di confidenza di 0,3 (il modello visualizza i rilevamenti solo quando è sicuro di aver identificato correttamente un oggetto per almeno il 30%) e una dimensione dell'immagine di 640 per una valutazione equa. I risultati del rilevamento e del tracciamento degli oggetti hanno evidenziato differenze fondamentali in termini di accuratezza, velocità e precisione del rilevamento.

Fin dal primo fotogramma, YOLO11 ha individuato veicoli di grandi dimensioni, come i camion, che YOLOv10 non ha rilevato. YOLOv8 e YOLOv9 hanno mostrato prestazioni decenti, ma variabili a seconda delle condizioni di illuminazione e delle dimensioni dell'oggetto. I veicoli più piccoli e distanti sono rimasti una sfida per tutti i modelli, anche se YOLO11 ha mostrato notevoli miglioramenti anche in questi rilevamenti.

In termini di velocità, tutti i modelli hanno operato tra i 10 e i 20 millisecondi per fotogramma, abbastanza velocemente da gestire attività in tempo reale a oltre 50 FPS. Da un lato, YOLOv8 e YOLOv9 hanno fornito rilevamenti costanti e affidabili per tutto il video. È interessante notare che YOLOv10, progettato per una latenza più bassa, è stato più veloce ma ha mostrato alcune incongruenze nel rilevamento di alcuni tipi di oggetti.

YOLO11, invece, si è distinto per la sua precisione, offrendo un forte equilibrio tra velocità e accuratezza. Anche se nessuno dei modelli si è comportato perfettamente in ogni fotogramma, il confronto fianco a fianco ha dimostrato chiaramente che YOLO11 ha fornito le migliori prestazioni complessive.

La selezione di un modello per un progetto dipende dai suoi requisiti specifici. Ad esempio, alcune applicazioni possono dare priorità alla velocità, mentre altre possono richiedere una maggiore accuratezza o affrontare vincoli di deployment che influenzano la decisione.

Un altro fattore importante è il tipo di compiti di computer vision che dovete affrontare. Se siete alla ricerca di una maggiore flessibilità tra i vari compiti, YOLOv8 e YOLO11 sono buone opzioni.

La scelta di YOLOv8 o YOLO11 dipende dalle vostre esigenze. YOLOv8 è un'opzione valida se siete alle prime armi con la computer vision e apprezzate una comunità più ampia, un maggior numero di tutorial e ampie integrazioni di terze parti.

D'altra parte, se cercate prestazioni all'avanguardia con una migliore precisione e velocità, YOLO11 è la scelta migliore, anche se è dotato di una comunità più piccola e di un minor numero di integrazioni a causa del fatto che è una versione più recente.

Da Ultralytics YOLOv8 a Ultralytics YOLO11, l'evoluzione della serie di modelli YOLO riflette una spinta costante verso modelli di computer vision più intelligenti. Ogni versione di YOLO apporta significativi miglioramenti in termini di velocità, accuratezza e precisione.

Con il continuo progresso della computer vision, questi modelli offrono soluzioni affidabili alle sfide del mondo reale, dal rilevamento degli oggetti ai sistemi autonomi. Il continuo sviluppo dei modelli YOLO dimostra quanta strada sia stata fatta nel settore e quanto ancora ci si possa aspettare in futuro.

Per saperne di più sull'IA, visita il nostro repository GitHub e interagisci con la nostra community. Scopri i progressi in diversi settori, dalla Vision AI nel manufacturing alla computer vision nella sanità. Consulta le nostre opzioni di licenza per iniziare oggi stesso i tuoi progetti di Vision AI.

Inizia il tuo viaggio con il futuro del machine learning