Scopri perché Ultralytics è più facile da implementare in produzione!

Scopri come Ultralytics collega ricerca e produzione con un design edge-first che semplifica l'implementazione e l'integrazione.

.webp)

Scopri come Ultralytics collega ricerca e produzione con un design edge-first che semplifica l'implementazione e l'integrazione.

.webp)

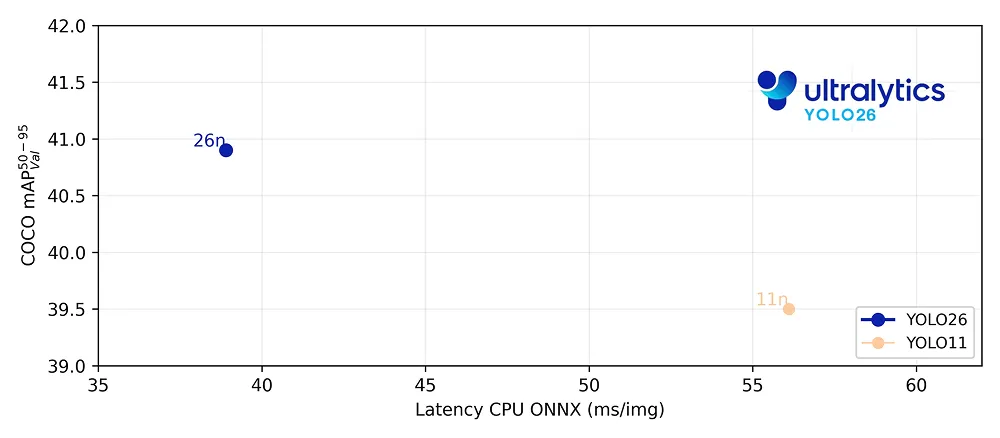

Ultralytics , il nostro ultimo modello di visione artificiale, segna un passo avanti nel rendere più facile l'implementazione di soluzioni di visione artificiale in tempo reale. In altre parole, è progettato per passare più agevolmente dalla fase di sperimentazione a sistemi che funzionano in modo continuo su hardware reale.

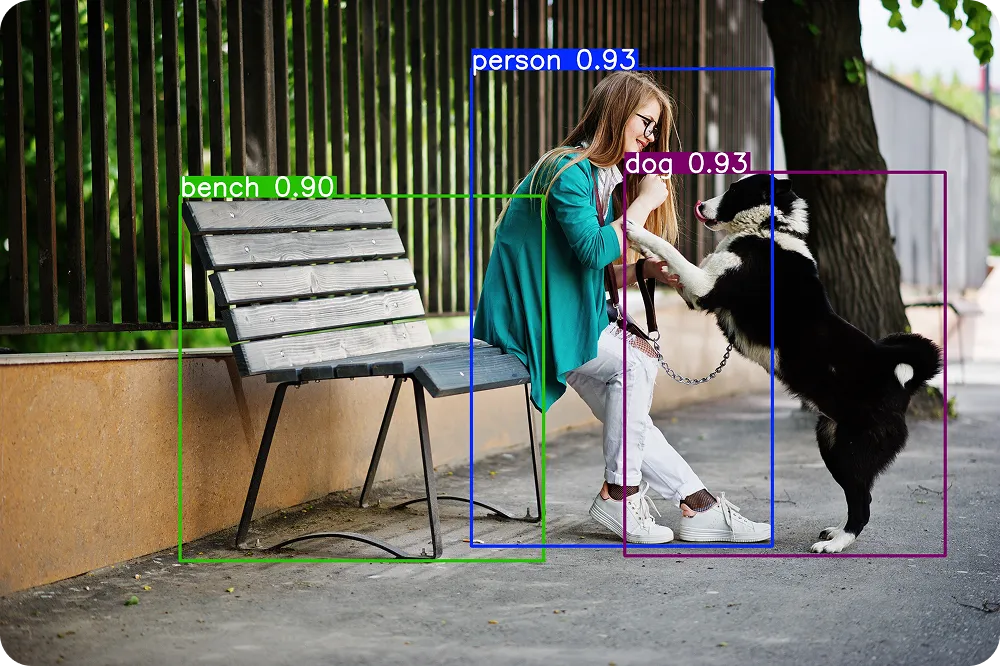

La visione artificiale è oggi utilizzata in molte applicazioni reali, tra cui la produzione, la robotica, la vendita al dettaglio e le infrastrutture. Man mano che questi sistemi passano dalla fase di test all'uso quotidiano, l'attenzione si sta spostando dalle prestazioni dei singoli modelli alla loro capacità di integrarsi in un sistema software più ampio. Fattori come l'affidabilità, l'efficienza e la facilità di integrazione sono importanti tanto quanto la precisione.

Questo cambiamento ha importanti implicazioni sul modo in cui vengono progettati e valutati i modelli di visione artificiale. Il successo nella produzione dipende non solo da ciò che un modello è in grado di detect, ma anche dalla facilità con cui può essere integrato, implementato e mantenuto nel tempo.

YOLO26 è stato progettato tenendo conto di queste esigenze pratiche. Concentrandosi sull'inferenza end-to-end, sulle prestazioni edge-first e su un'integrazione più semplice, riduce la complessità dell'intero processo di implementazione.

In questo articolo vedremo come Ultralytics contribuisca a colmare il divario tra ricerca e produzione e perché le sue caratteristiche rendano più semplice l'integrazione dei sistemi di visione artificiale in tempo reale nelle applicazioni del mondo reale. Cominciamo!

Con la diffusione sempre più capillare della visione artificiale, molti team stanno andando oltre la fase di ricerca e iniziando a implementare modelli in applicazioni reali. Questo passo successivo verso la produzione spesso mette in luce sfide che non erano visibili durante la fase di sperimentazione.

In ambito di ricerca, i modelli vengono solitamente testati in ambienti controllati utilizzando set di dati fissi. Questi test sono utili per misurare l'accuratezza, ma non riflettono appieno il comportamento di un modello una volta implementato. In produzione, i sistemi di visione artificiale devono elaborare dati in tempo reale, funzionare in modo continuo e operare su hardware reale insieme ad altri software.

Una volta che un modello entra a far parte di un sistema di produzione, i fattori che vanno oltre la precisione assumono maggiore importanza. Le pipeline di inferenza possono includere passaggi aggiuntivi; le prestazioni possono variare da un dispositivo all'altro e i sistemi devono comportarsi in modo coerente nel tempo. Queste considerazioni pratiche influiscono sulla facilità con cui un modello può essere integrato e mantenuto man mano che le applicazioni crescono.

A causa di questi fattori, il passaggio dalla ricerca alla produzione spesso non riguarda tanto il miglioramento dei risultati dei modelli quanto la semplificazione dell'implementazione e del funzionamento. I modelli più facili da integrare, che funzionano in modo efficiente sull'hardware di destinazione e si comportano in modo prevedibile tendono a passare alla produzione in modo più agevole.

Ultralytics è stato progettato proprio tenendo conto di questa transizione. Ridurre la complessità dell'intero processo di implementazione aiuta i team a trasferire i modelli di visione artificiale dalla fase sperimentale alla produzione reale in modo più efficiente.

Uno dei motivi principali per cui Ultralytics è più pratico da implementare è il suo design di inferenza end-to-end. In parole povere, ciò significa che il modello è progettato per produrre direttamente previsioni finali, senza ricorrere a ulteriori fasi di post-elaborazione al di fuori del modello stesso.

In molti sistemi tradizionali di visione artificiale, l'inferenza non si interrompe al termine dell'esecuzione del modello. Il modello genera invece un gran numero di previsioni intermedie che devono essere filtrate e perfezionate prima di poter essere utilizzate.

Questi passaggi aggiuntivi vengono spesso gestiti da una fase di post-elaborazione separata denominata Non-Maximum Suppression (NMS), che aggiunge complessità al sistema complessivo. Negli ambienti di produzione, questa complessità può rappresentare un problema.

Le fasi di post-elaborazione possono aumentare la latenza, comportarsi in modo diverso sulle diverse piattaforme hardware e richiedere un lavoro di integrazione aggiuntivo. Inoltre, introducono ulteriori componenti che devono essere testati, sottoposti a manutenzione e mantenuti coerenti man mano che i sistemi crescono.

YOLO26 adotta un approccio diverso. La risoluzione delle previsioni duplicate e la produzione di output finali all'interno del modello riduce il numero di passaggi richiesti nella pipeline di inferenza. Ciò semplifica l'implementazione, poiché vi è meno logica esterna da gestire e minori possibilità di incongruenze tra gli ambienti.

Per i team che implementano sistemi di visione, questo design end-to-end e NMS aiuta a semplificare l'integrazione. Il modello si comporta in modo più prevedibile una volta implementato e i modelli esportati, ovvero le versioni preparate per essere eseguite al di fuori dell'ambiente di formazione sull'hardware di destinazione, sono più autonomi.

Di conseguenza, ciò che viene testato durante lo sviluppo corrisponde maggiormente a ciò che viene eseguito in produzione. Ciò rende Ultralytics più facile da integrare nei sistemi software reali e più semplice da distribuire su larga scala.

Oltre all'inferenza end-to-end, Ultralytics include una serie di opzioni relative alle prestazioni e alla formazione progettate per rendere più prevedibile l'implementazione in produzione.

Ecco alcune delle caratteristiche principali che rendono Ultralytics più semplice da distribuire e utilizzare in produzione:

Nel complesso, queste innovazioni contribuiscono a ridurre il rischio e la complessità dell'implementazione dei sistemi di visione artificiale nella produzione. Combinando prestazioni edge-first con un training più stabile e un comportamento prevedibile dei modelli, Ultralytics rende più facile per i team passare dallo sviluppo all'implementazione nel mondo reale con fiducia.

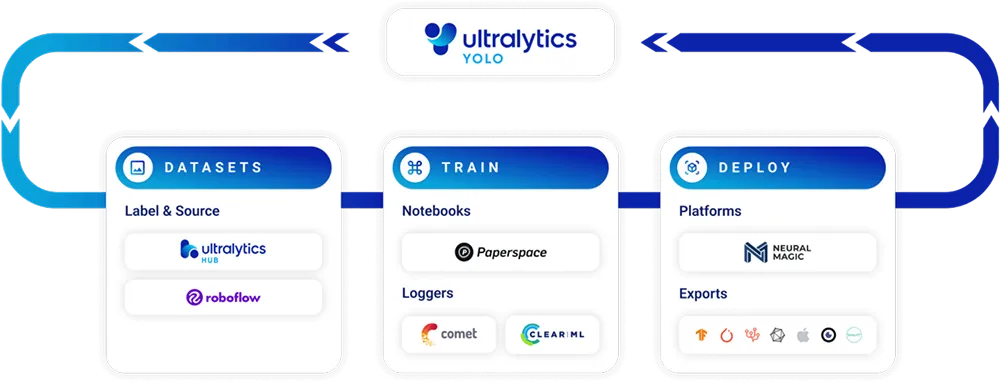

L'implementazione di un modello di visione artificiale raramente riguarda solo il modello stesso. In produzione, i team devono addestrare i modelli, eseguire inferenze, monitorare le prestazioni ed esportare i modelli in formati compatibili con diverse piattaforme e hardware. Ogni strumento aggiuntivo o script personalizzato in questa pipeline aumenta la complessità e il rischio di errore.

Il Ultralytics è progettato per ridurre tale complessità riunendo questi passaggi in un unico flusso di lavoro coerente. Con un'unica libreria, i team possono addestrare modelli come YOLO26, eseguire previsioni, convalidare i risultati ed esportare modelli per l'implementazione senza dover cambiare strumenti o riscrivere il codice di integrazione.

Supporta inoltre un'ampia gamma di integrazioni durante l'intero ciclo di vita, dalla formazione e valutazione all'esportazione e implementazione su diversi hardware di destinazione. Questo approccio unificato fa la differenza negli ambienti di produzione.

Gli stessi comandi e le stesse interfacce utilizzati durante la sperimentazione vengono trasferiti alla fase di implementazione, riducendo così l'attrito tra i team di ricerca, ingegneria e operazioni. Anche l'esportazione dei modelli diventa più prevedibile, poiché i modelli YOLO26 possono essere convertiti direttamente in formati come ONNX, TensorRT, CoreML, OpenVINO e altri comunemente utilizzati nei sistemi di produzione.

Riducendo al minimo il codice glue e il lavoro di integrazione personalizzato, il Ultralytics aiuta i team a concentrarsi sulla creazione di applicazioni affidabili piuttosto che sulla manutenzione di pipeline complesse. Ciò rende più accessibile scalare le distribuzioni, aggiornare i modelli nel tempo e mantenere un comportamento coerente tra gli ambienti di sviluppo e produzione.

Vediamo ora come Ultralytics può essere utilizzato in applicazioni reali che richiedono funzionalità di visione artificiale affidabili e pronte per la produzione.

I sistemi robotici dipendono da una percezione rapida e affidabile per funzionare in modo sicuro ed efficace. Che si tratti di un robot mobile autonomo che naviga in un magazzino o di un braccio robotico che movimenta oggetti su una linea, i modelli di visione devono fornire risultati coerenti con una latenza minima.

Ultralytics è in grado di detect , riconoscere oggetti e monitorare la presenza umana direttamente sull'hardware robotico. Il suo design di inferenza end-to-end semplifica l'integrazione nel software di controllo robotico, facilitando l'implementazione di funzionalità di visione che funzionano in modo continuo in ambienti reali.

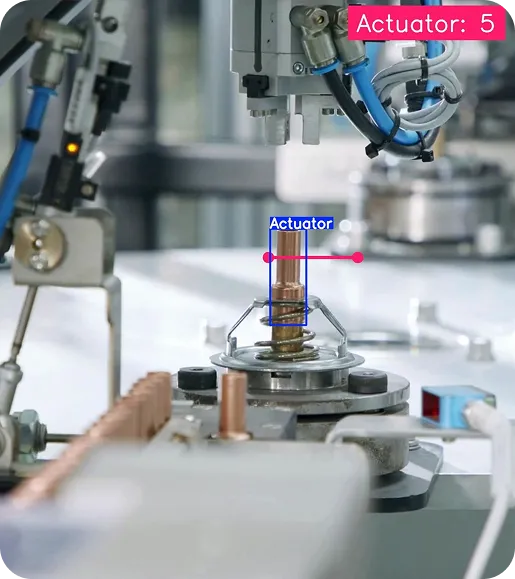

Negli stabilimenti industriali, la visione artificiale è comunemente utilizzata per monitorare le attrezzature, ispezionare i prodotti e garantire che i processi rimangano entro limiti operativi di sicurezza. YOLO26 può essere implementato su hardware industriale locale per detect , verificare le fasi di assemblaggio o track movimento dei componenti meccanici in tempo reale.

La sua capacità di funzionare in modo efficiente su dispositivi edge lo rende particolarmente adatto alle linee di produzione in cui i sistemi devono operare in modo continuo, con bassa latenza e un overhead minimo dell'infrastruttura.

I droni e i sistemi remoti spesso funzionano con potenza limitata e connettività inaffidabile. YOLO26 è in grado di elaborare i dati visivi direttamente sul dispositivo, consentendo attività quali ispezioni, rilevamenti o monitoraggio durante il volo. Analizzando le immagini localmente, i sistemi possono rispondere in tempo reale e ridurre la necessità di trasmettere grandi quantità di dati a una sede centrale.

Si pensi a una città che installa telecamere agli incroci, nei parchi pubblici e nei nodi di trasporto. Ogni luogo può utilizzare hardware diverso e operare in condizioni diverse, ma il sistema di visione deve comunque funzionare in modo coerente.

Ultralytics può aiutare ad analizzare questi flussi video per attività quali il monitoraggio del traffico, il rilevamento dei pedoni o l'analisi degli spazi pubblici. Il suo comportamento di implementazione prevedibile e il supporto per più piattaforme hardware facilitano l'implementazione, l'aggiornamento e la manutenzione dei sistemi di visione in ambienti urbani estesi e distribuiti.

Per molte organizzazioni, la sfida più grande con Vision AI non è costruire un modello che funzioni in una demo. È trasformare quel lavoro in un sistema che funzioni in modo affidabile nella produzione.

L'implementazione richiede spesso un notevole sforzo ingegneristico, una manutenzione continua e un coordinamento tra i team, che possono rallentare i progetti o limitarne l'impatto. Quando i modelli sono facili da distribuire, l'equazione aziendale cambia.

Una distribuzione più rapida riduce il tempo necessario per ottenere valore. Un'integrazione più semplice riduce i costi di progettazione e operativi. Un comportamento più prevedibile in tutti gli ambienti riduce i rischi e rende pratica la pianificazione a lungo termine.

Ultralytics è stato progettato tenendo conto di questi fattori. Semplificare l'implementazione e supportare un comportamento coerente nella produzione aiuta le organizzazioni a passare dalla sperimentazione all'uso quotidiano della Vision AI. Per i leader aziendali, questo rende la visione artificiale un investimento più pratico e affidabile, piuttosto che un'attività di ricerca ad alto rischio.

Ultralytics è stato progettato per colmare il divario tra ricerca e produzione, semplificando l'implementazione e la manutenzione della visione artificiale in tempo reale. Il suo design end-to-end e le prestazioni edge-first riducono la complessità che spesso rallenta i progetti di Vision AI. Ciò consente alle organizzazioni di muoversi più rapidamente e vedere prima i risultati.

Entra a far parte della nostra community ed esplora il nostro repository GitHub per saperne di più sull'IA. Consulta le nostre pagine dedicate alle soluzioni per scoprire l'IA nel settore retail e la visione artificiale in agricoltura. Scopri le nostre opzioni di licenza e inizia oggi stesso a sviluppare con la visione artificiale!

Inizia il tuo viaggio con il futuro del machine learning