눈 속의 동물 발자국이 야생 동물 이동에 대한 통찰력을 제공하는 방법과 컴퓨터 비전이 연구자들의 연구를 어떻게 돕는지 알아보세요.

눈 속의 동물 발자국이 야생 동물 이동에 대한 통찰력을 제공하는 방법과 컴퓨터 비전이 연구자들의 연구를 어떻게 돕는지 알아보세요.

이 글에서 다루는 개념을 시각적으로 살펴보려면 아래 동영상을 시청하세요.

눈은 다른 자연 표면과 마찬가지로 야생 동물 활동의 기록을 남길 수 있습니다. 예를 들어 눈 속에 남겨진 발자국은 어떤 동물이 지나갔는지, 어떻게 움직였는지, 무엇을 하고 있었는지 보여줄 수 있습니다.

수십 년 동안 등산객, 사냥꾼, 연구자들은 야생 동물의 행동을 더 자세히 알아보기 위해 이러한 발자국을 연구해 왔습니다. 하지만 이 과정이 항상 신뢰할 수 있는 것은 아닙니다. 눈이 움직이거나 바람이 세부 사항을 흐리게 만들 수 있으며, 겹쳐진 발자국은 식별을 어렵게 만들 수 있습니다. 숙련된 관찰자조차도 중요한 패턴을 간과할 수 있습니다.

기술의 발전으로 이러한 신호를 더 쉽게 해석할 수 있게 되었습니다. 특히 기계가 시각적 데이터를 정확하고 빠르게 분석할 수 있는 AI의 한 분야인 컴퓨터 비전은 동물의 흔적을 detect 이해하는 데 사용할 수 있습니다. 예를 들어 다음과 같은 모델이 있습니다. Ultralytics YOLO11 와 같은 모델은 동물 발자국 이미지에서 모양과 패턴을 detect 학습시킬 수 있습니다.

이번 글에서는 눈 속 동물 발자국이 어떻게 보존되는지, 야생 동물에 대해 무엇을 알려주는지, 그리고 컴퓨터 비전이 어떻게 추적 효율성을 높이는지 살펴보겠습니다.

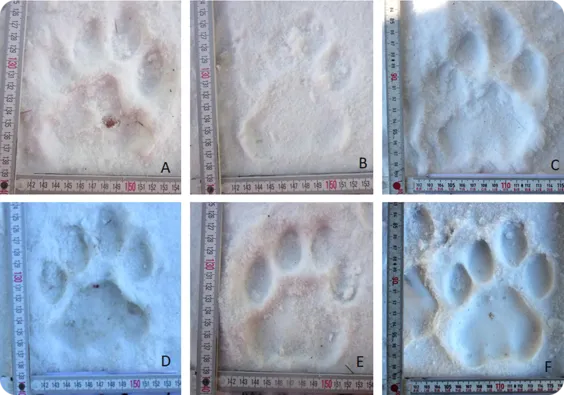

동물 발자국은 동물이 눈, 흙, 진흙 등의 표면을 이동할 때 남기는 흔적입니다. 적절한 눈 상태에서는 발톱 자국, 발가락 패드, 앞발과 뒷발의 차이 등 흙이나 풀에서는 detect 어려운 선명한 디테일을 보존할 수 있습니다.

종을 식별하는 것 외에도 발자국의 간격, 배열 및 미묘한 변화는 연구원에게 이동, 행동 및 환경과의 상호 작용에 대해 많은 것을 알려주어 연구원, 등산객 및 야생 동물 애호가에게 동물 활동에 대한 귀중한 통찰력을 제공할 수 있습니다.

연구원들이 트랙을 읽는 동안 찾는 주요 기능은 다음과 같습니다:

눈 위의 모든 track 동물의 이야기의 일부를 말해줍니다. 각 발자국의 크기와 모양, 앞발과 뒷발의 차이, 발톱 자국의 유무에 따라 동물의 종, 걸음걸이, 체중 분포 등을 알 수 있습니다. 예를 들어 여우와 코요테는 발톱 자국이 뚜렷하게 남는 경우가 많지만 살쾡이와 퓨마는 그렇지 않은 경우가 많습니다.

발자국은 드물게 단독으로 나타납니다. 배설물, 털 조각, 꼬리 끌린 흔적 또는 주변의 굴 입구와 같은 단서들이 종종 중요한 맥락을 더해줍니다. 눈의 상태와 겹쳐진 흔적들로 인해 세부 사항이 흐릿해질 수 있으므로, 추적자들은 더 명확한 그림을 만들기 위해 여러 징후들을 함께 활용합니다. 눈 위에 발자국이 배열된 방식은 특히 유용하며, 동물이 어디로 갔는지 뿐만 아니라 어떻게 움직이고 행동했는지도 보여줍니다.

다음은 눈에서 흔히 볼 수 있는 동물의 track 패턴입니다:

눈 위의 발자국과 관련된 다양한 단서에도 불구하고 눈 속에서 동물을 추적하는 것은 여전히 복잡할 수 있습니다. 눈의 상태는 발자국이 나타나는 방식에 영향을 미칩니다. 갓 내린 눈은 세부 사항을 보존하는 반면, 딱딱하거나 녹거나 새로 내린 눈은 발자국을 왜곡하거나 덮을 수 있습니다.

바람과 햇빛이 가장자리를 흐리게 할 수 있고 여러 동물의 겹치는 경로가 혼란을 야기할 수 있으므로 날씨도 역할을 합니다. 이 외에도 동물 행동은 예측 불가능성을 더합니다.

스컹크나 검은 곰과 같은 일부 종은 겨울에 동면하는 반면, 다른 종은 불규칙하게 움직이거나 이동 경로를 되짚어 갑니다. 한편, 숲에서는 사슴, 무스 또는 엘크의 흔적이 작은 동물이나 포식자의 흔적과 교차하는 경우가 많으며, 배설물, 털 또는 꼬리 끌림과 같은 추가적인 징후를 사용하여 움직임과 행동을 파악합니다.

눈 속 동물 발자국 분석의 어려움을 해결하기 위해 연구자들은 컴퓨터 비전과 같은 첨단 기술을 활용하기 시작했습니다. 예를 들어, 연구자들은 개별 발자국을 detect 위치를 파악하고, 겹치는 발자국을 구분하고, 맞춤형 데이터 세트를 학습하여 발톱 자국이나 걸음걸이 패턴과 같은 종별 특징을 인식할 수 있는 컴퓨터 비전 모델을 연구하고 있습니다.

특히, Ultralytics YOLO11 같은 모델은 개별 발자국을 식별하고 위치를 파악하는 데 사용할 수 있는 물체 감지, 겹치는 트랙을 분리할 수 있는 인스턴스 분할과 같은 컴퓨터 비전 작업을 지원합니다. 연구자들은 동물 발자국의 맞춤형 데이터 세트에 대해 YOLO11 같은 모델을 훈련함으로써 종별 패턴을 더 쉽게 인식하고, 겹치는 발자국을 구분하며, 수동 관찰보다 더 일관된 결과를 생성할 수 있습니다.

컴퓨터 비전으로 동물 발자국을 track 방법을 살펴봤으니 이제 이 기술이 실제 연구에 어떻게 적용되고 있는지 살펴보겠습니다.

수년 동안 대부분의 발자국 연구는 FIT(Footprint Identification Technology)에 의존해 왔습니다. FIT는 각 발자국에 특정 지점을 표시하고 해당 측정값을 사용하여 동물을 구별합니다. 효과적이지만 프로세스가 느리고 숙련된 전문가가 필요하며 야생에서 수천 개의 트랙을 분석하려는 경우에는 실용적이지 않습니다.

중국 동북부의 아무르 호랑이에 대한 최근 연구에서는 FIT가 눈 속 발자국에서 개체를 식별할 수도 있음을 보여주어 멸종 위기에 처한 포식자를 모니터링하는 신뢰할 수 있는 비침습적 방법을 제공합니다.

그러나 연구자들은 또한 노동 집약적이고 확장하기 어렵다는 한계를 강조했습니다. 중요한 것은 컴퓨터 비전이 향후 이 프로세스를 자동화하여 수동 측정의 필요성을 줄이면서 훨씬 더 큰 데이터 세트를 처리할 수 있다고 언급했습니다.

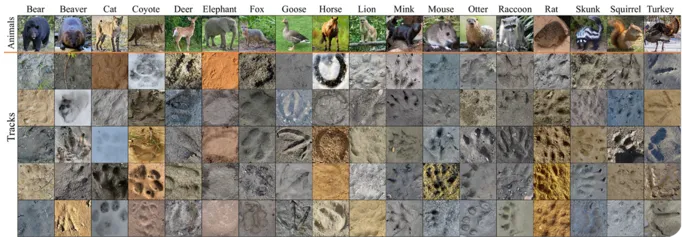

이러한 변화는 이미 진흙, 모래, 눈 위에서 18개 종의 수천 개의 라벨이 붙은 발자국이 포함된 공개 데이터 세트인 OpenAnimalTracks와 같은 프로젝트에서 시작되고 있습니다. 이러한 리소스를 통해 Vision AI 모델을 학습시켜 발자국을 자동으로 detect classify 수 있으므로 야생동물을 더 빠르고 쉽게 모니터링할 수 있습니다.

FIT의 토대를 구축하고 이를 개방형 데이터 세트 및 컴퓨터 비전과 결합함으로써 동물 보호 연구는 동물 자체를 방해하지 않으면서도 종을 track 생태계를 보호할 수 있는 확장 가능한 시스템으로 나아가고 있습니다.

눈 속의 동물 발자국은 동물이 어떻게 움직이고 행동하며 서식지를 이용하는지를 보여줍니다. 손으로 일일이 읽어내려면 인내심과 경험이 필요하지만, 컴퓨터 비전을 활용하면 보다 효율적으로 작업할 수 있습니다. YOLO11 같은 도구를 인간의 지식과 함께 사용하면 야생동물 모니터링이 더욱 간소화되고, 보호 노력에 도움이 되며, 종 보호에 유용한 데이터를 제공할 수 있습니다.

점점 더 커지는 커뮤니티에 참여하세요! AI에 대해 자세히 알아보려면 GitHub 저장소를 탐색해 보세요. 솔루션 페이지에서 제조 분야의 컴퓨터 비전과 물류 분야의 AI를 만나보세요. 컴퓨터 비전으로 개발을 시작하려면 라이선스 옵션을 확인해 보세요.

미래의 머신러닝 여정을 시작하세요