Explore a segmentação de conceitos promptable, como ela difere dos métodos tradicionais e como modelos relacionados, como o YOLOE-26, permitem recursos de vocabulário aberto.

Explore a segmentação de conceitos promptable, como ela difere dos métodos tradicionais e como modelos relacionados, como o YOLOE-26, permitem recursos de vocabulário aberto.

A IA visual está a avançar rapidamente e está a ser amplamente utilizada para analisar imagens e vídeos em ambientes reais. Por exemplo, aplicações que vão desde sistemas de gestão de tráfego até análises de retalho estão a ser integradas com modelos de visão computacional.

Em muitas dessas aplicações, modelos de visão, como modelos de deteção de objetos, são treinados para reconhecer um conjunto predefinido de objetos, incluindo veículos, pessoas e equipamentos. Durante o treinamento, esses modelos são apresentados a muitos exemplos rotulados para que possam aprender como cada objeto aparece e como distingui-lo dos outros em uma cena.

Para tarefas de segmentação, os modelos vão um passo além, produzindo contornos precisos ao nível do pixel em torno desses objetos. Isso permite que os sistemas compreendam exatamente onde cada objeto está localizado numa imagem.

Isso funciona bem desde que o sistema precise apenas reconhecer aquilo para o qual foi treinado. No entanto, em ambientes reais, isso raramente é o caso.

As cenas visuais são normalmente dinâmicas. Novos objetos e conceitos visuais aparecem, as condições mudam e os utilizadores muitas vezes querem segment que não faziam parte da configuração original do treinamento.

Essas limitações ficam especialmente claras quando se trata de segmentação. À medida que a IA de visão continua a evoluir, há uma necessidade crescente de modelos de segmentação mais flexíveis, capazes de se adaptar a novos conceitos sem a necessidade de retreinamento repetido. É por isso que a segmentação de conceitos promptable (PCS) está a ganhar atenção.

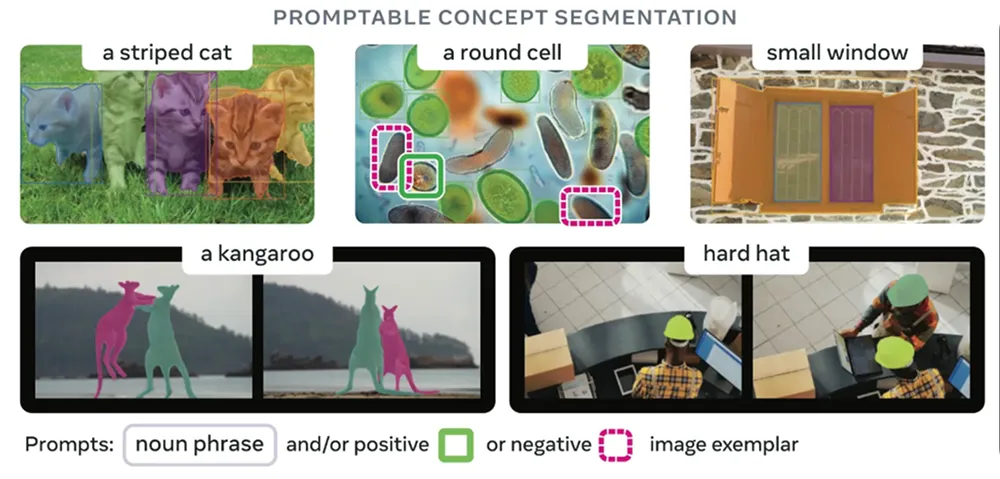

Em vez de depender de uma lista fixa de categorias de objetos, os utilizadores podem descrever o que desejam segment texto, prompts visuais ou imagens de exemplo. Esses modelos podem então identificar e segment as regiões que correspondem ao conceito descrito, mesmo que esse conceito não tenha sido explicitamente incluído durante o treinamento.

Neste artigo, exploraremos como funciona a segmentação de conceitos promptable, como ela difere das abordagens tradicionais e onde é utilizada atualmente.

Na maioria dos casos, os modelos de segmentação são treinados para reconhecer uma pequena lista de tipos de objetos. Isso funciona bem quando um sistema de IA de visão precisa apenas detect segment conjunto específico de objetos.

Em aplicações do mundo real, no entanto, as cenas visuais são dinâmicas. Novos objetos aparecem, os requisitos das tarefas mudam e os utilizadores muitas vezes precisam segment que não estavam incluídos no conjunto de rótulos original. Dar suporte a essas situações normalmente significa coletar novos dados e anotações de alta qualidade e treinar novamente o modelo, o que aumenta o custo e retarda a implementação.

A segmentação de conceitos promptable resolve essa questão, permitindo que os utilizadores digam ao modelo o que procurar, em vez de escolherem a partir de uma lista fixa de rótulos. Os utilizadores descrevem o objeto ou a ideia que procuram, e o modelo destaca todas as áreas correspondentes na imagem. Isso torna muito mais fácil conectar a intenção do utilizador aos pixels reais de uma imagem.

Os modelos que suportam a segmentação de conceitos promptáveis são flexíveis porque podem aceitar diferentes tipos de entrada. Em outras palavras, há mais de uma maneira de dizer ao modelo o que procurar, como descrições de texto, dicas visuais ou imagens de exemplo.

Veja abaixo uma análise mais detalhada de cada abordagem:

Antes de nos aprofundarmos no funcionamento da segmentação de conceitos promptable, vamos primeiro compará-la com vários métodos tradicionais de segmentação de objetos.

O PCS permite modelos com vocabulário aberto e orientados por prompts. Ele pode trabalhar com novas ideias descritas por meio de prompts, mas a segmentação tradicional não. Existem vários tipos diferentes de abordagens de segmentação tradicional, cada uma com suas próprias suposições e limitações.

Aqui está um resumo de alguns tipos principais de segmentação tradicional:

Todas essas abordagens dependem de uma lista predefinida de categorias de objetos. Elas funcionam bem dentro desse escopo, mas não lidam muito bem com conceitos fora dele. Quando um novo objeto específico precisa ser segmentado, geralmente são necessários dados de treino adicionais e ajustes no modelo.

O PCS pretende mudar isso. Em vez de ficar preso a categorias predefinidas, ele permite descrever o que se deseja segment imagem no momento da inferência.

A seguir, vamos ver como os modelos de segmentação evoluíram para a segmentação de conceitos promptable.

Um modelo de base popular que marcou uma mudança na segmentação foi SAM, ou Modelo Segmente Qualquer Coisa. Foi introduzido em 2023. Em vez de depender de categorias de objetos predefinidas, SAM aos utilizadores orientar a segmentação usando prompts visuais simples, como pontos ou caixas delimitadoras.

Com SAM, os utilizadores já não precisavam selecionar uma etiqueta. Bastava indicar onde um objeto estava e o modelo gerava uma máscara para ele. Isso tornou a segmentação mais flexível, mas os utilizadores ainda precisavam mostrar ao modelo onde procurar.

SAM , lançado em 2024, baseou-se nessa ideia para lidar com cenas mais complexas e estender a segmentação por prompt ao vídeo. Ele melhorou a robustez em diferentes condições de iluminação, formas de objetos e movimentos, continuando a depender principalmente de prompts visuais para orientar a segmentação.

O modelo SAM é o mais recente passo nessa evolução. Lançado no ano passado, é um modelo unificado que combina compreensão visual com orientação linguística, permitindo um comportamento consistente em tarefas de segmentação de imagens e vídeos.

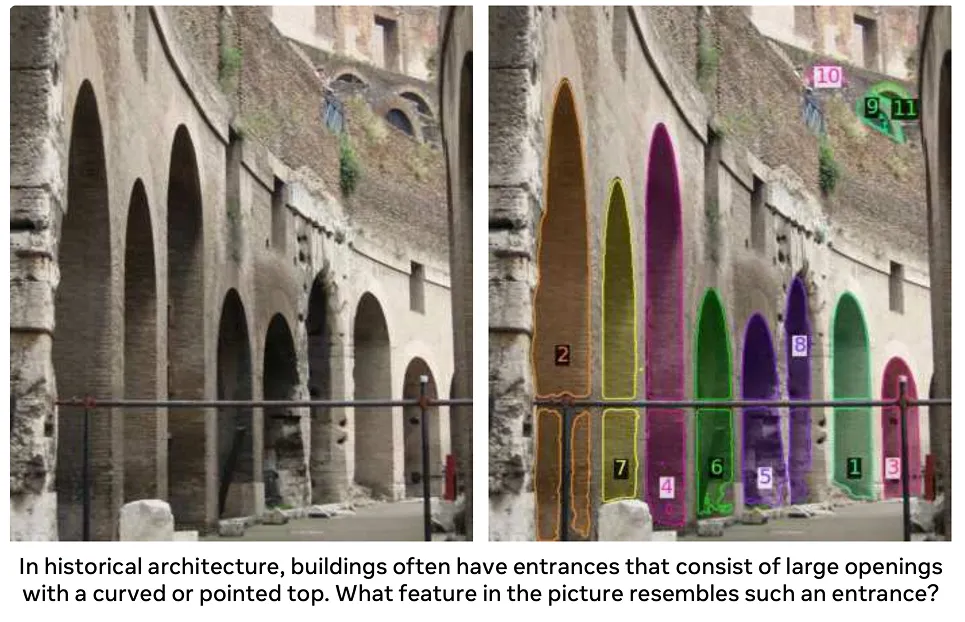

Com SAM , os utilizadores não estão limitados a apontar ou desenhar prompts. Em vez disso, podem descrever o que desejam segment texto, e o modelo pesquisa a imagem ou os fotogramas de vídeo em busca de regiões que correspondam a essa descrição.

A segmentação é orientada por conceitos, em vez de categorias de objetos fixas, apoiando o uso de vocabulário aberto em diferentes cenários e ao longo do tempo. Na verdade, SAM opera em um amplo espaço de conceitos aprendidos, baseado em uma ontologia derivada de fontes como o Wikidata e expandida por meio de dados de treinamento em grande escala.

Em comparação com as versões anteriores, que dependiam principalmente de prompts geométricos, SAM representa um passo em direção a uma segmentação mais flexível e orientada por conceitos. Isso o torna mais adequado para aplicações do mundo real, onde os objetos ou ideias de interesse podem mudar e nem sempre podem ser definidos com antecedência.

Então, como funciona a segmentação de conceitos promptáveis? Ela se baseia em grandes modelos pré-treinados de visão e linguagem visual, que são modelos treinados em coleções massivas de imagens e, em muitos casos, textos emparelhados. Esse treinamento permite que eles aprendam padrões visuais gerais e significado semântico.

A maioria dos modelos PCS usa arquiteturas baseadas em transformadores, que processam uma imagem inteira de uma só vez para entender como as diferentes regiões se relacionam entre si. Um transformador de visão extrai características visuais da imagem, enquanto um codificador de texto converte palavras em representações numéricas com as quais o modelo pode trabalhar.

Durante o treino, esses modelos podem aprender com diferentes tipos de supervisão, incluindo máscaras ao nível do pixel que definem os limites exatos dos objetos, caixas delimitadoras que localizam os objetos de forma aproximada e rótulos ao nível da imagem que descrevem o que aparece numa imagem. O treino com diferentes tipos de dados rotulados ajuda o modelo a capturar tanto detalhes finos quanto conceitos visuais mais amplos.

No momento da inferência, ou seja, quando o modelo é realmente usado para fazer previsões, o PCS segue um processo orientado por prompts. O utilizador fornece orientações por meio de descrições de texto, dicas visuais, como pontos ou caixas, ou imagens de exemplo. O modelo codifica tanto o prompt quanto a imagem em uma representação interna compartilhada ou embeddings e identifica regiões que se alinham com o conceito descrito.

Um descodificador de máscara converte essa representação partilhada em máscaras de segmentação precisas ao nível do pixel. Como o modelo associa características visuais a significados semânticos, ele pode segment conceitos, mesmo que eles não tenham sido explicitamente incluídos durante o treino.

Além disso, muitas vezes, o resultado pode ser refinado ajustando o prompt ou adicionando orientações adicionais, o que ajuda o modelo a lidar com cenas complexas ou ambíguas. Esse processo iterativo oferece suporte à otimização prática durante a implementação.

Os modelos de segmentação de conceitos promptáveis são normalmente avaliados com base na sua capacidade segment conceitos segment vistos e na robustez do seu desempenho em diferentes cenários. Os benchmarks concentram-se frequentemente na qualidade da máscara, generalização e eficiência computacional, refletindo os requisitos de implementação no mundo real.

A seguir, vamos ver onde a segmentação de conceitos promptáveis já está a ser utilizada e a começar a ter um impacto real.

A imagiologia médica envolve muitas estruturas biológicas, doenças e tipos de exames, e novos casos surgem todos os dias. Os modelos de segmentação tradicionais têm dificuldade em acompanhar essa variedade.

O PCS se encaixa naturalmente neste espaço porque permite que os médicos descrevam o que desejam encontrar, em vez de escolherem a partir de uma lista curta e rígida. Com frases de texto ou prompts visuais, o PCS pode ser usado para segment ou áreas de interesse diretamente, sem a necessidade de retreinar o modelo para cada nova tarefa. Isso facilita o tratamento de diversas necessidades clínicas, reduz a necessidade de desenhar máscaras manualmente e funciona em muitos tipos de imagens.

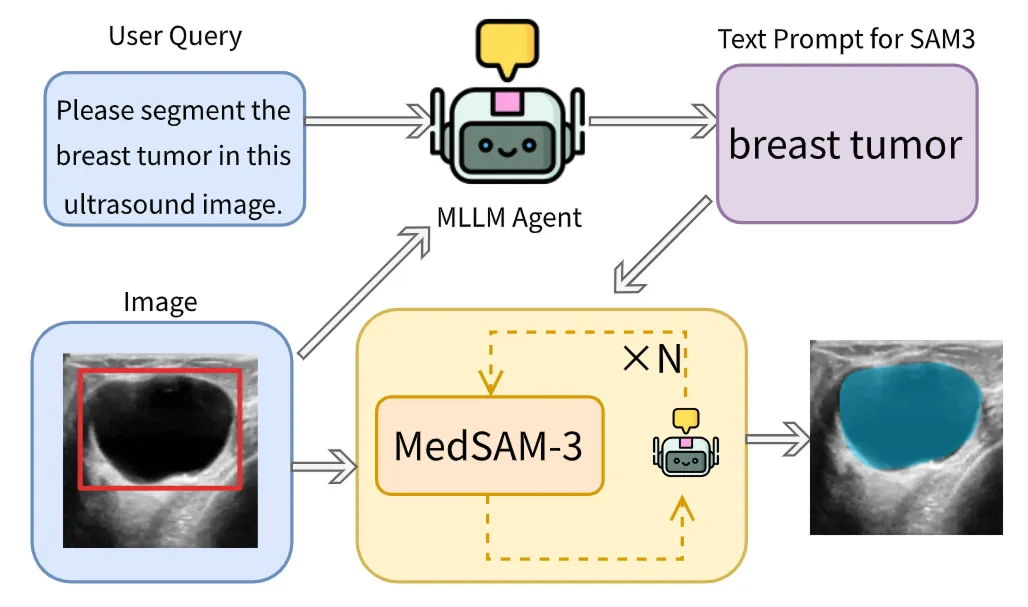

Um ótimo exemplo é o MedSAM-3, que adapta a arquitetura SAM para PCS com prompt de texto em imagens médicas. Este modelo pode ser acionado com termos anatómicos e patológicos explícitos, como nomes de órgãos, como fígado ou rim, e conceitos relacionados a lesões, como tumor ou lesão. Dado um prompt, o modelo segmenta diretamente a região correspondente na imagem médica.

O MedSAM-3 também integra modelos de linguagem multimodais de grande porte (MLLMs ou LLMs multimodais), que podem raciocinar tanto sobre textos quanto sobre imagens. Esses modelos operam em uma configuração de agente no circuito, na qual os resultados são refinados iterativamente para melhorar a precisão em casos mais desafiadores.

O MedSAM-3 tem um bom desempenho em dados de raios X, ressonância magnética, tomografia computadorizada, ultrassom e vídeo, destacando como o PCS pode permitir fluxos de trabalho de imagens médicas mais flexíveis e eficientes em ambientes clínicos reais.

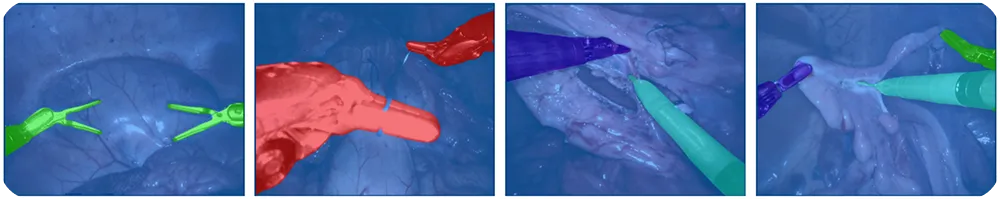

A cirurgia robótica depende de sistemas de visão para track e compreender cenários cirúrgicos em rápida mudança. Os instrumentos movem-se rapidamente, a iluminação varia e novos instrumentos podem aparecer a qualquer momento, o que torna difícil manter sistemas de etiquetagem predefinidos.

Com o PCS, os robôs podem track , orientar câmaras e acompanhar etapas cirúrgicas em tempo real. Isso reduz a necessidade de rotulagem manual e facilita a adaptação dos sistemas a diferentes procedimentos. Cirurgiões ou sistemas automatizados podem usar comandos de texto como «pinça», «bisturi» ou «ferramenta de câmara» para indicar o que deve ser segmentado numa imagem.

Outro modelo de última geração interessante relacionado à segmentação de conceitos promptáveis é o nosso Ultralytics . O nosso modelo traz segmentação de vocabulário aberto e orientada por prompts para a famíliaYOLO Ultralytics YOLO .

O YOLOE-26 é construído sobre a arquitetura Ultralytics e suporta segmentação de instâncias de vocabulário aberto. O YOLOE-26 permite que os utilizadores orientem a segmentação de várias maneiras.

Ele suporta prompts de texto, onde frases curtas e visualmente fundamentadas podem especificar o objeto alvo, bem como prompts visuais, que fornecem orientações adicionais com base em pistas de imagem. Além disso, o YOLOE-26 inclui um modo sem prompts para inferência zero-shot, onde o modelo detecta e segmenta objetos a partir de um vocabulário integrado, sem a necessidade de prompts do utilizador.

O YOLOE-26 é excelente para aplicações como análise de vídeo, perceção robótica e sistemas baseados em borda, onde as categorias de objetos podem mudar, mas a baixa latência e a taxa de transferência confiável continuam sendo essenciais. Ele também é especialmente útil para rotulagem de dados e curadoria de conjuntos de dados, pois simplifica os fluxos de trabalho ao automatizar partes do processo de anotação.

Aqui estão alguns dos principais benefícios de usar a segmentação de conceitos promptáveis:

Embora o PCS tenha vantagens claras, aqui estão algumas limitações a serem consideradas:

Ao explorar a segmentação promptable, poderá questionar-se sobre quais as aplicações para as quais ela é mais adequada e quando um modelo tradicional de visão computacional, como o YOLO26, é mais adequado para o problema que está a tentar resolver. A segmentação promptable funciona bem para objetos gerais, mas não é adequada para casos de uso que exigem resultados muito precisos e consistentes.

A deteção de defeitos é um bom exemplo. Na indústria transformadora, os defeitos são frequentemente minúsculos e subtis, tais como pequenos riscos, amolgadelas, desalinhamentos ou irregularidades na superfície. Também podem variar muito, dependendo dos materiais, da iluminação e das condições de produção.

Essas questões são difíceis de descrever com um prompt simples e ainda mais difíceis para um modelo de uso geral detect . No geral, os modelos baseados em prompts tendem a não detectar defeitos ou produzir resultados instáveis, enquanto os modelos treinados especificamente em dados de defeitos são muito mais confiáveis para sistemas de inspeção do mundo real.

A segmentação de conceitos promptable torna os sistemas de visão mais fáceis de se adaptar ao mundo real, onde novos objetos e ideias surgem o tempo todo. Em vez de ficarem presos a rótulos fixos, os utilizadores podem simplesmente descrever o que desejam segment deixar o modelo fazer o resto, o que economiza tempo e reduz o trabalho manual. Embora ainda tenha limitações, o PCS já está a mudar a forma como a segmentação é usada na prática e provavelmente se tornará uma parte essencial dos futuros sistemas de visão.

Explore mais sobre IA visitando o nosso repositório GitHub e juntando-se à nossa comunidade. Consulte as nossas páginas de soluções para saber mais sobre IA em robótica e visão computacional na indústria. Descubra as nossas opções de licenciamento para começar a usar o Vision AI hoje mesmo!

Comece sua jornada com o futuro do aprendizado de máquina