Пересмотрите ключевые моменты YOLO Vision 2025 Shenzhen, где Ultralytics собрала инноваторов, партнеров и сообщество ИИ на день вдохновения.

Пересмотрите ключевые моменты YOLO Vision 2025 Shenzhen, где Ultralytics собрала инноваторов, партнеров и сообщество ИИ на день вдохновения.

26 октября YOLO Vision 2025 (YV25) дебютировала в Китае в здании B10 в парке креативной культуры OCT в Шэньчжэне. Гибридное мероприятие Vision AI от Ultralyticsсобрало более 200 участников лично, а еще больше присоединились к мероприятию онлайн через YouTube и Bilibili.

Онлайн-трансляция YV25 Shenzhen уже набрала 3500 просмотров на YouTube и продолжает привлекать внимание, так как основными моментами мероприятия делится все сообщество. Это был день, наполненный идеями, разговорами и практическим изучением того, куда движется Vision AI в будущем.

День начался с теплого приветствия нашей ведущей Хуан Сюэин, которая пригласила всех желающих общаться, учиться и принимать участие в дискуссиях на протяжении всего мероприятия. Она объяснила, что это уже второй YOLO Vision в этом году, после лондонского мероприятия в сентябре, и поделилась тем, как интересно снова собрать сообщество Vision AI здесь, в Шэньчжэне.

В этой статье мы рассмотрим основные моменты этого дня, включая обновления моделей, выступления докладчиков, живые демонстрации и моменты, которые объединили всех. Давайте начнем!

Первым в этот день выступил основатель и генеральный директор Ultralytics Гленн Джочер, который рассказал о том, как моделиUltralytics YOLO из исследовательского прорыва превратились в одни из самых широко используемых моделей Vision AI в мире. Гленн рассказал, что в начале своей работы он стремился сделать YOLO проще в использовании.

Он портировал модели на PyTorch, улучшил документацию и поделился всем открыто, чтобы разработчики во всем мире могли строить на основе этого. Как он вспоминает, "в 2018 году я с головой окунулся в работу. Я решил, что здесь мое будущее". То, что начиналось как личная работа, быстро превратилось в глобальное движение с открытым исходным кодом.

Сегодня модели Ultralytics YOLO позволяют делать миллиарды выводов каждый день, и Гленн подчеркнул, что такой масштаб стал возможен только благодаря людям, которые помогли его создать. Исследователи, инженеры, студенты, любители и разработчики открытого кода со всего мира сформировали YOLO таким, каким он является сегодня.

Как сказал Гленн: "Их [спонсоров] почти тысяча, и мы очень благодарны им за это. Без этих людей нас бы здесь не было".

Первый взгляд на Ultralytics YOLO26 был представлен в начале этого года на мероприятии YOLO Vision 2025 в Лондоне, где он был представлен как следующий крупный шаг вперед в семействе моделей Ultralytics YOLO . На выставке YV25 в Шэньчжэне Гленн представил обновленную информацию о прогрессе, достигнутом с момента анонса, и дал возможность сообществу ИИ ближе познакомиться с тем, как развивалась эта модель.

YOLO26 разработан, чтобы стать меньше, быстрее и точнее, оставаясь при этом практичным для использования в реальном мире. Гленн объяснил, что команда провела последний год, дорабатывая архитектуру, сравнивая производительность на разных устройствах и учитывая результаты исследований и отзывы сообщества. Цель состоит в том, чтобы обеспечить современную производительность, не усложняя при этом развертывание моделей.

Одним из основных обновлений, на которых остановился Гленн, является то, что YOLO26 сочетается со специальной кампанией по настройке гиперпараметров, что позволяет перейти от обучения полностью с нуля к тонкой настройке на больших наборах данных. Он подчеркнул, что такой подход в большей степени соответствует реальным случаям использования.

Вот некоторые из других ключевых улучшений, о которых было рассказано на мероприятии:

Все эти обновления позволили создать модели, которые на 43% быстрее на CPU и при этом более точны, чем Ultralytics YOLO11что делает YOLO26 особенно полезным для встраиваемых устройств, робототехники и пограничных систем.

YOLO26 будет поддерживать все те же задачи и размеры моделей, которые сейчас доступны в YOLO11, в результате чего в семействе будет 25 вариантов моделей. Это модели для обнаружения, сегментации, оценки позы, ориентированных ограничительных блоков и классификации, начиная от нано и заканчивая сверхкрупными.

Команда также работает над пятью вариантами с подсказками. Это модели, которые могут принимать текстовый запрос и возвращать ограничительные рамки напрямую, без необходимости обучения.

Это первый шаг на пути к более гибким рабочим процессам технического зрения, основанным на инструкциях, которые легче адаптировать к различным условиям использования. Модели YOLO26 все еще находятся в стадии активной разработки, но первые результаты производительности очень высоки, и команда работает над тем, чтобы выпустить их в ближайшее время.

После обновления YOLO26 Гленн поприветствовал Пратека Бхатнагара, руководителя отдела разработки продуктов, который провел живую демонстрацию платформы Ultralytics . Эта платформа создается для объединения ключевых частей рабочего процесса компьютерного зрения, включая изучение наборов данных, аннотирование изображений, обучение моделей и сравнение результатов.

Пратик отметил, что платформа остается верной корням Ultralyticsс открытым исходным кодом, представляя два сообщества, сообщество наборов данных и сообщество проектов, где разработчики могут вносить свой вклад, повторно использовать и улучшать работу друг друга. В ходе демонстрации он показал аннотирование с помощью ИИ, простое облачное обучение и возможность точной настройки моделей непосредственно в сообществе, без использования локальных ресурсов GPU .

В настоящее время платформа находится в стадии разработки. Пратик призвал аудиторию следить за анонсами и отметил, что команда в Китае растет, чтобы поддержать запуск.

Набрав обороты, мероприятие перешло в панельную дискуссию с участием нескольких исследователей, стоящих за различными моделями YOLO . В дискуссии приняли участие Гленн Джочер, а также Цзин Цю, наш старший инженер по машинному обучению; Чэнь Хуэй, инженер по машинному обучению в Meta и один из авторов YOLOv10; и Бо Чжан, стратег по алгоритмам в Meituan и один из авторов YOLOv6.

Обсуждение было посвящено тому, как YOLO продолжает развиваться благодаря реальному использованию. Докладчики затронули вопрос о том, что прогресс часто определяется практическими проблемами развертывания, такими как эффективная работа на граничных устройствах, улучшение обнаружения мелких объектов и упрощение экспорта моделей.

Вместо того чтобы гнаться только за точностью, участники дискуссии отметили важность баланса между скоростью, удобством и надежностью в производственных средах. Еще одним общим выводом стала ценность итераций и обратной связи с сообществом.

Вот еще несколько интересных моментов из беседы:

Далее мы рассмотрим некоторые из ключевых докладов YV25 Shenzhen, в которых лидеры ИИ-сообщества рассказали о том, как развивается концептуальный ИИ: от цифровых людей и робототехники до мультимодальных рассуждений и эффективного развертывания границ.

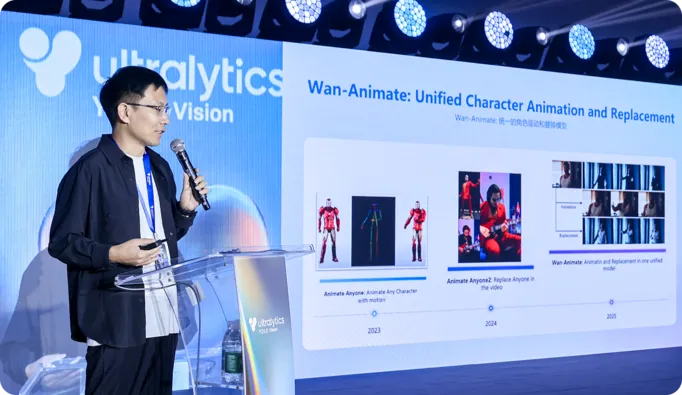

В ходе содержательной сессии доктор Пэн Чжан из лаборатории Alibaba Qwen Lab рассказал о том, как его команда разрабатывает большие видеомодели, позволяющие генерировать выразительных цифровых людей с более естественными движениями и управлением. Он рассказал о программах Wan S2V и Wan Animate, которые используют аудио- или моушн-референсы для создания реалистичной речи, жестов и анимации, устраняя ограничения чисто текстовой генерации.

Доктор Чжан также рассказал о прогрессе, достигнутом в создании интерактивных аватаров в реальном времени, включая клонирование внешности и движений с нулевого снимка и легкие модели, которые могут анимировать лицо прямо с камеры в реальном времени, приближая реалистичных цифровых людей к бесперебойной работе на повседневных устройствах.

Одной из ключевых тем YV25 Shenzhen стал переход от моделей зрения, которые просто видят мир, к системам, которые могут действовать в нем. Другими словами, восприятие больше не является концом конвейера; оно становится началом действия.

Например, в своем выступлении Ху Чуньсю из D-Robotics рассказал о том, как их наборы для разработки и решения SoC (система на кристалле) объединяют сенсорное восприятие, управление движением в реальном времени и принятие решений в едином программно-аппаратном стеке. Рассматривая восприятие и действие как непрерывный цикл обратной связи, а не как отдельные этапы, они поддерживают роботов, которые могут двигаться, адаптироваться и взаимодействовать в реальных условиях более надежно.

Алекс Чжан из Baidu Paddle поддержал эту идею в своем выступлении, рассказав, как YOLO и PaddleOCR работают вместе, detect объекты, а затем интерпретируя текст и структуру вокруг них. Это позволяет системам преобразовывать изображения и документы в полезную, структурированную информацию для таких задач, как логистика, инспекции и автоматическая обработка.

Еще одной интересной темой на YV25 Shenzhen стало то, как искусственный интеллект Vision AI становится все более эффективным и способным на граничных устройствах.

Пол Юнг из компании DEEPX рассказал о развертывании моделей YOLO непосредственно на встроенном оборудовании, что позволяет снизить зависимость от облачных вычислений. Уделяя особое внимание низкому энергопотреблению, оптимизированным выводам и настройке моделей с учетом аппаратного обеспечения, DEEPX обеспечивает восприятие в реальном времени для беспилотников, мобильных роботов и промышленных систем, работающих в динамичных средах.

Кроме того, Лю Лингфей из компании Moore Threads рассказал о том, как платформа Moore Threads E300 объединяет центральный процессорCPU), графический процессорGPU) и блок нейронной обработки (NPU) для обеспечения высокоскоростных вычислений в области зрения на компактных устройствах.

Платформа может обрабатывать несколько потоков YOLO с высокой частотой кадров, а ее инструментарий упрощает такие этапы, как квантование, статическая компиляция и настройка производительности. Компания Moore Threads также выложила в открытый доступ широкий набор моделей компьютерного зрения и примеров развертывания, чтобы снизить барьер для разработчиков.

До недавнего времени для создания единой модели, способной одновременно понимать изображения и интерпретировать язык, требовались большие архитектуры трансформаторов, которые были дороги в исполнении. На выставке YV25 в Шэньчжэне Юэ Цзыинь из Yuanshi Intelligence представил обзор RWKV - архитектуры, сочетающей в себе способности трансформаторов к рассуждениям в длинном контексте и эффективность рекуррентных моделей.

Он объяснил, как Vision-RWKV применяет эту разработку для компьютерного зрения, обрабатывая изображения линейно с увеличением разрешения. Это делает его подходящим для ввода данных с высоким разрешением и для краевых устройств, где вычисления ограничены.

Юэ также показал, как RWKV используется в системах "зрение-язык", где особенности изображения сочетаются с пониманием текста, что позволяет выйти за рамки обнаружения объектов и интерпретировать сцены, документы и реальный контекст.

В то время как докладчики на сцене говорили о перспективах развития искусственного интеллекта, стенды на полу показывали, как он используется уже сегодня. Посетители смогли увидеть работающие модели, сравнить варианты аппаратного обеспечения и напрямую пообщаться с командами, создающими эти системы.

Вот взгляд на представленные технологии:

Помимо захватывающих технологий, одним из лучших моментов YV25 Shenzhen было то, что сообщество специалистов по компьютерному зрению и команда Ultralytics снова собрались вместе. В течение всего дня люди собирались у демонстрационных стендов, делились идеями во время кофе-брейков и продолжали беседовать еще долго после окончания выступлений.

Исследователи, инженеры, студенты и строители сравнивали записи, задавали вопросы и обменивались реальным опытом - от развертывания до тренировки моделей. А благодаря Cinco Jotas от Grupo Osborne мы даже привнесли в мероприятие нотку испанской культуры, угостив его свежим хамоном, создав теплый момент единения. Прекрасное место проведения, восторженная публика и общее ощущение динамики сделали этот день по-настоящему особенным.

От вдохновляющих ключевых докладов до практических демонстраций, YOLO Vision 2025 Shenzhen передал дух инноваций, определяющий сообщество Ultralytics . В течение всего дня докладчики и участники обменивались идеями, изучали новые технологии и объединялись общим видением будущего ИИ. Все вместе они ушли воодушевленными и готовыми к новым свершениям вместе с Ultralytics YOLO.

Вообразите, что возможно с помощью искусственного интеллекта и компьютерного зрения. Присоединяйтесь к нашему сообществу и репозиторию GitHub, чтобы узнать больше. Узнайте больше о таких областях применения, как компьютерное зрение в сельском хозяйстве и ИИ в розничной торговле. Изучите наши варианты лицензирования и начните работать с компьютерным зрением уже сегодня!

Начните свой путь в будущее машинного обучения