Узнайте, как работает оценка позы, каковы ее реальные применения и как модели, подобные Ultralytics YOLO11 , позволяют машинам интерпретировать движение тела и позу.

Узнайте, как работает оценка позы, каковы ее реальные применения и как модели, подобные Ultralytics YOLO11 , позволяют машинам интерпретировать движение тела и позу.

Когда вы видите кого-то сутулого или стоящего прямо с отведенными назад плечами, сразу становится ясно, плохая у него осанка или уверенная. Никому не нужно вам это объяснять. Это потому, что со временем мы естественным образом научились интерпретировать язык тела.

Благодаря опыту и наблюдениям наш мозг научился очень хорошо распознавать позы различных объектов, включая людей. Благодаря последним достижениям в области искусственного интеллекта (ИИ) и компьютерного зрения, области, которая позволяет машинам интерпретировать визуальную информацию из мира, машины теперь также начинают учиться и воспроизводить эту способность.

Оценка позы — это задача компьютерного зрения, которая помогает машинам определять положение и ориентацию человека или объекта, глядя на изображения или видео. Это делается путем определения ключевых точек на теле, таких как суставы и конечности, чтобы понять, как кто-то или даже что-то движется.

Эта технология находит широкое применение в таких областях, как фитнес, здравоохранение и анимация. Например, на рабочем месте она может использоваться для контроля осанки сотрудников и поддержки инициатив по безопасности и оздоровлению. Модели компьютерного зрения, такие как Ultralytics YOLO11 позволяют оценить позу человека в режиме реального времени.

В этой статье мы более подробно рассмотрим оценку позы и то, как она работает, а также реальные примеры использования, где она играет важную роль. Давайте начнем!

Исследования в области оценки позы начались еще в конце 1960-х и 70-х годов. С годами подходы к этой задаче компьютерного зрения сместились от базовой математики и геометрии к более продвинутым методам, основанным на искусственном интеллекте.

Изначально методы зависели от фиксированных углов камеры и известных опорных точек. Позже они стали включать в себя 3D-модели и сопоставление характеристик. Сегодня модели глубокого обучения, такие как YOLO11 , могут detect положение тела в реальном времени по изображениям или видео, что делает оценку позы более быстрой и точной, чем когда-либо прежде.

По мере совершенствования технологий исследователи увидели потенциальную пользу от возможности контролировать и track позы различных объектов, особенно людей и животных. Оценка позы особенно важна, поскольку позволяет инструментам искусственного интеллекта понимать и измерять позу и движения таким образом, который раньше был невозможен.

Например, это позволяет компьютерам распознавать жесты для взаимодействия без помощи рук, анализирует движения спортсменов для улучшения результатов, обеспечивает реалистичную анимацию в видеоиграх и даже поддерживает здравоохранение, отслеживая прогресс выздоровления пациентов.

Оценка позы отличается от других задач компьютерного зрения, таких как обнаружение объектов и сегментация экземпляров. Эти задачи в основном сосредоточены на идентификации и локализации объектов на изображении.

Обнаружение объектов, например, рисует ограничивающие рамки вокруг таких элементов, как люди, транспортные средства или животные, чтобы указать на их присутствие и положение. Сегментация экземпляров идет еще дальше, очерчивая точную форму каждого объекта на уровне пикселей.

Однако, оба этих метода в основном касаются того, что это за объект и где он находится - они не предоставляют никакой информации о том, как объект расположен или что он может делать. Именно здесь оценка позы становится решающей.

Определяя ключевые точки на теле, такие как локти, колени или даже хвост, оценка позы может интерпретировать осанку и движение. Это позволяет глубже понять действия, жесты и динамику тела, включая движение в 3D-пространстве.

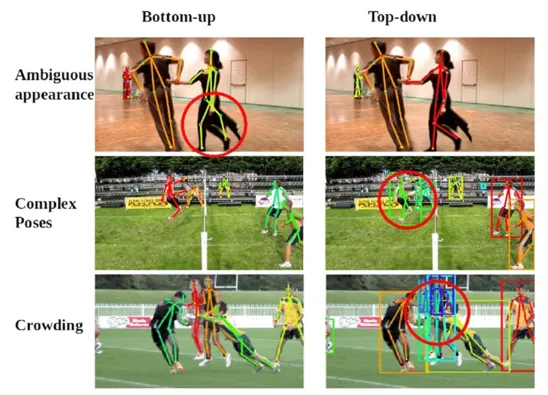

Модели оценки позы обычно следуют двум основным подходам: восходящему и нисходящему. В восходящем подходе модель сначала обнаруживает отдельные ключевые точки, такие как локти, колени или плечи, а затем группирует их, чтобы выяснить, к какому человеку или объекту они принадлежат. В отличие от этого, нисходящий подход начинается с обнаружения каждого объекта (например, человека на изображении), а затем определяет ключевые точки для этого конкретного объекта.

Некоторые новые модели, такие как YOLO11, сочетают в себе преимущества обоих подходов. Он сохраняет эффективность метода "снизу вверх", пропуская этап ручной группировки, и в то же время использует точность систем "сверху вниз", обнаруживая людей и оценивая их позу сразу - в едином, оптимизированном процессе.

По мере того, как мы рассматриваем, как работают модели оценки позы, вам может быть интересно: как эти модели на самом деле учатся оценивать позу различных объектов? Именно здесь вступает в игру идея пользовательского обучения.

Индивидуальное обучение - это обучение модели распознаванию определенных ключевых точек на основе ваших собственных данных. Поскольку создание модели с нуля требует большого количества помеченных изображений и значительного времени, многие выбирают трансферное обучение. Это предполагает использование модели, уже обученной на большом наборе данных, например модели оценки позы YOLO11 , которая была предварительно обучена на наборе данныхCOCO, а затем ее тонкую настройку на собственных данных для конкретной задачи или случая использования.

Допустим, вы работаете с позами йоги - вы можете точно настроить YOLO11 , используя изображения, на которых каждая поза помечена ключевыми моментами, характерными для данного вида деятельности. Для этого вам понадобится пользовательский набор аннотированных изображений, на которых модель сможет обучаться.

Во время обучения вы можете настроить такие параметры, как размер пакета (количество обрабатываемых одновременно изображений), скорость обучения (как быстро модель обновляет свое обучение) и эпохи (сколько раз модель проходит через набор данных), чтобы повысить точность. Это значительно упрощает создание моделей оценки позы, адаптированных к вашим конкретным потребностям.

Теперь, когда мы обсудили, что такое оценка позы и как она работает, давайте подробнее рассмотрим некоторые реальные примеры ее использования.

Оценка позы постепенно становится надежным инструментом в сфере здравоохранения, особенно в физиотерапии. Используя искусственный интеллект и компьютерное зрение, эти системы могут track позу и движения в режиме реального времени и предоставлять обратную связь, аналогичную той, что предлагает физиотерапевт.

Например, пациент, восстанавливающийся после операции на колене, может использовать систему оценки позы, чтобы убедиться, что он правильно выполняет реабилитационные упражнения. Система может заметить любые неправильные движения и предложить предложения по их улучшению, помогая пациенту не сбиться с track и избежать травм.

Помимо реабилитации, оценка позы также проникает в фитнес-приложения. Например, человек, занимающийся спортом дома, может использовать приложение для проверки своей формы во время упражнений. Приложение может давать обратную связь в режиме реального времени, например, регулировать угол приседаний или следить за тем, чтобы спина была прямой во время становой тяги. Это помогает пользователям улучшить свою форму и предотвратить травмы без необходимости в тренере.

Оценка позы изменила способ работы захвата движения в индустрии развлечений, сделав его проще и доступнее. В прошлом захват движения требовал размещения маркеров на теле человека и отслеживания их с помощью специальных камер, что могло быть сложным и дорогостоящим.

Теперь, благодаря достижениям в области искусственного интеллекта и компьютерного зрения, мы можем использовать обычные камеры и алгоритмы для track движений тела без использования маркеров, что делает процесс более эффективным и точным, даже в режиме реального времени.

Отличным примером этого является Disney's AR (Augmented Reality) Poser. Этот забавный инструмент позволяет вам сделать фотографию с помощью телефона и получить цифрового персонажа, копирующего вашу позу в дополненной реальности. Он работает, анализируя вашу позу на картинке и сопоставляя ее с 3D-персонажем, создавая забавное персонализированное AR-селфи.

Изучение поведения животных помогает ученым понять, как животные общаются, находят партнеров, заботятся о своем потомстве и живут в группах. Эти знания жизненно важны для защиты дикой природы и углубления понимания мира природы.

Оценка позы упрощает этот процесс, отслеживая движения и осанку животных с помощью изображений и видео, без прикрепления датчиков или меток к животным. Эти системы могут автоматически отслеживать их позы, предоставляя информацию о таких моделях поведения, как уход за собой, игры или драки.

Интересный пример - ученые используют оценку позы для изучения поведения обезьян. Исследователи собрали такие наборы данных, как OpenApePose, который содержит более 71 000 помеченных изображений шести видов обезьян.

Вот некоторые из ключевых преимуществ, которые оценка позы может привнести в различные отрасли:

Хотя преимущества оценки позы очевидны в различных областях, есть также некоторые проблемы, которые следует учитывать. Вот несколько ключевых ограничений, о которых следует помнить:

Оценка позы прошла долгий путь с первых дней своего существования, превратившись из систем, использующих маркеры, в эффективные инструменты, основанные на моделях глубокого обучения, таких как YOLO11. Будь то улучшение физиотерапии, использование интерактивных AR-технологий или помощь в исследовании дикой природы, оценка позы меняет представление машин о движении и осанке. По мере развития технологии устранение ее ограничений станет ключом к открытию еще большего числа практических применений и улучшению понимания машинами того, как двигаемся мы и другие живые существа.

Интересуетесь ИИ? Изучите наш репозиторий GitHub, присоединяйтесь к нашему сообществу и ознакомьтесь с нашими вариантами лицензирования, чтобы дать старт своему проекту в области компьютерного зрения. Узнайте больше об инновациях, таких как ИИ в розничной торговле и компьютерное зрение в логистике, на страницах наших решений.

Начните свой путь в будущее машинного обучения