Aprenda cómo funciona la estimación de la postura, sus aplicaciones en el mundo real y cómo modelos como Ultralytics YOLO11 permiten a las máquinas interpretar el movimiento y la postura del cuerpo.

Aprenda cómo funciona la estimación de la postura, sus aplicaciones en el mundo real y cómo modelos como Ultralytics YOLO11 permiten a las máquinas interpretar el movimiento y la postura del cuerpo.

Cuando ves a alguien encorvado o de pie con los hombros hacia atrás, está inmediatamente claro si tiene una postura mala o segura. Nadie necesita explicártelo. Esto se debe a que, con el tiempo, hemos aprendido de forma natural a interpretar el lenguaje corporal.

A través de la experiencia y la observación, nuestros cerebros se han vuelto muy buenos en el reconocimiento de la postura de varios objetos, incluidos los humanos. Gracias a los recientes avances en inteligencia artificial (IA) y visión artificial, un campo que permite a las máquinas interpretar la información visual del mundo, las máquinas ahora están comenzando a aprender y replicar esta capacidad también.

La estimación de pose es una tarea de visión artificial que ayuda a las máquinas a determinar la posición y la orientación de una persona u objeto observando imágenes o vídeos. Lo hace identificando puntos clave en el cuerpo, como articulaciones y extremidades, para comprender cómo se mueve alguien, o incluso algo.

Esta tecnología se está utilizando ampliamente en campos como el fitness, la sanidad y la animación. En entornos laborales, por ejemplo, puede utilizarse para controlar la postura de los empleados y apoyar iniciativas de seguridad y bienestar. Modelos de visión por ordenador como Ultralytics YOLO11 lo hacen posible estimando las posturas humanas en tiempo real.

En este artículo, analizaremos más de cerca la estimación de la pose y cómo funciona, junto con los casos de uso en el mundo real donde está marcando la diferencia. ¡Empecemos!

La investigación sobre la estimación de la pose comenzó a finales de los años 60 y 70. A lo largo de los años, los enfoques para esta tarea de visión artificial han pasado de las matemáticas básicas y la geometría a métodos más avanzados impulsados por la inteligencia artificial.

Al principio, las técnicas dependían de ángulos de cámara fijos y puntos de referencia conocidos. Más tarde, evolucionaron para incluir modelos 3D y coincidencia de características. Hoy en día, los modelos de aprendizaje profundo como YOLO11 pueden detect posiciones corporales en tiempo real a partir de imágenes o vídeos, lo que hace que la estimación de la pose sea más rápida y precisa que nunca.

A medida que mejoraba la tecnología, los investigadores vieron las aplicaciones potenciales de poder controlar y track las posturas de diversos objetos, especialmente humanos y animales. La estimación de la postura es especialmente importante porque permite a las herramientas de IA comprender y medir la postura y el movimiento de formas que antes no eran posibles.

Por ejemplo, permite a los ordenadores reconocer gestos para la interacción manos libres, analiza los movimientos de los atletas para mejorar el rendimiento, potencia animaciones realistas en videojuegos e incluso apoya la atención médica mediante el seguimiento del progreso de recuperación de los pacientes.

La estimación de pose es diferente de otras tareas de visión artificial como la detección de objetos y la segmentación de instancias. Estas tareas se centran principalmente en identificar y localizar objetos dentro de una imagen.

La detección de objetos, por ejemplo, dibuja cuadros delimitadores alrededor de elementos como personas, vehículos o animales para indicar su presencia y posición. La segmentación de instancias lleva esto un paso más allá al delinear la forma precisa de cada objeto a nivel de píxel.

Sin embargo, ambos métodos se centran principalmente en qué es el objeto y dónde está; no proporcionan ninguna información sobre cómo está posicionado el objeto o qué podría estar haciendo. Ahí es donde la estimación de la pose se vuelve crucial.

Al identificar puntos clave en el cuerpo, como codos, rodillas o incluso una cola, la estimación de la pose puede interpretar la postura y el movimiento. Esto permite una comprensión más profunda de las acciones, los gestos y la dinámica corporal, incluido el movimiento en el espacio 3D.

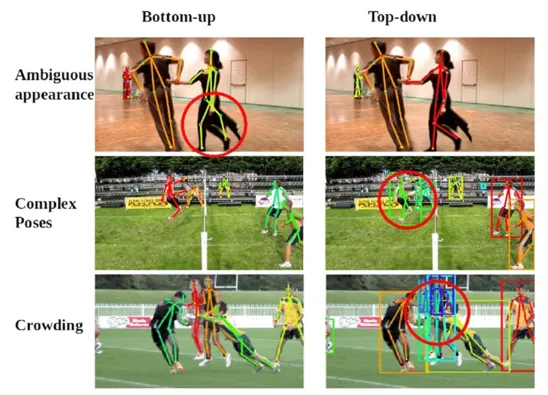

Los modelos de estimación de pose generalmente siguen dos enfoques principales: ascendente (bottom-up) y descendente (top-down). En el enfoque ascendente, el modelo primero detecta puntos clave individuales, como codos, rodillas u hombros, y luego los agrupa para determinar a qué persona u objeto pertenecen. En contraste, el enfoque descendente comienza detectando cada objeto primero (como una persona en la imagen) y luego localiza los puntos clave para ese objeto específico.

Algunos modelos más recientes, como YOLO11, combinan las ventajas de ambos enfoques. Mantiene la eficiencia del método ascendente al omitir el paso de agrupación manual, al tiempo que aprovecha la precisión de los sistemas descendentes al detectar a las personas y estimar sus poses a la vez, en un único proceso racionalizado.

A medida que explicamos cómo funcionan los modelos de estimación de pose, puede que se pregunte: ¿cómo aprenden realmente estos modelos a estimar la pose de diferentes objetos? Ahí es donde entra en juego la idea del entrenamiento personalizado.

El entrenamiento personalizado consiste en enseñar a un modelo a reconocer puntos clave específicos utilizando sus propios datos. Dado que construir un modelo desde cero requiere una gran cantidad de imágenes etiquetadas y mucho tiempo, muchas personas optan por el aprendizaje por transferencia. Esto implica comenzar con un modelo que ya ha sido entrenado en un gran conjunto de datos, como el modelo de estimación de pose YOLO11 , que está preentrenado en el conjunto de datosCOCO, y luego ajustarlo con tus propios datos para una tarea o caso de uso específico.

Digamos que trabajas con posturas de yoga: puedes perfeccionar YOLO11 utilizando imágenes en las que cada postura esté etiquetada con puntos clave específicos de esa actividad. Para ello, necesitarás un conjunto de datos personalizado con imágenes anotadas de las que el modelo pueda aprender.

Durante el entrenamiento, puede ajustar parámetros como el tamaño del lote (el número de imágenes procesadas a la vez), la tasa de aprendizaje (la rapidez con la que el modelo actualiza su aprendizaje) y las épocas (el número de veces que el modelo recorre el conjunto de datos) para mejorar la precisión. Esto facilita la creación de modelos de estimación de poses adaptados a sus necesidades específicas.

Ahora que hemos analizado qué es la estimación de pose y cómo funciona, analicemos más de cerca algunos de sus casos de uso en el mundo real.

La estimación de la postura se está convirtiendo poco a poco en una herramienta fiable en el sector sanitario, especialmente en fisioterapia. Gracias a la inteligencia artificial y la visión por ordenador, estos sistemas pueden track la postura y los movimientos en tiempo real y proporcionar información similar a la que ofrecería un fisioterapeuta.

Por ejemplo, un paciente que se recupera de una operación de rodilla puede utilizar un sistema de estimación de posturas para asegurarse de que está haciendo correctamente sus ejercicios de rehabilitación. El sistema puede detectar cualquier movimiento incorrecto y ofrecer sugerencias para mejorarlo, ayudando al paciente a mantener el track y evitar lesiones.

Más allá de la rehabilitación, la estimación de la pose también se está abriendo camino en las aplicaciones de fitness. Por ejemplo, alguien que se ejercita en casa puede usar la aplicación para verificar su forma durante los ejercicios. La aplicación puede dar retroalimentación en tiempo real, como ajustar el ángulo de una sentadilla o asegurarse de que su espalda esté recta durante un peso muerto. Esto ayuda a los usuarios a mejorar su forma y prevenir lesiones sin necesidad de un entrenador.

La estimación de la pose ha cambiado la forma en que funciona la captura de movimiento en el entretenimiento, haciéndola más sencilla y accesible. En el pasado, la captura de movimiento requería colocar marcadores en el cuerpo de una persona y rastrearlos con cámaras especiales, lo que podía ser complicado y costoso.

Ahora, con los avances en IA y visión por ordenador, podemos utilizar cámaras normales y algoritmos para track movimientos del cuerpo sin necesidad de marcadores, lo que hace que el proceso sea más eficaz y preciso, incluso en tiempo real.

Un gran ejemplo de esto es AR (Realidad Aumentada) Poser de Disney. Esta divertida herramienta te permite tomar una foto con tu teléfono y hacer que un personaje digital copie tu pose en realidad aumentada. Funciona analizando tu pose en la imagen y haciéndola coincidir con un personaje 3D, creando un selfie AR divertido y personalizado.

Estudiar el comportamiento animal ayuda a los científicos a comprender cómo se comunican los animales, cómo encuentran pareja, cómo cuidan a sus crías y cómo viven en grupo. Este conocimiento es vital para proteger la vida silvestre y obtener una comprensión más profunda del mundo natural.

La estimación de pose simplifica este proceso mediante el seguimiento de los movimientos de los animales y la postura utilizando imágenes y vídeos, sin necesidad de colocar sensores o etiquetas a los animales. Estos sistemas pueden supervisar automáticamente sus poses, proporcionando información sobre comportamientos como el aseo, el juego o la lucha.

Un ejemplo interesante es el de los científicos que utilizan la estimación de poses para estudiar el comportamiento de los simios. De hecho, los investigadores han recopilado conjuntos de datos como OpenApePose, que contiene más de 71.000 imágenes etiquetadas de seis especies de simios.

Estos son algunos de los principales beneficios que la estimación de la pose puede aportar a diversas industrias:

Si bien las ventajas de la estimación de la pose son claras en varios campos, también hay algunos desafíos a tener en cuenta. Estas son algunas de las limitaciones clave que hay que tener en cuenta:

La estimación de la postura ha recorrido un largo camino desde sus inicios, evolucionando desde sistemas que utilizaban marcadores hasta herramientas impactantes impulsadas por modelos de aprendizaje profundo como YOLO11. Ya sea para mejorar la fisioterapia, impulsar experiencias interactivas de realidad aumentada o ayudar en la investigación de la vida salvaje, la estimación de la postura está cambiando la forma en que las máquinas entienden el movimiento y la postura. A medida que la tecnología sigue avanzando, abordar sus limitaciones será clave para desbloquear usos aún más prácticos y hacer que las máquinas comprendan mejor cómo nos movemos nosotros y otros seres vivos.

¿Tiene curiosidad por la IA? Explore nuestro repositorio de GitHub, conéctese con nuestra comunidad y consulte nuestras opciones de licencia para impulsar su proyecto de visión artificial. Obtenga más información sobre innovaciones como la IA en el comercio minorista y la visión artificial en la industria de la logística en nuestras páginas de soluciones.

Comience su viaje con el futuro del aprendizaje automático