Únete a nosotros mientras analizamos más de cerca qué es la segmentación de instancias, cómo funciona, su uso en diversas aplicaciones de visión artificial y el impacto que puede tener.

Únete a nosotros mientras analizamos más de cerca qué es la segmentación de instancias, cómo funciona, su uso en diversas aplicaciones de visión artificial y el impacto que puede tener.

Las aplicaciones de visión artificial son cada vez más comunes en nuestra vida diaria, desde las cámaras de tráfico que monitorean las condiciones de las carreteras hasta los sistemas de autopago en las tiendas. Al permitir que las máquinas comprendan los datos visuales de una manera similar a los humanos, la IA de visión está teniendo un impacto en una variedad de industrias.

Muchas de estas aplicaciones se basan en la detección de objetos, una tarea de visión artificial que coloca cuadros delimitadores alrededor de los objetos clave en las imágenes. Si bien este enfoque a menudo funciona bien, algunas soluciones de análisis de imágenes necesitan aún mayor precisión.

Por ejemplo, las imágenes médicas requieren algo más que la detección de un tumor: es crucial delinear su forma exacta. Del mismo modo, en robótica, las máquinas necesitan reconocer los contornos exactos de un objeto para agarrarlo correctamente. Para abordar estos desafíos, la segmentación de instancias ofrece una solución más precisa.

La segmentación de instancias es una tarea de visión por ordenador diseñada para dar soporte a casos de uso en los que detectar objetos no es suficiente: proporciona precisión a nivel de píxel. Los modelos de visión por ordenador como Ultralytics YOLO11 pueden utilizarse para aplicar fácilmente la segmentación de instancias a imágenes y vídeos.

En esta guía, explicaremos cómo funciona la segmentación de instancias, sus aplicaciones y cómo Ultralytics YOLO11 puede personalizarse para tareas de segmentación específicas.

Digamos que hay una foto de grupo de personas de pie muy juntas. La detección de objetos puede ayudar a dibujar cuadros alrededor de cada persona, pero eso no indica su forma exacta.

La segmentación de instancias, por otro lado, es similar a trazar cuidadosamente el contorno de cada persona para que pueda ver su silueta completa, incluso si se superponen. En lugar de simplemente marcar dónde está algo con un cuadro, identifica la forma exacta de cada objeto a nivel de píxel, lo que facilita la comprensión de imágenes complejas.

El resultado es una máscara detallada que rellena la forma de un objeto, señalando exactamente qué píxeles le pertenecen. Este nivel de precisión es útil en muchas aplicaciones del mundo real donde es importante comprender la forma y los límites exactos de los objetos.

Mientras exploras la segmentación de instancias, es posible que te encuentres con el concepto de segmentación semántica.

Ambas técnicas ayudan a las computadoras a entender las imágenes a nivel de píxel, pero tienen propósitos diferentes. La segmentación semántica etiqueta cada píxel según su categoría, agrupando todos los objetos del mismo tipo. Por ejemplo, en una imagen con varios coches, la segmentación semántica los marcaría a todos como "coche" sin distinguir entre vehículos individuales.

La segmentación de instancias, por otro lado, va un paso más allá al identificar cada objeto por separado. Asigna etiquetas únicas a instancias individuales y crea máscaras precisas alrededor de sus formas. Entonces, en la misma imagen, la segmentación de instancias no solo etiquetaría todo como "coche", sino que reconocería y delineararía cada coche individualmente.

La principal diferencia entre los dos es que la segmentación semántica agrupa los objetos por categoría, mientras que la segmentación de instancias distingue cada objeto como una entidad única con límites claros. La elección de la tarea a utilizar depende de la aplicación específica: si es suficiente saber qué hay en una imagen o si es importante diferenciar entre objetos individuales.

Hoy en día, existen varios modelos de segmentación de instancias disponibles para la comunidad de Vision AI. Algunos son más rápidos, otros más precisos y otros más fáciles de usar.

Estas opciones, aunque útiles, pueden llevar a preguntarse cuál es la correcta para una tarea concreta. Entre las opciones, los modelosYOLO Ultralytics son bastante populares porque se centran en la velocidad y la precisión.

Además, estos modelos han evolucionado mucho a lo largo de los años. Por ejemplo, Ultralytics YOLOv5 simplificó el despliegue utilizando marcos de trabajo como PyTorch, haciendo que la IA de visión avanzada fuera accesible a un público más amplio sin necesidad de profundos conocimientos técnicos.

Aprovechando ese éxito, Ultralytics YOLOv8 ha introducido mejoras en tareas de visión por ordenador como la segmentación de instancias, la estimación de poses y la clasificación de imágenes.

Ahora, YOLO11 lleva el rendimiento a un nuevo nivel. Alcanza una mayor precisión mediamAP) en el conjunto de datos COCO con un 22 % menos de parámetros que YOLOv8m, lo que significa que puede reconocer objetos con mayor precisión utilizando menos recursos.

En pocas palabras, YOLO11 ofrece una precisión de vanguardia sin comprometer la eficacia, lo que lo convierte en una herramienta revolucionaria sobre el terreno.

A continuación, exploremos cómo funciona normalmente la segmentación de instancias. Los modelos de visión artificial más antiguos utilizan un enfoque de dos pasos.

En primer lugar, detect los objetos dibujando recuadros a su alrededor. A continuación, generan una máscara a nivel de píxel para delinear la forma exacta de cada objeto. Un ejemplo muy conocido es Mask R-CNN, que se basa en modelos de detección de objetos añadiendo un paso de predicción de máscaras. Aunque este método es eficaz, puede ser lento porque procesa la imagen en varias etapas, lo que dificulta las aplicaciones en tiempo real.

Mientras tanto, modelos como YOLO11 procesan las imágenes de una sola vez, prediciendo simultáneamente los cuadros delimitadores de los objetos y las máscaras de segmentación de instancias. Este enfoque simplificado lo hace mucho más rápido y, al mismo tiempo, mantiene una gran precisión. Como resultado, resulta especialmente útil para aplicaciones en tiempo real como la conducción autónoma, el análisis de vídeo y la robótica, donde tanto la velocidad como la precisión son cruciales.

YOLO11 se presenta como un modelo preentrenado. Se ha entrenado en el conjunto de datosCOCO, que abarca objetos cotidianos para la segmentación de ejemplos. Sin embargo, el paquetePython Ultralytics admite el entrenamiento personalizado, que es esencial para aplicaciones especializadas en las que es necesario segmentar objetos únicos.

¿Por qué es importante el entrenamiento personalizado o el ajuste fino de un modelo? El entrenamiento personalizado aprovecha el aprendizaje por transferencia al basarse en el conocimiento ya integrado en los modelos pre-entrenados. En lugar de empezar desde cero, adapta un modelo existente a nuevas tareas utilizando conjuntos de datos más pequeños y menos recursos informáticos, todo ello manteniendo una alta precisión.

A continuación se describen los pasos necesarios para ajustar YOLO11 a la segmentación por ejemplo:

La segmentación de instancias se puede utilizar para resolver desafíos del mundo real, ayudando a las máquinas a ver y comprender los objetos con mayor precisión. Desde la mejora de la automatización hasta la protección del medio ambiente, desempeña un papel clave en muchos campos. Veamos algunos ejemplos de dónde está teniendo un impacto.

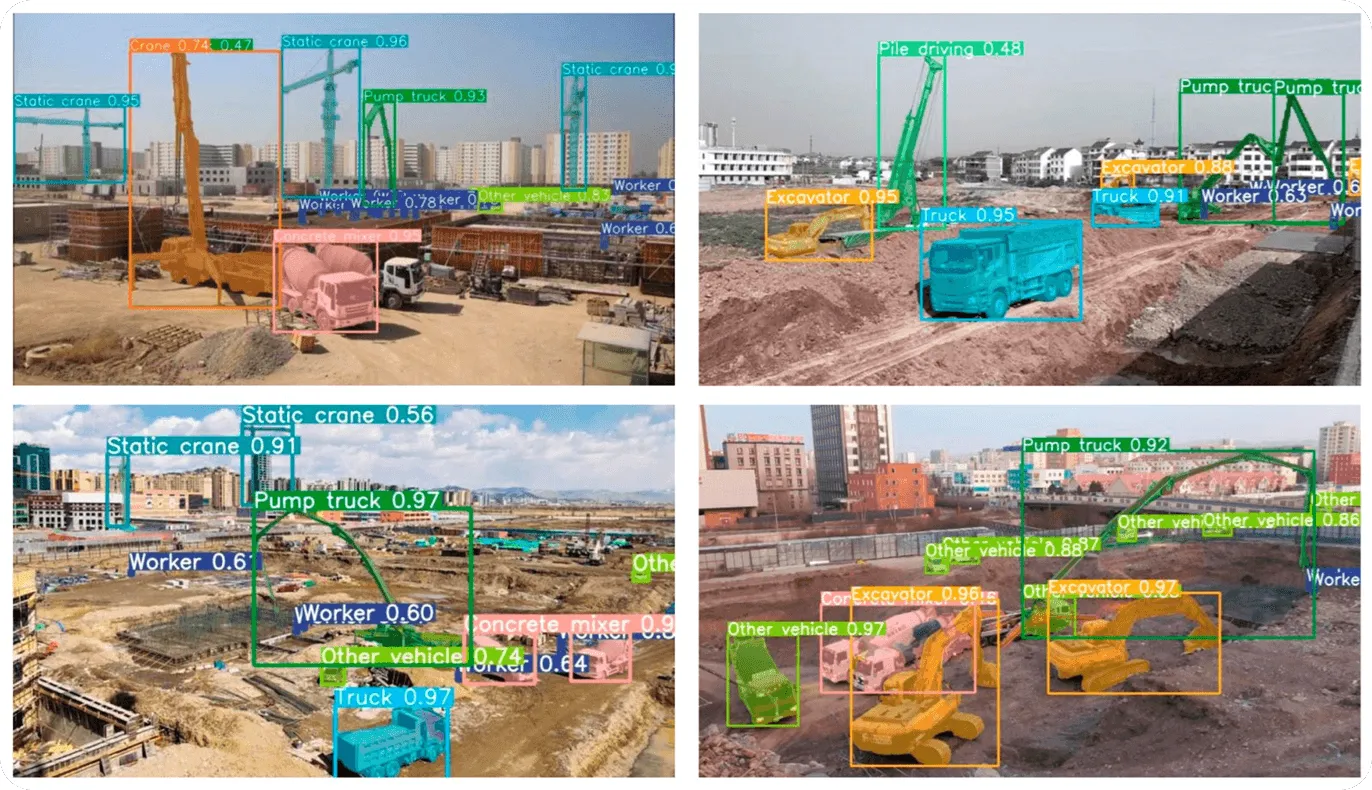

La segmentación de instancias puede ser fundamental para garantizar la seguridad y la eficiencia en las obras de construcción. Por ejemplo, se puede utilizar para supervisar maquinaria pesada.

YOLO11 puede ajustarse para segment e identificar con precisión distintos tipos de equipos, como grúas, excavadoras y bulldozers, y track sus posiciones en tiempo real. Esto permite a los jefes de obra asegurarse de que la maquinaria funciona estrictamente dentro de las áreas designadas y no invade zonas en las que hay trabajadores o existen peligros.

Además, la integración de estas soluciones con sistemas de alerta en tiempo real permite tomar medidas correctivas rápidas. Más allá de esto, la información recopilada puede ayudar a optimizar la distribución y el flujo de trabajo del sitio, reduciendo aún más los riesgos y aumentando la productividad.

La monitorización del comportamiento animal ayuda a los investigadores, agricultores y conservacionistas a cuidar mejor de los animales en diferentes entornos. La segmentación de instancias juega un papel útil en estos sistemas al identificar y segmentar animales individuales en granjas, zoológicos y hábitats naturales. A diferencia de la detección de objetos tradicional que utiliza bounding boxes, la segmentación de instancias proporciona una delineación a nivel de píxel de cada animal, lo cual es particularmente útil cuando los animales están muy cerca.

La segmentación detallada facilita un seguimiento más preciso de los movimientos y comportamientos. Los animales solapados o muy agrupados pueden reconocerse claramente, lo que proporciona un análisis más preciso de las interacciones, las evaluaciones de salud y los patrones de actividad. En general, una mayor comprensión del comportamiento animal mejora las prácticas de cuidado y gestión de los animales.

El seguimiento preciso de jugadores y eventos es una parte importante del análisis deportivo. Los métodos de seguimiento tradicionales se basan en el etiquetado manual, que puede no captar interacciones detalladas. La visión por ordenador puede utilizarse para segment detalles como cada jugador, balón y evento clave a nivel de píxel para obtener información detallada.

Por ejemplo, la segmentación de instancias puede ayudar a detect eventos como faltas o incidentes sin balón separando claramente a cada jugador y objeto. Este seguimiento granular que permiten modelos como YOLO11 ofrece a los analistas información más clara para estudiar los patrones de movimiento, el posicionamiento espacial y las interacciones con gran precisión. Una de las principales ventajas de esta información es que ayuda a los equipos a perfeccionar sus estrategias y mejorar el rendimiento general.

Estos son algunos de los beneficios clave que la segmentación de instancias puede aportar a diversas industrias:

Si bien estos beneficios resaltan cómo la segmentación de instancias impacta en diferentes casos de uso, también es esencial considerar los desafíos involucrados en su implementación.

Estas son algunas de las limitaciones clave de la segmentación de instancias:

La segmentación de instancias permite distinguir objetos individuales con precisión, incluso cuando se superponen. Al capturar los límites de los objetos a nivel de píxel, proporciona una comprensión más profunda de los datos visuales en comparación con las tareas tradicionales de visión artificial, como la detección de objetos.

Los recientes avances en visión por ordenador han agilizado y facilitado la segmentación de instancias. En particular, los modelos de visión por ordenador como Ultralytics YOLO11 simplifican el proceso, permitiendo la segmentación en tiempo real con una configuración mínima, lo que lo hace más accesible para diversas industrias y aplicaciones.

¿Tienes curiosidad por la IA? Visita nuestro repositorio de GitHub y conéctate con nuestra comunidad para seguir explorando. Obtén información sobre innovaciones como la IA en coches autónomos y la visión artificial en la agricultura en nuestras páginas de soluciones. Consulta nuestras opciones de licencia y ¡comienza con un proyecto de visión artificial!

Comience su viaje con el futuro del aprendizaje automático