了解姿势估计 的工作原理、实际应用,以及Ultralytics YOLO11 等模型如何让机器解读身体动作和姿势。

了解姿势估计 的工作原理、实际应用,以及Ultralytics YOLO11 等模型如何让机器解读身体动作和姿势。

当您看到一个人弯腰驼背或挺胸抬头时,您会立即清楚他们是姿势不好还是充满自信。没有人需要向您解释。这是因为,随着时间的推移,我们自然而然地学会了解释肢体语言。

通过经验和观察,我们的大脑非常擅长识别各种物体的姿势,包括人类。得益于人工智能 (AI) 和计算机视觉的最新进展,计算机视觉是一个使机器能够解释来自世界的视觉信息的领域,机器现在也开始学习和复制这种能力。

姿势估计是一项计算机视觉任务,通过观察图像或视频,帮助机器找出人或物体的位置和方向。它通过识别身体上的关键点(如关节和四肢)来了解某人甚至某物是如何移动的。

这项技术正被广泛应用于健身、医疗保健和动画等领域。例如,在工作场所环境中,它可以用来监测员工的姿势,支持安全和健康计划。计算机视觉模型,如 Ultralytics YOLO11等计算机视觉模型通过实时估算人体姿势来实现这一目标。

在本文中,我们将详细介绍姿势估计 及其工作原理,以及它在现实世界中发挥作用的案例。让我们开始吧!

对姿势估计 研究始于 20 世纪 60 年代末和 70 年代。多年来,针对这项计算机视觉任务的方法已从基本的数学和几何转向由人工智能驱动的更先进的方法。

最初,这些技术依赖于固定的摄像机角度和已知的参考点。后来,它们发展到包括三维模型和特征匹配。如今,YOLO11 等深度学习模型可以从图像或视频中实时detect 身体位置,使姿势估计 估计比以往任何时候都更快、更准确。

随着技术的进步,研究人员看到了能够监控和track 各种物体(尤其是人类和动物)姿势的潜在应用。姿势估计尤为重要,因为它能让人工智能工具以前所未有的方式理解和测量姿势和运动。

例如,它允许计算机识别手势以进行免提交互,分析运动员的动作以提高表现,为视频游戏中的逼真动画提供支持,甚至可以通过跟踪患者的康复进度来支持医疗保健。

姿势估计不同于其他计算机视觉任务,如物体检测和实例分割。这些任务主要侧重于识别和定位图像中的物体。

例如,物体检测会在人、车辆或动物等物体周围绘制边界框,以指示它们的存在和位置。实例分割通过在像素级别勾勒出每个物体的精确形状,使这一过程更进一步。

然而,这两种方法主要关注的是物体是什么以及它在哪里,而不提供任何关于物体如何定位或可能在做什么的信息。这就是姿势估计 变得至关重要的地方。

通过识别身体上的关键点,如手肘、膝盖甚至尾巴,姿势估计 估计可以解读姿势和动作。这样就能更深入地理解动作、手势和身体动态,包括三维空间中的运动。

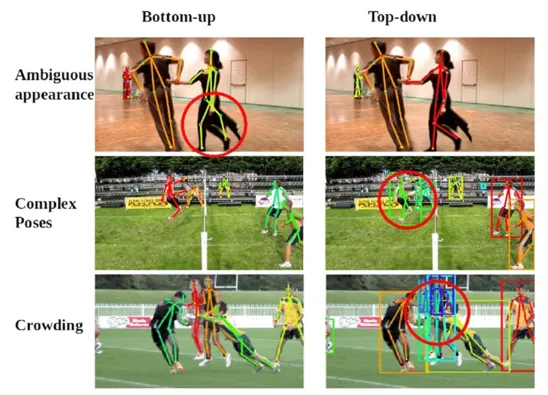

姿势估计模型一般采用两种主要方法:自下而上和自上而下。在自下而上的方法中,模型首先检测单个关键点,如手肘、膝盖或肩膀,然后将它们分组,找出它们属于哪个人或物体。而自上而下的方法则是先检测每个物体(如图像中的人),然后找出该特定物体的关键点。

一些较新的模型,如YOLO11,融合了两种方法的优点。它跳过了手动分组步骤,从而保持了自下而上方法的效率,同时还通过一次检测人员并估算其姿势--在单一、精简的流程中--利用了自上而下系统的精确性。

在我们介绍姿势估计 模型的工作原理时,你可能会想:这些模型究竟是如何学会估计不同物体的姿势估计 的呢?这就是定制训练的意义所在。

自定义训练指的是使用自己的数据来教模型识别特定的关键点。由于从头开始建立模型需要大量标注图像和大量时间,因此很多人选择了迁移学习。这包括从一个已经在大型数据集上训练过的模型开始,如YOLO11 姿势估计 模型,它是在COCO数据集上预先训练过的,然后根据特定任务或使用案例,用自己的数据对其进行微调。

比方说,您正在研究瑜伽姿势--您可以使用图像对YOLO11 进行微调,图像中的每个姿势估计 都标注了该活动的特定关键点。要做到这一点,您需要一个自定义的注释图像数据集,以便模型可以从中学习。

在训练过程中,你可以调整批量大小(一次处理的图像数量)、学习率(模型更新学习的速度)和历时(模型循环处理数据集的次数)等设置,以提高准确性。这使得根据您的特定需求建立姿势估计 模型变得更加容易。

既然我们已经讨论了什么是 "姿势估计 "以及它是如何工作的,让我们来仔细看看它在现实世界中的一些应用案例。

姿势估计正逐渐成为医疗保健行业的可靠工具,尤其是在物理治疗领域。利用人工智能和计算机视觉,这些系统可以实时track 姿势和动作,并提供反馈,类似于理疗师提供的服务。

例如,膝关节手术后恢复期的病人可以使用姿势估计 系统来确保自己的康复训练正确无误。该系统可以发现任何不正确的动作,并提出改进建议,帮助病人保持track 的姿势,避免受伤。

除了康复,"姿势估计 估算 "也在健身应用程序中大显身手。例如,在家锻炼的人可以使用应用程序检查自己在锻炼过程中的姿势。该应用可以提供实时反馈,例如调整深蹲的角度,或在举重时确保背部挺直。这可以帮助用户改善姿势,防止受伤,而不需要教练。

估计姿势改变了娱乐业的动作捕捉方式,使其变得更简单、更易用。过去,动作捕捉需要在人的身体上放置标记,并用特殊的摄像机进行跟踪,这既麻烦又昂贵。

现在,随着人工智能和计算机视觉技术的发展,我们可以使用普通摄像头和算法来track 身体运动,而无需标记,从而使整个过程更加高效和准确,甚至可以实时track 。

迪斯尼的 AR(增强现实)Poser 就是一个很好的例子。这个有趣的工具可以让您用手机拍照,然后让一个数字角色在增强现实中复制您的姿势估计 。它的工作原理是分析照片中你的姿势估计 ,并将其与 3D 人物相匹配,从而创建一个有趣的个性化 AR 自拍。

研究动物行为有助于科学家了解动物如何交流、寻找配偶、照顾幼崽以及群体生活。这些知识对于保护野生动物和更深入地了解自然世界至关重要。

姿势估计通过使用图像和视频跟踪动物的动作和姿势来简化这一过程,而无需在动物身上安装传感器或标签。这些系统可以自动监测动物的姿势,为它们梳理毛发、玩耍或打斗等行为提供洞察力。

科学家们利用姿势估计 来研究猿类行为就是一个有趣的例子。事实上,研究人员已经汇编了 OpenApePose 等数据集,其中包含来自六个猿类物种的 71,000 多张标记图像。

以下是 "姿势估计 估计 "为各行各业带来的一些主要益处:

虽然姿势估计 在各个领域都有明显的优势,但也有一些挑战需要考虑。以下是几个需要注意的关键限制:

姿势估计从早期的标记系统发展到由YOLO11 等深度学习模型驱动的有影响力的工具,已经走过了漫长的道路。无论是改善物理治疗、为交互式 AR 体验提供动力,还是帮助野生动物研究,姿势估计 估计正在改变机器理解动作和姿势的方式。随着技术的不断进步,解决其局限性将成为开启更多实际用途的关键,并使机器更好地理解我们和其他生物的运动方式。

对 AI 感兴趣吗?浏览我们的 GitHub 仓库,与 我们的社区 建立联系,并查看我们的许可选项,以快速启动您的计算机视觉项目。在我们的解决方案页面上了解更多关于零售业中的 AI和物流业中的计算机视觉等创新。

开启您的机器学习未来之旅