Descubra por qué la poda y la cuantización son esenciales para optimizar los modelos de visión artificial y permitir un rendimiento más rápido en los dispositivos de borde.

Descubra por qué la poda y la cuantización son esenciales para optimizar los modelos de visión artificial y permitir un rendimiento más rápido en los dispositivos de borde.

Los dispositivos periféricos son cada vez más comunes gracias al avance de la tecnología. Desde relojes inteligentes que track la frecuencia cardiaca hasta drones aéreos que vigilan las calles, los sistemas Edge pueden procesar datos en tiempo real de forma local dentro del propio dispositivo.

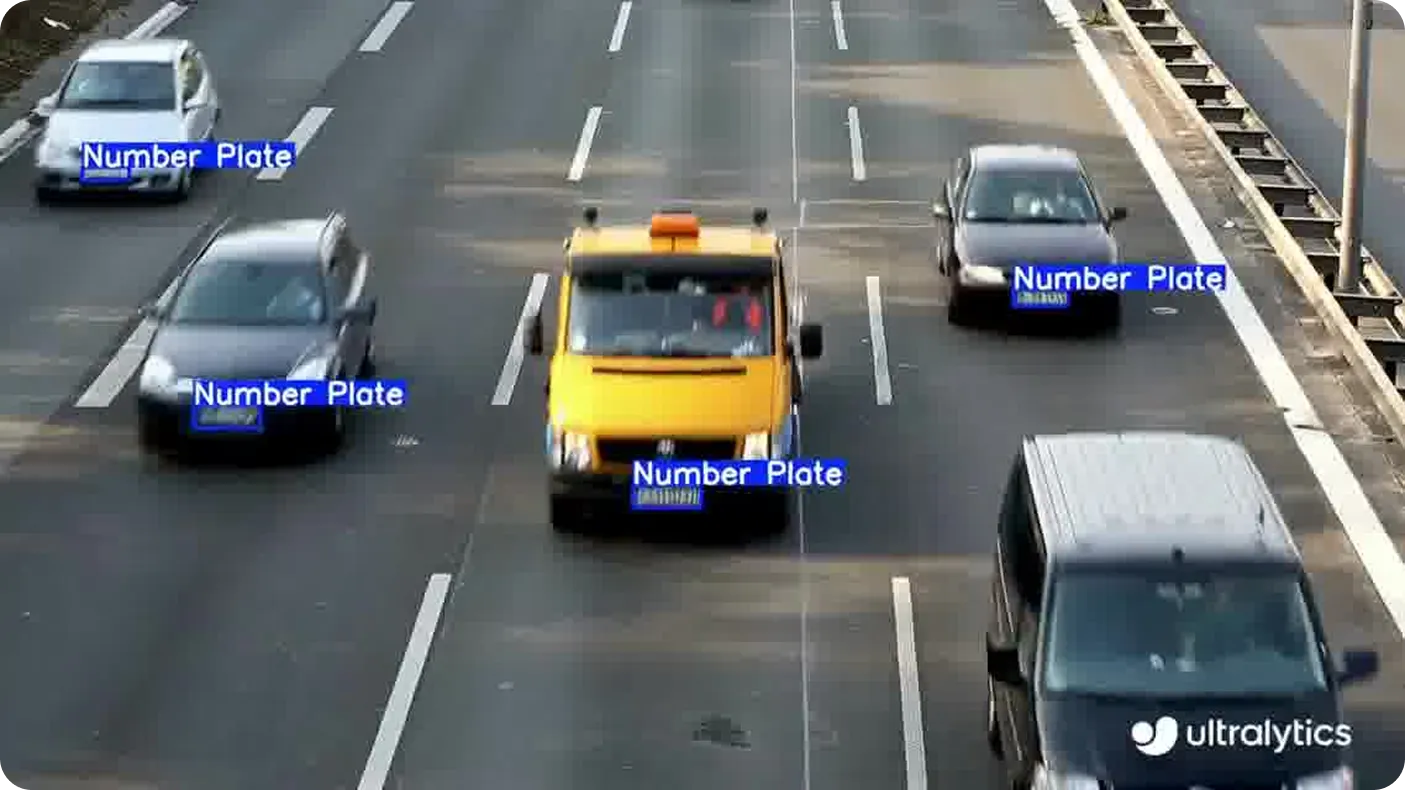

Este método suele ser más rápido y seguro que enviar datos a la nube, especialmente para aplicaciones que involucran datos personales, como la detección de matrículas o el seguimiento de gestos. Estos son ejemplos de visión artificial, una rama de la inteligencia artificial (IA) que permite a las máquinas interpretar y comprender la información visual.

Sin embargo, una consideración importante es que tales aplicaciones requieren modelos de Visión Artificial capaces de manejar una gran carga computacional, utilizando recursos mínimos y operando de forma independiente. La mayoría de los modelos de visión artificial se desarrollan para sistemas de alto rendimiento, lo que los hace menos adecuados para su implementación directa en dispositivos edge.

Para superar esta brecha, los desarrolladores a menudo aplican optimizaciones específicas que adaptan el modelo para que se ejecute de manera eficiente en hardware más pequeño. Estos ajustes son críticos para las implementaciones perimetrales del mundo real, donde la memoria y la potencia de procesamiento son limitadas.

Curiosamente, los modelos de visión por ordenador como Ultralytics YOLO11 ya están diseñados teniendo en cuenta la eficiencia de los bordes, lo que los hace ideales para tareas en tiempo real. Sin embargo, su rendimiento puede mejorarse aún más utilizando técnicas de optimización de modelos como la poda y la cuantización, lo que permite una inferencia aún más rápida y un menor uso de recursos en dispositivos con limitaciones.

En este artículo, analizaremos con más detalle qué son la poda y la cuantificación, cómo funcionan y cómo pueden ayudar a los modelos YOLO a rendir en las implantaciones de bordes del mundo real. Pongámonos manos a la obra.

Al preparar los modelos de Visión Artificial para su implementación en dispositivos edge, uno de los objetivos clave es hacer que el modelo sea ligero y fiable sin sacrificar el rendimiento. Esto a menudo implica reducir el tamaño del modelo y las demandas computacionales para que pueda operar de manera eficiente en hardware con memoria, energía o capacidad de procesamiento limitadas. Dos formas comunes de hacer esto son la poda y la cuantificación.

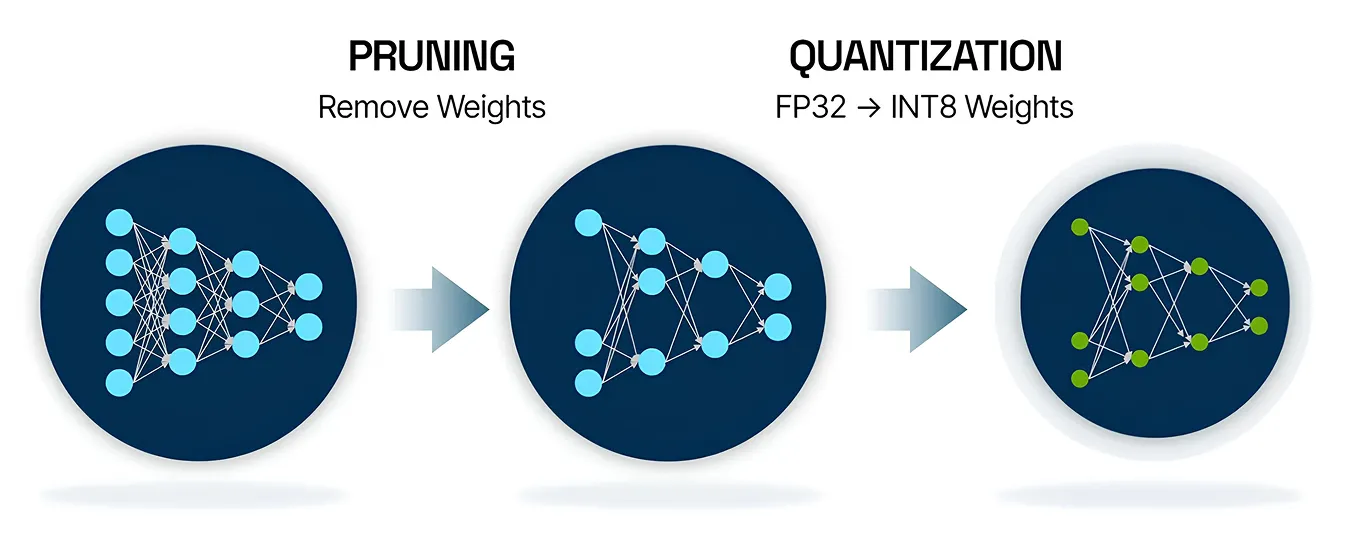

La poda es una técnica de optimización de modelos de IA que ayuda a que las redes neuronales sean más pequeñas y eficientes. En muchos casos, partes de un modelo, como ciertas conexiones o nodos, no contribuyen mucho a sus predicciones finales. La poda funciona identificando y eliminando estas partes menos importantes, lo que reduce el tamaño del modelo y acelera su rendimiento.

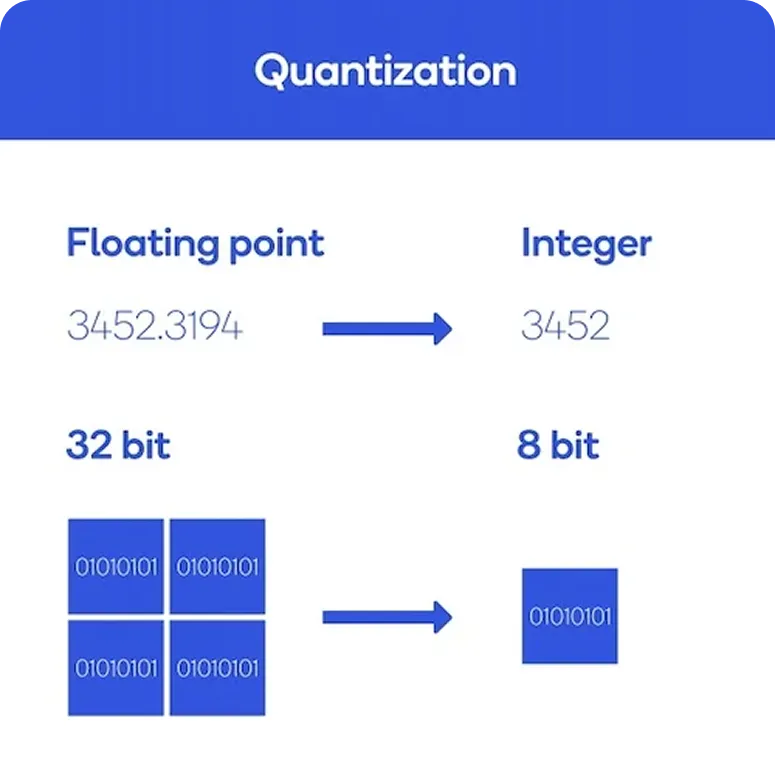

Por otro lado, la cuantización es una técnica de optimización que reduce la precisión de los números que utiliza un modelo. En lugar de depender de números de coma flotante de 32 bits de alta precisión, el modelo cambia a formatos más pequeños y eficientes, como los enteros de 8 bits. Este cambio ayuda a reducir el uso de memoria y acelera la inferencia, el proceso en el que el modelo realiza predicciones.

Ahora que comprendemos mejor qué son la poda y la cuantización, veamos cómo funcionan ambas.

La poda se realiza mediante un proceso conocido como análisis de sensibilidad. Este identifica qué partes de los modelos de redes neuronales, como ciertos pesos, neuronas o canales, contribuyen menos a la predicción de salida final. Estas partes pueden eliminarse con un efecto mínimo en la precisión. Después de la poda, el modelo se vuelve a entrenar normalmente para afinar su rendimiento. Este ciclo puede repetirse para encontrar el equilibrio adecuado entre su tamaño y su precisión.

Mientras tanto, la cuantización de modelos se centra en cómo el modelo gestiona los datos. Comienza con la calibración, donde el modelo se ejecuta con datos de muestra para aprender el rango de valores que necesita procesar. Esos valores se convierten entonces de punto flotante de 32 bits a formatos de menor precisión, como enteros de 8 bits.

Hay varias herramientas disponibles que facilitan el uso de la poda y la cuantización en proyectos de IA del mundo real. La mayoría de los marcos de IA, como PyTorch y TensorFlow, incluyen soporte integrado para estas técnicas de optimización, lo que permite a los desarrolladores integrarlas directamente en el proceso de despliegue del modelo.

Una vez optimizado un modelo, herramientas como ONNX Runtime pueden ayudar a ejecutarlo de forma eficiente en diversas plataformas de hardware, como servidores, ordenadores de sobremesa y dispositivos periféricos. Además, Ultralytics ofrece integraciones que permiten exportar modelos YOLO en formatos adecuados para la cuantización, lo que facilita la reducción del tamaño del modelo y aumenta el rendimiento.

Los modelosYOLO Ultralytics , como YOLO11 , son ampliamente reconocidos por su detección de objetos rápida y en un solo paso, lo que los hace ideales para tareas de IA de visión en tiempo real. Ya están diseñados para ser lo suficientemente ligeros y eficientes para su despliegue en el borde. Sin embargo, las capas responsables del procesamiento de las características visuales, denominadas capas convolucionales, pueden seguir exigiendo una potencia de cálculo considerable durante la inferencia.

Quizás te preguntes: si YOLO11 ya está optimizado para su uso en bordes, ¿por qué necesita una mayor optimización? Sencillamente, no todos los dispositivos periféricos son iguales. Algunos funcionan con un hardware mínimo, como pequeños procesadores integrados que consumen menos energía que una bombilla LED estándar.

En estos casos, incluso un modelo simplificado como YOLO11 necesita una optimización adicional para garantizar un rendimiento fluido y fiable. Técnicas como la poda y la cuantización ayudan a reducir el tamaño del modelo y a acelerar la inferencia sin afectar significativamente a la precisión, por lo que resultan ideales para estos entornos con restricciones.

Para facilitar la aplicación de estas técnicas de optimización, Ultralytics soporta varias integraciones que pueden utilizarse para exportar modelos YOLO a múltiples formatos como ONNX, TensorRT, OpenVINO, CoreML y PaddlePaddle. Cada formato está diseñado para funcionar bien con tipos específicos de hardware y entornos de despliegue.

Por ejemplo, ONNX se utiliza a menudo en flujos de trabajo de cuantificación debido a su compatibilidad con una amplia gama de herramientas y plataformas. TensorRT, por su parte, está muy optimizado para los dispositivos NVIDIA y admite la inferencia de baja precisión mediante INT8, lo que lo hace ideal para la implantación a alta velocidad en GPU de borde.

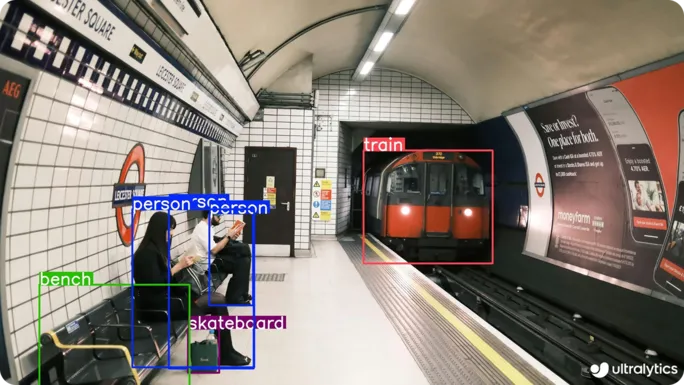

A medida que la visión por ordenador se expande hacia diversas aplicaciones del mundo real, los modelos YOLO optimizados permiten ejecutar tareas como la detección de objetos, la segmentación de instancias y el seguimiento de objetos en hardware más pequeño y rápido. A continuación, analizaremos un par de casos de uso en los que la poda y la cuantización hacen que estas tareas de visión por ordenador sean más eficientes y prácticas.

Muchos espacios industriales, así como zonas públicas, dependen de la vigilancia en tiempo real para mantenerse seguros. Lugares como estaciones de tránsito, plantas de fabricación y grandes instalaciones al aire libre necesitan sistemas Vision AI que puedan detect personas o vehículos con rapidez y precisión. A menudo, estos lugares funcionan con una conectividad limitada y restricciones de hardware, lo que dificulta el despliegue de grandes modelos.

En estos casos, un modelo Vision AI optimizado como YOLO11 es una gran solución. Su tamaño compacto y su rápido rendimiento lo hacen perfecto para ejecutarse en dispositivos periféricos de bajo consumo, como cámaras integradas o sensores inteligentes. Estos modelos pueden procesar datos visuales directamente en el dispositivo, lo que permite detectar en tiempo real infracciones de seguridad, accesos no autorizados o actividades anómalas, sin depender de un acceso constante a la nube.

Los sitios de construcción son entornos de ritmo rápido e impredecibles, llenos de maquinaria pesada, trabajadores en movimiento y actividad constante. Las condiciones pueden cambiar rápidamente debido a cambios en los horarios, movimiento de equipos o incluso cambios repentinos en el clima. En un entorno tan dinámico, la seguridad de los trabajadores puede sentirse como un desafío continuo.

La supervisión en tiempo real desempeña un papel crucial, pero los sistemas tradicionales a menudo dependen del acceso a la nube o de hardware caro que puede no ser práctico in situ. Aquí es donde modelos como YOLO11 pueden ser impactantes. YOLO11 puede optimizarse para funcionar en dispositivos pequeños y eficientes que trabajan directamente in situ sin necesidad de conexión a Internet.

Por ejemplo, en una gran obra de construcción, como la ampliación de una autopista que abarca varias hectáreas. En este tipo de entorno, el seguimiento manual de cada vehículo o pieza de equipo puede ser difícil y llevar mucho tiempo. Un dron equipado con una cámara y un modelo YOLO11 optimizado puede ayudar detectando y siguiendo automáticamente a los vehículos, controlando el flujo de tráfico e identificando problemas de seguridad como accesos no autorizados o comportamientos de conducción inseguros.

Estas son algunas de las ventajas clave que ofrecen los métodos de optimización de modelos de visión artificial, como la poda y la cuantificación:

Si bien la poda y la cuantificación ofrecen muchas ventajas, también conllevan ciertas contrapartidas que los desarrolladores deben considerar al optimizar los modelos. Estas son algunas de las limitaciones que debe tener en cuenta:

La poda y la cuantización son técnicas útiles que ayudan a los modelos YOLO a rendir mejor en los dispositivos periféricos. Reducen el tamaño del modelo, disminuyen sus necesidades informáticas y aceleran las predicciones, todo ello sin una pérdida notable de precisión.

Estos métodos de optimización también brindan a los desarrolladores la flexibilidad de ajustar los modelos para diferentes tipos de hardware sin necesidad de reconstruirlos por completo. Con algunos ajustes y pruebas, se vuelve más fácil aplicar Vision AI en situaciones del mundo real.

¡Únase a nuestra creciente comunidad! Explore nuestro repositorio de GitHub para obtener más información sobre la IA. ¿Listo para comenzar sus proyectos de visión artificial? Consulte nuestras opciones de licencia. ¡Descubra la IA en la agricultura y la visión artificial en la atención médica visitando nuestras páginas de soluciones!

Comience su viaje con el futuro del aprendizaje automático