了解新型Ultralytics YOLO11 型号如何用于物体检测,从而在各行各业的各种应用中实现更高的精度。

了解新型Ultralytics YOLO11 型号如何用于物体检测,从而在各行各业的各种应用中实现更高的精度。

计算机视觉是人工智能 (AI) 的一个领域,可帮助机器解释和理解视觉信息,从而实现物体检测等基本任务。与图像分类不同,物体检测不仅可以识别图像中的物体,还可以精确定位它们的确切位置。这使其成为视觉人工智能应用(如自动驾驶汽车、实时安全系统和仓库自动化)的关键工具。

随着时间的推移,物体检测技术变得越来越先进和易于使用。在Ultralytics的年度混合活动YOLO Vision 2024(YV24)上,Ultralytics 推出了YOLO11 型号,标志着该技术又向前迈进了一大步。YOLO11 提高了准确性和性能,同时支持与 YOLOv8的相同任务,使以前型号的用户可以轻松实现无缝过渡。

在本文中,我们将分析物体检测是什么,它与其他计算机视觉任务有何不同,并探讨其在现实世界中的应用。我们还将教你如何将YOLO11 模型与Ultralytics Python 软件包和Ultralytics HUB 平台结合使用。让我们开始吧!

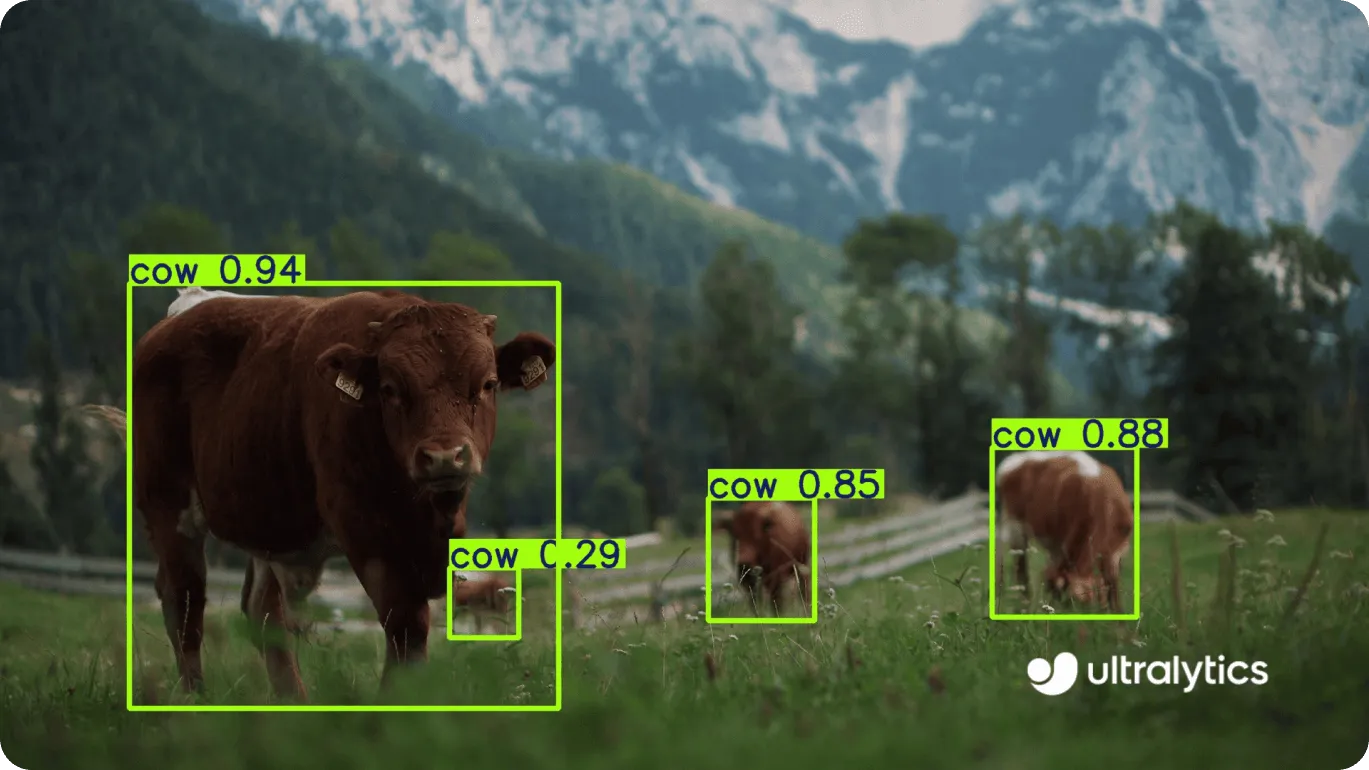

物体检测 是计算机视觉中的一项核心任务,它不仅仅是识别图像中的物体。 与仅确定是否存在特定物体的图像分类不同,物体检测可以识别多个物体,并使用边界框精确定位它们的确切位置。

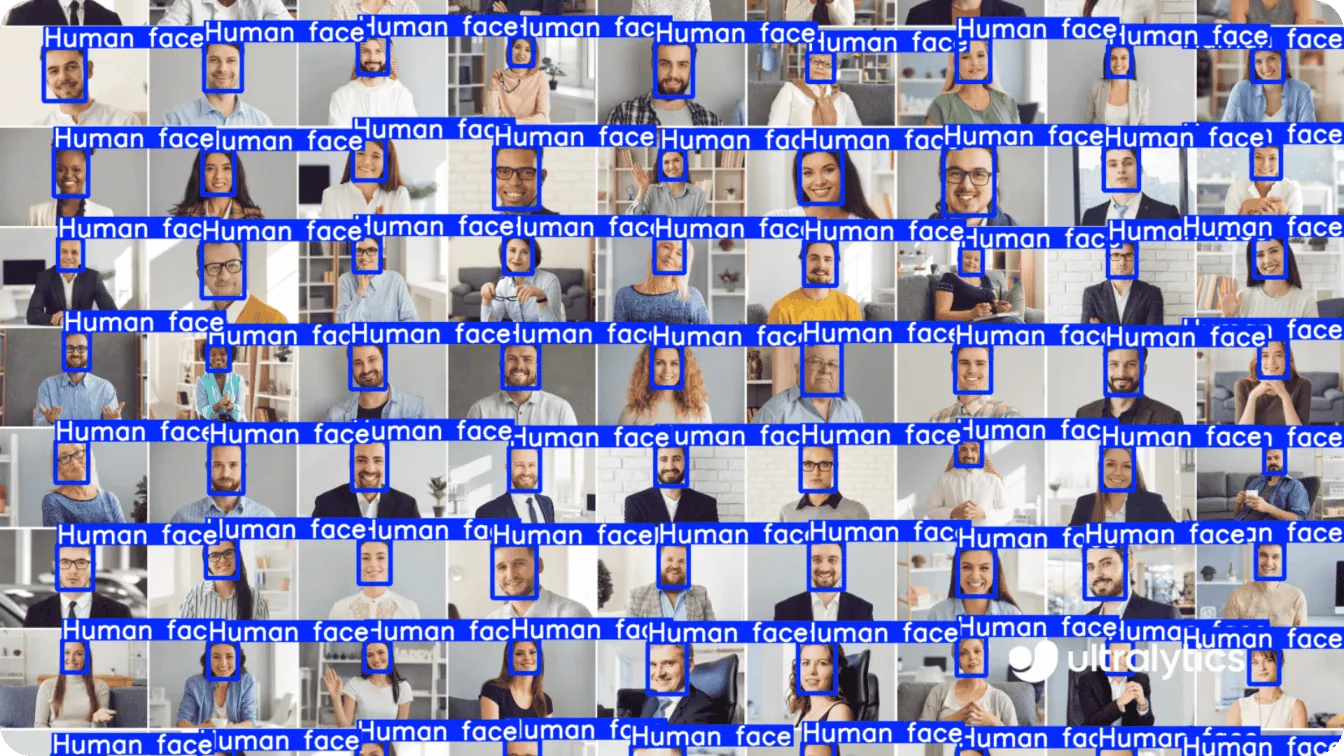

例如,它可以识别和定位集体照中的人脸、繁忙街道上的汽车或商店货架上的产品。目标识别和定位的结合使其特别适用于监控、人群监控和自动化库存管理等应用。

与其他任务(如语义或 实例分割)相比,目标检测的独特之处在于其关注的焦点和效率。

语义分割标记图像中的每个像素,但不区分同一类型的各个对象(例如,照片中的所有人脸都将归为“人脸”)。实例分割 通过分离每个对象并勾勒出其确切形状(即使对于同一类别的对象)来进一步实现这一点。

然而,物体检测提供了一种更简化的方法,通过识别和分类物体,同时标记它们的位置。这使其成为实时任务的理想选择,例如检测安全录像中的人脸或识别自动驾驶汽车的障碍物。

YOLO11 先进的物体检测功能使其在许多行业都非常有用。让我们来看几个例子。

YOLO11 和物体检测正在重新定义零售分析,使库存管理和货架监控更加高效和准确。该模型能够快速、可靠地detect 物体,帮助零售商track 库存水平、整理货架并减少库存清点中的错误。

例如 YOLO11可以detect 商店货架上的太阳镜等特定商品。但零售商为什么要监控货架呢?保持货架上的存货充足且井然有序对于确保顾客能够找到所需商品至关重要,而这将直接影响销售额。通过实时监控货架,零售商可以迅速发现商品不足、放错位置或过度拥挤的情况,帮助他们保持有序、美观的陈列,改善购物体验。

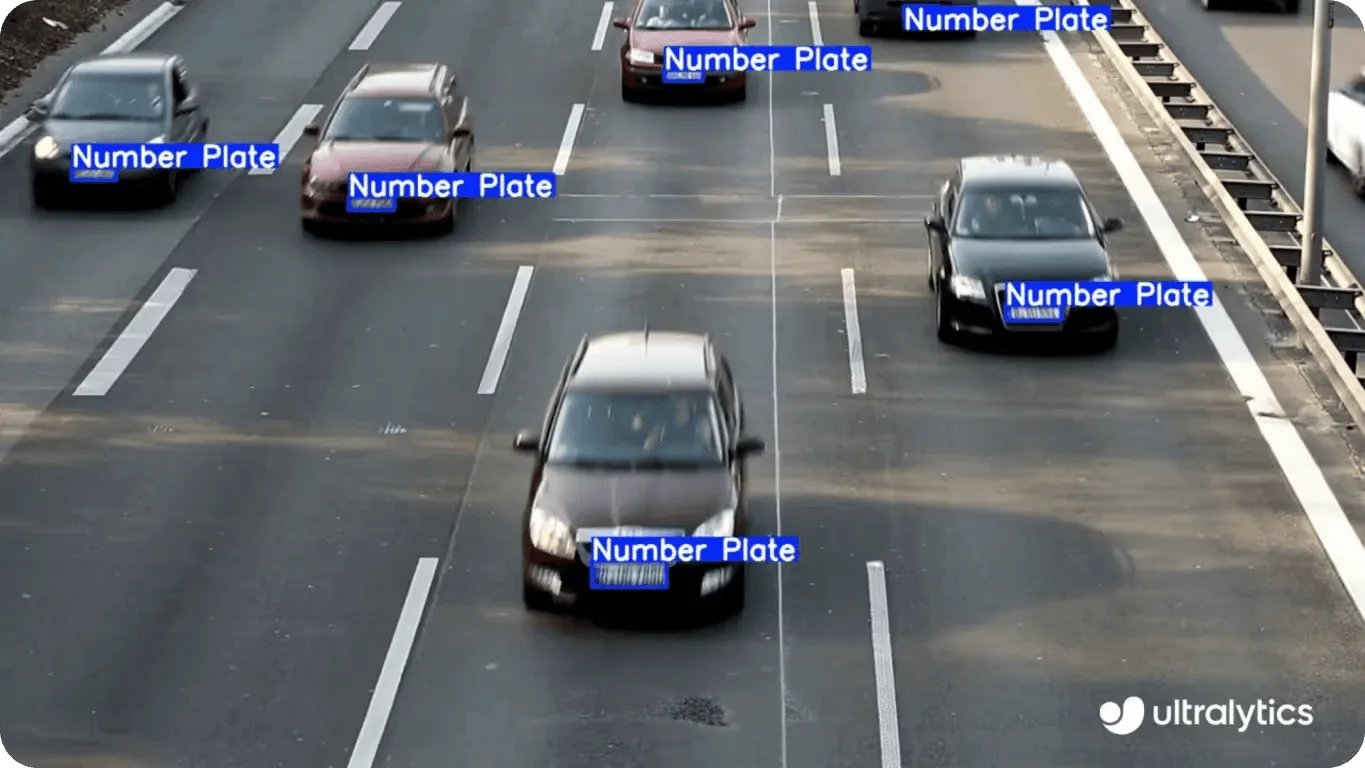

繁华都市的高效运转有赖于顺畅的交通和安全的街道,而YOLO11 可以帮助实现这一点。事实上,许多智慧城市应用程序都可以与YOLO11 集成。

其中一个有趣的案例涉及使用物体检测来识别行驶车辆上的车牌。通过这样做,YOLO11 可以支持更快的收费、更好的交通管理和更快的法规执行。

来自 Vision AI 系统的道路监控洞察力可以在交通违规或拥堵升级为更大问题之前向当局发出警报。 YOLO11还能detect 行人和骑自行车的人,使街道对每个人来说都更安全、更高效。

事实上,YOLO11处理可视化数据的能力使其成为改善城市基础设施的强大工具。例如,它可以通过分析车辆和行人的移动情况,帮助优化交通信号灯的时间。它还可以通过检测儿童并提醒司机减速来加强学校区域的安全。有了YOLO11,城市可以采取积极措施应对挑战,为每个人创造更高效的环境。

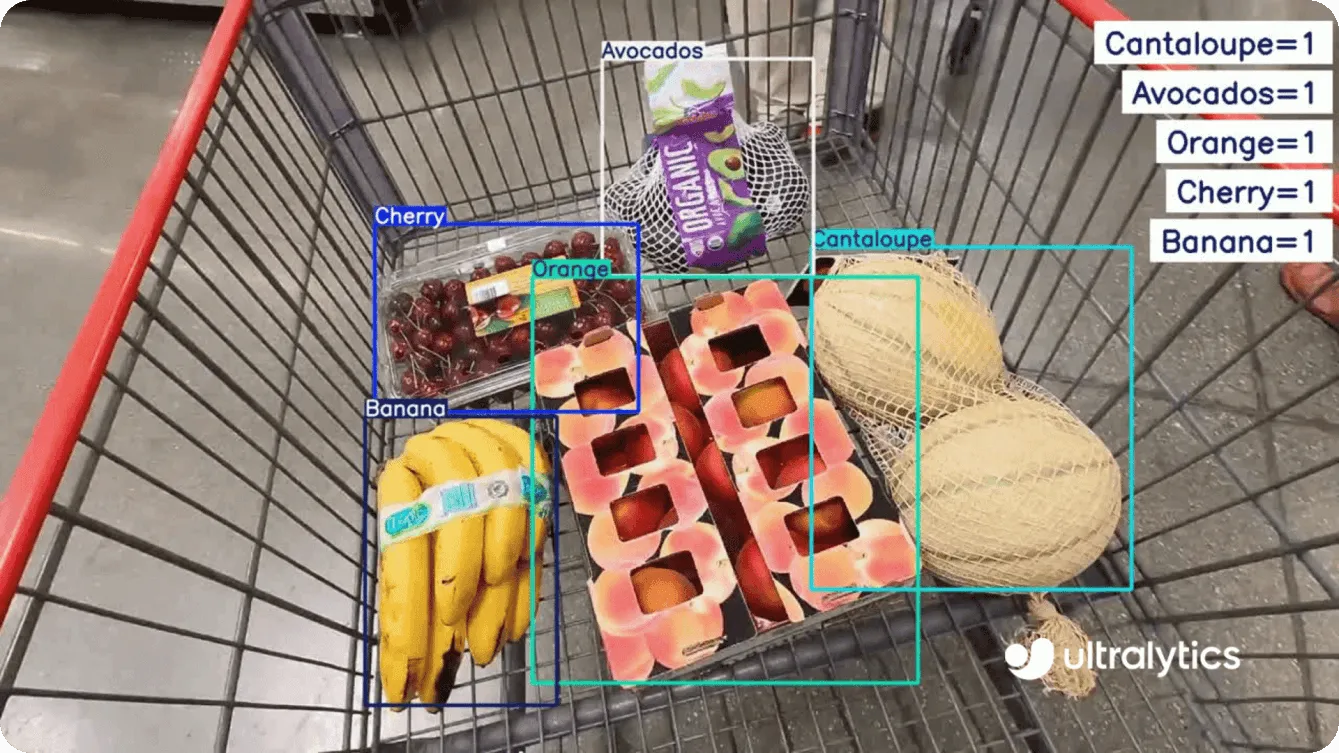

实时物体检测是指系统在实时视频中出现物体时对其进行识别和classify 能力。YOLO11 专为卓越的实时性能而设计,在支持这种能力方面表现出色。它的应用不仅仅局限于简化流程,还有助于创造一个更具包容性和无障碍的世界。

例如 YOLO11可以通过实时识别物体来帮助视障人士。根据检测结果,还可以提供语音描述,帮助用户更加独立地浏览周围环境。

考虑一下视障人士购买日用品的情况。挑选合适的商品可能很困难,但YOLO11 可以提供帮助。当他们将物品放入购物车时,与YOLO11 集成的系统可以用来识别每件物品(如香蕉、鳄梨或一箱牛奶),并提供实时语音描述。这样,购物者就可以确认他们的选择,并确保他们得到了所需的一切。通过识别日常用品,YOLO11 可以让购物变得更简单。

现在,我们已经介绍了物体检测的基础知识及其各种应用,下面让我们深入探讨如何使用Ultralytics YOLO11 模型来完成物体检测等任务。

使用YOLO11 有两种直接的方法:通过Ultralytics Python 软件包或Ultralytics HUB。让我们从Python 软件包开始,探索这两种方法。

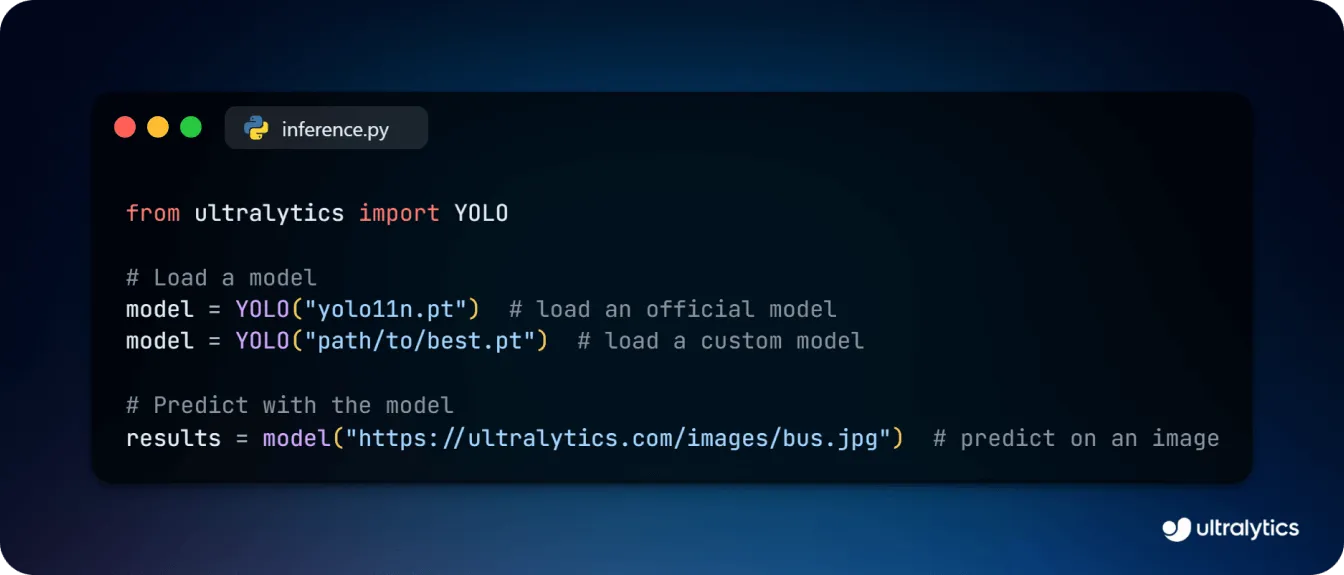

推理是指人工智能模型分析新的、未见过的数据,根据其在训练过程中学到的知识进行预测、信息classify 或提供见解。就物体检测而言,这意味着在图像或视频中识别和定位特定物体,在物体周围绘制边框,并根据模型的训练结果对其进行标注。

要使用YOLO11 对象检测模型进行推断,首先需要通过 pip、conda 或 Docker安装Ultralytics Python 软件包。如果遇到任何安装问题,请查看故障排除指南,了解帮助您解决问题的技巧和窍门。安装完成后,您可以使用以下代码加载YOLO11 对象检测模型,并对图像进行预测。

YOLO11 还支持自定义训练,以更好地适应您的特定用例。通过对模型进行微调,您可以调整模型以detect 与您的项目相关的对象。例如,在医疗保健领域使用计算机视觉时,定制训练的YOLO11 模型可用于detect 医疗图像中的特定异常,如核磁共振扫描中的肿瘤或 X 光片中的骨折,从而帮助医生做出更快、更准确的诊断。

下面的代码片段展示了如何加载和训练用于物体检测的YOLO11 模型。您可以从 YAML 配置文件或预训练模型开始,转移权重,并在诸如 COCO等数据集上进行训练,以获得更精细的物体检测能力。

训练模型后,您还可以将训练好的模型导出为各种格式,以便在不同的环境中部署。

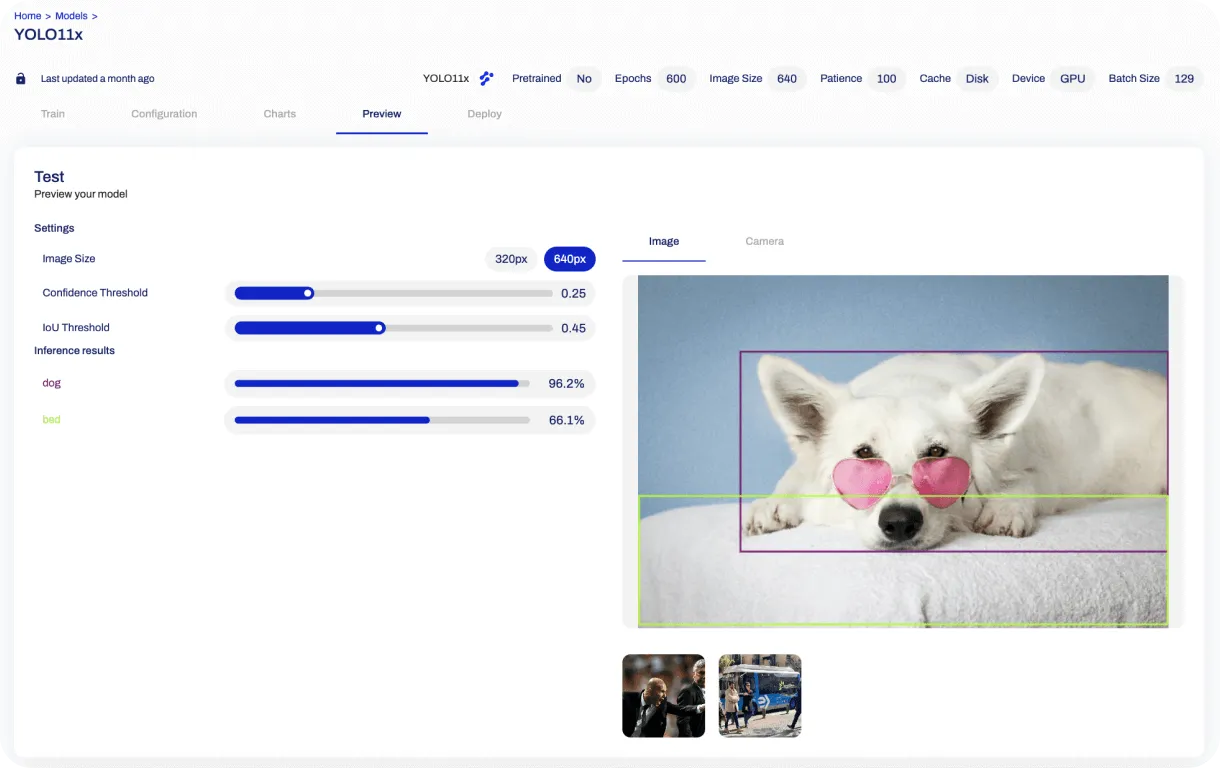

对于那些寻求无代码替代方案的用户,Ultralytics HUB提供了一个易于使用的 Vision AI 平台,用于训练和部署YOLO 模型,包括YOLO11。

要在图像上运行物体检测,只需创建一个账户,导航到 "模型 "部分,然后选择YOLO11 物体检测模型变体。上传图像后,平台将在预览部分显示检测到的物体。

通过将Python 软件包的灵活性与 HUB 的易用性相结合,YOLO11 使开发人员和企业都能轻松利用先进的对象检测技术。

YOLO11 树立了物体检测的新标准,将高精确度与多功能性相结合,满足了各行各业的需求。从增强零售分析到管理智能城市基础设施,YOLO11 可在无数应用中实现实时、可靠的性能。

通过Ultralytics HUB 提供的定制培训选项和易于使用的界面,将YOLO11 集成到您的工作流程中从未如此简单。无论您是探索计算机视觉的开发人员,还是希望利用人工智能进行创新的企业,YOLO11 都能为您提供成功所需的工具。

要了解更多信息,请查看我们的GitHub存储库,并与我们的社区互动。 在我们的解决方案页面上探索自动驾驶汽车和农业计算机视觉中的AI应用。 🚀

开启您的机器学习未来之旅