انضم إلينا ونحن نغوص في نموذج Segment Anything Model 2SAM 2SAM من Meta AI ونفهم التطبيقات الآنية التي يمكن استخدامها في مختلف الصناعات.

انضم إلينا ونحن نغوص في نموذج Segment Anything Model 2SAM 2SAM من Meta AI ونفهم التطبيقات الآنية التي يمكن استخدامها في مختلف الصناعات.

في 29 يوليو 2024، أصدرت Meta AI الإصدار الثاني من نموذج Segment Anything Model، SAM 2. يمكن للنموذج الجديد تحديد وحدات البكسل التي تنتمي إلى كائن مستهدف في كل من الصور ومقاطع الفيديو! أفضل ما في الأمر هو أن النموذج قادر على تتبع الكائن باستمرار عبر جميع إطارات الفيديو في الوقت الفعلي. يفتح SAM 2 إمكانيات مثيرة لتحرير الفيديو، وتجارب الواقع المختلط، والتعليق التوضيحي الأسرع للبيانات المرئية لتدريب أنظمة الرؤية الحاسوبية.

استنادًا إلى نجاح SAM الأصلي، الذي تم استخدامه في مجالات مثل العلوم البحرية وصور الأقمار الصناعية والطب، يتصدى SAM 2 لتحديات مثل الأجسام سريعة الحركة والتغيرات في المظهر. كما أن تحسين دقتها وكفاءتها يجعلها أداة متعددة الاستخدامات لمجموعة واسعة من التطبيقات. في هذه المقالة، سنركز في هذه المقالة على المجالات التي يمكن تطبيقSAM 2 فيها وسبب أهميتها لمجتمع الذكاء الاصطناعي.

نموذج Segment Anything Model 2 هو نموذج أساس متقدم يدعم التجزئة البصرية القابلة للتوجيه أو PVS في كل من الصور ومقاطع الفيديو. PVS هي تقنية حيث يمكن للنموذج segment أو تحديد أجزاء مختلفة من صورة أو مقطع فيديو بناءً على مطالبات أو مدخلات محددة يقدمها المستخدم. يمكن أن تكون هذه المطالبات على شكل نقرات أو مربعات أو أقنعة تبرز المنطقة محل الاهتمام. يقوم النموذج بعد ذلك بإنشاء قناع تجزئة يحدد المنطقة المحددة.

تعتمد بنية SAM 2 على SAM الأصلي من خلال التوسع من تجزئة الصور لتشمل تجزئة الفيديو أيضًا. وهي تتميز بوحدة فك ترميز قناع خفيفة الوزن تستخدم بيانات الصورة والمطالبات لإنشاء أقنعة التجزئة. بالنسبة لمقاطع الفيديو، تقدم SAM 2 نظام ذاكرة يساعدها على تذكر المعلومات من الإطارات السابقة، مما يضمن التتبع الدقيق مع مرور الوقت. يتضمن نظام الذاكرة مكونات تقوم بتخزين واستدعاء تفاصيل حول الكائنات التي يتم تجزئتها. يمكن ل SAM 2 أيضًا التعامل مع حالات الانسداد، track الأجسام من خلال إطارات متعددة، وإدارة المطالبات الغامضة من خلال توليد العديد من الأقنعة الممكنة. تجعل بنية SAM 2 المتطورة من SAM 2 قادرة على العمل في البيئات المرئية الثابتة والديناميكية على حد سواء.

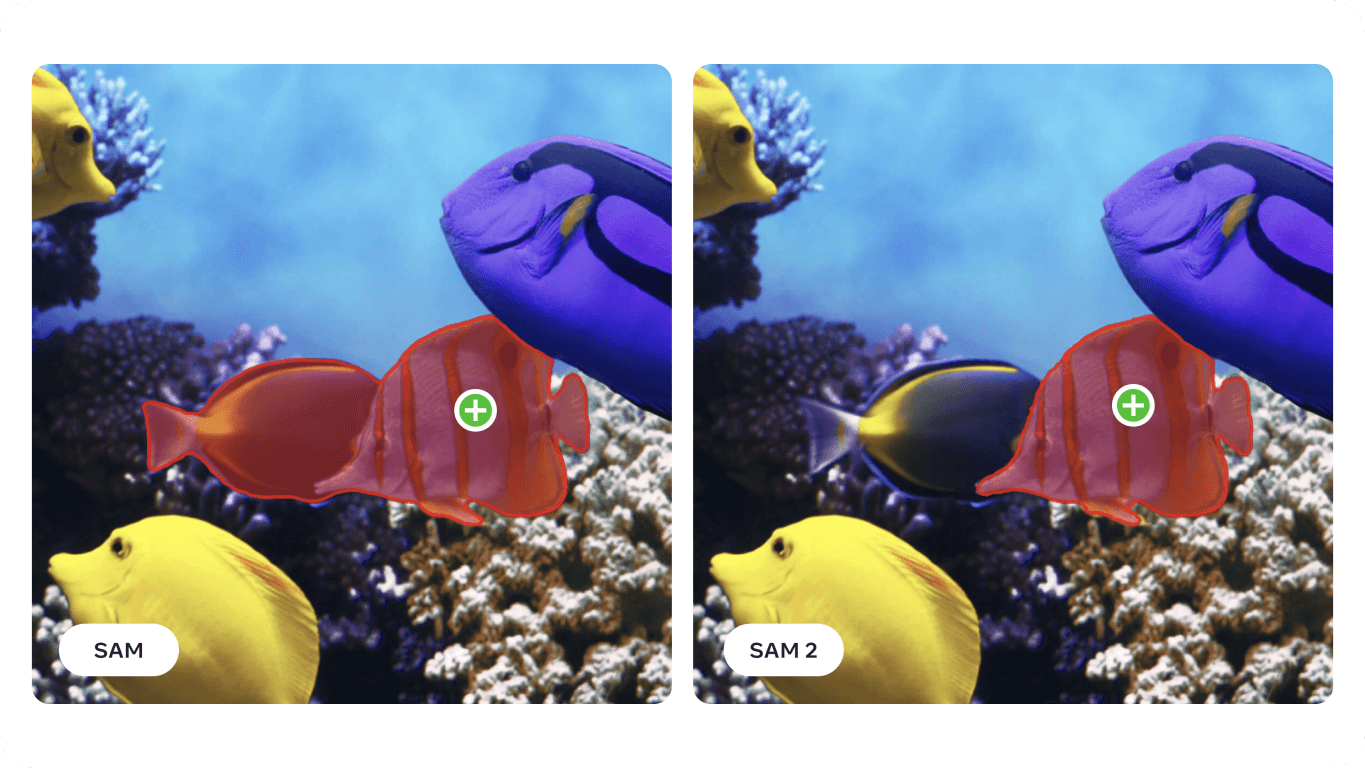

على وجه التحديد، فيما يتعلق بتجزئة الفيديو، يحقق SAM 2 دقة أعلى مع تفاعلات أقل بثلاثة أضعاف من المستخدم مقارنةً بالطرق السابقة. بالنسبة إلى تجزئة الصور، يتفوق SAM 2 على نموذج تجزئة أي شيء الأصلي (SAM)، حيث إنه أسرع وأكثر دقة بست مرات. وقد تم عرض هذا التحسن في الورقة البحثية SAM 2 عبر 37 مجموعة بيانات مختلفة، بما في ذلك 23 مجموعة بيانات تم اختبار SAM عليها سابقًا.

ومن المثير للاهتمام، تم تطوير SAM 2 من Meta AI من خلال إنشاء أكبر مجموعة بيانات تجزئة للفيديو حتى الآن، وهي مجموعة بيانات SA-V. تتضمن مجموعة البيانات الشاملة أكثر من 50,000 مقطع فيديو و35.5 مليون قناع تجزئة وتم جمعها من خلال مساهمات المستخدمين التفاعلية. قدم المعلقون مطالبات وتصحيحات لمساعدة النموذج على التعلم من مجموعة واسعة من السيناريوهات وأنواع الكائنات.

بفضل قدراته المتقدمة في تجزئة الصور والفيديو، يمكن استخدام SAM 2 في مختلف الصناعات. دعنا نستكشف بعض هذه التطبيقات.

يمكن استخدام نموذج التجزئة الجديد من Meta AI في تطبيقات الواقع المعزز (AR) والواقع الافتراضي (VR). على سبيل المثال، يمكن لـ SAM 2 تحديد segment الأجسام في العالم الحقيقي بدقة وجعل التفاعل مع الأجسام الافتراضية أكثر واقعية. يمكن أن يكون مفيدًا في مجالات مختلفة مثل الألعاب والتعليم والتدريب، حيث يكون التفاعل الواقعي بين العناصر الافتراضية والحقيقية أمرًا ضروريًا.

مع تطور الأجهزة مثل نظارات الواقع المعزز التي أصبحت أكثر تطوراً، يمكن دمج قدرات SAM 2 فيها قريباً. تخيل ارتداء النظارة والنظر حول غرفة المعيشة الخاصة بك. عندما segment النظارات وتلاحظ وعاء الماء الخاص بكلبك، فقد تذكرك بإعادة ملئه، كما هو موضح في الصورة أدناه. أو، إذا كنت تطبخ وصفة جديدة، يمكن للنظارات أن تحدد المكونات الموجودة على سطح الطاولة وتوفر لك الإرشادات والنصائح خطوة بخطوة، مما يحسن من تجربة الطهي ويضمن حصولك على جميع العناصر الضرورية في متناول يدك.

أظهرت الأبحاث باستخدام نموذج SAM أنه يمكن تطبيقه في مجالات متخصصة مثل التصوير بالسونار. ينطوي التصوير بالسونار على تحديات فريدة من نوعها بسبب دقته المنخفضة ومستويات التشويش العالية والأشكال المعقدة للأجسام داخل الصور. من خلال ضبط SAM لصور السونار بشكل دقيق، أثبت الباحثون قدرتها على segment الأجسام المختلفة تحت الماء بدقة مثل الحطام البحري والتكوينات الجيولوجية وغيرها من العناصر ذات الأهمية. يمكن استخدام التصوير الدقيق والموثوق تحت الماء في الأبحاث البحرية، وعلم الآثار تحت الماء، وإدارة مصايد الأسماك، والمراقبة لمهام مثل رسم خرائط الموائل واكتشاف القطع الأثرية والكشف عن التهديدات.

%25252525201.png)

نظرًا لأن SAM 2 يعتمد على العديد من التحديات التي تواجه SAM ويحسنها، فإن لديه القدرة على تحسين تحليل التصوير بالسونار بشكل أكبر. يمكن أن تساعد قدرات التجزئة الدقيقة في مختلف التطبيقات البحرية، بما في ذلك البحث العلمي ومصائد الأسماك. على سبيل المثال، يمكن ل SAM 2 تحديد الهياكل تحت الماء بشكل فعال، detect الحطام البحري، وتحديد الأجسام في صور السونار ذات الرؤية الأمامية، مما يساهم في الاستكشاف والرصد تحت الماء بشكل أكثر دقة وكفاءة.

فيما يلي الفوائد المحتملة لاستخدام SAM 2 لتحليل التصوير بالسونار:

من خلال دمج SAM 2 في عمليات التصوير بالسونار، يمكن للصناعة البحرية تحقيق كفاءة ودقة وموثوقية أعلى في الاستكشاف والتحليل تحت الماء، مما يؤدي في النهاية إلى نتائج أفضل في الأبحاث البحرية.

هناك تطبيق آخر ل SAM 2 في المركبات ذاتية القيادة. يمكن ل SAM 2 تحديد الأجسام بدقة مثل المشاة والمركبات الأخرى وعلامات الطريق والعوائق في الوقت الفعلي. يُعد مستوى التفاصيل التي يمكن أن يوفرها SAM 2 ضرورياً لاتخاذ قرارات الملاحة الآمنة وتجنب الاصطدام. من خلال معالجة البيانات المرئية بدقة، تساعد SAM 2 في إنشاء خريطة مفصّلة وموثوقة للبيئة وتؤدي إلى اتخاذ قرارات أفضل.

إن قدرة SAM 2 على العمل بشكل جيد في ظروف الإضاءة المختلفة وتغيرات الطقس والبيئات الديناميكية تجعلها موثوقة للمركبات ذاتية القيادة. سواء أكان شارعاً حضرياً مزدحماً أو طريقاً سريعاً ضبابياً، يمكن لـ SAM 2 تحديد الأجسام segment بدقة باستمرار حتى تتمكن السيارة من الاستجابة بشكل صحيح لمختلف المواقف.

ومع ذلك، هناك بعض القيود التي يجب وضعها في الاعتبار. بالنسبة للأجسام المعقدة وسريعة الحركة، يمكن أن تفوت SAM 2 في بعض الأحيان التفاصيل الدقيقة، ويمكن أن تصبح تنبؤاتها غير مستقرة عبر الإطارات. كما يمكن أن تخلط SAM 2 في بعض الأحيان بين العديد من الأجسام المتشابهة في المشاهد المزدحمة. هذه التحديات هي السبب في أن تكامل أجهزة الاستشعار والتقنيات الإضافية أمر محوري في تطبيقات القيادة الذاتية.

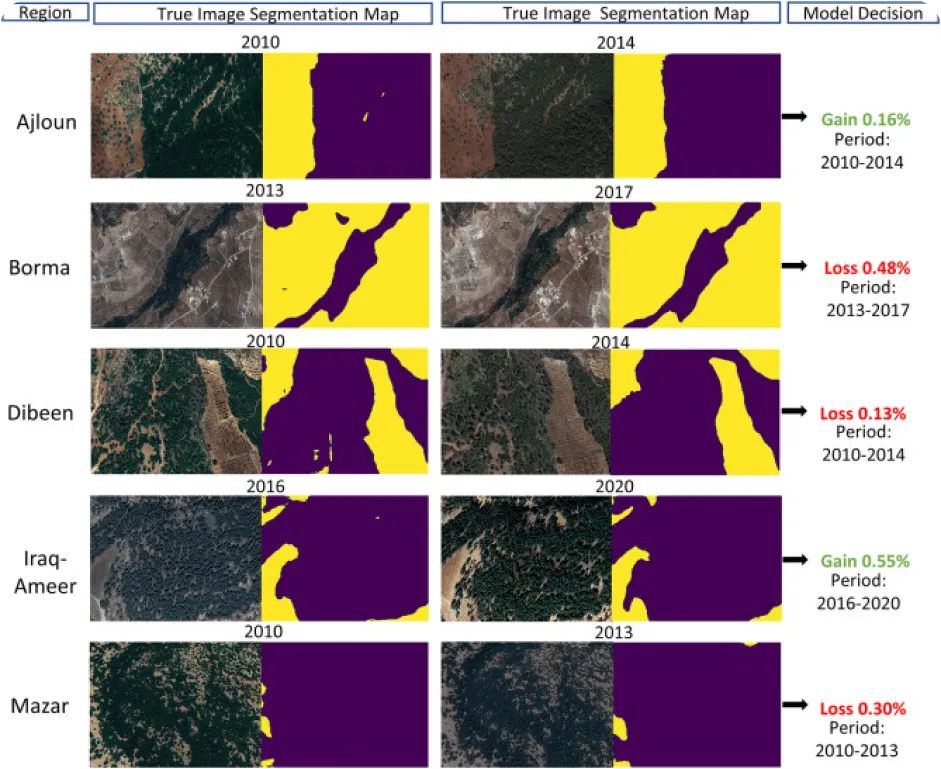

قد يكون الرصد البيئي باستخدام الرؤية الحاسوبية أمرًا صعبًا، خاصةً عندما يكون هناك نقص في البيانات المشروحة، ولكن هذا أيضًا ما يجعلها تطبيقًا مثيرًا للاهتمام لـ SAM 2. يمكن استخدام SAM 2 track وتحليل التغييرات في المناظر الطبيعية من خلال تجزئة وتحديد السمات البيئية المختلفة بدقة مثل الغابات والمسطحات المائية والمناطق الحضرية والأراضي الزراعية من صور الأقمار الصناعية أو صور الطائرات بدون طيار. على وجه التحديد، يساعد التجزئة الدقيقة في رصد إزالة الغابات والتوسع الحضري والتغيرات في استخدام الأراضي بمرور الوقت لتوفير بيانات قيمة للحفاظ على البيئة والتخطيط.

فيما يلي بعض فوائد استخدام نموذج مثل SAM 2 لتحليل التغيرات البيئية مع مرور الوقت:

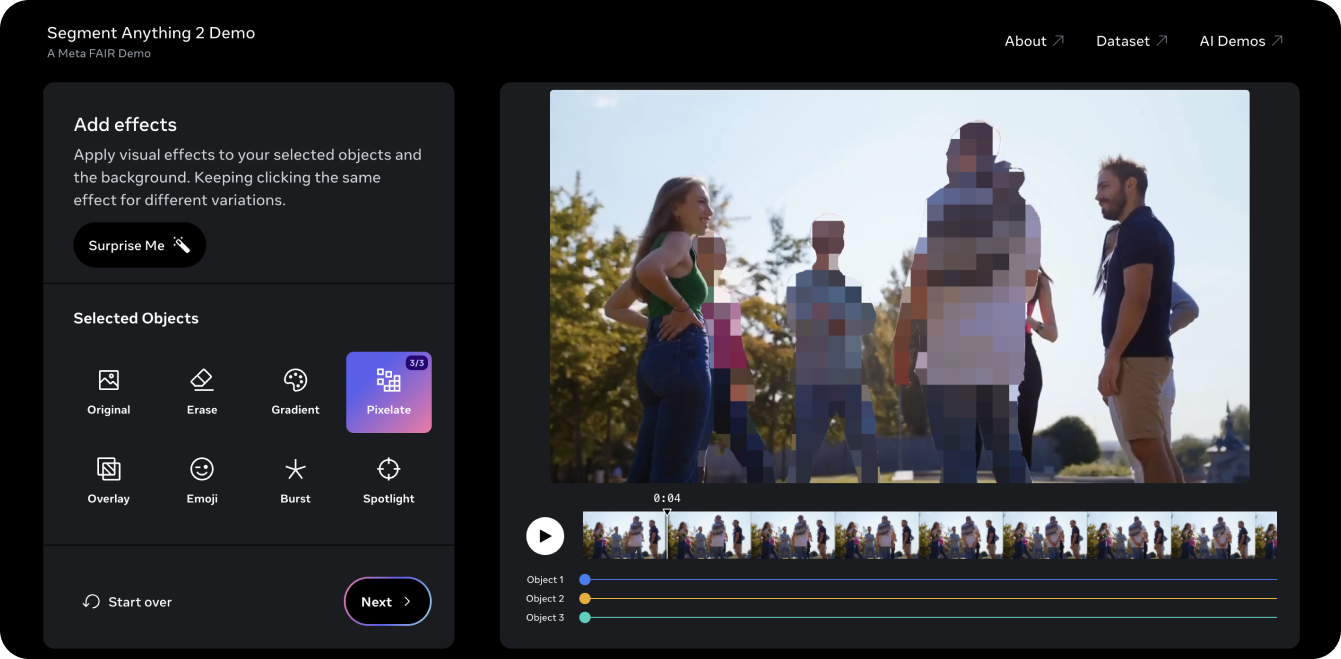

يعد العرض التوضيحي Segment Anything 2 طريقة رائعة لتجربة النموذج على مقطع فيديو. باستخدام إمكانيات PVS في SAM 2، أخذنا مقطع فيديو قديم من Ultralytics على YouTube وتمكنا من segment ثلاثة أشياء أو أشخاص في الفيديو وتقطيعهم. تقليدياً، كان تحرير ثلاثة أفراد من مقطع فيديو كهذا يستغرق وقتاً طويلاً ومضنيًا ويتطلب إخفاء يدويًا إطارًا تلو الآخر. ومع ذلك، فإن SAM 2 يبسِّط هذه العملية. من خلال بضع نقرات على العرض التوضيحي، يمكنك حماية هوية ثلاثة أشياء ذات أهمية في غضون ثوانٍ معدودة.

يتيح لك العرض التوضيحي أيضًا تجربة بعض المؤثرات البصرية المختلفة، مثل تسليط الضوء على الأجسام التي تحددها للتتبع ومسح الأجسام التي يتم تتبعها. إذا أعجبك العرض التوضيحي وكنت مستعدًا لبدء الابتكار باستخدام SAM 2، فراجع صفحة مستندات نموذجSAM 2 من Ultralytics للحصول على إرشادات مفصلة حول كيفية استخدام النموذج بشكل عملي. استكشف الميزات وخطوات التثبيت والأمثلة للاستفادة الكاملة من إمكانات SAM 2 في مشاريعك!

يعمل نموذج تقسيم أي شيء من Meta AI's Segment Anything Model 2SAM 2) على تحويل تقسيم الفيديو والصور. مع تحسن مهام مثل تتبع الأشياء، نكتشف فرصًا جديدة في تحرير الفيديو والواقع المختلط والبحث العلمي والتصوير الطبي. من خلال جعل المهام المعقدة أسهل وتسريع عمليات التجزئة التوضيحية وتسريعها، تم إعداد SAM 2 ليصبح أداة مهمة لمجتمع الذكاء الاصطناعي. مع استمرارنا في الاستكشاف والابتكار باستخدام نماذج مثل SAM 2، يمكننا أن نتوقع المزيد من التطبيقات الرائدة والتطورات في مختلف المجالات!

تعرف على المزيد حول الذكاء الاصطناعي من خلال استكشاف مستودع GitHub الخاص بنا والانضمام إلى مجتمعنا. تحقق من صفحات الحلول الخاصة بنا للحصول على رؤى تفصيلية حول الذكاء الاصطناعي في التصنيع و الرعاية الصحية. 🚀

ابدأ رحلتك مع مستقبل تعلم الآلة