Erfahren Sie, warum Ultralytics einfacher in die Produktion zu integrieren ist!

Sehen Sie, wie Ultralytics Forschung und Produktion mit einem Edge-First-Design verbindet, das die Bereitstellung und Integration vereinfacht.

.webp)

Sehen Sie, wie Ultralytics Forschung und Produktion mit einem Edge-First-Design verbindet, das die Bereitstellung und Integration vereinfacht.

.webp)

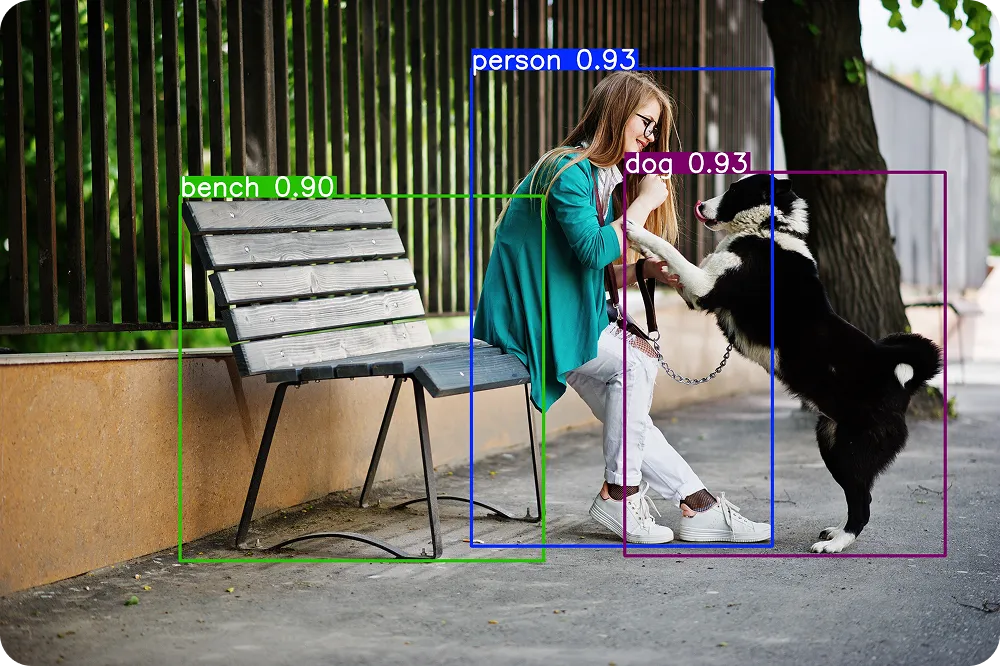

Ultralytics , unser neuestes Computer-Vision-Modell, ist ein wichtiger Schritt, um Echtzeit-Computer-Vision-Lösungen einfacher einsetzbar zu machen. Mit anderen Worten: Es ist so konzipiert, dass es reibungsloser von der Experimentierphase in Systeme übergeht, die kontinuierlich auf echter Hardware laufen.

Computer Vision wird mittlerweile in vielen realen Anwendungen eingesetzt, darunter Fertigung, Robotik, Einzelhandel und Infrastruktur. Da diese Systeme nun vom Testbetrieb in den Alltag übergehen, verlagert sich der Fokus von der Leistung einzelner Modelle hin zur Frage, wie gut sich das Modell in ein größeres Softwaresystem einfügt. Faktoren wie Zuverlässigkeit, Effizienz und einfache Integration sind ebenso wichtig wie Genauigkeit.

Diese Veränderung hat wichtige Auswirkungen auf die Art und Weise, wie Computer-Vision-Modelle entwickelt und bewertet werden. Der Erfolg in der Produktion hängt nicht nur davon ab, was ein Modell detect kann, sondern auch davon, wie einfach es integriert, eingesetzt und langfristig gewartet werden kann.

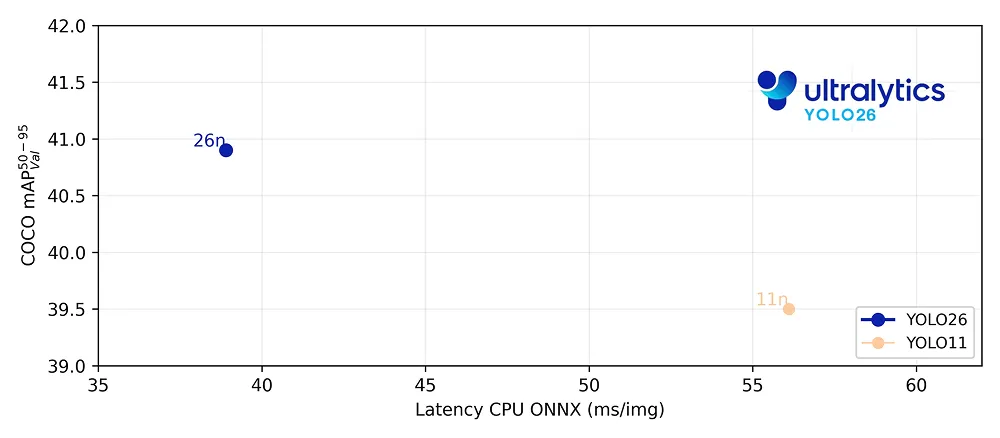

YOLO26 wurde unter Berücksichtigung dieser praktischen Anforderungen entwickelt. Durch die Konzentration auf End-to-End-Inferenz, Edge-First-Leistung und einfachere Integration reduziert es die Komplexität im gesamten Bereitstellungsprozess.

In diesem Artikel untersuchen wir, wie Ultralytics dazu beiträgt, die Lücke zwischen Forschung und Produktion zu schließen, und warum seine Funktionen die Implementierung von Echtzeit-Computervisionsystemen in realen Anwendungen vereinfachen. Los geht's!

Da Computer Vision immer häufiger zum Einsatz kommt, gehen viele Teams über die Forschung hinaus und beginnen damit, Modelle in realen Anwendungen einzusetzen. Dieser nächste Schritt in Richtung Produktion bringt oft Herausforderungen mit sich, die während der Experimentierphase nicht sichtbar waren.

In Forschungsumgebungen werden Modelle in der Regel in kontrollierten Umgebungen unter Verwendung fester Datensätze getestet. Diese Tests sind nützlich, um die Genauigkeit zu messen, aber sie spiegeln nicht vollständig wider, wie sich ein Modell nach seiner Einführung verhalten wird. In der Produktion müssen Computer-Vision-Systeme Live-Daten verarbeiten, kontinuierlich laufen und auf realer Hardware neben anderer Software betrieben werden.

Sobald ein Modell Teil eines Produktionssystems ist, gewinnen Faktoren, die über die Genauigkeit hinausgehen, an Bedeutung. Inferenz-Pipelines können zusätzliche Schritte umfassen, die Leistung kann je nach Gerät variieren und Systeme müssen sich im Laufe der Zeit konsistent verhalten. Diese praktischen Überlegungen beeinflussen, wie einfach ein Modell integriert und gewartet werden kann, wenn Anwendungen skaliert werden.

Aufgrund dieser Faktoren geht es beim Übergang von der Forschung zur Produktion oft weniger um die Verbesserung der Modellergebnisse als vielmehr um die Vereinfachung der Bereitstellung und des Betriebs. Modelle, die sich leichter integrieren lassen, auf der Zielhardware effizient laufen und sich vorhersehbar verhalten, lassen sich in der Regel reibungsloser in die Produktion überführen.

Ultralytics wurde mit Blick auf diesen Übergang entwickelt. Durch die Reduzierung der Komplexität im gesamten Bereitstellungsprozess können Teams Computer-Vision-Modelle effizienter von der Experimentierphase in die reale Produktion überführen.

Einer der Hauptgründe, warum Ultralytics praktischer einzusetzen ist, ist sein End-to-End-Inferenzdesign. Einfach ausgedrückt bedeutet dies, dass das Modell so konzipiert ist, dass es direkt endgültige Vorhersagen liefert, ohne auf zusätzliche Nachbearbeitungsschritte außerhalb des Modells selbst angewiesen zu sein.

In vielen herkömmlichen Computer-Vision-Systemen endet die Inferenz nicht, wenn das Modell seine Ausführung beendet hat. Stattdessen gibt das Modell eine große Anzahl von Zwischenvorhersagen aus, die gefiltert und verfeinert werden müssen, bevor sie verwendet werden können.

Diese zusätzlichen Schritte werden häufig in einer separaten Nachbearbeitungsphase namens Non-Maximum Suppression (NMS) durchgeführt, was das Gesamtsystem komplexer macht. In Produktionsumgebungen kann diese Komplexität ein Problem darstellen.

Nachbearbeitungsschritte können die Latenz erhöhen, sich auf verschiedenen Hardwareplattformen unterschiedlich verhalten und zusätzliche Integrationsarbeiten erfordern. Außerdem führen sie zu mehr Komponenten, die getestet, gewartet und bei der Skalierung der Systeme konsistent gehalten werden müssen.

YOLO26 verfolgt einen anderen Ansatz. Durch die Auflösung doppelter Vorhersagen und die Erzeugung endgültiger Ergebnisse innerhalb des Modells wird die Anzahl der erforderlichen Schritte in der Inferenz-Pipeline reduziert. Dies vereinfacht die Bereitstellung, da weniger externe Logik verwaltet werden muss und weniger Möglichkeiten für Inkonsistenzen zwischen den Umgebungen bestehen.

Für Teams, die Bildverarbeitungssysteme einsetzen, vereinfacht dieses durchgängige, NMS Design die Integration. Das Modell verhält sich nach der Bereitstellung vorhersehbarer, und exportierte Modelle, also Versionen, die für die Ausführung außerhalb der Trainingsumgebung auf der Zielhardware vorbereitet sind, sind eigenständiger.

Dadurch entspricht das, was während der Entwicklung getestet wird, besser dem, was in der Produktion läuft. Dadurch lässt sich Ultralytics leichter in reale Softwaresysteme integrieren und einfacher in großem Maßstab bereitstellen.

Über die End-to-End-Inferenz hinaus umfasst Ultralytics eine Reihe von Leistungs- und Trainingsoptionen, die darauf ausgelegt sind, die Produktionsbereitstellung vorhersehbarer zu machen.

Hier sind einige der wichtigsten Funktionen, die Ultralytics einfacher zu versenden und in der Produktion zu betreiben machen:

Insgesamt tragen diese Innovationen dazu bei, das Risiko und die Komplexität der Bereitstellung von Computer-Vision-Systemen in der Produktion zu reduzieren. Durch die Kombination von Edge-First-Leistung mit stabilerem Training und vorhersehbarem Modellverhalten erleichtert Ultralytics Teams den Übergang von der Entwicklung zur realen Bereitstellung.

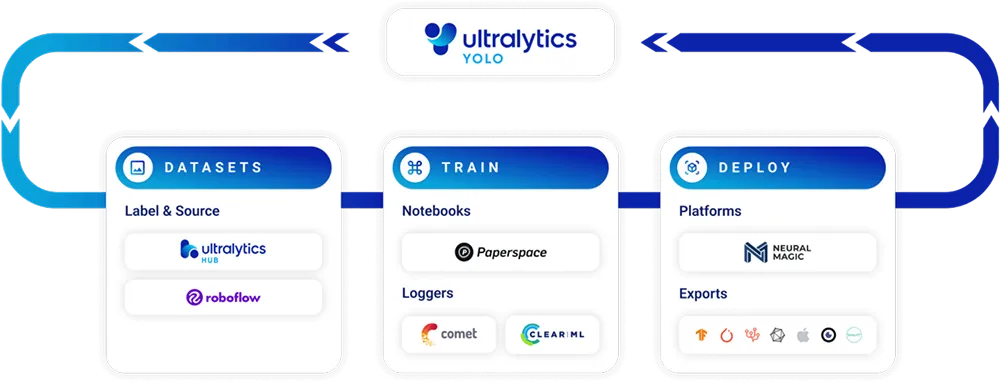

Bei der Bereitstellung eines Computer-Vision-Modells geht es selten nur um das Modell selbst. In der Produktion müssen Teams Modelle trainieren, Inferenzläufe durchführen, die Leistung überwachen und Modelle in Formate exportieren, die auf verschiedenen Plattformen und Hardware funktionieren. Jedes zusätzliche Tool oder benutzerdefinierte Skript in dieser Pipeline erhöht die Komplexität und das Ausfallrisiko.

Das Ultralytics wurde entwickelt, um diese Komplexität zu reduzieren, indem diese Schritte in einem einzigen, konsistenten Workflow zusammengefasst werden. Mit einer einzigen Bibliothek können Teams Modelle wie YOLO26 trainieren, Vorhersagen durchführen, Ergebnisse validieren und Modelle für die Bereitstellung exportieren, ohne zwischen Tools wechseln oder Integrationscode neu schreiben zu müssen.

Es unterstützt außerdem eine Vielzahl von Integrationen über den gesamten Lebenszyklus hinweg, von der Schulung und Bewertung bis hin zum Export und zur Bereitstellung auf verschiedenen Hardware-Zielen. Dieser einheitliche Ansatz macht in Produktionsumgebungen einen Unterschied.

Die gleichen Befehle und Schnittstellen, die während der Experimentierphase verwendet werden, werden auch bei der Bereitstellung verwendet, wodurch Reibungsverluste zwischen Forschungs-, Entwicklungs- und Betriebsteams reduziert werden. Der Export von Modellen wird ebenfalls vorhersehbarer, da YOLO26-Modelle direkt in Formate wie ONNX, TensorRT, CoreML, OpenVINO und andere konvertiert werden können, die häufig in Produktionssystemen verwendet werden.

Durch die Minimierung von Glue-Code und benutzerdefinierten Integrationsarbeiten hilft das Ultralytics Teams dabei, sich auf die Entwicklung zuverlässiger Anwendungen zu konzentrieren, anstatt komplexe Pipelines zu warten. Dadurch wird es einfacher, Bereitstellungen zu skalieren, Modelle im Laufe der Zeit zu aktualisieren und das Verhalten in Entwicklungs- und Produktionsumgebungen konsistent zu halten.

Als Nächstes wollen wir uns ansehen, wie Ultralytics in realen Anwendungen eingesetzt werden kann, die zuverlässige, produktionsreife Computer-Vision-Funktionen erfordern.

Robotersysteme sind auf eine schnelle und zuverlässige Wahrnehmung angewiesen, um sicher und effektiv zu funktionieren. Ob es sich nun um einen autonomen mobilen Roboter handelt, der sich in einem Lagerhaus bewegt, oder um einen Roboterarm, der Objekte auf einem Fließband handhabt – Bildverarbeitungsmodelle müssen konsistente Ergebnisse mit minimaler Latenz liefern.

Ultralytics kann detect , Objekte identifizieren und die Anwesenheit von Menschen direkt auf Roboterhardware überwachen. Sein End-to-End-Inferenzdesign vereinfacht die Integration in Robotersteuerungssoftware und erleichtert den Einsatz von Bildverarbeitungsfunktionen, die kontinuierlich in realen Umgebungen laufen.

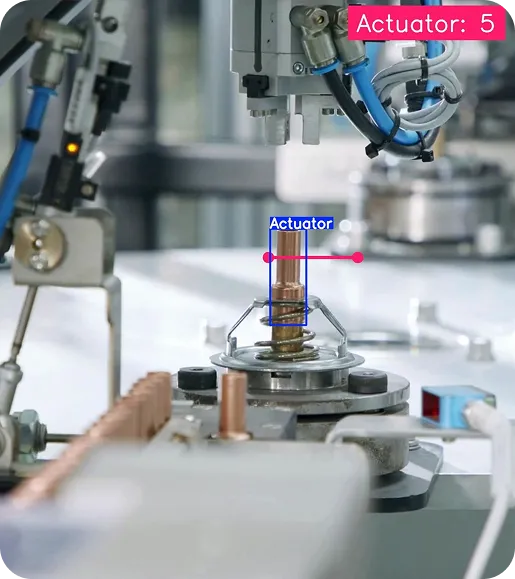

In Fabrikhallen wird Computer Vision häufig eingesetzt, um Anlagen zu überwachen, Produkte zu prüfen und sicherzustellen, dass Prozesse innerhalb sicherer Betriebsgrenzen bleiben. YOLO26 kann auf lokaler Industriehardware eingesetzt werden, um detect , Montageschritte zu überprüfen oder track Bewegung mechanischer Komponenten in Echtzeit track .

Seine Fähigkeit, effizient auf Edge-Geräten zu laufen, macht es besonders geeignet für Produktionslinien, in denen Systeme kontinuierlich mit geringer Latenz und minimalem Infrastruktur-Overhead betrieben werden müssen.

Drohnen und Fernsteuerungssysteme arbeiten oft mit begrenzter Leistung und unzuverlässiger Konnektivität. YOLO26 kann visuelle Daten direkt auf dem Gerät verarbeiten und ermöglicht so Aufgaben wie Inspektion, Vermessung oder Überwachung während des Fluges. Durch die lokale Analyse von Bildern können Systeme in Echtzeit reagieren und müssen weniger große Datenmengen an einen zentralen Standort zurückübertragen.

Stellen Sie sich eine Stadt vor, die Kameras an Kreuzungen, in öffentlichen Parks und an Verkehrsknotenpunkten installiert. An jedem Standort kann unterschiedliche Hardware zum Einsatz kommen und es können unterschiedliche Bedingungen herrschen, aber das Bildverarbeitungssystem muss dennoch konsistent funktionieren.

Ultralytics kann bei der Analyse dieser Videostreams für Aufgaben wie Verkehrsüberwachung, Fußgängererkennung oder Analyse öffentlicher Räume helfen. Dank seines vorhersehbaren Einsatzverhaltens und der Unterstützung mehrerer Hardwareplattformen lassen sich Bildverarbeitungssysteme in großen, verteilten städtischen Umgebungen einfacher einführen, aktualisieren und warten.

Für viele Unternehmen besteht die größte Herausforderung bei Vision AI nicht darin, ein Modell zu entwickeln, das in einer Demo funktioniert. Vielmehr geht es darum, dieses Modell in ein System zu verwandeln, das in der Produktion zuverlässig läuft.

Die Bereitstellung erfordert oft einen erheblichen technischen Aufwand, laufende Wartungsarbeiten und die Koordination zwischen verschiedenen Teams, was Projekte verlangsamen oder deren Wirkung einschränken kann. Wenn Modelle einfach zu versenden sind, verändert dies die Geschäftsgleichung.

Eine schnellere Bereitstellung verkürzt die Amortisationszeit. Eine einfachere Integration senkt die Entwicklungs- und Betriebskosten. Ein besser vorhersehbares Verhalten in allen Umgebungen reduziert Risiken und erleichtert die langfristige Planung.

Ultralytics wurde unter Berücksichtigung dieser Faktoren entwickelt. Die Vereinfachung der Bereitstellung und die Unterstützung eines konsistenten Verhaltens in der Produktion helfen Unternehmen dabei, Vision AI vom Experimentierstadium in den täglichen Einsatz zu überführen. Für Führungskräfte in der Wirtschaft wird Computer Vision dadurch zu einer praktischeren und zuverlässigeren Investition und nicht mehr zu einem risikoreichen Forschungsvorhaben.

Ultralytics wurde entwickelt, um die Lücke zwischen Forschung und Produktion zu schließen, indem es die Bereitstellung und Wartung von Echtzeit-Computervision vereinfacht. Sein End-to-End-Design und seine Edge-First-Leistung reduzieren die Komplexität, die Vision-AI-Projekte oft verlangsamt. Dadurch können Unternehmen schneller vorankommen und schneller einen Mehrwert erzielen.

Treten Sie unserer Community bei und entdecken Sie unser GitHub-Repository, um mehr über KI zu erfahren. Auf unseren Lösungsseiten finden Sie Informationen zu KI im Einzelhandel und Computer Vision in der Landwirtschaft. Entdecken Sie unsere Lizenzoptionen und beginnen Sie noch heute mit der Entwicklung von Computer Vision!

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens