Scopri cos'è l'elaborazione delle immagini, come funziona e come viene applicata nel settore sanitario, nella guida autonoma e in altri sistemi intelligenti moderni.

Scopri cos'è l'elaborazione delle immagini, come funziona e come viene applicata nel settore sanitario, nella guida autonoma e in altri sistemi intelligenti moderni.

Quando cammini in un centro commerciale o in una strada pubblica affollata, le telecamere montate sopra gli ingressi e i passaggi pedonali registrano l'attività. Generano dati visivi ogni secondo e, il più delle volte, non ce ne accorgiamo nemmeno.

Questo flusso costante di dati alimenta i moderni sistemi basati sull'intelligenza artificiale, dai sistemi di sicurezza intelligenti alle auto a guida autonoma. Queste innovazioni sono guidate dall'image computing, un campo versatile che riunisce informatica, matematica e fisica.

L'elaborazione delle immagini aiuta le macchine a comprendere ciò che vedono in un'immagine. Consente ai sistemi di riconoscere ciò che sta accadendo in una scena e decidere come funzionare o reagire, ad esempio fermando un'auto a guida autonoma quando compare un ostacolo.

In questo articolo esploreremo cos'è l'elaborazione delle immagini e come viene utilizzata nei sistemi di intelligenza artificiale (AI) all'avanguardia. Cominciamo!

L'elaborazione delle immagini è il processo di acquisizione, elaborazione e analisi delle immagini mediante algoritmi avanzati. Tratta le immagini come dati che le macchine possono comprendere e con cui possono lavorare.

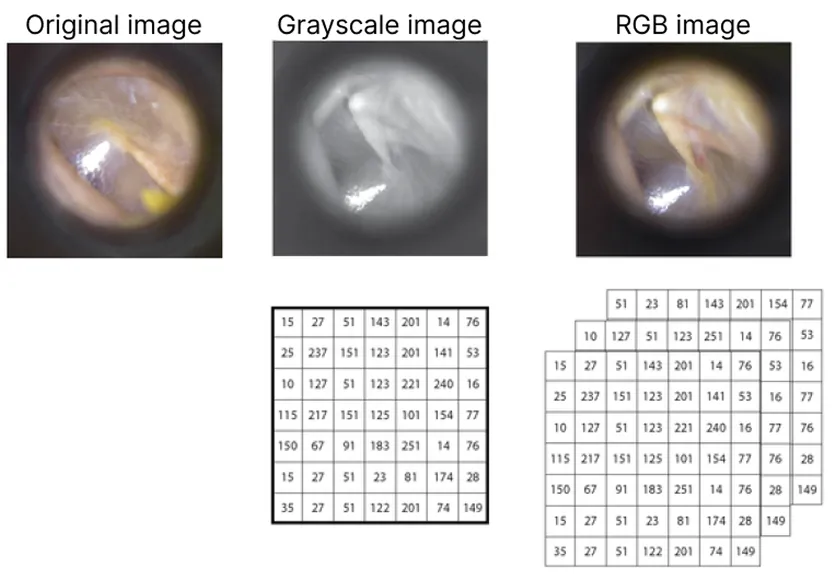

In altre parole, ogni immagine viene elaborata come una griglia di numeri. Ciò avviene convertendo i pixel, le unità più piccole di un'immagine, in una matrice composta da righe e colonne. Ogni pixel ha un valore numerico che indica alla macchina quanto è chiara o scura una determinata area dell'immagine.

Il modo in cui questi valori sono organizzati dipende dal fatto che l'immagine sia in scala di grigi o a colori. Nelle immagini in scala di grigi, i valori dei pixel variano in genere da 0 (nero) a 255 (bianco). Nelle immagini a colori, vengono utilizzate più matrici per rappresentare diversi canali di colore, come Rosso, Verde e Blu (RGB) o Tonalità, Saturazione e Valore (HSV).

Oltre alle matrici di pixel, un'immagine contiene spesso informazioni contestuali nascoste, note come metadati. I metadati forniscono dettagli importanti quali la risoluzione dell'immagine, la profondità di bit, le impostazioni della fotocamera o del sensore e l'ora esatta in cui l'immagine è stata scattata. Le immagini vengono memorizzate in formati di file specifici per preservare sia i dati visivi che i metadati.

Ad esempio, nell'elaborazione delle immagini biomediche, le immagini vengono comunemente archiviate utilizzando il formato DICOM (Digital Imaging and Communications in Medicine). Il formato DICOM combina i dati delle immagini visive con le informazioni sui pazienti, quali i dettagli identificativi e le impostazioni delle apparecchiature, garantendo che l'analisi delle immagini mediche sia accurata, coerente e sicura.

Ora che abbiamo una migliore comprensione di cosa sia l'elaborazione delle immagini, esaminiamo i passaggi utilizzati per convertire le immagini riprese da una telecamera in informazioni utili.

Sebbene il flusso di lavoro esatto possa variare a seconda dell'applicazione, la maggior parte dei sistemi di elaborazione delle immagini segue queste fasi principali:

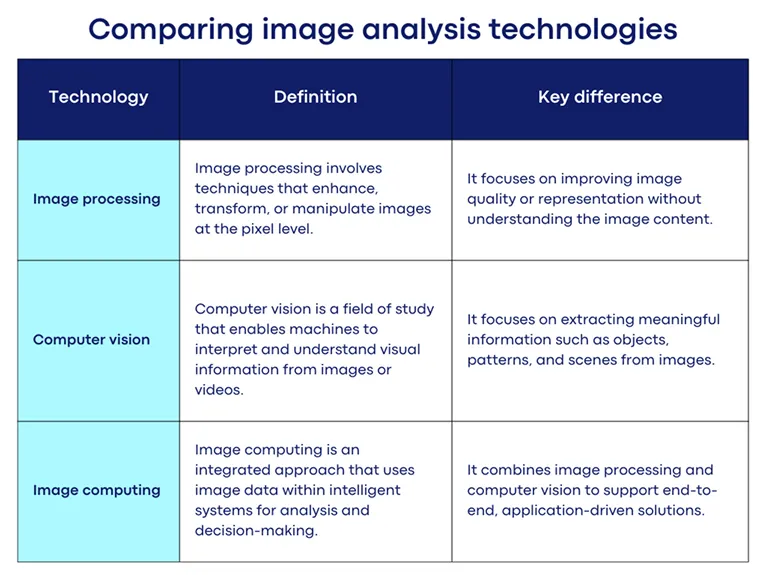

Quando si parla di elaborazione delle immagini, si possono incontrare anche termini come "elaborazione delle immagini" e "visione artificiale". Sebbene questi termini siano spesso usati in modo intercambiabile, descrivono modi diversi in cui i sistemi di intelligenza artificiale interagiscono con i dati visivi.

Ad esempio, l'elaborazione delle immagini si concentra sul miglioramento delle immagini o sulla qualità delle immagini in ingresso utilizzando operazioni di base quali la rimozione del rumore, il ridimensionamento e la regolazione del contrasto. Nel frattempo, la visione artificiale, che è una branca dell'IA, si basa sull'elaborazione delle immagini consentendo alle macchine di riconoscere oggetti, interpretare scene e comprendere ciò che accade nelle immagini o nei video.

L'elaborazione delle immagini combina l'elaborazione delle immagini e la visione artificiale per trasformare i dati visivi in risultati significativi e utilizzabili per i sistemi intelligenti.

Vediamo ora come viene implementato oggi il calcolo delle immagini.

Nelle prime fasi dell'elaborazione delle immagini, caratteristiche quali bordi, angoli e texture venivano definite manualmente utilizzando algoritmi basati su regole e creati ad hoc. Sebbene tali metodologie funzionassero abbastanza bene in ambienti controllati, avevano difficoltà a scalare e adattarsi alle complesse condizioni del mondo reale.

I moderni sistemi di elaborazione delle immagini superano questi limiti utilizzando approcci basati sul deep learning. Modelli come le reti neurali convoluzionali (CNN) e i trasformatori di visione apprendono automaticamente le caratteristiche rilevanti da grandi set di dati di immagini. Ciò consente loro di eseguire attività come il rilevamento di oggetti, la segmentazione di istanze e il tracciamento di oggetti con maggiore precisione e robustezza.

Oggi, i flussi di lavoro di elaborazione delle immagini si basano spesso su modelli di visione in tempo reale progettati per l'implementazione in sistemi di IA all'avanguardia. Ad esempio, i modelli di IA visiva come Ultralytics consentono funzionalità di visione artificiale rapide ed efficienti, come il rilevamento di oggetti e la segmentazione di istanze, sia su dispositivi edge che in ambienti cloud.

L'elaborazione delle immagini viene ampiamente utilizzata nelle applicazioni del mondo reale per comprendere e agire sui dati visivi. Esploriamo come l'elaborazione delle immagini viene applicata in diversi ambiti.

L'elaborazione delle immagini può aiutare medici e clinici a individuare le malattie in fase precoce e ad analizzare le scansioni mediche in modo più efficiente. Questi sistemi sanitari innovativi sono in grado di elaborare rapidamente dati di imaging medico quali radiografie e scansioni di risonanza magnetica (MRI) e spesso forniscono risultati più coerenti rispetto alla revisione manuale.

Ad esempio, modelli come Ultralytics possono essere addestrati su grandi serie di immagini radiografiche del torace per apprendere i modelli associati a infezioni e anomalie. Una volta addestrati, questi modelli possono aiutare a identificare se una scansione appare normale o mostra segni di patologie quali polmonite o COVID-19.

I veicoli autonomi utilizzano l'elaborazione delle immagini per comprendere ciò che accade intorno a loro e prendere decisioni di guida. La tecnologia trasforma le riprese grezze della telecamera in informazioni in tempo reale che aiutano il veicolo a muoversi in modo sicuro e fluido.

L'elaborazione delle immagini è comunemente utilizzata nei sistemi avanzati di assistenza alla guida (ADAS). Anziché limitarsi a registrare video, questi moduli analizzano ogni fotogramma per individuare la segnaletica orizzontale, altri veicoli, pedoni e ostacoli. Ciò consente all'auto di reagire alle mutevoli condizioni della strada con un intervento minimo da parte dell'uomo.

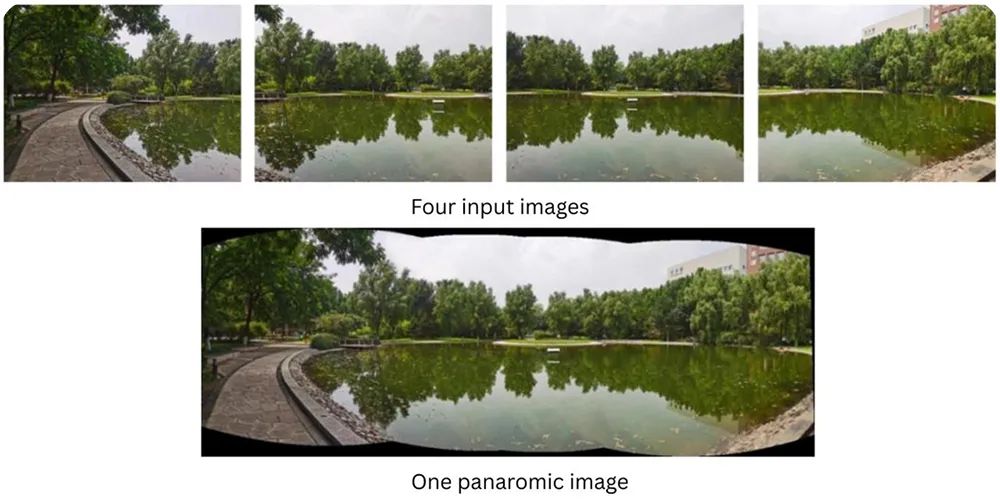

Un altro caso d'uso comune è la combinazione di immagini provenienti da più telecamere per creare una visione a 360 gradi dell'ambiente circostante il veicolo. L'elaborazione delle immagini aiuta a correggere la distorsione dell'obiettivo, migliorare la nitidezza dell'immagine e bilanciare la luminosità e il colore in tutti i feed delle telecamere. Il risultato è una visione chiara e senza interruzioni che consente al veicolo di navigare in sicurezza, anche in condizioni meteorologiche avverse o di scarsa illuminazione.

Ecco alcuni dei vantaggi dell'elaborazione delle immagini:

Sebbene l'elaborazione delle immagini offra numerosi vantaggi, presenta anche alcune limitazioni. Ecco alcuni fattori da considerare:

L'elaborazione delle immagini si è evoluta dalla semplice elaborazione delle immagini a una tecnologia che consente ai sistemi di intelligenza artificiale di percepire e comprendere il mondo reale in tempo reale. Con il continuo progresso del deep learning, l'elaborazione delle immagini sta diventando una parte essenziale della creazione di toolkit e applicazioni più intelligenti e pratici.

Entra a far parte della nostra community e dai un'occhiata al nostro repository GitHub per saperne di più sull'IA. Esplora le nostre pagine dedicate alle soluzioni per scoprire le applicazioni dell'IA nell'agricoltura e della visione artificiale nella logistica. Scopri le nostre opzioni di licenza e inizia a creare modelli di IA visiva.

Inizia il tuo viaggio con il futuro del machine learning