O que é a Transformada de Característica Invariante à Escala (SIFT)?

Explore o algoritmo SIFT. Saiba o que é SIFT, seus recursos poderosos para visão computacional invariante de escala. Melhore seu processamento de imagem.

Explore o algoritmo SIFT. Saiba o que é SIFT, seus recursos poderosos para visão computacional invariante de escala. Melhore seu processamento de imagem.

Para uma explicação visual dos conceitos abordados neste artigo, assista ao vídeo abaixo.

Hoje em dia, muitos dos dispositivos inteligentes que usamos, de telefones e câmeras a sistemas domésticos inteligentes, vêm com soluções de IA que podem reconhecer rostos, objetos e até mesmo cenas visuais inteiras. Essa capacidade vem da visão computacional, um campo da inteligência artificial que permite que as máquinas entendam e interpretem imagens e vídeos.

Por exemplo, se você tirar uma foto da Torre Eiffel de qualquer ângulo ou distância, seu dispositivo normalmente ainda consegue reconhecê-la usando visão computacional e organizá-la na pasta correta em sua galeria. Embora isso pareça simples, reconhecer objetos nem sempre é fácil. As imagens podem parecer muito diferentes dependendo de seu tamanho, ângulo, escala ou iluminação, o que dificulta que as máquinas as identifiquem de forma consistente.

Para ajudar a resolver este problema, os investigadores desenvolveram um algoritmo de visão por computador chamado Scale Invariant Feature Transform, ou SIFT. Este algoritmo permite detect objectos em diferentes condições de visualização. Criado por David Lowe em 1999, o SIFT foi concebido para encontrar e descrever pontos-chave únicos numa imagem, tais como cantos, arestas ou padrões que permanecem reconhecíveis mesmo quando a imagem é redimensionada, rodada ou iluminada de forma diferente.

Antes dos modelos de visão computacional orientados para a aprendizagem profunda, como o Ultralytics YOLO11 se tornarem populares, a SIFT era uma técnica amplamente utilizada na visão computacional. Era uma abordagem padrão para tarefas como o reconhecimento de objectos, em que o objetivo é identificar um item específico numa fotografia, e a correspondência de imagens, em que as fotografias são alinhadas encontrando caraterísticas de imagem sobrepostas.

Neste artigo, exploraremos o SIFT com uma visão geral rápida do que é, como funciona em alto nível e por que é importante na evolução da visão computacional. Vamos começar!

Em uma imagem, um objeto pode aparecer de muitas maneiras diferentes. Por exemplo, uma caneca de café pode ser fotografada de cima, de lado, sob luz solar forte ou sob uma lâmpada quente. A mesma caneca também pode parecer maior quando está perto da câmera e menor quando está mais longe.

Todas essas diferenças tornam a tarefa de ensinar um computador a reconhecer um objeto uma tarefa complicada. Essa tarefa de visão computacional, conhecida como detecção de objetos, exige que os modelos de Visão de IA identifiquem e localizem objetos com precisão, mesmo quando seu tamanho, ângulo ou condições de iluminação mudam.

Para tornar isto possível, a visão computacional depende de um processo chamado extração de características ou deteção. Em vez de tentar entender a imagem inteira de uma vez, um modelo procura características de imagem distintas, como cantos nítidos, padrões únicos ou texturas que permanecem reconhecíveis em diferentes ângulos, escalas e condições de iluminação.

Em particular, era para isso que o Scale Invariant Feature Transform, ou SIFT, foi projetado. O SIFT é um algoritmo de detecção e descrição de características que pode identificar objetos de forma confiável em imagens, independentemente de como são capturadas.

O algoritmo SIFT tem algumas propriedades importantes que o tornam útil para o reconhecimento de objetos. Uma das principais propriedades é chamada de invariância de escala. Isso significa que o SIFT pode reconhecer várias partes de um objeto, quer ele pareça grande e esteja perto da câmera ou pequeno e distante. Mesmo que o objeto não esteja completamente visível, o algoritmo ainda pode identificar os mesmos pontos-chave.

Ele faz isso usando um conceito chamado teoria do espaço de escala. Simplificando, a imagem é desfocada em diferentes níveis para criar múltiplas versões. O SIFT então procura nessas versões para encontrar padrões e detalhes que permanecem os mesmos, independentemente de como a imagem muda de tamanho ou nitidez.

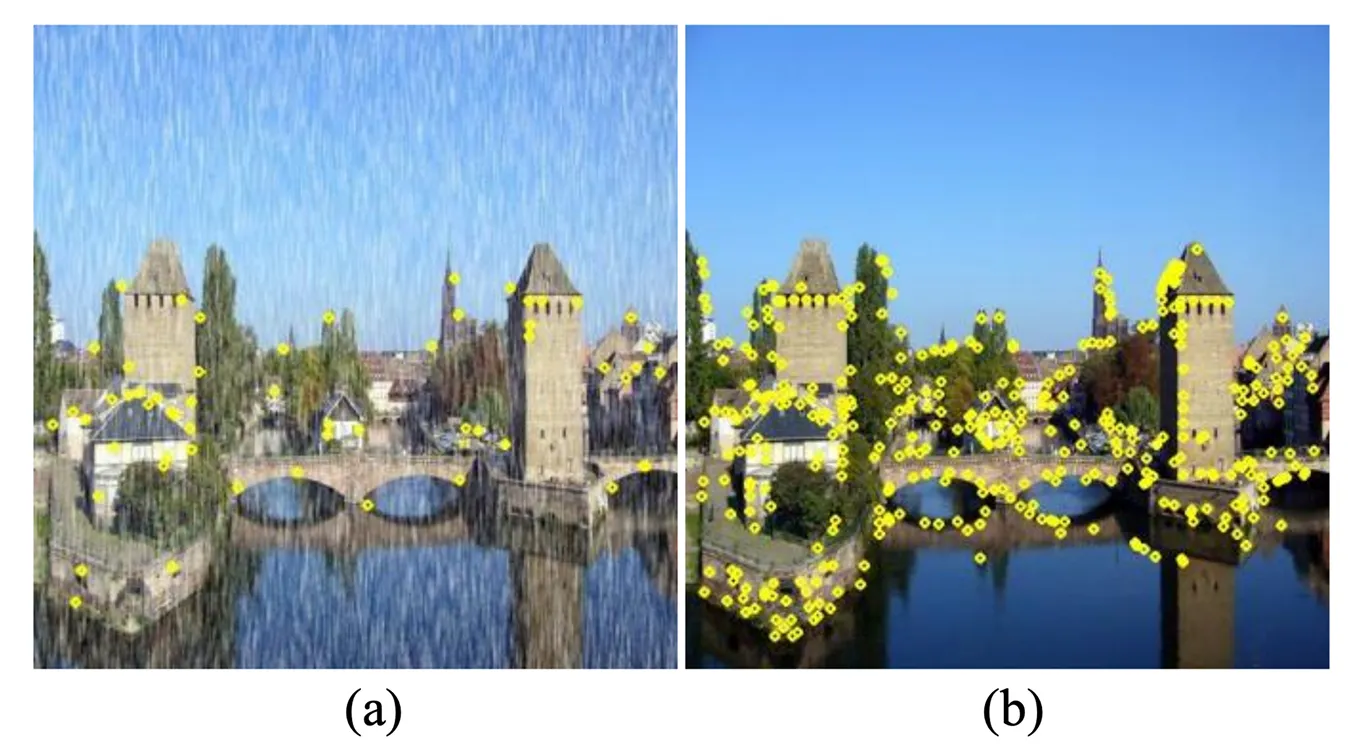

Por exemplo, um sinal de trânsito fotografado a alguns metros de distância parecerá muito maior do que o mesmo sinal capturado à distância, mas a SIFT consegue detect as mesmas caraterísticas distintivas. Isto permite fazer corresponder corretamente as duas imagens, mesmo que o sinal apareça a escalas muito diferentes.

Os objetos nas imagens também podem aparecer rodados, por vezes até de cabeça para baixo. O SIFT lida com isto através de uma propriedade chamada invariância de rotação. Para cada ponto-chave que deteta, o algoritmo atribui uma orientação consistente com base nos gradientes de imagem locais. Desta forma, o mesmo objeto pode ser reconhecido independentemente de como é rodado.

Pode pensar nisso como marcar cada ponto-chave com uma pequena seta que mostra a direção para a qual ele está virado. Ao alinhar as características a estas orientações, o SIFT garante que os pontos-chave correspondem corretamente, mesmo quando o objeto é rodado. Por exemplo, um ponto de referência capturado numa foto de paisagem pode ainda ser identificado corretamente, mesmo que outra foto do mesmo seja tirada com a câmara inclinada num ângulo.

Além do tamanho e da rotação, as imagens também podem mudar de outras maneiras, como alterações na iluminação. A iluminação em um objeto pode passar de clara para escura, o ângulo da câmera pode mudar ligeiramente ou a imagem pode ficar borrada ou ruidosa.

O SIFT foi construído para lidar com estes tipos de variações. Ele faz isto focando-se em pontos-chave que são distintos e com alto contraste, uma vez que estas características são menos afetadas por mudanças na iluminação ou pequenas mudanças no ponto de vista. Como resultado, o SIFT tende a ser mais fiável do que os métodos simples de deteção de bordas ou cantos, que muitas vezes falham quando as condições mudam.

Considere uma pintura numa galeria. Ela pode ser reconhecida quer seja fotografada sob luz natural suave, sob luzes artificiais brilhantes ou mesmo com um ligeiro desfoque de movimento de uma câmara de mão. Os pontos-chave permanecem suficientemente estáveis para uma correspondência precisa, apesar destas diferenças.

Em seguida, vamos dar uma olhada em como o algoritmo SIFT funciona. Este processo pode ser dividido em quatro etapas principais: detecção de pontos-chave, localização de pontos-chave, atribuição de orientação e descrição de pontos-chave.

O primeiro passo é encontrar e detect pontos-chave, que são pontos distintivos na imagem, tais como cantos ou alterações acentuadas na textura, que ajudam a track ou reconhecer um objeto.

Para garantir que estes potenciais pontos-chave possam ser reconhecidos em qualquer tamanho, o SIFT constrói o que é chamado de espaço de escala. Esta é uma coleção de imagens criadas pelo desfoque gradual da imagem original com um filtro Gaussiano, que é uma técnica de suavização, e agrupando os resultados em camadas chamadas oitavas. Cada oitava contém a mesma imagem em níveis crescentes de desfoque, enquanto a oitava seguinte é uma versão menor da imagem.

Ao subtrair uma imagem borrada de outra, o SIFT calcula a Diferença de Gaussianas (DoG), que destaca áreas onde a luminosidade muda abruptamente. Essas áreas são escolhidas como keypoints candidatos porque permanecem consistentes quando a imagem é ampliada ou reduzida.

Nem todos os pontos-chave candidatos são úteis porque alguns podem ser fracos ou instáveis. Para refiná-los, o SIFT usa um método matemático chamado Expansão da Série de Taylor, que ajuda a estimar a posição exata de um ponto-chave com maior precisão.

Durante esta etapa, os pontos não confiáveis são removidos. Os pontos-chave com baixo contraste, que se misturam com o ambiente, são descartados, assim como aqueles que estão diretamente nas bordas, pois podem se deslocar muito facilmente. Esta etapa de filtragem deixa para trás apenas os pontos-chave mais estáveis e distintos.

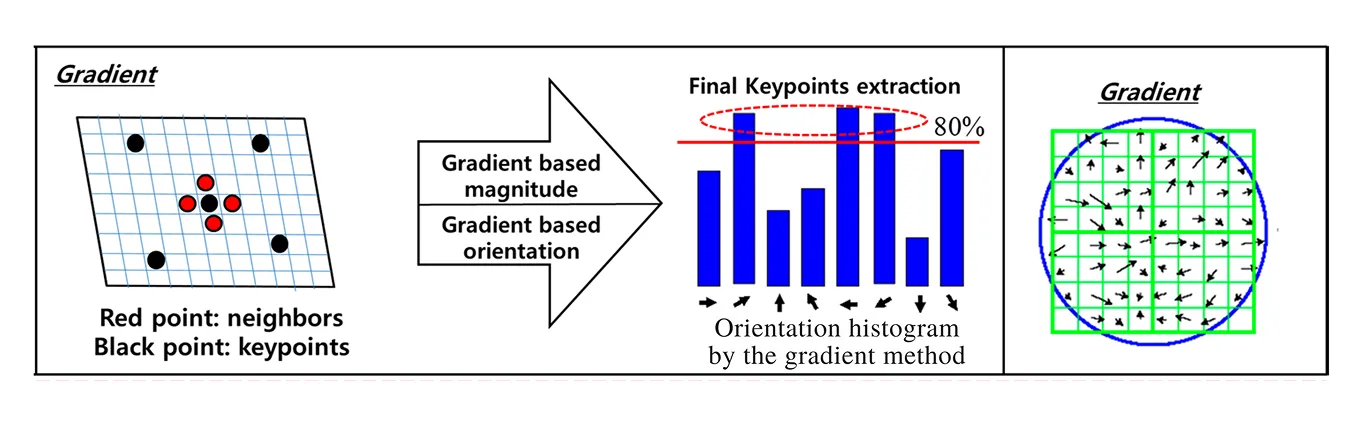

Uma vez que os pontos-chave estáveis são identificados, o SIFT os torna invariantes à rotação, o que significa que eles ainda podem ser combinados, mesmo que a imagem seja virada de lado ou de cabeça para baixo. Para fazer isso, o SIFT analisa como o brilho muda em torno de cada ponto-chave, o que é conhecido como gradiente. Os gradientes mostram a direção e a força da mudança na intensidade do pixel e, juntos, capturam a estrutura local ao redor do ponto.

Para cada ponto-chave, o SIFT considera os gradientes dentro de uma região circundante e os agrupa em um histograma de orientações. O pico mais alto neste histograma indica a direção dominante da mudança de intensidade, que é então atribuída como a orientação do ponto-chave. Tanto as direções do gradiente, que mostram onde a intensidade está mudando, quanto as magnitudes do gradiente, que indicam a força dessa mudança, são usadas para construir este histograma.

Se houver outros picos que sejam quase tão fortes, o SIFT atribui várias orientações ao mesmo keypoint. Isso evita que recursos importantes sejam perdidos quando os objetos aparecem em ângulos incomuns. Ao alinhar cada keypoint com sua orientação, o SIFT garante que os descritores gerados na próxima etapa permaneçam consistentes.

Por outras palavras, mesmo que duas imagens do mesmo objeto sejam rodadas de forma diferente, os keypoints alinhados à orientação ainda corresponderão corretamente. Este passo é o que dá ao SIFT a sua forte capacidade de lidar com a rotação e o torna muito mais robusto do que os métodos de detecção de características anteriores.

A última etapa no SIFT é criar uma descrição de cada keypoint para que ele possa ser reconhecido em outras imagens.

O SIFT consegue isto analisando um pequeno patch quadrado em torno de cada ponto-chave, com cerca de 16 por 16 pixels. Este patch é primeiro alinhado com a orientação do ponto-chave para que a rotação não o afete. O patch é então dividido numa grelha de 4 por 4 quadrados mais pequenos.

Em cada pequeno quadrado, o SIFT mede como o brilho muda em diferentes direções. Estas mudanças são armazenadas em algo chamado histograma, que é como um gráfico que mostra quais direções são mais comuns. Cada quadrado tem o seu próprio histograma e, juntos, os 16 quadrados produzem 16 histogramas.

Finalmente, esses histogramas são combinados em uma única lista de números, 128 no total. Esta lista é chamada de vetor de características, e age como uma impressão digital para o ponto-chave. Como captura a textura e a estrutura únicas ao redor do ponto, esta impressão digital torna possível corresponder o mesmo ponto-chave em diferentes imagens, mesmo que sejam redimensionadas, giradas ou iluminadas de forma diferente.

Agora que temos uma melhor compreensão do que é SIFT e como ele funciona, vamos explorar algumas de suas aplicações no mundo real em visão computacional.

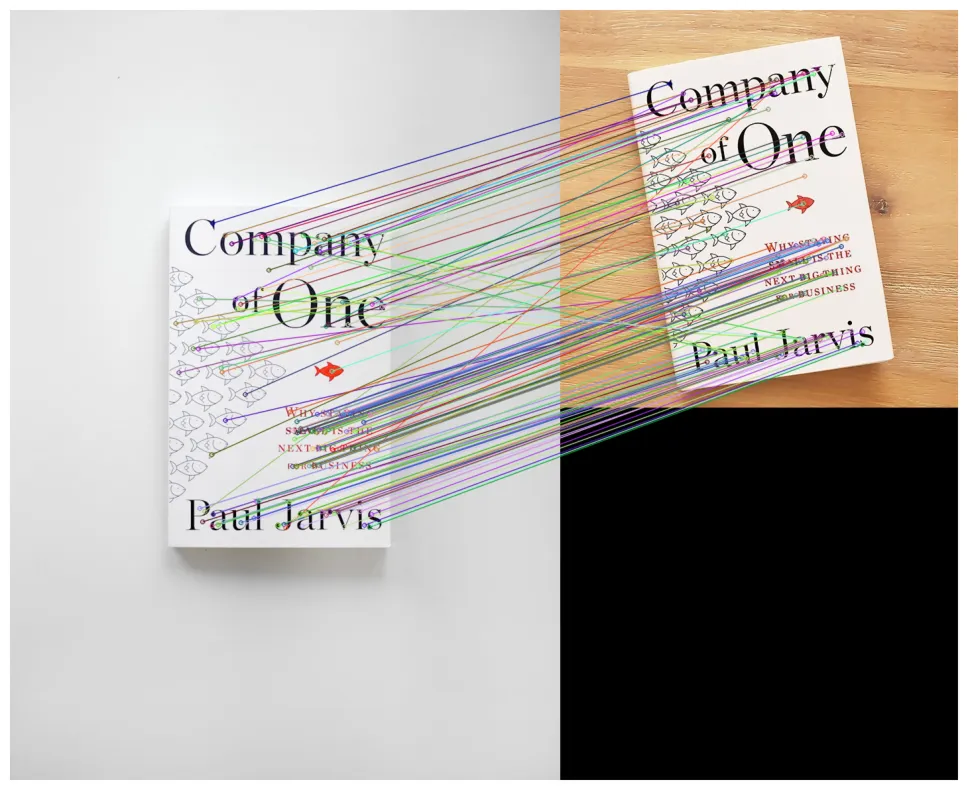

Uma das principais utilizações da SIFT é o reconhecimento e a deteção de objectos. Isto implica ensinar um computador a reconhecer e localizar objectos em imagens, mesmo quando os objectos não têm sempre o mesmo aspeto. Por exemplo, a SIFT pode detect um livro, independentemente de estar perto da câmara, mais longe ou rodado num ângulo.

A razão pela qual isso funciona é que o SIFT extrai pontos-chave que são altamente distintos e estáveis. Quando esses pontos-chave são combinados com descritores SIFT, eles formam recursos SIFT, que fornecem uma maneira confiável de corresponder o mesmo objeto em diferentes imagens. Esses recursos capturam detalhes únicos do objeto que permanecem consistentes, permitindo a correspondência confiável de recursos entre imagens, mesmo quando o tamanho, a posição ou a orientação do objeto mudam.

Antes que o aprendizado profundo se tornasse popular, o SIFT era um dos métodos mais confiáveis para construir sistemas de reconhecimento de objetos. Ele era amplamente utilizado em pesquisas e aplicações que exigiam a correspondência de objetos em grandes conjuntos de dados de imagens, embora muitas vezes exigisse recursos computacionais significativos.

O SIFT também pode ser usado para criar imagens panorâmicas, que são fotos amplas feitas juntando várias imagens. Usando o SIFT, pontos-chave distintos são encontrados nas partes sobrepostas de diferentes imagens e, em seguida, combinados uns com os outros. Estas correspondências atuam como âncoras, guiando o processo de junção sobre como as fotos devem ser alinhadas.

Uma vez que a correspondência é concluída, os algoritmos de costura podem ser usados para calcular o alinhamento correto, muitas vezes usando transformações geométricas que mapeiam uma imagem na outra. As imagens são então misturadas para que as costuras desapareçam. O resultado final é um panorama perfeito que se parece com uma única foto ampla, embora tenha sido criado a partir de várias fotos.

Outra aplicação interessante do SIFT é na reconstrução 3D, onde várias fotos 2D tiradas de diferentes ângulos são combinadas para construir um modelo tridimensional. O SIFT funciona encontrando e combinando os mesmos pontos nessas imagens.

Uma vez que as correspondências são feitas, as posições 3D desses pontos podem ser estimadas usando triangulação, um método que calcula a profundidade a partir de diferentes pontos de vista. Este processo faz parte da estrutura a partir do movimento (SfM), uma técnica que usa várias imagens sobrepostas para estimar a forma 3D de uma cena, juntamente com as posições das câmeras que tiraram as fotos.

O resultado é geralmente uma nuvem de pontos 3D, uma coleção de pontos no espaço que delineia o objeto ou ambiente. O SIFT foi uma das primeiras ferramentas que tornou a estrutura a partir do movimento prática. Embora as técnicas mais recentes sejam mais rápidas e mais comuns hoje, o SIFT continua a ser aplicado quando a precisão é mais importante do que a velocidade.

O SIFT também tem sido usado em robótica, particularmente em SLAM visual (Localização e Mapeamento Simultâneos). O SLAM permite que um robô descubra onde está enquanto constrói um mapa do seu ambiente ao mesmo tempo.

Os pontos-chave SIFT atuam como pontos de referência fiáveis que um robô pode reconhecer entre frames, mesmo quando a iluminação ou os ângulos mudam. Ao rastrear estes pontos de referência, o robô pode estimar a sua posição e atualizar o seu mapa em tempo real. Embora detetores de características mais rápidos sejam usados com mais frequência em robótica hoje em dia, o SIFT desempenhou um papel importante nos primeiros sistemas SLAM e ainda é fundamental em casos onde a robustez é mais crítica do que a velocidade.

Embora o algoritmo SIFT tenha sido amplamente utilizado em visão computacional e seja conhecido por ser um método confiável, ele também apresenta algumas desvantagens. Por isso, é importante ponderar seus prós e contras antes de decidir se ele é a opção certa para um projeto. Em seguida, vamos analisar seus principais pontos fortes e limitações.

Aqui estão algumas das vantagens de usar o algoritmo SIFT:

Aqui estão algumas das desvantagens de usar o algoritmo SIFT:

Ao explorar os prós e os contras do SIFT, poderá notar que muitas das suas limitações abriram caminho para técnicas mais avançadas. Especificamente, as redes neurais convolucionais (CNNs) surgiram como uma alternativa poderosa.

Uma CNN é um tipo de modelo de aprendizado profundo inspirado no funcionamento do sistema visual humano. Ela processa uma imagem em camadas, começando por padrões simples como bordas e texturas, e gradualmente construindo formas e objetos mais complexos. Ao contrário das regras de características criadas manualmente do SIFT, as CNNs aprendem representações de características diretamente dos dados.

Este aprendizado baseado em dados significa que as CNNs podem superar o SIFT em correspondência de descritores e tarefas de classificação. As CNNs também são mais expressivas e robustas, adaptando-se melhor à variabilidade e complexidade dos dados visuais.

Por exemplo, os modelos baseados em CNN obtiveram resultados revolucionários em ImageNetum enorme conjunto de dados de referência que contém milhões de imagens rotuladas em milhares de categorias. Concebido para testar a capacidade de os algoritmos reconhecerem e classify objectos, ImageNet é capaz de realçar a diferença entre os métodos baseados em caraterísticas mais antigos e a aprendizagem profunda.

As CNNs rapidamente superaram o SIFT ao aprender representações muito mais ricas e flexíveis, permitindo-lhes reconhecer objetos sob iluminação variável, de diferentes pontos de vista e até mesmo quando parcialmente ocultos, cenários onde o SIFT frequentemente tem dificuldades.

O algoritmo Scale Invariant Feature Transform ocupa um lugar importante na história da visão por computador. Proporcionou uma forma fiável de detect caraterísticas mesmo em ambientes em mudança e influenciou muitos dos métodos utilizados atualmente.

Embora as técnicas mais recentes sejam mais rápidas e eficientes, o SIFT lançou as bases para elas. O SIFT mostra onde começou o progresso atual na visão computacional e destaca o quão longe os sistemas de IA de ponta chegaram.

Junte-se à nossa comunidade global e confira nosso repositório GitHub para saber mais sobre visão computacional. Explore nossas páginas de soluções para descobrir inovações como IA na agricultura e visão computacional no varejo. Confira nossas opções de licenciamento e comece a construir seu próprio modelo de visão computacional.

Comece sua jornada com o futuro do aprendizado de máquina