Wähle das richtige Edge-Gerät für dein Computer-Vision-Projekt

Sieh dir an, wie du das richtige Edge-Gerät für dein Computer-Vision-Projekt basierend auf Leistung, Energieeffizienz und Bereitstellungsanforderungen auswählst.

Edge AI entwickelt sich schnell zu einem der größten Trends im Bereich der künstlichen Intelligenz und Computer Vision. Sie bringt Intelligenz in Echtzeit direkt auf die Geräte, anstatt sich auf Cloud-Computing zu verlassen, bei dem Daten zur Verarbeitung an einen anderen Ort gesendet werden müssen. Tatsächlich wird erwartet, dass der weltweite Edge-AI-Markt bis 2034 ein Volumen von etwa 143,06 Milliarden US-Dollar erreichen wird.

Dank jüngster technologischer Fortschritte definiert Edge AI die Echtzeit-Automatisierung auf Basis von Computer Vision in vielen Branchen neu. Die Qualitätskontrolle in der Fertigung ist dafür ein hervorragendes Beispiel.

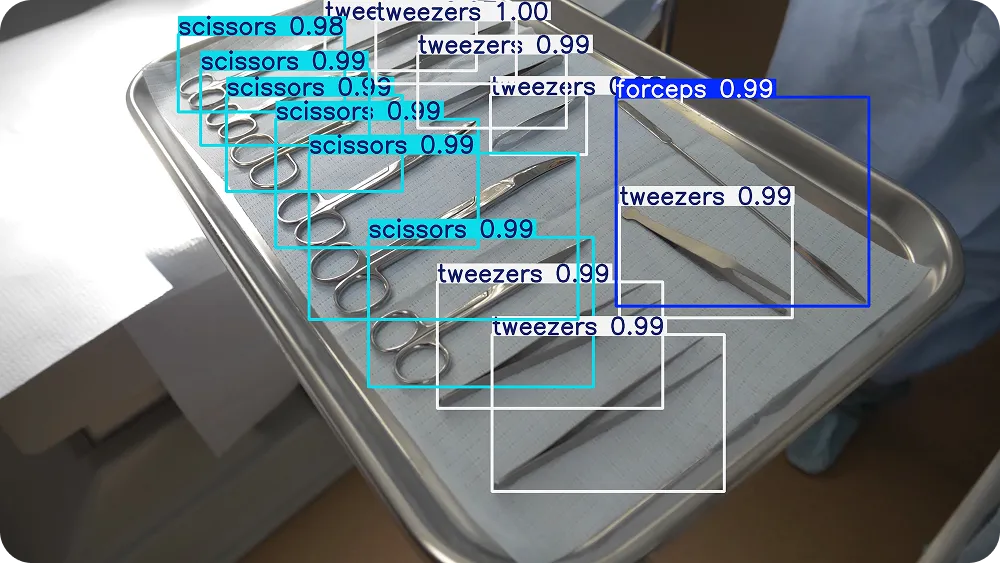

Hierbei analysieren Vision-AI-Kameras kontinuierlich Produkte auf einem Förderband. Sie können eingesetzt werden, um Defekte und Anomalien schnell zu erkennen. Dies ist besonders in Branchen wichtig, die eine hohe Präzision erfordern, wie etwa bei der Herstellung chirurgischer Instrumente.

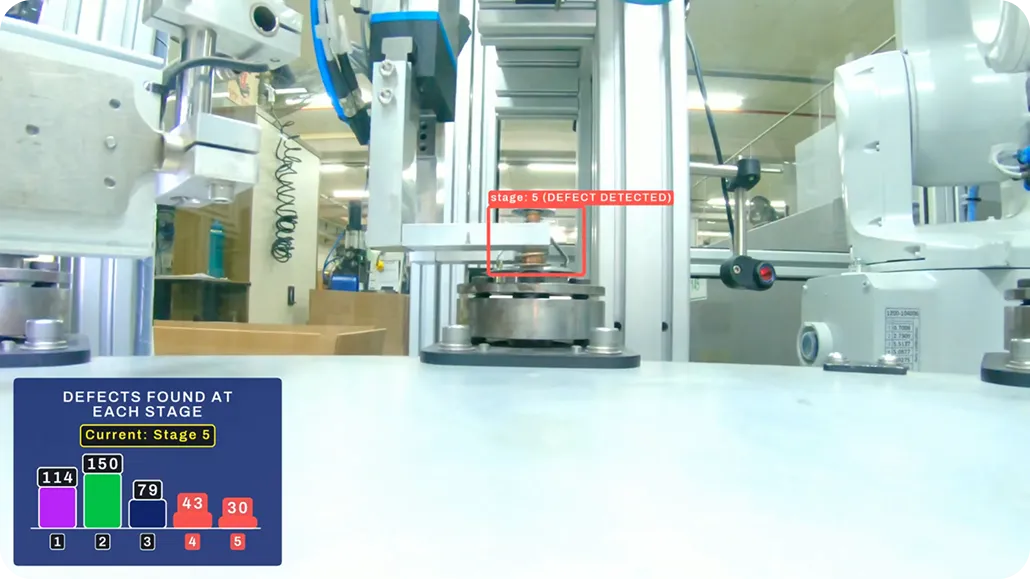

Abb. 1. Ein Beispiel für den Einsatz von Vision AI zur Erkennung chirurgischer Instrumente

Aber was genau sind Edge-Geräte? Es handelt sich um Hardwaresysteme, die in der Lage sind, KI-Modelle und Computer-Vision-Modelle, wie Ultralytics YOLO26, dort auszuführen, wo die Daten erzeugt werden – oder in unmittelbarer Nähe.

Dies kann in einer Fabrikhalle, in einer intelligenten Kamera oder an Bord autonomer Fahrzeuge sein. Durch die lokale Inferenz ermöglichen diese Geräte schnellere Reaktionszeiten. Zudem reduzieren sie die Bandbreitennutzung, da visuelle Daten nicht in die Cloud gestreamt werden müssen.

Die Auswahl des richtigen Edge-Geräts für dein Computer-Vision-Projekt kann jedoch schwierig sein. Hardware, die in einer Umgebung gut funktioniert, ist für eine andere möglicherweise nicht geeignet.

Ein Gerät, das beispielsweise in einer Fabrikhalle zuverlässig arbeitet, könnte für Drohneninspektionen ungeeignet sein, wo Gewicht und Energieverbrauch sehr andere Anforderungen stellen. Die Wahl des falschen Geräts kann die Kosten erhöhen, Rollouts verlangsamen und die Skalierung erschweren.

Deshalb sollten Teams Faktoren wie Gerätegröße, Energiebedarf, thermische Grenzwerte und industrielle Verfügbarkeit bewerten, anstatt sich nur auf die Rechenleistung zu konzentrieren. In diesem Artikel untersuchen wir Edge AI und wie du das richtige Edge-Gerät für deine Computer-Vision-Anwendung auswählst. Fangen wir an!

Hauptvorteile beim Einsatz von Edge-Geräten

Bevor wir uns damit befassen, wie du das richtige Edge-Gerät für dein spezielles Vision-AI-Projekt auswählst, lass uns einen Schritt zurücktreten und einige Vorteile des Einsatzes von Edge-Geräten für Vision-AI-Projekte diskutieren.

Hier sind einige der wichtigsten Vorteile der Bereitstellung von Vision AI am Edge:

- Echtzeitleistung: Daten werden dort oder in der Nähe verarbeitet, wo die Kamera eingesetzt ist, was sofortige Reaktionen für Anwendungsfälle wie Fehlererkennung, Sicherheitsüberwachung und Robotik ermöglicht. Diese lokale Verarbeitung unterstützt die Entscheidungsfindung in Echtzeit und erlaubt Systemen, ohne Cloud-Konnektivität sofort auf sich ändernde Bedingungen zu reagieren.

- Geringere Bandbreitenkosten: Anstatt Rohvideos in die Cloud zu streamen, übertragen Edge-Geräte nur Metadaten, Warnungen oder relevante Erkenntnisse. Dies reduziert die Netzwerklast und die Cloud-Speicherkosten erheblich.

- Funktioniert offline: Die meisten Edge-Systeme können auch bei instabiler oder begrenzter Internetverbindung weiterarbeiten, was in Fabriken, Lagerhäusern und abgelegenen Umgebungen häufig vorkommt.

- Besserer Datenschutz: Videodaten verbleiben vor Ort, wodurch Datenschutz- und Compliance-Anforderungen leichter erfüllt werden können, während die Offenlegung sensibler Informationen minimiert wird.

- Einfache Skalierung an vielen Standorten: Edge-Architekturen reduzieren die Abhängigkeit von zentraler Cloud-Infrastruktur. Dies ermöglicht es Teams, dieselbe Einrichtung mit konsistenter Leistung an mehreren Standorten zu replizieren.

Die Anforderungen deiner Anwendung verstehen

Der erste Schritt bei der Auswahl des richtigen Edge-Geräts besteht darin, zu verstehen, was deine Anwendung tatsächlich benötigt. Die Hardware, die du auswählst, sollte zu dem passen, was das System leisten soll, wie schnell es laufen muss und wo es eingesetzt wird.

Du kannst damit beginnen, die Leistungsanforderungen zu definieren. Während einige Lösungen KI-Inferenz in Echtzeit bei hoher FPS (Frames per Second) erfordern, können andere Frames in Gruppen oder Batches verarbeiten.

Modellkomplexität und -größe spielen ebenfalls eine wichtige Rolle. Leichte Objekterkennungsmodelle können oft auf kleineren, stromsparenden Geräten ausgeführt werden, während komplexere, schwerere Modelle oder mehrstufige Pipelines mehr Rechenleistung und Speicher erfordern.

Als Nächstes solltest du dein Daten-Setup berücksichtigen. Dies umfasst Kameraauflösung, Bildrate, die Anzahl der parallelen Streams und Sensortypen wie RGB, Wärmebild oder Tiefensensoren. Diese Faktoren beeinflussen direkt Bandbreite, Durchsatz, Speicherauslastung und die gesamte Systemlast.

Der Kompromiss zwischen Genauigkeit und Latenz

Über Hardware- und Datenanforderungen hinaus spielt die Modellauswahl eine entscheidende Rolle für die gesamte Systemleistung. Die meisten Edge-Implementierungen beinhalten einen Kompromiss zwischen Latenz und Genauigkeit. Modelle mit höherer Genauigkeit sind in der Regel rechenintensiver und können die Inferenzzeit erhöhen.

Schnellere Modelle hingegen opfern möglicherweise etwas Präzision. Das Ziel ist es, das richtige Gleichgewicht zwischen Geschwindigkeit und Genauigkeit basierend auf deinem spezifischen Anwendungsfall und deinen betrieblichen Einschränkungen zu finden.

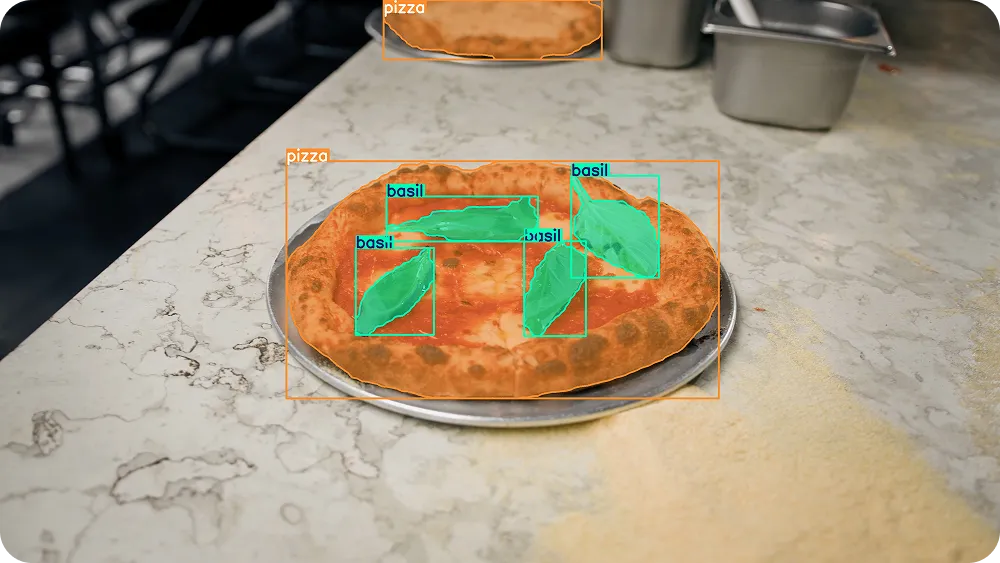

In automatisierten Lebensmittelproduktionslinien werden beispielsweise Computer-Vision-Systeme eingesetzt, um Produkte vor dem Verpacken und Versand zu überprüfen. Diese Systeme müssen in Echtzeit arbeiten, um das Förderband nicht zu verlangsamen.

Stell dir eine Pizza-Montagelinie vor, bei der das System überprüfen muss, ob jede Pizza die richtigen Beläge hat. Ein Modell wie Ultralytics YOLO26 kann die Pizza und ihre Beläge in Echtzeit erkennen und fehlende oder falsche Zutaten identifizieren. In diesem Szenario muss das Modell genau genug sein, um Fehler zu erkennen, und gleichzeitig schnell genug, um mit der Produktionsgeschwindigkeit auf der Edge-Hardware Schritt zu halten.

Abb. 2. Einsatz von Ultralytics YOLO26 zur Erkennung und Segmentierung einer Pizza und ihrer Beläge.

Die Größe des Edge-Geräts berücksichtigen

Neben der Rechenleistung ist die physische Größe des Edge-Geräts ein weiterer wichtiger Faktor bei der Bereitstellungsplanung. Der Formfaktor des Geräts (seine physische Größe, Form, Montageart und Erweiterungsschnittstellen) beeinflusst direkt, wie einfach es sich in die Umgebung integriert und wie es unter realen Bedingungen arbeitet.

Arten von Edge-AI-Geräten und ihre Formfaktoren

Edge-AI-Hardware gibt es in vielen Formfaktoren, von kompletten Rack-Servern und Peripheral Component Interconnect Express (PCIe)-Beschleunigerkarten bis hin zu kompakten M.2-Modulen, System-on-Module (SoM)-Plattformen, Single-Board-Computern (SBCs), intelligenten Kameras und sogar intelligenten Vision-Sensoren mit On-Chip-KI-Verarbeitung. Jedes Format bietet unterschiedliche Kompromisse bei Leistung, Energieeffizienz, thermischem Design und Integrationskomplexität.

Die Gerätegröße hängt eng mit den Kühlanforderungen, der Energieverfügbarkeit und der gesamten Systemarchitektur zusammen. Größere Systeme wie industrielle PCs im Rack-Format oder Tower-Workstations unterstützen typischerweise PCIe-GPUs voller Höhe, mehrere Erweiterungskarten und aktive Kühlung. Diese Plattformen eignen sich gut für die Multi-Kamera-Verarbeitung, zentrale Edge-Hubs oder Videoanalysen mit hohem Durchsatz.

Im Gegensatz dazu sind kompakte Formfaktoren wie M.2-Beschleuniger, SoMs auf kundenspezifischen Trägerplatinen, SBCs oder All-in-One-Smart-Kameras für platzbeschränkte Umgebungen konzipiert. Diese kleineren Geräte priorisieren oft Energieeffizienz und passive Kühlung, was sie ideal für eingebettete Systeme, mobile Roboter, Drohnen, Kioske und verteilte Inspektionseinheiten macht.

Am äußersten Ende der Miniaturisierung setzen einige Implementierungen auf intelligente Vision-Sensoren oder Mikrocontroller-basierte (TinyML)-Plattformen, bei denen die Inferenz direkt auf dem Bildsensor oder einem stromsparenden Prozessor läuft. Diese Systeme reduzieren den physischen Platzbedarf und den Energieverbrauch erheblich, eignen sich jedoch typischerweise für engere, hochoptimierte Arbeitslasten.

Diese Unterschiede in Größe, Modularität und Integrationsmodell führen im Allgemeinen zu zwei gängigen Edge-Bereitstellungskategorien: skalierbare Bereitstellungen und platzbeschränkte Bereitstellungen. Jeder Ansatz begegnet unterschiedlichen Leistungs-, Energie- und Umgebungsbeschränkungen und prägt gleichzeitig die langfristige Wartbarkeit und das Systemdesign.

Skalierbare Bereitstellungen

PCIe-Beschleuniger und Rack-montierte oder industrielle PCs (PCs) werden häufig verwendet, wenn ein Projekt hohe Rechenleistung erfordert oder Daten von mehreren Kameras gleichzeitig verarbeiten muss. Ein PCIe-Beschleuniger ist eine Hardwarekarte, die über einen PCIe-Steckplatz in einem größeren Computer installiert wird.

Er fügt dedizierte Rechenressourcen hinzu, wie etwa eine Graphics Processing Unit (GPU) oder einen anderen KI-Beschleuniger, um die Fähigkeit des Systems zur Bewältigung von KI-Arbeitslasten zu verbessern. Dies ähnelt der Art und Weise, wie eine Grafikkarte die Leistung in einem Desktop-Computer verbessert.

Rack-montierte oder industrielle PCs sind größere, gehärtete Systeme, die für den Dauerbetrieb in Umgebungen wie Fabriken, Produktionshallen oder Kontrollräumen konzipiert sind. Sie bieten mehr Platz für Kühlung, Hardware-Erweiterungen und leistungsstärkere Komponenten, was sie für anspruchsvolle Arbeitslasten wie die Multi-Kamera-Qualitätsprüfung oder groß angelegte Videoanalysen gut geeignet macht.

Platzbeschränkte Bereitstellungen

Platzbeschränkte Bereitstellungen sind in Umgebungen üblich, in denen ein Edge-Gerät innerhalb enger physischer, thermischer oder energetischer Grenzen arbeiten muss. Dies umfasst häufig intelligente Kameras, die an Produktionslinien montiert sind, mobile Roboter, Drohnen, Kioske oder kompakte Inspektionssysteme.

In diesen Fällen muss die Hardware klein, leicht und energieeffizient sein und dennoch eine zuverlässige KI-Leistung liefern. Zwei gängige Hardware-Optionen für diese Bereitstellungen sind M.2-Module und Single-Board-Computer.

Ein M.2-Modul ist eine kompakte Erweiterungskarte, die in einen M.2-Steckplatz innerhalb eines Host-Systems passt. Obwohl M.2 lediglich ein Formfaktor- und Schnittstellenstandard ist, sind einige Module speziell für die KI-Beschleunigung konzipiert.

Diese KI-Beschleunigermodule ermöglichen es kleinen Geräten, Computer-Vision-Modelle effizienter auszuführen, ohne die Größe oder den Stromverbrauch wesentlich zu erhöhen. M.2-Beschleuniger werden häufig in eingebettete Systeme integriert, bei denen das Hinzufügen einer PCIe-Erweiterungskarte in voller Größe nicht praktikabel wäre.

In der Zwischenzeit ist ein Single-Board-Computer ein kompletter Computer, der auf einer einzigen Leiterplatte aufgebaut ist. Er integriert CPU, Speicher, Speicherschnittstellen und Ein-/Ausgangs-Verbindungen (I/O) in einen kompakten Formfaktor. Da alles auf einer Platine enthalten ist, werden SBCs häufig in eingebetteten und Edge-Anwendungen verwendet, bei denen der Platz begrenzt ist und Einfachheit wichtig ist.

Obwohl platzbeschränkte Systeme in der Regel weniger rohe Rechenleistung bieten als größere rack-montierte Systeme, ermöglichen sie die Inferenz direkt auf dem Gerät in der Nähe des Entstehungsortes der Daten. Dies reduziert die Latenz, senkt die Bandbreitennutzung und verbessert die Flexibilität bei der Bereitstellung in Umgebungen, in denen größere Hardware keinen Platz finden würde.

Dedizierte KI-Beschleunigung für eingebettete Vision

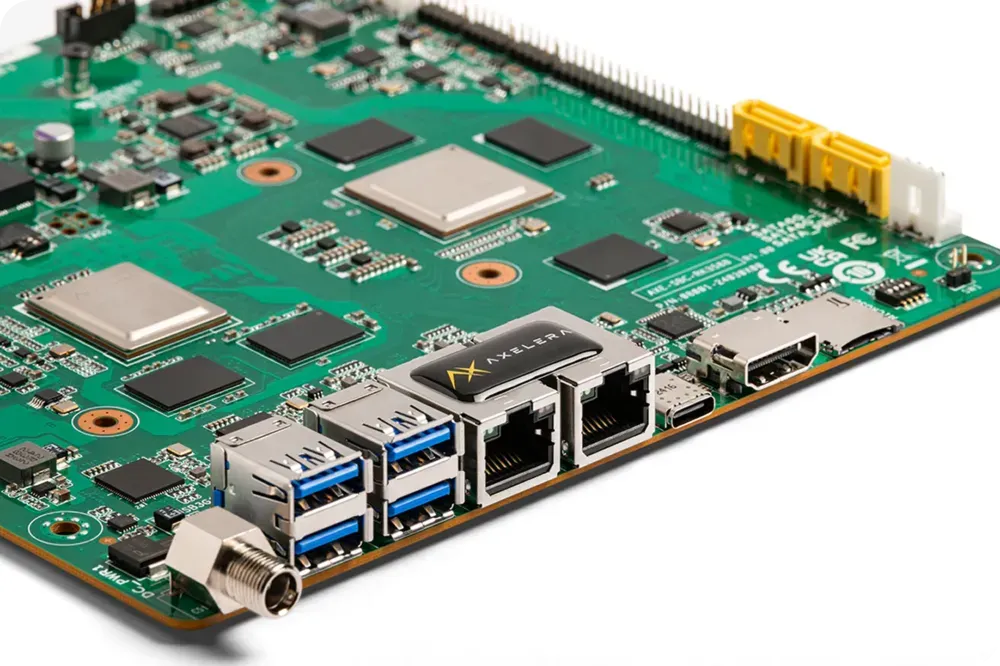

Viele Hardwareanbieter konzentrieren sich speziell auf kompakte, energieeffiziente KI-Beschleunigung für eingebettete Vision. Zum Beispiel bietet Axelera AI Metis® AI Processing Unit (AIPU)-Beschleuniger in verschiedenen Formfaktoren an, darunter PCIe-Karten, M.2-Module und integrierte Compute-Boards für platzbeschränkte Bereitstellungen.

Durch eine Integration mit Ultralytics können unterstützte YOLO-Modelle wie Ultralytics YOLOv8 und YOLO26 mithilfe des Ultralytics Python-Pakets in das Axelera-Format exportiert und über das Voyager SDK optimiert werden, das die Kompilierung und INT8-Quantisierung für eine effiziente Edge-Inferenz übernimmt.

Abb. 3. Ein Blick auf die Metis AI Processing Unit von Axelera AI (Quelle)

Den Stromverbrauch einberechnen

Der Stromverbrauch ist ebenfalls eine wesentliche Einschränkung bei Edge-Implementierungen, da er sich direkt auf die Wärmeentwicklung und die Kühlanforderungen auswirkt. Er bestimmt, ob das System zuverlässig in versiegelten Gehäusen oder kompakten Industriegehäusen betrieben werden kann.

Dies ist besonders in batteriebetriebenen Umgebungen wichtig, wie etwa bei mobilen Robotern, Drohnen oder Fernüberwachungsstationen, wo jedes Watt (W) die Laufzeit und die allgemeine Systemstabilität beeinflusst.

Die meisten Edge-Geräte lassen sich in drei breite Leistungsklassen einteilen. Hier ist ein genauerer Blick auf jede davon:

- Low-Power-Geräte (<10W): Diese werden typischerweise in eingebetteten Systemen verwendet, bei denen kompakte Größe und passive Kühlung erforderlich sind.

- Mittelklasse-Geräte (10–50W): Diese Geräte sind in Edge-Gateways und Fabrik-Endpunkten üblich, die einen höheren Durchsatz erfordern, während sie innerhalb kontrollierter thermischer Grenzwerte arbeiten.

- High-Power-Geräte (>50W): Solche Geräte sind in der Regel PCIe-Beschleuniger oder industrielle PCs, die für die Multi-Kamera-Verarbeitung und schwere Arbeitslasten konzipiert sind. Sie werden oft mit aktiver Kühlung und größeren Gehäusen kombiniert.

Es ist wichtig zu bedenken, dass die Eigenschaften der Arbeitslast eine große Rolle bei der Bestimmung der geeigneten Leistungsklasse spielen. Höhere Bildraten, größere Vision-Modelle und mehrere parallele Kamerastreams erhöhen den Rechenbedarf, was wiederum den Stromverbrauch ansteigen lässt.

Heutzutage konzentrieren sich viele Hardwareanbieter auf energieeffiziente KI-Beschleunigung. Zum Beispiel sind die Edge-Module von DEEPX für die Inferenz mit niedrigem Stromverbrauch bei Edge-Implementierungen ausgelegt. Intel-Prozessoren bieten ebenfalls Energieverwaltungs- und Skalierungsfunktionen, die es ermöglichen, die Leistung je nach Umwelt- und Arbeitslastanforderungen anzupassen.

Die industrielle Verfügbarkeit und den Lifecycle-Support berücksichtigen

Angenommen, du hast eine Pilotimplementierung erfolgreich abgeschlossen. Das Modell funktioniert gut, die Hardware erfüllt die Leistungsanforderungen und das System läuft im Test zuverlässig.

Die nächste Herausforderung besteht darin, diese Lösung in die vollständige Produktion zu skalieren. Hier werden industrielle Verfügbarkeit und Lifecycle-Support entscheidend.

Die meisten Edge-Systeme sollen über Jahre hinweg kontinuierlich arbeiten. Die Auswahl von Hardware, die kurz nach dem Rollout eingestellt werden könnte, birgt ein erhebliches Risiko. Selbst wenn ein Gerät während einer Pilotphase gut funktioniert, kann es zu einer Belastung werden, wenn es das Ende seines Lebenszyklus erreicht oder nach Produktionsbeginn schwer zu beschaffen ist.

Kurze Marktlebenszyklen können Lieferkettenunterbrechungen verursachen, die Wartungskosten erhöhen und unerwartete Neugestaltungen erzwingen. Bei Implementierungen an mehreren Standorten kann der Austausch nicht verfügbarer Komponenten die Expansion verlangsamen und die Systemverwaltung verkomplizieren.

Hardware, die für den industriellen Einsatz konzipiert ist, bietet in der Regel längere Produktionszeitpläne, klarere Richtlinien zum Lebenszyklus sowie fortlaufenden Firmware- oder Software-Support. Diese Stabilität erleichtert die Skalierung von Implementierungen ohne größere Hardwareänderungen mitten im Zyklus.

Bevor du ein Edge-Gerät endgültig festlegst, können Teams die Produkt-Roadmap, die Lifecycle-Verpflichtungen und die langfristige Support-Strategie des Herstellers prüfen.

Die Bedeutung von Team-Expertise und Benutzerfreundlichkeit

Die Auswahl und Implementierung eines Edge-Geräts hängt auch von der Erfahrung deines Teams ab. Einige Plattformen sind einfacher zu bedienen und bieten klare Dokumentationen, einfache Einrichtungsschritte und sofort einsatzbereite Tools. Andere bieten mehr Kontrolle über die Leistung, erfordern jedoch tieferes technisches Wissen und mehr Zeit für Optimierung und Fehlerbehebung.

Das Ultralytics Python-Paket macht es beispielsweise unkompliziert, Modelle wie YOLO26 zu trainieren, zu testen und bereitzustellen. Es vereinfacht allgemeine Aufgaben und unterstützt zudem das Exportieren von Modellen in verschiedene Formate, die in Edge-Implementierungen verwendet werden. Dies erleichtert es Teams, von der Entwicklung zur realen Hardware überzugehen, ohne ihren Workflow von Grund auf neu aufbauen zu müssen.

Für Teams, die neu in der Edge AI sind, kann ein starkes und gut dokumentiertes Software-Ökosystem die Entwicklungszeit verkürzen und das Implementierungsrisiko verringern. Erfahrenere Teams bevorzugen möglicherweise Plattformen, die eine tiefere Anpassung und Feinabstimmung ermöglichen, insbesondere bei Anwendungen, die Multi-Kamera-Verarbeitung oder strikte Latenzanforderungen erfordern.

Einfach ausgedrückt: Anbieter-Ökosysteme und Tools können einen signifikanten Unterschied machen. Klare Dokumentation, aktiver Support und flexible Implementierungsoptionen helfen Teams, reibungsloser von Pilotprojekten zu vollständigen Produktionssystemen überzugehen.

Wichtige Faktoren für Edge-Implementierungen, die oft übersehen werden

Nachdem wir die wichtigsten Faktoren bei der Auswahl eines Edge-Geräts behandelt haben, lass uns einige praktische Details durchgehen, die bei realen Implementierungen einen großen Unterschied machen können. Diese Überlegungen mögen anfangs nicht dringend erscheinen, aber sie spielen oft eine entscheidende Rolle bei der Entscheidungsfindung und beeinflussen, wie reibungslos ein Projekt läuft, sobald es über die Pilotphase hinausgeht.

I/O, Bandbreite und Software-Kompatibilität

Konnektivität und I/O-Kompatibilität sind oft eine der ersten praktischen Herausforderungen bei Edge-Implementierungen. Normalerweise muss ein Edge-Gerät deine Kamera- und Sensorkonfiguration unterstützen, einschließlich gängiger Schnittstellen wie USB 3.0, GigE mit Power over Ethernet (PoE) und MIPI.

Industrielle Vision-Systeme können auch Hardware-Trigger, Synchronisationssignale oder spezifische Timing-Unterstützung erfordern, um einen zuverlässigen Betrieb zu gewährleisten.

Bandbreite ist ein weiterer kritischer Faktor, insbesondere bei Setups mit mehreren Kameras. Selbst kleine Diskrepanzen zwischen Kameraausgang und Geräteeingangskapazität können den Durchsatz verringern oder zusätzliche Latenz einführen.

Software-Kompatibilität spielt ebenfalls eine entscheidende Rolle. Einige Implementierungen setzen auf leichte Inferenz-Frameworks wie NCNN und MNN, die häufig in mobilen und eingebetteten Umgebungen verwendet werden.

Bei Implementierungen mit intelligenten Sensoren integrieren Geräte wie der Sony IMX500 die KI-Verarbeitung direkt auf dem Bildsensor, was den Datentransfer und die Latenz reduziert. In diesen Fällen werden Modellkompatibilität und Exportunterstützung besonders wichtig, da das Modell in ein Format konvertiert werden muss, das von der Toolchain des Sensors unterstützt wird.

Das Ultralytics Python-Paket unterstützt beispielsweise den Export von Modellen wie Ultralytics YOLO11 in Formate, die mit Edge-Implementierungspipelines kompatibel sind, einschließlich Plattformen, die auf Geräten wie dem Sony IMX500 basieren.

Thermische und umweltbedingte Zuverlässigkeit

Wenn Edge-Geräte kontinuierlich visuelle Daten verarbeiten, werden thermische und umweltbedingte Zuverlässigkeit zu kritischen Faktoren. In diesem Kontext bedeutet Zuverlässigkeit, dass das Gerät über längere Zeiträume ohne Überhitzung oder Ausfall arbeiten kann, selbst unter rauen Bedingungen wie Staub, Vibration oder extremen Temperaturen.

Da die Arbeitslasten von Edge AI immer anspruchsvoller werden, ist die thermische Effizienz zu einem entscheidenden Faktor beim Systemdesign geworden. Dieser Schwerpunkt auf thermischer Leistung wurde auf der CES 2026 in Las Vegas hervorgehoben, wo DeepX identische KI-Arbeitslasten auf mehreren Chips ausführte, auf denen ein kleines Stück Butter platziert war.

Während konkurrierende Chips genug Wärme erzeugten, um die Butter zu schmelzen, tat das Edge-Gerät von DeepX dies nicht, was veranschaulicht, wie ein geringerer Stromverbrauch und eine stärkere thermische Stabilität die Zuverlässigkeit in der realen Welt direkt beeinflussen können.

Das Kühlungsdesign spielt eine zentrale Rolle bei der Aufrechterhaltung einer stabilen Leistung. Da Prozessoren härter arbeiten, erzeugen sie Wärme, und diese Wärme muss effektiv verwaltet werden.

In vielen industriellen Umgebungen wird passive Kühlung bevorzugt, da mechanische Lüfter mit der Zeit verschleißen oder ausfallen können, insbesondere in staubigen oder vibrationsreichen Umgebungen. Lüfterlose Aluminium-Kühlkörper werden häufig verwendet, um Wärme abzuleiten, ohne auf bewegliche Teile angewiesen zu sein, was die langfristige Haltbarkeit verbessert.

Umweltbedingungen können ebenfalls einen Einfluss haben. Jedes Gerät hat einen spezifizierten Betriebstemperaturbereich, und Implementierungen in versiegelten Schränken oder Außenbereichen können Wärme einschließen oder die Hardware schwankenden Temperaturen aussetzen. In diesen Fällen werden Gehäusedesign und Luftstrom genauso wichtig wie die rohe Rechenleistung.

Software-Ökosystem und Implementierungsbereitschaft

Bei der Auswahl des richtigen Edge-Geräts ist die Stärke seines Software-Ökosystems genauso wichtig wie die Hardwarespezifikationen. Ein Gerät mag auf dem Papier eine starke Rechenleistung bieten, aber ohne zuverlässige Tools und Plattformunterstützung kann der Übergang vom Prototyp zur Produktion langsam und komplex werden.

Eine gut unterstützte Plattform rationalisiert den gesamten Implementierungspfad, von der Modellvorbereitung bis zur optimierten Inferenz auf der Zielhardware. Ökosysteme, die integrierte Tools für Quantisierung, Leistungsoptimierung und Fehlerbehebung bereitstellen, erleichtern die Validierung von Modellen unter realen Arbeitslasten und reduzieren unerwartete Probleme während des Rollouts.

Beispielsweise können Ultralytics YOLO-Modelle wie YOLO26 direkt in das OpenVINO-Format exportiert werden, was eine optimierte Inferenz auf Intel-CPUs, integrierten GPUs und Neural Processing Units (NPUs) ermöglicht. OpenVINO bietet Leistungsoptimierungen wie Modellkonvertierung, Quantisierung (einschließlich FP16 und INT8) und heterogene Ausführung auf unterstützter Intel-Hardware.

Mithilfe des Ultralytics Python-Pakets können Teams Modelle mit einem einfachen Befehl exportieren und die Inferenz entweder über die High-Level-Schnittstelle von Ultralytics oder direkt mit der nativen OpenVINO Runtime ausführen, wodurch ein gestraffter und produktionsreifer Implementierungs-Workflow für Edge-Systeme auf Intel-Basis entsteht.

Reale Leistung unter Last

Viele Edge-Geräte sehen auf dem Papier beeindruckend aus, aber die Leistung kann sich ändern, sobald sie eine vollständige Vision-Pipeline ausführen. Bei realen Implementierungen führt das System nicht nur Inferenz aus.

Es übernimmt auch Vorverarbeitung, Nachverarbeitung und manchmal mehrere Kamerastreams gleichzeitig. Aus diesem Grund ist es wichtig, über die durchschnittlichen Bilder pro Sekunde hinaus zu schauen.

Konstante Latenz ist oft wichtiger als Spitzenleistung. Wenn du auf Speicherengpässe achtest und prüfst, wie stabil das System unter Dauerlast bleibt, erhältst du ein klareres Bild davon, wie es in der Produktion funktionieren wird.

Es ist hilfreich, die Kaltstartzeit zu testen, die langfristige Hochleistung über Betriebsstunden hinweg sowie das Verhalten des Geräts, wenn andere Aufgaben parallel zur Inferenz laufen, wie etwa Codierung, Protokollierung oder Netzwerkaktivitäten. In den meisten realen Anwendungsfällen ist eine stabile und vorhersehbare Leistung wichtiger als gelegentliche Geschwindigkeitsspitzen.

Sicherheit, Lebenszyklus und Management nach der Bereitstellung

Edge-Bereitstellungen müssen über die Zeit sicher und zuverlässig bleiben, besonders in Umgebungen wie der Fertigung, in denen Systeme kontinuierlich laufen müssen. Funktionen wie Secure Boot, verschlüsselter Speicher und regelmäßige Hersteller-Updates helfen, Geräte vor Manipulation zu schützen und das Risiko von Schwachstellen oder unerwarteten Ausfallzeiten zu verringern.

Die Verwaltung von Geräten nach der Bereitstellung ist genauso wichtig wie die Auswahl der richtigen Hardware. Fernüberwachungs- und Update-Funktionen ermöglichen es Teams, Software, Firmware und Modelle zu warten, ohne physischen Zugriff auf jedes Gerät zu benötigen. Dies wird zunehmend entscheidend, wenn Projekte von einem kleinen Pilotversuch zu einem größeren Rollout übergehen.

Wenn Bereitstellungen wachsen, hilft ein zentrales Flottenmanagement, alles organisiert zu halten. Es erleichtert Teams die Nachverfolgung des Gerätezustands, das Verwalten von Updates, die Überwachung der Leistung und die Fehlerbehebung an verschiedenen Standorten. Ohne eine klare Managementstrategie kann die Wartung von Dutzenden oder gar Hunderten von Edge-Systemen schnell schwierig werden.

Häufige reale Anwendungen von Computer Vision und Edge AI

Während du die Faktoren für die Auswahl des richtigen Edge-Geräts abwägst, fragst du dich vielleicht, wo diese Systeme tatsächlich eingesetzt werden. Heute treibt Edge AI Anwendungen in fast jeder Branche an, von der Fertigung und dem Einzelhandel bis hin zur Robotik und intelligenten Infrastruktur.

Hier sind fünf häufige Deep-Learning-Anwendungsfälle, bei denen Edge-Geräte niedrige Latenz, reduzierten Bandbreitenverbrauch und zuverlässige Verarbeitung direkt auf dem Gerät ermöglichen:

- Sicherheitsüberwachung in Industrieanlagen: Computer Vision-Pipelines, die auf Edge-Computing-Hardware bereitgestellt werden, können sofortige Warnmeldungen zur Einhaltung von persönlicher Schutzausrüstung (PSA) ausgeben. Das bedeutet, sie erkennen automatisch, ob Mitarbeiter erforderliche Schutzkleidung wie Helme, Handschuhe, Warnwesten oder Schutzbrillen tragen, und identifizieren unsicheres Verhalten. Dies verbessert die Betriebszuverlässigkeit durch die Reduzierung von Arbeitsunfällen, während sensible Videodaten sicher vor Ort verarbeitet werden.

- Einzelhandelsanalytik: Edge-Geräte können visuelle Daten lokal für Bestandsmanagement, Regalverfügbarkeit und Warteschlangenerkennung verarbeiten, wodurch Bandbreiten- und Cloud-Kosten gesenkt werden und das System in vielen Filialen kosteneffizient und skalierbar bleibt.

- Robotik: In der Robotik ermöglicht KI auf dem Gerät Echtzeit-Objekterkennung und autonome Navigation. Zum Beispiel können NVIDIA Jetson Edge-Geräte kompakte, GPU-beschleunigte Rechenplattformen bereitstellen, die es Robotern ermöglichen, Computer Vision-Modelle wie YOLO26 lokal auszuführen und dabei eine latenzarme Leistung bei hoher Energieeffizienz zu erzielen.

- Smart Cities und Verkehrsüberwachung: Smart-City-Bereitstellungen können Edge-Computer-Vision-Prozessoren für die Echtzeit-Analyse des Verkehrsflusses, die Unfallerkennung und die Überwachung der Sicherheit von Fußgängern nutzen. Durch den Verzicht auf kontinuierliches Video-Streaming in die Cloud reduzieren diese Systeme den Bandbreitenbedarf und verbessern die Reaktionszeiten.

- Qualitätsprüfung in der Fertigung: An Produktionslinien können Edge-Geräte Produkte in Echtzeit inspizieren, um Defekte, fehlende Komponenten oder Montagefehler zu erkennen, bevor die Artikel weiter auf dem Förderband transportiert werden. Diese Systeme können Modelle wie YOLO26 auf CPUs, GPUs oder dedizierten KI-Beschleunigern ausführen, abhängig von Durchsatz- und Leistungsbeschränkungen.

Abb. 4. YOLO26 kann am Edge bereitgestellt werden, um Defekte in Fertigungsanlagen zu erkennen.

Wichtige Erkenntnisse

Die Auswahl des richtigen Edge-Geräts für dein Computer Vision-Projekt erfordert ein Gleichgewicht zwischen Leistung, Energieeffizienz, Zuverlässigkeit und langfristiger Verfügbarkeit. Anstatt sich nur auf Spitzenspezifikationen zu konzentrieren, sollten Teams die realen Bedingungen, die Reife des Software-Ökosystems und den Support über den Lebenszyklus hinweg bewerten. Durch die Validierung deines Setups mit einem Pilotprojekt vor der Skalierung kannst du Risiken reduzieren, Kosten kontrollieren und einen reibungsloseren Weg vom Prototyp zur Produktion sicherstellen.

Werde Teil unserer Community und erkunde unser GitHub repository. Sieh dir unsere Lösungsseiten an, um verschiedene Anwendungen wie KI in der Landwirtschaft und Computer Vision im Gesundheitswesen zu entdecken. Entdecke unsere Lizenzoptionen und lege noch heute mit Vision AI los!