Erfahren Sie alles, was Sie über die Bildannotation mit Ultralytics wissen müssen, sowie über die integrierten Tools zum Beschriften von Datensätzen, Verwalten von Annotationen und Vorbereiten von Daten für Modelle.

Erfahren Sie alles, was Sie über die Bildannotation mit Ultralytics wissen müssen, sowie über die integrierten Tools zum Beschriften von Datensätzen, Verwalten von Annotationen und Vorbereiten von Daten für Modelle.

Ultralytics hat Ultralytics Ultralytics vorgestellt, eine Umgebung, die den gesamten Lebenszyklus der Entwicklung im Bereich Computer Vision unterstützt. Die Plattform bündelt Tools zur Verwaltung der verschiedenen Phasen von Vision-AI-Workflows, darunter die Vorbereitung von Datensätzen, die Annotation von Bildern und Videos, das Modelltraining sowie die Bereitstellung.

Trotz der zunehmenden Verbreitung in Branchen wie dem autonomen Fahren und dem Gesundheitswesen kann die Entwicklung von Computer-Vision-Lösungen nach wie vor als fragmentierter Prozess angesehen werden. Einer der Hauptgründe dafür ist, dass Computer-Vision-Modelle in hohem Maße von der Qualität der Daten abhängen, mit denen sie trainiert werden. Noch bevor das Training überhaupt beginnt, müssen Datensätze erstellt, organisiert, überprüft und beschriftet werden, damit das Modell lernen kann, was es detect identifizieren soll.

Bei der Arbeit mit visuellen Daten wird dieser Vorgang als Datenannotation oder Bildannotation bezeichnet. Bei der Bildannotation werden bestimmte Bereiche eines Bildes markiert und mit Beschriftungen versehen, die dem Modell während des Trainings als Orientierung dienen.

Wenn es beispielsweise darum geht, detect in Bildern detect , zeichnen die Annotatoren möglicherweise Begrenzungsrahmen um jeden Hund, um zu zeigen, wo dieser zu sehen ist. Bei komplexeren Aufgaben können sie die Form des Hundes mithilfe von Segmentierungsmasken umreißen oder Schlüsselpunkte markieren, um dessen Körperhaltung zu erfassen. Diese beschrifteten Beispiele haben direkten Einfluss darauf, wie gut das Modell nach seiner Bereitstellung funktioniert.

Die Verwaltung von Workflows zur Bildannotation in großem Maßstab kann eine Herausforderung darstellen. Große Datensätze erfordern oft einheitliche Beschriftungsstandards, die Zusammenarbeit mehrerer Annotatoren sowie Tools, die die Überprüfung und Verfeinerung von Annotationen erleichtern.

Ultralytics vereint all dies mit einem integrierten Annotationseditor. Sie unterstützt verschiedene Arten von Annotationsaufgaben und bietet Teams eine einfachere Möglichkeit, Daten zu kennzeichnen und Datensätze für die Bildverarbeitung in einem einzigen Arbeitsablauf vorzubereiten.

In diesem Artikel erfahren Sie, wie der Annotationseditor Ultralytics Teams dabei unterstützt, Datensätze effizient zu annotieren und die Datenaufbereitung zu optimieren. Los geht’s!

Bevor wir uns mit den auf Ultralytics verfügbaren Tools zur Bildannotation befassen, wollen wir zunächst einen Schritt zurücktreten, um zu verstehen, was Datenannotation ist und warum sie für die Entwicklung von Computer-Vision-Systemen wichtig ist.

Modelle der Bildverarbeitung lernen durch die Analyse großer Sammlungen von Bildern oder Videos, die als Datensätze bezeichnet werden. Rohbilder allein liefern jedoch nicht genügend Informationen, damit ein Modell versteht, was es detect identifizieren soll. Damit die Daten für das Training nutzbar sind, müssen die Bilder durch Datenkennzeichnung mit Labels versehen werden, damit das Modell lernen kann, nach welchen Objekten, Formen oder Mustern es suchen soll.

Bei der Bildannotation werden bestimmte Elemente innerhalb eines Bildes markiert und mit Beschriftungen versehen, die beschreiben, was das Modell lernen soll. Diese beschrifteten Beispiele dienen Deep-Learning-Modellen und -Algorithmen während des Trainings als Orientierung und helfen ihnen, bei der Verarbeitung neuer Bilder ähnliche Muster zu erkennen.

Je nach Anwendung und Anwendungsfall erfordern verschiedene Aufgaben im Bereich der Bildverarbeitung unterschiedliche Arten der Bildannotation. So können Annotatoren beispielsweise zur Objekterkennung Begrenzungsrahmen um Objekte zeichnen, zur semantischen Segmentierung Bereiche in einem Bild umranden, zur Posenabschätzung Schlüsselpunkte definieren oder zur Klassifizierung einem gesamten Bild Labels zuweisen.

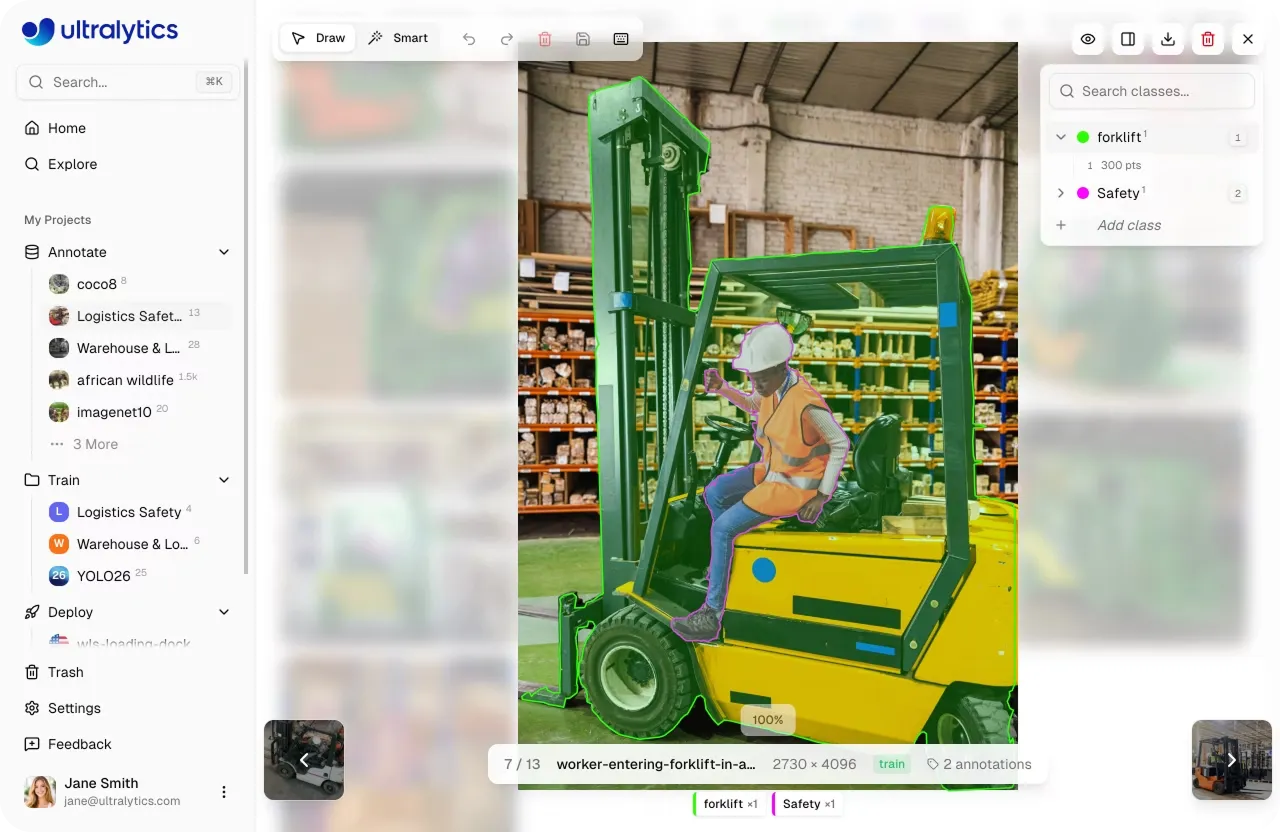

Die Vorbereitung von Daten für Computer-Vision-Projekte umfasst häufig die Arbeit mit verschiedenen Dateiformaten und die Organisation von Datensätzen. Dazu gehört auch, sicherzustellen, dass alles für die Annotation und das Training von Algorithmen für maschinelles Lernen bereit ist. In vielen Arbeitsabläufen verteilt sich dieser Prozess auf mehrere Tools, wobei die Daten hochgeladen, bereinigt und zwischen den Systemen verschoben werden müssen, bevor sie verwendet werden können.

Ultralytics vereinfacht diesen Prozess, indem sie die Datenaufbereitung, das Modelltraining und die Bereitstellung in einer einzigen Umgebung abwickelt. Teams können Bilder, Videos oder Datensatzarchive hochladen und profitieren von einem vollständig anpassbaren Ansatz zur Datenaufbereitung mit manuellen oder KI-automatisierten Annotationen. Ultralytics unterstützt sowohl Rohdaten als auch Standardformate wie YOLO COCO, was den Start neuer Projekte erleichtert. Sie bietet zudem Zugriff auf vorhandene Datensätze auf der Plattform, darunter annotierte Datensätze, mit denen Teams schnell neue Projekte oder Experimente starten können.

Sobald die Daten verfügbar sind, können sie direkt auf der Plattform verwaltet werden. Entwickler können Bilder überprüfen, den Fortschritt der Annotation überwachen und mithilfe integrierter Visualisierungen die Verteilung des Datensatzes nachvollziehen sowie mögliche Lücken erkennen.

Die Plattform unterstützt zudem die Versionierung von Datensätzen und hilft Teams dabei, Momentaufnahmen ihrer Daten im Laufe ihrer Entwicklung zu erstellen. Dies erleichtert es, track , Experimente zu vergleichen und während des Trainings die Konsistenz zu wahren.

Sobald die Daten aufbereitet sind, können die Teams damit fortfahren, die Bilder zu annotieren, wobei diese mit Beschriftungen versehen werden, damit die Modelle lernen, was sie detect sollen.

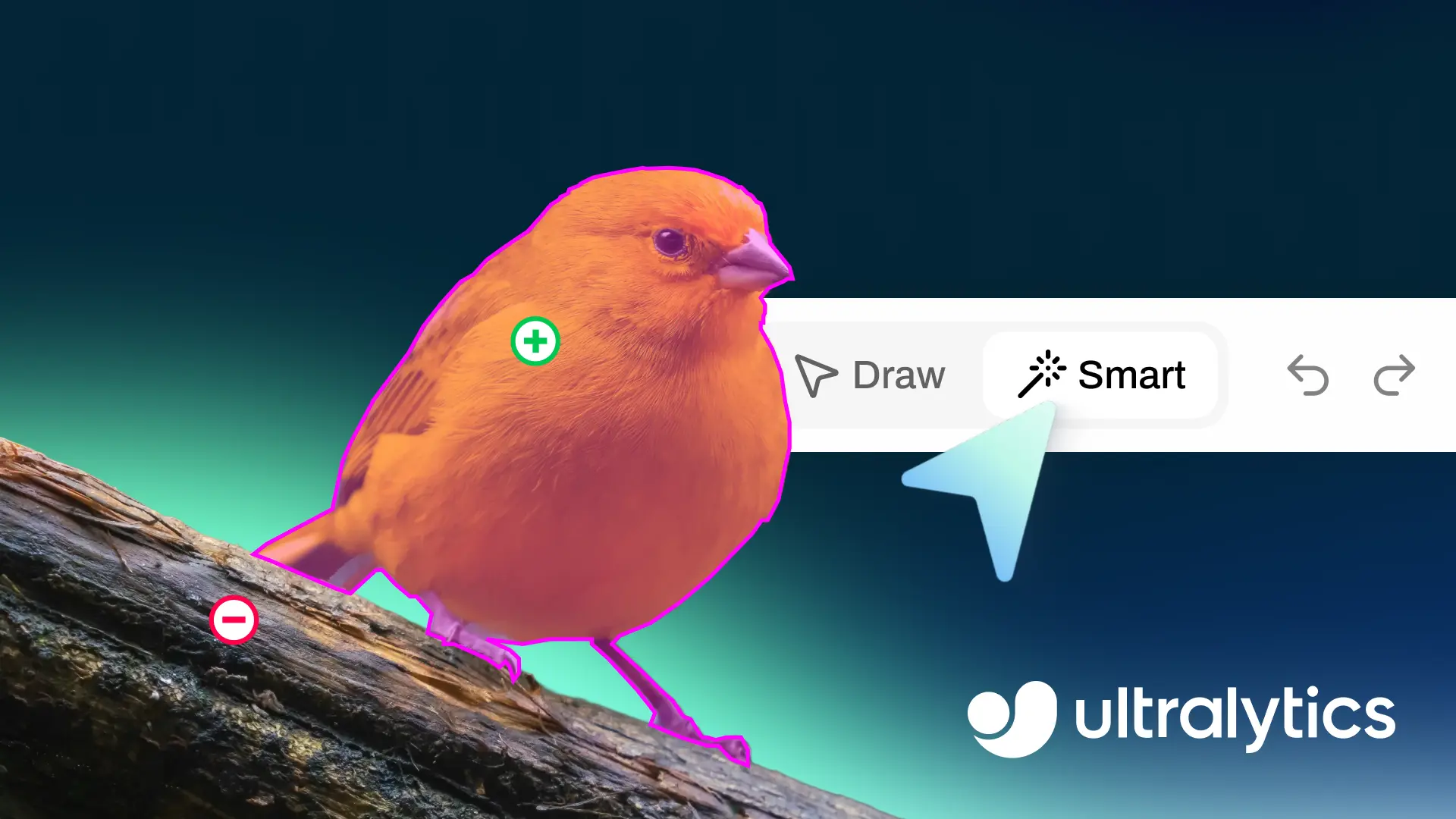

Sobald die Daten hochgeladen sind, folgt der nächste Schritt: die Annotation. Dabei werden die Bilddaten beschriftet, wodurch die Grundlage für das anschließende Training von Computer-Vision-Modellen geschaffen wird. Ultralytics verfügt über integrierte Bildannotationsdienste in Form eines Annotationseditors, der es Teams ermöglicht, Datensätze direkt in derselben Umgebung zu beschriften und zu verwalten.

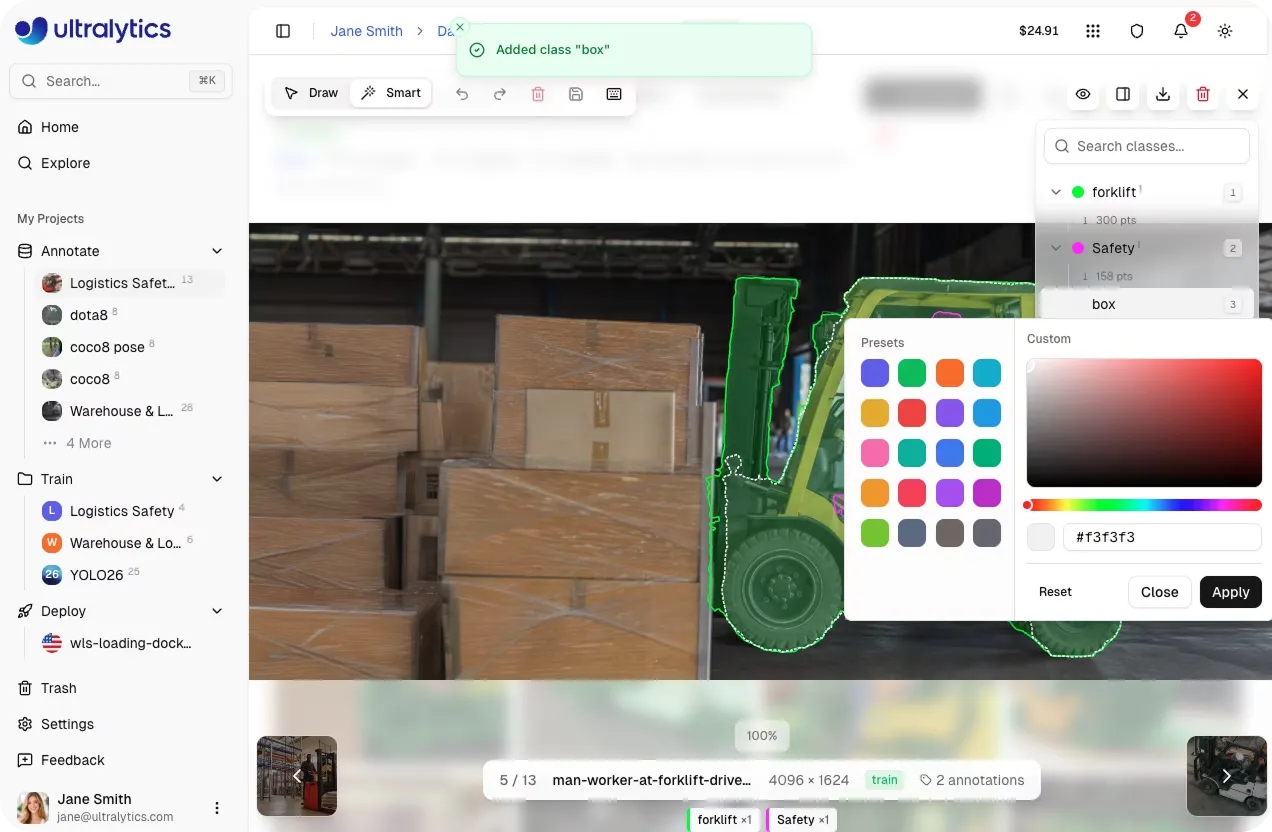

Der Annotationseditor öffnet sich in einer übersichtlichen Arbeitsumgebung, in der Benutzer Bilder prüfen, Beschriftungen hinzufügen und Annotationen nach Bedarf aktualisieren können. Da alles an einem Ort organisiert ist, lassen sich Datensätze leichter konsistent halten und für das Daten-Training vorbereiten.

Teams können Datensätze hochladen und direkt im Browser mit der Bildkennzeichnung beginnen, wobei sie Annotationsklassen definieren und verwalten, um sicherzustellen, dass die Kennzeichnungen im gesamten Datensatz einheitlich bleiben. Während der Erstellung der Annotationen können Nutzer diese im Editor visuell überprüfen, was die Überprüfung der Genauigkeit erleichtert, bevor mit dem Modelltraining fortgefahren wird.

Ultralytics umfasst zudem verschiedene Funktionen, die effiziente Workflows zur Datenbeschriftung unterstützen und den Annotationsprozess mithilfe fortschrittlicher Algorithmen vereinfachen.

Hier sind einige der wichtigsten Funktionen der Ultralytics :

Durch die Kombination von manuellen Werkzeugen, künstlicher Intelligenz und Automatisierung unterstützt Ultralytics die Nutzer dabei, Bilder effizienter zu annotieren. Zudem ermöglicht sie die Aufbereitung hochwertiger Trainingsdaten für skalierbare Computer-Vision-Modelle.

Verschiedene Anwendungsfälle, wie beispielsweise die Qualitätssicherung von Produkten, erfordern unterschiedliche Arten der Annotation, je nachdem, was in den Bildern oder Videos erkannt werden soll. Wie bereits oben erwähnt, unterstützt Ultralytics fünf Objekterkennungsaufgaben, von denen jede ihre eigene Art der Annotation hat.

Schauen wir uns einmal genauer an, welche Annotationsaufgaben die Plattform unterstützt und wie sie zur Beschriftung von Datensätzen genutzt werden können.

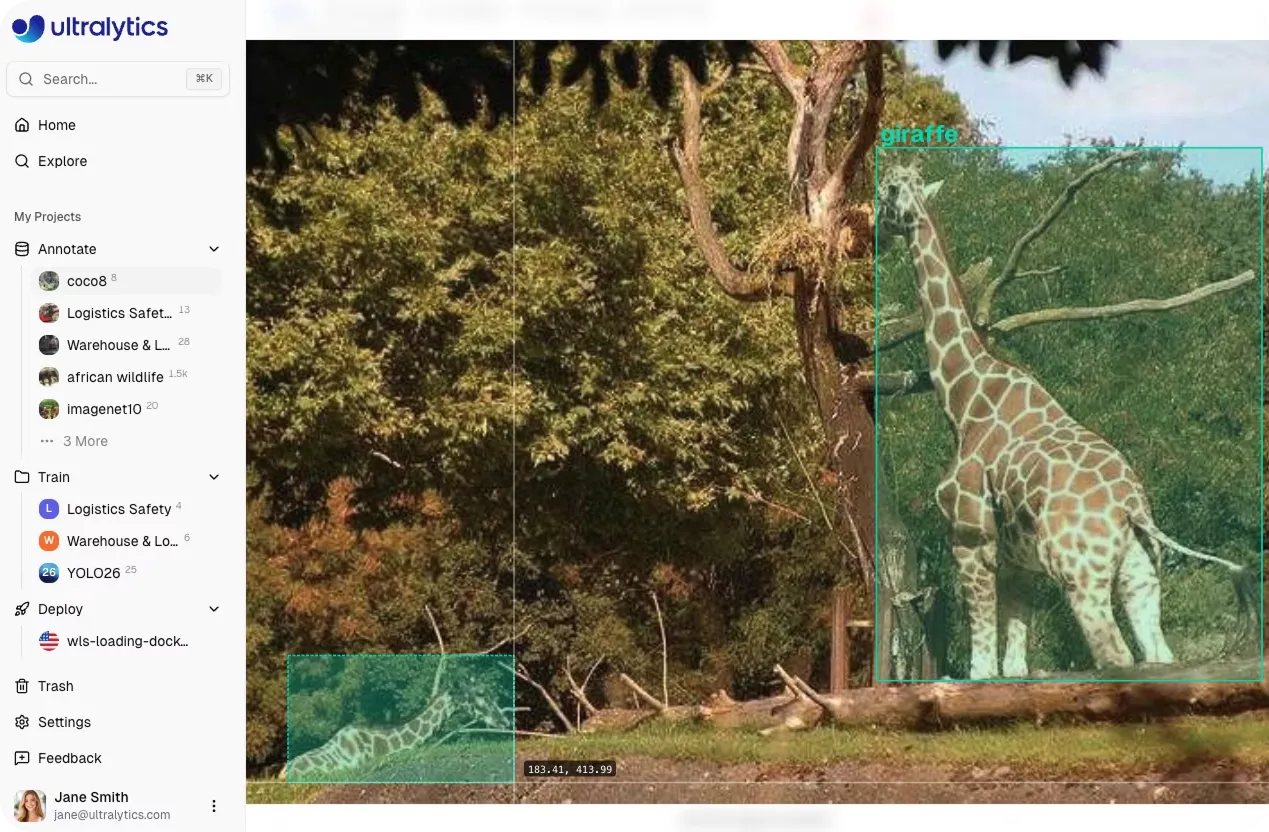

Bei der Objekterkennung werden Objekte in einem Bild identifiziert und lokalisiert. Die Annotatoren markieren jedes relevante Objekt mit Begrenzungsrahmen und geben so an, wo sich die Objekte im Bild befinden.

Im Annotationseditor erfolgt dies mithilfe des Begrenzungsrahmen-Werkzeugs. Benutzer können in den „Bearbeitungsmodus“ wechseln, durch Klicken und Ziehen ein Rechteck um ein Objekt ziehen und über ein Dropdown-Menü eine Klassenbezeichnung zuweisen.

Begrenzungsrahmen können nach ihrer Erstellung angepasst werden. Annotatoren können ihre Größe ändern, indem sie die Eck- oder Kantenpunkte ziehen, sie verschieben, indem sie die Mitte des Rahmens ziehen, oder sie mithilfe von Tastaturbefehlen löschen. Diese Annotationen helfen Bildverarbeitungsmodellen dabei, detect in verschiedenen Szenen und unter unterschiedlichen Bedingungen zu detect .

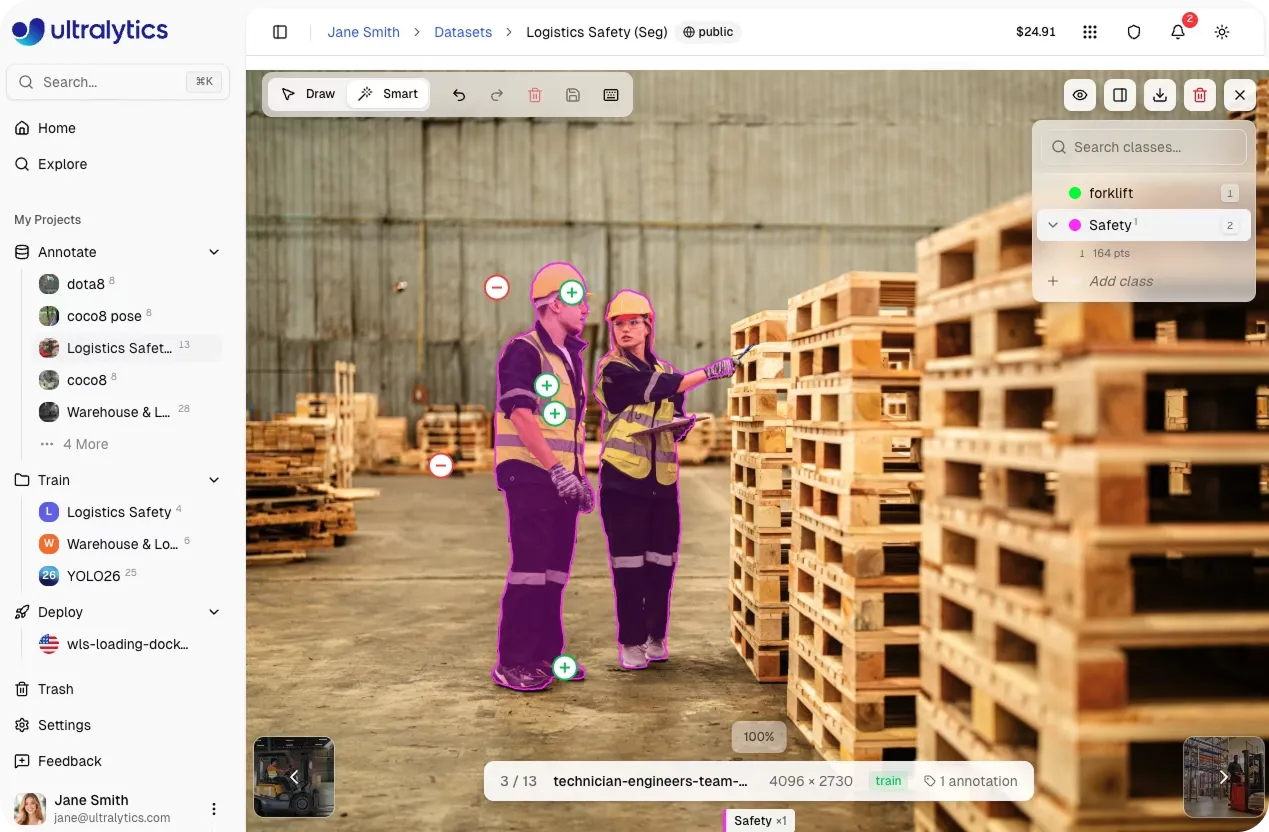

Die Instanzsegmentierung ermöglicht detailliertere Annotationen, indem sie die genaue Form von Objekten innerhalb eines Bildes definiert. Anstatt einen einfachen Rahmen zu zeichnen, zeichnen die Annotatoren die Konturen des Objekts mithilfe von Polygon-Annotationen nach, um präzise Masken für Bildsegmentierungsaufgaben zu erstellen.

Der Annotationseditor enthält für diese Aufgabe ein Polygon-Werkzeug. Die Annotatoren setzen mehrere Eckpunkte entlang der Kanten eines Objekts, um dessen Form nachzuzeichnen. Sobald die Eckpunkte gesetzt sind, kann das Polygon geschlossen werden, um eine Segmentierungsmaske zu erstellen.

Die Eckpunkte können nach der Erstellung des Polygons angepasst werden. Einzelne Punkte lassen sich verschieben, um die Objektgrenzen zu verfeinern, und bei Bedarf können Eckpunkte entfernt werden. Diese Anmerkungen auf Pixelebene helfen den Modellen dabei, detaillierte visuelle Strukturen zu erlernen und zwischen Objekten zu unterscheiden, die nahe beieinander liegen.

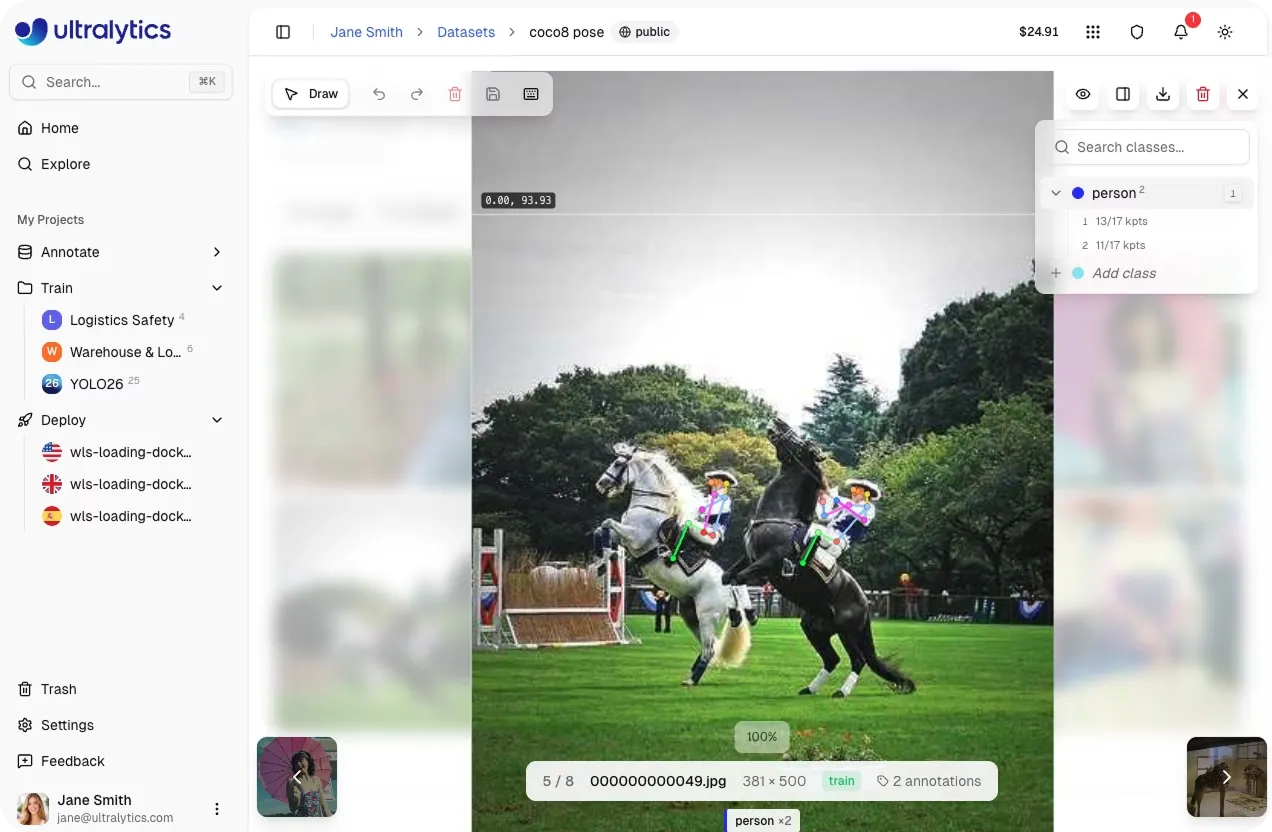

Annotationen zur Posenabschätzung erfassen die Positionen der Körpergelenke und die Beziehungen zwischen ihnen. Dies hilft Modellen dabei, die Struktur und die Bewegungen von Menschen oder Tieren in einem Bild zu verstehen.

Mithilfe des Keypoint-Werkzeugs setzen die Annotatoren Kontrollpunkte, die Körpergelenke wie Schultern, Ellbogen, Handgelenke, Hüften, Knie und Knöchel darstellen. Die Plattform unterstützt mehrere integrierte Skelettvorlagen, darunter das COCO Körperhaltungen sowie Vorlagen für Hände, Gesichter, Hunde und Ecken von Kisten.

Mit Vorlagen lässt sich ein vollständiges Skelettlayout mit einem einzigen Klick einfügen; anschließend können einzelne Schlüsselpunkte an die Pose im Bild angepasst werden. Jeder Schlüsselpunkt kann zudem mit einem Sichtbarkeitsflag versehen werden, um anzugeben, ob er sichtbar oder verdeckt ist.

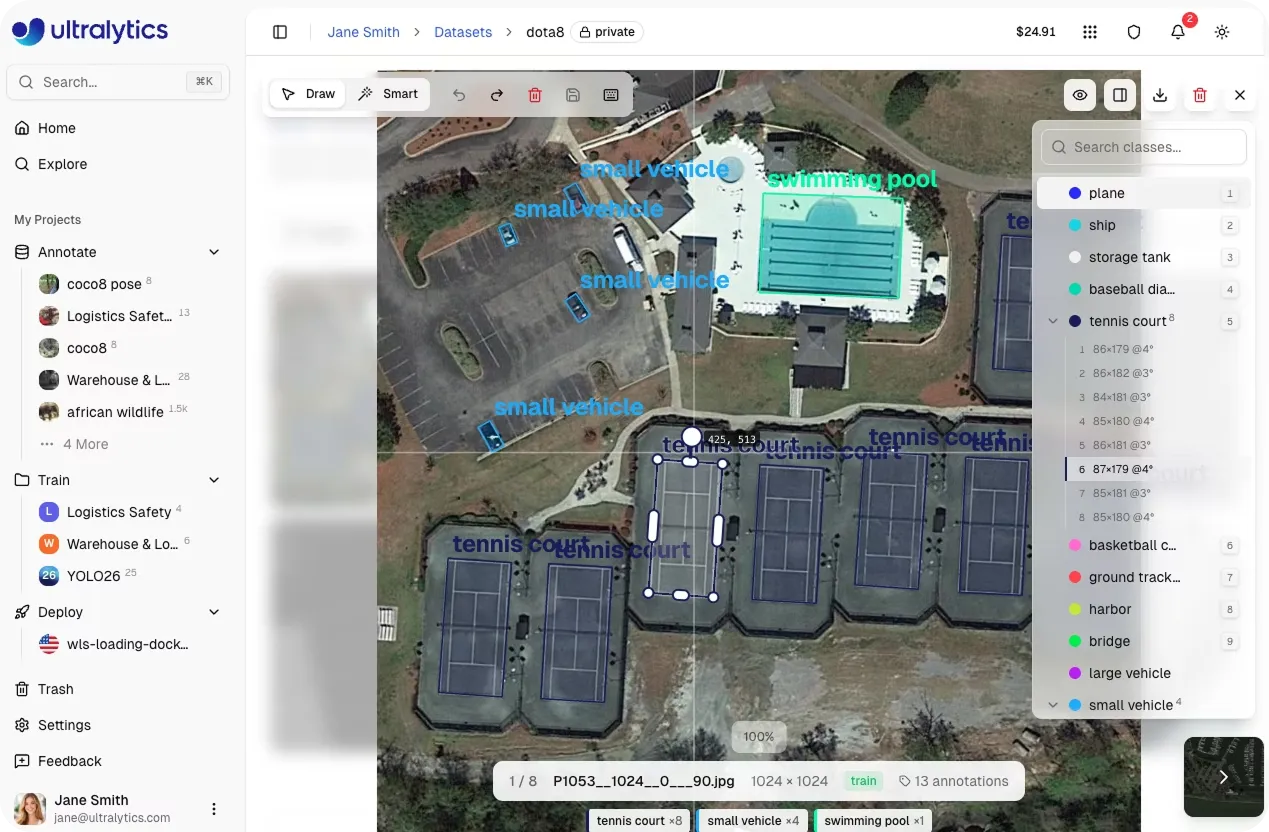

Orientierte Begrenzungsrahmen gehen über herkömmliche Begrenzungsrahmen hinaus, da sie eine Drehung ermöglichen. Diese Art der Annotation ist nützlich, wenn Objekte schräg erscheinen, anstatt am Bildrand ausgerichtet zu sein.

Im Annotationseditor können Annotatoren das Werkzeug „Ausrichtbare Begrenzungsrahmen“ verwenden, um gedrehte Rechtecke um Objekte zu zeichnen. Nach dem Zeichnen des ersten Rahmens lässt sich der Winkel mithilfe eines Drehgriffs anpassen, während die Größe des Rahmens über Eckgriffe geändert werden kann.

Drehbare Anmerkungen werden häufig in Luftbildern, Datensätzen zur industriellen Inspektion und anderen Szenarien verwendet, in denen Objekte schräg oder aus unterschiedlichen Blickwinkeln dargestellt werden.

Bei der Bildklassifizierung wird dem gesamten Bild eine Bezeichnung zugewiesen, anstatt einzelne Objekte darin zu kennzeichnen.

Für Klassifizierungsdatensätze bietet der Annotationseditor ein Klassenauswahlfenster. Annotatoren können Bildern Labels zuweisen, indem sie eine Klasse aus der Seitenleiste auswählen oder zur schnelleren Beschriftung Tastaturkürzel verwenden.

Diese Bildbeschriftungen helfen den Modellen dabei, übergeordnete visuelle Muster zu lernen, die verschiedene Kategorien repräsentieren.

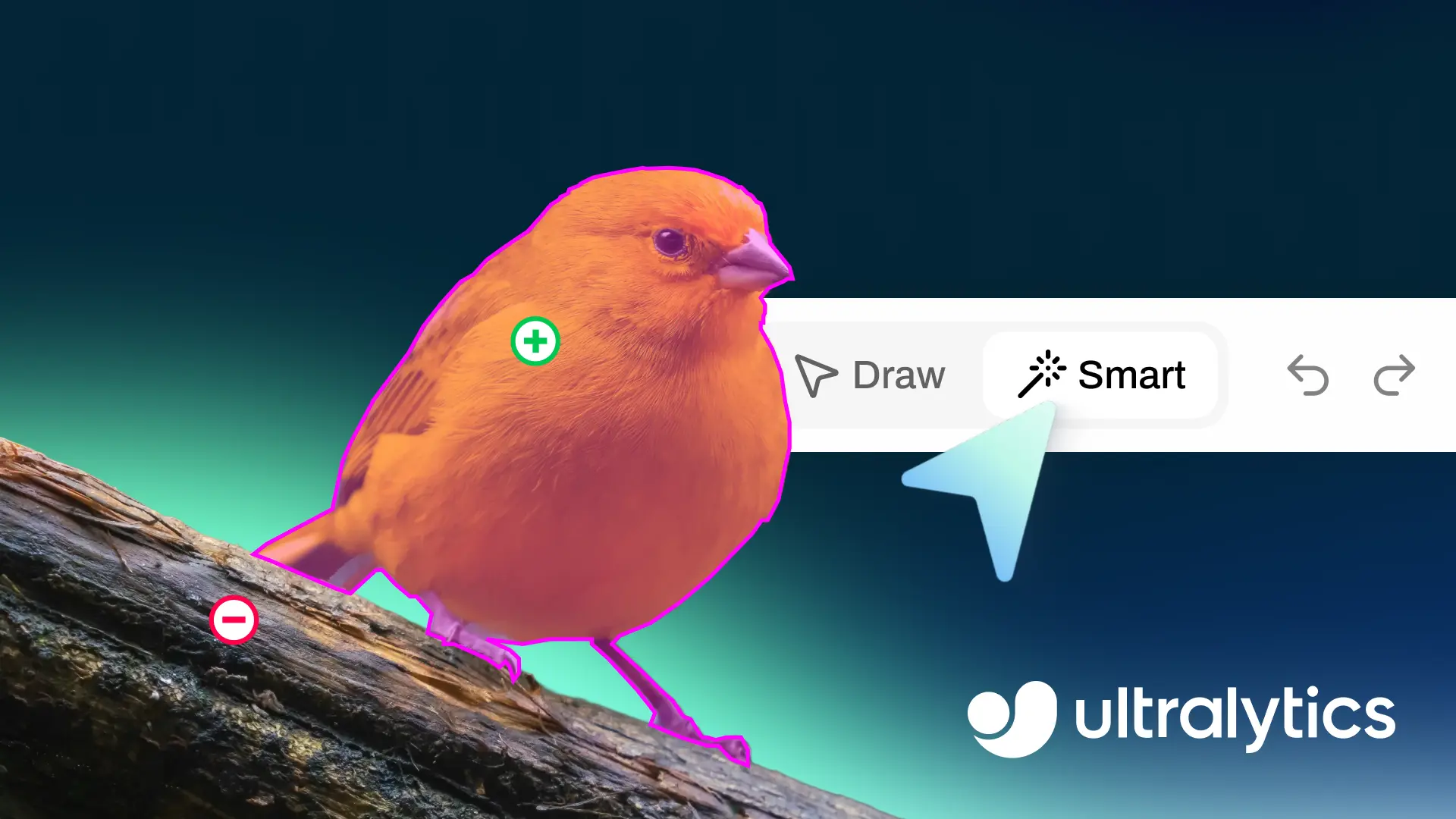

Das Beschriften von Bildern für Aufgaben wie die Segmentierung erfordert oft sorgfältige und detailgenaue Arbeit, insbesondere wenn Objekte präzise umrandet werden müssen. Ultralytics umfasst KI-gestützte Annotationswerkzeuge, die den Prozess beschleunigen und gleichzeitig dafür sorgen, dass die Annotationen präzise und leicht zu überprüfen sind.

So können Annotatoren beispielsweise mit einem Bild interagieren, indem sie auf Teile eines Objekts klicken, die sie in die Annotation aufnehmen möchten. Sie können auch Bereiche markieren, die ausgeschlossen werden sollen, um das Ergebnis zu verfeinern. Auf Grundlage dieser Eingaben erstellt das Modell in Echtzeit eine Segmentierungsmaske, die anschließend überprüft und angepasst werden kann, bevor sie gespeichert wird.

Dieser Ansatz erleichtert die Bearbeitung komplexer Bilder, ohne dass jedes Detail manuell nachgezeichnet werden muss. Gleichzeitig behalten die Annotatoren die Kontrolle über das Endergebnis und stellen so sicher, dass die Annotationen im gesamten Datensatz einheitlich bleiben.

Diese Funktionen basieren auf den Segment Anything Models (SAM). Diese Modelle sind Teil eines umfassenden Ökosystems von Open-Source-Tools für die Bildverarbeitung, die darauf ausgelegt sind, aus minimalen Eingaben hochwertige Segmentierungen zu generieren. Die Plattform unterstützt mehrere SAM , darunter SAM .1 und SAM . Dies gibt Teams die Flexibilität, je nach Bedarf zwischen schnellerer Leistung und detaillierteren Ergebnissen zu wählen.

Diese KI-gestützten Tools lassen sich für verschiedene Aufgaben wie Objekterkennung, Instanzsegmentierung und die Erkennung orientierter Begrenzungsrahmen einsetzen. Dadurch können Teams große Datensätze effizienter verarbeiten und gleichzeitig die für ein zuverlässiges Modelltraining erforderliche Qualität gewährleisten.

Im Laufe der Annotationsarbeit kommt es häufig vor, dass man zurückgeht, um Beschriftungen anzupassen, Fehler zu beheben oder Bilder genauer zu prüfen. Der Ultralytics verfügt über integrierte Tools, die diese alltäglichen Aufgaben vereinfachen und zeitsparender machen.

Zu den im Editor verfügbaren Workflow-Funktionen gehören unter anderem:

Klare und einheitliche Annotationsklassen spielen eine wichtige Rolle beim Aufbau zuverlässiger Datensätze für die Bildverarbeitung. Mit zunehmendem Projektumfang kann die Verwaltung der Datenkennzeichnung bei großen Datensätzen schwierig werden, insbesondere wenn mehrere Annotatoren beteiligt sind. Eine gut organisierte Klassenstruktur trägt dazu bei, dass die Annotationen konsistent bleiben und die Modelle aus strukturierten Daten lernen.

Ultralytics vereinfacht diesen Prozess, indem sie die Klassenverwaltung direkt in den Annotationseditor integriert. Anstatt Labels separat zu verwalten, können Teams Klassen erstellen, aktualisieren und überprüfen, während sie an den Bildern arbeiten, was es einfacher macht, während des gesamten Annotations-Workflows Konsistenz zu gewährleisten.

Im Editor stehen alle Klassen in einer Seitenleiste neben der Anmerkungsfläche zur Verfügung. So lässt sich beim Anmerken ganz einfach die richtige Bezeichnung auswählen und track wie die Klassen im gesamten Datensatz verwendet werden. Benutzer können nach vorhandenen Klassen suchen oder bei Bedarf neue erstellen, ohne ihren Arbeitsablauf unterbrechen zu müssen.

Die Details zu den Klassen können ebenfalls jederzeit aktualisiert werden. Namen lassen sich direkt bearbeiten, und es können Farben zugewiesen werden, um verschiedene Klassen in den Anmerkungen leichter unterscheiden zu können. Der Editor zeigt zudem an, wie viele Anmerkungen mit jeder Klasse verknüpft sind, und ermöglicht es den Benutzern, diese zu überprüfen, wodurch Teams die Konsistenz und Genauigkeit sicherstellen können.

Alle Klassen werden über eine zentrale Tabelle verwaltet, in der sie sortiert, durchsucht und aktualisiert werden können. Alle hier vorgenommenen Änderungen werden automatisch auf den gesamten Datensatz angewendet, was den Teams hilft, die Konsistenz zu wahren, wenn Annotationsprojekte an Umfang zunehmen.

Wenn Computer-Vision-Systeme von der Entwicklungsphase in den praktischen Einsatz übergehen, spielt die Qualität der annotierten Daten eine entscheidende Rolle für die Leistungsfähigkeit der Modelle. Gut annotierte Datensätze helfen den Modellen dabei, genauere und konsistentere Vorhersagen zu treffen, insbesondere in dynamischen oder unvorhersehbaren Umgebungen.

In der Praxis können selbst kleine Unstimmigkeiten bei der Annotation das Verhalten des Modells beeinflussen. Unterschiede bei der Beschriftung von Objekten oder beim Umgang mit Randfällen sind während des Trainings möglicherweise nicht offensichtlich, können jedoch nach der Inbetriebnahme der Systeme zu weniger zuverlässigen Vorhersagen führen.

Darüber hinaus können diese Unstimmigkeiten in praktischen Anwendungen noch deutlicher zutage treten. So stützen sich beispielsweise in der Robotik und in Gesundheitssystemen Modelle auf visuelle Eingaben, um detect und Handlungen in Echtzeit zu steuern. Abweichungen bei der Klassifizierung können beeinflussen, wie genau diese Systeme ihre Umgebung interpretieren.

Durch die Einhaltung einheitlicher Annotationsverfahren und den Einsatz von Plattformen wie Ultralytics Verwaltung und kontinuierlichen Optimierung von Datensätzen können Teams Modelle entwickeln, die auch außerhalb kontrollierter Testumgebungen zuverlässiger funktionieren.

Eine hochwertige Datenannotation ist unerlässlich, um präzise Computer-Vision-Modelle zu trainieren und erfolgreiche Bildannotationsprojekte zu unterstützen. Ultralytics vereinfacht diesen Prozess durch einen leistungsstarken Annotationseditor, der zahlreiche Bildverarbeitungsaufgaben unterstützt. Durch die Kombination von Tools zur manuellen Annotation mit KI-gestützter Beschriftung mittels SAM integrierten Workflow-Funktionen können Teams Datensätze effizienter aufbereiten und schneller von der Datenaufbereitung zur Modellentwicklung übergehen.

Werden Sie Teil unserer Community und stöbern Sie im GitHub-Repository, um mehr über Modelle für die Bildverarbeitung zu erfahren. Informieren Sie sich auf unseren Lösungsseiten über Anwendungsbereiche wie KI in der Automobilindustrie und Bildverarbeitung in der Robotik. Sehen Sie sich unsere Lizenzoptionen an und beginnen Sie mit der Entwicklung Ihres eigenen KI-Modells für die Bildverarbeitung.

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens