Scegli il dispositivo edge giusto per il tuo progetto di computer vision

Scopri come scegliere il dispositivo edge giusto per il tuo progetto di computer vision in base a prestazioni, efficienza energetica e requisiti di deployment.

L'Edge AI sta diventando rapidamente una delle tendenze principali nell'intelligenza artificiale e nella computer vision. Porta l'intelligenza in tempo reale direttamente sui dispositivi, invece di affidarsi al cloud computing, dove i dati vengono inviati altrove per l'elaborazione. Di fatto, si prevede che il mercato globale dell'Edge AI raggiungerà circa 143,06 miliardi di dollari entro il 2034.

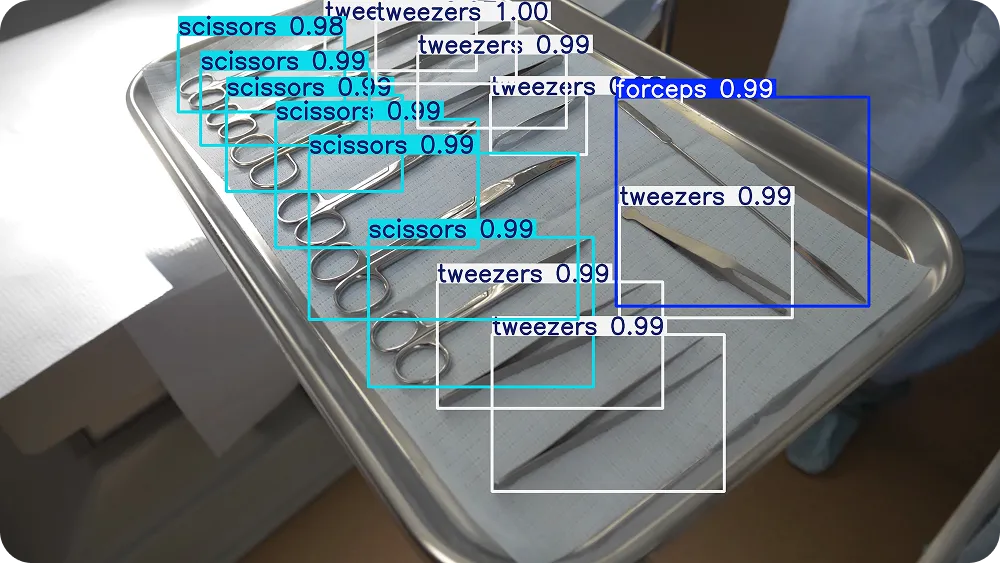

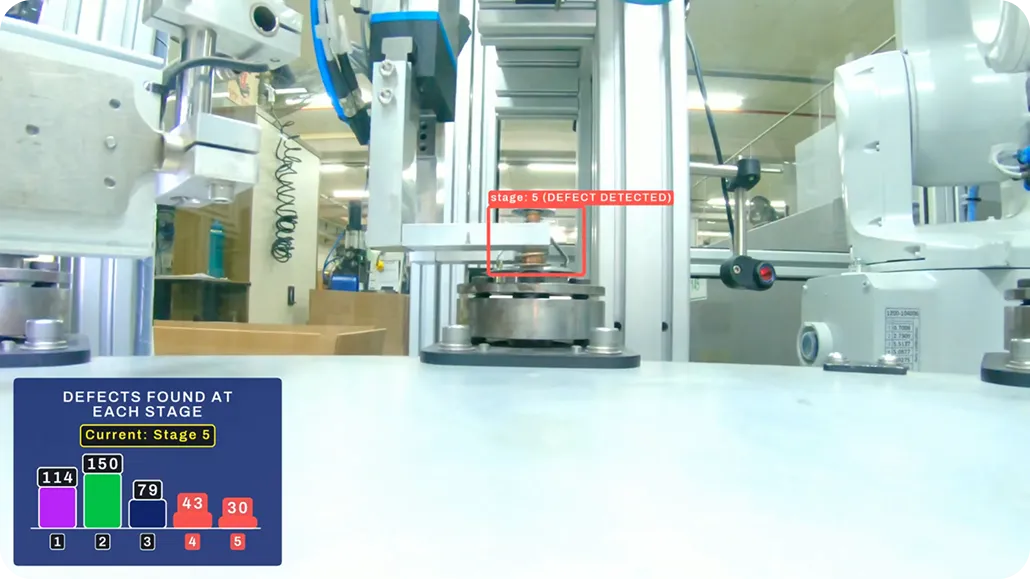

Grazie ai recenti progressi tecnologici, l'Edge AI sta ridefinendo l'automazione in tempo reale basata sulla visione in molti settori. L'ispezione della qualità nella produzione ne è un ottimo esempio.

In questo caso, le telecamere di vision AI analizzano continuamente i prodotti su un nastro trasportatore. Possono essere utilizzate per rilevare rapidamente difetti e anomalie. Questo è particolarmente cruciale nei settori che richiedono un'elevata precisione, come la produzione di strumenti chirurgici.

Fig 1. Un esempio dell'utilizzo della vision AI per rilevare strumenti chirurgici

Ma cosa sono esattamente i dispositivi edge? Si tratta di sistemi hardware in grado di eseguire modelli di IA e modelli di computer vision, come Ultralytics YOLO26, nel punto in cui i dati vengono generati o nelle immediate vicinanze.

Potrebbe trattarsi di un piano di fabbrica, all'interno di una smart camera o a bordo di veicoli autonomi. Eseguendo l'inferenza localmente, questi dispositivi consentono tempi di risposta più rapidi. Inoltre, riducono l'utilizzo della larghezza di banda perché i dati visivi non devono essere trasmessi in streaming verso il cloud.

Tuttavia, scegliere il dispositivo edge giusto per il tuo progetto di computer vision può essere complicato. L'hardware che funziona bene in un ambiente potrebbe non essere adatto a un altro.

Ad esempio, un dispositivo che funziona in modo affidabile in una fabbrica potrebbe non essere adatto per le ispezioni con droni, dove i limiti di peso e di alimentazione sono molto diversi. Scegliere il dispositivo sbagliato può aumentare i costi, rallentare il lancio e complicare la scalabilità.

Ecco perché i team dovrebbero valutare fattori come le dimensioni del dispositivo, l'assorbimento energetico, i limiti termici e la disponibilità industriale, piuttosto che solo la potenza di calcolo. In questo articolo esploreremo l'Edge AI e come scegliere il dispositivo edge giusto per la tua applicazione di computer vision. Iniziamo!

Principali vantaggi dell'utilizzo di dispositivi edge

Prima di addentrarci su come scegliere il dispositivo edge giusto per il tuo specifico progetto di vision AI, facciamo un passo indietro e discutiamo alcuni dei vantaggi derivanti dall'utilizzo di dispositivi edge per i progetti di vision AI.

Ecco alcuni dei principali vantaggi dell'implementazione della vision AI all'edge:

- Prestazioni in tempo reale: I dati vengono elaborati nel punto in cui è installata la telecamera o nelle immediate vicinanze, consentendo risposte istantanee per casi d'uso come il rilevamento dei difetti, il monitoraggio della sicurezza e la robotica. Questa elaborazione locale supporta il processo decisionale in tempo reale, consentendo ai sistemi di reagire immediatamente al variare delle condizioni senza fare affidamento sulla connettività cloud.

- Costi di larghezza di banda inferiori: Invece di trasmettere video grezzi al cloud, i dispositivi edge trasmettono solo metadati, avvisi o approfondimenti rilevanti. Ciò riduce significativamente il carico di rete e le spese di archiviazione nel cloud.

- Funzionamento offline: La maggior parte dei sistemi edge può continuare a funzionare anche con una connettività internet instabile o limitata, il che è comune in fabbriche, magazzini e ambienti remoti.

- Maggiore privacy: I dati video rimangono in loco, facilitando il rispetto dei requisiti di privacy e conformità, riducendo al contempo l'esposizione di informazioni sensibili.

- Scalabilità semplice in molte sedi: Le architetture edge riducono la dipendenza dall'infrastruttura cloud centralizzata. Ciò consente ai team di replicare la stessa configurazione in più sedi con prestazioni costanti.

Comprendere i requisiti della tua applicazione

Il primo passo per scegliere il dispositivo edge giusto è capire di cosa ha effettivamente bisogno la tua applicazione. L'hardware che selezioni deve corrispondere a ciò che il sistema dovrebbe fare, alla velocità con cui deve funzionare e al luogo in cui verrà installato.

Puoi iniziare definendo i requisiti di prestazione. Mentre alcune soluzioni richiedono un'inferenza AI in tempo reale ad alti FPS (frame al secondo), altre possono elaborare i fotogrammi in gruppi o batch.

Anche la complessità e le dimensioni del modello giocano un ruolo importante. I modelli leggeri di rilevamento oggetti possono spesso funzionare su dispositivi più piccoli e a basso consumo, mentre modelli più complessi e pesanti o pipeline a più stadi richiedono maggiore potenza di calcolo e memoria.

Successivamente, considera la configurazione dei tuoi dati. Ciò include la risoluzione della telecamera, il frame rate, il numero di flussi paralleli e i tipi di sensori come RGB, termici o di profondità. Questi fattori influenzano direttamente la larghezza di banda, il throughput, l'utilizzo della memoria e il carico complessivo del sistema.

Il compromesso tra precisione e latenza

Oltre ai requisiti hardware e di dati, la selezione del modello gioca un ruolo critico nelle prestazioni complessive del sistema. La maggior parte delle implementazioni edge comporta un compromesso tra latenza e precisione. I modelli a maggiore precisione sono solitamente più intensivi dal punto di vista computazionale e possono aumentare il tempo di inferenza.

I modelli più veloci, d'altra parte, potrebbero sacrificare parte della precisione. L'obiettivo è trovare il giusto equilibrio tra velocità e precisione in base al tuo caso d'uso specifico e ai vincoli operativi.

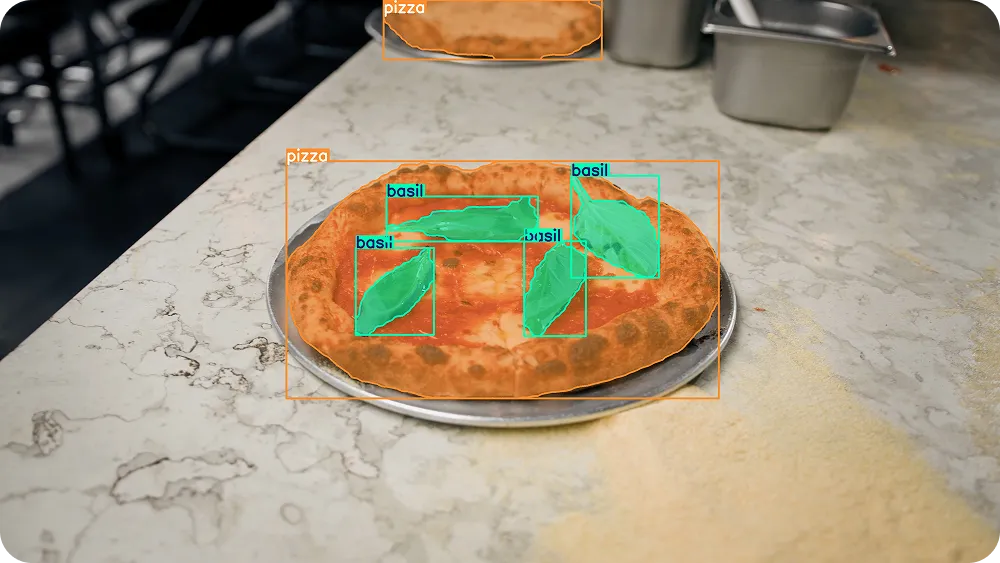

Ad esempio, nelle linee di produzione alimentare automatizzate, i sistemi di computer vision vengono utilizzati per ispezionare i prodotti prima che vengano confezionati e spediti. Questi sistemi devono operare in tempo reale per evitare di rallentare il nastro trasportatore.

Considera una linea di montaggio di pizze, dove il sistema deve verificare che ogni pizza abbia gli ingredienti corretti. Un modello come Ultralytics YOLO26 può rilevare la pizza e i suoi condimenti in tempo reale, identificando ingredienti mancanti o errati. In questo scenario, il modello deve essere abbastanza preciso da cogliere gli errori e allo stesso tempo abbastanza veloce da stare al passo con le velocità di produzione su hardware edge.

Fig 2. Utilizzo di Ultralytics YOLO26 per rilevare e segmentare una pizza e i suoi condimenti.

Considera le dimensioni del dispositivo edge

Oltre alle prestazioni di calcolo, le dimensioni fisiche del dispositivo edge sono un altro fattore importante nella pianificazione dell'implementazione. Il fattore di forma del dispositivo (le sue dimensioni fisiche, la forma, lo stile di montaggio e le interfacce di espansione) influenza direttamente la facilità con cui si integra nell'ambiente e le sue prestazioni in condizioni reali.

Tipi di dispositivi Edge AI e i loro fattori di forma

L'hardware Edge AI è disponibile in molti fattori di forma, che spaziano da server rack completi e schede acceleratrici Peripheral Component Interconnect Express (PCIe) a moduli M.2 compatti, piattaforme System-on-Module (SoM), computer a scheda singola (SBC), smart camera e persino sensori di visione intelligenti con elaborazione AI on-chip. Ogni formato offre diversi compromessi in termini di prestazioni, efficienza energetica, design termico e complessità di integrazione.

Le dimensioni del dispositivo sono strettamente legate ai requisiti di raffreddamento, alla disponibilità di alimentazione e all'architettura complessiva del sistema. Sistemi più grandi come PC industriali montati su rack o workstation tower supportano in genere GPU PCIe a piena altezza, schede di espansione multiple e raffreddamento attivo. Queste piattaforme sono adatte per l'elaborazione multi-camera, hub edge centralizzati o analisi video ad alto throughput.

Al contrario, fattori di forma compatti come acceleratori M.2, SoM montati su carrier board personalizzate, SBC o smart camera all-in-one sono progettati per ambienti con spazio limitato. Questi dispositivi più piccoli privilegiano spesso l'efficienza energetica e il raffreddamento passivo, rendendoli ideali per sistemi embedded, robot mobili, droni, chioschi e unità di ispezione distribuite.

All'estremo della miniaturizzazione, alcune implementazioni si basano su sensori di visione intelligenti o piattaforme basate su microcontrollori (TinyML), dove l'inferenza viene eseguita direttamente sul sensore di immagine o sul processore a basso consumo. Questi sistemi riducono significativamente l'ingombro fisico e il consumo energetico, ma sono solitamente adatti a carichi di lavoro più limitati e altamente ottimizzati.

Queste differenze nelle dimensioni, nella modularità e nel modello di integrazione portano generalmente a due categorie comuni di implementazione edge: implementazioni scalabili e implementazioni a spazio limitato. Ogni approccio affronta diversi vincoli di prestazioni, alimentazione e ambientali, definendo al contempo la manutenibilità a lungo termine e il design del sistema.

Implementazioni scalabili

Gli acceleratori PCIe e i personal computer (PC) montati su rack o industriali sono comunemente utilizzati quando un progetto richiede un'elevata potenza di calcolo o deve elaborare dati da più telecamere contemporaneamente. Un acceleratore PCIe è una scheda hardware installata all'interno di un computer più grande tramite uno slot PCIe.

Aggiunge risorse di calcolo dedicate, come un'unità di elaborazione grafica (GPU) o un altro acceleratore AI, per aumentare la capacità del sistema di gestire i carichi di lavoro AI. È simile a come una scheda grafica migliora le prestazioni in un computer desktop.

I PC rack o industriali sono sistemi più grandi e robusti progettati per il funzionamento continuo in ambienti come fabbriche, piani di produzione o sale di controllo. Offrono più spazio per il raffreddamento, l'espansione hardware e componenti ad alta potenza, rendendoli adatti a carichi di lavoro impegnativi come l'ispezione della qualità multi-camera o l'analisi video su larga scala.

Implementazioni a spazio limitato

Le implementazioni a spazio limitato sono comuni in ambienti in cui un dispositivo edge deve operare entro stretti limiti fisici, termici o di alimentazione. Ciò include spesso smart camera montate su linee di produzione, robot mobili, droni, chioschi o sistemi di ispezione compatti.

In questi casi, l'hardware deve essere piccolo, leggero ed efficiente dal punto di vista energetico, pur offrendo prestazioni AI affidabili. Due opzioni hardware comuni per queste implementazioni sono i moduli M.2 e i computer a scheda singola.

Un modulo M.2 è una scheda di espansione compatta che si inserisce in uno slot M.2 all'interno di un sistema host. Sebbene M.2 sia semplicemente uno standard di fattore di forma e interfaccia, alcuni moduli sono progettati specificamente per l'accelerazione AI.

Questi moduli acceleratori AI consentono ai piccoli dispositivi di eseguire modelli di computer vision in modo più efficiente senza aumentare significativamente le dimensioni o il consumo energetico. Gli acceleratori M.2 sono spesso integrati in sistemi embedded dove l'aggiunta di una scheda di espansione PCIe a grandezza naturale non sarebbe pratica.

Nel frattempo, un computer a scheda singola è un computer completo costruito su un'unica scheda a circuito stampato. Integra CPU, memoria, interfacce di archiviazione e connessioni di ingresso/uscita (I/O) in un fattore di forma compatto. Poiché tutto è contenuto in una sola scheda, gli SBC sono ampiamente utilizzati in applicazioni embedded ed edge in cui lo spazio è limitato e la semplicità è importante.

Sebbene i sistemi a spazio limitato offrano in genere prestazioni di calcolo grezze inferiori rispetto ai sistemi rack più grandi, consentono l'inferenza sul dispositivo vicino a dove vengono generati i dati. Ciò riduce la latenza, diminuisce l'utilizzo della larghezza di banda e migliora la flessibilità dell'implementazione in ambienti in cui l'hardware più grande non troverebbe posto.

Accelerazione AI dedicata per la visione embedded

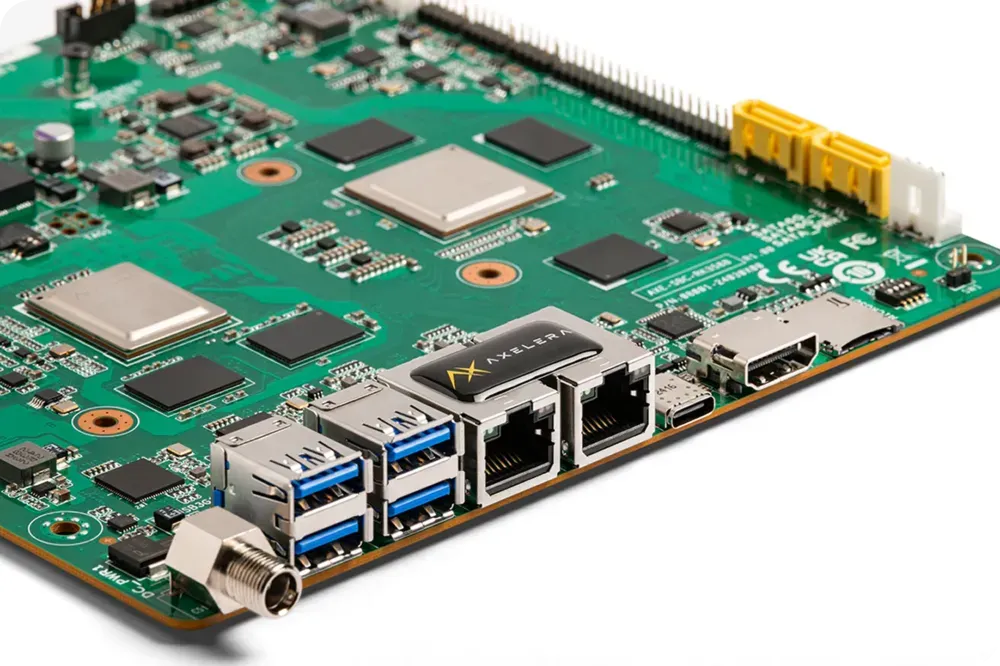

Molti fornitori di hardware si stanno concentrando specificamente sull'accelerazione AI compatta ed efficiente dal punto di vista energetico per la visione embedded. Ad esempio, Axelera AI offre acceleratori Metis® AI Processing Unit (AIPU) in molteplici fattori di forma, tra cui schede PCIe, moduli M.2 e schede di calcolo integrate per implementazioni a spazio limitato.

Grazie a un'integrazione con Ultralytics, i modelli YOLO supportati come Ultralytics YOLOv8 e YOLO26 possono essere esportati nel formato Axelera utilizzando il pacchetto Python di Ultralytics e ottimizzati tramite il Voyager SDK, che gestisce la compilazione e la quantizzazione INT8 per un'efficiente inferenza edge.

Fig 3. Uno sguardo alla Metis AI Processing Unit di Axelera AI (Fonte)

Tieni conto del consumo energetico

Il consumo energetico è anche un vincolo chiave nelle implementazioni edge perché influisce direttamente sulla generazione di calore e sui requisiti di raffreddamento. Determina se il sistema può operare in modo affidabile all'interno di involucri sigillati o alloggiamenti industriali compatti.

Questo diventa particolarmente vitale in ambienti alimentati a batteria come robot mobili, droni o stazioni di monitoraggio remoto, dove ogni watt (W) influisce sull'autonomia e sulla stabilità complessiva del sistema.

La maggior parte dei dispositivi edge rientra in tre ampie fasce di consumo energetico. Ecco un'analisi più dettagliata di ciascuna di esse:

- Dispositivi a basso consumo (<10W): Sono tipicamente utilizzati in sistemi embedded dove sono richiesti dimensioni compatte e raffreddamento passivo.

- Dispositivi di fascia media (10–50W): Questi dispositivi sono comuni in gateway edge e endpoint di fabbrica che richiedono un throughput più elevato pur operando entro limiti termici controllati.

- Dispositivi ad alta potenza (>50W): Tali dispositivi sono solitamente acceleratori PCIe o PC industriali progettati per l'elaborazione multi-camera e carichi di lavoro pesanti. Sono spesso abbinati a raffreddamento attivo e involucri più grandi.

È importante tenere a mente che le caratteristiche del carico di lavoro giocano un ruolo importante nel determinare quale fascia di potenza sia appropriata. Frame rate più elevati, modelli di visione più grandi e flussi di telecamere paralleli multipli aumentano tutti la richiesta di calcolo, che a sua volta aumenta il consumo energetico.

Oggigiorno, molti fornitori di hardware si stanno concentrando sull'accelerazione AI efficiente dal punto di vista energetico. Ad esempio, i moduli edge di DEEPX sono progettati per l'inferenza a basso consumo nelle implementazioni edge. Anche i processori Intel offrono funzionalità di gestione e scalabilità energetica che consentono di regolare le prestazioni in base ai requisiti ambientali e del carico di lavoro.

Considera la disponibilità industriale e il supporto al ciclo di vita

Diciamo che hai completato con successo un'implementazione pilota. Il modello funziona bene, l'hardware soddisfa i requisiti di prestazione e il sistema funziona in modo affidabile durante i test.

La sfida successiva è scalare quella soluzione nella produzione completa. È qui che la disponibilità industriale e il supporto al ciclo di vita diventano critici.

La maggior parte dei sistemi edge dovrebbe funzionare continuamente per anni. Selezionare hardware che potrebbe essere fuori produzione poco dopo il lancio introduce un rischio significativo. Anche se un dispositivo funziona bene durante un progetto pilota, può diventare una passività se raggiunge la fine del ciclo di vita o diventa difficile da reperire una volta iniziata la produzione.

Cicli di vita di mercato brevi possono creare interruzioni nella catena di approvvigionamento, aumentare i costi di manutenzione e costringere a riprogettazioni impreviste. Nelle implementazioni in più sedi, la sostituzione di componenti non disponibili può rallentare l'espansione e complicare la gestione del sistema.

L'hardware progettato per l'uso industriale offre solitamente tempistiche di produzione più lunghe, politiche di ciclo di vita più chiare e un supporto firmware o software continuo. Questa stabilità rende più semplice scalare le implementazioni senza importanti modifiche hardware a metà ciclo.

Prima di finalizzare un dispositivo edge, i team possono esaminare la roadmap del prodotto, gli impegni del ciclo di vita e la strategia di supporto a lungo termine del produttore.

L'importanza dell'esperienza del team e della facilità d'uso

Scegliere e implementare un dispositivo edge dipende anche dall'esperienza del tuo team. Alcune piattaforme sono più facili da usare e forniscono documentazione chiara, passaggi di configurazione semplici e strumenti pronti all'uso. Altre offrono maggiore controllo sulle prestazioni ma richiedono conoscenze tecniche più approfondite e più tempo speso per l'ottimizzazione e il debug.

Ad esempio, il pacchetto Python di Ultralytics rende semplice addestrare, testare e implementare modelli come YOLO26. Semplifica le attività comuni e supporta anche l'esportazione di modelli in diversi formati utilizzati nelle implementazioni edge. Ciò rende più facile per i team passare dallo sviluppo all'hardware reale senza dover ricostruire il proprio flusso di lavoro da zero.

Per i team che sono alle prime armi con l'Edge AI, un ecosistema software solido e ben documentato può ridurre i tempi di sviluppo e abbassare il rischio di implementazione. I team più esperti potrebbero preferire piattaforme che consentono una personalizzazione e una messa a punto più approfondite, specialmente in applicazioni che richiedono elaborazione multi-camera o requisiti di latenza rigorosi.

In parole povere, gli ecosistemi dei fornitori e gli strumenti possono fare una differenza significativa. Documentazione chiara, supporto attivo e opzioni di implementazione flessibili aiutano i team a passare più agevolmente da progetti pilota a sistemi di produzione completi.

Fattori chiave dell'implementazione edge che tendono a essere trascurati

Ora che abbiamo coperto i fattori principali coinvolti nella scelta di un dispositivo edge, esaminiamo alcuni dettagli pratici che possono fare una grande differenza nelle implementazioni reali. Queste considerazioni potrebbero non sembrare urgenti all'inizio, ma spesso svolgono un ruolo critico nel processo decisionale e determinano la fluidità con cui un progetto procede una volta superata la fase pilota.

I/O, larghezza di banda e compatibilità software

La connettività e la compatibilità I/O sono spesso tra le prime sfide pratiche nelle implementazioni edge. Tipicamente, un dispositivo edge deve supportare la configurazione della tua telecamera e del tuo sensore, incluse interfacce comuni come USB 3.0, GigE con Power over Ethernet (PoE) e MIPI.

I sistemi di visione industriale potrebbero anche richiedere trigger hardware, segnali di sincronizzazione o un supporto di temporizzazione specifico per garantire un funzionamento affidabile.

La larghezza di banda è un altro fattore critico, specialmente nelle configurazioni multi-camera. Anche piccole discrepanze tra l'uscita della telecamera e la capacità di ingresso del dispositivo possono ridurre il throughput o introdurre ulteriore latenza.

Anche la compatibilità software gioca un ruolo cruciale. Alcune implementazioni si basano su framework di inferenza leggeri come NCNN e MNN, che sono comunemente usati in ambienti mobili ed embedded.

Nelle implementazioni di smart sensor, dispositivi come il Sony IMX500 integrano l'elaborazione AI direttamente sul sensore di immagine, riducendo il trasferimento dati e la latenza. In questi casi, la compatibilità del modello e il supporto all'esportazione diventano particolarmente importanti, poiché il modello deve essere convertito in un formato supportato dalla toolchain del sensore.

Ad esempio, il pacchetto Python di Ultralytics supporta l'esportazione di modelli come Ultralytics YOLO11 in formati compatibili con pipeline di implementazione edge, incluse piattaforme costruite attorno a dispositivi come il Sony IMX500.

Affidabilità termica e ambientale

Quando i dispositivi edge elaborano continuamente dati visivi, l'affidabilità termica e ambientale diventa un fattore critico. In questo contesto, affidabilità significa che il dispositivo può operare per periodi prolungati senza surriscaldarsi o guastarsi, anche in condizioni difficili come polvere, vibrazioni o temperature estreme.

Man mano che i carichi di lavoro di Edge AI diventano più esigenti, l'efficienza termica è diventata un fattore determinante nel design del sistema. Questa enfasi sulle prestazioni termiche è stata evidenziata al CES 2026 a Las Vegas, dove DeepX ha eseguito carichi di lavoro AI identici su più chip con un piccolo pezzo di burro appoggiato sopra.

Mentre i chip concorrenti generavano abbastanza calore da sciogliere il burro, il dispositivo edge di DeepX no, illustrando come un minor consumo energetico e una maggiore stabilità termica possano influire direttamente sull'affidabilità nel mondo reale.

Il design del raffreddamento gioca un ruolo centrale nel mantenere prestazioni stabili. Poiché i processori lavorano di più, generano calore, e tale calore deve essere gestito in modo efficace.

In molte impostazioni industriali, il raffreddamento passivo è preferito perché le ventole meccaniche possono usurarsi o guastarsi nel tempo, specialmente in ambienti polverosi o ad alta vibrazione. I dissipatori di calore in alluminio senza ventola sono comunemente utilizzati per dissipare il calore senza fare affidamento su parti in movimento, il che migliora la durata a lungo termine.

Anche le condizioni ambientali possono avere un impatto. Ogni dispositivo ha un intervallo di temperatura operativa nominale e le implementazioni in armadi sigillati o posizioni esterne possono intrappolare il calore o esporre l'hardware a temperature fluttuanti. In questi casi, il design dell'involucro e il flusso d'aria diventano importanti quanto la potenza di calcolo grezza.

Ecosistema software e prontezza all'implementazione

Quando si seleziona il dispositivo edge giusto, la forza del suo ecosistema software è critica quanto le specifiche hardware. Un dispositivo può offrire prestazioni di calcolo elevate sulla carta, ma senza strumenti affidabili e supporto della piattaforma, passare dal prototipo alla produzione può diventare lento e complesso.

Una piattaforma ben supportata semplifica l'intero percorso di implementazione, dalla preparazione del modello all'inferenza ottimizzata sull'hardware target. Gli ecosistemi che forniscono strumenti integrati per la quantizzazione, la messa a punto delle prestazioni e il debug facilitano la convalida dei modelli sotto carichi di lavoro reali e riducono problemi imprevisti durante il lancio.

Ad esempio, i modelli Ultralytics YOLO come YOLO26 possono essere esportati direttamente nel formato OpenVINO, consentendo un'inferenza ottimizzata su CPU Intel, GPU integrate e Neural Processing Units (NPU). OpenVINO fornisce ottimizzazioni delle prestazioni come la conversione del modello, la quantizzazione (inclusi FP16 e INT8) ed esecuzione eterogenea su hardware Intel supportato.

Utilizzando il pacchetto Python di Ultralytics, i team possono esportare modelli con un semplice comando ed eseguire l'inferenza tramite l'interfaccia di alto livello di Ultralytics o direttamente con il runtime nativo di OpenVINO, creando un flusso di lavoro di implementazione semplificato e pronto per la produzione per sistemi edge basati su Intel.

Prestazioni reali sotto carico

Molti dispositivi edge sembrano impressionanti sulla carta, ma le prestazioni possono cambiare una volta che stanno eseguendo una pipeline di visione completa. Nelle implementazioni reali, il sistema non sta solo eseguendo l'inferenza.

Gestisce anche pre-elaborazione, post-elaborazione e talvolta flussi di telecamere multipli contemporaneamente. Per questo motivo, è importante guardare oltre la media dei frame al secondo.

Una latenza costante conta spesso più delle prestazioni di picco. Tenere d'occhio i colli di bottiglia della memoria e verificare quanto rimane stabile il sistema sotto un carico costante offre un quadro più chiaro di come si comporterà in produzione.

È utile testare il tempo di avvio a freddo, le prestazioni elevate a lungo termine dopo ore di operatività e il comportamento del dispositivo quando vengono eseguiti altri task insieme all'inferenza, come la codifica, la registrazione o la gestione della rete. Nella maggior parte dei casi d'uso reali, prestazioni stabili e prevedibili sono più vitali di picchi di velocità occasionali.

Sicurezza, ciclo di vita e gestione dopo il deployment

I deployment edge devono rimanere sicuri e affidabili nel tempo, specialmente in ambienti come quello manifatturiero, dove ci si aspetta che i sistemi funzionino ininterrottamente. Funzionalità come il secure boot, l'archiviazione crittografata e i regolari aggiornamenti del fornitore aiutano a proteggere i dispositivi da manomissioni e riducono il rischio di vulnerabilità o tempi di inattività imprevisti.

Gestire i dispositivi dopo il deployment è tanto importante quanto selezionare l'hardware giusto. Le funzionalità di monitoraggio e aggiornamento remoto consentono ai team di mantenere software, firmware e modelli senza bisogno di un accesso fisico a ogni singolo dispositivo. Questo diventa sempre più cruciale man mano che i progetti passano da un piccolo progetto pilota a un rollout più ampio.

Man mano che i deployment crescono, la gestione centralizzata della flotta aiuta a mantenere tutto organizzato. Rende più facile per i team tracciare lo stato di salute dei dispositivi, gestire gli aggiornamenti, monitorare le prestazioni e risolvere i problemi in più sedi. Senza una chiara strategia di gestione, mantenere decine o addirittura centinaia di sistemi edge può diventare rapidamente difficile.

Applicazioni comuni nel mondo reale di computer vision e edge AI

Mentre valuti i fattori coinvolti nella scelta del dispositivo edge giusto, potresti chiederti dove vengono effettivamente utilizzati questi sistemi. Oggi, l'edge AI alimenta applicazioni in quasi ogni settore, dal manifatturiero e retail alla robotica e alle infrastrutture intelligenti.

Ecco cinque casi d'uso comuni di deep learning in cui i dispositivi edge consentono una bassa latenza, un ridotto consumo di larghezza di banda e un'elaborazione affidabile sul dispositivo:

- Monitoraggio della sicurezza nei siti industriali: Le pipeline di computer vision distribuite su hardware edge computing possono fornire avvisi istantanei per la conformità ai dispositivi di protezione individuale (DPI), il che significa che rilevano automaticamente se i lavoratori indossano l'equipaggiamento di sicurezza richiesto come caschi, guanti, giubbotti riflettenti o occhiali protettivi, oltre a identificare comportamenti non sicuri. Ciò migliora l'affidabilità operativa riducendo gli incidenti sul posto di lavoro e mantenendo al contempo i dati video sensibili elaborati in modo sicuro in loco.

- Analisi retail: I dispositivi edge possono elaborare i dati visivi localmente per la gestione dell'inventario, la disponibilità a scaffale e il rilevamento delle code, riducendo i costi di larghezza di banda e cloud rimanendo convenienti e scalabili in molti negozi.

- Robotica: Nella robotica, l'AI sul dispositivo abilita il rilevamento di oggetti in tempo reale e la navigazione autonoma. Ad esempio, i dispositivi edge NVIDIA Jetson possono fornire piattaforme di calcolo compatte e accelerate da GPU che consentono ai robot di eseguire modelli di computer vision come YOLO26 localmente, offrendo prestazioni a bassa latenza pur mantenendo l'efficienza energetica.

- Smart city e monitoraggio del traffico: Le implementazioni di smart city possono utilizzare processori di computer vision edge per l'analisi del flusso del traffico in tempo reale, il rilevamento di incidenti e il monitoraggio della sicurezza dei pedoni. Evitando lo streaming video continuo verso il cloud, questi sistemi riducono i requisiti di larghezza di banda e migliorano i tempi di risposta.

- Ispezione della qualità nella produzione: Sulle linee di produzione, i dispositivi edge possono ispezionare i prodotti in tempo reale per rilevare difetti, componenti mancanti o errori di assemblaggio prima che gli articoli proseguano lungo il nastro trasportatore. Questi sistemi possono eseguire modelli come YOLO26 su CPU, GPU o acceleratori AI dedicati, a seconda dei vincoli di throughput e potenza.

Fig 4. YOLO26 può essere distribuito sull'edge per rilevare difetti negli impianti di produzione.

Punti chiave

La selezione del dispositivo edge giusto per il tuo progetto di computer vision comporta il bilanciamento di prestazioni, efficienza energetica, affidabilità e disponibilità a lungo termine. Invece di concentrarsi solo sulle specifiche di picco, i team dovrebbero valutare le condizioni reali, la maturità dell'ecosistema software e il supporto del ciclo di vita. Validando la tua configurazione con un deployment pilota prima di scalare, puoi ridurre il rischio, controllare i costi e garantire un percorso più agevole dal prototipo alla produzione.

Unisciti alla nostra community ed esplora il nostro GitHub repository. Dai un'occhiata alle nostre pagine delle soluzioni per scoprire varie applicazioni come AI nell'agricoltura e computer vision nell'assistenza sanitaria. Scopri le nostre opzioni di licenza e inizia subito con la vision AI!