Esplora i migliori modelli di rilevamento degli oggetti nel 2025, con uno sguardo alle architetture più diffuse, ai compromessi in termini di prestazioni e ai fattori pratici di implementazione.

Esplora i migliori modelli di rilevamento degli oggetti nel 2025, con uno sguardo alle architetture più diffuse, ai compromessi in termini di prestazioni e ai fattori pratici di implementazione.

All'inizio di quest'anno, Andrew Ng, pioniere nel campo dell'intelligenza artificiale e dell'apprendimento automatico, ha introdotto il concetto di rilevamento di oggetti agenziali. Questo approccio utilizza un agente ragionante per detect sulla base di un prompt testuale senza richiedere grandi quantità di dati di addestramento.

Essere in grado di identificare oggetti in immagini e video senza bisogno di enormi set di dati etichettati è un passo avanti verso sistemi di visione artificiale più intelligenti e flessibili. Tuttavia, l'intelligenza artificiale visiva agentica è ancora agli albori.

Sebbene sia in grado di gestire compiti generici, come il rilevamento di persone o segnali stradali in un'immagine, le applicazioni di visione artificiale più precise continuano ad affidarsi ai modelli tradizionali di rilevamento degli oggetti. Questi modelli vengono addestrati su set di dati di grandi dimensioni e accuratamente etichettati per imparare esattamente cosa cercare e dove si trovano gli oggetti.

Il rilevamento tradizionale degli oggetti è essenziale perché fornisce sia il riconoscimento, identificando di cosa si tratta, sia la localizzazione, determinando esattamente dove si trova nell'immagine. Questa combinazione consente alle macchine di eseguire in modo affidabile compiti complessi nel mondo reale, dai veicoli autonomi all'automazione industriale e alla diagnostica sanitaria.

Grazie ai progressi tecnologici, i modelli di rilevamento degli oggetti continuano a migliorare, diventando più veloci, più precisi e più adatti agli ambienti reali. In questo articolo, esamineremo alcuni dei migliori modelli di rilevamento degli oggetti disponibili oggi. Cominciamo!

Le attività di visione artificiale come la classificazione delle immagini possono essere utilizzate per stabilire se un'immagine contiene un'auto, una persona o un altro oggetto. Tuttavia, non sono in grado di determinare la posizione dell'oggetto all'interno dell'immagine.

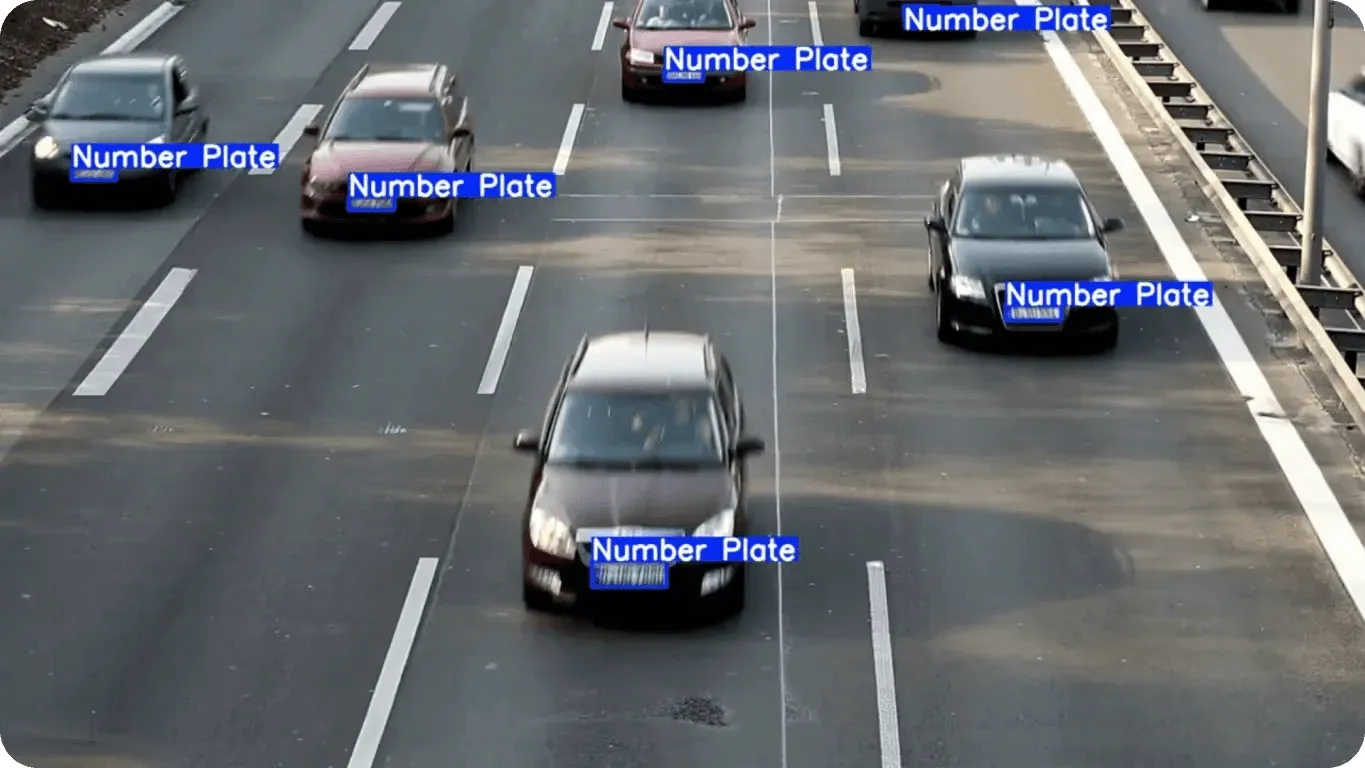

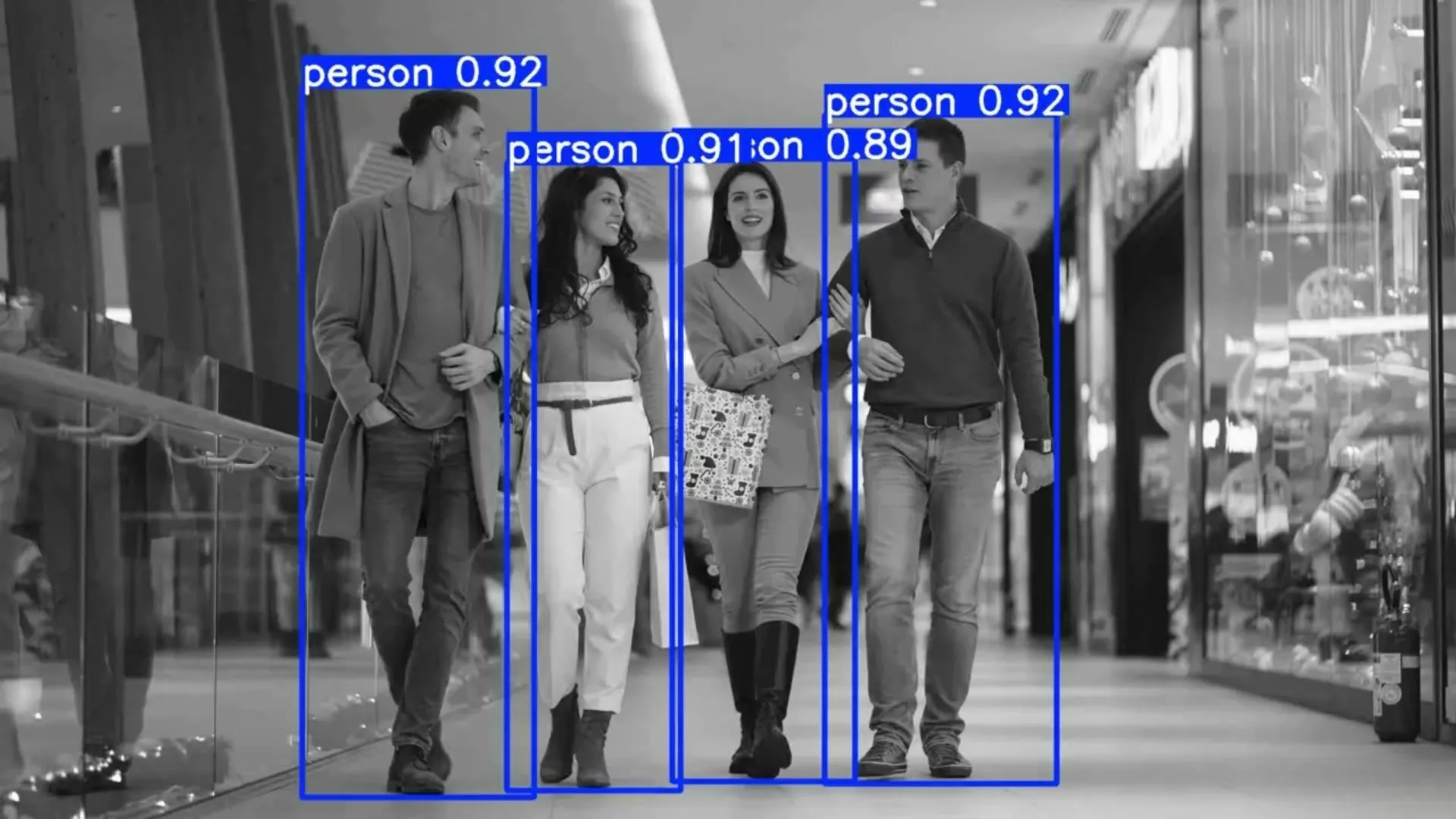

È qui che il rilevamento degli oggetti può rivelarsi utile. I modelli di rilevamento degli oggetti sono in grado di identificare quali oggetti sono presenti e di individuarne la posizione esatta. Questo processo, noto come localizzazione, consente alle macchine di comprendere le scene in modo più accurato e di rispondere in modo appropriato, che si tratti di fermare un'auto a guida autonoma, guidare un braccio robotico o evidenziare un'area nelle immagini mediche.

L'ascesa del deep learning ha trasformato il rilevamento degli oggetti. Anziché basarsi su regole codificate manualmente, i modelli moderni apprendono i modelli direttamente dalle annotazioni e dai dati visivi. Questi set di dati insegnano ai modelli l'aspetto degli oggetti, dove compaiono solitamente e come gestire sfide quali oggetti di piccole dimensioni, scene disordinate o condizioni di illuminazione variabili.

Infatti, i sistemi di rilevamento oggetti all'avanguardia sono in grado di detect con precisione detect oggetti contemporaneamente. Ciò rende il rilevamento oggetti una tecnologia fondamentale in applicazioni quali la guida autonoma, la robotica, la sanità e l'automazione industriale.

L'input di un modello di rilevamento degli oggetti è un'immagine, che può provenire da una fotocamera, da un fotogramma video o persino da una scansione medica. L'immagine di input viene elaborata attraverso una rete neurale, in genere una rete neurale convoluzionale (CNN), addestrata a riconoscere i modelli nei dati visivi.

All'interno della rete, l'immagine viene analizzata in più fasi. Sulla base delle caratteristiche rilevate, il modello prevede quali oggetti sono presenti e dove compaiono.

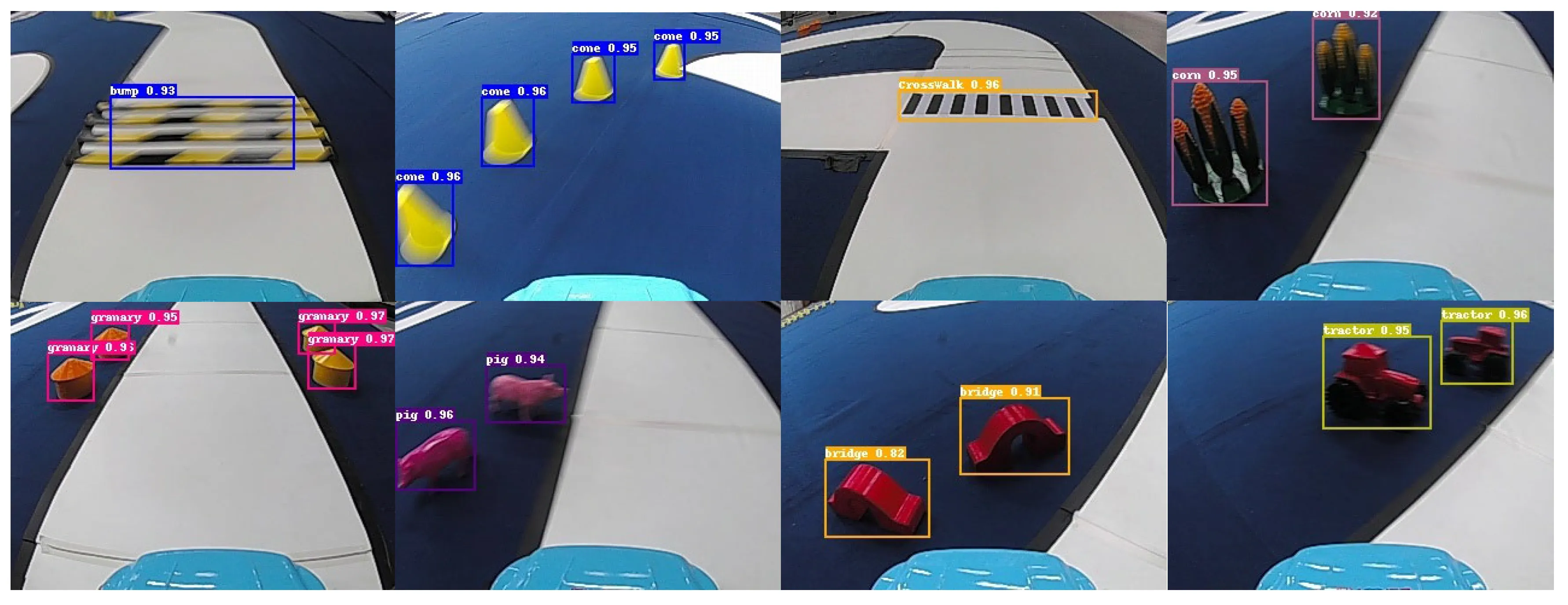

Queste previsioni sono rappresentate utilizzando dei riquadri di delimitazione, ovvero dei rettangoli disegnati attorno a ciascun oggetto rilevato. Per ogni riquadro di delimitazione, il modello assegna un'etichetta di classe (ad esempio, auto, persona o cane) e un punteggio di affidabilità che indica quanto sia certa la previsione (questo può anche essere considerato come una probabilità).

Il processo complessivo si basa in larga misura sull'estrazione delle caratteristiche. Il modello impara a identificare modelli visivi utili, quali bordi, forme, texture e altre caratteristiche distintive. Questi modelli sono codificati in mappe delle caratteristiche, che aiutano la rete a comprendere l'immagine a più livelli di dettaglio.

A seconda dell'architettura del modello, i rilevatori di oggetti utilizzano strategie diverse per individuare gli oggetti, bilanciando velocità, precisione e complessità.

Molti modelli di rilevamento degli oggetti, in particolare i rilevatori a due stadi come Faster R-CNN, si concentrano su parti specifiche dell'immagine chiamate regioni di interesse (ROI). Concentrandosi su queste aree, il modello dà la priorità alle regioni che con maggiore probabilità contengono oggetti, invece di analizzare ogni pixel in modo uguale.

D'altra parte, i modelli a stadio singolo come YOLO primi YOLO non selezionano ROI specifici come fanno i modelli a due stadi. Invece, dividono l'immagine in una griglia e utilizzano riquadri predefiniti, chiamati riquadri di ancoraggio, insieme a mappe di caratteristiche per prevedere gli oggetti nell'intera immagine in un unico passaggio.

Oggi, i modelli più avanzati per il rilevamento degli oggetti stanno esplorando approcci senza ancoraggi. A differenza dei modelli tradizionali a stadio singolo che si basano su riquadri di ancoraggio predefiniti, i modelli senza ancoraggi prevedono la posizione e le dimensioni degli oggetti direttamente dalle mappe delle caratteristiche. Questo può semplificare l'architettura, ridurre il carico computazionale e migliorare le prestazioni, soprattutto per il rilevamento di oggetti di forme e dimensioni diverse.

Oggi esistono molti modelli di rilevamento degli oggetti, ciascuno progettato con obiettivi specifici. Alcuni sono ottimizzati per prestazioni in tempo reale, mentre altri puntano al raggiungimento della massima precisione. La scelta del modello giusto per una soluzione di visione artificiale dipende spesso dal caso d'uso specifico e dai requisiti prestazionali.

Passiamo ora ad analizzare alcuni dei migliori modelli di rilevamento oggetti del 2025.

Una delle famiglie di modelli di rilevamento oggetti più utilizzate oggi è la famigliaYOLO Ultralytics YOLO . YOLO, acronimo di You Only Look Once, è popolare in tutti i settori perché offre prestazioni di rilevamento elevate pur essendo veloce, affidabile e facile da utilizzare.

YOLO Ultralytics YOLO comprende Ultralytics YOLOv5, Ultralytics YOLOv8, Ultralytics YOLO11e il prossimo Ultralytics , offrono una gamma di opzioni per diverse esigenze in termini di prestazioni e casi d'uso. Grazie al loro design leggero e all'ottimizzazione della velocità,YOLO Ultralytics YOLO sono ideali per il rilevamento in tempo reale e possono essere implementati su dispositivi edge con potenza di calcolo e memoria limitate.

Oltre al rilevamento di oggetti di base, questi modelli sono altamente versatili. Supportano anche attività quali la segmentazione delle istanze, che delinea gli oggetti a livello di pixel, e la stima della posa, che identifica i punti chiave su persone o oggetti. Questa flessibilità rendeYOLO Ultralytics YOLO un'opzione ideale per un'ampia gamma di applicazioni, dall'agricoltura e la logistica alla vendita al dettaglio e alla produzione.

Un altro motivo fondamentale della popolarità deiYOLO Ultralytics è il Python Ultralytics , che offre un'interfaccia semplice e intuitiva per l'addestramento, la messa a punto e l'implementazione dei modelli. Gli sviluppatori possono iniziare con pesi pre-addestrati, personalizzare i modelli per i propri set di dati e implementarli con poche righe di codice.

RT‑DETR (Real-Time Detection Transformer) e il più recente RT‑DETRv2 sono modelli di rilevamento oggetti progettati per l'uso in tempo reale. A differenza di molti modelli tradizionali, sono in grado di acquisire un'immagine e fornire direttamente i risultati finali del rilevamento senza ricorrere alla soppressione non massima (NMS).

NMS un passaggio che rimuove le caselle sovrapposte in eccesso quando un modello prevede lo stesso oggetto più di una volta. Saltare NMS il processo di rilevamento più semplice e veloce.

Questi modelli combinano le CNN con i trasformatori. La CNN individua dettagli visivi come bordi e forme, mentre il trasformatore è un tipo di rete neurale in grado di esaminare l'intera immagine contemporaneamente e comprendere come le diverse parti sono correlate tra loro. Questa comprensione globale consente al modello detect vicini tra loro o sovrapposti.

RT‑DETRv2 migliora il modello originale con funzionalità quali il rilevamento multiscala, che aiuta a individuare oggetti sia piccoli che grandi, e una migliore gestione delle scene complesse. Queste modifiche mantengono il modello veloce migliorandone al contempo la precisione.

RF‑DETR è un modello basato su trasformatori in tempo reale progettato per combinare la precisione delle architetture dei trasformatori con la velocità necessaria per le applicazioni nel mondo reale. Come RT‑DETR e RT‑DETRv2, utilizza un trasformatore per analizzare l'intera immagine e una CNN per estrarre caratteristiche visive dettagliate come bordi, forme e texture.

Il modello prevede gli oggetti direttamente dall'immagine di input, saltando gli anchor box e la soppressione non massima, il che semplifica il processo di rilevamento e mantiene veloce l'inferenza. RF‑DETR supporta anche la segmentazione delle istanze, consentendo di delineare gli oggetti a livello di pixel oltre a prevedere i bounding box.

Rilasciato alla fine del 2019, EfficientDet è un modello di rilevamento degli oggetti progettato per garantire un ridimensionamento efficiente e prestazioni elevate. Ciò che distingue EfficientDet è il ridimensionamento composto, un metodo che ridimensiona contemporaneamente la risoluzione di input, la profondità della rete e la larghezza della rete, anziché regolare un solo fattore. Questo approccio aiuta il modello a mantenere una precisione stabile sia che venga ridimensionato per attività ad alte prestazioni sia che venga ridimensionato per implementazioni leggere.

Un altro componente chiave di EfficientDet è la sua efficiente rete piramidale delle caratteristiche (FPN), che consente al modello di analizzare le immagini su più scale. Questa analisi multiscala è fondamentale per rilevare oggetti di diverse dimensioni, consentendo a EfficientDet di identificare in modo affidabile sia gli oggetti piccoli che quelli grandi all'interno della stessa immagine.

Rilasciato nel 2022, PP-YOLOE+ è un modello di rilevamento oggetti YOLO, ovvero rileva e classifica gli oggetti in un unico passaggio sull'immagine. Questo approccio lo rende veloce e adatto alle applicazioni in tempo reale, pur mantenendo un'elevata precisione.

Uno dei miglioramenti chiave di PP-YOLOE+ è l'apprendimento allineato alle attività, che aiuta i punteggi di affidabilità del modello a riflettere l'accuratezza con cui vengono localizzati gli oggetti. Ciò è particolarmente utile per rilevare oggetti piccoli o sovrapposti.

Il modello utilizza anche un'architettura a testa disaccoppiata, che separa i compiti di previsione della posizione degli oggetti e delle etichette di classe. Ciò consente di disegnare riquadri di delimitazione in modo più preciso, classificando correttamente gli oggetti.

GroundingDINO è un modello di rilevamento oggetti basato su trasformatori che combina visione e linguaggio. Anziché affidarsi a un insieme fisso di categorie, consente agli utenti detect utilizzando prompt di testo in linguaggio naturale.

Allineando le caratteristiche visive di un'immagine con le descrizioni testuali, il modello è in grado di individuare gli oggetti anche se le etichette esatte non erano presenti nei dati di addestramento. Ciò significa che è possibile fornire al modello descrizioni come "una persona che indossa un casco" o "un'auto rossa vicino a un edificio" e il modello genererà dei riquadri di delimitazione accurati attorno agli oggetti corrispondenti.

Inoltre, supportando il rilevamento zero-shot, GroundingDINO riduce la necessità di riqualificare o mettere a punto il modello per ogni nuovo caso d'uso, rendendolo altamente flessibile in un'ampia gamma di applicazioni. Questa combinazione di comprensione del linguaggio e riconoscimento visivo apre nuove possibilità per i sistemi di IA interattivi e adattivi.

Quando si confrontano vari modelli di rilevamento degli oggetti, ci si potrebbe chiedere come capire quale sia effettivamente il più performante. È una buona domanda, perché oltre all'architettura del modello e alla qualità dei dati, molti fattori possono influire sulle prestazioni.

I ricercatori spesso si affidano a benchmark condivisi e metriche di prestazione standard per valutare i modelli in modo coerente, confrontare i risultati e comprendere i compromessi tra velocità e precisione. I benchmark standard sono particolarmente importanti perché molti modelli di rilevamento degli oggetti vengono valutati sugli stessi set di dati, come il COCO .

Ecco uno sguardo più da vicino ad alcune metriche comunemente utilizzate per valutare i modelli di rilevamento degli oggetti:

Ecco alcuni dei principali vantaggi dell'utilizzo dei modelli di rilevamento degli oggetti nelle applicazioni reali:

Nonostante questi vantaggi, esistono dei limiti pratici che possono influire sulle prestazioni dei modelli di rilevamento degli oggetti. Ecco alcuni fattori fondamentali da considerare:

Il modello di rilevamento oggetti più adatto al tuo progetto di visione artificiale dipende dal caso d'uso, dalla configurazione dei dati, dai requisiti di prestazioni e dai vincoli hardware. Alcuni modelli sono ottimizzati per la velocità, mentre altri puntano sulla precisione; la maggior parte delle applicazioni reali richiede un equilibrio tra questi due aspetti. Grazie ai framework open source e alle comunità attive su GitHub, questi modelli stanno diventando più facili da valutare, adattare e implementare per l'uso pratico.

Per saperne di più, esplora il nostro repository GitHub. Unisciti alla nostra community e consulta le nostre pagine dedicate alle soluzioni per scoprire applicazioni come l'IA nel settore sanitario e la visione artificiale nell'industria automobilistica. Scopri le nostre opzioni di licenza per iniziare subito a utilizzare Vision AI.

Inizia il tuo viaggio con il futuro del machine learning