Come utilizzare Ultralytics YOLO11 per il rilevamento degli oggetti

Scoprite come il nuovo modello Ultralytics YOLO11 può essere utilizzato per il rilevamento di oggetti per ottenere una maggiore precisione in varie applicazioni in diversi settori.

Scoprite come il nuovo modello Ultralytics YOLO11 può essere utilizzato per il rilevamento di oggetti per ottenere una maggiore precisione in varie applicazioni in diversi settori.

La computer vision è un campo dell'intelligenza artificiale (IA) che aiuta le macchine a interpretare e comprendere le informazioni visive per consentire attività essenziali come l'object detection. A differenza dell'image classification, l'object detection non solo identifica quali oggetti sono presenti in un'immagine, ma ne individua anche le posizioni esatte. Questo la rende uno strumento fondamentale per le applicazioni di vision AI come le auto a guida autonoma, i sistemi di sicurezza in tempo reale e l'automazione dei magazzini.

Nel corso del tempo, la tecnologia di rilevamento degli oggetti è diventata più avanzata e più facile da usare. Un importante passo avanti è stato annunciato in occasione dell'evento ibrido annuale di Ultralytics, YOLO Vision 2024 (YV24), con il lancio del modelloUltralytics YOLO11 . YOLO11 migliora l'accuratezza e le prestazioni, supportando al contempo le stesse attività di YOLOv8e facilita la transizione per gli utenti dei modelli precedenti.

In questo articolo spiegheremo cos'è il rilevamento degli oggetti, in che modo si differenzia da altre attività di computer vision ed esploreremo le sue applicazioni reali. Vi spiegheremo inoltre come utilizzare il modello YOLO11 con il pacchettoUltralytics Python e la piattaformaUltralytics HUB. Iniziamo!

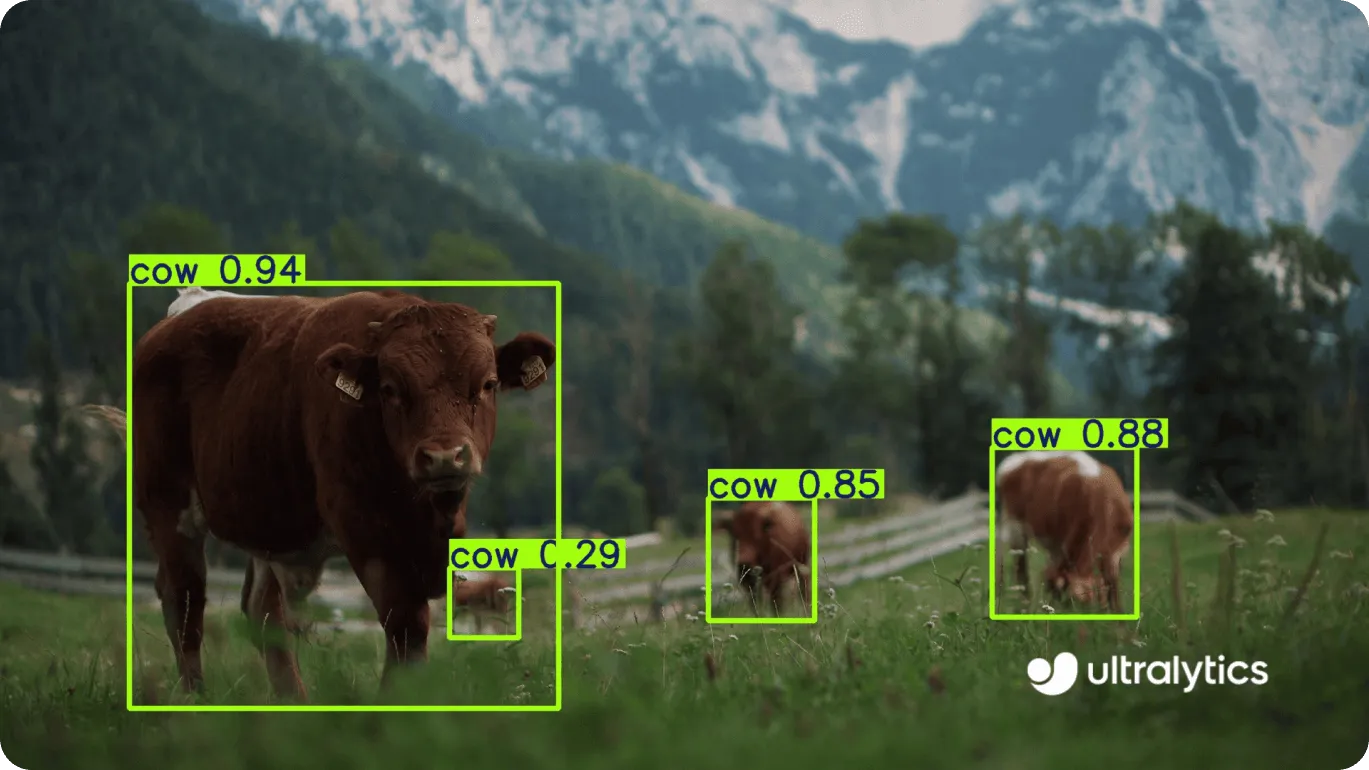

Il rilevamento oggetti è un'attività fondamentale nella computer vision che fa più che identificare oggetti in un'immagine. A differenza della classificazione delle immagini, che determina solo se un oggetto specifico è presente, il rilevamento oggetti riconosce più oggetti e individua le loro posizioni esatte utilizzando bounding box.

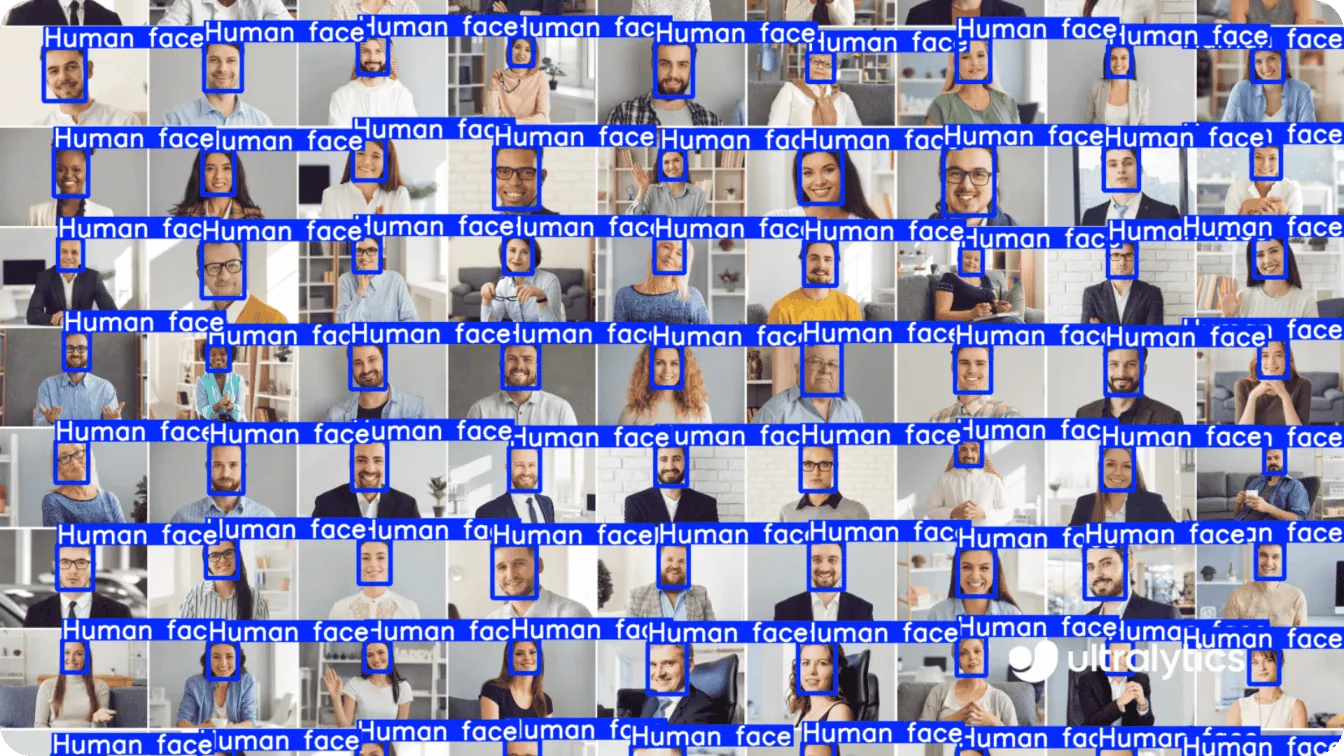

Ad esempio, può identificare e localizzare i volti in una foto di gruppo, le auto in una strada trafficata o i prodotti sullo scaffale di un negozio. La combinazione di riconoscimento e localizzazione degli oggetti lo rende particolarmente utile per applicazioni come la sorveglianza, il monitoraggio della folla e la gestione automatizzata dell'inventario.

Ciò che distingue il rilevamento di oggetti da altre attività come la segmentazione semantica o di istanze è la sua focalizzazione ed efficienza.

La segmentazione semantica etichetta ogni pixel in un'immagine ma non distingue tra singoli oggetti dello stesso tipo (ad esempio, tutti i volti in una foto sarebbero raggruppati come "volto"). La segmentazione di istanza fa un ulteriore passo avanti separando ogni oggetto e delineandone la forma esatta, anche per oggetti della stessa classe.

Il rilevamento oggetti, tuttavia, fornisce un approccio più snello identificando e classificando gli oggetti contrassegnando al contempo le loro posizioni. Questo lo rende ideale per attività in tempo reale come il rilevamento di volti in filmati di sicurezza o l'identificazione di ostacoli per veicoli autonomi.

Le funzioni avanzate di rilevamento degli oggetti di YOLO11 lo rendono utile in molti settori. Vediamo alcuni esempi.

YOLO11 e il rilevamento degli oggetti stanno ridefinendo l'analisi della vendita al dettaglio, rendendo più efficiente e accurata la gestione dell'inventario e il monitoraggio degli scaffali. La capacità del modello di detect gli oggetti in modo rapido e affidabile aiuta i retailer a track livelli delle scorte, a organizzare gli scaffali e a ridurre gli errori nel conteggio dell'inventario.

Ad esempio, YOLO11 è in grado di detect articoli specifici come gli occhiali da sole sugli scaffali di un negozio. Ma perché un rivenditore dovrebbe voler monitorare uno scaffale? Mantenere gli scaffali riforniti e organizzati è fondamentale per garantire che i clienti possano trovare ciò di cui hanno bisogno, con un impatto diretto sulle vendite. Monitorando gli scaffali in tempo reale, i rivenditori possono individuare rapidamente quando gli articoli sono in esaurimento, fuori posto o sovraffollati, aiutandoli a mantenere un'esposizione organizzata e attraente che migliora l'esperienza di acquisto.

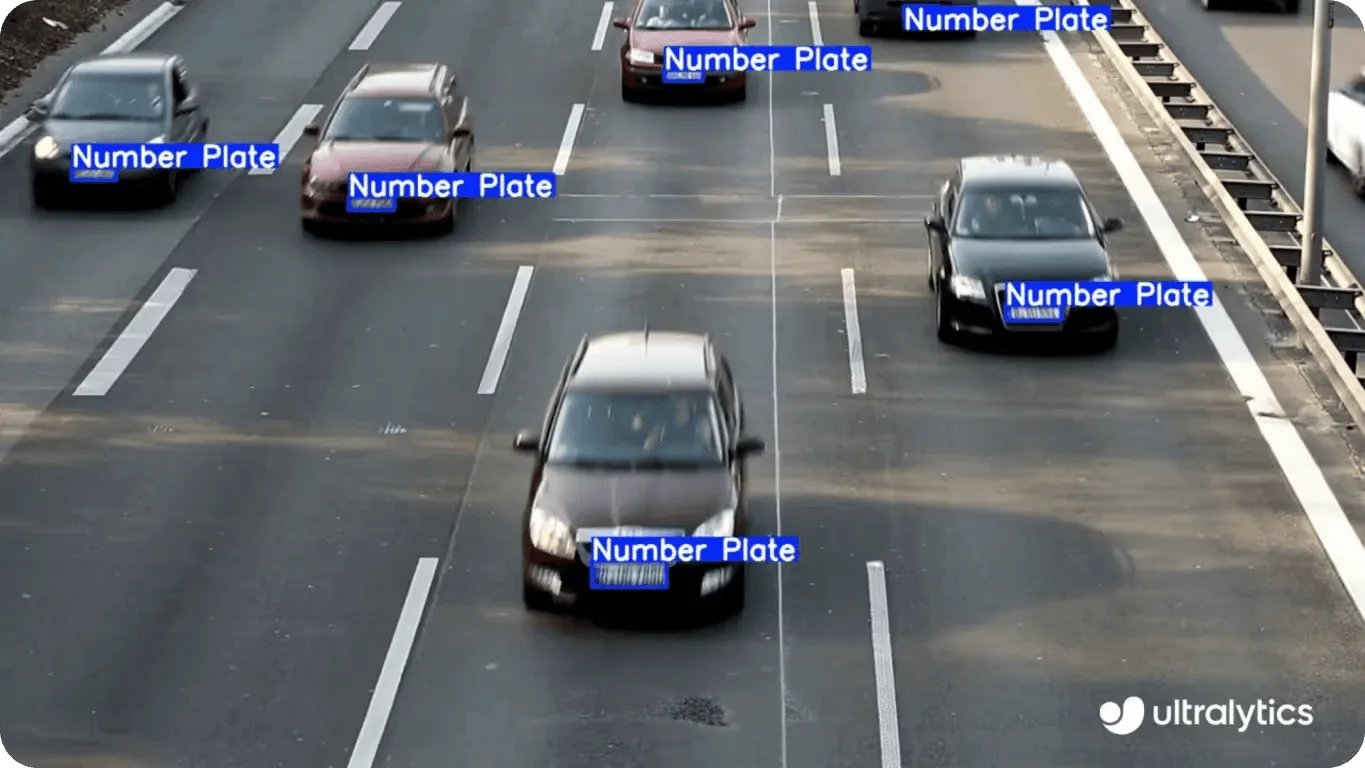

Per funzionare in modo efficiente, una città vivace ha bisogno di un flusso di traffico scorrevole e di strade sicure, e YOLO11 può contribuire a renderlo possibile. Infatti, molte applicazioni smart city possono essere integrate con YOLO11.

Un caso interessante è l'utilizzo del rilevamento degli oggetti per identificare le targhe dei veicoli in movimento. In questo modo, YOLO11 può supportare una più rapida riscossione dei pedaggi, una migliore gestione del traffico e una più rapida applicazione delle norme.

Le intuizioni dei sistemi Vision AI che monitorano le strade possono avvisare le autorità di violazioni del traffico o di congestioni prima che si aggravino in problemi più gravi. YOLO11 è in grado di detect anche pedoni e ciclisti, rendendo le strade più sicure ed efficienti per tutti.

La capacità di YOLO11di elaborare dati visivi lo rende uno strumento potente per migliorare le infrastrutture cittadine. Ad esempio, può aiutare a ottimizzare la tempistica dei semafori analizzando i movimenti dei veicoli e dei pedoni. Può anche migliorare la sicurezza nelle zone scolastiche, rilevando i bambini e avvisando gli automobilisti di rallentare. Con YOLO11, le città possono adottare misure proattive per affrontare le sfide e creare un ambiente più efficiente per tutti.

Il rilevamento di oggetti in tempo reale si riferisce alla capacità di un sistema di identificare e classify gli oggetti in un feed video live non appena appaiono. YOLO11 è stato progettato per offrire prestazioni superiori in tempo reale ed è in grado di supportare questa capacità. Le sue applicazioni vanno oltre la semplice semplificazione dei processi: può anche contribuire a creare un mondo più inclusivo e accessibile.

Ad esempio, YOLO11 può assistere le persone ipovedenti identificando gli oggetti in tempo reale. Sulla base dei rilevamenti, è possibile fornire descrizioni audio che aiutano gli utenti a navigare nell'ambiente circostante con maggiore indipendenza.

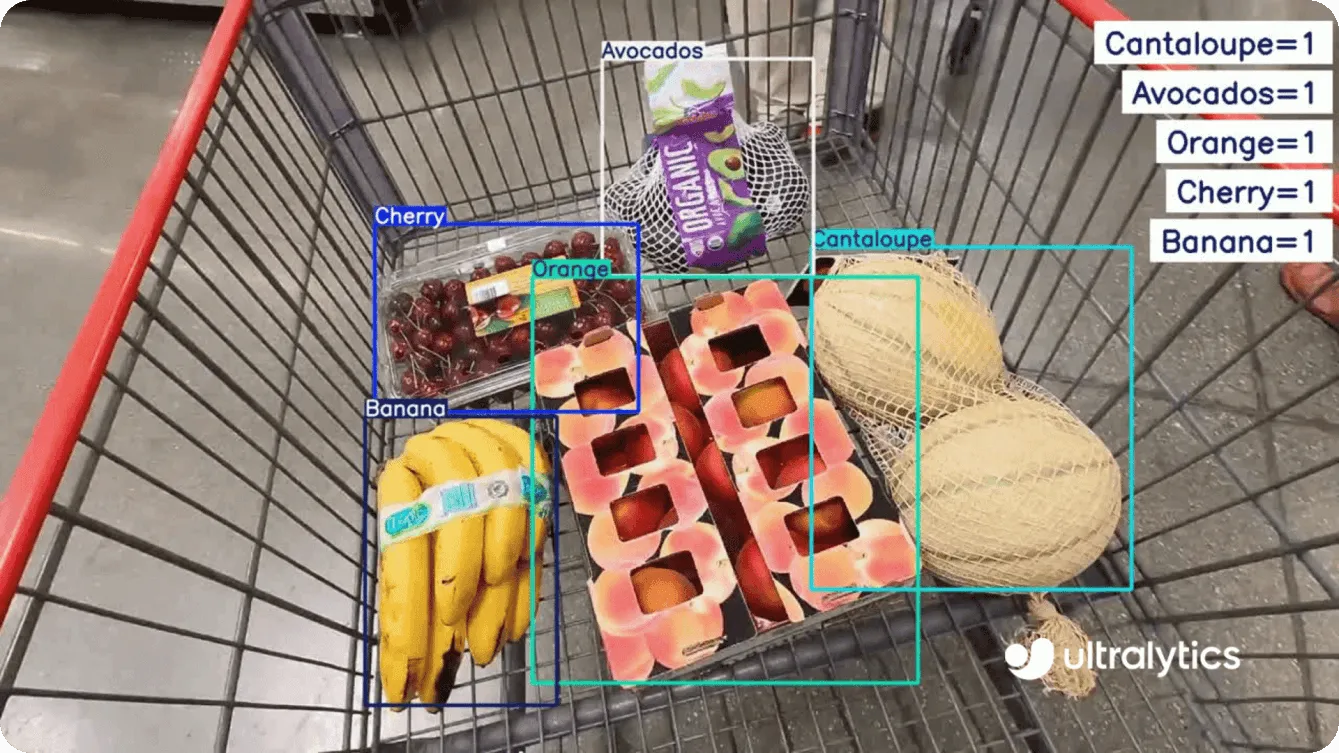

Pensate a una persona ipovedente che fa la spesa. Scegliere gli articoli giusti può essere difficile, ma YOLO11 può aiutarla. Mentre gli articoli vengono messi nel carrello, un sistema integrato con YOLO11 può essere utilizzato per identificare ogni articolo - come banane, avocado o un cartone di latte - e fornire descrizioni audio in tempo reale. In questo modo i clienti possono confermare le loro scelte e assicurarsi di avere tutto ciò di cui hanno bisogno. Riconoscendo gli articoli di uso quotidiano, YOLO11 può semplificare la spesa.

Dopo aver trattato le basi del rilevamento degli oggetti e le sue diverse applicazioni, vediamo come iniziare a utilizzare il modelloYOLO11 di Ultralytics per attività come il rilevamento degli oggetti.

Esistono due modi semplici per utilizzare YOLO11: attraverso il pacchetto Ultralytics Python o l'HUB Ultralytics . Esploriamo entrambi i metodi, iniziando dal pacchetto Python .

L'inferenza è quando un modello di intelligenza artificiale analizza nuovi dati non visti per fare previsioni, classify informazioni o fornire approfondimenti sulla base di quanto appreso durante l'addestramento. Per quanto riguarda il rilevamento degli oggetti, ciò significa identificare e localizzare oggetti specifici all'interno di un'immagine o di un video, disegnare riquadri di delimitazione intorno ad essi ed etichettarli in base alla formazione del modello.

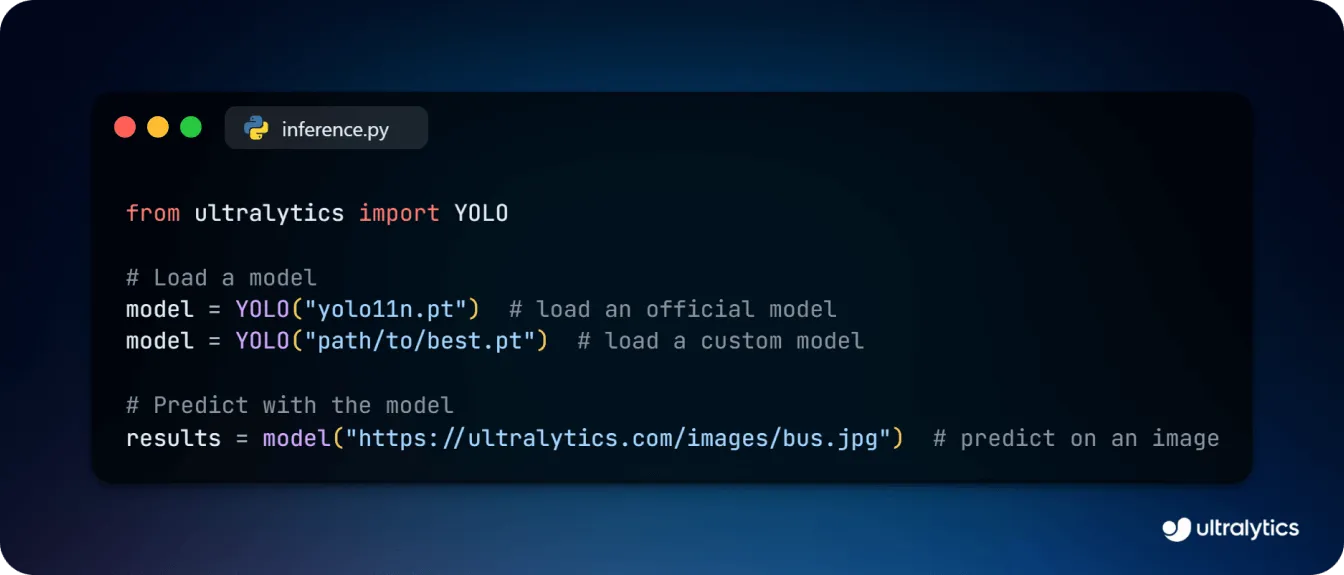

Per utilizzare il modello di rilevamento degli oggetti YOLO11 , è necessario installare il pacchetto Ultralytics Python tramite pip, conda o Docker. Se si riscontrano problemi di installazione, consultare la guida alla risoluzione dei problemi per trovare suggerimenti e trucchi per risolverli. Una volta installato, è possibile utilizzare il codice seguente per caricare il modello di rilevamento degli oggetti YOLO11 e fare previsioni su un'immagine.

YOLO11 supporta anche la formazione personalizzata per adattarsi meglio ai casi d'uso specifici. Grazie alla messa a punto del modello, è possibile adattarlo al detect oggetti rilevanti per il proprio progetto. Per esempio, quando si utilizza la computer vision nel settore sanitario, un modello YOLO11 addestrato su misura può essere utilizzato per detect anomalie specifiche nelle immagini mediche, come i tumori nelle scansioni MRI o le fratture nelle radiografie, aiutando i medici a fare diagnosi più rapide e precise.

Il frammento di codice qui sotto mostra come caricare e addestrare un modello YOLO11 per il rilevamento di oggetti. È possibile partire da un file di configurazione YAML o da un modello pre-addestrato, trasferire i pesi e addestrare su set di dati quali COCO per ottenere capacità di rilevamento degli oggetti più raffinate.

Dopo aver addestrato un modello, è anche possibile esportare il modello addestrato in vari formati per l'implementazione in diversi ambienti.

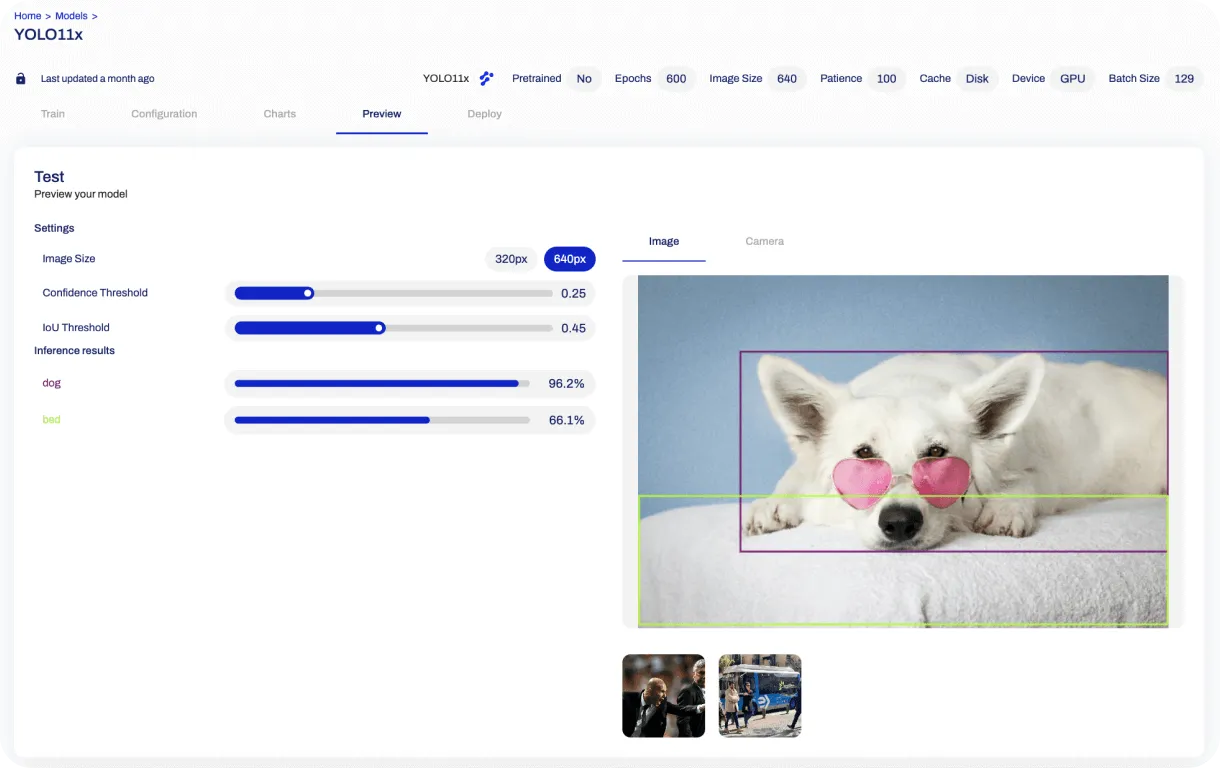

Per chi cerca un'alternativa senza codice, Ultralytics HUB offre una piattaforma Vision AI facile da usare per l'addestramento e la distribuzione dei modelli YOLO , compreso YOLO11.

Per eseguire il rilevamento degli oggetti sulle immagini, è sufficiente creare un account, navigare nella sezione 'Modelli' e selezionare la variante del modello di rilevamento degli oggetti YOLO11 . Caricare l'immagine e la piattaforma visualizzerà gli oggetti rilevati in una sezione di anteprima.

Combinando la flessibilità del pacchetto Python con la facilità dell'HUB, YOLO11 consente a sviluppatori e aziende di sfruttare in modo semplice la potenza della tecnologia avanzata di rilevamento degli oggetti.

YOLO11 stabilisce un nuovo standard nel rilevamento degli oggetti, combinando un'elevata precisione con la versatilità necessaria per soddisfare le esigenze di diversi settori. Dal miglioramento dell'analisi della vendita al dettaglio alla gestione delle infrastrutture delle città intelligenti, YOLO11 è costruito per garantire prestazioni affidabili e in tempo reale in innumerevoli applicazioni.

Grazie alle opzioni di formazione personalizzata e a un'interfaccia di facile utilizzo tramite Ultralytics HUB, l'integrazione di YOLO11 nei vostri flussi di lavoro non è mai stata così semplice. Che siate sviluppatori che esplorano la computer vision o aziende che vogliono innovare con l'IA, YOLO11 vi offre gli strumenti necessari per avere successo.

Per saperne di più, consulta il nostro repository GitHub e interagisci con la nostra community. Esplora le applicazioni dell'AI nelle auto a guida autonoma e nella computer vision per l'agricoltura nelle nostre pagine delle soluzioni. 🚀

Inizia il tuo viaggio con il futuro del machine learning