Ultralytics YOLO11 su NVIDIA Jetson Orin Nano Super: veloce ed efficiente

Scoprite come l'implementazione di Ultralytics YOLO11 su NVIDIA Jetson Orin Nano Super offre benchmark impressionanti e prestazioni GPU per le applicazioni AI avanzate.

Scoprite come l'implementazione di Ultralytics YOLO11 su NVIDIA Jetson Orin Nano Super offre benchmark impressionanti e prestazioni GPU per le applicazioni AI avanzate.

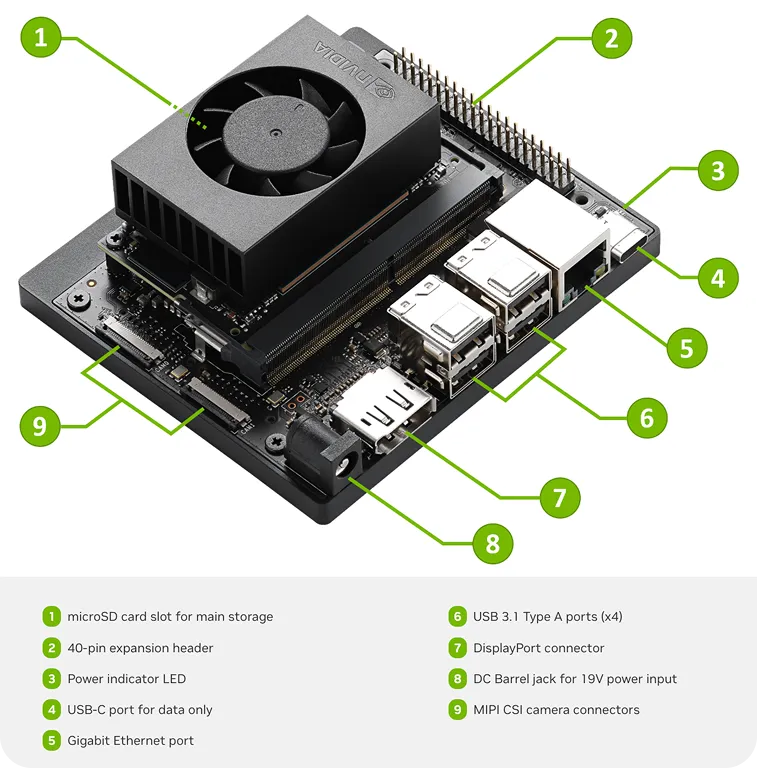

NVIDIA Jetson Orin Nano Super Developer Kit, lanciato il 17 dicembre 2024, è un supercomputer AI generativo compatto ma potente, progettato per portare capacità avanzate all'edge computing. Facilita l'elaborazione in tempo reale ed elimina la necessità di ricorrere al cloud computing. NVIDIA Jetson Orin Nano Super consente agli sviluppatori di creare sistemi intelligenti a prezzi accessibili che funzionano in modo efficiente negli ambienti locali.

Se abbinato ai modelliYOLO diUltralytics come Ultralytics YOLO11il Jetson Orin Nano Super è in grado di gestire una vasta gamma di applicazioni Vision AI on the edge. In particolare, YOLO11 è un modello di visione computerizzata noto per la sua velocità e precisione in compiti come il rilevamento di oggetti, il tracciamento di oggetti e la segmentazione di istanze.

La combinazione delle capacità di YOLO11con la robusta GPU (Graphics Processing Unit) del kit e il supporto di framework come PyTorch, ONNX e NVIDIA TensorRT consente di realizzare implementazioni ad alte prestazioni. Questa combinazione offre agli sviluppatori una soluzione efficiente per la creazione di applicazioni di intelligenza artificiale, dal rilevamento di oggetti nella robotica al tracciamento di oggetti in tempo reale in spazi intelligenti e sistemi di vendita al dettaglio.

In questo articolo analizzeremo il Super Developer Kit NVIDIA Jetson Orin Nano, come funziona con Ultralytics YOLO11 per l'edge AI, i suoi benchmark di prestazione, le applicazioni reali e come può aiutare gli sviluppatori a realizzare progetti di Vision AI. Iniziamo!

NVIDIA Jetson Orin Nano Super Developer Kit è un computer compatto ma potente che ridefinisce l'IA generativa per i piccoli dispositivi edge. Offre fino a 67 TOPS (trilioni di operazioni al secondo) di prestazioni di IA, il che lo rende ideale per sviluppatori, studenti e hobbisti che lavorano a progetti di IA avanzati.

Ecco alcune delle sue caratteristiche principali:

Se avete familiarità con il lavoro di NVIDIA, potreste chiedervi come questa nuova release si confronta con l'attuale NVIDIA Jetson Orin NX 16GB (senza super mode). Mentre Jetson Orin NX offre capacità complessive superiori, Jetson Orin Nano Super Developer Kit offre prestazioni impressionanti a una frazione del costo.

Ecco una rapida panoramica:

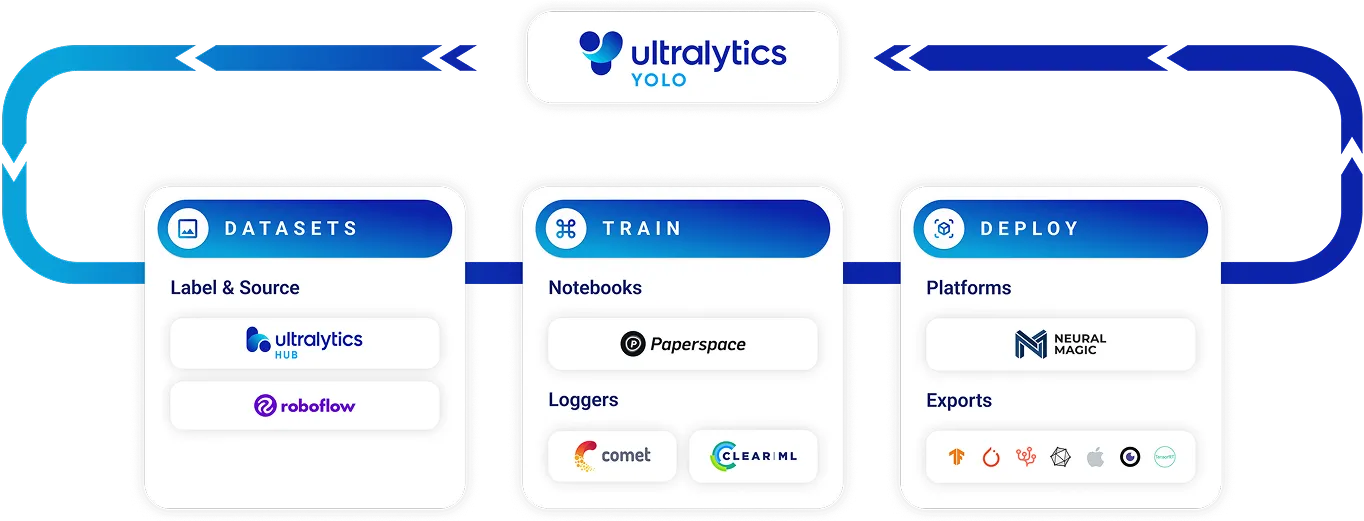

Ora che abbiamo una migliore comprensione di Jetson Orin Nano Super, diamo un'occhiata a come YOLO11 può intervenire per portare le capacità di Vision AI al limite. I modelliYOLO Ultralytics , compreso YOLO11, sono dotati di modalità versatili come addestramento, previsione ed esportazione, che li rendono adattabili a una varietà di flussi di lavoro AI.

Ad esempio, nella modalità di addestramento, i modelli Ultralytics YOLO possono essere perfezionati e addestrati su set di dati personalizzati per applicazioni specifiche, come il rilevamento di oggetti unici o l'ottimizzazione per ambienti specifici. Allo stesso modo, la modalità di previsione è progettata per l'inferenza, consentendo di svolgere attività di computer vision in tempo reale. Infine, la modalità di esportazione può essere utilizzata per convertire i modelli in formati ottimizzati per la distribuzione.

YOLO11 in modalità di esportazione supporta una serie di opzioni di distribuzione dei modelli, tra cui:

Utilizzando questi formati di distribuzione, gli sviluppatori possono sfruttare appieno l'hardware di Jetson Orin Nano Super per eseguire YOLO11 per applicazioni in tempo reale come spazi intelligenti, robotica e automazione della vendita al dettaglio.

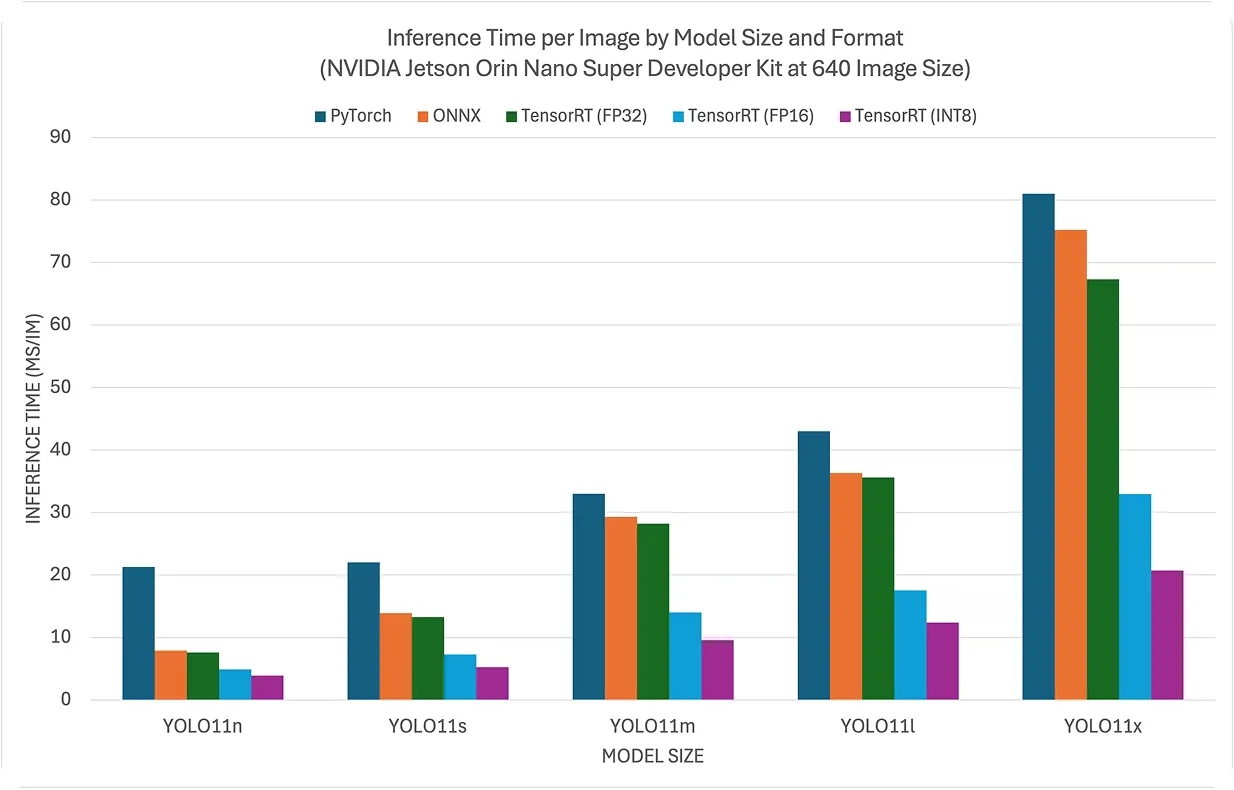

Per avere un'idea più precisa della velocità di esecuzione di YOLO11 su NVIDIA Jetson Orin Nano Super, esploriamo le sue impressionanti prestazioni e i benchmark utilizzando formati di esportazione GPU come PyTorch, ONNX e TensorRT. Questi test rivelano che Jetson Orin Nano Super raggiunge tempi di inferenza con i modelli YOLO11 paragonabili - e talvolta superiori - a quelli dell'attuale Jetson Orin NX 16GB (senza modalità super).

Ciò che rende questo risultato ancora più notevole è l'accessibilità economica di Jetson Orin Nano Super. Offrendo tali prestazioni a meno della metà del prezzo di Jetson Orin NX 16GB, rappresenta un valore eccezionale per gli sviluppatori che realizzano applicazioni YOLO11 ad alte prestazioni. Questa combinazione di costo e prestazioni rende Jetson Orin Nano Super una scelta eccellente per le attività di Vision AI in tempo reale.

Se non vedete l'ora di iniziare a distribuire YOLO11 su Jetson Orin Nano Super, c'è una buona notizia: si tratta di un processo semplice. Dopo aver eseguito il flashing del dispositivo con l'SDK NVIDIA JetPack, è possibile utilizzare un'immagine Docker precostituita per una rapida configurazione oppure installare manualmente i pacchetti necessari.

Per coloro che cercano un'integrazione più rapida e fluida, il container Docker JetPack 6 aggiornato è la soluzione ideale. Un container Docker è un ambiente leggero e portatile che include tutti gli strumenti e le dipendenze necessari per eseguire software specifici.

Il container Ultralytics , ottimizzato per JetPack 6.1, è precaricato con CUDA 12.6, TensorRT 10.3 e strumenti essenziali come PyTorch e TorchVision, tutti adattati all'architettura ARM64 di Jetson. Utilizzando questo contenitore, gli sviluppatori possono risparmiare tempo nella configurazione e concentrarsi sulla creazione e sull'ottimizzazione delle applicazioni Vision AI con YOLO11.

Per coloro che cercano ispirazione per il loro prossimo progetto di IA, ci sono potenziali applicazioni di computer vision edge-based intorno a noi.

Nella vita di tutti i giorni, l'edge AI sta ridefinendo gli spazi intelligenti, consentendo ai sistemi di detect e track oggetti in tempo reale, senza dover ricorrere all'elaborazione su cloud. Che si tratti di monitorare il traffico in una città trafficata o di identificare attività insolite negli spazi pubblici, l'AI edge Vision sta aumentando la sicurezza e l'efficienza.

Anche i rivenditori stanno sfruttando l'intelligenza artificiale e la computer vision. Dai controlli automatizzati dell'inventario alla prevenzione dei furti, modelli come YOLO11 consentono alle aziende di implementare soluzioni in tempo reale direttamente nei negozi.

Allo stesso modo, quando si parla di IA nel settore sanitario, il monitoraggio edge-based garantisce la sicurezza dei pazienti, rileva le anomalie e mantiene la conformità, il tutto senza ritardi causati dalla dipendenza dal cloud. Con strumenti come Jetson Orin Nano Super e YOLO11, il futuro dell'IA di visione si sta sviluppando proprio ai margini, dove è più necessario.

L'implementazione di modelli Ultralytics YOLO come YOLO11 su NVIDIA Jetson Orin Nano Super Developer Kit offre una soluzione affidabile ed efficiente per le applicazioni di intelligenza artificiale. Grazie alle solide prestazioni GPU , al supporto continuo di PyTorch, ONNX e TensorRT e a benchmark impressionanti, è particolarmente adatto a compiti di computer vision in tempo reale come il rilevamento e il tracciamento di oggetti.

Le innovazioni e le collaborazioni in tecnologie all'avanguardia come Vision AI e l'accelerazione hardware stanno trasformando il nostro modo di lavorare, consentendo agli sviluppatori di creare soluzioni scalabili e ad alte prestazioni ai margini. Con i progressi dell'intelligenza artificiale, strumenti come YOLO11 e Jetson Orin Nano Super rendono più facile che mai la realizzazione di soluzioni intelligenti e in tempo reale.

Siete curiosi di scoprire di più sull'IA? Visitate il nostro repository GitHub per esplorare i nostri contributi e interagire con la nostra community. Scoprite come stiamo utilizzando l'IA per avere un impatto in settori come l'agricoltura e la sanità.

Inizia il tuo viaggio con il futuro del machine learning