À medida que a tecnologia de IA avança, há uma necessidade crescente de poder de computação de IA novo e aprimorado. Explore como o poder de computação está ajudando a impulsionar o movimento da IA.

À medida que a tecnologia de IA avança, há uma necessidade crescente de poder de computação de IA novo e aprimorado. Explore como o poder de computação está ajudando a impulsionar o movimento da IA.

A inteligência artificial (IA) e o poder de computação compartilham uma relação muito próxima. O poder de computação é essencial para aplicações de IA porque ajuda os sistemas de computador a processar e executar tarefas. Essas aplicações exigem recursos computacionais substanciais para gerenciar algoritmos complexos e grandes conjuntos de dados, e é aí que as GPUs entram em cena. As GPUs, ou Unidades de Processamento Gráfico, foram originalmente projetadas para acelerar o processamento de imagens e vídeos, mas se tornaram essenciais para gerenciar o processamento intensivo de dados e as tarefas de aprendizado profundo que a IA exige.

Nos últimos anos, assistimos a um crescimento exponencial dos avanços da IA. Naturalmente, os avanços do hardware de IA precisam de acomodar este crescimento e de o acompanhar. Um estudo revelou que o desempenho GPU aumentou cerca de 7.000 vezes desde 2003.

Hardware mais forte, mais rápido e mais eficiente permite que pesquisadores e engenheiros desenvolvam modelos de IA cada vez mais complexos. Vamos entender como a infraestrutura de computação para IA está evoluindo para atender às crescentes demandas da inteligência artificial.

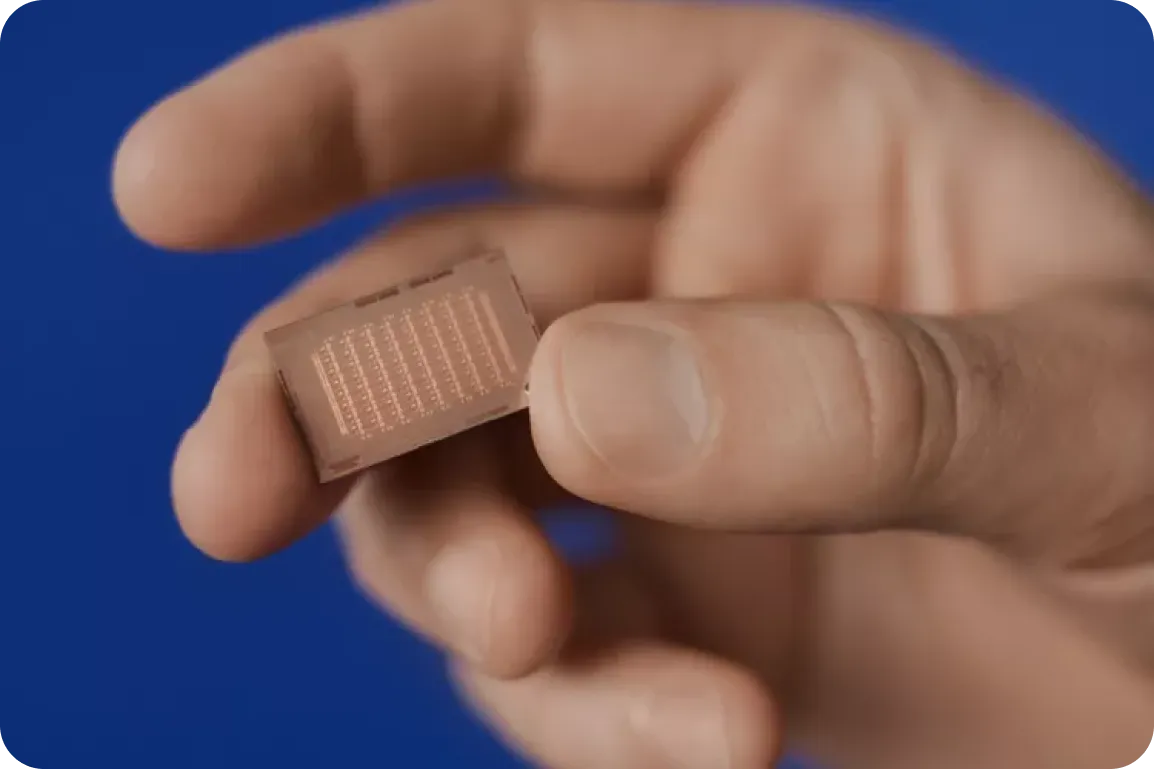

O papel das GPUs no desenvolvimento de IA é inegável. Esses processadores poderosos aceleram os cálculos complexos necessários para treinar e implantar modelos de IA. Essencialmente, eles servem como a espinha dorsal da tecnologia de IA moderna. Mas não são apenas as GPUs que estão atraindo atenção.

Estamos começando a ver chips feitos apenas para IA que competem com eles. Esses chips são construídos do zero para ajudar a IA a fazer seu trabalho ainda melhor e mais rápido. Muita pesquisa e trabalho estão sendo feitos para melhorar o futuro da computação de IA. Muitas empresas estão investindo em poder de computação de IA, que é uma das razões pelas quais o mercado global de hardware de IA foi avaliado em US$ 53,71 bilhões em 2023 e deve crescer para aproximadamente US$ 473,53 bilhões até 2033.

Por que os avanços no hardware de IA se tornaram um tópico de conversa recentemente? A mudança para hardware de IA especializado reflete as crescentes demandas de aplicações de IA em diferentes setores. Para criar soluções de IA com sucesso, é importante ficar à frente do jogo, estando ciente das mudanças que estão acontecendo no hardware.

Os principais fabricantes de hardware estão correndo para desenvolver hardware de última geração, melhorando o desempenho e a eficiência por meio de desenvolvimento interno, parcerias estratégicas e aquisições.

.webp)

A Apple deixou de utilizar GPUs externas e passou a desenvolver os seus próprios chips da série M com motores neuronais para aceleração da IA, reforçando o seu ecossistema rigorosamente controlado. Entretanto, Google continua a investir fortemente na sua infraestrutura de unidades de processamento de Tensor TPU). As TPUs são chips de IA concebidos para funcionar mais rapidamente e utilizar menos energia do que as GPUs, o que as torna óptimas para a formação e implementação de soluções de IA em maior escala.

Da mesma forma, a AMD entrou na arena do hardware de IA com sua série de aceleradores Radeon Instinct, visando centros de dados e aplicativos de computação de alto desempenho. Além disso, Nvidia continua a concentrar-se no desenvolvimento de GPUs optimizadas para cargas de trabalho de IA, como as GPUs A100 e H100 Tensor Core. A sua recente aquisição da Arm Holdings visa aumentar o seu controlo sobre as arquiteturas de chips que alimentam muitos dispositivos móveis.

Além desses players estabelecidos, muitas startups e instituições de pesquisa estão se aventurando em novas arquiteturas de chip de IA. Por exemplo, a Graphcore é especializada em computações esparsas com sua Unidade de Processamento de Inteligência (IPU). A Cerebras Systems oferece o Wafer Scale Engine, um chip massivo feito sob medida para cargas de trabalho de IA de escala extrema.

Vamos dar uma olhada no hardware de IA mais recente que foi lançado.

Em 9 de abril de 2024, Intel revelou o seu mais recente chip de IA, o Gaudi 3, com um desempenho superior ao da GPU H100 da Nvidia:

.webp)

Antes de Gaudi 3, em 18 de março de 2024, NVIDIA apresentou a sua mais recente plataforma de IA, a Blackwell. Essa plataforma foi projetada para impulsionar avanços em vários campos e possui os seguintes recursos:

.webp)

Enquanto isso, várias gigantes da tecnologia estão desenvolvendo seus próprios chips de IA personalizados para alimentar seus serviços.

Em 10 de abril de 2024, a Meta anunciou a versão mais recente de seu Meta Training and Inference Accelerator (MTIA). Este chip de segunda geração, já operacional nos data centers da Meta, está apresentando um desempenho melhor em termos de computação e largura de banda de memória. Essas atualizações suportam o desempenho das aplicações de IA da Meta, como mecanismos de classificação e recomendação, em plataformas como Facebook e Instagram.

Do mesmo modo, outros intervenientes importantes como Google, a Amazon e Microsoft também introduziram este ano os seus chips de silício personalizados. Trata-se de uma medida estratégica para otimizar as suas estruturas de custos e reduzir a dependência de fornecedores terceiros como a Nvidia.

O hardware de IA suporta várias soluções de IA em diversos setores. Na área da saúde, ele alimenta sistemas de imagem médica, como ressonância magnética e tomografia computadorizada, lidando com tarefas complexas e processando grandes volumes de dados de forma eficiente para um diagnóstico rápido e preciso.

As instituições financeiras usam algoritmos de IA para analisar dados para detecção de fraudes e otimização de investimentos. A natureza intrincada da análise de dados financeiros requer recursos de hardware avançados para lidar com a imensa carga de trabalho computacional de forma eficaz.

Na indústria automotiva, ajuda a processar dados de sensores em tempo real em veículos autônomos. Tarefas como detecção de objetos e prevenção de colisões precisam ser apoiadas por hardware avançado com poderosos recursos de processamento para uma tomada de decisão rápida e segurança dos passageiros.

Os varejistas usam mecanismos de recomendação baseados em IA para personalizar as experiências de compra e aumentar as vendas, analisando vastos dados de clientes em todos os departamentos para prever preferências e sugerir produtos relevantes. A necessidade de analisar diversos conjuntos de dados e gerar recomendações personalizadas exige hardware avançado para respostas em tempo real e maior envolvimento do usuário.

Outro exemplo relacionado com as lojas de retalho é a utilização da visão por computador para monitorizar e analisar o comportamento dos clientes. Os retalhistas podem compreender como os clientes interagem com o seu ambiente, identificar produtos populares e detect padrões de tráfego pedonal. Com base nessas descobertas, eles podem otimizar o layout da loja e a colocação de produtos para melhorar as vendas. A capacidade de computação é importante para o processamento em tempo real de grandes volumes de dados de vídeo. O rastreio exato de movimentos e interações depende de hardware robusto. Sem ele, a velocidade e a precisão do processamento de dados ficam comprometidas, reduzindo a eficácia da análise do comportamento do cliente.

Essa é a ponta do iceberg. Da manufatura à agricultura, o hardware de IA pode ser visto em todos os lugares.

O hardware de IA é frequentemente construído para lidar com grandes tarefas. Pode ser um desafio compreender a escala das implementações de IA em indústrias em todo o mundo, mas é claro que a IA escalável depende de ter o hardware certo em vigor.

Veja-se a colaboração entre a BMW e NVIDIA, por exemplo. Com a BMW a produzir 2,5 milhões de automóveis por ano, a escala das suas operações é imensa. A BMW está a utilizar a IA para otimizar vários aspectos do seu processo de fabrico, desde o controlo de qualidade e manutenção preditiva até à logística e gestão da cadeia de fornecimento.

Para atender a essas demandas, a BMW conta com soluções avançadas de hardware de IA, como o Quadro RTX 8000 NVIDIA e servidores com tecnologia RTX. Essas tecnologias tornam as implementações de IA mais fáceis e escaláveis.

Além de fornecer poder computacional para aplicações de IA, o hardware de IA que você escolhe influencia sua solução em termos de desempenho do modelo, necessidades de conversão do modelo, flexibilidade de implementação e precisão geral. Uma vez que os modelos de IA são treinados e testados, eles são frequentemente convertidos para um formato que será executado nas plataformas de implementação escolhidas.

No entanto, a conversão de modelos pode levar à perda de precisão e deve ser considerada com antecedência. Ferramentas de integração como o ONNX (Open Neural Network Exchange) podem fornecer um formato padronizado para a implantação de modelos de IA em uma variedade de plataformas de hardware. Esta é também a razão por detrás de modelos populares como o YOLOv8 , que dá aos utilizadores a opção de exportar os seus modelos personalizados em muitos formatos diferentes para atender a várias opções de implementação.

O impacto do poder computacional avançado da IA não se limita à IA; também está afetando o setor de energia.

Por exemplo, o LLaMA-3 da Meta, um modelo avançado de linguagem grande (LLM), foi treinado utilizando dois clusters de centros de dados personalizados equipados com 24 576 GPUs Nvidia H100 cada. Através desta configuração de hardware robusta, o Meta conseguiu aumentar a velocidade de processamento e obter uma redução significativa de 40% no consumo de energia. Assim, os avanços no hardware de IA também estão a contribuir para operações mais eficientes em termos energéticos.

Além disso, a ligação entre a IA e a energia está a receber mais atenção com o envolvimento de pessoas como Sam Altman. Altman, conhecido como o CEO da OpenAI, disponibilizou recentemente ao público a empresa de energia nuclear Oklo. A Oklo, com a sua inovadora tecnologia de fissão nuclear, tem como objetivo transformar a produção de energia, potencialmente fornecendo energia aos centros de dados essenciais para as operações de IA. Nos últimos anos, tanto Bill Gates, cofundador da Microsoft, como Jeff Bezos, fundador da Amazon, também fizeram investimentos em centrais nucleares.

Olhando para o futuro, o futuro do hardware de IA está definido para dar grandes saltos, especialmente com a ascensão da computação quântica. Os especialistas preveem que, até 2030, o mercado de computação quântica poderá valer quase US$ 65 bilhões. À medida que os modelos de IA crescem em complexidade, o hardware especializado se torna crucial para desbloquear todo o seu potencial. De chips específicos de IA a explorações de computação quântica, a inovação de hardware impulsiona o desenvolvimento de soluções de IA mais complexas e impactantes.

Sinta-se à vontade para conferir nosso repositório GitHub e interagir com nossa comunidade para saber mais sobre IA. Explore nossas últimas postagens de blog para ver como a IA é aplicada em vários campos, como corrida de Fórmula 1 e robótica.

Comece sua jornada com o futuro do aprendizado de máquina