探索 OpenAI 的新型 GPT-4o,它具有先进的人工智能和逼真交互功能,可改变我们与技术交互的方式。探索其突破性功能!

探索 OpenAI 的新型 GPT-4o,它具有先进的人工智能和逼真交互功能,可改变我们与技术交互的方式。探索其突破性功能!

2024 年 5 月 13 日星期一,OpenAI 宣布推出其新的旗舰模型 GPT-4o,其中“o”代表“omni”。GPT-4o 是一种先进的多模态人工智能模型,用于实时文本、音频和视觉交互,提供更快的处理速度、多语言支持和更高的安全性。

它带来了前所未有的人工智能生成功能。以ChatGPT 的对话优势为基础,GPT-4o 的功能标志着人们在如何看待人工智能方面向前迈出了一大步。现在,我们可以像与真人对话一样与 GPT-4o 交谈。让我们深入了解一下 GPT-4o 的具体功能!

在 OpenAI 的春季更新中,我们了解到 GPT-4o 在智能程度上与 GPT-4 相当,但它能更快地处理数据,并且更擅长处理文本、视觉和音频。与之前专注于让模型更智能的版本不同,此版本的发布考虑到了让普通大众更容易使用 AI 的需求。

.png)

去年年底发布的ChatGPT语音模式涉及三个不同的模型,它们共同转录语音输入,理解并生成书面回复,以及将文本转换为语音,以便用户可以听到回复。这种模式存在延迟问题,而且感觉不是很自然。GPT-4o 可以一次性处理文本、图像和音频,让用户感觉自己是在进行自然对话。

此外,与语音模式不同的是,现在你可以在 GPT-4o 说话时打断它,它会像真人一样做出反应。它会暂停并倾听,然后根据你所说的内容给出实时回复。它还可以通过声音表达情感,并理解你的语气。

GPT-4o 的模型评估显示了它的先进程度。其中一个最有趣的结果是,与 Whisper-v3 相比,GPT-4o 在所有语言(尤其是那些不太常用的语言)中的语音识别能力都得到了极大的提高。

音频 ASR(自动语音识别)性能衡量的是模型将口语转录成文本的准确程度。GPT-4o 的性能通过词错误率 (WER) 来跟踪,该指标显示了不正确转录的单词百分比(WER 越低意味着质量越好)。下图展示了 GPT-4o 在各个地区的较低 WER,证明了其在提高低资源语言语音识别方面的有效性。

.png)

以下是 GPT-4o 的一些更独特的功能:

现在你可以拿出手机,打开摄像头,然后像对待朋友一样,让 GPT-4o 根据你的面部表情来猜测你的情绪。GPT-4o 可以通过摄像头观察你并给出答案。

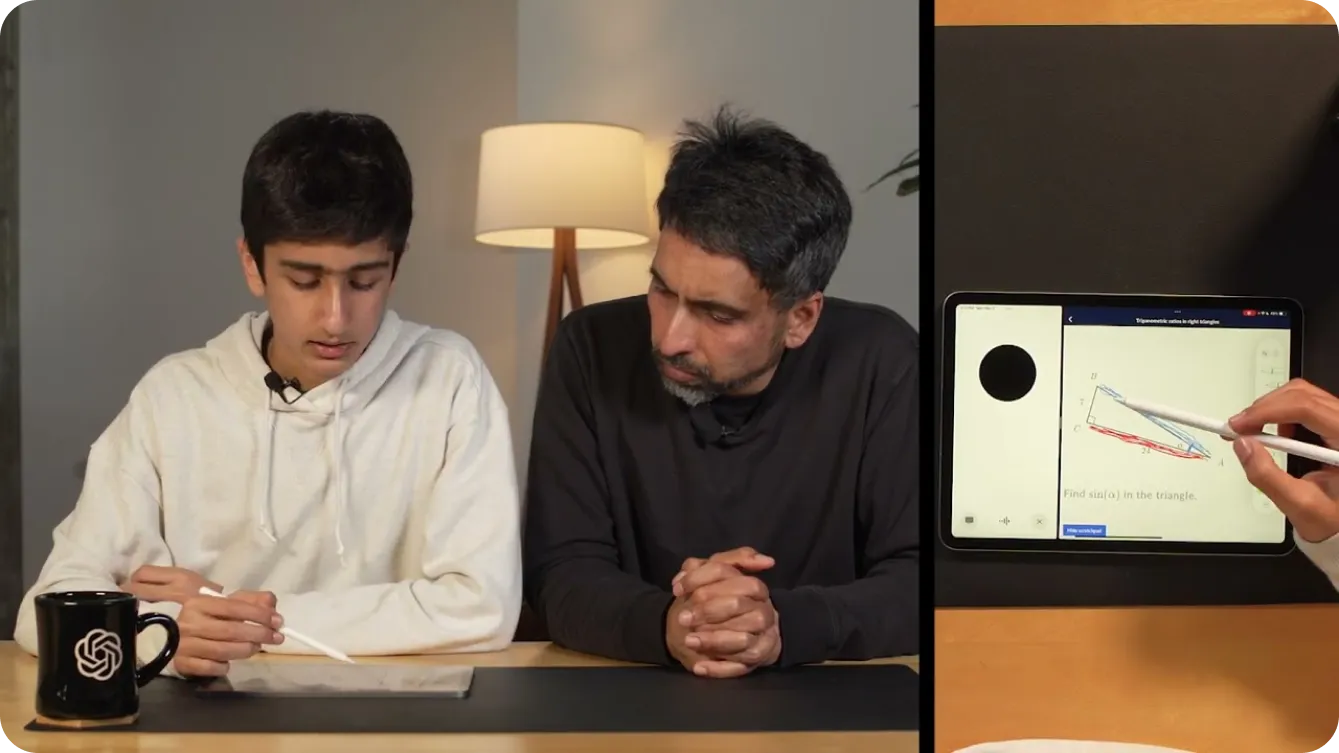

你甚至可以用它来帮助你解决数学问题,通过视频向 GPT-4o 展示你正在写的内容。或者,你可以分享你的屏幕,它可以成为可汗学院 (Khan Academy) 上一个有用的导师,让你指出几何图形中三角形的不同部分,如下所示。

除了帮助孩子们学习数学,开发人员还可以与 GPT-4o 进行对话,以调试他们的代码。这要归功于ChatGPT 桌面应用程序的推出。在与桌面 GPT-4o 语音应用程序对话时,如果使用 CTRL "C "选中并复制你的代码,它就能读取你的代码。或者,你也可以用它来翻译不同语言开发人员之间的对话。

GPT-4o 的可能性似乎是无限的。OpenAI 最有趣的演示之一是使用两部手机来展示 GPT-4o 与其自身的其他实例对话并一起唱歌。

正如演示中所示,GPT-4o 可以让视力障碍人士更容易地融入社会。它可以帮助他们更安全、更独立地互动和四处走动。例如,用户可以打开他们的视频,并向 GPT-4o 展示街道的景象。然后,GPT-4o 可以提供关于环境的实时描述,例如识别障碍物、阅读街道标志或引导他们到特定的位置。它甚至可以通过在出租车接近时提醒他们来帮助他们叫出租车。

.png)

同样,GPT-4o 可以通过其先进的功能改变各个行业。在零售业中,它可以通过提供实时帮助、回答问题和帮助客户在线和店内寻找产品来改善客户服务。假设你正在看一排产品,但无法挑选出你正在寻找的产品,GPT-4o 可以帮助你。

在医疗保健领域,GPT-4o可以通过分析患者数据、根据症状提出可能的病情,并提供治疗方案建议来辅助诊断。它还可以通过总结患者记录、快速访问医学文献,甚至提供实时语言翻译来与讲不同语言的患者沟通,从而为医疗专业人员提供支持。这些只是一些例子。GPT-4o的应用通过提供量身定制的、具有上下文感知能力的帮助,并打破信息和沟通的障碍,使日常生活更加轻松。

就像之前影响了数亿人生活的GPT版本一样,GPT-4o可能会在全球范围内与实时音频和视频互动,因此安全性在这些应用中至关重要。OpenAI在构建GPT-4o时非常谨慎,重点是降低潜在风险。

为了确保安全性和可靠性,OpenAI实施了严格的安全措施。这些措施包括过滤训练数据、在训练后改进模型的行为,以及整合新的安全系统来管理语音输出。此外,GPT-4o还经过了70多位社会心理学、偏见与公平以及虚假信息等领域外部专家的广泛测试。外部测试确保识别并解决新功能引入或放大的任何风险。

为了保持高安全标准,OpenAI将在未来几周内逐步发布GPT-4o的功能。分阶段发布使OpenAI能够监控性能、解决任何问题并收集用户反馈。采取谨慎的方法可以确保GPT-4o在提供高级功能的同时,保持最高的安全和道德使用标准。

GPT-4o 可免费使用。要体验上述实时对话功能,您可以直接从Google Play 商店或 Apple App Store 将ChatGPT 应用程序下载到手机上。

登录后,您可以通过点击屏幕右上角的三个点,从显示的列表中选择GPT-4o。导航到启用GPT-4o的聊天后,如果您点击屏幕左下角的加号,您将看到多个输入选项。在屏幕的右下角,您将看到一个耳机图标。选择耳机图标后,系统会询问您是否要体验GPT-4o的免提版本。同意后,您就可以试用GPT-4o,如下所示。

如果您想将GPT-4o的高级功能集成到您自己的项目中,它可以作为API供开发人员使用。它允许您将GPT-4o强大的语音识别、多语言支持和实时对话功能整合到您的应用程序中。通过使用API,您可以增强用户体验,构建更智能的应用程序,并将尖端AI技术引入到不同的领域。

虽然 GPT-4o 比以前的人工智能模型先进得多,但必须记住,GPT-4o 也有自己的局限性。OpenAI 曾提到,GPT-4o 有时会在说话时随机切换语言,从English 变成法语。他们还看到 GPT-4o 在不同语言之间出现错误的翻译。随着越来越多的人试用该模型,我们将了解 GPT-4o 的优势和需要进一步改进的地方。

OpenAI的GPT-4o凭借其先进的文本、视觉和音频处理能力,为AI开辟了新的大门,提供自然、类人的互动。它在速度、成本效益和多语言支持方面表现出色。GPT-4o是教育、可访问性和实时帮助的多功能工具。随着用户探索GPT-4o的功能,反馈将推动其发展。GPT-4o证明AI正在真正改变我们的世界,并成为我们日常生活的一部分。

探索我们的GitHub存储库并加入我们的社区,以更深入地了解AI。访问我们的解决方案页面,了解AI如何改变制造业和农业等行业。

开启您的机器学习未来之旅