Ultralytics YOLO26 与其他用于姿态估计的 Ultralytics YOLO 模型对比

了解 Ultralytics YOLO26 如何通过对非人类关键点的更好支持、更快的收敛速度、改进的遮挡处理以及高效的实时部署来提升姿态估计效果。

当你观察某人的姿势时,很容易就能看出他们是否在含胸、前倾或站得笔直。人类可以快速理解身体各部位之间的相互关系。

这是我们在日常生活中解读动作和肢体语言的内在组成部分。然而对于机器而言,这种视觉理解并非自动发生的。教导系统识别动作和结构需要先进的深度学习和 computer vision 技术,使它们能够以有意义的方式解析图像。

特别是 pose estimation 这种视觉 AI 技术,让计算机视觉模型能够建立类似的理解。模型不再仅仅是在图像中检测某个物体,而是预测代表重要结构地标的关键点。

这些关键点可以对应身体关节、动物肢体、机器组件,甚至是球场角落等固定点。通过识别和跟踪这些点,系统能够以结构化且可测量的方式理解位置、排列和运动。

随着姿态估计被应用于更多现实场景,模型必须更有效地处理非人类关键点、复杂场景和自定义数据集。例如,像 Ultralytics YOLO26 这样最先进的模型支持姿态估计等计算机视觉任务,并在早期 YOLO 姿态模型的基础上,通过架构和训练改进来增强灵活性和整体性能。

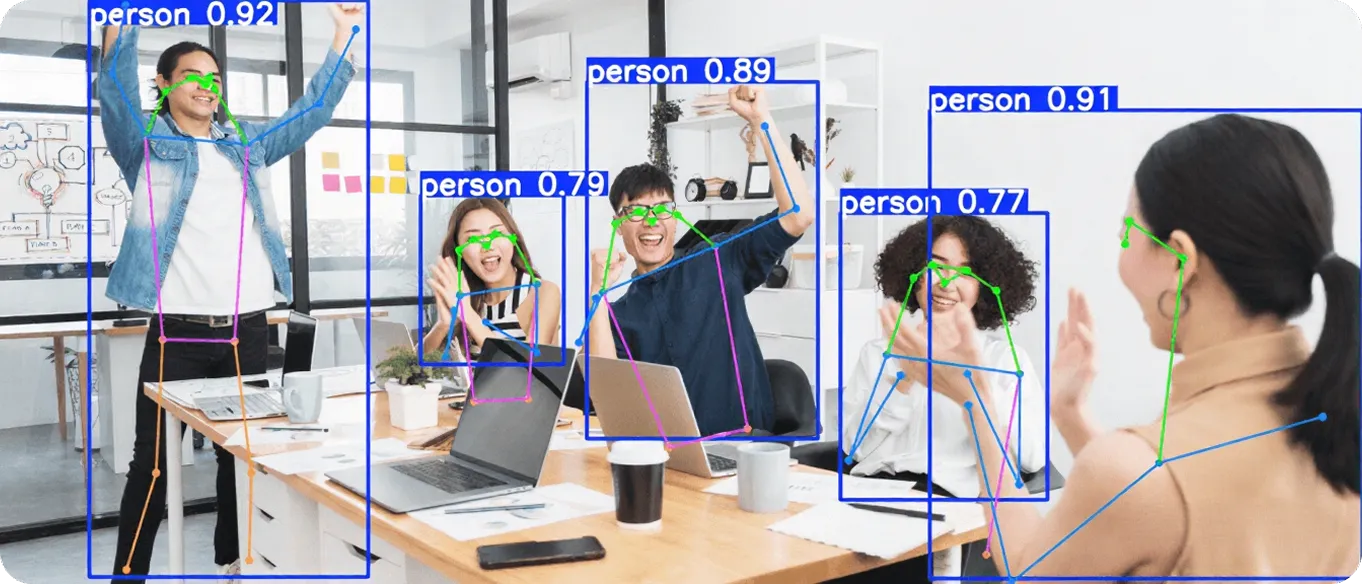

图 1. YOLO 实现的姿态估计示例 (来源)

在本文中,我们将把 YOLO26-pose 与之前的 Ultralytics YOLO 姿态模型进行比较,并探讨它如何在复杂场景中提高灵活性、收敛速度和性能。让我们开始吧!

Link to this section什么是姿态估计?#

在深入对比 Ultralytics YOLO 姿态模型之前,让我们仔细了解一下在计算机视觉语境下姿态估计的真正含义。

姿态估计是一种用于检测和跟踪图像或视频帧中特定关键点的技术。这些关键点可以代表重要的结构地标,例如人体关节、动物肢体、机器组件或场景中的固定参考点。

图 2. 使用人体姿态估计来预估工人的姿态 (来源)

通过识别这些点的坐标,模型可以理解物体的定位及其随时间的移动方式。与将单个标签分配给整张图像的图像分类,或者专注于围绕物体绘制边界框的物体检测模型不同,姿态估计提供了关于结构和运动的更详细的空间信息。

Link to this sectionYOLO26-pose 概览#

YOLO26-pose 提供多种模型变体或大小,包括像 YOLO26n-pose 这样的轻量级选项,以及 YOLO26m-pose、YOLO26l-pose 和 YOLO26x-pose 等更大的模型。这让团队可以根据硬件和性能需求选择速度与精度之间的最佳平衡点。

Ultralytics 还提供在大型通用数据集(如 COCO 数据集,特别是用于人体姿态估计的 COCO-Pose 关键点标注)上训练过的预训练姿态模型,因此你不必从头开始。在大多数情况下,团队会在自己的数据集上微调这些模型,以适应特定的关键点、布局或环境。

这通常涉及准备自定义标注文件,以结构化格式定义关键点坐标和类别标签。这些标注将关键点映射到每张图像内的特定像素坐标,使模型能够在训练期间学习精确的空间关系。

使用预训练模型可以加快训练速度,减少数据需求,并帮助更高效地将项目投入生产。

Link to this section人体姿态估计的现实应用#

以下是姿态估计发挥重要作用的一些现实应用场景:

- 医疗保健与康复: 临床医生可以使用姿态模型来评估姿势、监测恢复进度,并在物理治疗期间分析运动模式。

- 自主系统: 无人机和智能摄像头可以利用姿态信息更好地理解动态场景中的物体方向和移动。

- 工作场所安全: 组织可以监测身体姿势和重复性动作,以帮助识别潜在的安全风险。

- 健身与个人训练: 健身应用 使用姿态估计来跟踪运动姿势、计算重复次数,并针对健身教程中保持的姿势和动作提供实时反馈。

图 3. 姿态估计可以帮助在运动过程中跟踪关键身体点。 (来源)

Link to this section探索 Ultralytics YOLO26 对姿态估计的支持#

Ultralytics YOLO26 在早期 Ultralytics YOLO 模型的基础上进行了更新,旨在使训练和部署更加实用。

与之前的版本一样,它将姿态估计作为统一框架的一部分提供支持。主要的区别在于,YOLO26 构建得更加灵活,在更广泛的现实用例中也更稳定。

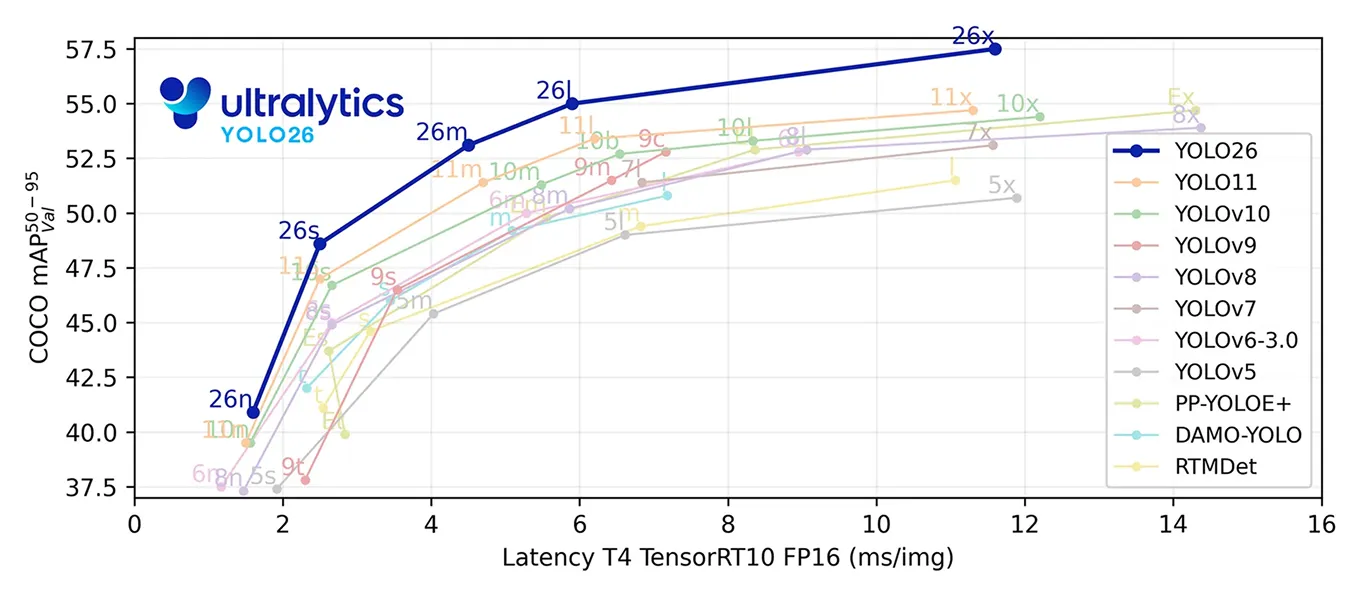

图 4. YOLO26 基准测试 (来源)

早期的 Ultralytics YOLO 姿态模型在很大程度上受到人类 pose datasets 的影响,这意味着旧方法的部分内容是围绕人体关节结构进行优化的。YOLO26 移除了这些特定于人类的假设。

因此,它更适合非人类关键点,例如检测网球场的角落或其他自定义结构地标。这很重要,因为现成的预训练 YOLO26-pose 模型是在 COCO-pose 等数据集上训练的,并且预测数据集标注中定义的人体关键点。

然而,当团队想要检测不同类型的地标时,例如机械组件、运动场地标记或基础设施点,通常需要在标注了这些特定关键点的自定义数据集上对模型进行微调。

由于 YOLO26 不受关于人体关节结构的假设束缚,它可以在微调过程中更有效地进行适配。这种灵活性使模型能够更可靠地学习自定义关键点布局,从而在针对具有独特关键点配置的数据集进行验证时,带来更好的评估指标。

YOLO26-pose 还旨在改善物体部分被隐藏或以极小比例出现时的关键点定位。在涉及远距离拍摄对象、无人机录像或小物体场景的现实世界中,与早期的姿态模型相比,这可以带来更准确的关键点预测。

另一个重要的更新是训练期间使用的改进损失公式。损失函数决定了模型在学习时如何修正错误。

对于 YOLO26-pose 而言,这个过程更有效,这有助于模型更快地学习并在更少的 epoch 内达到强大的准确性,其中 epoch 指的是对训练数据集的完整一轮遍历。

总体而言,YOLO26-pose 在早期 Ultralytics YOLO 姿态模型的基础上,在非人类关键点支持和训练收敛性方面有了明显的改进,同时保持了相同熟悉的流程。

Link to this section将 YOLO26-pose 与 Ultralytics YOLOv5 进行比较#

Ultralytics YOLO 模型的最早版本 Ultralytics YOLOv5 主要用于物体检测。虽然 YOLOv5 后来扩展到支持实例分割,但它在官方 Ultralytics 框架内不包含原生的、专门的姿态估计头。

需要关键点检测的团队通常依赖单独的实现或自定义修改。Ultralytics YOLO26 将姿态估计作为内置任务包含在内,并配备了专门用于预测关键点的专用架构头。

这意味着 YOLO26-pose 模型可以在与检测和分割相同的统一工作流程中进行训练、验证和部署。对于专注于结构化关键点检测的项目,YOLO26 提供了 YOLOv5 所不具备的原生姿态支持和任务专用架构。

Link to this section关键区别:YOLO26-pose 与 Ultralytics YOLOv8-pose#

Ultralytics YOLOv8 在统一的 Ultralytics 框架内引入了原生姿态估计,使得使用与检测和分割相同的工作流程来训练和部署关键点模型变得简单。它依赖于传统的后处理流水线,包含非极大值抑制(NMS),并使用早期的损失公式进行边界框回归和训练。

YOLO26 在此基础上通过架构和训练更新进行了构建,这些更新直接影响了姿态估计。一个主要的区别是端到端的设计。YOLO26 在推理过程中消除了对外部 NMS 的需求,这简化了部署并提高了延迟一致性,特别是在 CPU 和边缘设备上。

另一个关键的改进在于训练方法论。YOLO26 引入了 MuSGD 优化器以及更新的损失策略。对于姿态任务,它集成了残差对数似然估计(Residual Log-Likelihood Estimation),从而改进了关键点不确定性的建模方式。总而言之,这些变化可以带来更快的收敛和更稳定的关键点预测,特别是在复杂或部分遮挡的场景中。

简而言之,YOLOv8-pose 建立了一个强大且多功能的基准。YOLO26-pose 通过提高训练效率、改善遮挡处理以及为现实世界的非人类姿态应用提供更大的灵活性,对该基准进行了优化。

Link to this sectionYOLO26-pose 与 Ultralytics YOLO11-pose:有哪些改进?#

Ultralytics YOLO11 在 Ultralytics YOLOv8 的基础上通过精简主干网络和特征提取层进行了改进。它减少了 FLOPs,提高了参数效率,并在保持强大实时性能的同时提供了更高的 mAP。对于姿态任务,这意味着以更轻量化的架构实现了更好的关键点准确性。

YOLO26-pose 通过更根本的架构转变延续了这一发展。简单来说,YOLO11 优化了 YOLOv8 的效率和准确性,而 YOLO26 在此基础上进行了架构和训练更新,旨在实现更快的收敛、更稳定的推理以及在复杂场景中更高的姿态准确性。

Link to this section为什么要开始使用 YOLO26 模型进行姿态估计?#

当你探索 Ultralytics YOLO 模型之间的差异时,你可能想知道是否应该切换到 YOLO26-pose。

简短的回答是,这是一个简单的升级。如果你已经在运行 Ultralytics YOLOv8-pose 或 Ultralytics YOLO11-pose,切换到 YOLO26-pose 通常意味着只需更改模型版本,而无需重建你的工作流。

你可以受益于对非人类关键点的更好支持、训练期间更快的收敛以及对被遮挡点的改进处理,同时保留在相同的 Ultralytics 框架中。对于大多数新的和现有的姿态项目,迁移到 YOLO26-pose 是一种以最小阻力获得这些改进的直接方式。

除此之外,YOLO26-pose 在 Ultralytics Python package 中得到全面支持,该包基于 PyTorch 构建,使训练、验证和部署变得简单。模型可以导出为 ONNX、TensorRT、OpenVINO、CoreML 和 TFLite 等格式,从而更容易在 GPU、CPU 和边缘设备上进行部署,而无需改变你的整体工作流。

Link to this section关键要点#

Ultralytics YOLO26-pose 使姿态估计更加灵活和可靠,特别是在处理非人类关键点或复杂场景时。它的训练速度更快,处理遮挡效果更好,并在不同数据集上提供更一致的结果。对于已经在使用 Ultralytics YOLO 姿态模型的团队,YOLO26 在不改变现有工作流的情况下提供了清晰的改进。

想了解更多关于 AI 的信息吗?请查看我们的社区和 GitHub 仓库。浏览我们的解决方案页面,了解机器人领域的 AI 和农业计算机视觉。探索我们的许可选项,并立即开始构建计算机视觉应用!