关于 Intel

Intel (Nasdaq: INTC) 是行业领导者,创造改变世界的科技,赋能全球进步并丰富生活。Intel 不断推进半导体设计和制造,以帮助解决客户面临的最大挑战,将智能嵌入到云、网络、边缘和每一个计算设备中,从而推动商业和社会转型。 OpenVINO™ 是一款开源工具包,可通过降低延迟、提高吞吐量来加速 AI 推理,同时保持精度并优化硬件使用效率。它简化了跨计算机视觉、大语言模型和生成式 AI 的 AI 开发与深度学习集成流程。

为何选择 Intel 运行 YOLO?

针对 Ultralytics YOLO 优化

在 Intel 全系列设备上实现最大吞吐量,最小化延迟。

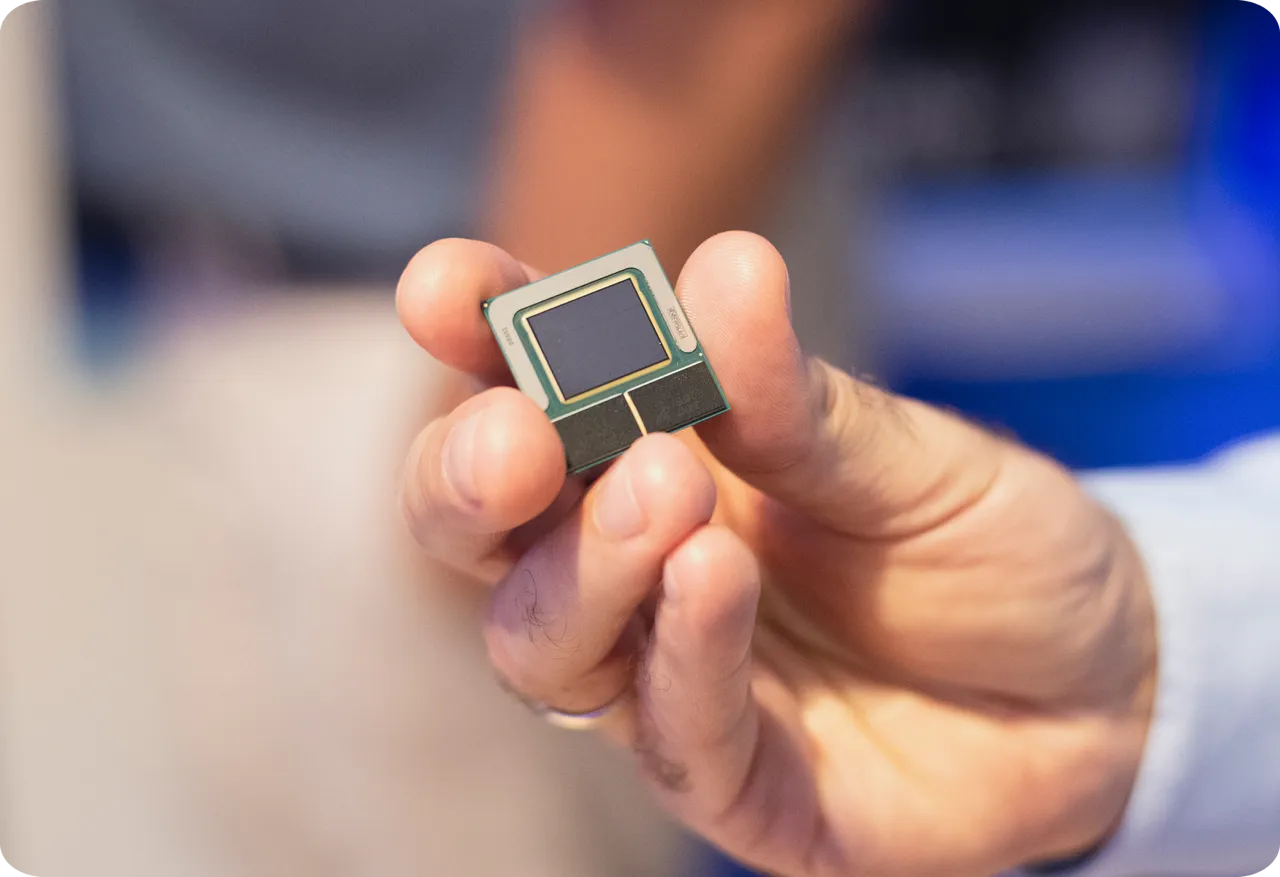

边缘原生性能

支持 FP32、FP16 和 INT8 的边缘原生 YOLO 推理。无需牺牲精度。

实时推理

在所有主要的 YOLO 任务中实现 10ms 以内的推理,并在 Intel CPU、GPU 和 NPU 上得到验证。

更低的拥有成本

在现有的 Intel 硅片上进行推理。降低成本,同时保持精度。

轻松集成

通过 Ultralytics Python 软件包或 CLI 几分钟内即可运行。使用相同的 API,相同的流程。

面向未来

始终紧跟最新的 YOLO 模型和 Intel 硬件。无需重写流水线。

完整解决方案

技术集成

Ultralytics 模型与 Intel 硬件之间的无缝集成

Ultralytics YOLOv8

YOLOv8 improved performance and added supported tasks: Segmentation, classification, and pose estimation.

Ultralytics YOLO11

YOLO11 supports the computer vision tasks users are familiar with while offering better accuracy, precision, and speed.

Ultralytics YOLO26

YOLO26 is a lighter, smaller, and faster model with the nano variant delivering up to 43% faster inference on standard CPUs.

开始使用 Intel

在 OpenVINO 和 Intel 硬件上部署 Ultralytics YOLO 的完整指南。