Mit dem Fortschritt der KI-Technologie steigt der Bedarf an neuer und verbesserter KI-Rechenleistung. Entdecken Sie, wie Rechenleistung dazu beiträgt, die KI-Bewegung voranzutreiben.

Mit dem Fortschritt der KI-Technologie steigt der Bedarf an neuer und verbesserter KI-Rechenleistung. Entdecken Sie, wie Rechenleistung dazu beiträgt, die KI-Bewegung voranzutreiben.

Künstliche Intelligenz (KI) und Rechenleistung stehen in einer sehr engen Beziehung zueinander. Rechenleistung ist für KI-Anwendungen unerlässlich, da sie Computersystemen hilft, Aufgaben zu verarbeiten und auszuführen. Diese Anwendungen benötigen erhebliche Rechenressourcen, um komplexe Algorithmen und große Datensätze zu verwalten, und hier kommen GPUs ins Spiel. GPUs (Graphics Processing Units) wurden ursprünglich entwickelt, um die Bild- und Videoverarbeitung zu beschleunigen, sind aber inzwischen unerlässlich für die Verwaltung der intensiven Datenverarbeitungs- und Deep-Learning-Aufgaben, die KI erfordert.

In den letzten Jahren sind die Fortschritte der KI exponentiell gestiegen. Natürlich müssen die Fortschritte bei der KI-Hardware mit diesem Wachstum mithalten. Eine Studie hat ergeben, dass die GPU seit 2003 um das 7.000-fache gestiegen ist.

Stärkere, schnellere und effizientere Hardware ermöglicht es Forschern und Ingenieuren, immer komplexere KI-Modelle zu entwickeln. Lassen Sie uns verstehen, wie sich die Recheninfrastruktur für KI entwickelt, um den wachsenden Anforderungen der künstlichen Intelligenz gerecht zu werden.

Die Rolle von GPUs in der KI-Entwicklung ist unbestreitbar. Diese leistungsstarken Prozessoren beschleunigen die komplexen Berechnungen, die für das Training und die Bereitstellung von KI-Modellen erforderlich sind. Im Wesentlichen dienen sie als Rückgrat der modernen KI-Technologie. Aber nicht nur GPUs erregen Aufmerksamkeit.

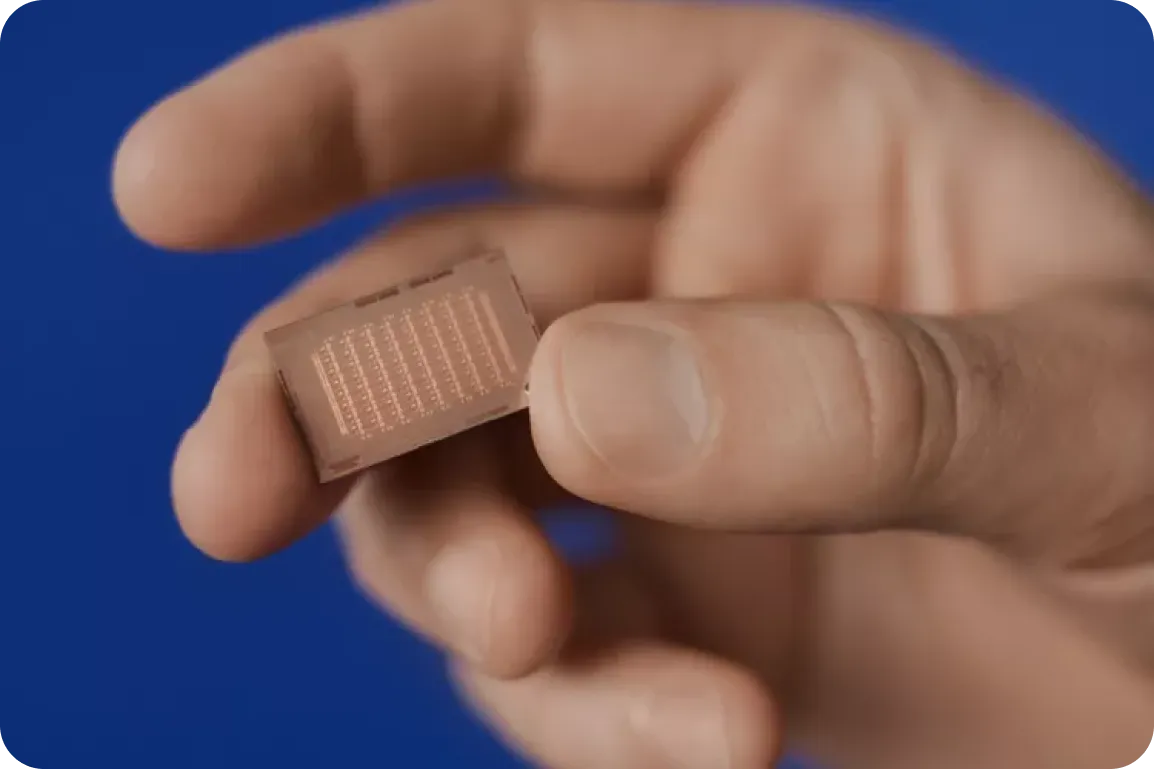

Wir sehen jetzt schon Chips, die speziell für KI hergestellt werden und mit ihnen konkurrieren. Diese Chips werden von Grund auf neu entwickelt, um KI zu helfen, ihre Arbeit noch besser und schneller zu erledigen. Es wird viel geforscht und gearbeitet, um die Zukunft des KI-Computing zu verbessern. Viele Unternehmen investieren in KI-Rechenleistung, was ein Grund dafür ist, dass der globale Markt für KI-Hardware im Jahr 2023 auf 53,71 Milliarden Dollar geschätzt wurde und bis 2033 voraussichtlich auf etwa 473,53 Milliarden Dollar anwachsen wird.

Warum sind Fortschritte im Bereich der KI-Hardware in letzter Zeit zu einem Gesprächsthema geworden? Der Wandel hin zu spezialisierter KI-Hardware spiegelt die steigenden Anforderungen von KI-Anwendungen in verschiedenen Sektoren wider. Um erfolgreich KI-Lösungen zu entwickeln, ist es wichtig, auf dem Laufenden zu bleiben und sich über die Veränderungen in der Hardware bewusst zu sein.

Führende Hardwarehersteller wetteifern um die Entwicklung von Hardware der nächsten Generation und verbessern Leistung und Effizienz durch interne Entwicklung, strategische Partnerschaften und Akquisitionen.

.webp)

Apple ist von der Verwendung externer GPUs zur Entwicklung eigener Chips der M-Serie mit neuronalen Engines zur KI-Beschleunigung übergegangen und stärkt damit sein streng kontrolliertes Ökosystem. Unterdessen investiert Google weiterhin stark in seine Tensor Processing UnitTPU)-Infrastruktur. TPUs sind KI-Chips, die schneller arbeiten und weniger Energie verbrauchen als GPUs, wodurch sie sich hervorragend für das Training und die Bereitstellung von KI-Lösungen in größerem Umfang eignen.

Auch AMD ist mit seiner Radeon Instinct-Serie von Beschleunigern in die KI-Hardware-Arena eingestiegen und zielt auf Rechenzentren und High-Performance-Computing-Anwendungen ab. Auch Nvidia konzentriert sich weiterhin auf die Entwicklung von GPUs, die für KI-Workloads optimiert sind, wie z. B. die Tensor Core GPUs A100 und H100. Die jüngste Übernahme von Arm Holdings zielt darauf ab, die Kontrolle über Chip-Architekturen zu erhöhen, die viele mobile Geräte antreiben.

Neben diesen etablierten Akteuren wagen sich viele Startups und Forschungseinrichtungen an neuartige KI-Chiparchitekturen. Graphcore beispielsweise ist mit seiner Intelligence Processing Unit (IPU) auf spärliche Berechnungen spezialisiert. Cerebras Systems bietet die Wafer Scale Engine an, einen massiven Chip, der auf KI-Workloads im Extrembereich zugeschnitten ist.

Werfen wir einen Blick auf die neueste KI-Hardware, die auf den Markt gekommen ist.

Am 9. April 2024 stellte Intel seinen neuesten KI-Chip, den Gaudi 3, vor, der eine höhere Leistung als der GPU von Nvidia bietet:

.webp)

Vor Gaudi 3, am 18. März 2024, stellte NVIDIA seine neueste KI-Plattform, Blackwell, vor. Diese Plattform wurde entwickelt, um Durchbrüche in verschiedenen Bereichen zu ermöglichen und verfügt über die folgenden Funktionen:

.webp)

In der Zwischenzeit entwickeln mehrere Tech-Giganten ihre eigenen kundenspezifischen KI-Chips, um ihre Dienste zu unterstützen.

Am 10. April 2024 kündigte Meta die neueste Version ihres Meta Training and Inference Accelerator (MTIA) an. Dieser Chip der zweiten Generation, der bereits in den Rechenzentren von Meta in Betrieb ist, schneidet in Bezug auf Rechen- und Speicherbandbreite besser ab. Diese Upgrades unterstützen die Leistung der KI-Anwendungen von Meta, wie z. B. Ranking- und Empfehlungs-Engines, auf Plattformen wie Facebook und Instagram.

Auch andere große Unternehmen wie Google, Amazon und Microsoft haben in diesem Jahr ihre eigenen Siliziumchips eingeführt. Dies ist ein strategischer Schritt, um ihre Kostenstrukturen zu optimieren und die Abhängigkeit von Drittanbietern wie Nvidia zu verringern.

KI-Hardware unterstützt verschiedene KI-Lösungen in vielen verschiedenen Branchen. Im Gesundheitswesen unterstützt sie medizinische Bildgebungssysteme wie MRT- und CT-Scans, die komplexe Aufgaben bewältigen und große Datenmengen effizient verarbeiten, um eine schnelle und präzise Diagnose zu ermöglichen.

Finanzinstitute verwenden KI-Algorithmen, um Daten zur Betrugserkennung und Anlageoptimierung zu analysieren. Die komplizierte Natur der Finanzdatenanalyse erfordert fortschrittliche Hardwarefunktionen, um die immense Rechenlast effektiv zu bewältigen.

In der Automobilindustrie hilft sie bei der Verarbeitung von Echtzeit-Sensordaten in autonomen Fahrzeugen. Aufgaben wie Objekterkennung und Kollisionsvermeidung müssen von fortschrittlicher Hardware mit leistungsstarken Verarbeitungskapazitäten unterstützt werden, um eine schnelle Entscheidungsfindung und die Sicherheit der Fahrgäste zu gewährleisten.

Einzelhändler nutzen KI-gesteuerte Empfehlungs-Engines, um das Einkaufserlebnis zu personalisieren und den Umsatz zu steigern, indem sie riesige Kundendaten aus allen Abteilungen analysieren, um Präferenzen vorherzusagen und relevante Produkte vorzuschlagen. Die Notwendigkeit, verschiedene Datensätze zu analysieren und personalisierte Empfehlungen zu generieren, erfordert fortschrittliche Hardware für Echtzeit-Reaktionen und eine verbesserte Benutzerbindung.

Ein weiteres Beispiel aus dem Einzelhandel ist der Einsatz von Computer Vision zur Überwachung und Analyse des Kundenverhaltens. Einzelhändler können verstehen, wie Kunden mit ihrer Umgebung interagieren, beliebte Produkte identifizieren und Laufwege detect . Auf der Grundlage dieser Erkenntnisse können sie die Ladengestaltung und die Platzierung der Produkte optimieren, um den Umsatz zu steigern. Rechenleistung ist wichtig für die Echtzeitverarbeitung großer Videodatenmengen. Die genaue Verfolgung von Bewegungen und Interaktionen hängt von einer robusten Hardware ab. Ohne sie sind Geschwindigkeit und Genauigkeit der Datenverarbeitung beeinträchtigt, was die Effektivität der Analyse des Kundenverhaltens verringert.

Das ist nur die Spitze des Eisbergs. Von der Fertigung bis zur Landwirtschaft ist KI-Hardware überall zu finden.

KI-Hardware wird oft für die Bewältigung großer Aufgaben entwickelt. Es kann schwierig sein, das Ausmaß von KI-Implementierungen in verschiedenen Branchen weltweit zu erfassen, aber es ist klar, dass skalierbare KI von der richtigen Hardware abhängt.

Nehmen wir zum Beispiel die Zusammenarbeit zwischen BMW und NVIDIA. Mit einer Jahresproduktion von 2,5 Millionen Autos ist der Umfang der BMW-Produktion immens. BMW nutzt KI, um verschiedene Aspekte des Produktionsprozesses zu optimieren, von der Qualitätskontrolle und der vorausschauenden Wartung bis hin zur Logistik und dem Lieferkettenmanagement.

Um diesen Anforderungen gerecht zu werden, setzt BMW auf fortschrittliche KI-Hardwarelösungen wie die Quadro RTX 8000 NVIDIA und RTX-basierte Server. Diese Technologien machen KI-Implementierungen einfacher und skalierbarer.

Die von Ihnen gewählte KI-Hardware stellt nicht nur Rechenleistung für KI-Anwendungen bereit, sondern beeinflusst Ihre Lösung auch in Bezug auf Modellperformance, Anforderungen an die Modellkonvertierung, Flexibilität bei der Implementierung und Gesamtgenauigkeit. Sobald KI-Modelle trainiert und getestet sind, werden sie oft in ein Format konvertiert, das auf den gewählten Deployment-Plattformen ausgeführt werden kann.

Die Konvertierung von Modellen kann jedoch zu Genauigkeitsverlusten führen und muss daher im Voraus bedacht werden. Integrationstools wie ONNX (Open Neural Network Exchange) können ein standardisiertes Format für den Einsatz von KI-Modellen auf einer Vielzahl von Hardware-Plattformen bereitstellen. Dies ist auch der Grund dafür, dass beliebte Modelle wie YOLOv8 den Nutzern die Möglichkeit bieten, ihre individuell trainierten Modelle in vielen verschiedenen Formaten zu exportieren, um mehrere Einsatzmöglichkeiten zu bieten.

Die Auswirkungen der fortschrittlichen KI-Rechenleistung beschränken sich nicht nur auf KI, sondern betreffen auch den Energiesektor.

So wurde beispielsweise Metas LLaMA-3, ein fortschrittliches großes Sprachmodell (LLM), mit zwei speziell angefertigten Rechenzentrums-Clustern trainiert, die jeweils mit 24.576 Nvidia H100-GPUs ausgestattet waren. Durch dieses robuste Hardware-Setup konnte Meta die Verarbeitungsgeschwindigkeit erhöhen und den Energieverbrauch um 40 % senken. Die Fortschritte bei der KI-Hardware tragen also auch zu einem energieeffizienteren Betrieb bei.

Darüber hinaus erhält die Verbindung zwischen KI und Energie durch Menschen wie Sam Altman, der sich hier engagiert, immer mehr Aufmerksamkeit. Altman, der als CEO von OpenAI bekannt ist, hat kürzlich das Kernenergieunternehmen Oklo der Öffentlichkeit zugänglich gemacht. Oklo zielt mit seiner innovativen Kernspaltungstechnologie darauf ab, die Energieerzeugung zu transformieren und möglicherweise die für den KI-Betrieb erforderlichen Rechenzentren mit Strom zu versorgen. In den letzten Jahren haben sowohl Bill Gates, Mitbegründer von Microsoft, als auch Jeff Bezos, Gründer von Amazon, in Kernkraftwerke investiert.

Mit Blick auf die Zukunft steht die Zukunft der KI-Hardware vor großen Sprüngen, insbesondere mit dem Aufstieg des Quantencomputings. Experten prognostizieren, dass der Markt für Quantencomputing bis 2030 fast 65 Milliarden Dollar wert sein könnte. Da KI-Modelle immer komplexer werden, wird spezialisierte Hardware entscheidend, um ihr volles Potenzial auszuschöpfen. Von KI-spezifischen Chips bis hin zu Quantencomputing-Explorationen treibt die Hardware-Innovation die Entwicklung komplexerer und wirkungsvollerer KI-Lösungen voran.

Besuchen Sie unser GitHub-Repository und tauschen Sie sich mit unserer Community aus, um mehr über KI zu erfahren. Entdecken Sie unsere neuesten Blogbeiträge, um zu sehen, wie KI in verschiedenen Bereichen wie Formel-1-Rennen und Robotik eingesetzt wird.

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens