使用最佳目标detect模型构建更智能的iOS应用。了解哪些模型能在iPhone和iPad等iOS设备上提供快速、准确的实时性能。

使用最佳目标detect模型构建更智能的iOS应用。了解哪些模型能在iPhone和iPad等iOS设备上提供快速、准确的实时性能。

Android设备和iPhone已成为日常必需品。人们全天候使用它们进行购物、导航、拍照、扫描产品以及与应用互动。

随着人工智能的快速发展,许多智能手机现在都包含能够理解设备摄像头捕获的图像和视频的功能。高效运行这些功能的能力在很大程度上取决于底层硬件。

例如,在苹果生态系统中,iPhone、iPad 和 Mac 等设备均由 Apple Silicon 芯片(包括 A 系列和 M 系列)提供支持。这些片上系统 (SoC) 设计集成了中央处理器 (CPU)、图形处理器 (GPU) 和专用的机器学习加速器,从而实现了 AI 工作负载的设备端推理。

具体而言,图像分析能力通过 计算机视觉 得以实现。计算机视觉是人工智能的一个领域,它使机器能够通过 object detection 等任务解释和理解图像和视频中的视觉信息。

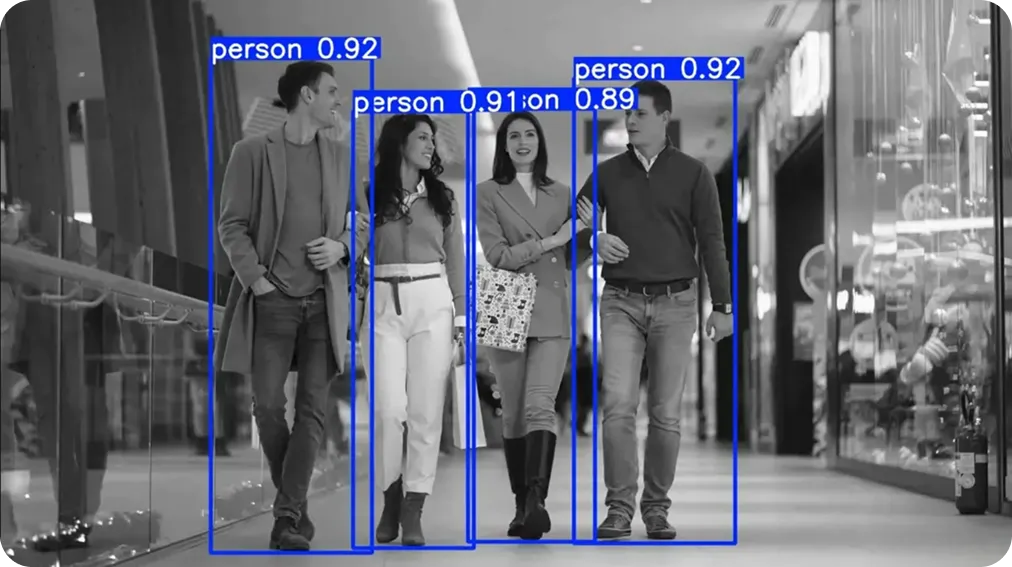

具体来说,目标 detect 模型通过在图像中绘制边界框来分析图像并识别物体。这些模型可以优化,以在移动硬件(例如 Apple Silicon 芯片)上高效运行,从而在 iOS 设备上直接实现实时设备端视觉分析。

在本文中,我们将探讨一些用于构建快速、实时 iOS 应用程序的最佳 object detection 模型。让我们开始吧!

object detection 帮助应用程序识别和定位图像中的对象。当应用程序处理输入图像时,object detection 模型可以分析场景,并通过在对象周围放置边界框并分配标签来识别不同的对象。

大多数 object detection 系统依赖于能够识别训练数据中模式的神经网络。对于图像任务,这些模型通过分析大型训练数据集中的像素级信息来学习视觉表示。

卷积神经网络 (CNN) 通常用作 object detection 模型的主干网络。CNN 非常适合图像预测,因为它们学习分层的视觉特征,例如边缘、形状和纹理,这有助于模型识别场景中的对象。

研究人员还在探索用于计算机视觉任务的基于 Transformer 的架构。这些模型分析图像不同区域之间的关系,并捕获整个场景中更广泛的上下文信息。

除了模型架构类型之外,效率是 iOS 设备上 object detection 的一个关键考虑因素。由于这些模型直接在移动设备上运行,因此它们必须在有限的计算资源下快速处理图像。

高效模型保持低延迟,并支持移动应用程序中的实时 object detection,尤其是在分析连续摄像头输入时。

在深入探讨一些最佳的 iOS object detection 模型之前,让我们退一步,了解是什么让一个模型非常适合移动应用程序。

适用于 iOS 应用的理想目标 detect 模型需要在性能、效率和可靠性之间取得平衡。以下是定义适用于 iOS 部署的强大模型的一些关键因素:

接下来,让我们看看一些最广泛用于 iOS 设备的 object detection 模型。

Ultralytics YOLO模型是一系列流行的目标detect模型,专为实时计算机视觉应用设计。多年来,Ultralytics发布了诸如Ultralytics YOLOv5、Ultralytics YOLOv8、Ultralytics YOLO11以及最新的最先进模型Ultralytics YOLO26等视觉模型。

每一个新版本都带来了 detect 准确性、模型效率和运行时性能的改进。这些更新使得 Ultralytics YOLO 模型越来越适合智能手机等边缘设备。

将 Ultralytics YOLO 模型用于 iOS 应用程序的关键优势之一是,通过 Ultralytics python 包 提供的 CoreML 集成。这个开源库帮助开发人员通过简单的工作流程训练、测试和导出 Ultralytics YOLO 模型。

该软件包支持将训练好的模型导出到 CoreML,这是 Apple 用于在 iOS 设备上部署模型的机器学习格式。导出后,CoreML 模型可以集成到应用程序中,并利用 CPU、GPU 和 Apple 神经网络引擎等硬件直接在设备上运行。

这使得开发者能够轻松地将实时目标检测集成到 iOS 应用中,同时保持模型在设备端进行推理。

除了模型本身之外,Ultralytics 生态系统还提供了一系列选项,使在 Apple Silicon 芯片上部署 YOLO 模型变得更加容易。

例如,Ultralytics 最近推出了 Ultralytics Platform,它将数据集管理、模型训练、验证和部署整合到一个环境中。这种统一的工作流程减少了对多种工具的需求,并有助于简化从实验到实际应用的路径。

作为平台的一部分,训练模型可以导出为多种格式,包括适用于 Apple 设备的 CoreML。这使得只需点击几下即可导出 Ultralytics YOLO 模型,用于设备端推理。

除了导出功能,Ultralytics 还为 iOS 提供了开源 Swift(Apple 用于构建 iOS 应用的编程语言)实现。其中包括一个用 Swift 编写的即用型 YOLO iOS 应用,演示了 CoreML 模型如何集成、在相机输入上运行以及用于实时目标检测。

以下是使 Ultralytics YOLO 模型成为构建 iOS 应用的绝佳选择的一些其他主要特点:

EfficientDet 是 Google 研究人员在 2019 年推出的一种目标检测架构。它旨在平衡检测精度和计算效率,使其适用于资源有限的环境。

EfficientDet背后的一个关键思想是一种称为复合缩放(compound scaling)的缩放方法。这种方法不是只增加模型的一个部分,例如网络深度或图像分辨率,而是同时缩放架构的多个组件。

通过同时调整这些元素,无论模型是配置为高精度还是优化为轻量级部署,都能保持稳定的性能。

该架构有多种变体,从EfficientDet-D0到EfficientDet-D7。较小的模型旨在实现更快的推理速度和更低的资源消耗,而较大的版本则侧重于实现更高的检测精度。

MobileNet SSD 是一种轻量级目标检测模型,旨在在移动和边缘设备上高效运行。它在 2017 年左右流行起来。

该模型结合了专注于高效特征提取的MobileNet骨干网络,以及用于detect物体的SSD(单次检测器)方法。SSD方法在单次前向传播中detect物体并生成边界框。

这种设计使模型保持相对快速和简单,这对于需要快速 detect 结果的应用非常有用。MobileNet SSD 通常用于模型尺寸较小和推理速度较快的场景。

MobileNet架构减少了所需的计算量,使其更容易在处理能力有限的设备上运行模型。尽管MobileNet SSD可能无法达到一些新型检测架构的精度水平,但它在许多常见的物体detect任务中仍然表现良好。

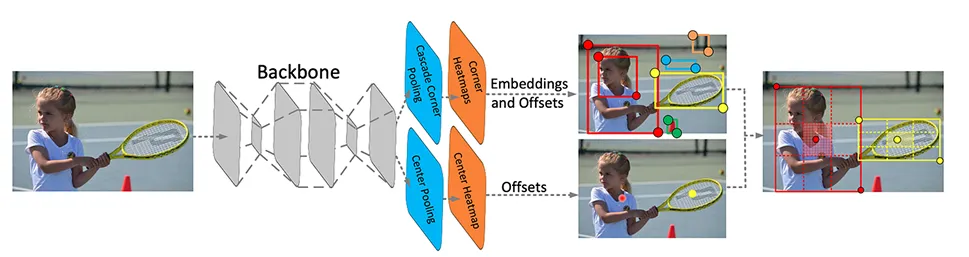

CenterNet 是一种目标检测模型,通过预测物体的中心点来识别物体。它于 2019 年推出。

该模型不生成大量候选区域,而是 detect 物体的中心,然后预测其周围边界框的大小。这种方法简化了检测流程,并减少了推理过程中涉及的步骤。

CenterNet 可用于实时检测任务,与一些多阶段检测器相比,它以其相对简单的架构而闻名。带有 ResNet 主干网络的 CenterNet 变体常用于不同的计算机视觉应用。

其高效设计使 CenterNet 适用于需要快速目标检测的系统,包括在 iOS 设备上运行的应用。

NanoDet 是一种轻量级目标检测模型,专为边缘和移动设备上的实时应用而设计。它于 2020 年推出,旨在提供高效的目标检测,同时保持模型尺寸和计算要求非常低。

该模型采用单阶段检测架构,使其能够在网络单次前向传播中预测物体位置和类别。这种设计使模型速度快,适用于硬件资源有限的系统。

NanoDet 采用紧凑的主干网络和优化的检测头,以减少推理过程中所需的参数和计算量。这些设计选择有助于保持合理的检测精度,同时优先考虑速度和效率。

为 iOS 应用选择物体 detect 模型通常取决于用例的具体要求。由于这些模型直接在 iPhone 和 iPad 等设备上运行,有几个因素会影响哪种选项最有效。

以下是一些重要考量:

目标检测模型为智能移动应用带来了先进的计算机视觉能力。这些模型直接在 iOS 设备上运行,使应用能够实时分析来自设备摄像头的图像和视频。通过选择合适的模型,开发者可以构建响应迅速、视觉驱动的移动应用,提供可靠的实时性能。

加入我们不断壮大的社区,并浏览我们的GitHub 仓库以获取实践 AI 资源。立即开始使用视觉 AI 进行构建,请查看我们的许可选项。访问我们的解决方案页面,了解AI 在农业中的应用如何改变农业,以及机器人视觉 AI 如何塑造未来。

开启您的机器学习未来之旅