了解在Ultralytics 何时应选择专用推理端点,以实现比共享推理更具可扩展性且延迟更低的视觉 AI 部署。

了解在Ultralytics 何时应选择专用推理端点,以实现比共享推理更具可扩展性且延迟更低的视觉 AI 部署。

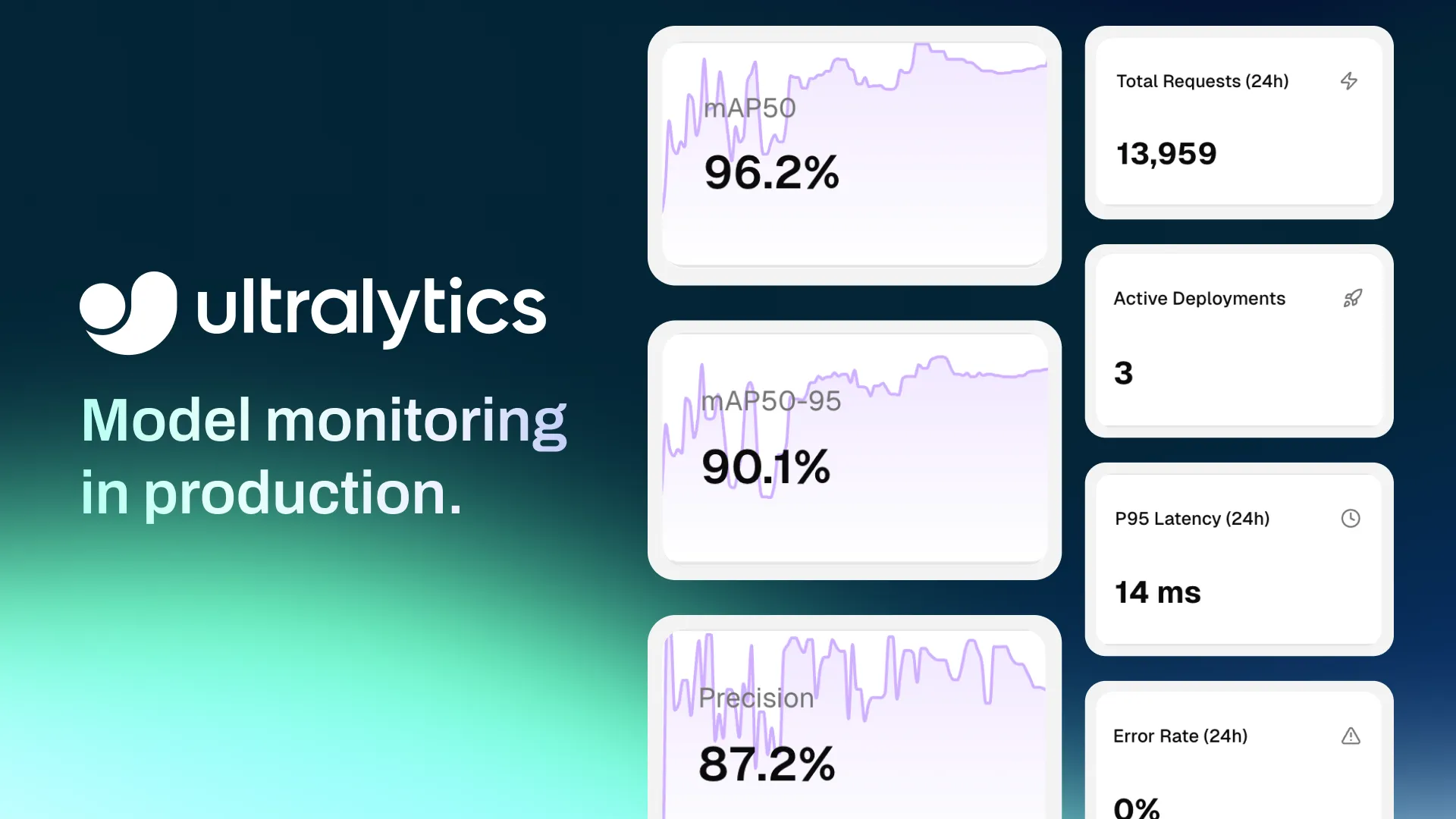

最近,我们推出了Ultralytics ,这是一个端到端的解决方案,将整个计算机视觉工作流整合到一个平台中,涵盖从数据集准备、模型训练到推理、部署和监控的各个环节。

该平台基于计算机视觉领域的反馈构建而成,旨在通过提供支持视觉人工智能应用全生命周期的集成功能,简化开发过程的每个阶段。

例如,模型训练完成后,下一步就是将其部署,以便在实际应用中运行推理并进行预测。该平台提供了多种部署选项,使这一过程变得简单明了。

您可以将模型导出以便在自己的环境中运行,使用共享推理功能进行快速测试,或部署专用端点以构建可扩展且适合生产环境的应用程序。这些部署选项均可用于运行 AI 推理,但它们针对不同的阶段和用例而设计。

模型导出功能让您能够完全掌控在自有基础设施上运行模型;共享推理功能让您无需配置即可轻松进行测试和实验;而专用端点则专为可靠的大规模生产工作负载而设计。

乍一看,共享推理和专用端点似乎非常相似。两者都允许您向模型发送 API 请求并接收结构化预测结果,从而轻松将视觉 AI 集成到应用程序中。

然而,随着工作负载的增加以及计算机视觉应用开始处理实时推理请求,这些选项之间的差异就变得愈发重要。在本文中,我们将深入探讨共享推理与专用端点的区别、它们的对比情况、何时使用哪种方案,以及为何随着应用程序的扩展,专用端点会成为更优的选择。

共享推理是一种简便的方式,可让您在无需搭建任何基础设施、也无需担心GPU 、框架集成或运行时配置的情况下,直接对模型进行 AI 推理。一旦模型完成训练或微调,您即可通过该平台直接使用它进行预测。

在此配置中,您的模型将在覆盖美国、欧洲和亚太等几个核心区域的共享多租户计算资源上运行。请求会自动路由到可用的服务,因此您无需配置GPU 或运行时环境。所有操作均由系统自动处理,让您轻松上手。

使用共享推理时,REST API Python CLI 等工具REST API 向模型发送请求,并接收结构化的 JSON 输出,例如检测到的物体、置信度评分以及其他预测详情。这使得测试模型并将其集成到应用程序中变得非常顺畅。

由于该系统为共享系统,因此主要面向开发、测试及轻量级使用场景。它非常适合用于验证预测结果和构建早期集成。同时,系统性能可能会因负载情况而有所波动,且每个 API 密钥的请求速率限制为每分钟 20 次,因此不太适合高吞吐量的生产环境工作负载。

总体而言,共享推理最适合用于开发初期,此时的重点在于理解和改进模型,之后再转向更大规模的应用。

专用端点是单租户推理服务,您的视觉 AI 模型将在隔离的计算资源上运行。每个端点都有独立的运行时环境,配备可配置的资源(如CPU 内存),无需共享基础设施,从而让您能够更好地掌控性能。

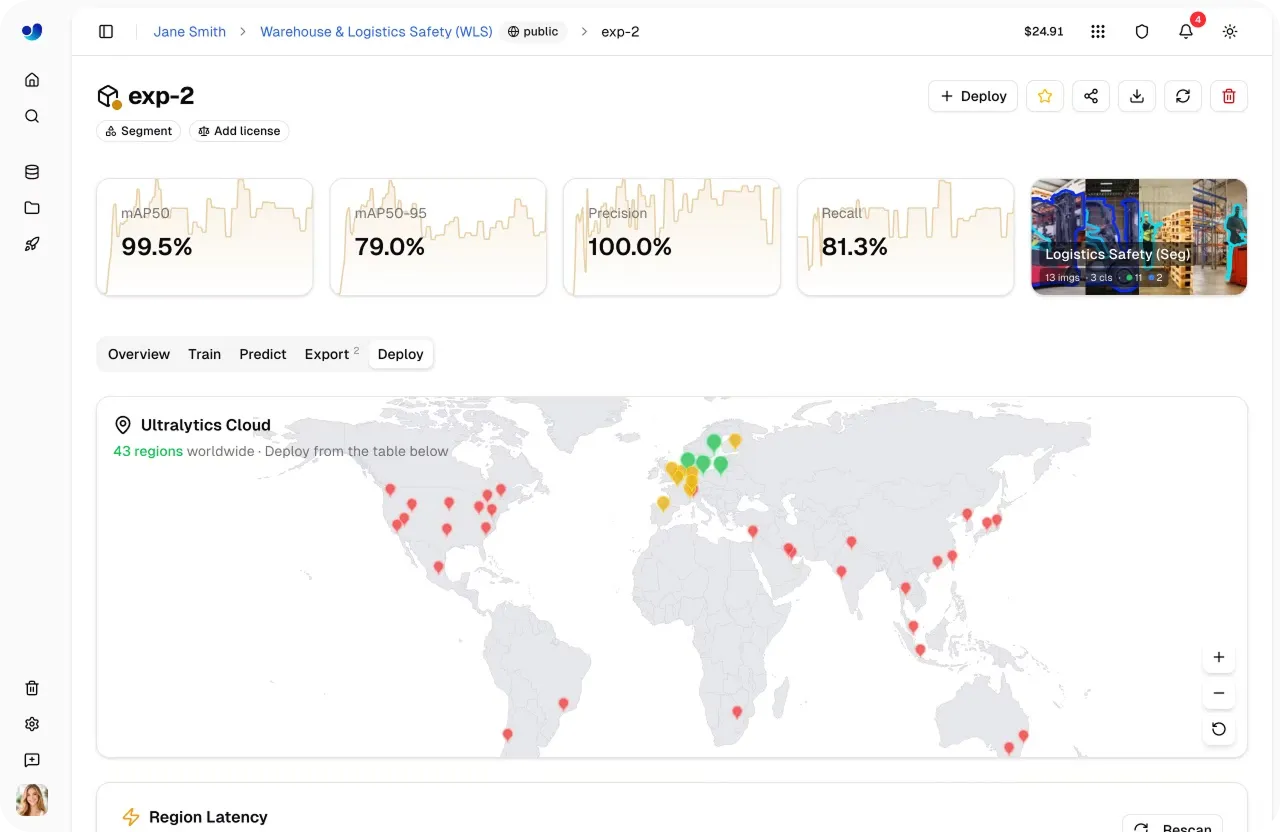

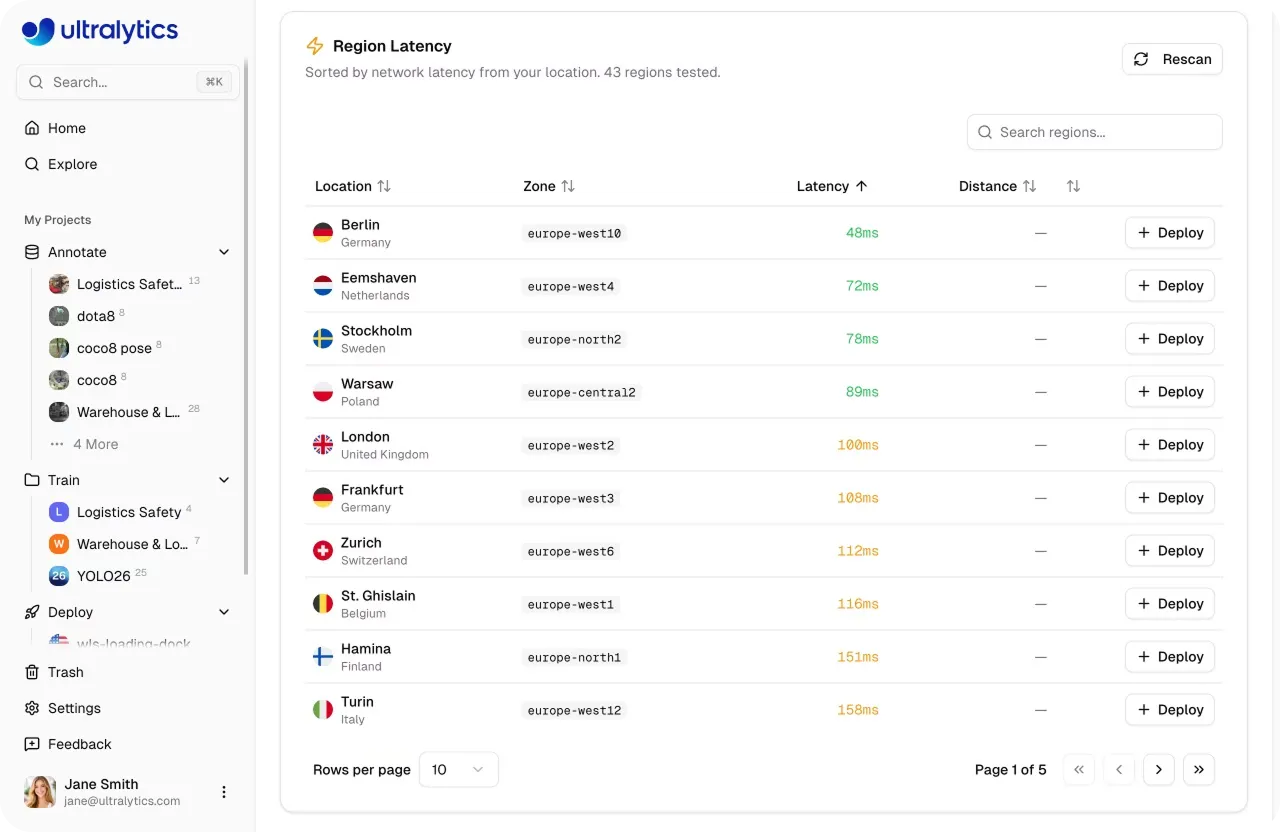

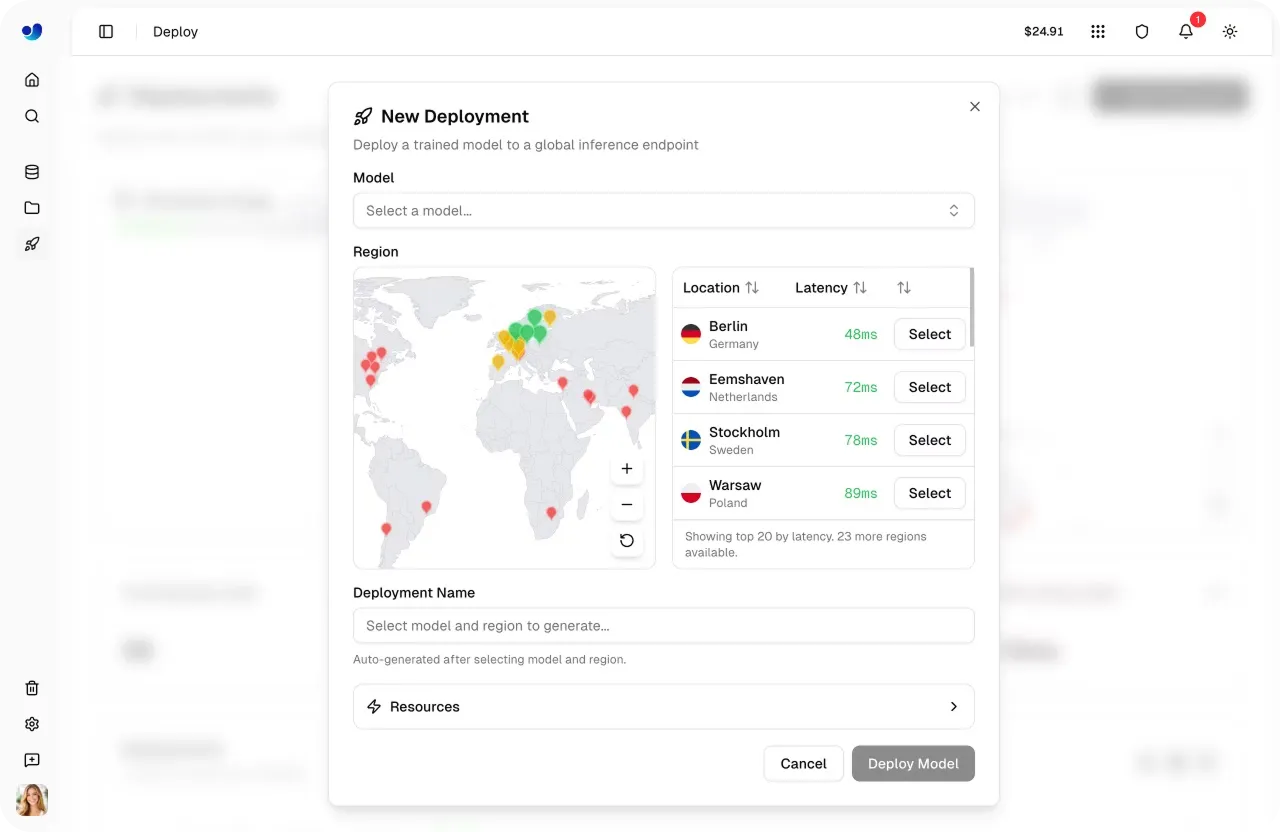

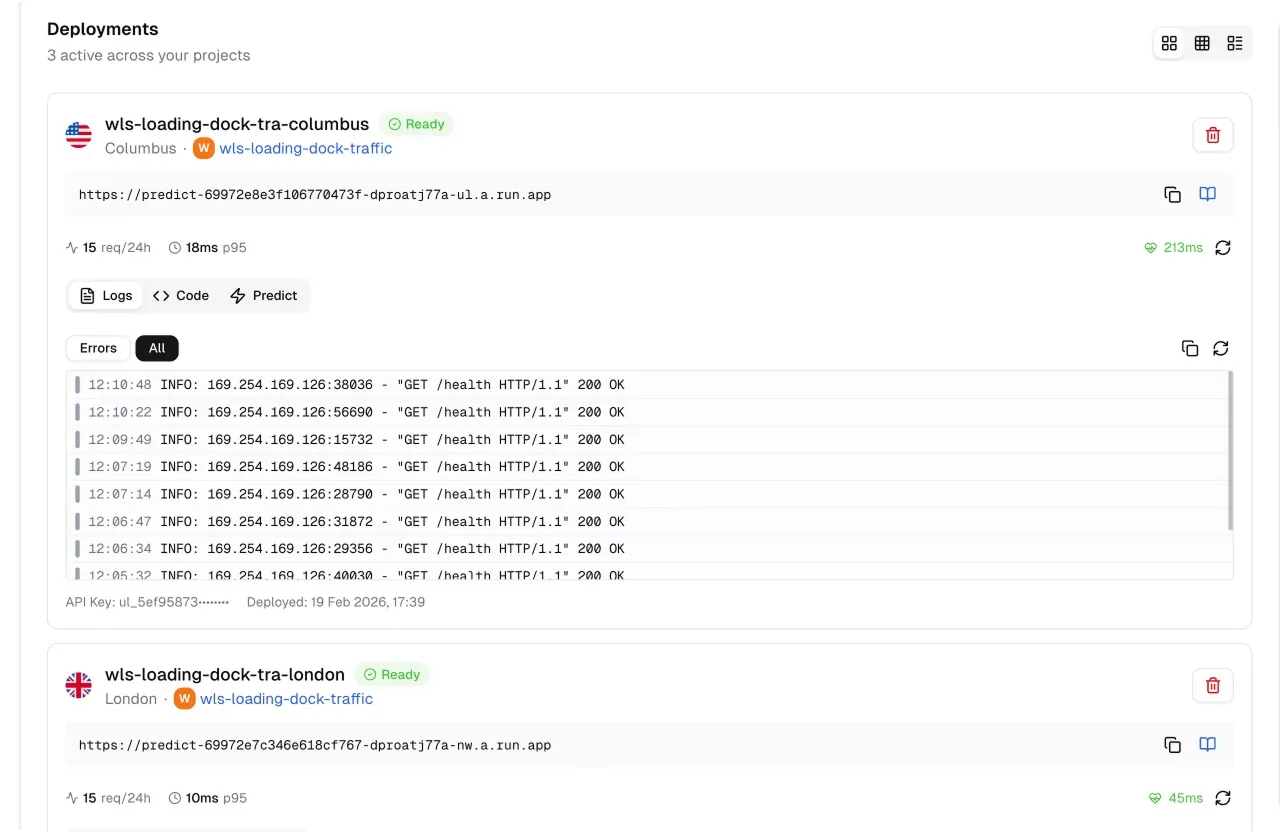

将模型部署为专用端点时,系统会为其分配一个唯一的 API URL,并使用您的 API 密钥进行身份验证,从而便于将其集成到应用程序中。这些端点可部署在43 个全球区域中,使您能够在更接近用户的位置运行推理,从而降低延迟。

其关键优势之一是自动扩展。端点会根据传入的请求自动调整,在流量增加时扩展以应对更高负载,在需求下降时缩减规模。由于默认启用了“缩减至零”功能,端点在空闲时会自动关闭,并在需要时重新启动,从而帮助优化资源利用率。

换句话说,专用端点专为生产环境的工作负载而设计。与共享推理相比,它们能提供更稳定的低延迟、更高的吞吐量以及更强的可靠性。

此外,专用端点没有速率限制。请求会直接发送到您的端点,因此您能处理的流量大小取决于您的配置和扩展情况,而非固定的限制。

此外,内置的监控、日志、健康检查以及可预测的运行时和启动行为,使得在所有套餐中都能轻松track 并保持部署的稳定性。在免费套餐中,冷启动通常需要 5 到 45 秒;而在 Pro 套餐中,端点始终保持预热状态,从而带来更快且更可预测的推理性能。

简而言之,专用终端设备非常适合需要可靠、可扩展且高性能推理的实时视觉人工智能应用。

下面我们将详细对比共享推理与专用端点的差异:

随着人工智能和机器学习应用从测试阶段迈向实际应用,性能、可扩展性和可靠性变得至关重要。正因如此,专用终端设备相较于共享推理方案具有明显的优势。

借助专用端点,您的预训练模型或自定义模型将在独立的计算资源上运行,因此性能不会受到其他用户的影响。这有助于保持低延迟且稳定的性能,这对视频分析和监控系统等实时应用至关重要。

例如,设想一个处理多家门店实时监控视频的零售分析系统。通过在全球 43 个地区部署端点,推断计算可以在更接近各门店的位置运行,从而降低延迟并提升响应速度。

在共享推理环境中,由于资源共享且区域受限,繁忙时段的性能可能会有所波动。

专用端点还能处理更大的流量,并根据需求自动扩展。凭借内置的监控、日志和健康检查功能,它们能提供更可预测的性能,因此非常适合大规模且持续的 AI 工作负载。

在了解共享推理与专用端点的区别时,您可能会好奇:共享推理在整体计算机视觉工作流中扮演着怎样的角色。

让我们再次看看零售分析的例子。在将视觉解决方案部署到多家门店之前,团队通常需要测试其在真实数据上的表现,并根据测试结果对其进行优化。

共享推理功能让这一过程变得简单:您无需搭建基础设施,即可发送来自店内摄像头的样本图像或视频帧,并快速查看预测结果。这对于测试模型行为、排查错误预测以及在不同条件下(例如光线变化或店内布局变化)验证结果尤为有用。

通过这种迭代方式,团队可以在模型投入生产前提高其准确性和可靠性。一旦模型在这些测试场景中表现良好,即可将其部署到专用端点,以便在多个地点进行实时应用。

共享推理在低频或使用频率较低的场景中同样表现出色。例如,一家小型零售店可以利用它来不定期分析客流量,或查看特定时段的顾客活动,而无需进行全面的大规模部署。在这些情况下,它提供了一种简单且经济高效的方式,可按需运行推理任务。

随着人工智能应用的范围超越测试领域,部署方式的选择开始直接影响性能、可扩展性和用户体验。专用端点因能提供稳定的性能、低延迟以及处理大规模工作负载的能力,已在各行各业得到广泛应用。

以下是一些常见的使用场景,展示了专用端点在实际应用中的具体用法:

Ultralytics 的一大核心优势在于,随着应用程序的扩展,您可以非常轻松地从共享推理环境迁移到专用端点。您无需更换工具或重新构建环境,即可在同一环境中直接过渡到生产就绪的部署。

在使用共享推理对模型进行测试后,迁移到专用端点是顺理成章的下一步。您可以将同一模型部署到端点,选择您偏好的区域和计算资源,并在应用程序中更新端点 URL。整体集成流程保持不变,因此发送请求或处理响应的方式几乎无需更改。

这意味着您只需点击几下,即可从测试环境无缝切换到生产环境。随着工作负载的增加或应用程序对性能一致性的要求提高,您可以迁移到专用端点,而不会中断现有工作流程。

如需进一步了解如何在Ultralytics 使用专用端点部署模型,请查阅Ultralytics 官方文档。

共享推理是进行测试和实验的绝佳起点,但生产环境的工作负载需要更高的一致性和可扩展性。随着应用程序的扩展,专用端点能够提供支持实际应用所需的性能和可靠性。这使得它们成为大多数生产部署的最佳选择。

加入我们的社区,浏览我们的GitHub 代码库,深入了解计算机视觉模型。您可以在我们的解决方案页面上阅读关于农业人工智能和 机器人领域计算机视觉等应用的介绍。查看我们的授权方案,立即开始使用视觉人工智能。

开启您的机器学习未来之旅