Begleiten Sie uns, während wir uns genauer ansehen, was Instanzsegmentierung ist, wie sie funktioniert, wie sie in verschiedenen Anwendungen der Computer Vision eingesetzt wird und welche Auswirkungen sie haben kann.

Begleiten Sie uns, während wir uns genauer ansehen, was Instanzsegmentierung ist, wie sie funktioniert, wie sie in verschiedenen Anwendungen der Computer Vision eingesetzt wird und welche Auswirkungen sie haben kann.

Computer-Vision-Anwendungen werden in unserem täglichen Leben immer häufiger, von Verkehrskameras, die die Straßenverhältnisse überwachen, bis hin zu Self-Checkout-Systemen in Geschäften. Indem sie es Maschinen ermöglichen, visuelle Daten ähnlich wie Menschen zu verstehen, leistet Vision AI einen Beitrag in einer Reihe von Branchen.

Viele dieser Anwendungen basieren auf Objekterkennung, einer Computer-Vision-Aufgabe, die Begrenzungsrahmen um wichtige Objekte in Bildern platziert. Obwohl dieser Ansatz oft gut funktioniert, benötigen einige Bildanalyselösungen eine noch höhere Präzision.

Zum Beispiel erfordert die medizinische Bildgebung mehr als nur die Erkennung eines Tumors – es ist entscheidend, seine genaue Form zu umreißen. In ähnlicher Weise müssen Maschinen in der Robotik die genauen Konturen eines Objekts erkennen, um es richtig zu greifen. Um diese Herausforderungen zu bewältigen, bietet die Instanzsegmentierung eine präzisere Lösung.

Die Segmentierung von Instanzen ist eine Aufgabe der Computer Vision, die für Anwendungsfälle entwickelt wurde, in denen die Erkennung von Objekten nicht ausreicht - sie bietet Genauigkeit auf Pixelebene. Computer-Vision-Modelle wie Ultralytics YOLO11 können verwendet werden, um die Instanzsegmentierung einfach auf Bilder und Videos anzuwenden.

In diesem Leitfaden erläutern wir, wie die Instanzsegmentierung funktioniert, welche Anwendungen es gibt und wie Ultralytics YOLO11 für bestimmte Segmentierungsaufgaben individuell trainiert werden kann.

Nehmen wir an, es gibt ein Gruppenfoto von Personen, die eng beieinander stehen. Die Objekterkennung kann helfen, Kästchen um jede Person zu zeichnen, aber das sagt Ihnen nicht ihre genaue Form.

Instanzsegmentierung hingegen ist vergleichbar mit dem sorgfältigen Nachzeichnen jeder Person, sodass Sie ihre vollständige Kontur sehen können, selbst wenn sie sich überschneiden. Anstatt nur mit einem Kästchen zu markieren, wo sich etwas befindet, identifiziert sie die genaue Form jedes Objekts auf Pixelebene, was es einfacher macht, komplexe Bilder zu verstehen.

Das Ergebnis ist eine detaillierte Maske, die die Form eines Objekts ausfüllt und genau festlegt, welche Pixel zu ihm gehören. Dieses Maß an Präzision ist in vielen realen Anwendungen nützlich, in denen es wichtig ist, die genaue Form und die Grenzen von Objekten zu verstehen.

Beim Erkunden der Instanzsegmentierung stößt man möglicherweise auf das Konzept der semantischen Segmentierung.

Beide Techniken helfen Computern, Bilder auf Pixelebene zu verstehen, dienen aber unterschiedlichen Zwecken. Die semantische Segmentierung kennzeichnet jedes Pixel anhand seiner Kategorie und gruppiert alle Objekte desselben Typs zusammen. In einem Bild mit mehreren Autos würde die semantische Segmentierung beispielsweise alle als "Auto" markieren, ohne zwischen einzelnen Fahrzeugen zu unterscheiden.

Die Instanzsegmentierung geht hingegen noch einen Schritt weiter, indem sie jedes Objekt separat identifiziert. Sie weist einzelnen Instanzen eindeutige Bezeichnungen zu und erstellt präzise Masken um ihre Formen. Im selben Bild würde die Instanzsegmentierung also nicht nur alles als "Auto" bezeichnen, sondern jedes Auto einzeln erkennen und umreißen.

Der Hauptunterschied zwischen den beiden besteht darin, dass die semantische Segmentierung Objekte nach Kategorie gruppiert, während die Instanzsegmentierung jedes Objekt als eine eindeutige Entität mit klaren Grenzen unterscheidet. Die Wahl der zu verwendenden Aufgabe hängt von der jeweiligen Anwendung ab - ob es ausreicht zu wissen, was sich in einem Bild befindet, oder ob es wichtig ist, zwischen einzelnen Objekten zu unterscheiden.

Heutzutage stehen der Vision-AI-Community verschiedene Modelle für die Instanzsegmentierung zur Verfügung. Einige sind schneller, andere genauer und wieder andere einfacher zu bedienen.

Diese Optionen sind zwar nützlich, können aber auch zu der Frage führen, welche die richtige für eine bestimmte Aufgabe ist. Unter den Optionen sind dieYOLO Ultralytics recht beliebt, da sie sich auf Geschwindigkeit und Genauigkeit konzentrieren.

Außerdem haben sich diese Modelle im Laufe der Jahre erheblich weiterentwickelt. Zum Beispiel, Ultralytics YOLOv5 die Bereitstellung mithilfe von Frameworks wie PyTorch vereinfacht und fortschrittliche Vision AI einem breiteren Publikum zugänglich gemacht, ohne dass tiefgreifende technische Kenntnisse erforderlich sind.

Auf diesem Erfolg aufbauend, Ultralytics YOLOv8 erweiterte Unterstützung für Computer-Vision-Aufgaben wie Instanzsegmentierung, Posenschätzung und Bildklassifizierung.

Jetzt hebt YOLO11 die Leistung auf ein neues Niveau. Es erreicht eine höhere durchschnittliche GenauigkeitmAP) auf dem COCO mit 22 % weniger Parametern als YOLOv8m, d. h. es kann Objekte präziser erkennen und verbraucht dabei weniger Ressourcen.

Einfach ausgedrückt: YOLO11 bietet modernste Genauigkeit ohne Kompromisse bei der Effizienz und ist damit ein entscheidender Faktor für den Einsatz in der Praxis.

Als Nächstes wollen wir untersuchen, wie die Instanzsegmentierung typischerweise funktioniert. Ältere Computer-Vision-Modelle verwenden einen zweistufigen Ansatz.

Zunächst detect sie Objekte, indem sie Bounding Boxes um sie herum zeichnen. Dann erzeugen sie eine Maske auf Pixelebene, um die genaue Form jedes Objekts zu umreißen. Ein bekanntes Beispiel ist Mask R-CNN, das auf Objekterkennungsmodellen aufbaut, indem es einen Maskenvorhersageschritt hinzufügt. Diese Methode ist zwar effektiv, kann aber langsam sein, da sie das Bild in mehreren Schritten verarbeitet, was Echtzeitanwendungen erschwert.

In der Zwischenzeit verarbeiten Modelle wie YOLO11 Bilder in einem Durchgang und sagen gleichzeitig Objektbegrenzungsrahmen und Instanzsegmentierungsmasken voraus. Dieser rationalisierte Ansatz macht sie viel schneller, während die hohe Genauigkeit erhalten bleibt. Daher ist es besonders nützlich für Echtzeitanwendungen wie autonomes Fahren, Videoanalyse und Robotik, bei denen sowohl Geschwindigkeit als auch Präzision entscheidend sind.

YOLO11 wird als vortrainiertes Modell ausgeliefert. Es wurde mit dem COCO trainiert, der Alltagsobjekte für die Segmentierung von Beispielen abdeckt. Das Ultralytics Python unterstützt jedoch benutzerdefiniertes Training, das für spezielle Anwendungen, bei denen einzigartige Objekte segmentiert werden müssen, unerlässlich ist.

Warum ist benutzerdefiniertes Training oder Feinabstimmung eines Modells wichtig? Benutzerdefiniertes Training nutzt Transfer Learning, indem es auf dem Wissen aufbaut, das bereits in vortrainierten Modellen enthalten ist. Anstatt von Grund auf neu zu beginnen, passt es ein bestehendes Modell mit kleineren Datensätzen und weniger Rechenressourcen an neue Aufgaben an, und das alles bei gleichbleibend hoher Genauigkeit.

Hier ein genauerer Blick auf die Schritte, die zur Feinabstimmung von YOLO11 für die Segmentierung erforderlich sind:

Instanzsegmentierung kann zur Lösung realer Herausforderungen eingesetzt werden, indem sie Maschinen hilft, Objekte genauer zu sehen und zu verstehen. Von der Verbesserung der Automatisierung bis zum Schutz der Umwelt spielt sie in vielen Bereichen eine Schlüsselrolle. Lassen Sie uns einige Beispiele dafür durchgehen, wo sie Wirkung zeigt.

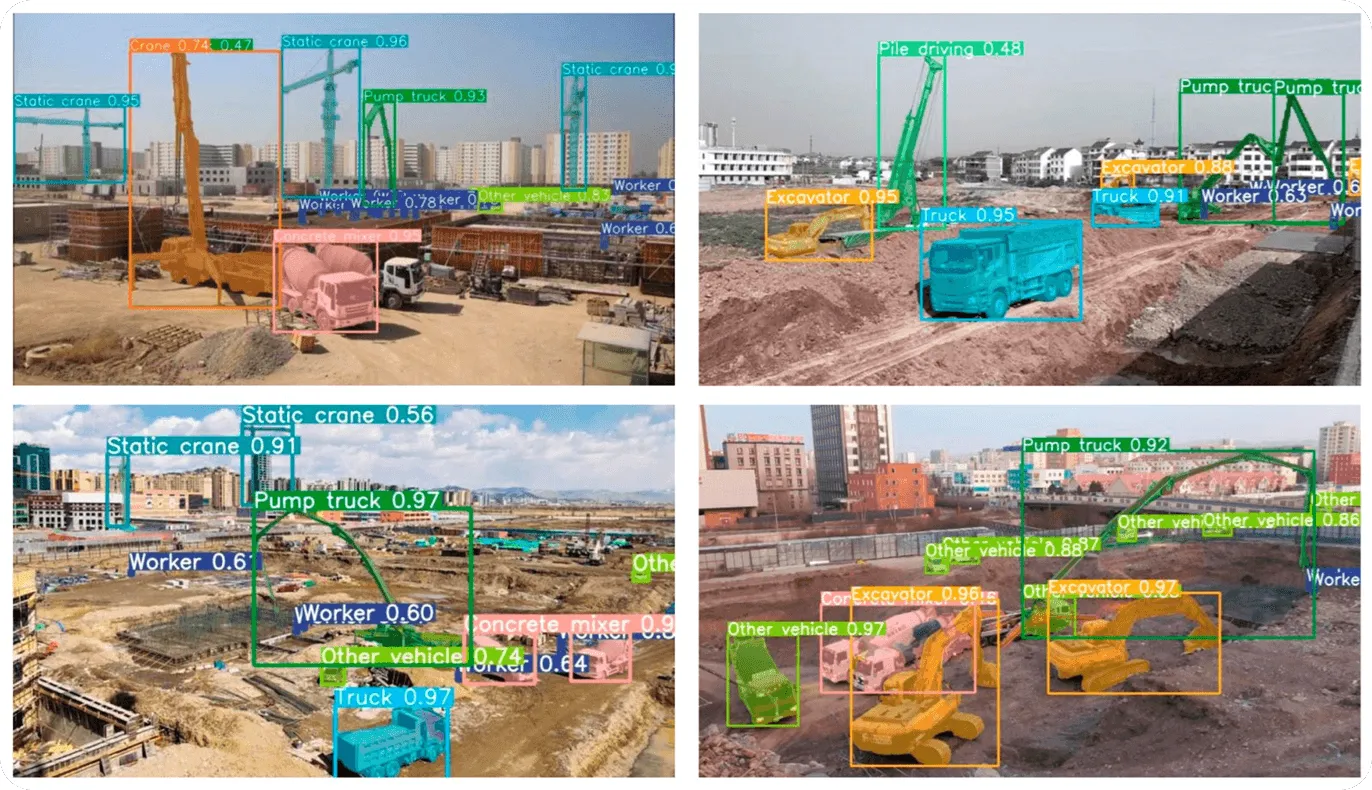

Die Instanzsegmentierung kann ein entscheidender Faktor für die Gewährleistung von Sicherheit und Effizienz auf Baustellen sein. Sie kann beispielsweise zur Überwachung schwerer Maschinen eingesetzt werden.

YOLO11 kann so eingestellt werden, dass es verschiedene Gerätetypen wie Kräne, Bagger und Planierraupen genau segment und identifiziert und ihre Positionen in Echtzeit track . So können die Bauleiter sicherstellen, dass die Maschinen nur in den dafür vorgesehenen Bereichen arbeiten und nicht in Bereiche eindringen, in denen sich Arbeiter aufhalten oder Gefahren bestehen.

Darüber hinaus ermöglicht die Integration solcher Lösungen in Echtzeit-Alarmsysteme die Einleitung schneller Korrekturmaßnahmen. Abgesehen davon können die gewonnenen Erkenntnisse zur Optimierung des Baustellenlayouts und des Arbeitsablaufs beitragen, wodurch Risiken weiter reduziert und die Produktivität gesteigert werden.

Die Überwachung des Tierverhaltens hilft Forschern, Landwirten und Naturschützern, sich besser um Tiere in verschiedenen Umgebungen zu kümmern. Die Instanzsegmentierung spielt in diesen Systemen eine hilfreiche Rolle, indem sie einzelne Tiere in landwirtschaftlichen Betrieben, Zoos und natürlichen Lebensräumen identifiziert und segmentiert. Im Gegensatz zur traditionellen Objekterkennung, die Begrenzungsrahmen verwendet, bietet die Instanzsegmentierung eine pixelgenaue Abgrenzung jedes Tieres, was besonders nützlich ist, wenn sich Tiere in unmittelbarer Nähe befinden.

Die detaillierte Segmentierung ermöglicht eine genauere Verfolgung von Bewegungen und Verhaltensweisen. Sich überlappende oder eng beieinander liegende Tiere können eindeutig erkannt werden, was eine präzisere Analyse von Interaktionen, Gesundheitsbewertungen und Aktivitätsmustern ermöglicht. Insgesamt verbessern tiefere Einblicke in das Tierverhalten die Tierpflege- und Managementpraktiken.

Die genaue Verfolgung von Spielern und Ereignissen ist ein wichtiger Bestandteil der Sportanalyse. Herkömmliche Nachverfolgungsmethoden beruhen auf manueller Markierung, die möglicherweise keine detaillierten Interaktionen erfasst. Mithilfe von Computer Vision können Details wie Spieler, Bälle und Schlüsselereignisse auf Pixelebene segment werden, um detaillierte Einblicke zu erhalten.

Beispielsweise kann die Segmentierung von Instanzen helfen, Ereignisse wie Fouls oder Vorfälle außerhalb des Balls detect , indem die einzelnen Spieler und Objekte klar voneinander getrennt werden. Diese granulare Überwachung, die durch Modelle wie YOLO11 ermöglicht wird, bietet Analysten klarere Informationen, um Bewegungsmuster, räumliche Positionierung und Interaktionen mit hoher Genauigkeit zu untersuchen. Ein wesentlicher Vorteil dieser Erkenntnisse besteht darin, dass sie den Teams helfen, ihre Strategien zu verfeinern und die Gesamtleistung zu steigern.

Hier sind einige der wichtigsten Vorteile, die die Instanzsegmentierung für verschiedene Branchen mit sich bringen kann:

Während diese Vorteile verdeutlichen, wie sich die Instanzsegmentierung auf verschiedene Anwendungsfälle auswirkt, ist es auch wichtig, die Herausforderungen zu berücksichtigen, die mit ihrer Implementierung verbunden sind.

Hier sind einige der wichtigsten Einschränkungen der Instanzsegmentierung:

Instanzsegmentierung ermöglicht es, einzelne Objekte präzise zu unterscheiden, selbst wenn sie sich überlappen. Durch die Erfassung von Objektgrenzen auf Pixelebene bietet sie ein tieferes Verständnis visueller Daten im Vergleich zu traditionellen Computer-Vision-Aufgaben wie der Objekterkennung.

Die jüngsten Fortschritte in der Computer Vision haben die Segmentierung von Instanzen schneller und einfacher gemacht. Insbesondere Computer-Vision-Modelle wie Ultralytics YOLO11 vereinfachen den Prozess und ermöglichen eine Echtzeit-Segmentierung mit minimaler Einrichtung, was sie für verschiedene Branchen und Anwendungen zugänglicher macht.

Neugierig auf KI? Besuchen Sie unser GitHub-Repository und treten Sie mit unserer Community in Kontakt, um weiter zu forschen. Erfahren Sie mehr über Innovationen wie KI in selbstfahrenden Autos und Vision AI in der Landwirtschaft auf unseren Lösungsseiten. Sehen Sie sich unsere Lizenzoptionen an und starten Sie ein Computer-Vision-Projekt!

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens