インスタンスセグメンテーションとは何か、その仕組み、さまざまなコンピュータビジョンアプリケーションでの使用法、そしてそれがもたらす影響について詳しく見ていきます。

インスタンスセグメンテーションとは何か、その仕組み、さまざまなコンピュータビジョンアプリケーションでの使用法、そしてそれがもたらす影響について詳しく見ていきます。

コンピュータビジョンアプリケーションは、道路状況を監視する交通カメラから店舗のセルフレジシステムまで、私たちの日常生活でより一般的になっています。マシンが人間と同じように視覚データを理解できるようにすることで、Vision AIはさまざまな業界に影響を与えています。

これらのアプリケーションの多くは、画像内の主要なオブジェクトの周りにバウンディングボックスを配置するコンピュータビジョンタスクである物体検出に依存しています。このアプローチは多くの場合うまく機能しますが、一部の画像分析ソリューションでは、さらに高い精度が必要です。

例えば、医用画像処理では、腫瘍を検出するだけでなく、その正確な形状を概説することが重要です。同様に、ロボット工学では、機械は物体を正しく把握するために、物体の正確な輪郭を認識する必要があります。これらの課題に対処するために、インスタンスセグメンテーションはより正確なソリューションを提供します。

インスタンス・セグメンテーションは、オブジェクトの検出だけでは不十分なユースケースをサポートするために設計されたコンピュータ・ビジョンのタスクである。次のようなコンピュータビジョンモデルがあります。 Ultralytics YOLO11のようなコンピュータビジョンモデルを使用すると、インスタンスセグメンテーションを画像や動画に簡単に適用できる。

このガイドでは、インスタンスセグメンテーションがどのように機能するのか、そのアプリケーション、そしてUltralytics YOLO11 特定のセグメンテーションタスクのためにどのようにカスタムトレーニングすることができるのかを説明します。

例えば、人々が密集して立っているグループ写真があるとします。物体検出は、各人物の周りにボックスを描くのに役立ちますが、正確な形状まではわかりません。

インスタンスセグメンテーションは、重なり合っていても、それぞれの人の輪郭全体が見えるように、各人物を注意深くトレースするのに似ています。何かがどこにあるかをボックスでマークするだけでなく、ピクセルレベルで各オブジェクトの正確な形状を識別するため、複雑な画像を理解しやすくなります。

その結果、オブジェクトの形状を埋める詳細なマスクが作成され、どのピクセルがオブジェクトに属するかを正確に特定します。このレベルの精度は、オブジェクトの正確な形状と境界を理解することが重要な多くの現実世界のアプリケーションで役立ちます。

インスタンスセグメンテーションを検討する際に、セマンティックセグメンテーションの概念に出会うかもしれません。

どちらの手法も、コンピュータがピクセルレベルで画像を理解するのに役立ちますが、目的が異なります。セマンティックセグメンテーションは、カテゴリに基づいてすべてのピクセルにラベルを付け、同じタイプのオブジェクトをすべてグループ化します。たとえば、複数の車が写っている画像では、セマンティックセグメンテーションは個々の車両を区別せずに、それらすべてを「車」としてマークします。

一方、インスタンスセグメンテーションは、各オブジェクトを個別に識別することで、さらに一歩進んでいます。個々のインスタンスに固有のラベルを割り当て、その形状の周りに正確なマスクを作成します。したがって、同じ画像内で、インスタンスセグメンテーションはすべてを「車」としてラベル付けするだけでなく、個々の車を認識してアウトライン表示します。

セマンティックセグメンテーションはオブジェクトをカテゴリー別にグループ化するのに対し、インスタンスセグメンテーションは各オブジェクトを明確な境界を持つ固有のエンティティとして区別するという点が主な違いです。どちらのタスクを使用するかは、特定のアプリケーションによって異なります。画像に何が含まれているかを知るだけで十分なのか、個々のオブジェクトを区別することが重要なのかによって判断します。

最近では、Vision AIコミュニティで利用できるさまざまなインスタンスセグメンテーションモデルがあります。より高速なものもあれば、より正確なものもあれば、より使いやすいものもあります。

これらのオプションは便利ではあるが、特定のタスクに使用するにはどれが正しいのかという疑問が生じる。選択肢の中では、Ultralytics YOLO モデルがスピードと正確さに重点を置いているため、かなり人気がある。

また、これらのモデルは年々大きく進化している。例えば Ultralytics YOLOv5は、PyTorchようなフレームワークを使用してデプロイを簡素化し、深い技術的専門知識を必要とせずに、高度なビジョンAIをより多くの人々が利用できるようにしました。

その成功の上に Ultralytics YOLOv8は、インスタンスのセグメンテーション、ポーズ推定、画像分類などのコンピュータビジョンタスクのサポートを強化した。

そして今、YOLO11 11はパフォーマンスを新たなレベルに引き上げた。COCO データセットにおいて、YOLOv8m22%少ないパラメータで高い平均精度mAP)を達成。

簡単に言えば、YOLO11 11は効率を犠牲にすることなく最先端の精度を実現し、現場でのゲームチェンジャーとなっている。

次に、インスタンスセグメンテーションが通常どのように機能するかを見ていきましょう。従来のコンピュータビジョンモデルでは、2段階のアプローチが使用されています。

まず、オブジェクトの周囲にバウンディングボックスを描くことでオブジェクトをdetect 。次に、各オブジェクトの正確な形状の輪郭を描くために、ピクセルレベルのマスクを生成する。よく知られている例はマスクR-CNNで、これはマスク予測ステップを追加することで物体検出モデルを構築している。この方法は効果的であるが、画像を多段階で処理するため処理速度が遅くなり、リアルタイムでの応用が難しくなる。

一方、YOLO11 ようなモデルは画像を一度に処理し、オブジェクトのバウンディングボックスとインスタンスのセグメンテーションマスクを同時に予測する。この合理的なアプローチにより、高い精度を維持したまま、より高速に処理できる。その結果、速度と精度の両方が重要な、自律走行、ビデオ解析、ロボット工学のようなリアルタイムアプリケーションに特に有用である。

YOLO11 、事前に学習されたモデルとして提供される。COCOデータセットで学習され、インスタンスのセグメンテーションのために日常的なオブジェクトをカバーしています。しかし、Ultralytics Python パッケージはカスタムトレーニングをサポートしており、ユニークなオブジェクトをセグメンテーションする必要がある特殊なアプリケーションには不可欠です。

カスタムトレーニングまたはモデルのファインチューニングが重要なのはなぜですか?カスタムトレーニングは、事前学習済みモデルにすでに組み込まれている知識を基盤とすることで、転移学習を活用します。ゼロから始めるのではなく、既存のモデルを、より少ないデータセットとコンピューティングリソースを使用して新しいタスクに適応させ、高い精度を維持します。

YOLO11 セグメンテーションを微調整する手順を詳しく見てみよう:

インスタンスセグメンテーションは、機械がオブジェクトをより正確に見て理解できるようにすることで、現実世界の課題を解決するために使用できます。自動化の改善から環境保護まで、多くの分野で重要な役割を果たしています。それがどのような影響を与えているかの例をいくつか見ていきましょう。

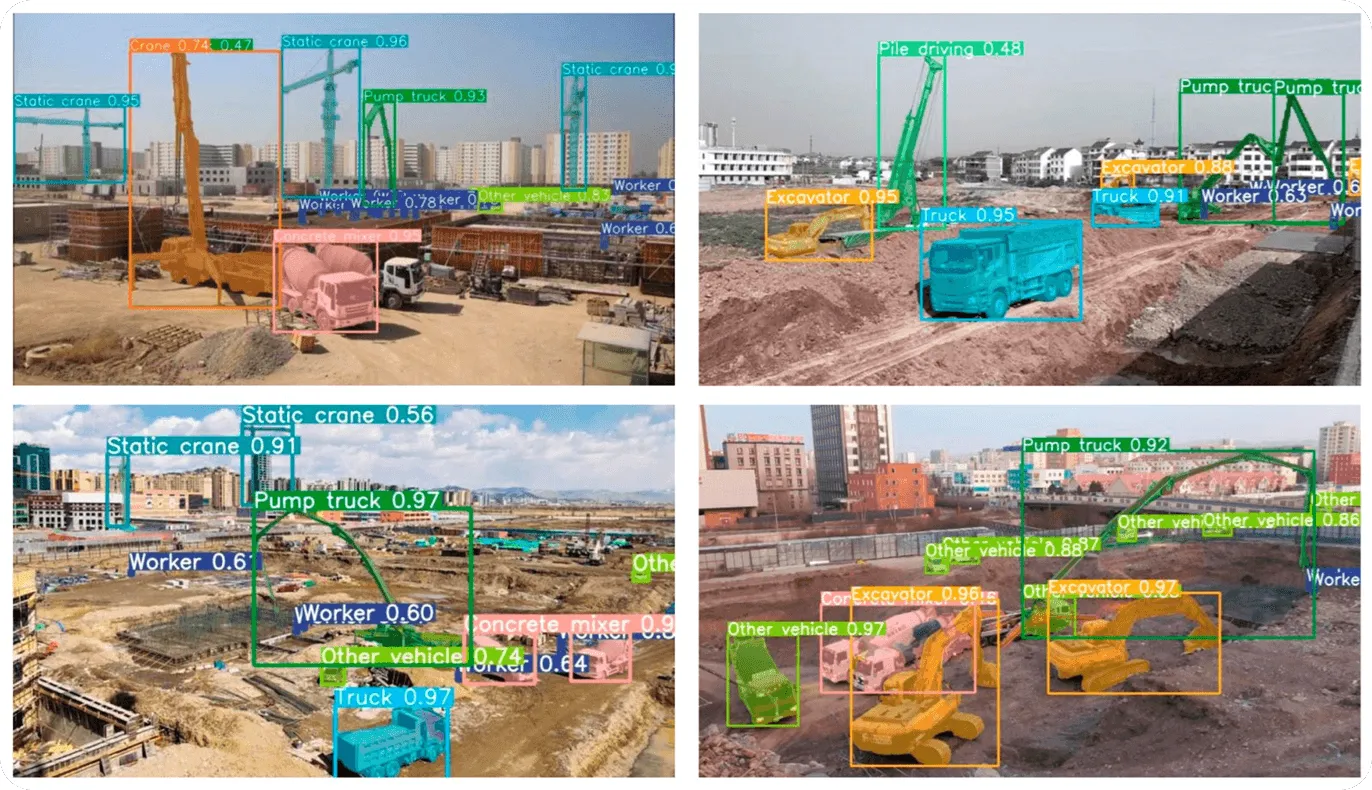

インスタンスセグメンテーションは、建設現場での安全性と効率性を確保するための重要な要素となり得ます。たとえば、重機の監視に使用できます。

YOLO11 、クレーン車、掘削機、ブルドーザーなど、さまざまなタイプの機械を正確にsegment 化して識別し、それらの位置をリアルタイムでtrack するように微調整することができます。これにより、現場管理者は、機械が指定されたエリア内で厳密に動作し、作業員がいるゾーンや危険が存在するゾーンに侵入しないことを確認することができます。

また、このようなソリューションをリアルタイムアラートシステムと統合することで、迅速な是正措置を講じることができます。さらに、収集されたインサイトは、サイトのレイアウトとワークフローを最適化し、リスクを軽減し、生産性を向上させるのに役立ちます。

動物の行動モニタリングは、研究者、農家、保護活動家がさまざまな環境で動物をより適切に世話をするのに役立ちます。インスタンスセグメンテーションは、農場、動物園、自然の生息地で個々の動物を識別およびセグメント化することにより、これらのシステムで役立ちます。バウンディングボックスを使用する従来の物体検出とは異なり、インスタンスセグメンテーションは各動物のピクセルレベルの境界線を提供します。これは、動物が近接している場合に特に役立ちます。

詳細なセグメンテーションは、動きや行動のより正確な追跡を促進します。重複または密集して群がっている動物を明確に認識し、相互作用、健康評価、および活動パターンのより正確な分析を提供できます。全体として、動物の行動に関するより深い洞察は、動物のケアと管理の実践を強化します。

正確な選手とイベントのトラッキングは、スポーツ分析の大きな部分を占めています。従来のトラッキング方法は手作業によるタグ付けに頼っており、詳細なインタラクションを捉えることができない場合がありました。コンピュータビジョンを使用することで、各選手、ボール、重要なイベントなどの詳細をピクセルsegment し、詳細な洞察を得ることができます。

例えば、インスタンスのセグメンテーションは、各選手とオブジェクトを明確に分離することで、ファウルやオフボールインシデントのようなイベントをdetect のに役立ちます。YOLO11 ようなモデルが可能にするこのきめ細かなモニタリングは、アナリストにより明確な情報を提供し、動きのパターン、空間的なポジショニング、相互作用を高い精度で調査します。これらの洞察の主な利点は、チームが戦略を洗練させ、全体的なパフォーマンスを向上させるのに役立つことです。

インスタンスセグメンテーションがさまざまな産業にもたらす主な利点をいくつかご紹介します。

これらの利点は、インスタンスセグメンテーションがさまざまなユースケースにどのように影響するかを示していますが、その実装に伴う課題を考慮することも不可欠です。

インスタンスセグメンテーションの主な制限事項をいくつかご紹介します。

インスタンスセグメンテーションを使用すると、オブジェクトが重複している場合でも、個々のオブジェクトを正確に区別できます。ピクセルレベルでオブジェクトの境界をキャプチャすることにより、オブジェクト検出などの従来のコンピュータビジョンのタスクと比較して、視覚データをより深く理解できます。

最近のコンピュータビジョンの進歩により、インスタンスのセグメンテーションがより速く、より使いやすくなっている。特に、Ultralytics YOLO11 ようなコンピュータビジョンモデルは、プロセスを簡素化し、最小限のセットアップでリアルタイムのセグメンテーションを可能にするため、さまざまな業界やアプリケーションで利用しやすくなっている。

AIにご興味がありますか?当社のGitHubリポジトリにアクセスし、コミュニティと繋がって、さらに詳しく調べてみましょう。ソリューションページで、自動運転車におけるAIや農業におけるVision AIなどのイノベーションについて学びましょう。ライセンスオプションを確認して、コンピュータビジョンプロジェクトを始めましょう!

未来の機械学習で、新たな一歩を踏み出しましょう。