コンピュータビジョンが、オブジェクト検出、画像分類、姿勢推定などのAI搭載タスクによって、どのように産業を変革しているかをご覧ください。

%252525202.webp)

コンピュータビジョンが、オブジェクト検出、画像分類、姿勢推定などのAI搭載タスクによって、どのように産業を変革しているかをご覧ください。

%252525202.webp)

20年前、機械やコンピュータが世界を見て理解できるという考えは、単なるサイエンスフィクションでした。今日、人工知能(AI)の進歩のおかげで、その概念は現実のものとなっています。特に、AIの一分野であるコンピュータビジョン(CV)は、機械が画像や動画を理解し分析することを可能にします。リアルタイムでのオブジェクトの識別、セキュリティシステムの改善、複雑なタスクの自動化など、その可能性は可能なことの境界を押し広げています。

コンピュータビジョンは、さまざまな業界がその独自の能力を採用するさまざまな方法を模索しており、テクノロジーの未来を急速に形作っています。世界のコンピュータビジョンの市場規模は、2024年に198.3億ドルに達し、今後数年間で年率19.8%の成長が見込まれています。

この記事では、コンピュータビジョンについて詳しく解説します。その概要、進化、そして今日の仕組みについて掘り下げ、さらに興味深い応用例もいくつかご紹介します。それでは、始めましょう。

コンピュータ・ビジョンは、機械学習とニューラルネットワークを活用して、画像やビデオファイルなどの視覚データの内容を理解するようコンピュータに教えるAIのサブ分野である。処理された画像から収集された洞察は、より良い意思決定を行うために使用することができる。例えば、コンピュータ・ビジョンは小売業において、棚の画像を分析して在庫レベルをtrack したり、自動レジシステムで買い物体験を向上させたりするのに利用できる。すでに多くの企業が、スマートフォンの写真にフィルターをかけるような作業から製造業の品質管理まで、さまざまな用途にコンピューター・ビジョン技術を利用している。

なぜコンピュータビジョンソリューションがこれほど必要とされているのか疑問に思うかもしれません。欠陥を見つけたり、パターンを認識したりするなど、常に注意を払う必要があるタスクは、人間にとって困難な場合があります。目が疲れて細部を見落としたり、特にペースが速く複雑な環境では見逃してしまうことがあります。

人は異なるサイズ、色、照明、角度の物体を認識するのは得意だが、プレッシャーの中で一貫性を保つのに苦労することが多い。一方、コンピュータ・ビジョン・ソリューションは、ノンストップで動作し、大量の視覚データを迅速かつ正確に処理する。例えば、渋滞のdetect 、信号タイミングの最適化、あるいは事故の特定など、人間が観察するよりも早く、リアルタイムで交通を分析することができる。

長年にわたり、コンピュータビジョンは理論的な概念から、さまざまな業界でイノベーションを推進する信頼性の高い技術へと進化してきました。その発展を定義する主要なマイルストーンをいくつか見てみましょう。

今日、コンピュータビジョンは急速に進歩しており、ヘルスケア、自律走行車、スマートシティなどの分野における問題解決方法を変革しています。リアルタイムコンピュータービジョンタスクのために設計されたUltralytics YOLO (You Only Look Once)モデルは、様々な業界でビジョンAIを効果的かつ正確に実装することを容易にします。AIとハードウェアが改善され続ける中、これらのモデルは、高度な視覚データ分析を使用することで、企業がよりスマートな意思決定を行い、業務を効率化するのに役立っています。

コンピュータビジョンシステムは、人間の脳の働きに触発されたアルゴリズムであるニューラルネットワークを使用して画像を分析します。特に畳み込みニューラルネットワーク(CNN)と呼ばれる特定のタイプは、画像内のエッジや形状などのパターンを認識するのに非常に優れています。

視覚データを単純化するために、プーリングのような技術は画像の最も重要な部分に焦点を当て、追加のレイヤーはこの情報を処理して、特徴の識別や物体の検出などのタスクを実行する。次のような高度なモデル Ultralytics YOLO11のような高度なモデルは、スピードと精度のために設計され、リアルタイムの画像処理を可能にします。

一般的なコンピュータビジョンアプリケーションでは、生の画像を役立つ洞察に変換するために、いくつかのステップが含まれます。主な4つの段階を以下に示します。

コンピュータ・ビジョンの仕組みについて話すとき、コンピュータ・ビジョンのタスクについて言及したことにお気づきかもしれません。Ultralytics YOLO11 ようなモデルは、これらのタスクをサポートするために構築され、実世界のアプリケーションに高速で正確なソリューションを提供します。物体の検出から動きの追跡まで、YOLO11 11はこれらのタスクを効率的に処理します。YOLO11がサポートする主なコンピュータビジョンタスクと、それらがどのように機能するかを見てみましょう。

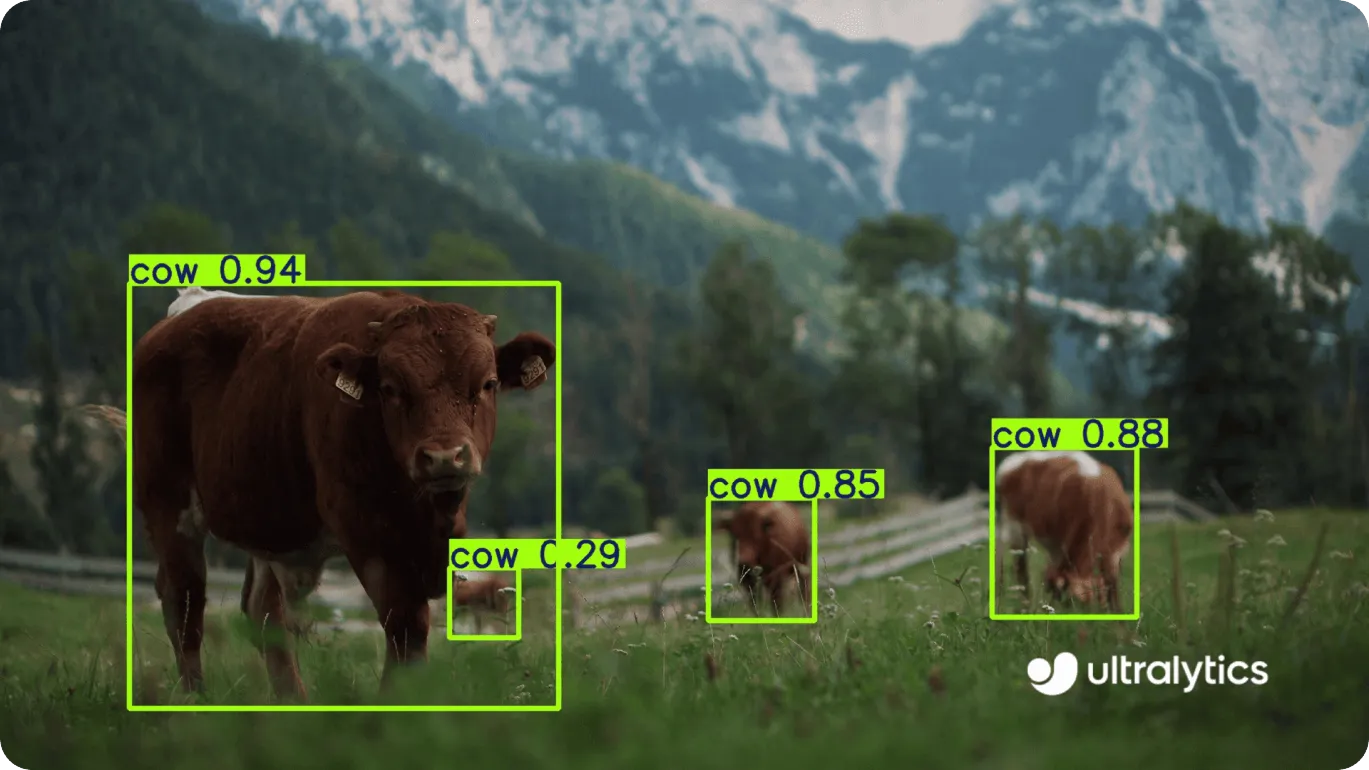

物体検出は主要なコンピュータビジョンタスクであり、画像内の関心のある物体を識別するために使用されます。物体検出タスクの出力は、クラスラベル(「車」や「人」など、各物体のカテゴリまたはタイプ)と信頼度スコア(モデルが各検出についてどれだけ確信しているかを示す数値)とともに、一連のバウンディングボックス(画像内で検出された物体の周りに描かれた長方形)です。たとえば、物体検出を使用して、道路上の歩行者や交通中の車の位置を特定して特定できます。

画像分類の主な目的は、入力画像に対して、その全体的な内容に基づいて、あらかじめ定義されたラベルやカテゴリーを割り当てることである。このタスクには通常、画像内の支配的なオブジェクトや特徴を特定することが含まれる。例えば、画像分類は、画像に猫が写っているか、犬が写っているかを判断するのに使われます。YOLO11 ようなコンピュータ・ビジョン・モデルは、以下に示すように、猫や犬の個々の品種をclassify するようにカスタム・トレーニングすることもできる。

インスタンスセグメンテーションは、さまざまなアプリケーションで使用されるもう1つの重要なコンピュータビジョンタスクです。画像内の各セグメントを分解し、同じ種類のオブジェクトが複数存在する場合でも、個々のオブジェクトを識別します。オブジェクト検出とは異なり、インスタンスセグメンテーションは、各オブジェクトの正確な境界を特定する点でさらに高度です。たとえば、自動車の製造および修理において、インスタンスセグメンテーションは各自動車部品を個別に識別してラベル付けするのに役立ち、プロセスをより正確かつ効率的にします。

ポーズ推定の目的は、手、頭、肘などのキーポイントの位置を予測することにより、人またはオブジェクトの位置と方向を特定することです。これは、リアルタイムで物理的な動作を理解することが重要なアプリケーションで特に役立ちます。人間のポーズ推定は、スポーツ分析、動物の行動監視、ロボット工学などの分野で一般的に使用されています。

YOLO11サポートする他のコンピュータビジョンタスクを調べるには、 Ultralytics 公式ドキュメントを参照してください。このドキュメントには、YOLO11 どのようにオブジェクト・トラッキングやOBB(Oriented bounding box)オブジェクト検出などのタスクを処理するかについての詳細情報が記載されています。

世の中には多くのコンピュータビジョンモデルがありますが、Ultralytics YOLO シリーズは、その強力な性能と多用途性で際立っています。時間の経過とともに、Ultralytics YOLO モデルは改良され、より速く、より正確で、より多くのタスクを処理できるようになりました。いつ Ultralytics YOLOv5が導入されると、PyTorchようなVision AIフレームワークでモデルのデプロイが簡単になりました。高精度と使いやすさを兼ね備え、より幅広いユーザーが高度なVision AIに取り組めるようになりました。

次へ Ultralytics YOLOv8は、インスタンスのセグメンテーション、ポーズ推定、画像分類などの新しい能力を追加することで、さらに進化しました。一方、最新バージョンのYOLO1111は、複数のコンピュータビジョンタスクで最高のパフォーマンスを発揮します。YOLO11mは、YOLOv8m22%少ないパラメータで、COCO データセットにおいて高い平均精度mAP)を達成しました。経験豊富な開発者であれ、AI初心者であれ、YOLO11 11はコンピュータ・ビジョンのニーズに応える強力なソリューションを提供します。

先に、YOLO11 ようなコンピュータ・ビジョン・モデルが幅広い産業でどのように応用できるかを説明した。今度は、私たちの日常生活を変えつつある、より多くの使用例を探ってみましょう。

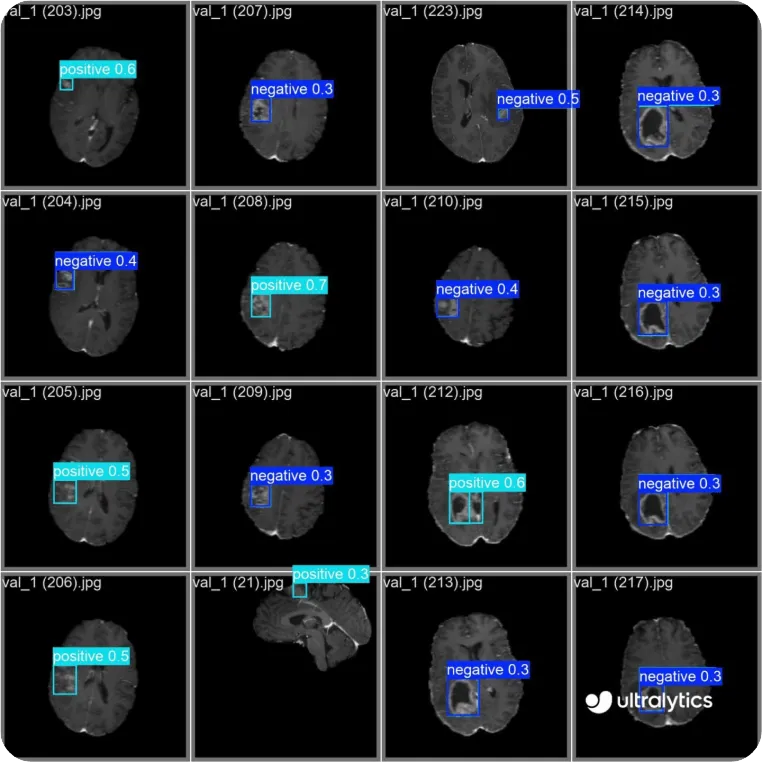

ヘルスケアにおけるコンピュータビジョンには、幅広いアプリケーションが存在します。オブジェクト検出や分類などのタスクは、病気の検出をより迅速かつ正確にするために、医用画像処理で使用されています。X線分析では、コンピュータビジョンは人間の目には見えにくいパターンを識別できます。

また、がん細胞と健康な細胞を比較するために、がん検出にも使用されます。同様に、CTスキャンやMRIに関しても、コンピュータビジョンは、ほぼ人間に近い精度で画像を分析するために使用できます。これにより、医師はより適切な判断を下すことができ、最終的にはより多くの命を救うことができます。

コンピュータ・ビジョンは自動運転車にとって重要であり、道路標識や信号機などの物体をdetect のに役立っている。光学式文字認識(OCR)などの技術により、自動車は道路標識からテキストを読み取ることができる。また、物体検出タスクがリアルタイムで人を識別する歩行者検出にも使用される。

さらに、コンピュータビジョンは、道路の表面のひび割れや穴を特定することもでき、変化する道路状況のより良い監視を可能にします。全体として、コンピュータビジョン技術は、交通管理の改善、輸送の安全性の向上、スマートシティ計画のサポートにおいて重要な役割を果たすことができます。

農家が何の心配もなく、自動的に時間通りに種をまき、水をやり、作物を収穫できるとしよう。それこそがコンピューター・ビジョンが農業にもたらすものだ。作物をリアルタイムで監視できるため、農家は病気や栄養不足などの問題を人間よりも正確にdetect できる。

監視に加えて、コンピュータビジョンと統合されたAI駆動の自動除草機は、雑草を識別して除去し、人件費を削減し、作物の収量を増やすことができます。このテクノロジーの組み合わせは、農家がリソースを最適化し、効率を向上させ、作物を保護するのに役立ちます。

製造業では、コンピューター・ビジョンが生産の監視、製品の品質チェック、作業員の自動track いる。ビジョンAIは工程をより速く、より正確にし、エラーを減らし、コスト削減につながる。

具体的には、品質保証のために、オブジェクト検出とインスタンス分割が一般的に使用される。欠陥検出システムは、完成した製品の最終チェックを行い、最高のものだけが顧客に届くようにする。へこみやひび割れのある製品は自動的に識別され、不合格となる。また、これらのシステムは、リアルタイムで製品をtrack し、カウントし、組立ラインでの継続的な監視を提供する。

コンピュータ・ビジョンが教室で使われる方法のひとつに、ジェスチャー認識がある。YOLO11 ようなモデルはこのタスクに最適です。YOLO11のようなモデルは、挙手や困惑した表情などのジェスチャーをリアルタイムで正確に識別することができます。

このようなジェスチャーが検出されると、追加の支援を提供したり、コンテンツを修正して生徒のニーズにより適合させることで、進行中のレッスンを調整できます。これにより、よりダイナミックで適応性のある学習環境が生まれ、教師は教えることに集中でき、システムは各生徒の学習体験をサポートします。

さまざまな業界におけるコンピュータビジョンの応用例を見てきたので、その進歩を推進する主要なトレンドを見ていきましょう。

主要なトレンドの1つはエッジコンピューティングです。これは、データソースの近くでデータを処理する分散コンピューティングフレームワークです。たとえば、エッジコンピューティングは、カメラやセンサーなどのデバイスに視覚データを直接処理する機能を提供し、応答時間の短縮、遅延の削減、プライバシーの向上を実現します。

コンピュータビジョンのもう1つの重要なトレンドは、複合現実の使用です。これは、物理世界とデジタル要素を組み合わせ、コンピュータビジョンを使用して仮想オブジェクトを現実世界とスムーズに融合させます。ゲーム、教育、トレーニングのエクスペリエンスを向上させるために使用できます。

コンピュータビジョンがさまざまな業界にもたらすことができる主な利点をいくつかご紹介します。

これらの利点は、コンピュータビジョンがさまざまな業界にどのように影響を与えるかを示していますが、その実装に伴う課題を考慮することも重要です。主な課題を以下に示します。

コンピュータビジョンは、機械が人間と同じように世界を見て理解できるようにすることで、機械と世界との対話方法を再構築しています。すでに、自動運転車の安全性の向上、医師が病気をより迅速に診断するのを支援、ショッピングをよりパーソナライズ、さらには農家が作物の監視を支援するなど、多くの分野で使用されています。

テクノロジーが向上し続けるにつれて、エッジコンピューティングや複合現実などの新しいトレンドがさらに多くの可能性を切り開いています。バイアスや高コストなどの課題もありますが、コンピュータビジョンは将来、多くの業界に大きなプラスの影響を与える可能性があります。

詳細については、GitHubリポジトリにアクセスし、コミュニティにご参加ください。ソリューションページで、自動運転車におけるAIや農業におけるコンピュータビジョンなどの分野のイノベーションをご覧ください。🚀

未来の機械学習で、新たな一歩を踏み出しましょう。