Rejoignez-nous pour examiner de plus près ce qu'est la segmentation d'instance, comment elle fonctionne, son utilisation dans diverses applications de vision par ordinateur et l'impact qu'elle peut avoir.

Rejoignez-nous pour examiner de plus près ce qu'est la segmentation d'instance, comment elle fonctionne, son utilisation dans diverses applications de vision par ordinateur et l'impact qu'elle peut avoir.

Les applications de vision par ordinateur sont de plus en plus courantes dans notre vie quotidienne, des caméras de circulation qui surveillent l'état des routes aux systèmes de caisse automatique dans les magasins. En permettant aux machines de comprendre les données visuelles d'une manière similaire à celle des humains, la vision artificielle a un impact dans un large éventail d'industries.

Bon nombre de ces applications reposent sur la détection d'objets, une tâche de vision par ordinateur qui place des cadres de délimitation autour des objets clés dans les images. Bien que cette approche fonctionne souvent bien, certaines solutions d'analyse d'images nécessitent une précision encore plus grande.

Par exemple, l'imagerie médicale exige plus que la simple détection d'une tumeur : il est essentiel de délimiter sa forme exacte. De même, en robotique, les machines doivent reconnaître les contours exacts d'un objet pour le saisir correctement. Pour relever ces défis, la segmentation d'instance offre une solution plus précise.

La segmentation des instances est une tâche de vision par ordinateur conçue pour prendre en charge les cas d'utilisation où la détection des objets n'est pas suffisante - elle permet d'obtenir une précision au niveau du pixel. Les modèles de vision artificielle comme Ultralytics YOLO11 peuvent être utilisés pour appliquer facilement la segmentation d'instances aux images et aux vidéos.

Dans ce guide, nous allons expliquer comment fonctionne la segmentation d'instance, ses applications, et comment Ultralytics YOLO11 peut être formé sur mesure pour des tâches de segmentation spécifiques.

Supposons qu'il existe une photo de groupe de personnes se tenant près les unes des autres. La détection d'objets peut aider à dessiner des boîtes autour de chaque personne, mais cela ne vous indique pas leur forme exacte.

La segmentation d'instance, d'autre part, s'apparente à un traçage minutieux autour de chaque personne afin que vous puissiez voir leur contour complet, même s'ils se chevauchent. Au lieu de simplement marquer l'emplacement d'un élément avec une boîte, elle identifie la forme exacte de chaque objet au niveau du pixel, ce qui facilite la compréhension des images complexes.

Le résultat est un masque détaillé qui remplit la forme d'un objet, identifiant avec précision les pixels qui lui appartiennent. Ce niveau de précision est utile dans de nombreuses applications du monde réel où il est important de comprendre la forme et les limites exactes des objets.

Lors de l'exploration de la segmentation d'instance, vous pourriez rencontrer le concept de segmentation sémantique.

Les deux techniques aident les ordinateurs à comprendre les images au niveau des pixels, mais elles servent des objectifs différents. La segmentation sémantique étiquette chaque pixel en fonction de sa catégorie, regroupant tous les objets du même type. Par exemple, dans une image avec plusieurs voitures, la segmentation sémantique les marquerait toutes comme "voiture" sans distinguer les véhicules individuels.

La segmentation d'instance, quant à elle, va encore plus loin en identifiant chaque objet séparément. Elle attribue des étiquettes uniques aux instances individuelles et crée des masques précis autour de leurs formes. Ainsi, dans la même image, la segmentation d'instance ne se contenterait pas d'étiqueter tout comme "voiture", mais reconnaîtrait et délimiterait chaque voiture individuellement.

La principale différence entre les deux est que la segmentation sémantique regroupe les objets par catégorie, tandis que la segmentation d'instance distingue chaque objet comme une entité unique avec des limites claires. Le choix de la tâche à utiliser dépend de l'application spécifique : est-il suffisant de savoir ce qu'il y a dans une image ou est-il important de différencier les objets individuels.

Il existe de nombreux modèles de segmentation d'instance disponibles pour la communauté Vision AI aujourd'hui. Certains sont plus rapides, d'autres plus précis et d'autres plus faciles à utiliser.

Ces options, bien qu'utiles, peuvent conduire à la question suivante : laquelle est la bonne pour une tâche spécifique ? Parmi ces options, les modèlesYOLO d'Ultralytics sont très populaires car ils mettent l'accent sur la vitesse et la précision.

En outre, ces modèles ont considérablement évolué au fil des ans. A titre d'exemple, Ultralytics YOLOv5 a simplifié le déploiement à l'aide de frameworks tels que PyTorch, rendant l'IA visionnaire avancée accessible à un public plus large sans nécessiter d'expertise technique approfondie.

Tirer parti de ce succès, Ultralytics YOLOv8 a introduit un support amélioré pour les tâches de vision artificielle telles que la segmentation d'instances, l'estimation de la pose et la classification d'images.

Aujourd'hui, YOLO11 atteint un nouveau niveau de performance. Il atteint une précision moyenne plus élevéemAP sur l'ensemble de données COCO avec 22 % de paramètres en moins que YOLOv8m, ce qui signifie qu'il peut reconnaître des objets avec plus de précision tout en utilisant moins de ressources.

En d'autres termes, YOLO11 offre une précision de pointe sans compromettre l'efficacité, ce qui change la donne sur le terrain.

Ensuite, explorons le fonctionnement typique de la segmentation d'instance. Les anciens modèles de vision par ordinateur utilisent une approche en deux étapes.

Tout d'abord, ils detect objets en traçant des boîtes de délimitation autour d'eux. Ensuite, ils génèrent un masque au niveau des pixels pour définir la forme exacte de chaque objet. Un exemple bien connu est le R-CNN de masque, qui s'appuie sur les modèles de détection d'objets en ajoutant une étape de prédiction de masque. Bien que cette méthode soit efficace, elle peut être lente car elle traite l'image en plusieurs étapes, ce qui complique les applications en temps réel.

En revanche, des modèles comme YOLO11 traitent les images en une seule fois, en prédisant simultanément les boîtes de délimitation des objets et les masques de segmentation des instances. Cette approche rationalisée est beaucoup plus rapide tout en conservant une grande précision. Elle est donc particulièrement utile pour les applications en temps réel telles que la conduite autonome, l'analyse vidéo et la robotique, où la vitesse et la précision sont cruciales.

YOLO11 est livré avec un modèle pré-entraîné. Il a été entraîné sur l'ensemble de donnéesCOCO, qui couvre les objets de la vie quotidienne pour la segmentation d'instances. Cependant, le package Ultralytics Python prend en charge l'entraînement personnalisé, ce qui est essentiel pour les applications spécialisées dans lesquelles des objets uniques doivent être segmentés.

Pourquoi la formation personnalisée ou le réglage fin d'un modèle est-il important ? La formation personnalisée tire parti de l'apprentissage par transfert en s'appuyant sur les connaissances déjà intégrées dans les modèles pré-entraînés. Plutôt que de partir de zéro, elle adapte un modèle existant à de nouvelles tâches en utilisant des ensembles de données plus petits et moins de ressources informatiques, tout en conservant une grande précision.

Voici un examen plus approfondi des étapes nécessaires à l'affinement de YOLO11 pour la segmentation des instances :

La segmentation d'instance peut être utilisée pour résoudre des problèmes concrets en aidant les machines à voir et à comprendre les objets avec plus de précision. De l'amélioration de l'automatisation à la protection de l'environnement, elle joue un rôle clé dans de nombreux domaines. Examinons quelques exemples de son impact.

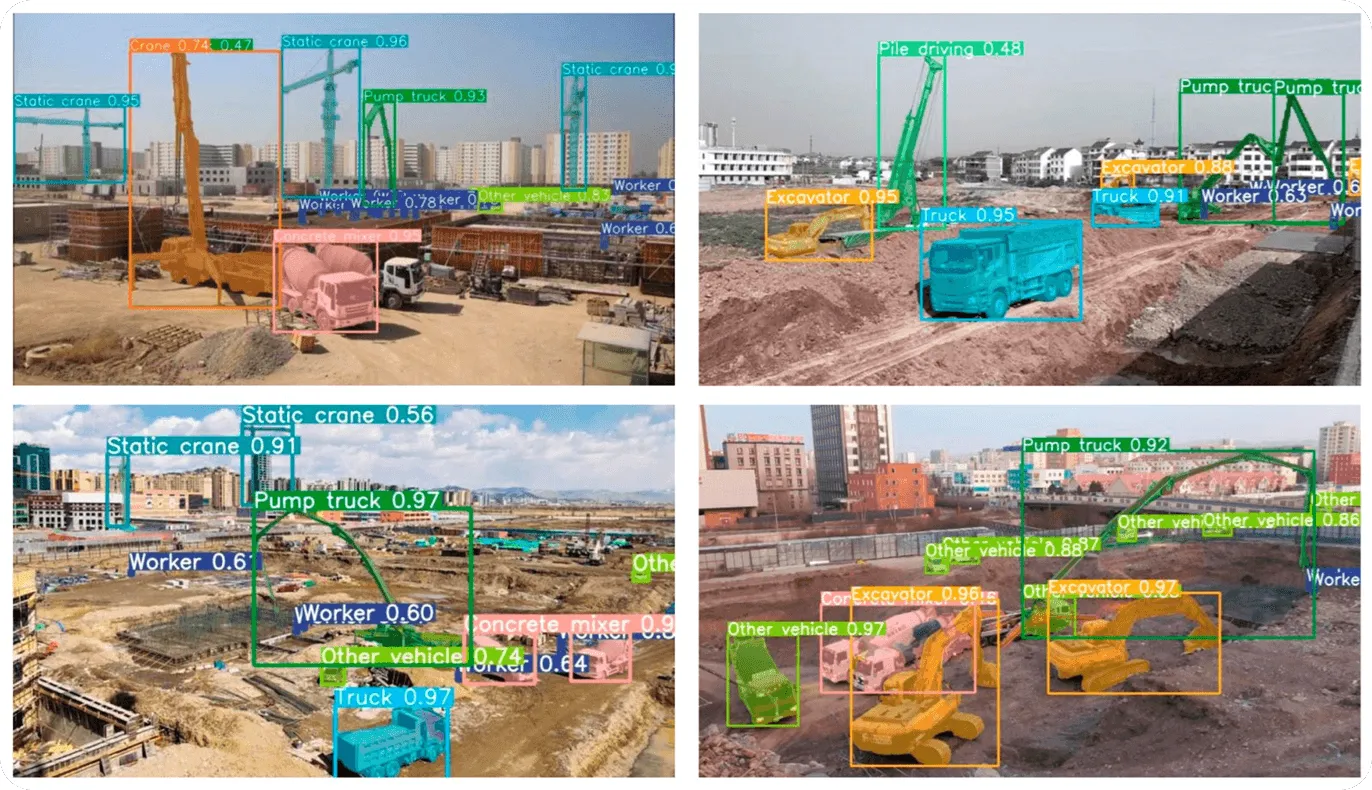

La segmentation d'instance peut jouer un rôle essentiel pour garantir la sécurité et l'efficacité sur les chantiers de construction. Par exemple, elle peut être utilisée pour surveiller les engins lourds.

YOLO11 peut être affiné pour segment et identifier avec précision différents types d'équipements, tels que les grues, les excavateurs et les bulldozers, et track leur position en temps réel. Les gestionnaires de sites peuvent ainsi s'assurer que les machines fonctionnent strictement dans les zones désignées et qu'elles n'empiètent pas sur les zones où des travailleurs sont présents ou des dangers existent.

De plus, l'intégration de telles solutions avec des systèmes d'alerte en temps réel permet de prendre rapidement des mesures correctives. Au-delà de cela, les informations recueillies peuvent aider à optimiser la disposition du site et le workflow, réduisant ainsi davantage les risques et augmentant la productivité.

La surveillance du comportement animal aide les chercheurs, les agriculteurs et les défenseurs de l'environnement à mieux prendre soin des animaux dans différents environnements. La segmentation d'instance joue un rôle utile dans ces systèmes en identifiant et en segmentant les animaux individuels dans les fermes, les zoos et les habitats naturels. Contrairement à la détection d'objets traditionnelle qui utilise des boîtes englobantes, la segmentation d'instance fournit une délimitation au niveau des pixels de chaque animal, ce qui est particulièrement utile lorsque les animaux sont à proximité les uns des autres.

Une segmentation détaillée facilite un suivi plus précis des mouvements et des comportements. Les animaux qui se chevauchent ou sont étroitement regroupés peuvent être clairement reconnus, ce qui permet une analyse plus précise des interactions, des évaluations de la santé et des schémas d'activité. Globalement, une connaissance plus approfondie du comportement animal améliore les pratiques de soins et de gestion des animaux.

Le suivi précis des joueurs et des événements constitue une part importante de l'analyse sportive. Les méthodes traditionnelles de suivi reposent sur le marquage manuel, qui ne permet pas toujours de saisir les interactions détaillées. La vision par ordinateur peut être utilisée pour segment détails tels que chaque joueur, chaque ballon et chaque événement clé au niveau du pixel afin d'obtenir des informations détaillées.

Par exemple, la segmentation des instances peut aider à detect événements tels que des fautes ou des incidents hors ballon en séparant clairement chaque joueur et chaque objet. Ce suivi granulaire rendu possible par des modèles comme YOLO11 offre aux analystes des informations plus claires pour étudier les schémas de mouvement, le positionnement spatial et les interactions avec une grande précision. L'un des principaux avantages de ces informations est qu'elles aident les équipes à affiner leurs stratégies et à améliorer leurs performances globales.

Voici quelques-uns des principaux avantages que la segmentation d'instance peut apporter à divers secteurs :

Bien que ces avantages soulignent l'impact de la segmentation d'instance sur différents cas d'utilisation, il est également essentiel de tenir compte des défis liés à sa mise en œuvre.

Voici quelques-unes des principales limitations de la segmentation d'instance :

La segmentation d'instance permet de distinguer les objets individuels avec précision, même lorsqu'ils se chevauchent. En capturant les limites des objets au niveau du pixel, elle offre une compréhension plus approfondie des données visuelles par rapport aux tâches traditionnelles de vision par ordinateur telles que la détection d'objets.

Les progrès récents dans le domaine de la vision par ordinateur ont rendu la segmentation des instances plus rapide et plus facile à utiliser. En particulier, les modèles de vision par ordinateur comme Ultralytics YOLO11 simplifient le processus, permettant une segmentation en temps réel avec une configuration minimale, ce qui le rend plus accessible pour diverses industries et applications.

L'IA vous intéresse ? Visitez notre dépôt GitHub et connectez-vous à notre communauté pour continuer à explorer. Découvrez les innovations telles que l'IA dans les voitures autonomes et la Vision IA dans l'agriculture sur nos pages de solutions. Consultez nos options de licence et lancez-vous dans un projet de vision par ordinateur !

Commencez votre parcours avec l'avenir de l'apprentissage automatique