Como Ultralytics utiliza a IA para automatizar a anotação

Descubra como Ultralytics utiliza a IA para automatizar a anotação, gerir grandes conjuntos de dados, melhorar a consistência e acelerar o desenvolvimento da visão computacional.

Descubra como Ultralytics utiliza a IA para automatizar a anotação, gerir grandes conjuntos de dados, melhorar a consistência e acelerar o desenvolvimento da visão computacional.

As soluções de visão computacional que analisam imagens e vídeos estão a tornar-se parte integrante dos fluxos de trabalho em muitos setores, desde a indústria transformadora até à imagiologia médica. Na indústria transformadora, por exemplo, a deteção de defeitos superficiais em produtos que se deslocam ao longo de uma correia transportadora depende de modelos de visão computacional capazes de identificar padrões subtis.

Para que esses modelos funcionem bem, têm de ser treinados com dados rotulados, nos quais cada defeito é claramente identificado. Isto permite que esses modelos aprendam o que procurar e reconheçam padrões semelhantes.

O processo de criação destas etiquetas denomina-se «anotação de dados». Em particular, a anotação de imagens e a anotação de vídeos envolvem o desenho de caixas delimitadoras, o contorno de formas ou a identificação de regiões específicas dentro de imagens e fotogramas de vídeo.

Embora isto seja viável para conjuntos de dados pequenos, torna-se rapidamente mais difícil de gerir à medida que os dados aumentam. Rotular milhares de imagens exige um esforço manual constante, tornando a anotação um grande obstáculo. As ferramentas tradicionais são frequentemente lentas, fragmentadas e difíceis de escalar.

Ultralytics , a plataforma de IA de visão «tudo-em-um», ajuda a resolver estes desafios através da anotação assistida por IA. Ao utilizar a IA para gerar automaticamente rótulos iniciais que podem ser rapidamente revistos e aperfeiçoados, reduz o esforço manual e melhora a eficiência.

Neste artigo, vamos explorar como funciona a anotação assistida por IA na Ultralytics e como ela melhora o processo de rotulagem. Vamos começar!

Antes de nos debruçarmos sobre o funcionamento da anotação baseada em IA na Ultralytics , vamos primeiro analisar mais detalhadamente o que é a anotação de dados.

A anotação de dados, também conhecida como rotulagem de dados, é o processo de atribuir rótulos estruturados a dados brutos para que estes possam ser utilizados no treino de modelos de aprendizagem automática. Na visão computacional, estes rótulos definem os objetos, as regiões ou as características de interesse nas imagens ou nos vídeos.

Durante o treino, os modelos ou algoritmos aprendem a associar os dados de entrada a esses rótulos, tornando a qualidade da anotação um fator fundamental para o desempenho do modelo. Conjuntos de dados rotulados de forma precisa e consistente permitem que o modelo aprenda padrões corretos, enquanto anotações de má qualidade ou inconsistentes podem levar a previsões pouco fiáveis.

Por exemplo, num caso de utilização de deteção de defeitos, uma imagem de um produto numa correia transportadora pode ser anotada, indicando onde os defeitos aparecem e identificando de que tipo de defeito se trata. Isto ajuda o modelo a aprender como são os defeitos, para que possa identificá-los em novas imagens.

A seguir, vamos analisar algumas formas comuns de anotar imagens na visão computacional. Estes métodos são utilizados para rotular dados visuais em tarefas como a deteção de objetos, a segmentação de instâncias e a classificação de imagens. Cada método de anotação desempenha uma função diferente, como localizar objetos, captar formas ou identificar estruturas-chave.

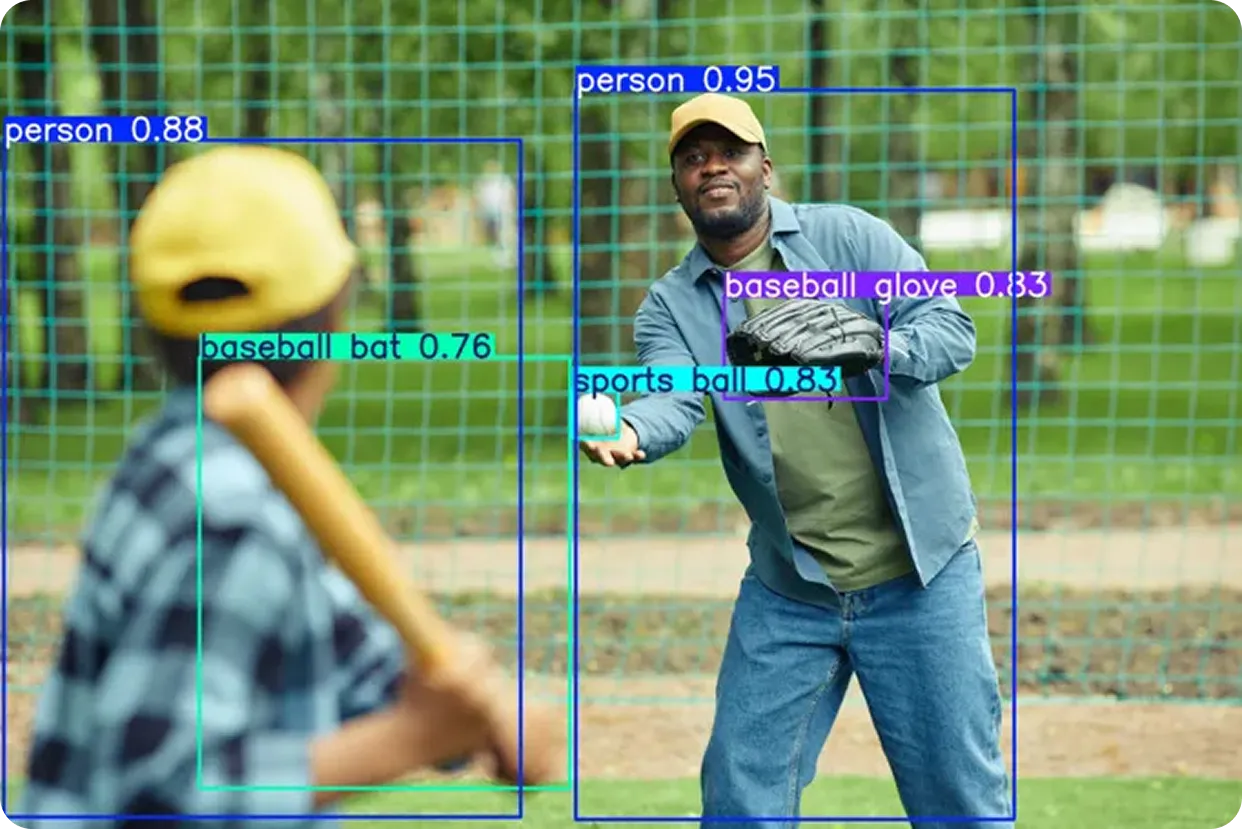

As caixas delimitadoras são simples retângulos desenhados à volta dos objetos numa imagem para indicar a sua localização. Constituem uma das formas mais comuns de rotular dados na visão computacional.

Ao treinar com imagens que incluem estas caixas, os modelos de deteção de objetos aprendem a reconhecer diferentes objetos e a compreender a sua localização dentro de uma imagem. Isto permite-lhes detect objetos ao mesmo tempo e identificar onde cada um deles aparece.

Por exemplo, imagine um jogo de basebol a ser analisado através da visão computacional. É possível desenhar caixas à volta dos jogadores, do taco e da bola em cada fotograma, permitindo que o modelo detect identifique esses objetos ao longo do jogo.

Os polígonos, também conhecidos como máscaras de segmentação, vão um passo além das caixas delimitadoras, ao rotular os objetos ao nível do pixel. Em vez de desenhar um retângulo aproximado, captam a forma e os contornos exatos de cada objeto numa imagem. Isto torna-os úteis para tarefas que exigem uma compreensão mais detalhada.

Por exemplo, na condução autónoma, as máscaras de segmentação são utilizadas em tarefas como a segmentação semântica, em que a cada pixel é atribuída uma categoria, como estrada ou céu, e a segmentação de instâncias, em que objetos individuais, como veículos ou peões, são identificados separadamente.

Também são utilizadas para tarefas como a remoção do fundo, em que um objeto, como uma pessoa, precisa de ser isolado do resto da imagem.

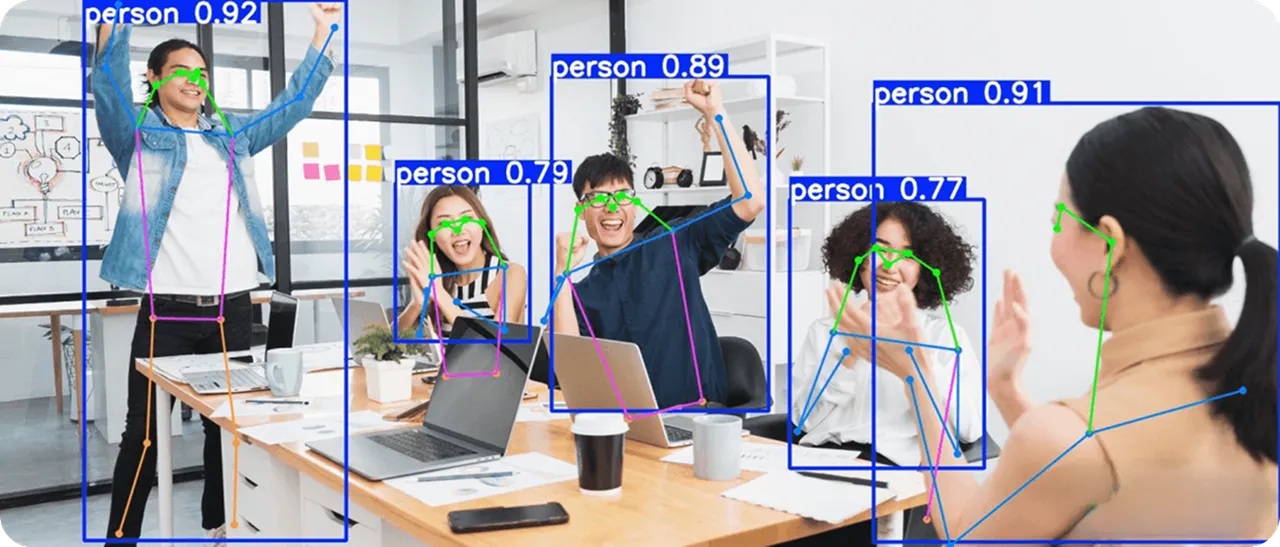

Os pontos-chave são utilizados para marcar pontos específicos num objeto, tais como articulações no corpo humano ou partes de um animal. Ao identificar esses pontos, os modelos conseguem compreender a estrutura de um objeto e a forma como as suas partes se posicionam umas em relação às outras.

Na visão computacional, isto é conhecido como estimativa de pose, sendo que o objetivo é identificar a localização desses pontos-chave e compreender como se relacionam entre si. O acompanhamento destes pontos ao longo do tempo permite analisar o movimento e as alterações na postura.

Um exemplo comum é marcar as articulações do corpo num vídeo para analisar o movimento humano. Ao concentrarem-se nestes pontos-chave, os modelos conseguem captar a posição de uma pessoa e a forma como a sua postura se altera ao longo do tempo.

Nem todos os objetos numa imagem estão perfeitamente alinhados. Em muitos cenários reais, os objetos aparecem inclinados, rodados ou são vistos de ângulos diferentes.

As caixas delimitadoras padrão têm frequentemente dificuldades nestes casos, uma vez que podem incluir fundo desnecessário ou não se ajustar perfeitamente ao objeto. As caixas delimitadoras orientadas resolvem este problema utilizando retângulos rodados que se alinham com a direção do objeto. Isto resulta em anotações mais precisas e bem ajustadas.

Esta abordagem é utilizada na deteção de caixas delimitadoras orientadas (OBB), em que os modelos identificam tanto a localização de um objeto como a sua orientação. Um exemplo são as imagens aéreas, nas quais objetos como edifícios, navios ou veículos aparecem frequentemente sob ângulos diferentes. As caixas rotacionadas facilitam a captura da sua verdadeira forma e direção dentro da cena.

As etiquetas de classificação adotam uma abordagem diferente de outros métodos de anotação, atribuindo uma única etiqueta a toda a imagem, em vez de marcar objetos ou regiões específicos. São utilizadas quando o objetivo é identificar o que está presente numa imagem, sem se centrar no local onde aparece.

Por exemplo, uma imagem pode ser classificada como «gato» ou «cão» com base no seu conteúdo geral. Isto torna a classificação de imagens útil para tarefas em que basta uma compreensão geral da imagem.

Muitas ferramentas tradicionais de rotulagem dependem de várias etapas e fluxos de trabalho desconexos. As equipas de desenvolvimento de IA têm frequentemente de alternar entre plataformas de anotação para a rotulagem, o armazenamento e a validação, o que atrasa os projetos de IA.

A maioria das ferramentas suporta apenas um conjunto limitado de tipos de anotação e tipos de dados, pelo que as equipas acabam por utilizar ferramentas diferentes para caixas delimitadoras, segmentação e pontos-chave. Esta configuração fragmentada pode ser difícil de gerir, especialmente para equipas sem experiência em visão computacional.

O trabalho manual constitui outro grande desafio. Embora a anotação de uma única imagem possa demorar apenas alguns minutos, trabalhar com grandes conjuntos de dados torna-se rapidamente demorado, especialmente quando imagens semelhantes implicam tarefas repetitivas.

À medida que os conjuntos de dados crescem, as equipas têm também de gerir ficheiros, track as versões track e manter a consistência nas anotações. Isto aumenta a carga de trabalho, levando a que se dedique mais tempo à gestão de dados e menos tempo à melhoria do desempenho dos modelos.

Uma abordagem mais eficiente consiste em utilizar a anotação assistida por IA na Ultralytics , que recorre à IA para gerar e aperfeiçoar rótulos, reduzindo o trabalho manual e, ao mesmo tempo, aumentando a rapidez e a consistência, tudo num único ambiente que reúne a gestão de conjuntos de dados, a anotação, o treino de modelos, a implementação e a monitorização.

Ultralytics simplifica a anotação ao integrá-la diretamente com o resto do fluxo de trabalho de visão computacional. Em vez de dependerem de ferramentas separadas, as equipas podem trabalhar com dados, anotações e modelos num único ambiente.

Suporta uma variedade de tarefas de visão computacional, incluindo deteção de objetos, classificação de imagens, segmentação de instâncias, estimativa de poses e deteção de caixas delimitadoras orientadas.

Neste contexto, a anotação pode ser realizada de várias formas. As equipas podem rotular os dados manualmente para terem controlo total, utilizar a anotação inteligente SAM para uma rotulagem interativa e pontual, ou aplicar a anotação inteligente YOLO para gerar anotações automaticamente, que podem ser revistas e aperfeiçoadas. Esta flexibilidade facilita o trabalho com diferentes conjuntos de dados e requisitos de anotação.

Uma vez que a anotação assistida por IA e a anotação manual estão integradas na gestão de conjuntos de dados e no treino de modelos, as equipas podem passar facilmente da rotulagem de dados para a organização de conjuntos de dados e o treino de modelos. Isto mantém os fluxos de trabalho estruturados e elimina a necessidade de alternar entre ferramentas ou reformatar as anotações.

A plataforma também suportaYOLO Ultralytics , tais como Ultralytics YOLO11 e Ultralytics , permitindo que os dados anotados sejam utilizados diretamente para treino e teste. Isto facilita a identificação de lacunas nos conjuntos de dados, o aperfeiçoamento das anotações e o retreino dos modelos através de iterações contínuas.

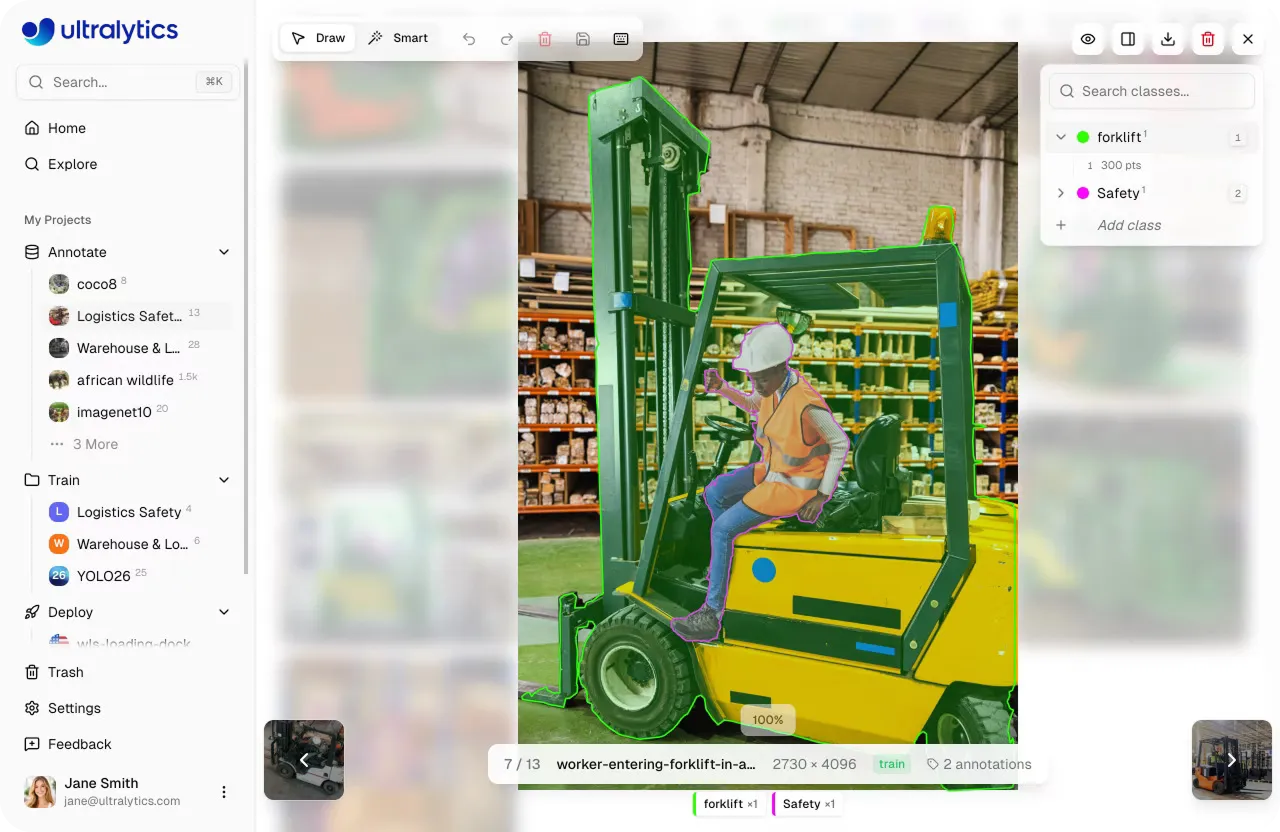

A anotação inteligente SAM na Ultralytics foi concebida para acelerar a anotação em tarefas de deteção de objetos, segmentação de instâncias e caixas delimitadoras orientadas (OBB).

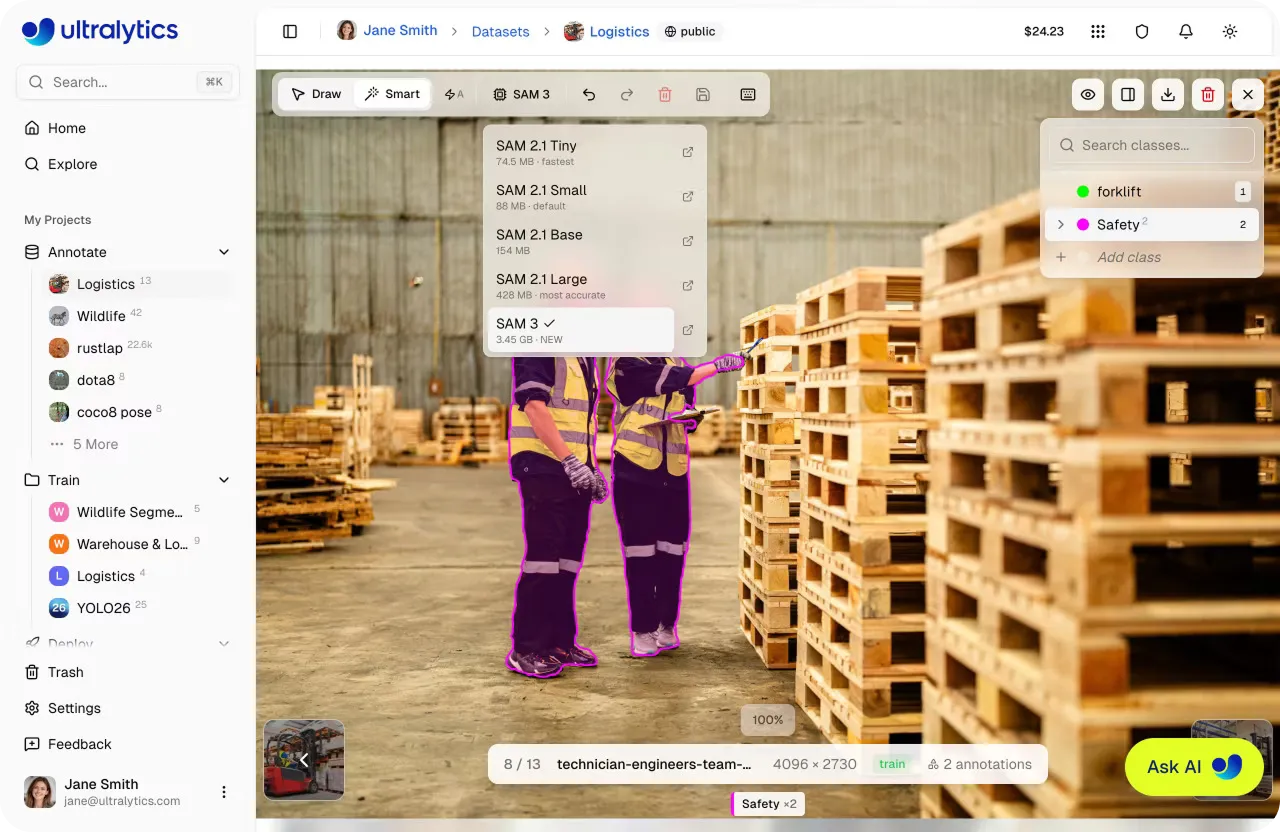

A plataforma disponibiliza várias variantes SAM , incluindo SAM .1 Tiny, SAM .1 Small, SAM .1 Base, SAM .1 Large e SAM , permitindo aos utilizadores escolher entre velocidade e precisão.

Os modelos mais pequenos, como o Tiny e o Small, são mais rápidos e adequados para fluxos de trabalho de anotação rápidos, enquanto os modelos maiores, como o Large e SAM , oferecem maior precisão para cenas mais complexas. A mudança entre modelos atualiza imediatamente o comportamento da anotação.

No editor de anotações, assim que um SAM é selecionado, os anotadores humanos podem ativar o modo Smart para iniciar a rotulagem. Em vez de desenhar formas manualmente, o modelo é orientado através de entradas simples baseadas em pontos.

Um clique com o botão esquerdo adiciona um ponto positivo para incluir uma região, enquanto um clique com o botão direito adiciona um ponto negativo para excluir áreas indesejadas. Com base nestas entradas, o modelo gera uma máscara precisa em tempo real.

Para acelerar o fluxo de trabalho, é possível ativar o modo de aplicação automática. Quando ativo, cada clique gera e guarda automaticamente uma anotação sem necessidade de confirmação manual. No caso de objetos mais complexos, os anotadores podem manter a tecla «Shift» premida para colocar vários pontos antes de aplicar a máscara ou desativar a aplicação automática para adicionar pontos livremente e, em seguida, premir «Enter» para aplicar a máscara.

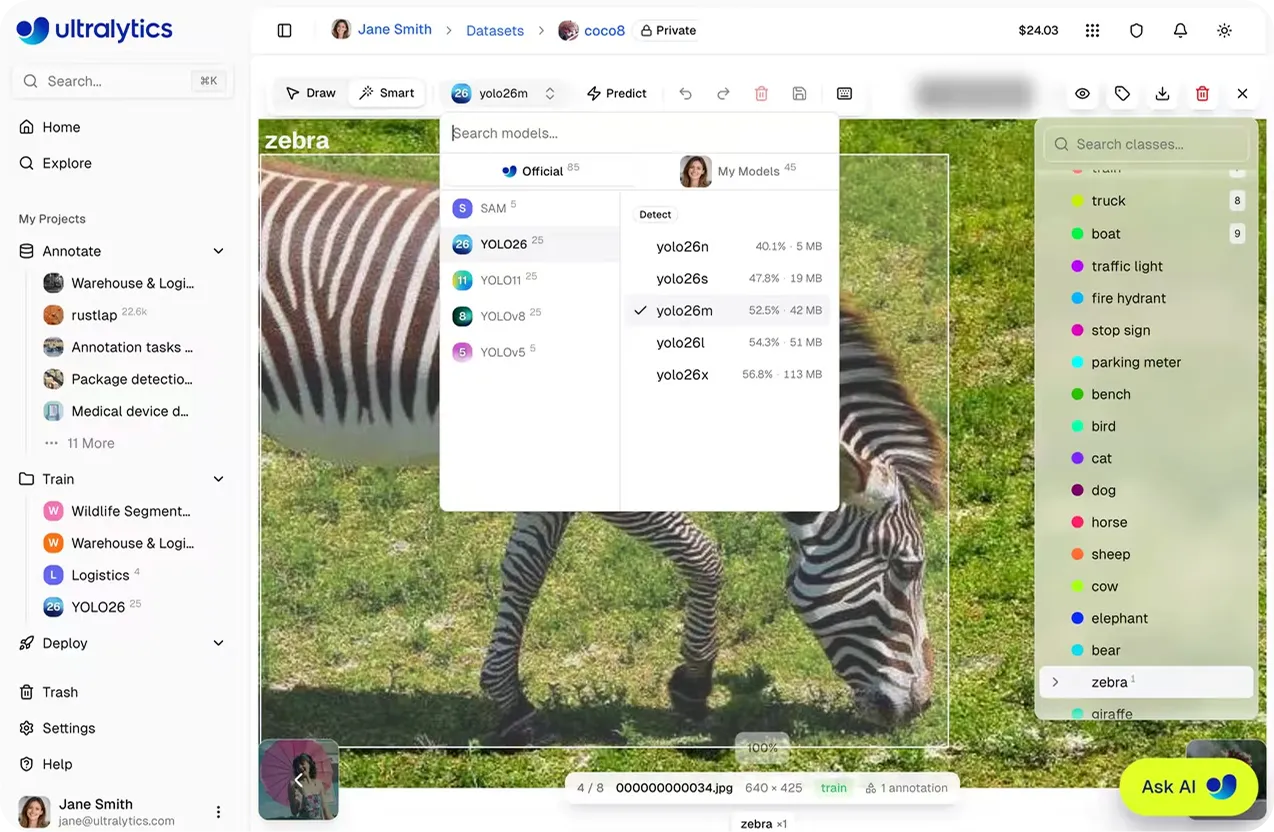

À semelhança da anotação inteligente SAM, a anotação YOLO na Ultralytics utiliza IA para acelerar o processo de rotulagem. Em vez de orientar o modelo através de cliques, utiliza as previsões do modelo para gerar anotações automaticamente.

Esta abordagem suporta tarefas como a deteção de objetos, a segmentação de instâncias e a anotação de caixas delimitadoras orientadas (OBB). Funciona especificamente comYOLO Ultralytics , incluindo modelos pré-treinados fornecidos pela Ultralytics YOLO treinados à medida.

No editor de anotações, os anotadores podem ativar o modo Smart, selecionar um YOLO no seletor de modelos e clicar em «Predict». O seletor de modelos mostra apenas YOLO que correspondem à tarefa atual do conjunto de dados, garantindo que as anotações geradas sejam compatíveis.

O modelo analisa a imagem e gera anotações com base nas suas previsões, que são depois adicionadas diretamente à imagem. Se as previsões se sobreporem a resultados de anotação já existentes da mesma classe, as deteções de duplicados são automaticamente ignoradas quando a sobreposição excede um limiar definido, o que ajuda a manter rótulos limpos e consistentes.

Depois de geradas as previsões, os anotadores humanos podem revê-las, ajustá-las ou removê-las, conforme necessário. Isto facilita a rotulagem rápida de grandes conjuntos de dados, começando com as anotações geradas pelo modelo e aperfeiçoando-as, em vez de anotar tudo manualmente.

Com o tempo, YOLO aperfeiçoados podem ser reutilizados para gerar melhores previsões, apoiando um fluxo de trabalho iterativo de rotulagem automática.

A seguir, vamos analisar alguns exemplos de como a Ultralytics permite a anotação de dados em casos de utilização reais.

Os veículos autónomos equipados com modelos de visão computacional dependem de dados visuais devidamente anotados para compreender o ambiente circundante em tempo real. Os modelos treinados com esses dados conseguem detect segment , peões, sinais de trânsito e limites da estrada.

As tarefas de segmentação exigem limites precisos ao nível do pixel, o que torna a anotação tanto essencial como demorada. A rotulagem manual de grandes volumes de dados de sensores pode rapidamente tornar-se um obstáculo, especialmente em cenários de condução complexos.

Ultralytics simplifica este processo através da anotação assistida por IA, utilizando YOLO SAM YOLO . A anotação inteligente SAM permite uma segmentação rápida, com base em cliques e máscaras precisas, enquanto YOLO podem ser utilizados para gerar automaticamente anotações em todas as imagens.

Em conjunto, estas abordagens facilitam o tratamento de cenas complexas com objetos sobrepostos.

Uma vez que a anotação está diretamente ligada ao treino dos modelos, os conjuntos de dados em grande escala atualizados podem ser utilizados imediatamente para retreinar e avaliar os modelos. Isto permite que as equipas melhorem continuamente o desempenho e se adaptem a novas condições de condução de forma mais eficiente.

Na indústria transformadora, a manutenção de um controlo de qualidade consistente depende da deteção precisa de defeitos durante a produção. Os modelos de visão computacional são frequentemente utilizados para identificar problemas em tempo real, mas o seu desempenho depende da medida em que os dados de treino refletem as condições reais de produção.

As alterações nos ambientes de fabrico, tais como variações nas matérias-primas, nas configurações das máquinas ou na iluminação, podem introduzir novos e raros tipos de defeitos que não faziam parte dos dados de treino originais. Isto cria uma discrepância entre o que o modelo aprendeu e o que surge na linha de produção.

Para se manterem atualizados, os conjuntos de dados precisam de ser atualizados regularmente com anotações internas de alta qualidade. Ultralytics simplifica a atualização das anotações e a expansão dos conjuntos de dados à medida que surgem novos padrões de defeitos. Estes conjuntos de dados atualizados podem então ser utilizados para retreinar modelos, ajudando as equipas a adaptarem-se mais rapidamente às condições de produção em constante mudança.

Os estaleiros de construção são ambientes dinâmicos, com várias equipas, equipamento em movimento e disposições em constante mudança. Manter a segurança nestas condições depende de dados visuais claros e bem anotados.

Anotações precisas podem melhorar a qualidade dos dados e ajudar os sistemas de IA a identificar trabalhadores, equipamentos, equipamento de segurança e riscos potenciais numa variedade de condições no local, incluindo cenários com muita gente, fundos em movimento e iluminação variável.

Ultralytics facilita este processo, permitindo atualizar e aperfeiçoar facilmente as anotações à medida que as condições no local evoluem. É possível capturar novas imagens e adicioná-las ao conjunto de dados à medida que surgem, mantendo-o alinhado com os cenários reais.

A anotação de alta qualidade é essencial para a criação de modelos fiáveis de visão computacional e IA, mas os fluxos de trabalho tradicionais acabam muitas vezes por atrasar as equipas. Ultralytics simplifica este processo com ferramentas de anotação automatizadas e um fluxo de trabalho escalável. Como resultado, as equipas conseguem avançar mais rapidamente dos dados para o modelo, mantendo a precisão e a consistência.

Conheça a nossa comunidade em crescimento e o nosso repositório no GitHub para saber mais sobre visão computacional. Se pretende desenvolver soluções de visão computacional, consulte as nossas opções de licenciamento. Explore as nossas páginas de soluções para saber mais sobre os benefícios da visão computacional na indústria transformadora e da IA na área da saúde.

Comece sua jornada com o futuro do aprendizado de máquina