FastVLM: Apple giới thiệu mô hình ngôn ngữ thị giác nhanh mới của mình

Apple ra mắt FastVLM tại CVPR 2025. Mô hình ngôn ngữ‑thị giác mã nguồn mở này có bộ mã hóa FastViTHD, mang lại thời gian hiển thị mã thông báo đầu tiên nhanh hơn tới 85 ×.

Apple ra mắt FastVLM tại CVPR 2025. Mô hình ngôn ngữ‑thị giác mã nguồn mở này có bộ mã hóa FastViTHD, mang lại thời gian hiển thị mã thông báo đầu tiên nhanh hơn tới 85 ×.

Tại hội nghị CVPR 2025, Apple đã giới thiệu một mô hình AI mã nguồn mở mới có tên là FastVLM. Nó được xây dựng để hiểu cả hình ảnh và ngôn ngữ, và nó chạy trên các thiết bị Apple như iPhone, iPad và Mac. Điều này có nghĩa là nó có thể cung cấp kết quả thông minh một cách nhanh chóng, mà không cần gửi dữ liệu của bạn lên đám mây.

Điều gì khiến FastVLM trở nên đặc biệt thú vị là tốc độ và hiệu quả của nó. Apple đã phát triển một bộ mã hóa thị giác mới có tên là FastViTHD, giúp mô hình diễn giải hình ảnh chất lượng cao trong khi sử dụng ít bộ nhớ và năng lượng hơn. Tất cả quá trình xử lý diễn ra cục bộ trên thiết bị, giúp thời gian phản hồi nhanh hơn đồng thời bảo vệ quyền riêng tư của người dùng.

Trong bài viết này, chúng ta sẽ khám phá cách FastVLM hoạt động, điều gì làm nên sự khác biệt của nó và tại sao bản phát hành này của Apple có thể là một bước tiến quan trọng đối với các ứng dụng AI hàng ngày trên thiết bị của bạn.

Trước khi chúng ta đi sâu vào điều gì làm cho FastVLM trở nên đặc biệt, hãy xem qua chữ “VLM” trong tên của nó có nghĩa là gì. Nó đề cập đến một mô hình ngôn ngữ thị giác, được thiết kế để hiểu và kết nối nội dung trực quan với ngôn ngữ.

Mô hình VLM kết hợp khả năng hiểu hình ảnh và ngôn ngữ, cho phép chúng thực hiện các tác vụ như mô tả ảnh, trả lời câu hỏi về ảnh chụp màn hình hoặc trích xuất văn bản từ tài liệu. Mô hình ngôn ngữ thị giác (Vision-language models) thường hoạt động theo hai phần: một phần xử lý hình ảnh và chuyển đổi nó thành dữ liệu, phần còn lại diễn giải dữ liệu đó để tạo ra phản hồi mà bạn có thể đọc hoặc nghe.

Bạn có thể đã sử dụng loại đổi mới AI này mà thậm chí không nhận ra. Các ứng dụng quét biên lai, đọc thẻ ID, tạo chú thích hình ảnh hoặc giúp những người có thị lực kém tương tác với màn hình của họ thường dựa vào các mô hình ngôn ngữ thị giác chạy âm thầm ở chế độ nền.

Apple đã xây dựng FastVLM để thực hiện các tác vụ tương tự như các mô hình ngôn ngữ thị giác khác, nhưng với tốc độ cao hơn, quyền riêng tư mạnh mẽ hơn và hiệu suất được tối ưu hóa trên các thiết bị của riêng mình. Nó có thể hiểu nội dung của một hình ảnh và trả lời bằng văn bản, nhưng không giống như nhiều mô hình dựa vào máy chủ đám mây, FastVLM có thể chạy hoàn toàn trên iPhone, iPad hoặc Mac của bạn.

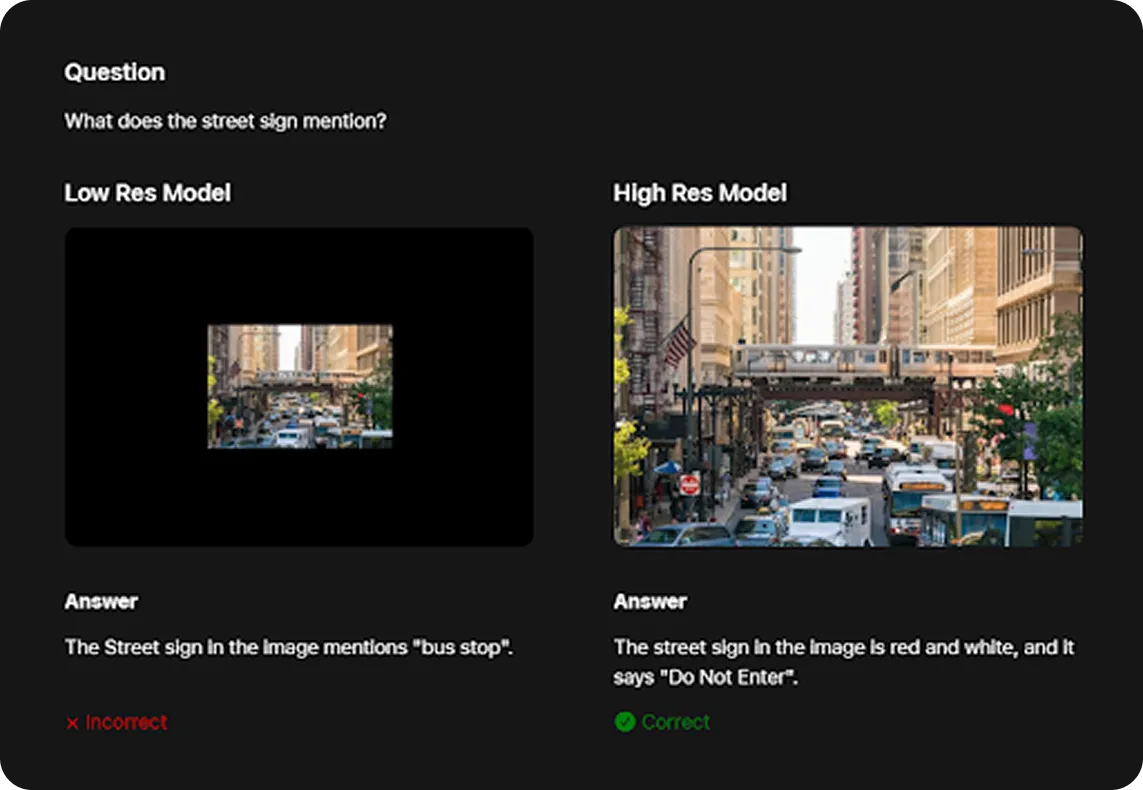

Nhìn chung, VLM hoạt động tốt hơn với hình ảnh có độ phân giải cao. Ví dụ: như hình bên dưới, FastVLM chỉ có thể xác định chính xác biển báo đường phố là “Cấm vào” khi được cung cấp phiên bản có độ phân giải cao của hình ảnh. Tuy nhiên, đầu vào có độ phân giải cao thường làm chậm mô hình. Đây là điểm khác biệt của FastViTHD.

Bộ mã hóa thị giác mới của Apple, FastViTHD, giúp FastVLM xử lý hình ảnh chất lượng cao hiệu quả hơn, sử dụng ít bộ nhớ và năng lượng hơn. Cụ thể, FastViTHD đủ nhẹ để chạy mượt mà ngay cả trên các thiết bị nhỏ hơn.

Ngoài ra, FastVLM hiện có sẵn công khai trên kho lưu trữ FastVLM GitHub, nơi các nhà phát triển có thể truy cập mã nguồn, thực hiện các thay đổi và sử dụng nó trong các ứng dụng của riêng họ theo các điều khoản cấp phép của Apple.

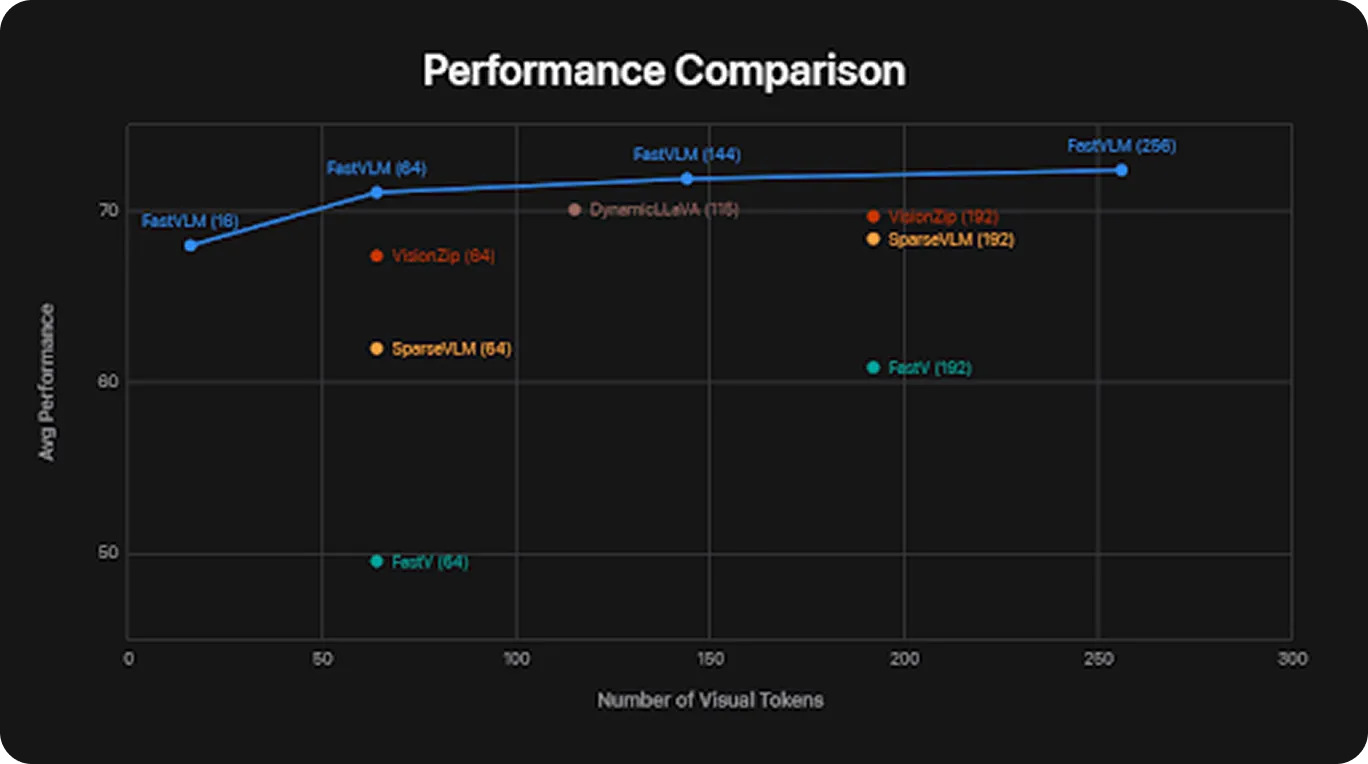

So với các mô hình ngôn ngữ thị giác khác, FastVLM được tối ưu hóa để chạy trên các thiết bị hàng ngày như điện thoại thông minh và máy tính xách tay. Trong các thử nghiệm hiệu suất, FastVLM tạo ra từ hoặc đầu ra đầu tiên nhanh hơn tới 85 lần so với các mô hình như LLaVA-OneVision-0.5B.

Đây là cái nhìn sơ lược về một số tiêu chuẩn đánh giá mà FastVLM đã được đánh giá:

Trong các điểm chuẩn này, FastVLM đạt được kết quả cạnh tranh trong khi sử dụng ít tài nguyên hơn. Nó mang AI trực quan thiết thực đến các thiết bị hàng ngày như điện thoại, máy tính bảng và máy tính xách tay.

Tiếp theo, hãy xem xét kỹ hơn về FastViTHD, bộ mã hóa hình ảnh đóng vai trò quan trọng trong hiệu suất xử lý hình ảnh của FastVLM.

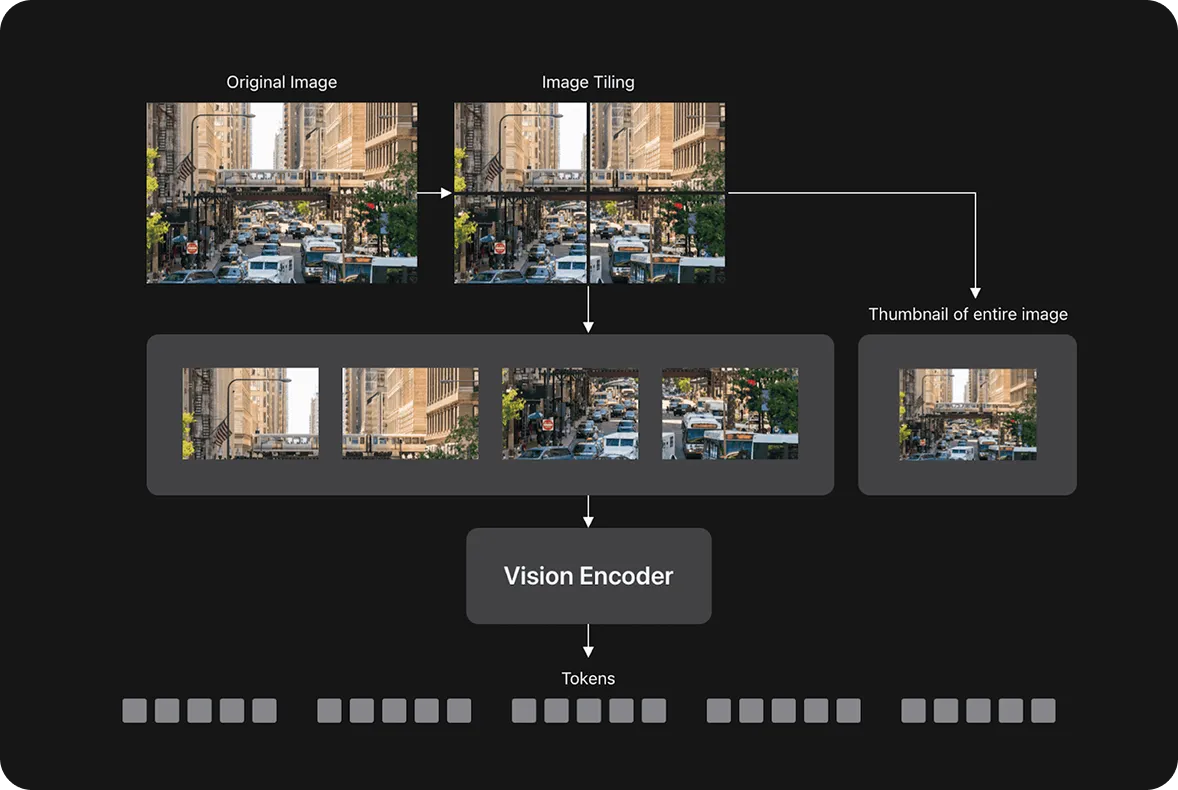

Hầu hết các mô hình ngôn ngữ thị giác chia một hình ảnh thành hàng nghìn vùng nhỏ gọi là token. Càng nhiều token, mô hình càng cần nhiều thời gian và năng lượng để hiểu hình ảnh. Điều này có thể làm chậm quá trình, đặc biệt là trên điện thoại hoặc máy tính xách tay.

FastViTHD tránh sự chậm lại khi xử lý quá nhiều token bằng cách sử dụng ít token hơn, đồng thời vẫn hiểu toàn bộ hình ảnh. Nó kết hợp hai phương pháp: transformers, rất giỏi trong việc mô hình hóa các mẫu và mối quan hệ, và các lớp tích chập, có hiệu quả trong việc xử lý dữ liệu trực quan. Kết quả là một hệ thống hoạt động nhanh hơn và sử dụng ít bộ nhớ hơn.

Theo Apple, FastViTHD nhỏ hơn tới 3,4 lần so với một số bộ mã hóa hình ảnh truyền thống, đồng thời vẫn duy trì độ chính xác cao. Thay vì dựa vào các kỹ thuật tối ưu hóa mô hình như tỉa bớt token (loại bỏ các vùng ảnh ít quan trọng để tăng tốc độ xử lý), nó đạt được hiệu quả thông qua một kiến trúc đơn giản và hợp lý hơn.

Apple đã phát hành FastVLM với ba kích thước khác nhau: 0,5B, 1,5B và 7B tham số (trong đó "B" là viết tắt của tỷ, đề cập đến số lượng trọng số có thể huấn luyện trong mô hình). Mỗi phiên bản được thiết kế để phù hợp với các loại thiết bị khác nhau. Các mô hình nhỏ hơn có thể chạy trên điện thoại và máy tính bảng, trong khi mô hình 7B lớn hơn phù hợp hơn cho máy tính để bàn hoặc các tác vụ đòi hỏi khắt khe hơn.

Điều này mang lại cho các nhà phát triển sự linh hoạt để chọn những gì phù hợp nhất cho ứng dụng của họ. Họ có thể xây dựng một thứ gì đó nhanh chóng và nhẹ cho thiết bị di động hoặc thứ gì đó phức tạp hơn cho các hệ thống lớn hơn, tất cả trong khi sử dụng cùng một kiến trúc mô hình cơ bản.

Apple đã huấn luyện các biến thể mô hình FastVLM bằng quy trình LLaVA‑1.5, một khuôn khổ để căn chỉnh thị giác và các mô hình ngôn ngữ. Đối với thành phần ngôn ngữ, họ đã đánh giá FastVLM bằng các mô hình mã nguồn mở hiện có như Qwen và Vicuna, được biết đến với khả năng tạo ra văn bản tự nhiên và mạch lạc. Thiết lập này cho phép FastVLM xử lý cả hình ảnh đơn giản và phức tạp, đồng thời tạo ra các phản hồi dễ đọc và phù hợp.

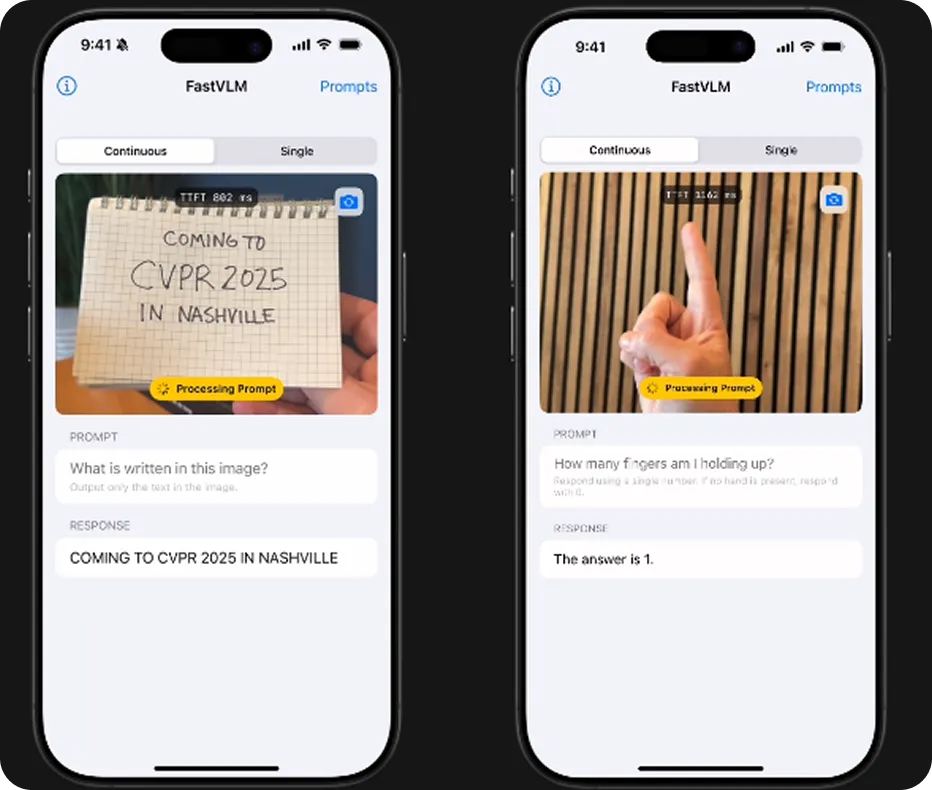

Bạn có thể tự hỏi, tại sao khả năng xử lý hình ảnh hiệu quả của FastVLM lại quan trọng? Điều này liên quan đến mức độ mượt mà mà các ứng dụng có thể hoạt động trong thời gian thực mà không cần dựa vào đám mây. FastVLM có thể xử lý hình ảnh có độ phân giải cao, lên đến 1152 x 1152 pixel, đồng thời vẫn đủ nhanh và nhẹ để chạy trực tiếp trên thiết bị của bạn.

Điều này có nghĩa là các ứng dụng có thể mô tả những gì camera nhìn thấy, quét biên lai khi chúng được chụp hoặc phản hồi các thay đổi trên màn hình, tất cả đều diễn ra cục bộ. Nó đặc biệt hữu ích cho các lĩnh vực như giáo dục, khả năng tiếp cận, năng suất và nhiếp ảnh.

Vì FastViTHD hiệu quả ngay cả với những hình ảnh lớn, nó giúp các thiết bị luôn phản hồi nhanh và mát mẻ. Nó hoạt động với tất cả các kích thước mô hình, kể cả mô hình nhỏ nhất, chạy trên iPhone cơ bản. Điều đó có nghĩa là các tính năng AI tương tự có thể hoạt động trên điện thoại, máy tính bảng và máy Mac.

FastVLM có thể cung cấp năng lượng cho một loạt các ứng dụng, nhờ các lợi ích chính của nó như tốc độ, hiệu quả và quyền riêng tư trên thiết bị. Dưới đây là một vài cách nó có thể được sử dụng:

Trợ lý AI trên thiết bị: FastVLM có thể hoạt động tốt với các trợ lý AI cần nhanh chóng hiểu những gì trên màn hình. Vì nó chạy trực tiếp trên thiết bị và giữ dữ liệu ở chế độ riêng tư, nó có thể giúp thực hiện các tác vụ như đọc văn bản, xác định các nút hoặc biểu tượng và hướng dẫn người dùng trong thời gian thực mà không cần gửi thông tin lên đám mây.

FastVLM mang AI ngôn ngữ thị giác trên thiết bị đến các thiết bị Apple, kết hợp tốc độ, quyền riêng tư và hiệu quả. Với thiết kế gọn nhẹ và bản phát hành mã nguồn mở, nó cho phép hiểu hình ảnh theo thời gian thực trên các ứng dụng di động và máy tính để bàn.

Điều này giúp làm cho AI trở nên thiết thực và dễ tiếp cận hơn để sử dụng hàng ngày, đồng thời cung cấp cho các nhà phát triển một nền tảng vững chắc để xây dựng các ứng dụng hữu ích, tập trung vào quyền riêng tư. Nhìn về phía trước, có khả năng các mô hình thị giác-ngôn ngữ sẽ đóng một vai trò quan trọng trong cách chúng ta tương tác với công nghệ, làm cho AI phản hồi nhanh hơn, nhận biết ngữ cảnh và hữu ích hơn trong các tình huống hàng ngày.

Khám phá kho lưu trữ GitHub của chúng tôi để tìm hiểu thêm về AI. Tham gia cộng đồng năng động của chúng tôi và khám phá những đổi mới trong các lĩnh vực như AI trong ngành ô tô và Vision AI trong sản xuất. Để bắt đầu với thị giác máy tính ngay hôm nay, hãy xem các tùy chọn cấp phép của chúng tôi.

Bắt đầu hành trình của bạn với tương lai của học máy