ImplementierungYOLO Ultralytics YOLO auf der Axelera-AI-Hardware für Edge-KI

Erfahren Sie mehr über die neue Export-Integration, die vomPython in Zusammenarbeit mit Axelera AI für effiziente, leistungsstarke Edge-KI unterstützt wird.

Erfahren Sie mehr über die neue Export-Integration, die vomPython in Zusammenarbeit mit Axelera AI für effiziente, leistungsstarke Edge-KI unterstützt wird.

Bei Ultralytics beobachten wir einen zunehmenden Trend, Computer-Vision-Modelle direkt auf Edge-Geräten auszuführen, da KI immer breitere Anwendung findet. In unseren Gesprächen mit der Computer-Vision-Community – sowohl online als auch persönlich auf den jüngsten Technologiekonferenzen – hat unser Team ein wachsendes Interesse daran festgestellt, Vision-KI näher an den Ort zu bringen, an dem die Daten generiert werden.

Von intelligenten Einzelhandelsumgebungen über industrielle Automatisierung bis hin zur Robotik – Echtzeit-Einblicke werden immer wichtiger, und es reicht nicht mehr aus, sich allein auf die Cloud zu verlassen.

Einfach ausgedrückt bedeutet Edge-KI, dass KI-Modelle lokal auf den Geräten ausgeführt werden, anstatt Daten zur Verarbeitung an zentrale Server zu senden. Dadurch lassen sich Latenzzeiten reduzieren, die Zuverlässigkeit verbessern und in Echtzeit auf Ereignisse in der realen Welt reagieren.

Der Einsatz leistungsstarker Modelle in diesen Umgebungen bringt jedoch eigene Herausforderungen mit sich, da begrenzte Rechenressourcen und Leistungsbeschränkungen erfordern, dass die Modelle sowohl effizient als auch für die Hardware, auf der sie laufen, optimiert sind.

Ultralytics YOLO wie Ultralytics sind für die Echtzeit-Bildverarbeitung konzipiert, doch um ihr volles Potenzial am Edge auszuschöpfen, bedarf es der richtigen Kombination aus Software und Hardware. Aus diesem Grund freuen wir uns, unsere Zusammenarbeit mit Axelera AI bekannt zu geben.

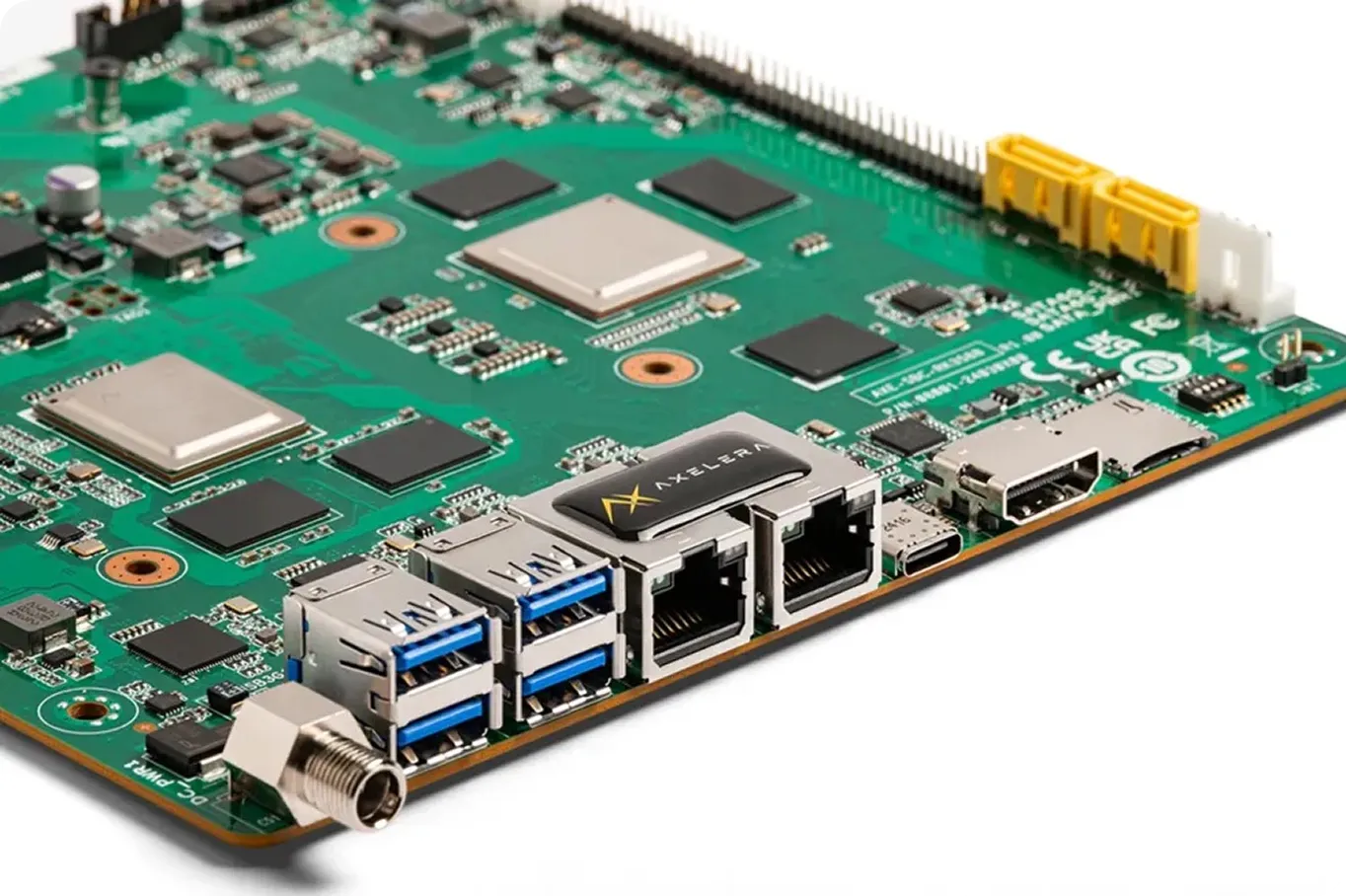

Wir haben uns mit Axelera AI zusammengetan, um eine aktualisierte Export-Integration einzuführen, die eine effiziente und leistungsstarke Bereitstellung von Ultralytics YOLO auf Metis®- AI-Processing-Units (AIPUs) ermöglicht.

In diesem Artikel werden wir uns damit befassen, wie sichYOLO ganz einfach für den Einsatz auf Metis kompilieren lassen. Los geht’s!

Da sich Anwendungen im Bereich der Bildverarbeitung ständig weiterentwickeln, wird der Bedarf an einer schnelleren und effizienteren Verarbeitung immer wichtiger. Herkömmliche cloudbasierte Ansätze können zu Verzögerungen führen, sind auf eine stabile Verbindung angewiesen und erfüllen möglicherweise nicht die Echtzeitanforderungen vieler intelligenter Bildverarbeitungsanwendungen.

Edge-KI bewältigt diese Herausforderungen, indem sie es ermöglicht, Modelle direkt auf lokalen Geräten auszuführen, sodass Daten näher an ihrer Quelle verarbeitet werden können. Nehmen wir zum Beispiel Drohnen mit Bildverarbeitungsfunktionen, die bei Such- und Rettungsaktionen zum Einsatz kommen.

Diese Systeme müssen Videobilder in Echtzeit analysieren, um detect , Hindernisse oder Gefahren detect – oft in abgelegenen Gebieten mit begrenzter oder gar keiner Internetverbindung. Durch die direkte Ausführung von Computer-Vision-Modellen auf der Drohne ermöglicht Edge-KI eine schnellere Entscheidungsfindung und eine zuverlässigere Leistung, ohne auf eine Cloud-Infrastruktur angewiesen zu sein.

Dieser Wandel eröffnet branchenübergreifend neue Möglichkeiten. Anwendungen wie die Objekterkennung in Echtzeit im Einzelhandel, die automatisierte Qualitätsprüfung in der Fertigung und die Wahrnehmung in der Robotik profitieren alle von schnelleren Reaktionszeiten und höherer Zuverlässigkeit.

Edge-KI entwickelt sich rasch zu einem entscheidenden Faktor für den Einsatz skalierbarer und reaktionsschneller Computer-Vision-Systeme in realen Umgebungen.

Bevor wir uns mit der neuen Exportintegration befassen, wollen wir einen Schritt zurücktreten und mehr über die Metis-KI-Verarbeitungseinheiten von Axelera AI und ihre Rolle bei der Realisierung effizienter Edge-KI erfahren.

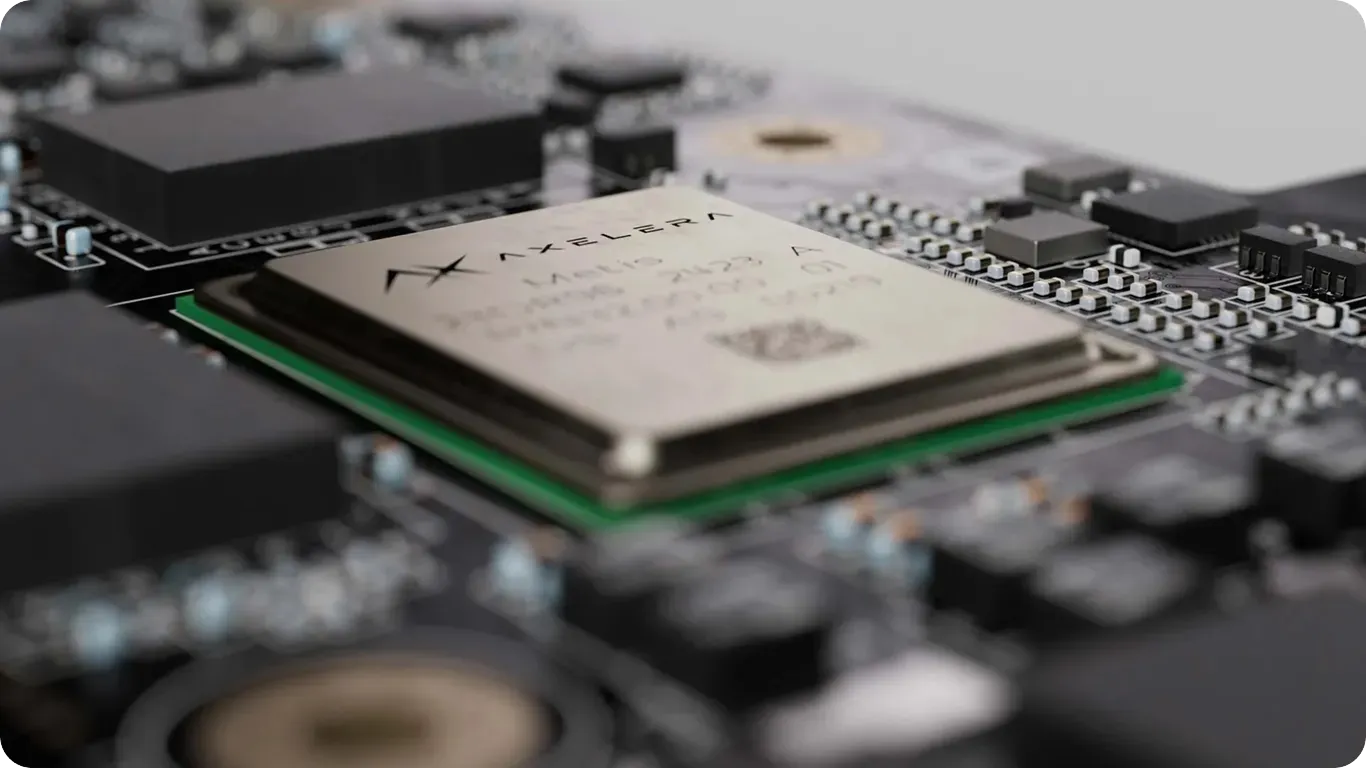

Axelera AI entwickelt speziell für die Beschleunigung von KI-Inferenz am Netzwerkrand konzipierte Hardware. Ein zentraler Bestandteil davon ist die Metis AIPU (AI Processing Unit), ein spezialisierter Prozessor, der dafür ausgelegt ist, neuronale Netze auf Edge-Geräten effizient auszuführen.

Im Gegensatz zu Allzweck-Zentralprozessoren (CPUs) oder sogar Grafikprozessoren (GPUs) sind AIPUs darauf ausgelegt, die spezifischen Rechenmuster von KI-Workloads zu bewältigen. Dadurch können sie eine hohe Leistung bei gleichzeitig geringem Stromverbrauch bieten, was für Edge-Umgebungen, in denen die Ressourcen oft begrenzt sind, von entscheidender Bedeutung ist.

Was den Ansatz von Axelera AI besonders innovativ macht, ist sein Full-Stack-Design. Metis basiert auf Digital In-Memory Computing (D-IMC) und RISC-V und bietet so hohe Leistung bei der Energieeffizienz, die Edge-Computing erfordert. Die vier Kerne von Metis sind unabhängig voneinander programmierbar, sodass pro Chip vier Modelle parallel ausgeführt werden können. Zusätzlich zur Hardware enthält das Voyager SDK einen Compiler und eine Laufzeitumgebung, die zusammenarbeiten, um Modelle für den Einsatz zu optimieren.

Dadurch können Entwickler effizienter von trainierten Modellen zu produktionsreifer Inferenz übergehen. Konkret ermöglichen Metis-AIPUs die direkte Ausführung fortschrittlicher Computer-Vision-Modelle, wie beispielsweiseYOLO , auf Edge-Geräten – von Umgebungen in Unternehmen, im Einzelhandel, im Gesundheitswesen und in der Fertigung bis hin zu landwirtschaftlichen Maschinen, Industrieanlagen und Satelliten.

Das Python Ultralytics bietet eine einheitliche Schnittstelle für das Trainieren, Bewerten und Bereitstellen YOLO für eine Vielzahl von Aufgaben im Bereich der Bildverarbeitung. YOLO werden in der Regel mit PyTorch entwickelt und trainiert, das sich hervorragend für Experimente und die Modellentwicklung eignet.

Wenn diese Modelle jedoch auf spezieller Edge-Hardware eingesetzt werden sollen, müssen sie in ein Format konvertiert werden, das für das Zielgerät optimiert ist. Hier kommen die vomPython unterstützten Export-Integrationen ins Spiel.

Ultralytics eine Reihe von Exportoptionen, mit denen YOLO je nach Einsatzziel in verschiedene Formate konvertiert werden können, darunter ONNX, TensorRT und andere hardwarespezifische Backends. Diese Integrationen vereinfachen die Vorbereitung von Modellen für den praktischen Einsatz, indem sie die erforderlichen Optimierungs- und Konvertierungsschritte übernehmen.

Auf dieser Grundlage Ultralytics eine aktualisierte Exportintegration mit Axelera AI eingeführt, die es ermöglicht, YOLO für den Einsatz auf Metis-AIPUs zu exportieren.

Beim Export wird das Modell kompiliert und in eine optimierte Darstellung quantisiert, die speziell für die Hardware von Axelera entwickelt wurde. Dieser Vorgang erzeugt ein kompiliertes Modell im „.axm“-Format sowie die für die Bereitstellung und die Inferenz erforderlichen Metadaten.

Die Integration unterstützt eine Vielzahl von Computer-Vision-Aufgaben in den Bereichen Ultralytics YOLOv8, Ultralytics YOLO11sowie die Modelle Ultralytics , einschließlich Objekterkennung, Posenabschätzung, Instanzsegmentierung, OBB-Erkennung (Oriented Bounding Box) und Bildklassifizierung. Während die meisten Aufgaben direkt über den Export-Workflow unterstützt werden, kann die YOLO26-Segmentierung über den Model Zoo mit dem Voyager SDK genutzt werden.

Diese erweiterte Unterstützung bietet Entwicklern die Flexibilität, je nach Anwendungsfall verschiedene Arten von Bildverarbeitungsmodellen einzusetzen – von der Erkennung von Objekten in Echtzeit über das Verstehen von Szenen bis hin zur Verfolgung von Bewegungen und der Analyse komplexer visueller Daten.

Nach dem Export können die Modelle bereitgestellt und ausgeführt werden, ohne dass PyTorch der Inferenz auf PyTorch zurückgegriffen werden muss. Stattdessen werden sie mithilfe der Voyager SDK-Laufzeitumgebung ausgeführt, die die Erstellung von End-to-End-Pipelines für Aufgaben wie Videoverarbeitung, Echtzeit-Erkennung und -Verfolgung direkt auf Edge-Geräten unterstützt.

Nachdem wir nun ein besseres Verständnis der neuen Exportintegration gewonnen haben, wollen wir uns ansehen, wie manYOLO in dieses benutzerdefinierte Format exportiert und sie auf Metis-Hardware am Netzwerkrand ausführt.

Zunächst müssen Sie dasPython Ultralytics installieren. Es bietet eine einfache und einheitliche Schnittstelle zum Trainieren, Auswerten und Exportieren von YOLO .

Sie können es mit pip installieren, indem Sie den folgenden Befehl in Ihrem Terminal oder in der Eingabeaufforderung ausführen:

pip install ultralytics

Sollten bei der Installation oder beim Export Probleme auftreten, bieten die offizielle Ultralytics und der Leitfaden zu häufigen Problemen wertvolle Hilfe bei der Fehlerbehebung.

Um Modelle auf Axelera-Hardware zu exportieren und auszuführen, müssen Sie außerdem die Axelera-Treiber und das Voyager SDK installieren. Dieser Schritt ermöglicht die Kommunikation mit der Metis AIPU und stellt die erforderlichen Laufzeit- und Compiler-Tools bereit.

Die folgenden Schritte müssen in einer Linux-Umgebung mit Zugriff auf Axelera AI Metis-Hardware durchgeführt werden. Öffnen Sie ein Terminal auf Ihrem System oder verwenden Sie eine Notebook-Zelle, falls Sie Jupyter Notebook auf einer kompatiblen lokalen Umgebung ausführen, und führen Sie die folgenden Befehle aus.

Fügen Sie zunächst den Schlüssel für das Axelera-Repository wie folgt hinzu:

sudo sh -c "curl -fsSL https://software.axelera.ai/artifactory/api/security/keypair/axelera/public | gpg --dearmor -o /etc/apt/keyrings/axelera.gpg"

Fügen Sie anschließend, wie unten gezeigt, das Axelera-Repository zu Ihrem System hinzu:

sudo sh -c "echo 'deb [signed-by=/etc/apt/keyrings/axelera.gpg] https://software.axelera.ai/artifactory/axelera-apt-source/ ubuntu22 main' > /etc/apt/sources.list.d/axelera.list"

Installieren Sie anschließend das Voyager SDK und laden Sie den Metis-Treiber wie folgt:

sudo apt update

sudo apt install -y metis-dkms=1.4.16

sudo modprobe metis

Sobald diese Schritte abgeschlossen sind, ist Ihr System bereit, Ultralytics YOLO zu exportieren und auf Axelera AI Metis-Geräten auszuführen.

Sobald das Ultralytics installiert ist, können Sie Ihr YOLO laden und als kompiliertes Paket für Metis exportieren. Bei diesem Vorgang wird das Modell in ein Format konvertiert, das für den Einsatz auf der Axelera AI Metis-Hardware optimiert ist.

Im folgenden Beispiel verwenden wir ein vortrainiertes YOLO26-Nano-Modell und exportieren es für Metis. Das exportierte Modell wird in einem Verzeichnis namens „/yolo26n_axelera_model“ gespeichert.

from ultralytics YOLO

model = YOLO("yolo26n.pt")

model.export(format="axelera")

Nach dem Export des Modells können Sie es laden und Inferenzberechnungen für bisher unbekannte Bilder oder Videostreams durchführen. Dies ermöglicht Computer-Vision-Aufgaben in Echtzeit direkt auf Axelera AI Metis-Geräten.

Das folgende Code-Schnipsel zeigt beispielsweise, wie man das exportierte Modell lädt und eine Inferenz über eine öffentlich zugängliche URL durchführt.

axelera_model = YOLO("yolo26n_axelera_model")

results = axelera_model("ultralytics", save=True)

In diesem Fall analysiert das Modell das Eingabebild, erkennt Objekte und speichert die Ergebnisse im Verzeichnisdetect“.

Als Nächstes wollen wir einige gängige Edge-AI-Anwendungen betrachten, bei denen Ultralytics YOLO in realen Szenarien auf Axelera-AI-Hardware eingesetzt werden können.

Die Metis-AIPUs von Axelera AI sind für eine Vielzahl von Einsatzumgebungen konzipiert, von eingebetteten Systemen und Industrie-PCs bis hin zu Robotik und Edge-Servern. Dank ihrer leistungsstarken und energieeffizienten Inferenzfunktionen ermöglichen sie die branchenübergreifende Ausführung von Computer-Vision-Anwendungen direkt auf dem Gerät. Das Voyager SDK enthält zudem einen Pipeline-Builder, mit dem ML- und APP-Entwickler Modelle für den Edge-Einsatz produktionsreif machen können.

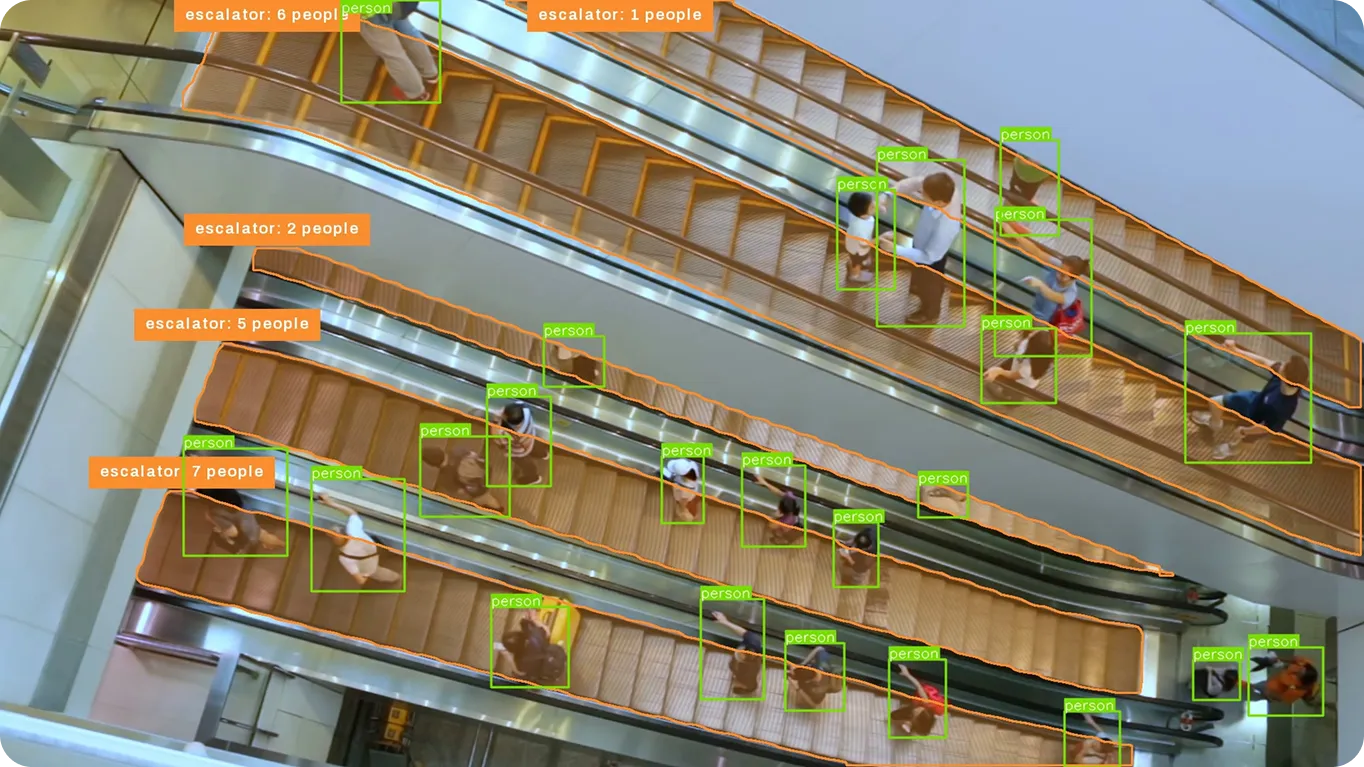

Im Einzelhandel kann es entscheidend sein, das Kundenverhalten in Echtzeit zu verstehen.

Mithilfe vonYOLO , die auf Axelera-AI-Hardware laufen, können Geschäfte die Kundenfrequenz überwachen, Personen zählen und Bewegungsmuster im Laden in Echtzeit analysieren. Da alles direkt auf dem Gerät verarbeitet wird, lassen sich Erkenntnisse sofort gewinnen, ohne dass eine Cloud-Verbindung erforderlich ist. So können Teams schneller reagieren und gleichzeitig den Datenschutz gewährleisten.

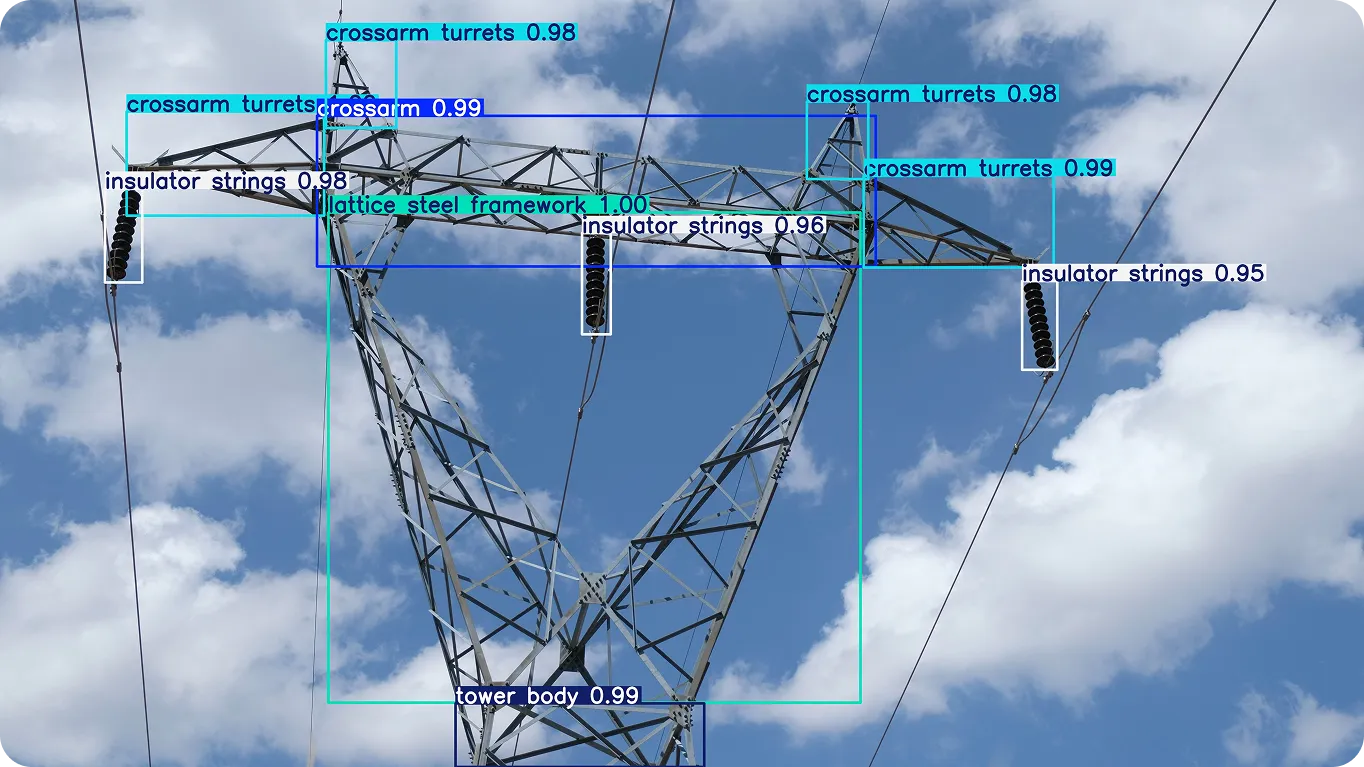

Die Instandhaltung groß angelegter Infrastruktur wie Stromleitungen ist komplex und ressourcenintensiv. Diese Netze erstrecken sich oft über weite Entfernungen, was Inspektionen zeitaufwendig, kostspielig und potenziell gefährlich macht. Wenn Störungen oder erste Anzeichen von Verschleiß unentdeckt bleiben, können sie zu Ausfällen, Geräteschäden oder Sicherheitsrisiken führen.

Drohnen werden zunehmend eingesetzt, um die Effizienz von Inspektionen zu steigern. Sie können große Entfernungen zurücklegen, schwer zugängliche Bereiche erreichen und hochauflösende Bilder von kritischen Anlagen aufnehmen.

Die Kombination von Drohnen mit Edge-KI optimiert diese Arbeitsabläufe zusätzlich.YOLO Ultralytics , die auf Axelera-AI-Hardware laufen, ermöglichen Echtzeitanalysen während der Inspektionen, wodurch Fehler erkannt, Komponenten klassifiziert und Anomalien vor Ort aufgedeckt werden. Dies verringert den Bedarf an manuellen Überprüfungen und ermöglicht eine schnellere und zuverlässigere Überwachung der Infrastruktur.

In der Robotik sind Geschwindigkeit und Reaktionsfähigkeit von entscheidender Bedeutung. Ob sie sich nun in einem Lager bewegen oder in dynamischen industriellen Umgebungen eingesetzt werden – Roboter müssen ihre Umgebung sofort erfassen.

YOLO auf Axelera-AI-Hardware laufendenYOLO Ultralytics ermöglichen es Robotern, ihre Umgebung in Echtzeit zu erfassen – von der Erkennung von Hindernissen über die Verfolgung von Personen bis hin zur Identifizierung von Objekten. Dadurch können sich die Systeme sicherer bewegen, sich an dynamische Bedingungen anpassen und mit größerer Autonomie arbeiten, ohne auf eine ständige Cloud-Verbindung angewiesen zu sein.

Hier sind einige der wichtigsten Vorteile des Einsatzes von Ultralytics YOLO auf der Metis-Hardware von Axelera AI mithilfe der neuen Integration:

YOLO Ultralytics und die Metis-AIPUs von Axelera AI erleichtern die Implementierung leistungsstarker Computer-Vision-Lösungen am Edge. Durch die Vereinfachung der Bereitstellung und die Optimierung der Modelle für spezielle Hardware trägt diese Integration dazu bei, die Lücke zwischen Entwicklung und praktischen Anwendungen zu schließen.

Da Edge-KI weiter zunimmt, werden effiziente und skalierbare Bereitstellungsoptionen entscheidend sein, um reaktionsschnelle und zuverlässige Systeme aufzubauen. Diese Zusammenarbeit ist ein Schritt dahin, fortschrittliche Bildverarbeitungs-KI branchenübergreifend zugänglicher zu machen.

Möchten Sie mehr über KI erfahren? Erkunden Sie unser GitHub-Repository, vernetzen Sie sich mit unserer Community und informieren Sie sich über unsere Lizenzoptionen, um Ihr Computer-Vision-Projekt zu starten. Finden Sie heraus, wie Innovationen wie KI im Einzelhandel und Computer Vision im Gesundheitswesen die Zukunft gestalten.

Beginnen Sie Ihre Reise mit der Zukunft des maschinellen Lernens