Ultralytics YOLO26 vs YOLO11 vs YOLOv8: Welches Modell solltest du verwenden?

Entdecke Ultralytics YOLO26 vs Ultralytics YOLO11 vs Ultralytics YOLOv8 und finde heraus, welches Computer-Vision-Modell du für deine Projekte wählen solltest.

Hochmoderne Computer-Vision-Systeme, die oft auf faltenden neuronalen Netzen (CNNs) basieren, ermöglichen es Maschinen, visuelle Daten aus Bildern und Videos zu analysieren und zu interpretieren. Sie kommen mittlerweile in unterschiedlichsten Umgebungen zum Einsatz.

Von der Landwirtschaft über die Fertigung bis hin zum Einzelhandel – diese Systeme arbeiten in einer Vielzahl von Einsatzumgebungen, darunter Edge-Geräte, eingebettete Hardware, Internet of Things (IoT)-Geräte, On-Device-Verarbeitung und groß angelegte Cloud-Pipelines, die Echtzeitanwendungen unterstützen.

In der Praxis ist die Bereitstellung dieser Modelle nicht immer ganz einfach. Sie müssen oft mit begrenzten Rechenressourcen auskommen, strenge Latenzanforderungen erfüllen und skalieren, ohne die Kosten erheblich in die Höhe zu treiben. Diese Einschränkungen machen die Leistung zu einem mehrdimensionalen Problem und nicht nur zu einer Frage der Genauigkeit.

Obwohl Genauigkeit nach wie vor wichtig ist, ist es genauso entscheidend, dass ein Modell in der Produktion effizient läuft. Faktoren wie Geschwindigkeit, Ressourcenverbrauch und Skalierbarkeit spielen eine große Rolle dabei, wie gut ein System im Laufe der Zeit funktioniert.

Computer-Vision-Modelle wie Ultralytics YOLO Modelle wurden mit diesem Gleichgewicht im Hinterkopf entwickelt. Zum Beispiel hat Ultralytics YOLOv8 ein starkes und vielseitiges Fundament geschaffen, Ultralytics YOLO11 hat dies mit verbesserter Geschwindigkeit und Genauigkeit weiter ausgebaut, und Ultralytics YOLO26 baut darauf auf, indem es leichter, schneller und effizienter als je zuvor ist.

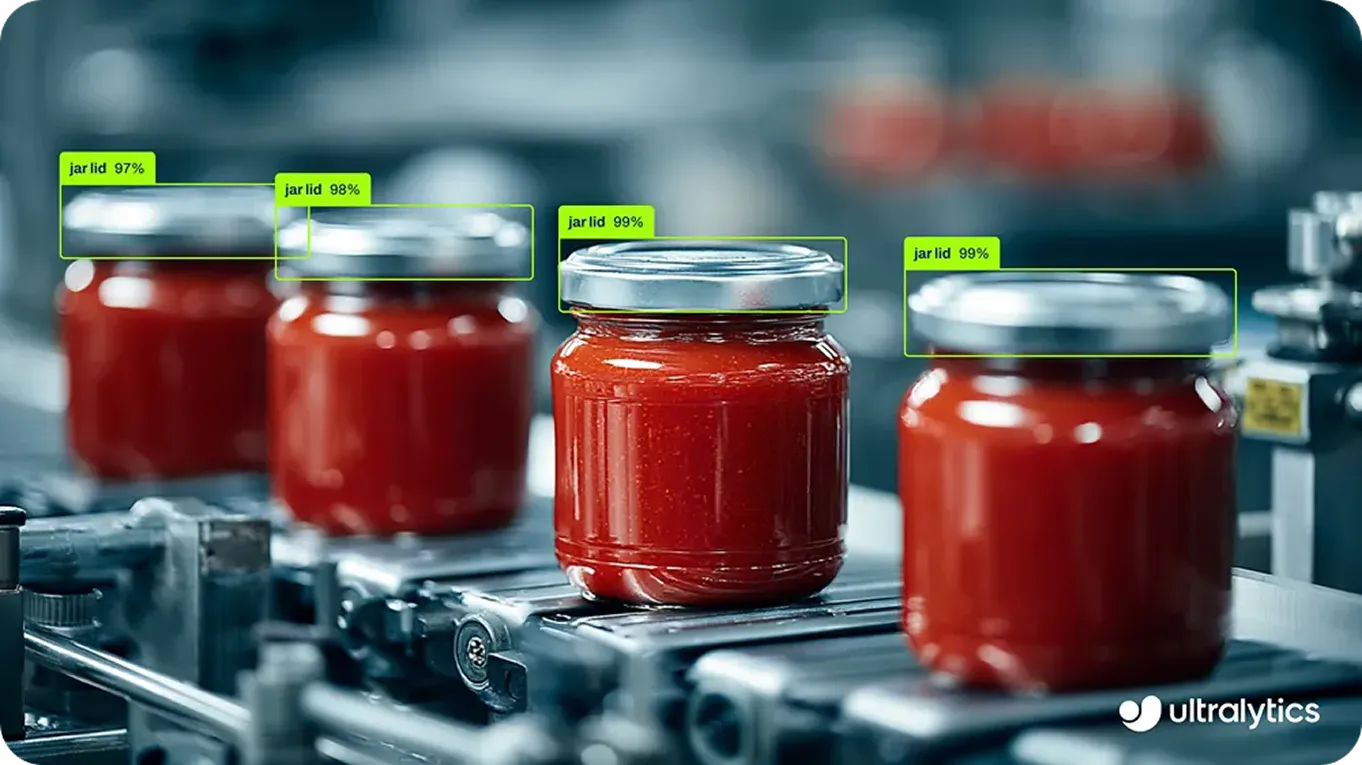

Abb. 1: Verwendung von Ultralytics YOLO26 zur Objekterkennung in einem Bild (Quelle)

In diesem Artikel vergleichen wir Ultralytics YOLO26 vs YOLO11 vs YOLOv8, um dir bei der Auswahl des richtigen Modells für dein Computer-Vision-Projekt zu helfen. Fangen wir an!

Link to this sectionVerständnis der Entwicklung von Ultralytics YOLO Modellen#

Jede Iteration der Ultralytics YOLO Modelle hat Verbesserungen eingeführt, um Anforderungen aus der Praxis besser zu erfüllen und Computer Vision zugänglicher zu machen. Diese Updates haben die Modelle schneller, effizienter und einfacher bereitzustellen gemacht und fördern das Wachstum des Vision AI-Ökosystems.

Sie basieren außerdem auf PyTorch, was das Training, die Anpassung und die Integration in intelligente Machine-Learning-Workflows erleichtert. Die Ultralytics YOLO Modelle sind sofort einsatzbereit als vortrainierte Modelle verfügbar, die oft auf Datensätzen wie dem COCO Datensatz trainiert wurden, sodass Teams schnell starten und sie für spezifische Anwendungsfälle feinabstimmen können.

Darüber hinaus vereinfacht das Ultralytics Python Paket die Bereitstellung, indem es integrierte Unterstützung für den Export von Modellen in Formate wie ONNX und TensorRT bietet. Dies erleichtert die Integration von Modellen über verschiedene Hardwareplattformen hinweg, von Edge-Geräten bis hin zu GPU-beschleunigten Systemen.

Link to this sectionDer Weg von Ultralytics YOLOv5 zu Ultralytics YOLO26#

Das erste Ultralytics YOLO Modell, Ultralytics YOLOv5, wurde aufgrund seiner zuverlässigen Objekterkennungsfähigkeiten sehr populär. Basierend auf einem einstufigen Erkennungsansatz ermöglichte es schnelle Echtzeitvorhersagen in einem einzigen Durchgang, wodurch es sich gut für Produktionsworkflows eignete.

Spätere Updates führten anchor-freie Varianten ein, bei denen das Modell Objektpositionen direkt vorhersagt, anstatt vordefinierte Anchor-Boxen zu verwenden, was die Erkennung flexibler macht. Das ursprüngliche Modell konzentrierte sich jedoch weiterhin primär auf Objekterkennungsaufgaben.

Darauf aufbauend erweiterte YOLOv8 den Anwendungsbereich der Modellfamilie. Anstatt sich nur auf Objekterkennung zu konzentrieren, fügte es Unterstützung für mehrere Computer-Vision-Aufgaben wie Instanzsegmentierung, Bildklassifizierung, Posenschätzung und die Erkennung von orientierten Bounding Boxes (OBB) hinzu. Es brachte auch architektonische Verbesserungen mit sich, darunter fortschrittliche Backbone- und Neck-Designs, die die Merkmalsextraktion und die allgemeine Erkennungsleistung verbesserten.

Darüber hinaus gaben Varianten wie YOLOv8n (Nano), YOLOv8s (Small), YOLOv8m (Medium), YOLOv8l (Large) und YOLOv8x (Extra Large) Entwicklern die Flexibilität, Geschwindigkeit, Genauigkeit und Ressourcenverbrauch je nach Bedarf auszubalancieren. Diese erweiterte Funktionalität, kombiniert mit der einfachen Bedienung, machte es zur ersten Wahl für eine Vielzahl von Vision-Anwendungen.

Abb. 2: YOLO Modelle wie YOLOv8, YOLO11 und YOLO26 unterstützen eine Reihe von Vision-Aufgaben.

Anschließend konzentrierte sich YOLO11 auf die Verbesserung der Leistung in realen Workflows und lieferte eine höhere Genauigkeit bei schnelleren Inferenzgeschwindigkeiten. Mit einer leichteren Architektur funktioniert es sowohl in Edge- als auch in Cloud-Umgebungen gut und ist gleichzeitig mit bestehenden YOLOv8-Pipelines kompatibel.

Die neueste Ergänzung der Ultralytics YOLO Modellfamilie, YOLO26, ist ein hochmodernes Modell, das einen neuen Standard für Edge-first Vision AI setzt und einen leichteren, schnelleren und effizienteren Ansatz für die praktische Bereitstellung bietet. Es wurde so konzipiert, dass es effizient auf CPUs und eingebetteten Systemen läuft, während die Bereitstellung vereinfacht und die Echtzeitleistung über eine Vielzahl von Anwendungen hinweg verbessert wird.

Link to this sectionVergleich von YOLO26 vs YOLO11 vs YOLOv8#

Wenn du an Computer-Vision-Projekten arbeitest, stößt du möglicherweise auf verschiedene Ultralytics Modelle und fragst dich, welches das richtige für dein Projekt ist. Gehen wir durch, wie sich YOLO26, YOLO11 und YOLOv8 in realen Szenarien vergleichen.

YOLOv8 wurde 2023 veröffentlicht und wird seither von der Computer-Vision-Community umfassend genutzt. Seine starke Community-Unterstützung und Benutzerfreundlichkeit machten es in der Vergangenheit für viele Teams zur ersten Wahl. Wenn du ein gut dokumentiertes Modell mit einer Vielzahl von Tutorials, Anleitungen und Community-Ressourcen suchst, ist YOLOv8 ein großartiger Ausgangspunkt.

Im Jahr 2024 wurde YOLO11 mit Verbesserungen sowohl bei der Leistung als auch bei der Effizienz eingeführt. Es bietet im Vergleich zu YOLOv8 eine bessere Geschwindigkeit und Genauigkeit, während es eine kleinere und optimiertere Architektur beibehält. Es ist ein ausgewogeneres Modell, das in der Produktion zuverlässig arbeitet, ohne den Ressourcenverbrauch signifikant zu erhöhen.

In diesem Jahr wurde YOLO26 als neueste Iteration veröffentlicht, die sich auf die effiziente Bereitstellung im großen Maßstab konzentriert. Es liefert eine schnellere CPU-Inferenz und eine verbesserte Ressourcennutzung, was es Teams ermöglicht, mehr Workloads auf derselben Hardware auszuführen.

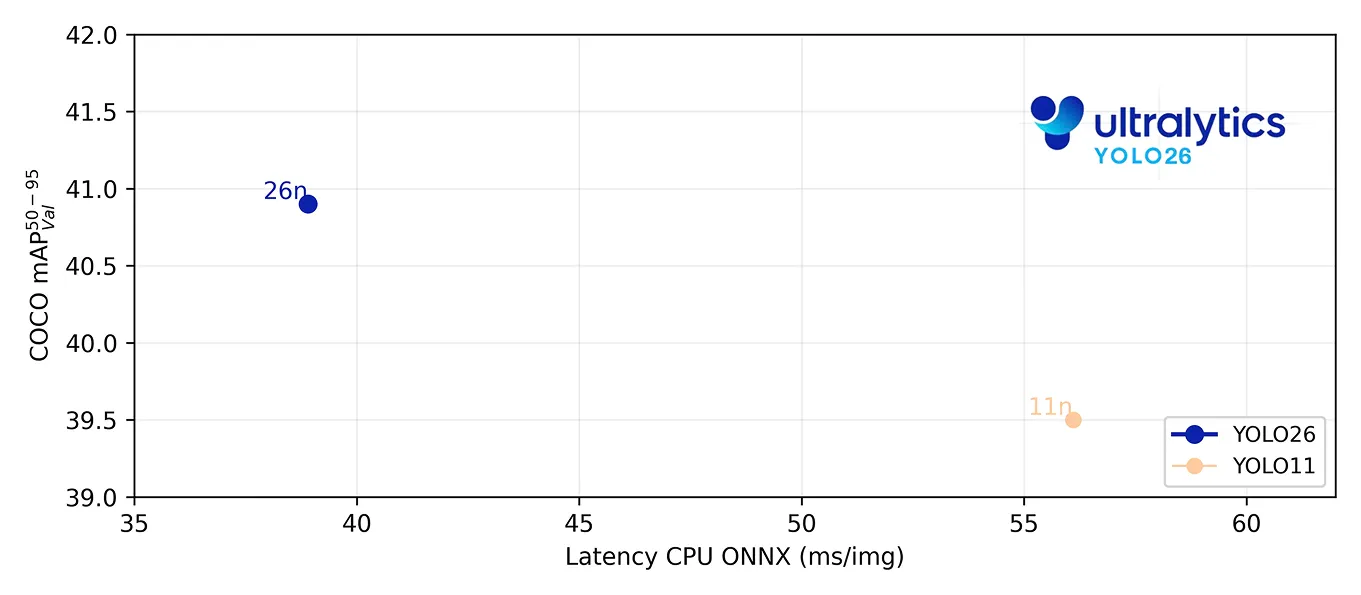

Beispielsweise kann das YOLO26 Nano-Modell eine bis zu 43 % schnellere Inferenz als YOLO11 auf Central Processing Units (CPU) erreichen, was es zu einer großartigen Option für Edge-Umgebungen und Umgebungen mit begrenzten Ressourcen macht. Dies ist besonders wichtig, da traditionelle Setups oft stark auf Graphics Processing Units (GPU) angewiesen sind, die kostspielig und schwieriger zu skalieren sein können.

Abb. 3: Benchmarking der Leistung von YOLO26 auf CPUs (Quelle)

Insgesamt ist YOLO26 eine solide Wahl für Teams und Einzelpersonen, die die Kompromisse zwischen Leistung, Kosten und Skalierbarkeit optimieren möchten.

Link to this sectionEin genauerer Blick auf Ultralytics YOLO26#

YOLO26 ist ein hochmodernes Modell, das für den realen Einsatz entwickelt wurde, wo Effizienz, Geschwindigkeit und Skalierbarkeit genauso wichtig sind wie Genauigkeit. Anstatt sich nur auf die Verbesserung der Benchmark-Leistung zu konzentrieren, führt es architektonische und trainingsbezogene Änderungen ein, die die Modelle einfacher auszuführen, schneller bereitzustellen und über verschiedene Hardwareumgebungen hinweg zuverlässiger machen.

Diese Verbesserungen sind besonders wichtig für Edge- und Produktionssysteme, bei denen begrenzte Rechenleistung, Latenzanforderungen und Kostenüberlegungen eine Schlüsselrolle spielen. Durch die Vereinfachung der Inferenz und die Optimierung der Leistung ermöglicht YOLO26 KI-Enthusiasten den effizienteren Aufbau und die Skalierung von Vision-Anwendungen.

Hier ist ein genauerer Blick auf einige der Hauptfunktionen von YOLO26:

- End-to-End NMS-freie Inferenz: Eine der entscheidenden Änderungen ist das Non-Maximum Suppression-freie (NMS) Design, das die Notwendigkeit für Nachbearbeitung eliminiert. Einfach ausgedrückt: Das Modell erzeugt direkt endgültige Vorhersagen. Dadurch wird die Latenz vorhersehbarer und die Bereitstellung einfacher.

- Entfernung von DFL: YOLO26 bewegt sich weg vom Distribution Focal Loss (DFL)-Modul hin zu einem einfacheren Ansatz zur Vorhersage von Bounding Boxes. Diese Änderung steht im Einklang mit seinem End-to-End NMS-freien Design, reduziert die Komplexität der Pipeline und verbessert die Konsistenz bei der Bereitstellung.

- MuSGD Optimizer: Die neuesten Ultralytics YOLO Modelle führen MuSGD ein, einen hybriden Optimierer, der Stochastic Gradient Descent (SGD) mit Muon-inspirierten Updates kombiniert. Dies verbessert die Trainingsstabilität und Konvergenz, was zu einer reibungsloseren Optimierung und konsistenterem Verhalten über verschiedene Modellgrößen hinweg führt.

- ProgLoss und STAL: Diese Trainingsinnovationen, Progressive Loss Balancing (ProgLoss) und Small-Target-Aware Label Assignment (STAL), machen das Modell stabiler und zuverlässiger. ProgLoss hilft dem Modell, schrittweise aus Datensätzen zu lernen, während STAL sicherstellt, dass kleine Objekte während des Trainings nicht ignoriert werden, was die Erkennung in komplexen Szenen verbessert.

Link to this sectionGenauigkeit vs Effizienz: Jenseits von Benchmarks hin zur realen Leistung#

Um die Unterschiede zwischen YOLO26, YOLO11 und YOLOv8 in einen Kontext zu setzen, lass uns die Faktoren besser verstehen, die die Modellleistung in der realen Welt bestimmen.

Genauigkeit, oft gemessen an Leistungsmetriken wie mean average precision (mAP), ist seit langem eine wichtige Methode zur Bewertung von Computer-Vision-Modellen. Sie zeigt, wie gut ein Modell unter standardisierten Bedingungen funktioniert und ist nützlich, wenn verschiedene Versionen verglichen werden.

Sobald Modelle jedoch vom Testen in den realen Einsatz übergehen, reicht Genauigkeit allein nicht mehr aus. Die Produktionsleistung hängt von Faktoren wie Modellgröße, Inferenzzeit oder Latenz, Rechenlast und der Skalierbarkeit des Systems in verschiedenen Umgebungen ab.

Im Gegensatz zu kontrollierten Benchmarks sind reale Umgebungen oft unvorhersehbar. Lichtverhältnisse können sich ändern, Objekte können teilweise sichtbar sein und Eingabedaten können erheblich von denen abweichen, auf denen das Modell trainiert wurde. Diese Variationen können beeinflussen, wie konsistent ein Modell in der Praxis funktioniert.

Abb. 4: Ein Beispiel für YOLO26 in einer unvorhersehbaren Umgebung, wie einer Baustelle.

Betrachte zum Beispiel ein Setup mit Hunderten von Kameras in einer Smart City, einem Einzelhandelsgeschäft oder einem Lagerhaus. Jeder Stream muss in Echtzeit verarbeitet werden, was oft konsistente Bildraten (Frames per Second, oder FPS) erfordert, um Verzögerungen oder Bildverluste zu vermeiden.

Ein weniger effizientes Modell kann weniger gleichzeitige Streams auf einem gegebenen System verarbeiten, was bedeutet, dass die Skalierung normalerweise zusätzliche Hardware erfordert und die Infrastrukturkosten erhöht.

Effizientere Modelle, wie YOLO26, können mehr Streams auf derselben Hardware verarbeiten und die verfügbaren Ressourcen besser nutzen. Dies verbessert die Gesamteffizienz des Systems und erleichtert die Skalierung von Bereitstellungen im Laufe der Zeit.

Um tiefer in den Vergleich von YOLO26 vs YOLO11 vs YOLOv8 einzutauchen, schau dir die offizielle Ultralytics Dokumentation an.

Link to this sectionWichtige Erkenntnisse#

Die Ultralytics YOLO Modellserie hat sich weiterentwickelt, um den Anforderungen der realen Bereitstellung besser gerecht zu werden. Jede Version baut auf der vorherigen auf, mit einem wachsenden Fokus auf Effizienz, Skalierbarkeit und einfache Bereitstellung. Mit anderen Worten: Wenn du eine Echtzeit-Erkennungsanwendung baust, die zuverlässig skalieren muss, ist Ultralytics YOLO26 eine perfekte Wahl.

Möchtest du Vision AI in deine Abläufe bringen? Sieh dir unsere Lizenzierungsoptionen an. Du kannst auch unsere Lösungsseiten besuchen, um zu sehen, wie KI in der Fertigung Fabriken transformiert und wie Vision AI in der Robotik die Zukunft gestaltet. Tritt unserer wachsenden Community bei und erkunde unser GitHub Repository für KI-Ressourcen.